基于图像的强化学习机械臂无标定视觉伺服系统

2024-07-07陈砆兴朱亚军

陈砆兴 朱亚军

摘 要: 为了解决传统机械臂视觉伺服受外界环境影响较大的问题,提出一种基于图像的无标定视觉伺服控制方法。该方法对采集的每一帧图像参数进行处理,无需繁琐的摄像头校准定位等操作,从而在复杂环境下获得了较高的抗干扰工作性能。通过动态的迭代学习过程实现机械臂的最优轨迹控制。在自由度机器臂测试平台上的实验结果表明:所提方法既可以减少模型参数,提高计算速度,又可以有效地对机械臂进行控制,可以对位置信息实施精确调整。

关键词: 机械臂 无标定视觉 非线性矩阵 轨迹控制

中图分类号: TP24文献标识码: A文章编号: 1679-3567(2024)04-0001-04

基金项目:甘肃省教育厅2022年度高等学校创新基金项目“苹果采摘机器人视觉定位与检测系统研究”(项目编号:2022A-225)。

The Uncalibrated Visual Servo System for Manipulators Based on the Reinforcement Learning of Images

CHEN Fuxing ZHU Yajun

Lanzhou Petrochemical University of Vocational Technology, Lanzhou, Gansu Province, 730060 China

Abstract: In order to solve the problem that the traditional visual servo of manipulators is greatly affected by the external environment, this paper proposes an image-based uncalibrated visual servo control method. This method processes the parameters of each frame of captured image without complicated camera calibration and positioning and other operations, so as to obtain high anti-interference performance in the complex environment, and realizes the optimal trajectory control of the manipulator through a dynamic iterative learning process. Experimental results on the freedom testing platform of the manipulator show that the proposed method can not only reduce model parameters and increase the calculation speed, but also effectively control the manipulator and accurately adjust its position information.

Key Words: Mechanical arm; Uncalibrated vision; Nonlinear matrix; Trajectory control

机械臂无标定视觉伺服是通过分析摄像机采集到每一帧的图像对机械臂进行控制。此领域涵盖的技术有机器人技术、计算机图像处理、控制等内容。传统的视觉伺服是基于无标定的需要大量的预处理和设置参数等操作。自20世纪90年代,无标定的视觉伺服系统应运而生,成为研究热点。

随着人工智能和机器人技术的发展,将强化学习应用于机械臂控制系统变成近年来机器人控制技术发展热点[1]。李静提出了基于模糊的强化学习方法来实现自动化路径规划的控制[2]。朱光耀利用强化学习解决了多关节机械臂轨迹跟踪等问题,该方法的模型分别为评价网络和动作网络,评价网络可以无限逼近长期的代价函数,动作网络被用于系统输入[3]。杨加超提出将非同步迭代规则用于强化学习中,可使机械臂在较强干扰条件下进行指定的动作,该方法在多机器人系统上加入了并行计算,节省了训练时间[4]。但是上述基于强化学习的方法均没有有效利用图像属性参数,因此本文尝试在强化学习中合理结合图像属性参数,来提高抗干扰能力,实现快速精确的机械臂控制。

1 强化学习的机械臂无标定视觉伺服控制方法

本文采取强化学习的机械臂无标定视觉伺服控制方法,首先,利用机械臂无标定视觉伺服控制进行每一帧的特征提取;其次,利用TD算法递推估计机械臂关节空间与图像属性参数空间之间的非线性矩阵。展示了基于强化学习的无标定视觉伺服控制平台。Cam1和Cam2为两个采集动态图像的摄像机。为了便于图像进行属性参数提取,为位姿定位提供有利条件。

1.1 基于强化学习的控制方法

基于强化学习的无标定视觉伺服总体控制结构和详细设计方案如图1所示。当机械臂在目标空间运动时,通过双目摄像头Cam1、Cam2来采集每一帧的图像信息,通过采集可以收集到4个图像属性参数点来反映机械臂末端位姿状态,其中,Cam1产生点P11、P12;Cam2产生点P21、P22;θ1是点P11、P12和Cam1采集的u轴之间夹角;θ2是点P21、P22和Cam2采集的u轴之间夹角。机械臂无标定视觉伺服控制利用当前fc与期望图像属性参数fd进行偏差运算,然后将关节控制器操控机械臂达到目标关节位置q,得出机械臂空间位姿信息T,最后使用双目摄像头Cam1、Cam2进行每一帧的图信息采集,并得到控制偏差的信息。迭代此过程,即可得到机械臂到期望位姿。

本文提出一种基于强化学习的视觉伺服控制方法,为特征偏差加权一个学习而得到的系数,通过使用Kalman在线滤波,可以令采集的图像信息特征和机械臂关节运动变化之间达到较优的逼近效果,以产生相对较优的空间运动轨迹。本文采用基于无模型强化学习算法中的帧间差分学习算法,学习训练无标定视觉伺服控制器,图1中Δf表示图像属性参数偏差值,S表示Agent状态,k表示图像属性参数偏差的运算系数[5]。

1.2 图像属性参数提取方法

无标定视觉伺服控制方法的优劣性,关键的一步在于对每一帧图像提取特征的效率和质量。为解决机械臂的轨迹控制问题,就必须在三维笛卡尔空间中对图像属性参数进行有效表示。因此,本文对图像属性参数提取的方法如图2所示。

如图2所示,为机械臂末端染上红黄颜料作为标记,可以使摄像头在提取图像信息时更高效,更有区别度,为后面图像处理时创造便捷条件。通过视觉传感器以及图像处理后,机械臂末端上分别投影到采集的图像1上的二维坐标为P11(u11,v11)和P12(u12,v12),采集的图像2上的二维坐标为P21(u21,v21)和P22(u22,v22)。当机械臂末端达到期望位姿,图像平面1的点P11(u11,v11)和P12() u12,v12与采集的图像2的点P21(u21,v21)和P22(u22,v22)分别为P1和P2在图像1和2上的期望投影点。

2 实验结果与分析

2.1 环境建模

利用自由度机器臂测试平台搭建实验环境,选取MT-ARM机械臂作为控制对象。首先要获悉机械臂的D-H参数。实验所用机械臂各连杆D-H参数如表1所示。

2.2 控制性能

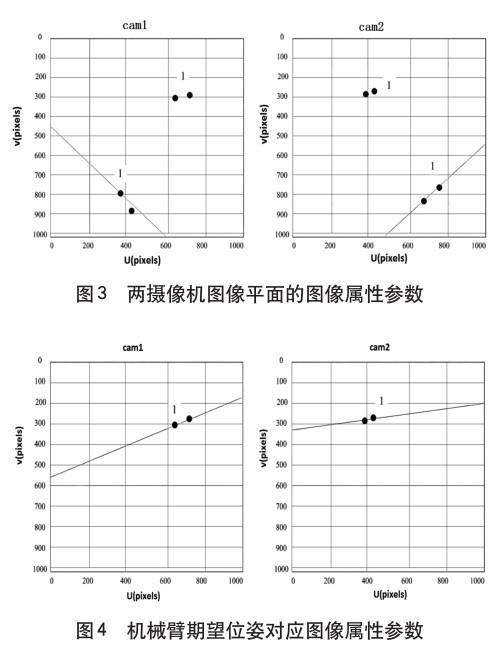

为了将机械臂移动范围限制在测试摄像机的工作区域内,训练开始前需要调节机械臂初始关节角。机械臂的两摄像机图像平面的图像属性参数如图3所示。

如图3所示,下方直线连接的2个坐标视为采集到的图片参数信息,上方2个坐标视为所需的图片参数信息。通过强化学习后,控制机械臂移动到当前迭代期望的目标位姿,其对应图像属性参数如图4所示。

在运行每一次强化学习任务后,对机械臂的图像属性参数偏差进行判断,如果Δf小于s16,则表示该强化学习任务结束。最终结合望位姿对应图像属性参数,利用所得的参数对机械臂进行训练。

在相同的实验条件下,将常规PID控制和本文强化学习控制进行了对比,机械臂控制和期望图像属性参数信息分别如表2和表3所示。

从表4可以看出,强化学习训练机械臂运动的前后过程,机械臂的开始位姿和采集的图像信息特征与期望位姿相同,但终止位姿和图像采集信息的特征上存有偏差。利用强化学习训练后,训练后期望图像属性参数与结束时图像属性参数偏差见表4。训练前后机械臂的控制轨迹见图5。

从表3和图5可以看出,机械臂经过训练后机械臂最终获得的图像属性参数偏差大大小于一个像素rad,也就是说位置准确度可以保持小于0.001 m范围。图5中,训练前后机械臂的控制轨迹通过迭代次数的增加与预测轨迹误差不断减少,当执行到100次迭代时趋于稳定,由此可见本文方法的鲁棒性较高。

3 结语

本文通过引入强化学习来对机械臂进行控制,提出一种无标定视觉伺服的方法,对采集的每一帧图像参数进行处理,利用强化学习中的TD算法递推估计机械臂关节空间与图像属性参数空间之间的非线性矩阵。实验结果表明:本文方法对于无标定的伺服系统控制起到了有效的作用,具有良好的性能。但是,TD算法仅能够处理离散函数问题,这对机械臂的控制精度有不利影响,因此后续将尝试采用能够处理连续函数问题的强化学习技术来进一步改进控制性能。

参考文献

[1]李涛.机械臂无标定视觉伺服及其网络化控制技术研究[D].天津:天津大学,2020.

[2]李静.机械臂视觉伺服控制研究[D].淮南:安徽理工大学,2022.

[3]朱光耀.全向移动机械臂的无标定视觉拾取控制系统设计[D].青岛:青岛科技大学,2021.

[4]杨加超.无标定视觉伺服中图像雅可比矩阵在线估计方法的研究[D].株洲:湖南工业大学,2021.

[5]程亮玮.工业机械臂的无标定视觉伺服系统研究[D].绵阳:西南科技大学,2021.