基于超声图像评估甲状腺和乳腺病变的通用计算方法

2024-04-29安俊达李玉双

安俊达 李玉双

摘要:甲状腺和乳腺病变是影响女性身心健康的两类常见疾病。为了深入挖掘两类病变在超声图像上的个性差异和共性特征,提出一种通用的计算方法识别甲状腺和乳腺病变。先利用小波包变换将超声图像分解为4个子图;再借助灰度共生矩阵提取不含高频噪声的3个子图的纹理特征;最后利用最大相关最小冗余算法筛选特征,输入4种机器学习模型,完成甲状腺、乳腺结节良恶二分类和四分类。将方法应用于来自不同平台的甲状腺和乳腺超声图像,随机排列交叉验证二分类AUC达到0.88~0.99,准确率ACC达到0.84~0.98,均优于已有研究结果;四分类AUC达到0.95~0.97,ACC达到0.88~0.92,优于深度残差网络ResNet50。基于甲状腺(乳腺)图像训练的四种模型在交叉识别乳腺(甲状腺)良恶结节方面也取得了理想的分类结果,进一步验证了所提方法的稳定性和通用性。同时,T检验结果显示:甲状腺和乳腺恶性结节超声图像的近似子图存在非常显著的纹理差异,垂直细节子图展示出6个潜在的共性特征。

关键词:甲状腺;乳腺;良性结节;恶性结节;机器学习;超声图像

中图分类号: TP391文献标识码: ADOI:10.3969/j.issn.1007-791X.2024.01.0100

引言

乳腺癌和甲状腺癌是女性中最常见的两种癌症。乳腺癌已取代肺癌成为全球第一大癌[1],是45岁以下女性癌症死亡的主要原因及最大威胁[2-3],甲状腺癌的发病率也呈现出逐年上升的趋势[4]。超声影像因其无创、无辐射、成本低等优点被广泛用于筛查、诊断乳腺和甲状腺的病变[5],其准确性很大程度上取决于医生对超聲图像的正确解读[6]。人工智能辅助诊断技术可以帮助医生精准评估乳腺和甲状腺的病变风险,避免过度治疗[7]。

最近,Qian等人利用10 815 张多模态多角度的乳腺超声图像训练了深度学习诊断系统,用以评估乳腺影像报告和数据系统分级,并成功应用于多家医院的前瞻性临床环境[8]。Ma等人利用临床收集的508名患者的甲状腺超声图像,验证了深度神经网络(Deep Neural Network,DNN)可以更好地辅助医生诊断甲状腺癌[9]。深度学习的诊断水平与图像的数量和质量密不可分。当数据量不足时,往往很难训练出理想的模型[10],可解释性不强也是许多深度学习模型普遍存在的共性问题[11]。已有研究表明,一些超声特征与恶性肿瘤有关,一些则与良性有关[12]。如何采用计算工具用以揭示超声特征与肿瘤良恶性之间的关联,是目前智能诊断迫切需要解决的问题。

超声图像的计算机分析,尤其是纹理分析,为医生提供了目视检查可能无法发现的有关图像模式的定量信息[13]。灰度共生矩阵(Gray-Level Co-occurrence Matrix,GLCM)是一种通过研究灰度的空间相关特性来描述纹理的常用方法,能反映图像灰度在方向、相邻间隔、变化幅度等方面的综合信息[14]。离散小波变换(Discrete Wavelet Transform,DWT)是图像处理的常用技术之一[15],它使用由有限脉冲响应滤波器组成的滤波器组将信号分解为低频和高频信息[16]。Acharya等人利用3个GLCM纹理特征和2个 DWT 高频信息特征,借助AdaBoost评估甲状腺结节的恶性风险,并综合这5个特征定义了甲状腺恶性肿瘤指数,该指标值在10例良性和10例恶性受试者中具有显著差异[17]。这种方法为快速识别甲状腺病变提供了参考依据,但其使用的数据量过小,适用性和稳定性有待进一步验证。众所周知,超声采集会在信号中引入散斑噪声,从而影响超声图像细节特征的辨识[18-19]。小波变换虽然能够有效表征以低频(近似)信息为主的信号,但不能很好地分解和表示包含大量高频(细节)信息(如细小边缘或纹理)的信号,而小波包变换(Wavelet Packet Transform,WPT)可以对高频信息提供更精细的分解,对包含大量中、高频信息的信号能够进行更好的时频局部化分析[20]。

值得注意的是,当前研究多针对乳腺或甲状腺的超声图像建立仅适用于各自病变的智能诊断模型[21-22]。然而,甲状腺和乳腺病变存在某些共同的病理生理诱因[5],在超声扫描下具有一些共同特征,如结节的形状不规则、边界模糊等[23]。开发通用的诊断模型将大大简化两类病变的分类过程,具有广泛的临床参考价值。当其中一类病变的数据或标注不易获取时,这种通用模型可以发挥作用。Zhu等人首次提出了一个通用的深度卷积神经网络架构来评估乳腺和甲状腺病变,该方案的可行性在临床实践收集的超声图像中得到充分验证[24]。

受以上工作启发,本文提出了甲状腺和乳腺病变的通用识别方法,采用分步式融合WPT和GLCM,提取来自不同平台的甲状腺和乳腺结节超声图像的WPT-GLCM纹理特征,旨在解析基于该特征的经典机器学习模型(逻辑回归(Logistic Regression,LR)、支持向量机(Support Vector Machine,SVM)、随机森林(Random Forest,RF)和极端梯度提升树(eXtreme Gradient Boosting,XGBoost))识别甲状腺和乳腺病变的能力,挖掘两类病变的个性纹理差异及共性纹理特征,验证所提方法的通用性。

1数据集介绍与研究框架

甲状腺结节超声图像来自文献[9],涵盖河北医科大学第三医院的508名患者(良性415名,恶性93名)。恶性结节图像尺寸介于84×81~567×340,良性介于25×20~529×529。乳腺结节超声图像涵盖了在Baheya医院接受治疗的600名女性患者[25],包含780张图像(正常133张、良性487张、恶性210张),平均大小为500×500。文献[26]将这些原始图像统一调整为28×28,并将正常和良性统记为良性,构建了数据集BreastMNIST。为便于理解本文的研究流程,图1给出了整体研究框架。

2超声图像的纹理特征提取方法

2.1GLCM特征

选取像素对的四个偏移方向(0°,45°,90°,135°)和长为1的空间距离生成GLCM。基于GLCM计算4个方向上的7个统计量,包括角二阶矩(ASM)、对比度(Contrast)、相关性(Correlation)、相异度(Dissimilarity)、熵(Entropy)、同质性(Homogeneity)和能量(Energy)(见公式(1)~(7)),得到28维GLCM特征。

2.2WPT-GLCM特征

将超声图像进行一级2维WPT分解,得到4个子图,包括近似子图LL、水平细节子图HL、垂直细节子图LH和高频噪声子图HH。图2(a)和(b)分别展示了甲状腺和乳腺结节代表图像及其对应的4个分解子图。为避免超声图像中的散斑噪声对后续分类的影响,这里剔除高频噪声子图HH,仅关注其余3个子图。分别提取这3个子图的28维GLCM特征,整合得到84维WPT-GLCM特征。

2.3 WMCM特征

为充分展示WPT-GLCM特征在识别甲状腺和乳腺病变方面的通用性和有效性,引入文献[27]提出的小波多子图共生矩阵(Wavelet Multi-subgraph Co-occurrence Matrix,WMCM)特征以做比较。将超声图像进行一级2维WPT分解后,构造整体细节子图

3预测模型与评估指标

LR、SVM、RF和XGBoost是常用的分类模型[28]。LR是一种广义线性回归模型,可以清楚地解释输入特征如何通过最终生成的方程来证明输出的合理性。SVM是一种简单且有效的监督式學习方法,广泛应用于统计分类和回归分析。RF通过构建和合并多个决策树来获得更准确和更稳定的预测,为不平衡分类提供平衡的数据集误差。XGBoost是梯度提升决策树的高效实现,具有准确率高、运行效率高、泛化能力强等优点。

为了全面评估模型的分类性能,引入5个统计量,包括ROC曲线下的面积(AUC)、准确率(ACC)、精确率(precision)、召回率(recall)和F1分数(F1_score)(见公式(17)~(20))。

其中,TP(TN)表示预测标签为恶性(良性),而实际标签也为恶性(良性)的样本数;FP(FN)表示预测标签为恶性(良性),而实际标签为良性(恶性)的样本数。

4实验结果

本章主要介绍上述4种模型在WPT-GLCM特征下对于甲状腺、乳腺结节6个分类问题的预测结果,并与GLCM特征、WMCM特征以及其他已发表的结果进行比较。由于GLCM特征和WPT-GLCM特征的维数相对较高,故利用最大相关-最小冗余(Maximal Relevance and Minimal Redundancy,mRMR)算法进行特征筛选。为简化计算,选择前5维作为起始特征,并以5为间隔增量依次进行特征选择,直至全部特征选择完毕结束。依据预测结果确定最优的特征维数。为避免过拟合,采用随机排列交叉验证方法(Shuffle Split)训练模型及评估预测性能。训练集和测试集比例为9∶1。以 “AUC最优”作为调参依据。重复执行5次,取5次预测结果的平均值作为最终预测结果。

4.1基于最优T-model的甲状腺结节良恶二分类结果4种最优T-model在三类特征下的甲状腺结节良恶二分类AUC如图3(a)所示:显然,WPT-GLCM取得了最理想的结果,WMCM表现最差。表1汇总了基于WPT-GLCM的最优T-model的预测结果:T-SVM以最少的特征取得了最好的结果,T-LR略低于T-SVM,而T-RF和T-XGBoost整体上逊色于T-SVM和T-LR,特别是recall 和F1_score的结果不尽如人意。4种模型的预测结果均优于文献[9]的最好结果(DNN的ACC=0.87)。

注:这里T-LR的最优参数C=35,Classed weighted=balanced,Penalty=L1;T-SVM的最优参数C=6 600,Probability=True;T-RF的最优参数N_estimators=100,Min_samples_split=3,Max_features=60,Min_samples_leaf=6;T-XGBoost的最优参数N_estimators=11。

4.2基于最优B-model的乳腺结节良恶二分类结果

4种最优B-model在3类特征下的乳腺结节良恶二分类AUC如图3(b) 所示:显然,WPT-GLCM依然表现最优,WMCM依然表现最差。表2汇总了基于WPT-GLCM的最优B-model的预测结果:B-RF和B-XGBoost以明显的特征维数优势获得了优于B-LR和B-SVM的分类结果,完全可以与文献[26]的最优结果(Google AutoML Vision,AUC=0.92、ACC=0.86)相媲美,且优于文献[26]的其他深度学习模型(如ResNet50,AUC=0.87,ACC=0.84)。

4.3基于最优T-model的乳腺结节良恶二分类结果

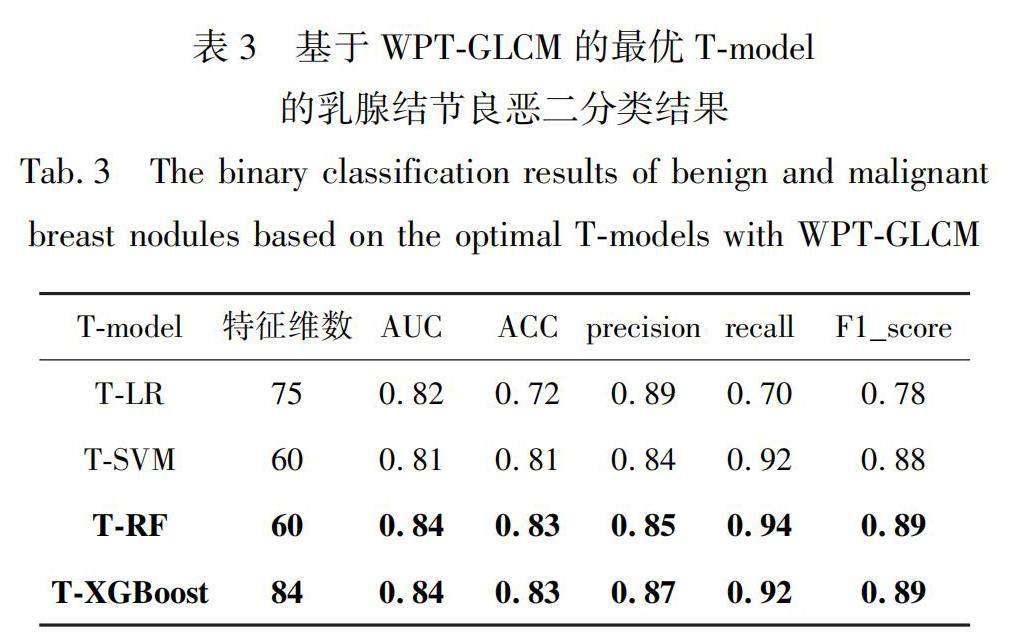

为验证所提方法的通用性,将乳腺结节超声图像的相应WPT-GLCM特征直接输入4.1节中的最优T-model,得到的测试结果如表3所示:基于甲状腺结节超声图像训练的4种最优T-model仍然能够有效识别乳腺良恶结节,T-RF和T-XGBoost整体优于T-LR和T-SVM,但低于表2中的B-RF和B-XGBoost。

4.4基于最优B-model的甲状腺结节良恶二分类结果

为进一步验证方法的通用性,将甲状腺结节超声图像的相应WPT-GLCM特征直接输入4.2节中的最优B-model,得到的测试结果如表4所示:基于乳腺结节超声图像训练的4种最优B-model仍然能够有效识别甲状腺良恶结节,且依然超越了文献[9]的最优结果;B-LR和B-SVM整体优于B-RF和B-XGBoost,但低于表1中的T-LR和T-SVM。

4.5甲状腺乳腺结节二分类结果

为了说明甲状腺和乳腺结节之间的差异性,将甲状腺和乳腺结节的超声图像放在一起构成混合数据集,将混合图像的每类特征分别输入4种模型进行甲状腺结节和乳腺结节的识别。实验结果显示:即使在默认参数下,基于不同维数的各类特征的4种模型均能获得理想的分类结果,AUC等于或接近1,ACC>0.95。

4.6甲状腺+乳腺结节良恶四分类结果

为了说明甲状腺和乳腺良恶结节之间的差异性,并验证所提方法识别多分类任务的能力,将甲状腺和乳腺结节混合图像的每类特征分别输入4种模型,进行甲状腺良、恶结节和乳腺良、恶结节的四分类。4种最优模型在三类特征下的四分类AUC如图4所示:它们依然在WPT-GLCM特征下取得了最理想的结果,但相比GLCM,其优势不像前面二分类那样明显;WMCM依然表现最差。表5汇总了基于WPT-GLCM的最优模型的四分类预测结果:显然,整体预测比较理想,XGBoost在5个指标上均优于其他三种模型,RF只有recall略低于LR和SVM。为了进一步展示本文所提方法的有效性,将混合图像直接输入ResNet50,以7∶1∶2的比例将数据集随机分为训练集、验证集和测试集,最优模型的四分类AUC=0.72,ACC=0.90,均低于4种模型的预测结果(SVM的ACC除外)。

5讨论

结合表1~表4不难发现,LR和SVM更适用于识别甲状腺病变,RF和XGBoost更适用于评估乳腺病变。尤其对于指标recall和F1_score,LR和SVM对于甲状腺超声图像表现出了绝对优势,而RF和XGBoost却很不理想,出现大幅下降(见表1和表4)。这种现象对于乳腺超声图像没有发生。在乳腺结节良恶识别中,尽管RF和XGBoost整体上更有优势,但是LR和SVM并没有在某个指标上表现出异常下降,特别是SVM(见表2和表3)。因此,当临床测试更加注重recall和F1_score时,不建议用RF和XGBoost来评估甲状腺病变。

表3和表4理想的交叉测试结果表明,甲状腺和乳腺病变很可能会产生相似的WPT-GLCM特征。因为甲状腺癌和乳腺癌是研究的重中之重,所以这里重点讨论甲状腺和乳腺恶性结节超声图像之间的特征关联及差异。分别计算84个WPT-GLCM特征在甲状腺良、恶结节和乳腺良、恶结节中的取值。T检验结果显示:6个LH特征(ASM-0°、ASM-90°、Contrast-0°、Dissimility-0°、Energy-90°、Entropy-0°)在两类恶性结节超声图像中没有显著差异(p值均大于0.05,见图5),但在各自良恶结节超声图像中均展现出显著的差异(p值均小于0.01,见图5)。

為进一步验证上述推断,一方面,计算了甲状腺恶性结节超声图像对应的6维LH特征向量(分量即为上述6个代表特征在所有甲状腺恶性结节超声图像取值的平均值),以及乳腺恶性结节超声图像对应的6维LH特征向量,两个向量的皮尔森相关系数等于1。另一方面,将甲状腺和乳腺结节混合超声图像的这6个代表特征输入4种模型,识别良性结节和恶性结节,二分类AUC范围为0.80~0.85。两个层面的计算结果再次证实了上述6个代表特征在挖掘甲状腺癌和乳腺癌共性纹理特征方面的潜力。

两类恶性结节不仅存在共性WPT-GLCM纹理特征,还存在个性WPT-GLCM纹理差异。例如,28个LL特征在两类恶性结节超声图像中的T检验p值最大为1.763 3×10-14,说明两类恶性结节超声图像的近似子图存在非常显著的纹理差异。4.5节甲状腺和乳腺混合超声图像的精准二分类表明,甲状腺结节超声图像的WPT-GLCM特征与乳腺结节有很大不同。事实上,在84个WPT-GLCM特征中,只有3个特征的T检验p值大于0.05。正是由于各类型结节之间既存在共性的纹理特征,又表现出个性的纹理差异,才使得基于WPT-GLCM的4种模型在第4.6节的四分类任务中能够取得理想的预测结果,也从侧面解释了WMCM特征在各种分类任务中表现差的部分原因,即整体细节子图LHL可能丢失了垂直细节子图LH和水平细节子图HL所蕴含的重要分类信息。

文献[17]中用于分类的5个特征均在甲状腺良恶结节超声图像中展示出显著的差异,但是文中基于mRMR算法筛选的特征与其在相应分类图像中是否具有显著差异没有必然联系。例如,在最优B-XGBoost对应的15维WPT-GLCM特征中,有7个特征在乳腺良恶结节超声图像中没有显著差异(p>0.05),但是它们与其他8个具有显著差异的特征一起输入模型却能产生很好的预测结果。四分类问题中mRMR筛选的前10维WPT-GLCM特征虽然在甲状腺和乳腺结节超声图像之间,以及在甲状腺和乳腺恶性结节超声图像之间,均具有非常显著的差异(p<<0.01),但其中2个特征在甲状腺良恶结节超声图像中差异不显著(p>0.05),5个特征在乳腺良恶结节超声图像中差异不显著(p>0.05)。以上事实说明,WPT-GLCM特征的某些组合可能对甲状腺和乳腺结节的分类产生协同或抑制作用,该猜测值得后续进一步研究。

最后需要指出,超声散斑虽然会影响图像质量、引起信号失真等,但散斑的变化能够反映温度和运动的信息,散斑跟踪技术已在评估心肌功能领域发挥作用[29-30]。文献[17]使用的2个特征也来自于高频噪声子图HH。本文更加重视子图HH对分类工作带来的不良影响,从而忽略了其潜在的应用价值,后续将对HH展开深入研究,多角度、多层面挖掘基于WPT的4个子图在甲状腺、乳腺结节良恶分类中的贡献。

6结语

在良恶结节多种分类任务中,基于WPT-GLCM纹理特征的4种机器学习模型对于来自两个不同平台的甲状腺和乳腺结节超声图像均表现出良好的分类性能,表明本文提出的方法通用性强、适用面广,有助于医生快速诊断甲状腺和乳腺病变。在超声图像特征挖掘方面,甲状腺和乳腺恶性结节的超声图像的近似子图均存在非常显著的纹理差异,垂直细节子图则蕴含了6个共性纹理特征,这一结论可能有助于医生区分第二原发甲状腺癌(乳腺癌)和由原发肿瘤转移而来的病灶。

參考文献

[1] WILD C,WEIDERPASS E,STEWART B W.World cancer report:cancer research for cancer prevention[M].Lyon:IARC Press,2020.

[2] CHEN W,ZHENG R,BAADE P D,et al.Cancer statistics in China[J].CA:A Cancer Journal for Clinicians,2016,66(2):115-132.

[3] SIEGEL R L,MILLER K D,JEMAL A.Cancer statistics[J].CA:A Cancer Journal for Clinicians,2019,69(1):7-34.

[4] EVERT F V V,ANGELA M L,TIM I M.Korevaar,diagnostic and treatment considerations for thyroid cancer in women of reproductive age and the perinatal period[J].Endocrinology and Metabolism Clinics of North America,2022,51(2):403-416.

[5] 姜欢,赵睿,戴绍春.乳腺癌合并甲状腺癌致病因素的研究进展[J].肿瘤防治研究,2021,48(5):530-536.

JIANG H,ZHAO R,DAI S C.Research progress on the pathogenic factors of breast cancer combined with thyroid cancer[J].Cancer Research on Prevention and Treatment,2021,48(5):530-536.

[6] HOANG J K,MIDDLETON W D,FARJAT A E,et al.Interobserver variability of sonographic features used in the American college of radiology thyroid imaging reporting and data system[J].American Journal of Roentgenology,2018,211(1):162-167.

[7] YANASE J,TRIANTAPHYLLOU E.A systematic survey of computer-aided diagnosis in medicine:past and present developments[J].Expert Systems with Applications,2019,138:112821.

[8] QIAN X,PEI J,ZHENG H,et al.Prospective assessment of breast cancer risk from multimodal multiview ultrasound images via clinically applicable deep learning[J].Nature Biomedical Engineering,2021,5(6):522-532.

[9] MA X,XI B,ZHANG Y,et al.A machine learning-based diagnosis of thyroid cancer using thyroid nodules ultrasound images[J].Current Bioinformatics,2020,15(4):349-358.

[10] ZHU Y C,ALZOUBI A,JASSIM S,et al.A generic deep learning framework to classify thyroid and breast lesions in ultrasound images[J].Ultrasonics,2021,110:106300.

[11] MA X,ZHANG L.Diagnosis of thyroid nodules based on image enhancement and deep neural networks[J].Computational Intelligence and Neuroscience,2022,2022:5582029.

[12] HAUGEN B R,ALEXANDER E K,BIBLE K C,et al.2015 American thyroid association management guidelines for adult patients with thyroid nodules and differentiated thyroid cancer:the american thyroid association guidelines task force on thyroid nodules and differentiated thyroid cancer[J].Thyroid,2016,26(1):1-133.

[13] SOLLINI M,COZZI L,CHITI A,et al.Texture analysis and machine learning to characterize suspected thyroid nodules and differentiated thyroid cancer:where do we stand?[J].European Journal of Radiology,2018,99:1-8.

[14] GOMEZ W,PEREIRA W C A,INFANTOSI A F C.Analysis of co-occurrence texture statistics as a function of gray-level quantization for classifying breast ultrasound[J].IEEE Transactions on Medical Imaging,2012,31(10):1889-1899.

[15] 顧广华,张凤.最优区域与离散小波变换结合的颜色恒常性计算算法[J].燕山大学学报,2014,38(3):226-232.

GU G H,ZHANG F.Color constancy algorithm combining optimal region and discrete wavelet transform [J].Journal of Yanshan University,2014,38(3):226-232.

[16] TAN J H,NG E Y K,ACHARYA U R.Study of normal ocular thermogram using textural parameters[J].Infrared Physics & Technology,2009,53:120-126.

[17] ACHARYA U R,FAUST O,SREE S V,et al.ThyroScreen system:high resolution ultrasound thyroid image characterization into benign and malignant classes using novel combination of texture and discrete wavelet transform[J].Computer Methods and Programs in Biomedicine,2012,107(2):233-241.

[18] LAMONT D,PARKER L,WHITE M,et al.Risk of cardiovascular disease measured by carotid intima-media thickness at age 49-51:life course study[J].British Medical Journal,2000,320(7230):273-278.

[19] 李灿飞,王耀南,肖昌炎,等.用于超声斑点噪声滤波的各向异性扩散新模型[J].自动化学报,2012,38(3):412-419.

LI C F,WANG Y N,XIAO C Y,et al.A new speckle reducing anisotropic diffusion for ultrasonic speckle [J]. Acta Automatica Sinica,2012,38(3):412-419.

[20] YOSHIDA H,CASALINO D D,KESERCI B,et al.Wavelet-packet-based texture analysis for differentiation between benign and malignant liver tumors in ultrasound images[J].Physics in Medicine & Biology,2003,48(22):3735-3753.

[21] 汪琳琳,沈璐,施俊,等.基于自步学习的多经验核映射集成分类器在乳腺癌超声计算机辅助诊断上的应用[J].生物医学工程学杂志,2021,38(1):30-38.

WANG L L,SHEN L,SHI J,et al.Application of multi-experience kernel mapping ensemble classifier based on self-paced learning in computer-aided diagnosis of breast cancer ultrasound [J].Journal of Biomedical Engineering,2021,38(1):30-38.

[22] PROCHAZKA A,GULATI S,HOLINKA S,et al.Classification of thyroid nodules in ultrasound images using direction-independent features extracted by two-threshold binary decomposition[J].Technology in Cancer Research & Treatment,2019,18:1-8.

[23] 吕明德.甲状腺、乳腺外科疾病的超声诊断[J].中国实用外科杂志,2001,21(5):317-318.

L? M D.Ultrasound diagnosis of thyroid and breast surgical diseases[J].Chinese Journal of Practical Surgery,2001,21(5):317-318.

[24] ZHU Y C,ALZOUBI A,JASSIM S,et al.A generic deep learning framework to classify thyroid and breast lesions in ultrasound images[J].Ultrasonics,2021,110:106300

[25]AL-DHABYANI W,GOMAA M,KHALED H,et al.Dataset of breast ultrasound images[J].Data in Brief,2020,28:104863.

[26]YANG J C,SHI R,WEI D L,et al.MedMNIST v2:a large-scale lightweight benchmark for 2D and 3D biomedical image classification[J].Scientific Data,2023,10: 41.

[27] 馬蕊香.基于超声图像的肝纤维化分期研究[D].哈尔滨:哈尔滨工业大学,2016.

MA R X.Study of liver fibrosis staging based on ultrasound images [D].Harbin:Harbin Institute of Technology,2016.

[28] ABREU P H,SANTOS M S,ABREU M H,et al.Predicting breast cancer recurrence using machine learning techniques:A systematic review[J].ACM Computing Surveys,2016,49(3):1-40.

[29]WANG P,LIU Y,REN L.Evaluation of left ventricular function after percutaneous recanalization of chronic coronary occlusions:The role of two dimensional speckle tracking echocardiography[J].Herz,2019,44(2):170-174.

[30]WDOWIAK-OKROJEK K,WEJNER-MIK P,KASPRZAK JD,et al.Recovery of regional systolic and diastolic myocardial function after acute myocardial infarction evaluated by two-dimensional speckle tracking echocardiography[J].Clinical Physiology and Functional Imaging,2019,39(2):177-181.

A general computational method of assessing thyroid

and breast lesions based on ultrasound images

AN Junda,LI Yushuang

(School of Science,Yanshan University,Qinhuangdao,Hebei 066004,China)

Abstract:Thyroid and breast nodules are common diseases that affect women′s physical and mental health. In order to explore their individual differences and common features on ultrasound images, a general computational method is proposed to identify thyroid and breast nodules. The ultrasonic images are first decomposed into four sub-images by wavelet packet transform, and the gray level co-occurrence matrix is used to extract texture features of three sub-images without high-frequency noise.Effective features screened by the max-relevance and min-redundancy algorithm were respectively input four types of machine learning models to classify thyroid,breast benign and malignant nodules.The proposed method is applied to thyroid and breast ultrasound images from different platforms.The randomized cross-validation results show that the binary classification achieves the AUC of 0.88~0.99 and the accuracy (ACC) of 0.84~0.98,superior to the existed results,and the four classification achieves the AUC of 0.95~0.97 and the ACC of 0.88~0.92,which are better than that of ResNet50.Moreover,the four models trained on thyroid (breast) images are able to cross-identify benign and malignant breast (thyroid) nodules effectively,further validating the stability and generality of the proposed method.Meanwhile,the T-test results indicate that there are significant texture differences between approximate sub-images of the ultrasound images of malignant thyroid and breast nodules,and their vertical detail sub-images exhibit 6 potential common features.

Keywords:thyroid;breast;benign nodule;malignant nodule;machine learning;ultrasound image