基于深度学习的低照度荧光渗透数字化图像恢复方法研究

2024-03-27王茂振程向梅任益博章家鹏

王茂振,程向梅,沈 威,任益博,章家鹏

(1. 航天晨光股份有限公司,南京 210000;2. 南昌航空大学测试与光电工程学院,南昌 330000)

0 引言

荧光渗透法(Fluorescence Penetration)广泛应用于检测管件、焊接件、叶片等工件表面的裂纹、气孔、分层等表面缺陷,其利用毛细现象原理将涂有荧光渗透液的工件置于一定的环境条件下[1],使荧光渗透液在物质内部进行渗透,使缺陷部位在黑光灯的照射下发出荧光,进而判定缺陷等级。它具有非破环性、成本低、步骤简单、适用范围广等优点,结合机器视觉、图像处理技术可实现工件表面缺陷的自动化检测[2]。通过采集工件的荧光渗透数字图像,利用图像处理技术识别缺陷大小、位置、类型,可以极大地提高工业现场的检测效率。

荧光渗透图像通常在暗室环境下进行拍摄,并结合黑光灯的辐射来激发工件表面的荧光信号。由于环境光的缺乏,相机感知的光线非常有限,导致图像的整体亮度较低,这种低照度条件使得图像细节难以清晰地展现,造成图像模糊和低对比度的问题。通常在低照度条件下为了增加图像的信噪比,相机的感光器件会增加增益或延长曝光时间,这容易引入感光器件本身的噪声,进一步降低图像的清晰度和质量。多种因素的共同作用使得拍摄出的荧光图像呈现出清晰度低、模糊、对比度低等不足。

目前对低光照图像的恢复算法主要分为两种,一种是传统的低光照图像恢复算法,另一种是基于深度学习的图像恢复算法。传统的低光照图像恢复算法主要有色调映射法[3]、伽马校正法[4]、直方图均衡化法[5]、基于Retinex[6]理论的方法等。这些方法通过对图像像素值进行调整,来增强图像的对比度、亮度等特征,以使图像变得更加清晰和鲜艳。基于Retinex 理论的图像增强方法通过模拟图像中的光照和反射过程,优化图像的亮度和对比度,以改善视觉感知和图像质量[7]。Retinex 理论认为,人类视觉系统对光照的感知是基于物体表面反射和照明的分离处理。基于这个理论,Retinex 算法将图像分解为反射分量和照明分量,并进行增强从而对图像质量进行改善。然而Retinex 方法通常需要对图像中的光照进行估计,以分离反射和照明分量。然而,在低光照条件下,光照估计本身可能存在挑战,因为光照信息在低亮度区域可能不可靠或不准确。不准确的光照估计可能导致增强后的图像出现颜色失真或过度增强的问题。

随着机器学习的快速发展,基于深度学习的方法在低光照图像恢复任务中表现出更为优越的性能。Wei等[8]通过神经网络将低光照图像分解成光照分量和反射分量,并通过学习的方法修正光照分量,以重建低光照图像,得到增强后的图像。Shen 等[9]融合了卷积神经网络和Retinex 理论,设计出一个多尺度的卷积神经网络MSR-net(multi-scale Retinex network),这个网络的设计允许它自动学习并处理不同尺度的信息,以提高对低光照条件下图像的处理效果。通过使用Photoshop 处理后的成对数据进行训练,实现了一个用于低光照图像恢复的全面的端对端解决方案。Fan等[10]提出了带照度约束的多尺度低光照图像增强网络,该网络用Res2Net通过提取深层多尺度特征来增强模型的能力,从而避免了颜色失真问题,同时具有更自然的视觉效果。Wang 等[11]将低光照图像增强问题视为残差学习的任务,即试图估计低光照图像与正常光照图像之间的差异,即残差。他们在网络结构中采用了光照反向映射的迭代过程,通过多次增加和减少光照来估计残差光照。Chen等[12]创建了一个包含Raw 格式的短曝光低光照图像和相应的长曝光参考图像的数据集。利用这个数据集,他们提出了一种端到端训练的基于全卷积网络的方法,用于改善低光照图像的质量。Zhao 等[13]则提出了深度对称网络,采用可逆神经网络来进行图像之间的双向特征学习。

基于深度学习的图像恢复方法有自动学习特征、适应性强、上下文信息利用、端到端优化和鲁棒性强等优势。能够自动学习和提取图像的高级特征,这能够更好地捕捉图像的纹理、结构和语义信息,从而提高恢复质量。尽管深度学习方法在图像恢复领域取得了显著的进展,但也有一些缺点,如数据需求量大、参数调整和计算复杂度高、可解释性低、泛化性差等问题。通常需要大量的训练数据来获取良好的恢复效果,对于一些数据稀缺的领域,该方法显得比较困难;此外训练和推理过程中需要大量的计算资源和时间,不利于实时的恢复任务。

本文构建荧光渗透检测图像数据集,使用Raw 格式图像采集多种不同短曝光时间图像作为低光照图像,对应的长曝光时间图像作为参考图像。基于U-net 网络构建一种端到端的卷积神经网络,Raw 格式数据作为输入,处理并划分为RGGB 四个通道。随后将这四通道数据减去相机传感器的黑电平值以进行校正,再放大一定倍数输入到U-net 网络中,最后将网络输出通过上采样操作得到RGB 空间的输出图像。训练过程设计使用一种SSIM 损失与MAE损失联合损失函数,以获得最佳恢复效果。

1 算法原理

1.1 拜尔阵列

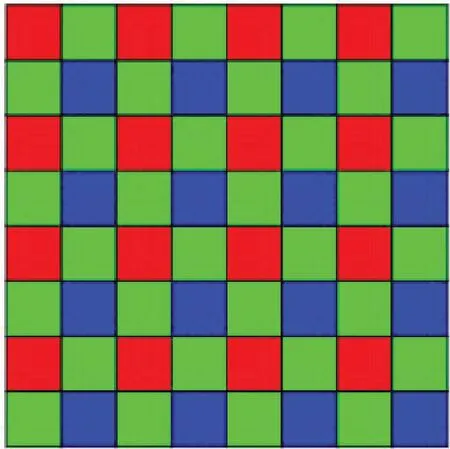

本文采集原始图像采用Sony Alpha7SⅡ相机,采集原始图像数据即Raw 格式图像,该相机的图像传感器排列方式为拜尔阵列,即使用拜尔阵列来捕捉彩色图像。拜尔阵列(Bayer array)是一种常见的彩色图像传感器排列方式,广泛应用于数码相机、手机摄像头等设备中。它利用了人眼对颜色感知的特性,通过排列红、绿、蓝三种滤光片来捕捉彩色图像。

拜尔阵列的排列方式是一个重复的2×2 单元格网格,每个单元格内包含一个像素。在这个网格中,红色滤光片(R)和蓝色滤光片(B)以交叉的方式排列,而绿色滤光片(G)则位于相邻的位置,如图1所示。

图1 拜尔阵列

当光线通过拜尔阵列时,每个像素只能接收到其中一种颜色的光。图2(a)为使用相机拍摄渗透检验荧光显示对比图谱所得的Raw 格式图像,图2(b)为截取的一小段图像,从图中可以看出,Raw 格式图像信息有些缺失,图像、颜色显示不完整。但通过对邻近像素的颜色信息进行插值和处理,可以还原出完整的彩色图像。在拜尔阵列中,绿色像素的数量最多,通过采样更多的绿色信息,可以提高图像的亮度和清晰度。然而,由于每个像素只能接收到一种颜色的光,需要进行插值和后期处理才能得到完整的彩色图像。因此在Raw 格式图像中,需要对拜尔阵列中的数据进行解析和处理。

图2 荧光测试板拜尔阵列图像

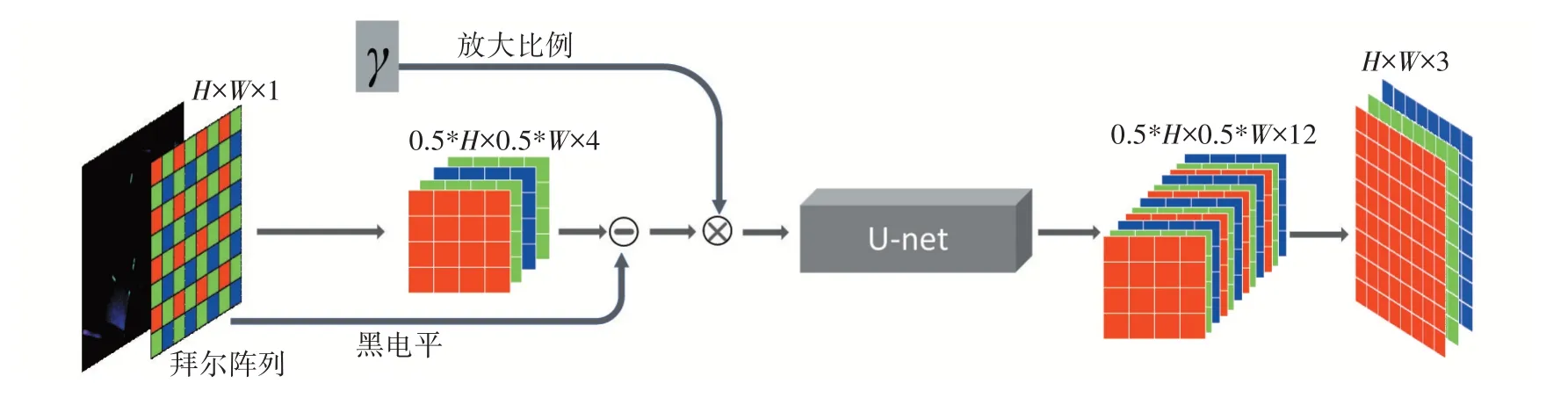

1.2 网络结构

算法采用的网络结构如图3所示。相机采集到的彩色Raw 格式图像采用拜尔阵列排列方式,网络首先输入一组一定大小的单通道拜尔阵列图像数据,并将其划分为四个通道,再对每个通道做一次2倍的下采样,空间分辨率减小4倍。随后将四个通道减去相机传感器自身的黑电平值进行矫正,将所有低于黑电平值的像素全设置为0,即纯黑。黑电平值可通过Raw 图像自身读取。再将输入数据亮度放大γ倍,输入到U-net网络中,经过网络处理后,图像的通道数变为12通道,同时分辨率减少为原始分辨率的一半。网络的输出为3通道RGB 图像。其中,γ的计算公式为

其中,Exposure1、Exposure2分别为长曝光时间和短曝光时间。

图4 为将原始拜尔阵列图像划分为四通道图像示意图,可以看出四个通道的亮度值均不一致。

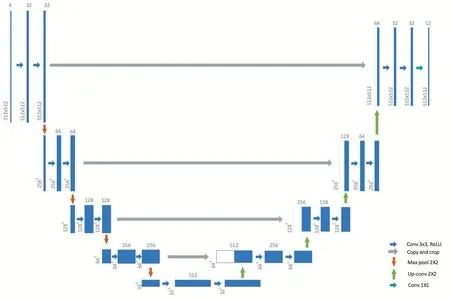

其中U-net网络结构[14]如图5所示。U-net网络由编码器和解码器两部分组成,整个网络的左半部分是编码器,右半部分是解码器。编码器提取图像的特征,解码器则负责将特征重新映射为与原始图像相同尺寸的预测结果[15]。

编码器部分由一系列卷积层和池化层构成,每个卷积层后面跟着一个激活函数(ReLU)。这些层逐渐减小图像的尺寸,同时增加特征的提取深度。通过这种逐步减小尺寸的过程,编码器可以捕捉到不同尺度的上下文信息,以帮助解码器更好地还原细节。

图3 网络结构图

图4 拜尔阵列四通道图像

解码器部分包含了一系列上采样层和卷积层,它们的作用是逐步将特征图的尺寸还原为与原始图像相同的尺寸。每个上采样层都使用上采样操作来扩大特征图的尺寸。接着,通过连接操作将这些层的输出与编码器相应层的特征图相结合,使解码器能够充分利用低级和高级特征来精确地还原图像的细节信息。这个过程有助于提高网络对图像的还原和重建能力。

为了更好地整合编码器和解码器之间的信息流动,在U-net 的解码器的每一层都会执行跳跃连接操作。这个跳跃连接的核心思想是将编码器相应层次的特征图与当前解码器层次的特征图相连接,以实现低级和高级特征的有机融合,有助于提高网络的性能和准确性。这样能够使解码器同时利用底层和高层的特征信息,从而提高预测结果的准确性。

在U-net 的最末端,利用一个1×1 的卷积层将特征图映射为最终的预测输出。U-net 网络结构呈现出编码器和解码器之间的对称性,通过跳跃连接和特征融合的方法,有效提升了预测结果的准确性。

图5 U-net网络结构图

1.3 激活函数

U-net 网络采用ReLU 作为网络的激活函数,ReLU的函数表达式如式(2)所示:

导数公式为

ReLU 激活函数不需要复杂的数学计算,只是一个简单的条件判断。这使得它在计算上非常高效,适用于大规模的神经网络。ReLU 在负数范围内为零,但在非负数范围内,它是一个线性函数。对于大于零的输入,ReLU 的导数始终为1,它不会引起梯度消失问题。相比之下,一些传统的激活函数(如Sigmoid 和tanh)在输入较大或较小的情况下,梯度接近于零,导致梯度消失或梯度爆炸。

1.4 损失函数

为了获得较好的图像恢复效果,结合结构相似性指数(SSIM)损失和平均绝对值误差(MAE)损失构建一个联合损失函数,同时考虑图像的结构相似性和亮度误差。使用加权求和的方式将这两个指标结合到一个联合损失函数中,其计算公式为

其中,LMAE表示MAE 损失函数,LSSIM表示SSIM损失函数,α、β分别为其权重系数,设置α=0.8,β= 0.2。

平均绝对值误差损失函数LMAE的函数表达式如下:

其中,yi为真实值,f(xi)为网络的输出,n为样本数。LMAE对异常值的鲁棒性较强,它使用了绝对差值,不受异常值的影响。另外,由于LMAE在0 点处不可导,因此在优化过程中,当预测值与真实值之间的差异较小时,LMAE的梯度为常数1,从而促使模型学习到尽可能少的非零权重,这使得LMAE在优化过程中更倾向于产生稀疏解。

LSSIM表示增强图像E与参考图像R的特征表示之间的SSIM 损失,用于评估两个图像结构相似性,它比较了图像的亮度、对比度和结构信息,其计算公式为

其中,(E,R)分别表示增强图像和参考图像;(μE,μR),分别表示E和R的平均值;(σE,σR),分别表示E和R的标准差;σER代表E和R的协方差;c1,c2表示常数。

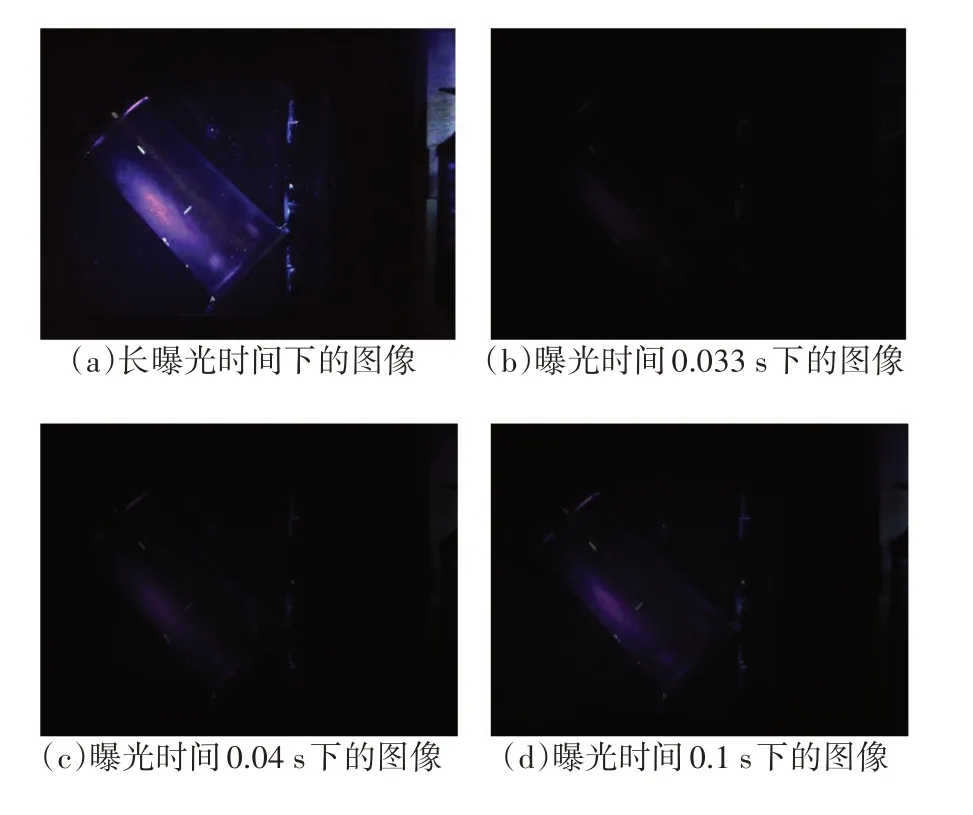

2 荧光图像数据集构建

选用索尼相机,在暗室环境下拍摄荧光渗透检测图像。每次拍摄不同形状、大小的工件,为保证拍摄过程的稳定性,采用固定支架固定相机。保证相同工件的相机参数相同,调整曝光时间,采集长、短时间曝光图像。短曝光时间分别设置为0.033 s、0.04 s、0.1 s,长曝光时间为10 s,相机的其他参数如ISO、光圈、对焦等都设置为最佳,在同一环境同一工件下,拍摄四种不同曝光时间的图像,其中长曝光时间图像只拍摄1 张,短曝光时间分别拍摄3、5、8张,总共对200个不同的工件进行拍摄,最后得到3400 张荧光渗透检测图像。荧光图像数据集见表1。其中短曝光时间图像作为网络输入,长曝光时间图像作为参考图像,一张长曝光时间图像对应多张短曝光时间图像。并划分数据集,训练集、测试集、验证集的比例为7∶2∶1。

表1 荧光图像数据集

图6 为不同曝光时间下的荧光渗透检测图像,可以看出随着曝光时间的增加,图像亮度也随之增加,整体细节也更加丰富,但同时长曝光时间图像也会引入更多的噪点。

图6 不同曝光时间的荧光渗透图像

3 实验及结果分析

3.1 实验设置

本实验使用Ubuntu 18.04 操作系统,使用PyTorch 作为深度学习框架。实验平台配置了两块NVIDIA GeForce RTX 3080 Ti GPU,以及一颗Intel Core i9-12900K CPU 和32 GB DDR4 RAM内存。

将数据集加载至网络,短曝光时间图像作为网络输入,长曝光时间图像作为真实值,选择SSIM 损失与MAE损失联合损失函数作为损失函数,并使用Adam 优化器进行模型训练,一共训练4000 轮。初始学习率设置为0.0001,并采用学习率衰减策略,在训练了2000 轮后,将学习率调整为0.000001。在每次迭代中,对一张输入图片进行随机裁剪,裁剪成512*512大小的图片,并对其进行旋转、翻转、镜像等操作。

实验图像评价指标为PSNR(峰值信噪比)和SSIM(结构相似性指数)。PSNR 用来度量恢复图像与原始图像之间差异,其结果以分贝(dB)为单位表示,数值越高表示恢复质量越好。SSIM通过比较原始图像和恢复图像之间的结构信息来评估它们之间的相似性。SSIM 考虑了亮度、对比度和结构三个方面的相似性。这两个指标在图像恢复质量评价中发挥关键作用,它们能够帮助准确评估恢复图像与原始图像之间的差异和相似性,从而评估图像恢复算法的性能。PSNR 提供了一个数值度量,而SSIM 则更全面地考虑了图像的多个方面,能够更全面地评估图像恢复的质量,可以更好地捕捉人眼对图像质量的感知。最终的SSIM 指数的取值范围在0~1之间,数值越接近1,表示恢复质量越好。

3.2 结果分析

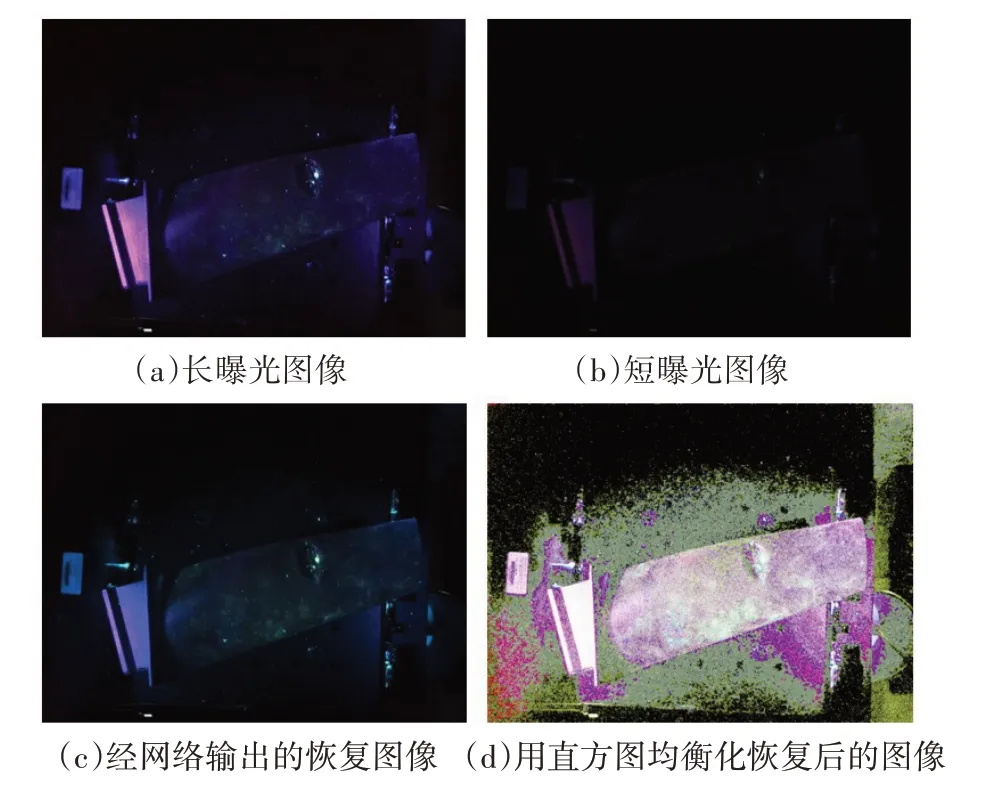

恢复后的结果如图7 所示,从图7 可以看出,采用本文方法对低光照图像进行复原,其主观成像效果较好,图像细节、纹理接近于长曝光图像,而使用直方图均衡化法恢复的图像,虽然图像整体更亮,但同时包含了大量噪点,掩盖了许多原有的细节,并且偏色较为严重,效果不佳。

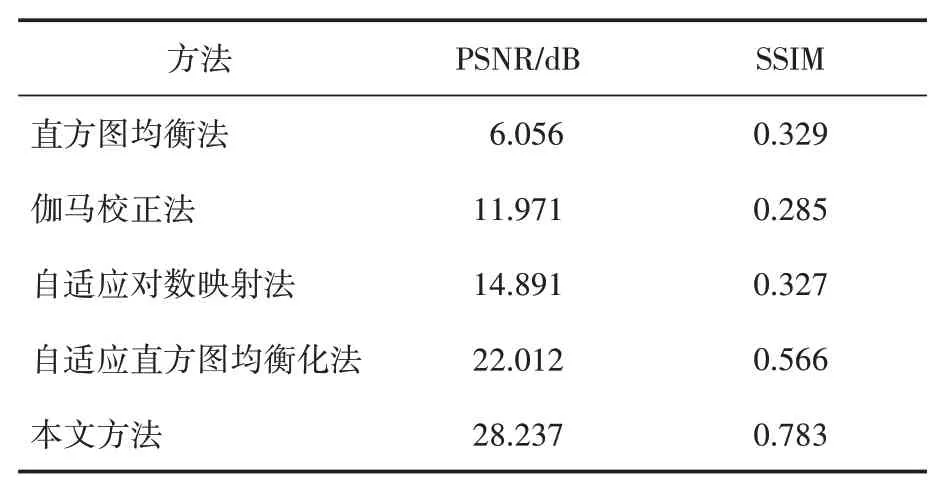

实验选用直方图均衡法、伽马校正法、自适应对数映射法[16]、自适应直方图均衡化法作为对比对照,采用以上几种方法对所有低光图像进行恢复,并利用长曝光图像作为参考图像计算相应的PSNR 和SSIM 值,结果平均值见表2。可以看出,采用传统方法恢复的PSNR和SSIM 值都比较低,本文方法的PSNR值达到了28.237 dB,对比传统方法最高提升了78.7%,SSIM 值达到了0.783,对比传统方法最高提升了63.6%,提升效果显著。

图7 恢复结果对比

表2 不同方法客观指标比较

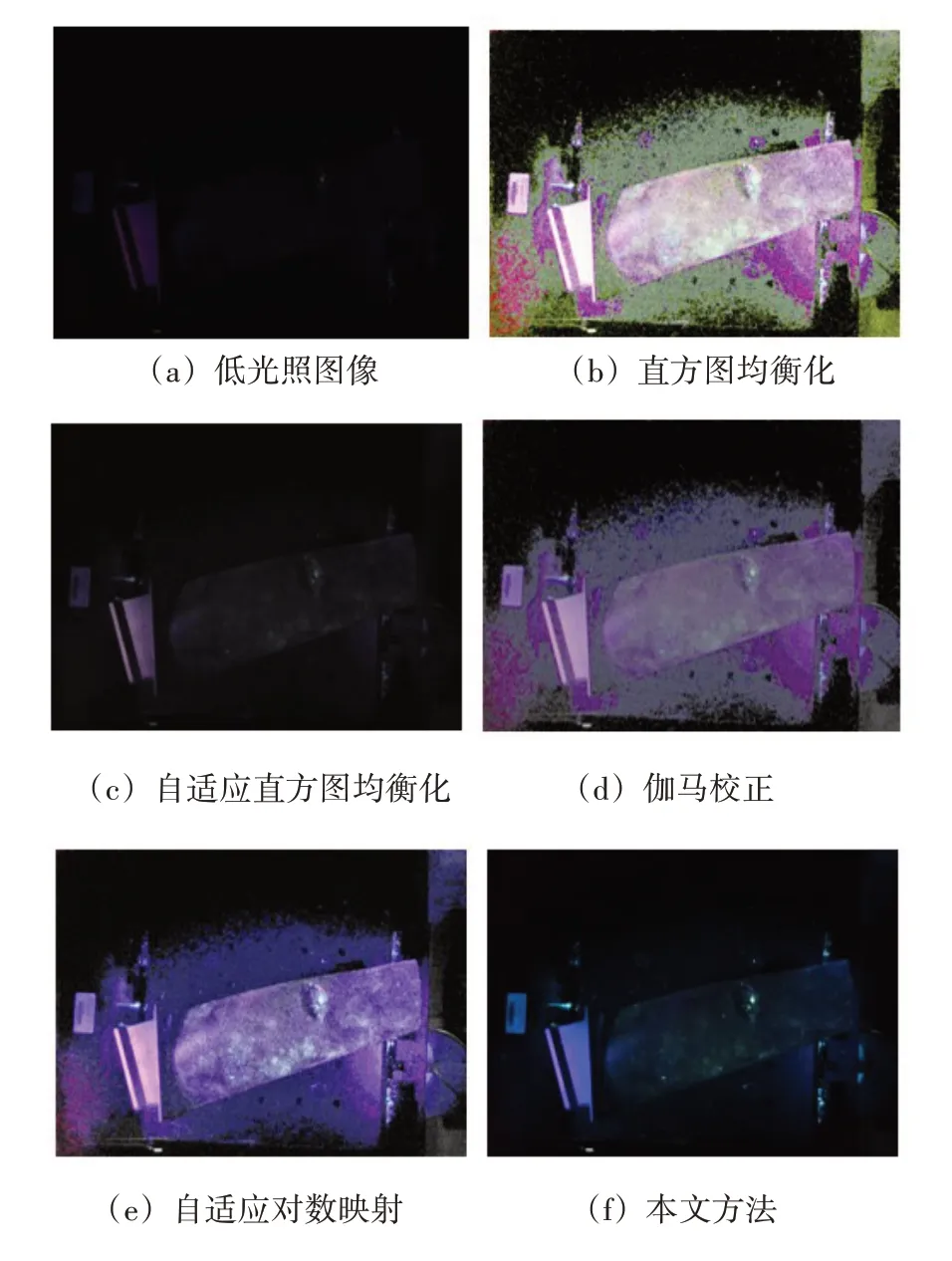

图8为采用传统方法与本文方法复原结果的对比图,图(c)为自适应直方图均衡化法恢复结果,图像总体恢复较好,但亮度较低,边缘处的细节缺失,工件表面的荧光缺陷部位恢复效果不佳。图(b)、图(d)都出现了低强度的噪声被放大,图像噪声过多的问题,并且对比度严重失真,图(e)中恢复图像的明暗细节区域产生了过度增强的效果。而本文方法无论是在图像噪声、纹理细节、图像亮度等方面都恢复得比较好,优于传统方法,尤其是在工件表面荧光缺陷部分,恢复效果接近于长曝光图像。

图8 各方法恢复结果对比

4 结语

本文提出了一种基于深度学习的低照度图像恢复方法,优于传统方法。可以较好地还原图像细节,适合于荧光渗透数字化图像恢复,提高检测精度。