一种基于动态异构图的谣言检测模型

2024-02-27朱文龙陈羽中饶孟宇

朱文龙,陈羽中,饶孟宇

1(福州大学 计算机与大数据学院,福州 350116)

2(福建省网络计算与智能信息处理重点实验室,福州 350116)

0 引 言

随着互联网的迅速发展,微博、Twitter等社交媒体逐渐成为人们生活中不可缺少的交流工具.同时,由于社交媒体传播速度快、范围广,谣言也逐渐成为人们关注的一大焦点.在社交媒体中,谣言是一种以某些途径广泛传播且未经证实的信息表述[1].谣言的出现往往会给社会造成严重的危害和巨大的经济损失.尽管各社交媒体机构陆续开通了辟谣平台来加强对谣言的管控,但这些辟谣平台仍然需要依靠人工收集的信息来识别谣言真实性,非常耗时耗力.因此,迫切需要一种能够有效检测谣言的自动化方法.

传统的谣言检测方法主要利用特征工程从文本内容、用户资料和传播模式中提取易识别的特征来训练有监督学习分类器[2-7],例如随机森林、支持向量机、决策树等.然而,特征工程提取特征往往十分费时费力,并很难应对复杂的社交媒体数据.近年来,深度学习在自然语言处理领域取得了优异的性能表现,能够让模型自动学习谣言的深层特征表示,例如循环神经网络和卷积神经网络.通过将文本内容建模为时间序列,循环神经网络可以捕获每个帖子及其评论的语义变化[8].卷积神经网络可以捕获文本内容中的局部语义信息[9].但是,上述方法仅从传播序列中学习时间特征,忽略了传播内部的拓扑关系.因此,一些研究人员研究了基于文本语义信息及其传播结构的谣言检测方法[13-22].通过对帖子的传播结构建模,构建传播图,并采用图神经网络聚合邻居节点的特征,从而捕获谣言的传播结构特征.此外,一些研究人员结合多种异构信息构建异构传播图,通过学习不同类型节点和边丰富的结构信息来提高谣言检测的性能[23-25].

尽管基于文本语义信息及其传播结构的谣言检测方法取得了显著的进展,但仍然存在一些亟待解决的问题.首先,现有基于异构传播图的谣言检测模型通常使用常规的同构图神经网络,不能充分学习传播图中的结构信息,忽略了异构传播图中节点特定于自身类型的信息.其次,现有模型往往忽略了谣言传播的动态过程,无法捕获谣言动态传播的演化模式.最后,现有模型无法充分学习帖子与相关评论之间的语义关联,导致文本语义信息损失.针对上述问题,本文提出了一种基于动态异构图的谣言检测模型DHGNN(Dynamic Heterogeneous Graph Network With Multi-level Attention),主要贡献如下:

1)DHGNN引入基于异构图的图神经网络.该网络对异构传播图中的用户、帖子节点和转发(或评论)关系进行建模,通过对不同类型的节点和边设置不同的共享参数,来表征每个边上的异构性注意力,为不同类型的节点和边生成特定的表示,学习谣言传播过程中所有用户之间的潜在交互,从而充分学习异构传播图中的结构信息.

2)DHGNN提出一种基于旋转记忆单元(Rotational Unit of Memory,RUM)的时序注意力.该注意力通过RUM为每个异构传播图快照建立记忆,模拟谣言在社交媒体中的动态传播过程,从而学习传播过程中的动态信息,且能进一步捕获谣言动态传播的演化模式.

3)DHGNN提出一种多级注意力机制.该机制通过在词级和句子级中应用多头注意力,引导模型关注源帖和相应评论中的关键词和关键句,充分学习源帖与评论之间的语义关联,从而增强源帖的语义表示.

4)本文在两个公共数据集上进行了充分实验验证DHGNN的性能.与最先进的谣言检测模型相比,DHGNN在所有数据集上均取得领先的性能.此外,本文进一步通过消融实验分析了DHGNN的各模块对其整体性能的贡献.

1 相关工作

近年来,国内外很多学者对谣言检测领域进行了深入的研究,并取得了出色的成果.谣言检测相关研究主要可以分为两类:基于传统机器学习的检测方法与基于深度学习的检测方法.

传统的机器学习方法需要从社交媒体中提取有效的特征送入分类器对谣言进行检测.Yang等人[3]通过提取文本内容、地理位置、转发次数和评论次数等特征来训练SVM分类器,该分类器使用了径向基核函数(Radial Basis Function,RBF).Castillo等人[4]对社交媒体上的热门话题进行统计分析,提出基于文本特征、用户特征和传播特征的决策树模型.Kwon等人[2]通过考虑一些特殊时间节点对谣言产生的影响,如节假日、美国大选等,提出了一种基于时间特征的随机森林模型.Ma等人[5]应用时间序列建模技术来整合各种社会背景信息,通过考虑特定话题事件的整个生命周期来判断是否为谣言.Wu等人[6]对传播树进行建模,使用具有不同核的支持向量机来检测谣言.Zhao等人[7]通过发掘谣言中隐藏的关键字特征,并结合K-means聚类方法和SVM分类器进行谣言检测.上述方法虽然取得了一定的进展,但严重依赖手工的特征工程来提取特征集,模型经常缺乏泛化能力,费时费力.

随着深度学习方法研究的不断深入,许多研究人员也将深度学习模型应用到谣言检测领域中.Ma等人[8]利用循环神经网络来捕获每个源帖子及其转发评论之间的语义变化,并根据语义变化进行预测.Yu等人[9]通过卷积神经网络捕获文本内容的局部语义,并获得隐藏单元的深层文本特征.Pan等人[10]在经典的文本卷积神经网络(Text CNN)上引用注意力机制,为卷积层提取的每个特征赋予不同权重来进行谣言事件检测.Liu等人[11]将每个新闻的传播路径建模成一个多元时间序列,其中每个元组是一个数值向量,表示参与传播新闻的用户特征.Wang等人[12]采用自动构造方法构建的情感字典来捕获人们对不同事件的细粒度情感反应,并通过两步动态时间序列算法保留事件的时间跨度分布信息.上述这些方法都是将帖子及其评论建模为时间序列进行处理,而忽略了谣言传播内部的拓扑关系.

随着图神经网络的快速发展,一些研究学者研究了基于帖子语义信息和传播结构的谣言检测方法.Ma等人[13]利用自顶向下和自低向上的树形递归神经网络来捕获谣言的语义信息和传播特征.Khoo等人[14]使用Transformer网络中的多头注意力机制对帖子之间的长距离交互进行建模,提出一种帖子级注意力模型.Bian等人[15]利用双向图卷积网络学习谣言的传播模式,捕捉谣言扩散的结构.Ma等人[16]提出一种基于树Transformer的检测模型,利用对话中的用户交互来聚合子树的观点.Wu等人[17]为每个谣言构建传播图,并使用门控图神经网络对关系路径上的相邻节点交换信息,更新节点的表示,从而增强传播图的节点表示.Tu等人[18]提出联合图的概念,构建了一个集成所有推文传播关系的大图,并使用基于CNN的模型捕捉推文的文本内容特征和传播结构信息.Luo等人[19]提出一种新的顺序编码方法,将源推文的传播树嵌入向量空间,并使用预训练的Transformer提取源推文的上下文语义特征.Wei等人[20]首次尝试探究传播过程中的不确定性,利用贝叶斯方法自适应地学习传播结构中潜在关系的可靠性,并设计一个新的边一致性训练框架来优化模型.

此外,一些研究人员则尝试构建异构图为模拟谣言传播过程提供新的视角,并取得了出色的性能表现.Yuan等人[23]将推文、转推和用户的全局关系建模成异构图,然后从帖子的内容和用户的传播关系中捕获局部语义信息和全局结构信息.Huang等人[24]构建了推文-词-用户异构图,利用基于元路径的异构图注意力网络捕获文本内容的全局语义关系和推文传播的全局结构信息.Ran等人[25]提出一种多通道图注意力网络,该网络分别对源推文与其评论的关系、源推文与其词的关系、源推文与其相关用户的关系进行建模构建3个子图,并设计一个事件共享模块学习不同事件谣言中的共性特征.

2 模型

2.1 任务定义

给定源帖集合S={s1,…,si,…,sN}和用户集合U={u1,…,uj,…,u|u|},其中N表示帖子的总数量.每篇源帖si的评论集Ri由m条评论帖子组成,可表示为Ri={r1,r2,…,rm}.谣言检测任务的目标是学习一个函数f:(si,Ri,U)→y,预测源帖是否为谣言,y表示所属的类别标签.其中,类别标签包括非谣言、假谣言、真谣言、未经证实的谣言.

2.2 模型架构

本文提出的DHGNN模型的整体架构如图1所示,主要包括多级注意力层、动态异构图网络层以及分类层.多级注意力层通过词级多头注意力和句子级多头注意力学习源帖与评论之间潜在的语义关联,得到源帖基于评论的细粒度语义表示.动态异构图网络层的主要任务是在谣言的动态传播过程中同时捕获结构信息和动态演化模式.动态异构图网络层由两部分组成,分别为基于异构图的图神经网络和时序注意力.通过图神经网络充分学习异构传播图快照的结构信息,同时,利用时序注意力来捕获谣言动态传播的演化模式,得到帖子的动态信息表示.最后,分类层将源帖的细粒度语义表示与动态信息表示拼接,通过学习分类函数来预测源帖的标签.

图1 DHGNN整体架构Fig.1 Overall architecture of DHGNN

2.3 多级注意力层

谣言的指示特征往往可以从相关用户的评论中获取,评论中表达的语义信息可以进一步增强源帖的语义表示.其中,具有强烈立场的评论在确定谣言的真实性时往往有着至关重要的作用.为了充分学习帖子与相关评论之间的语义关联,DHGNN采用多级注意力机制选择性地关注相应评论中具有重要谣言指示特征的词和句子,从而得到帖子基于评论的细粒度语义表示.多级注意力层由词级多头注意力和句子级多头注意力组成.以下进行详细说明.

2.3.1 词级多头注意力

给定一条帖子si和相应评论集合Ri={r1,r2,…,rm},使用预训练的词嵌入模型进行初始化得到对应的词嵌入表示,即si=(wi,…,wt,…,w|si|),rj=(w1,…,wt,…,w|rj|),其中每个wt∈d是一个d维向量.为了探究评论中的哪些信息可以作为谣言的指示特征,从而引导DHGNN模型专注于评论的一些关键单词或短语.DHGNN模型将帖子si作为矩阵Q,相应的评论Ri={r1,r2,…,rm}作为K和V,分别对帖子的每一条评论rj进行多头交叉注意力,将帖子的每个单词作为指导,引导模型关注到每条评论中关键的单词或短语,计算公式如下:

(1)

MultiHead(Q′,K′,V′)=Concat(head1,head2,…,headh)Wo

(2)

(3)

(4)

为了学习帖子中单词之间的依存关系,并提取句子内部的结构信息.将帖子si输入多头自注意力,从而关注源帖中的关键词.最后,通过池化层得到帖子si和相应评论rj的句子级表示:

(5)

(6)

(7)

其中,xi∈d,cj∈d,pool(·)表示池化函数,常用的池化函数有最大池化和平均池化.

2.3.2 句子级多头注意力

从公式(7)可以得到相应评论的句子表示,将所有评论拼接起来得到评论表示C∈m×d:

C=Concat(c1,…,cm)

(8)

在现实生活中,人们判断一个帖子是否是谣言,往往会专注于一些具有关键信息的评论,而忽略其他微不足道或毫无关系的评论.因此,DHGNN模型需要专注于有意义的评论句子.DHGNN使用句子级多头交叉注意力产生不同的注意力分布,来表示不同评论对确定帖子真实性的不同贡献.

首先,复制m次帖子的句子表示xi,可得到矩阵X∈m×d,通过多头交叉注意力关注重要的评论句,然后通过池化层得到所有评论的语义表示,公式如下:

C′=MultiHead(X,C,C)

(9)

o=pool(C′)

(10)

其中,C′∈m×d.之后,通过门控机制将帖子的句子表示xi与相应评论的综合语义表示o相融合,得到源帖基于评论的细粒度语义表示D,公式如下:

α=σ(w1xi+w2o+b)

(11)

D=xi⊙α+o⊙(1-α)

(12)

2.4 动态异构图网络层

2.4.1 异构传播图

具有特定特征用户之间的相关性往往可以帮助揭示一条帖子是否为谣言.本文通过构建异构传播图来模拟用户与源贴之间的交互关系.具体而言,异构传播图G=(V,E),节点集V包含源帖节点、发布源帖的用户节点和转发(或评论)源帖的用户节点,边集合E包含发布、转发和评论关系.然后,对所有节点进行统一编号,让邻接矩阵包含所有关系.

在社交媒体中,一个新的热门事件往往会引发人们的广泛关注和热议.因此,随着时间的推移,不断会有新的用户转发(或评论)源帖.为了进一步模拟社交媒体中帖子传播的动态过程,本文设置T个快照时间点,根据用户转发(或评论)源帖的时间构建T个异构传播图快照G1,…,GT,如图2所示.其中,Gt=(Vt,Et)表示为第t个异构传播图快照.

图2 异构传播图快照Fig.2 Snapshot of the heterogeneous propagation graph

2.4.2 图神经网络

每个异构传播图快照都可以被视为一个静态异构传播图,为了充分学习快照的传播结构信息,学习所有用户之间的潜在交互.本文引入基于异构图的图神经网络(Heterogeneous Graph Neural Network,HGN),通过多层HGN对异构传播图的节点和边进行建模,为不同类型的节点和边生成特定的表示.

首先,为了最大程度建模不同类型节点的分布差异性,HGN为不同类型的节点提供了相应的线性映射函数.同时,由于异构传播图中边类型的多样性,为了捕获不同节点对之间的语义关联,HGN为不同类型的边设置了不同的参数化权重矩阵,进而在保留不同关系特性的同时尽可能的实现参数共享.对于第t个异构传播图快照Gt=(Vt,Et),计算源帖子节点si与所有邻接用户节点集合N(si)的注意力分布,公式如下:

(13)

(14)

(15)

(16)

同时,源帖节点从相邻用户节点学习信息的过程可以看作是相邻用户节点向源帖节点信息传递的过程,为了缓解不同类型节点和边分布的差异性,HGN将不同边关系合并到信息传递的过程中.对于节点对e=(u,si),信息传递的计算过程如下:

(17)

InfoHGN(u,e,si)=Concat(Info_head1(u,e,si),…,Info_headH(u,e,si))

(18)

最后,得到源帖节点与所有邻接用户节点的注意力分布后,源帖节点使用注意力系数作为权重聚合所有邻接用户节点的信息,得到源帖节点si更新后的向量表示:

(19)

其中,t表示第t个异构传播图快照.

(20)

2.4.3 时序注意力

随着时间的推移,源帖在社交媒体中的演化模式主要表现为新的转发或评论出现,即异构传播图中新的用户节点和边的不断出现.HGN虽然可以有效地学习静态快照的结构信息,但是并不能模拟随时间演变的模式.最近,用于动态网络嵌入的循环神经网络(RNN)取得了很好的成果.然而,常用的RNN,例如Bi-LSTM和GRU,在保存与当前节点距离较远的节点的信息和复制过去很久的信息时仍然存在问题,这可能导致模型的长期记忆能力不足.Dangovski等人[26]提出一种被称为旋转记忆单元(RUM)的新型RNN单元以解决该问题.与通过门机制来操纵隐藏状态的LSTM和GRU不同,RUM通过在欧式空间中执行旋转操作从而实现对隐藏状态的操纵.因此,RUM可以有效地提升模型对长期信息的记忆能力并准确地总结上下文信息,从而释放模型在长期记忆方面的全部潜力.

DHGNN扩展了现有的RUM模型,并提出了一种基于RUM的时序注意力,学习谣言传播过程中更深层的演化模式.基于RUM的时序注意力主要包含两部分:旋转记忆单元(RUM)和时序注意力.其中,RUM计算过程定义如下:

(21)

(22)

(23)

(24)

(25)

(26)

(27)

(28)

(29)

(30)

(31)

(32)

(33)

(34)

其中Wq,Wk,Wv∈d×d是可训练参数,M∈T×T表示掩码矩阵.如果Mu,v=-∞,则意味着时间u到v不记录注意力系数.当时间u≤v时,设置Mu,v=0;否则Mu,v=-∞.最后,将Zi输入池化层中得到源帖si的动态信息表示B.

2.5 分类层

通过上述过程,得到一个文本细粒度语义表示D和一个动态信息表示B,这两种表示都对谣言检测非常的重要.因此,将两种表示进行拼接得到最终特征表示P:

P=Concat(D,B)

(35)

最后,使用一个全连接层和softmax层,得到帖子的预测标签y:

y=softmax(FC(P))

(36)

DHGNN使用交叉熵作为训练过程中的损失函数,并通过Adam优化算法进行学习率的更新,交叉熵损失函数如下:

(37)

3 实 验

3.1 数据集

为了评估DHGNN模型的性能,本文在Twitter15和 Twitter16两个公共数据集中进行实验验证.Twitter15和 Twitter16数据集由Ma等人[27]公开提供.每个数据集由一组源帖子和相应的响应帖子组成,并提供自源帖子发布以来经过的时间.在数据集中,每条源帖子都被标记为4种谣言类别之一:非谣言、假谣言、真谣言、未经证实的谣言.两个数据集的统计数据如表1所示.

表1 数据集统计信息Table 1 Statistics of datasets

3.2 对比模型

为了验证DHGNN模型的性能,本文选择了一些最新的模型进行对比:

DTC[4]:该模型手工提取多个全局特征,并使用基于信息可信度的决策树进行分类.

SVM-TS[5]:该模型提取随时间动态变化的手工特征,并使用线性支持向量机分类器进行谣言检测.

GRU-RNN[8]:该模型使用RNN对序列结构特征进行建模.

RvNN[13]:该模型采用两种递归神经模型,分别基于自底向上和自顶向下的传播树.

BiGCN[15]:该模型利用双向GCN来模拟自下而上的传播和自上而下的扩散.

RoBERTa-CNN[19]:该模型利用帖子文本的语义特征和帖子传播树的底层模式进行谣言检测.

EBGCN[20]:该模型通过采用贝叶斯方法自适应地考虑潜在边关系的可靠性.

MGAT-ESM[25]:该模型对源帖子与评论的关系、源帖子与词的关系和、源帖子与用户的关系建模,并通过事件共享模块学习不同谣言中的事件不变特征.

3.3 评估标准和实验设置

为了公平比较,本文采用了与先前工作[20,25]相同的评估指标,即准确率(Accuracy)和各类别非谣言(NR)、假谣言(FR)、真谣言(TR)、未经证实的谣言(UR)的F1分数.

本文随机选择10%的样本作为验证数据集,并将其余的样本以3∶1的比例分配给数据集的训练数据集和测试数据集.使用Adam算法优化模型,所有权重矩阵使用Xavier进行初始化,并将所有偏置值初始化为零.将初始学习率设置为0.001,并在训练过程中逐渐减小.词向量维度设置为300,当文本长度小于输入长度时用0填充.Dropout设置为0.5,多头注意力头数h设置为8,HGN层数L设置为4.本文提出的模型基于PyTorch开源工具实现,采用NVIDIA Tesla P100的GPU训练模型.

3.4 实验结果分析

DHGNN模型与其他对比模型的实验结果如表2所示.从中可以发现基于深度学习的方法明显优于传统方法DTC、SVM-TS.主要原因是传统基于机器学习的模型使用的是手工制作的特征,往往会导致特征选择的信息丢失,从而很难达到性能最优.另一方面,基于深度学习的模型可以从给定的高维数据中自动学习重要的特征表示.此外,与基于序列的模型GRU-RNN相比,DHGNN模型表现出了更好的性能,这可以归因于DHGNN模型能够从词级和句子级两方面充分学习文本的语义信息,并通过对谣言动态传播过程建模学习其中的结构信息,而不是仅从转发序列中捕获文本中的时序信息.DHGNN模型在两个数据集中均取得了良好的性能表现.DHGNN模型在Accuracy指标上分别比Twitter15和Twitter16数据集上的最佳对比模型高了0.9%和1.3%,在F1值指标上最大提升了1.4%和2.2%,但是在TR的F1值中分别比 EBGCN和MGAT-ESM低了0.2%、2.0%.因此,可以认为DHGNN模型具有最优的综合性能.

表2 Twitter15和Twitter16数据集上谣言检测的对比结果Table 2 Performance results of rumor detection on Twitter15 and Twitter16 datasets

3.5 消融分析

为了确定DHGNN中每个模块对模型性能的贡献,本文进行了一系列的消融实验.其中,消融模型包括DHGNN w/o MLAN、DHGNN w/o DH、DHGNNw/o HGN和DHGNNw/o TA.DHGNN w/o MLAN表示从DHGNN模型中去除多级注意力层,仅利用动态传播信息;DHGNN w/o DH 表示从DHGNN模型中去除动态异构图网络层,仅利用文本语义信息;DHGNN w/o TA表示去除时序注意力,不按照转发时间构建不同的异构传播图快照,即不使用传播过程中的动态信息;DHGNN w/o HGN表示不采用本文提出的图神经网络,而采用传统图神经网络GAT.

消融实验的结果如表2所示,可以看出DHGNN w/o DH的性能与其他消融模型相比存在较大差距,说明提出的动态异构图网络层可以充分学习异构传播图快照的结构性信息和帖子传播过程中的动态信息.DHGNN w/o HGN和DHGNN w/o TA的性能分别位于第2和第3,证明了图神经网络HGN和时序注意力是有效的.DHGNN w/o MLAN的性能差于DHGNN w/o TA和DHGNN w/o HGN,这表明提出的多级注意力层能够引导模型学习源帖与评论之间潜在的语义关联,从而提高模型性能.

3.6 参数分析

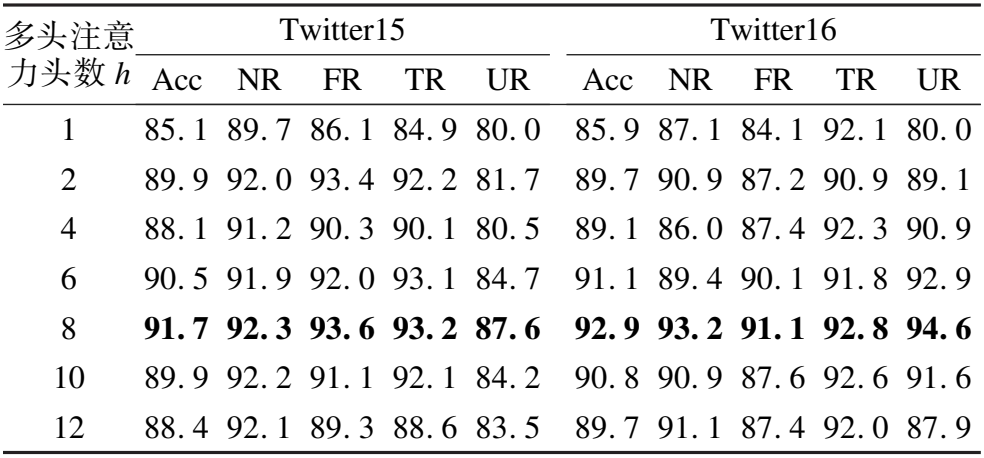

动态异构图网络层中的HGN层数L和多级注意力层中的注意力头数h决定了DHGNN模型学习传播结构信息和语义信息的程度,是影响模型性能的关键因素.本节在Twitter15、Twitter16数据集中进行一系列参数实验,分析上述参数对模型性能的影响.实验结果如表3与表4所示.从表3中可以看出,当L=4时,模型取得了最好的性能;当1≤L≤4时,模型性能随着层数的增加而有所提升;但当L> 4时,模型性能开始出现下降趋势.这是由于图神经网络层数越多,各节点状态更新时就可以融合更多跳内的邻居节点信息,从而增强帖子节点的传播信息表示.但当图神经网络层数过多时,模型过度学习各邻居节点的细节信息,可能引入更多的噪声,影响模型的性能.从表4中可以看出,当h=8时,模型在两个数据集中均取得了最好的综合性能.当h=1时,模型的性能s最差.这表明单个注意力函数并不能准确地将注意力权重分配给帖子(或评论)文本的上下文,而多头注意力可以关注到更多不同子空间中的语义表示信息,增强模型对文本语义的表达能力.但是,模型性能不会随着头数h单调增加.当h>8时,模型的性能出现下降趋势.这可以归因于过多的注意力函数会引入大量参数,从而导致模型过拟合.

表3 HGN层数对DHGNN模型性能的影响Table 3 Effects of the number of HGN layers on the performance of DHGNN

表4 多头注意力头数对DHGNN模型性能的影响Table 4 Effects of the number of multi-head attentions on the performance of DHGNN

4 总 结

针对现有未充分学习文本的语义信息和谣言传播过程中的结构信息,忽略谣言动态传播过程等问题.本文提出一种基于动态异构图的谣言检测模型DHGNN.首先,通过多级注意力引导模型关注到源帖和相应评论中关键的词和句子,学习源帖与评论之间潜在的语义关联,增强帖子的文本语义表示.然后,利用基于异构图的图神经网络HGN对异构传播图中的用户、帖子节点和转发(或评论)关系进行建模,通过对不同类型的节点和边设置不同的共享参数,来表征每个边上的异构性注意力,从而为不同类型的节点和边生成特定的表示,充分学习异构传播图中的结构信息.同时,利用基于旋转记忆单元的时序注意力为每个异构传播图快照建立记忆,模拟谣言的动态传播过程,捕获谣言动态传播的演化模式.此外,本文实验验证了DHGNN模型在谣言检测的性能,通过消融实验分析了多级注意力、图神经网络HGN及时序注意力各模块的有效性,通过参数实验分析了动态异构图网络层中的HGN层数和多级注意力层中的注意力头数对模型性能的影响.