基于深度学习的无人机单目标跟踪

2024-01-24谢志丰

谢志丰,周 诺,梁 军

(华南师范大学 软件学院,广东 佛山 528225)

0 引 言

近年来随着科技的快速发展,无人机逐步应用在各个领域,且发挥了巨大的作用。如,无人机可应用在军事领域内的通讯、侦察任务,执行自然灾害或事故发生地的搜寻、救助任务,实现物资派送、地质勘查、电力巡线等,无人机还具有成本低、安全性高和机动性强的特点。随着无人机技术的逐步推进,其研究和应用前景将得到进一步提升。

目标跟踪技术属于无人机应用的关键技术之一,同时也是无人机执行任务时信息获取源的主要技术。随着人工智能、深度学习领域的不断推广,借助计算机视觉或者深度学习技术可以让无人机更加智能,不再依赖地面端的信息处理,有效减少了信息传递中受到的环境干扰,极大提高了系统实时性和在复杂环境中的稳定性。

尽管基于深度学习的单目标跟踪算法在大多数检测和跟踪场景中表现出优秀的性能,但在困难环境中,例如存在小尺寸或相似物体、目标形变和目标遮挡等因素,模型的检测和跟踪性能往往显著下降。解决此类问题最简单的办法是提高精确度,但会带来计算资源消耗大、算法复杂度高等问题。因此,在保持一定精确度的前提下,控制算法复杂度或采用轻量级模型变得至关重要。

当前研究中,针对困难环境下的单目标跟踪,许多工作致力于在轻量级模型和可控算法复杂度的基础上提高性能。这些方法旨在平衡模型的准确性和计算效率,以应对目标的变化和遮挡等复杂情况。通过优化网络架构、引入注意力机制、设计精细的损失函数等手段,这些方法在保持较低计算资源需求的同时,提升了目标检测和跟踪的准确率。

在未来的研究中,仍需要进一步探索和发展更多适应困难环境的单目标跟踪算法。这些算法应具备高精确度、可控算法复杂度和轻量级模型的特点,以应对小型或相似物体、目标形变和目标遮挡等挑战。通过更深入的研究和创新去实现更加鲁棒和高效的单目标跟踪算法。

下面是该文的主要贡献:

(1)为了提高单目标跟踪的准确性和有效性,采用了自注意力机制网络结构,并将其与ResNet50[1]模型相结合,设计了Se_ResNet50的网络骨架。这个改进的网络骨架能够更好地关注重要的特征,并且在保留原有特征信息的基础上,提升对目标的识别和跟踪能力。

(2)在损失函数方面,使用了Balanced L1 Loss。这种损失函数能够平衡分类、整体定位以及精确定位之间的训练权重,使得回归梯度变得更加平滑和稳定,从而提升了跟踪的精度。它能够让训练过程更加平衡,并在不同的训练阶段中得到更优秀的结果,从而提升单目标跟踪的表现。

1 背景知识

单目标跟踪的主要方法分为两种,一种是基于相关滤波的跟踪算法。该算法通过当前已知目标训练出一个滤波器。滤波器和当前目标做相关运算后,可以得到高斯响应图。以此为模板寻找下一帧中响应最高的点,该点即为预测的目标位置。它是基于回归判别模型的典型方法,能够快速运转计算是因为其利用循环矩阵,使用快速傅里叶变换实现时域到频域的转换[2]。目前经典的基于滤波算法有:CSK[3],KCF[4],DCF[5],SRDCF[6]等。

深度学习跟踪算法是一种基于深度学习技术的目标跟踪方法,具有较强的学习和表征能力。与传统的跟踪算法相比,深度学习跟踪算法能够自动学习目标的特征表征,并在跟踪过程中不断更新和优化这些表征,从而大大提高了跟踪的准确性和鲁棒性。同时,由于深度学习模型可以学习到更加抽象和高层次的特征表示,因此该算法对目标的光照、尺度变化、遮挡等复杂情况具有较强的适应能力,能够实现在复杂环境下的实时跟踪[7]。神经网络也分为主流的三大类,分别是卷积神经网络(CNN)、循环神经网络(RNN)和生成式对抗网络(GAN)。

当前,目标追踪任务中往往基于卷积神经网络进行设计,通过其强大的特征提取能力,得到的不错的追踪效果。如,2012由Krizhevsky等人提出的AlexNet[8]和2016年He等人提出的ResNet在目前的主流追踪器SiamRPN[9]中具有良好效果。

SiamRPN是一种深度学习目标跟踪方法,通过将目标跟踪问题转化为目标匹配问题,并结合分类和回归技术来实现目标跟踪。在该方法中,使用卷积神经网络提取目标的特征,同时采用区域生成网络(RPN)辅助目标的定位。通过将分类和回归相结合,SiamRPN能够实现更加准确和鲁棒的目标跟踪。值得注意的是,SiamRPN能够自适应地学习目标的特征表示,从而具有更强的适应性和鲁棒性,能够在各种场景下实现高效的目标跟踪[2]。

SiamRPN系列除了两者外,还有各种改进系列,如SiamRPN++[10],DaSiamRPN[11],SiamMask[12],Deeper and Wider SiamRPN[13]等。SiamRPN系列展现出来强大的生命力,不仅在改进上各个版本有不同的改进思路,并且在VOT和OTB等测试评估中取得了显著成绩。

在近几年来,基于深度学习的单目标跟踪算法愈加精进,SiamRPN++,STARK[14]和MixFormer[15]在相关挑战上都取得了很好的成绩。尤其在OTB-100数据集上,AiATrack[16]和DiMP-NCE+[17]获得了最优结果。在VOT2018数据集上TREG[18]和Ocean[19]表现十分突出。然而其他系列模型较为庞大,在轻量级无人机上无法部署。因此,SiamRPN系列更为适合应用在无人机上,但其追踪准确性还有提高的空间。该文将基于SiamRPN++进行改进,通过结合自注意力机制和对Loss函数进行改进,有效提高追踪的精度。

各时间节点的代表性目标跟踪算法如图1所示。

图1 各时间节点的代表性目标跟踪算法

2 无人机单目标跟踪模型SB_SiamRPN++

该文主要研究的是基于SiamRPN++模型的Backbone和Loss改进,先对SiamRPN++基础理论内容和整体网络进行阐述。SiamRPN++是在SiamRPN的基础上进行改进,作者引入了Faster RCNN中的RPN,使用分支相关特征图提取特征,用于预测目标位置和置信度。SiamRPN++打破了严格平移不变性限制和目标相似限制,可以使用ResNet深层次网络进行训练。SiamRPN++使用多层特征融合的方式,合理使用浅层次中获取的图像特征与深层次中获取的语义信息。SiamRPN++还引进了Depthwise Cross Correlation模块,在减少计算量的同时使得分支更加平衡。SiamRPN++在SiamRPN上的优化使其感受野更广,卷积层更多,细粒度更高。

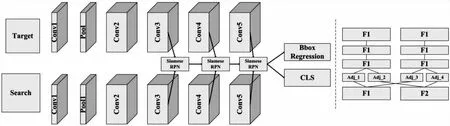

SiamRPN++的整体网络结构图如图2所示。

图2 SiamRPN++结构图(左)与Siamese RPN模块图(右)

在SiamRPN++的基础上,该文主要从注意力机制和损失函数出发。注意力机制有SE,CBAM,ECA和CA等,CBAM和CA计算复杂度高,ECA通道间的相关性建模能力相对较弱,综合后决定选取SE注意力机制模块,其简单高效,引入参数量少,能够显著提升性能。Smooth L1 Loss在样本均衡方面存在一定问题,在小目标、遮挡目标等具有优化空间, Balanced L1 Loss能在一定程度上缓解此问题。

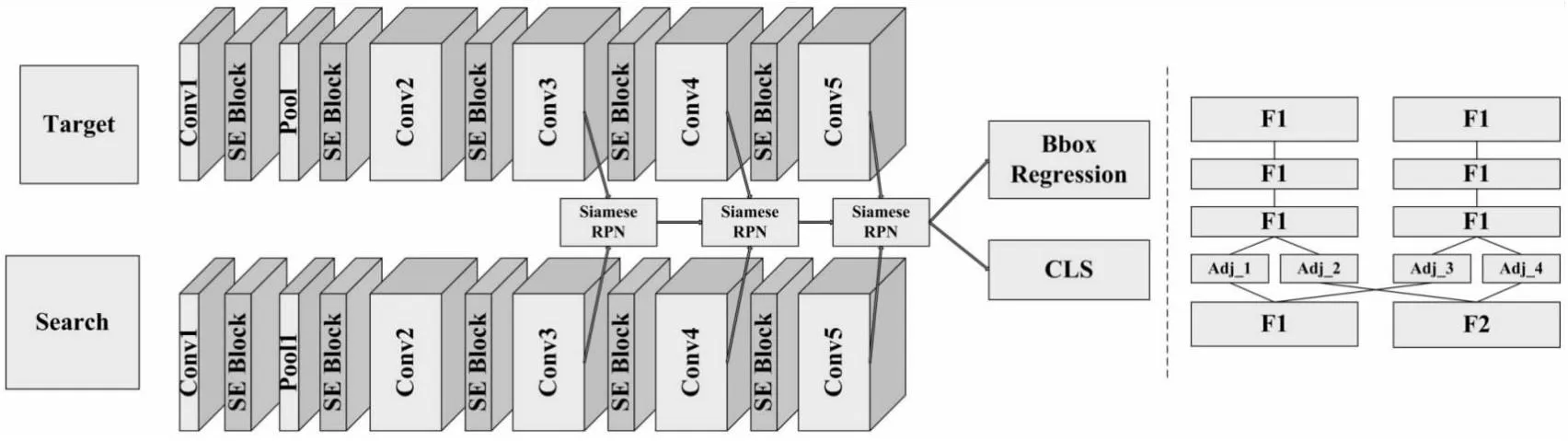

综上所述,该文在原有的SiamRPN++基础上对Backbone和Loss方面进行优化,在Backbone方面,将原有模型的ResNet50与SE Block融合成SE_ResNet50,Loss方面将原有模型中的L1 Loss更改为Balanced L1 Loss。整体网络结构与SiamRPN++基本一致,在每次计算中加入了SE Block模块。经过优化后的网络结构图取名为SB_SiamRPN++,如图3所示。

图3 SB_SiamRPN++结构图(左)与Siamese RPN模块图(右)

在Loss方面,官方SiamRPN++模型pysot中使用的是L1 Loss。该文采用Balanced L1 Loss对其进行优化,引入α,β,γ参数,调整loss计算策略,从压缩维度求和转为Balanced L1 Loss策略,loss_weight均衡策略不变。

在实验中,观察学习梯度逐步调整、优化参数,最终设置参数为:α=0.7,β=1.0,γ=1.5,具体实验过程在实验分析部分会指出。

Balanced L1 Loss在VOT2018数据集测试中,EAO有显著提升。其在迭代过程中,迭代效率大大提高。在使用L1 Loss的pysot模型训练中,需要10~20次迭代得到最好结果,修改为Balanced L1 Loss函数后在1~10个迭代中就能得到最好结果,说明在梯度收敛中,Balanced L1 Loss的收敛速度比L1 Loss更快。

2.1 SENet模块

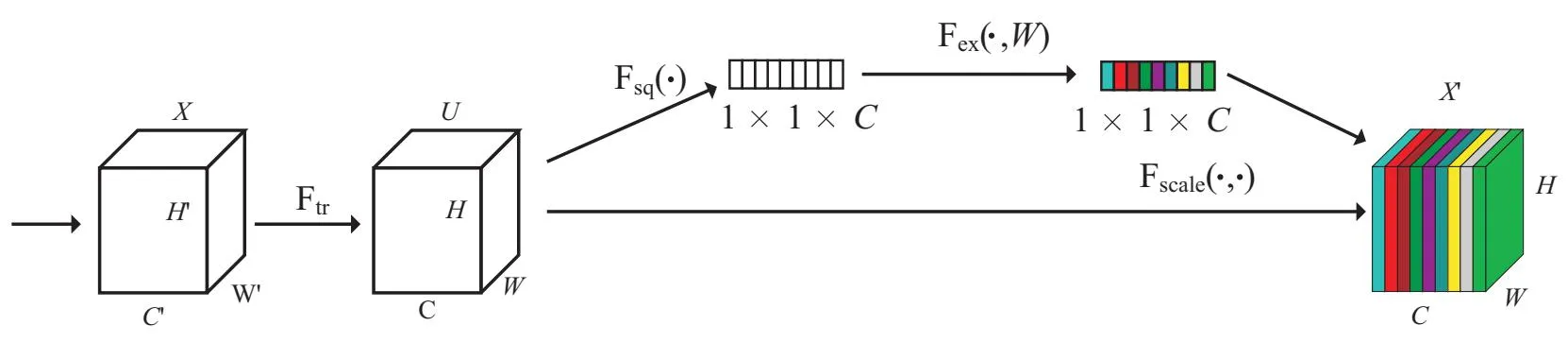

SENet[20]称Squeeze-and-Excitation Networks,是由Momenta胡杰团队提出的新网络结构,并夺下ImageNet 2017 Image Classification任务的桂冠。SENet在ImageNet[21]数据集中的Top-5 error降低至2.251%,性能提高了0.74%[22]。

SENet采用一种全新的特征重标定策略,通过深度学习自动获取每个特征通道的重要程度,以此为依据提升重要特征并抑制无用特征[5]。和以往特征通道融合方法不同,SENet并没有引入新的空间维度,而是通过新策略使特征通道之间的相互依赖关系直接呈现出来。SENet的核心思想从网络的loss入手,根据loss学习特征权重,使有效的特征图权重增大,无效或者效果小的特征图权重减小,以此为训练模型达到更好的效果。Sequeeze-and-Excitation block是一个子结构,可以嵌入到其他分类和检测模型。

图4为SENet结构图。SE Block属于自注意力机制函数,自注意力是一种特殊注意力机制,可以通过对所有位置的特征向量取加权平均得到,能更好地提高并行运算效率,提高了模型的可解释性。在传统的卷积神经网络中,对局部特征编码会导致在捕捉长距离方面无法进行建模,自注意力机制能计算不同位置间的相对关系,从而更好捕捉全局信息,所以在捕捉长距离的依赖关系中更具优势。

图4 SENet模块

SE Block作为一个子网络结构,其结构非常简单,容易部署,不需要引入新的函数或者层,可以嵌入到任何复杂模型中开发新型SENet,广泛用于计算机视觉等领域。但是它的灵活性也有一定的限制,无法直接应用于标准卷积转换。它减低了计算复杂度,在SE_ResNet50得到精度甚至与SE_ResNet101媲美,在训练过程中,加入了SENet模块一定程度上降低了收敛错误率。但在一定的网络深度下进行BP优化时,靠近输入层的部分网络可能出现梯度消散问题,导致模型难以优化。因此,除了结合该方法外,该文进一步对Loss进行修改,一定程度上解决了该问题。

2.2 Balanced L1损失函数

目标检测的损失函数分为分类损失和回归损失,是一个多任务损失函数。Balanced L1 Loss损失函数是在Fast R-CNN中使用的损失函数。通常,在回归损失前引入参数λ进行调整,当分类效果较好时,损失值较为精确,但是会忽略回归重要性。为了均衡不同任务,需要对参数进行调整。在参数调整中要注意的是,回归时没有边界限制的,直接增加回归损失权重是不可行的,容易产生巨大梯度不利于训练[23]。

Lp,u,tu,v=Lcls(p,u)+λ[u≥1]Lloc(tu,v)

(1)

基于上述问题,作者提出了Balanced L1 Loss,Balanced L1 Loss是在Smooth L1 Loss基础衍生出来的。在Smooth L1 Loss中,设置拐点区分inliers和outliers,并对outliers设置1.0进行梯度截断。

Balanced L1 Loss主要目的是要显著提升inliers的梯度,使准确的训练点在训练中能发挥更重要的作用。作者通过参数λ来调整回归损失上界,通过调整参数α,γ可以得到更加平衡的训练,作者并没有使用超参数β,该参数用于控制难易样本的权重。总的来说,Balanced L1 Loss的核心思想是提升关键的回归梯度,平衡样本及任务,以便能在分类、识别、定位和回归中实现更加平衡的训练。

Balanced L1 Loss的公式如下[23]:

(2)

(3)

Lb(x)=

(4)

其中,α,γ满足以下公式[23]:

αln(b+1)=γ

(5)

3 实验分析

3.1 相关环境与数据集说明

为模拟无人机中较为低端的计算环境,该文在Windows下运行,使用CPU,在原有官方pysot模型上修改相应配置,在对应代码将WORLD_SIZE设置为1,MASTER_ADDR设置为localhost,MASTER_PORT可以设置成任意未被占用的端口,如6789等。在torch.device函数中出现无法使用GPU的情况,则将GPU参数改为CPU参数。将代码中的RANK设置为0。该文使用的是python-3.10.7,pytorch为1.11.0+cu113。

在数据集上,训练采用的是ILSVRC2013和ILSVRC2014 DET dataset,而测试实际追踪效果则是在VOT2018[24]和OTB100[25]数据集上。ILSVRC全称为IMAGENET Large Scale Visual Recognition Challenge(示例见图5)。自2010始,每一年都会举办ILSVRC图像分类和目标检测大赛。ImageNet数据集在目前深度学习图像领域应用中占据主流,关于图像识别、分类、定位、检测等都基于此来开展。ImageNet数据集有1 400多万幅图片,涵盖多达2万多个类别,并在许多图片中有明确的类别标注和物体标注[26]。VOT2018包含了60个高质量的真实场景视频序列,涵盖了各种目标类别和运动模式。这些视频序列在不同的环境中捕捉到了目标物体的运动,如户外、室内和复杂背景等。OTB100数据集包含了100个具有挑战性的视频序列。这些视频序列涵盖了不同的目标类别(如人、车、动物等)、运动模式和背景条件。这两个数据集具有很强的挑战性,十分适合无人机应用。

图5 ILSVRC数据集示例

3.2 部分实验指标说明

在目标追踪中,常用的评估标准有Robustness,Accuracy和Expected Average Overlap(EAO),它们用于衡量追踪算法在准确性和鲁棒性方面的表现。

Robustness(鲁棒性):鲁棒性用于评估目标追踪算法在面对各种挑战性条件时的稳定性和可靠性。一种常用的鲁棒性指标是在多个测试视频序列上计算系统失效的频率。对于每个测试序列,当算法丢失跟踪目标且不再恢复时,认为系统失效。通过计算失效频率来得到鲁棒性指标,失效频率越低表示算法越鲁棒。

Accuracy(准确率):是用来评估目标位置估计精确度的指标。它通过计算预测框与目标真值框之间的重叠程度(IoU)来确定预测框的准确性。如果预测框与目标真值框的IoU大于等于设定的阈值(通常为0.5),则该预测框被视为准确的。最后,准确率被计算为准确的预测框数除以总的预测框数。准确率越高,表示算法在目标定位方面表现越精确。

Expected Average Overlap(EAO):EAO用于综合衡量目标追踪算法在准确性和鲁棒性之间的平衡。它基于预测框与目标真值框之间的重叠程度,通过衡量平均重叠面积(Average Overlap,AO)和失效率(failure rate)来计算。

具体来说,首先计算每个测试序列上的平均重叠面积,然后通过对平均重叠面积进行加权平均,权重为各个序列的失效率。最后得到的加权平均值即为EAO,值越高表示算法在准确性和鲁棒性方面表现越好。

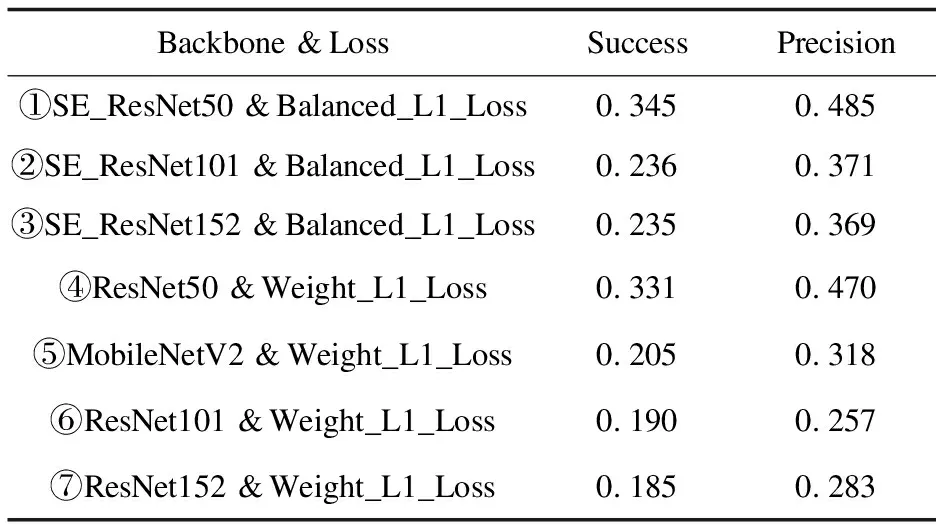

3.3 Balanced L1损失函数参数设置

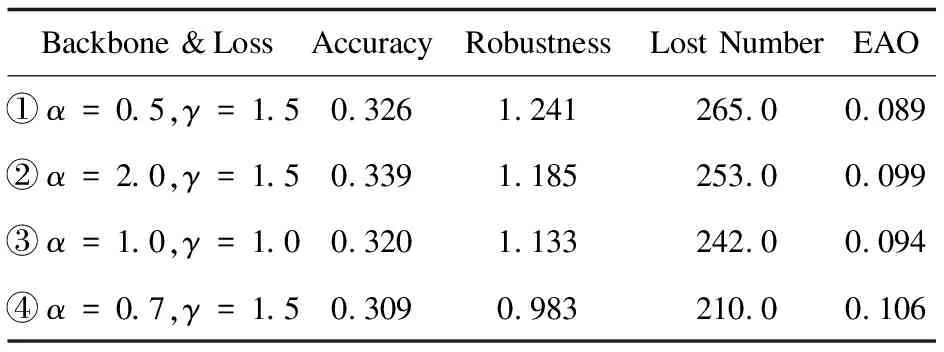

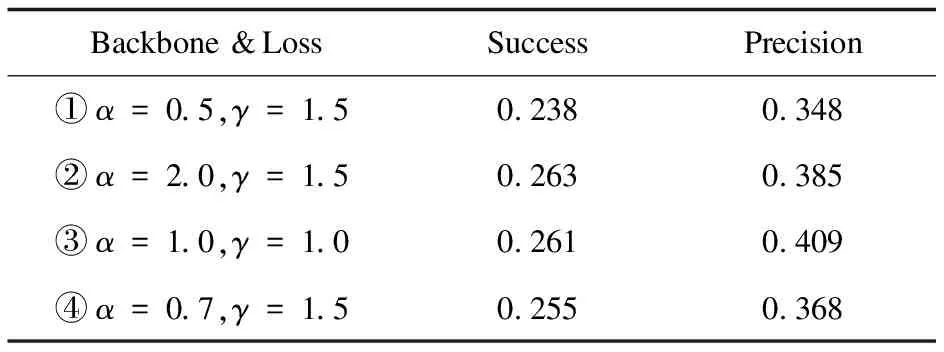

对Balanced L1 Loss中的α=0.5,γ=1.5进行调整。随机选取部分数据集,并以此作为标准训练数据集进行训练,对α,γ参数进行微调,迭代次数为10~20,β均为1.0,具体微调参数后VOT最优评估结果如表1所示,OTB最优评估结果如表2所示。

表1 Balanced L1 Loss调整α,γ的VOT最优评估结果

表2 Balanced L1 Loss调整α,γ的OTB最优评估结果

在表1的VOT最优评估表中,Accuracy最高分数的参数为②α=2.0,γ=1.5,这个参数函数与Smooth L1 Loss类似,在梯度和Loss方面都十分接近;但是在EAO指标中,④α=0.7,γ=1.5的效果最好,该参数梯度更偏向平缓,Loss数值比Smooth L1 Loss收敛得更快,EAO更高表示训练更有效。在Robustness指标中,对比原参数①α=0.5,γ=1.5,②α=2.0,γ=1.5和③α=1.0,γ=1.0逐层降低,④α=0.7,γ=1.5下降幅度最高,下降了20.79%,说明了在平缓梯度后提高了有效样本在训练过程中的重要性,减少了误差。在Lost Number指标中,其数值按顺序逐步递减,在④α=0.7,γ=1.5中递减了20.75%。

在表2 OTB最优评估表中,②α=2.0,γ=1.5在Success取0.263的高分;③α=1.0,γ=1.0取得0.261分数,与②几乎没有差距,说明提高梯度只在一定程度上有提升,依然具有一定的限制性;④α=0.7,γ=1.5取得0.255,比②低3.04%,可能在训练过程中梯度放缓,精细化程度更高,需要一定的迭代次数。在Precision指标中,③α=1.0,γ=1.0获得分数最高,说明在该梯度与Loss数值下训练模型能更好地提高模型的正确率和预测率。

综合表1和表2的数据指标,可以选取③α=1.0,γ=1.0参数完整训练,会使模型的精确度显著提高,但误差方面优化程度不高,且考虑到数据集训练样本不够多的情况,易出现过拟合现象。在整体模型鲁棒性方面,选择④α=0.7,γ=1.5是最优解,其VOT评估分数高达0.106,用该参数完整训练数据集后得到的模型鲁棒性是最好的。综合上述,在数据集训练样本较少的情况下,选取鲁棒性更高的模型更具有优势,因此选择参数④α=0.7,γ=1.5进行最终的完整训练。

3.4 实验结果分析

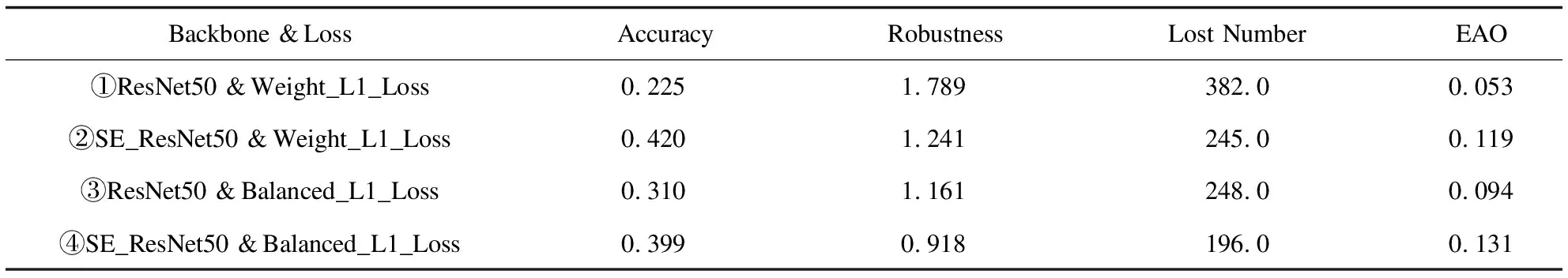

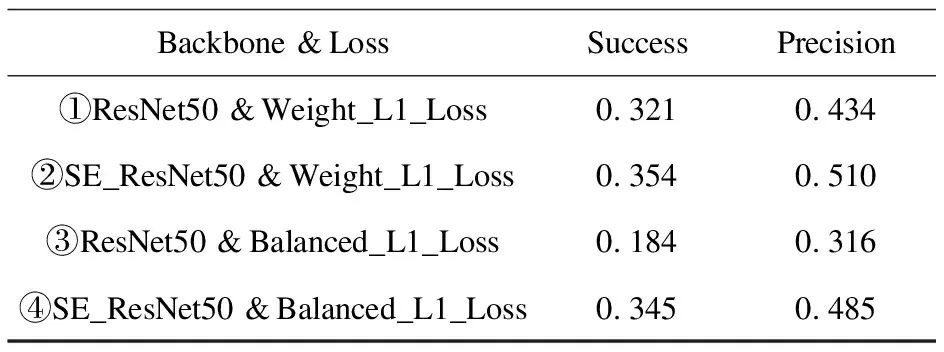

在消融实验部分,选择全部数据集进行测试,基本参数和通用模型参数不变,控制训练周期,实验取1~10次迭代的最优结果。VOT评估结果如表3所示,OTB评估结果如表4所示。

表3 消融实验下不同条件下的各模型VOT最优评估结果

表4 消融实验下不同条件下的各模型OTB评估结果

综合VOT和OTB的评估结果,对比原有模型ResNet50 &Weight L1 Loss,在使用SENet和ResNet50融合后的Se_ResNet50与Balanced L1 Loss的SiamRPN++,其在VOT和OTB表现优异。在VOT评估中,与原有模型相比,Accuracy略微下降,在Robustness、Loss Nmber和EAO评估指标方面,都有显著提升。Robustness比原有模型提升了40.6%,Loss Nmber提升了40.6%,EAO提升了33.6%。在OTB评估中,Success基本不变,Precision提升了11.7%。上述数据表明优化后的SiamRPN++,准确度相对于原模型略微提高,稳定性和鲁棒性显著提高。

上述实验结果是优化后的Backbone &Loss和原模型中的Backbone &Loss进行比较,除此之外,实验还对官方模型MobileNetV2,SE_ResNet101,SE_ResNet152,ResNet101和ResNet152进行了实验,迭代次数和训练数据集均与上述一致,并进行VOT和OTB评估,具体评估结果如表5、表6所示。

表5 SE_ResNet40,SE_ResNet101,SE_ResNet152,ResNet50,MobileNetV2,ResNet101和ResNet152的VOT最优评估结果

表6 SE_ResNet40,SE_ResNet101,SE_ResNet152,ResNet50,MobileNetV2,ResNet101和ResNet152的OTB最优评估结果

为了更好地显示出网络深度对模型性能的影响,从表5中的④,⑥和⑦中可得知加深原有模型的网络深度对模型的影响。在不优化Loss函数的前提下,通过加深ResNet网络深度,并不能提升模型性能。在各项指标方面,均有明显下降。对比ResNet50,ResNet101的EAO指标下降了19.39%,ResNet152的EAO指标下降了24.49%。说明了加深网络深度无法提升模型性能。从表5的①,②和③中,Loss优化为Balanced L1 Loss,也可以看出不同网络深度对整体模型的影响。在使用SE_ResNet101和SE_ResNet152增加网络深度后,与SE_ResNet50相比,两者在Accuracy指标都下降了15.54%;在Robustness两者略微上升;在Lost Number方面两者上升了至少18.37%;在EAO方面,SE_ResNet101和SE_ResNet152指标相同,都下降了22.90%。上述数据表明在增加网络深度后,VOT各项评估指标均有降低,在Accuracy和EAO方面降低尤甚。对比表6数据,OTB评估数据也表示在增加网络深度后Success和Precision指标均有较大程度降低。总体来说,SiamRPN++基础模型中缓解平移不变性的问题上具有一定限度。

对比原模型中的ResNet50 &Weight_L1_Loss, 使用Balanced L1 Loss的SE_ResNet101和SE_ResNet152在Accuracy方面显著下降,但是在Robustness有明显提升,两者EAO与原模型相比差距较小,而在SE_ResNet50中除了Accuracy方面下降,其他均有明显提升。横向对比表5中的②和⑤,③和⑦,也能验证在优化Backbone和Loss后有明显提升,其中最显著提升的是 SE_ResNet50 &Balanced L1 Loss。在表6中,SE_ResNet50 &Balanced L1 Loss的表现最佳,对比原模型ResNet50 &Weight_L1_Loss,Success和Precision分别提高了4.23%和3.19%。综上所述,优化SE_ResNet50 &Balanced L1 Loss后的SB_SiamRPN++模型鲁棒性和精确度方面都有不同程度的提高。

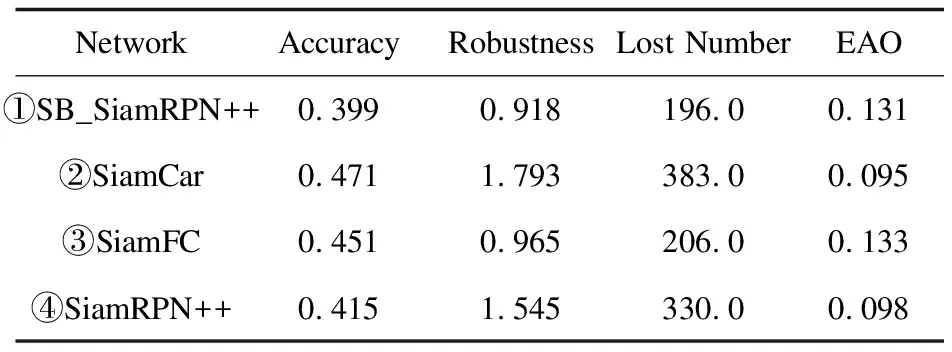

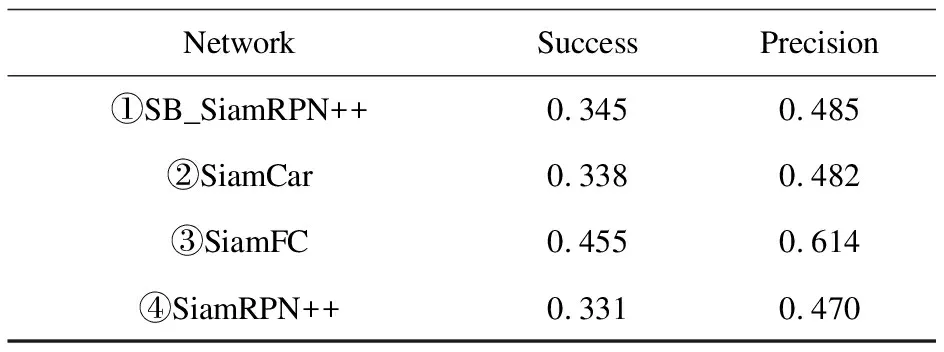

在上述相同的实验条件下,经过10~20次迭代训练后,SB_SiamRPN++与SiamCar,SiamFC和SiamRPN++所得到的VOT,OTB数据结果如表7、表8所示。

表7 SB_SiamRPN++,SiamCar,SiamFC和SiamRPN++的VOT最优评估结果

表8 SB_SiamRPN++,SiamCar,SiamFC和SiamRPN++的OTB最优评估结果

在表7中,Accuracy方面SiamCar最高,SB_SiamRPN++最低,相差0.072;在Robustness方面,SB_SiamRPN++最低,SiamCar最高,相较于SiamRPN++,SB_SiamRPN++降低了40.58%,数据与SiamFC相近;在Loss Number方面,与Robustness类似,SB_SiamRPN++相较于SiamRPN++提高了40.61%;在EAO方面,SiamFC与SB_SiamRPN++实验数据相近,两者都在较大程度上领先其他两个模型。

在表8中,Success和Precision方面SiamFC的数据结果最优,SB_SiamRPN++在OTB中并不占据优势,但相对于SiamRPN++模型仍有较大程度上的提升,其与SiamCar的实验数据相近。

从整体实验数据表明,预测SB_SiamRPN++最终训练效果相对于SiamRPN++有较大提升,与SiamCar所呈现的效果相似。SiamFC的准确性和预测性会比SB_SiamRPN++更高,SB_SiamRPN++的Robustness指标上,对于SiamFC上并不占据优势。整体来看SiamFC会比SB_SiamRPN++效果更好,SB_SiamRPN++对比其他两者占据优势。

4 结束语

目前,无人机在各个领域都有广泛的应用,并且单目标跟踪技术备受关注。在任务协助和军事等领域,无人机表现出色,而单目标跟踪算法的不断改进可以更好地帮助人类完成困难任务或自主完成高难度任务。该文对SiamRPN++算法进行了修改和优化,主要集中在Backbone和Loss函数方面,取得了显著的改进效果。相对于SiamRPN++算法,在保持准确度基本不变的情况下,降低了误差率,并提高了模型的鲁棒性。

尽管与一些最新的目标追踪算法相比,该算法的准确率略有不足,但这些追踪算法模型通常庞大且复杂,无法在无人机上得到很好的应用。而SiamRPN系列算法具有较强的实时性和轻量级模型架构,因此在实际应用中,对该算法进行改进具有较强的实用性。

该研究中的创新点:

(1)Backbone:使用SENet与ResNet融合,简化了数据复杂性,增强了算法精确度,使预测结果更加精准。SENet的Sigmoid和Scale操作极大地减少了参数量。SE_ResNet50网络具有更多非线性,在拟合通道间的复杂相关性上有明显提升,还融合了ResNet50的网络优点,网络深度更深,且不存在梯度消失问题。

(2)Loss:使用Balanced L1 Loss,能更好地提升回归梯度,使学习更加平衡,提高了回归任务中的精准度。

在未来可以继续改进的地方:

(1)在数据集方面,可以选用更大更多的数据集,如:ILSVRC2018和ILSVRC2019,MS COCO数据集等。但碍于机器设备原因,无法进行巨大数据集的训练。

(2)在Backbone方面,还能将ResNet更换成ResNeXt,能更好地提升计算能力,需要修改的工程量以及匹配通道数等各项参数上要花费更长的时间去优化、提升。

(3)在Loss方面,该文是修改回归损失函数,还能将分类损失函数作适当调整,也可以使用其他损失函数,如Smooth L1 Loss,KL Loss等。

回顾第一章中所提到的发展图,基于深度学习算法的单目标跟踪模型,经历了从简单模型到复杂模型,从复杂模型中提炼关键和结构优化的过程。该文实现了无人机视频的单目标跟踪算法SiamRPN++的优化,除了单目标跟踪任务,多目标跟踪任务也十分重要。多目标跟踪相比于单目标跟踪,其目标识别、定位和预测等问题更加复杂,还需要克服跟踪目标数量繁多和目标种类不一等难点。未来,无人机领域可能会扩展到民用,无人机的智能化和人性化使操作更加快捷方便,在娱乐、拍摄和运输等方面能带来极大的便利。