基于图像分割和卷积神经网络的苹果分类机器人分类模型

2024-01-13黄祖伟

黄祖伟

(烟台职业学院智能控制学院,山东 烟台 264670)

近年来,具有高效滤除噪声功能的图像处理技术在水果分类领域得到了广泛应用[1]。但传统图像处理技术的应用容易受到环境等外部因素的影响,对目标物体特征提取的精度易受外部环境影响[2-3]。随着人工智能技术的快速发展,在便捷性、设备成本、实时检测等方面具有明显优势的计算机视觉技术、深度学习等新型图像处理技术已被广泛应用于水果采摘、水果品质检测、水果分类及产量估测等领域[4-5]。

计算机视觉技术、深度学习等图像处理技术基于对植物或果蔬原始图像的处理进行植物或果蔬的识别或分类,如果原始图像中包含多个目标对象,识别时会相互干扰。为解决该问题,图像分割技术被引入植物或果蔬的检测和分类研究。Yang等[6]提出的植物分类方法首先通过R-CNN掩膜对植物叶子图片进行分割,然后使用VGG16进行植物叶子分类,测试结果表明该方法对15种植物的平均分类准确率达到91.5%。Javanmardi等[7]构建了基于VGG16和神经网络的玉米种子分类模型,测试结果表明,所构建模型可在26.8 s内分类2 250个测试实例,分类正确率、检测精度、召回率和F1分数分别达到98.1%、98.2%、98.1%和98.1%。Tavakoli等[8]建立了一个基于VGG16的卷积神经网络,并利用图像分割技术剪除图像中的干扰环境部分,实验结果表明该分类算法对叶片背面图像数据集具有较好的分类性能,对物种分类、同种栽培品种和不同种栽培品种的平均分类准确率分别达到95.86%、91.37%和86.87%。

鉴于图像分割技术和深度学习在植物和果蔬分类研究中的突出优势,以苹果为分类对象,利用图像分割技术、深度学习中的卷积神经网络技术,构建了用于提高苹果分类机器人对苹果分类准确性的分类新模型。该模型通过将原始苹果图像、原始图像中每个苹果的分割图片作为基于卷积神经网络的分类器的输入,并将分类器的输出结果进行集成,以提高苹果分类的准确性。

1 苹果分类机器人实现苹果分类的新模型

1.1 苹果图像数据库

为提升苹果图片数据库的代表性,通过不同的图片共享网站、文献和移动设备收集了1 592张、12种苹果(红富士苹果、瑞香红苹果、寒富苹果、鲁丽苹果、秦冠苹果、鸡冠苹果、皇后苹果、嘎啦苹果、津轻苹果、陆奥苹果、红冠苹果、红星苹果)的图像,这些图片涵盖了不同气候、亮度、对焦、遮挡、分辨率、距离和角度等条件下的苹果。这些图片构成的数据库被分为3个子图片数据库:70%的苹果图片构成子图片数据库1,用于分类模型训练;15%的苹果图片构成子图片数据库2,用于分类模型测试;15%的苹果图片构成子图片数据库3,用于分类模型验证。

1.2 用于提取特征的苹果分类基础模型

在引入基于图像分割和卷积神经网络的苹果分类模型之前,首先说明组成该分类模型的两种苹果分类基础模型:完整基苹果分类模型(apple classification model based on original apple images,FACM)和分割基苹果分类模型(apple classification model using segmented apple images,SACM),如图1所示。完整基苹果分类模型(图1a)使用完整的(未分割的)原始苹果图像进行训练,而分割基苹果分类模型(图1b)使用分割苹果图像进行训练。分割苹果图像忽略了苹果图像中的环境因素(如树枝和土壤等),只关注苹果,以削弱环境对苹果分类的干扰。

图1 苹果分类基础模型

两种基础模型将接收到的苹果图像发送到由一组卷积层组成的特征提取块,作为网络分类层的基础信息。特征提取块由InceptionV3、ResNet50或EfficientNetB3模型去除分类层之后的卷积部分组成。特征提取块的输出首先经过一个全局平均池(global average pooling,GAP);然后依次连接到一个有1 024个神经元的密集层和一个有512个神经元的密集层;最后通过一个由12个神经元和softmax功能组成的分类层对图像中包含的苹果进行识别。除最后一层外,前两个密集层使用重读激活功能。

1.3 苹果分类模型

根据选用的输入图像和基础苹果分类模型不同,可构建3种基于图像分割和卷积神经网络的苹果分类模型:完整图像苹果分类模型(图2a)、多重分割图像苹果分类模型(图2b)、多重分割-完整图像苹果分类模型(本文推荐的模型,图2b)。其中:

图2 苹果分类模型

1) 完整图像苹果分类模型直接对原始苹果图像进行处理。

2) 多重分割图像苹果分类模型接收由苹果检测网络裁剪下的所有苹果作为输入,然后将其逐一作为分割基苹果分类模型的输入进行苹果分类,最后将以上所有模型的输出直接相加。

3) 多重分割-完整图像苹果分类模型将多重分割图像苹果分类模型的输出与完整图像苹果分类模型的输出集成。

后两种苹果分类模型均选用由ResNet50组成的Faster RCNN作为苹果检测网络,用于检测原始苹果图像中所有苹果的位置。输入检测网络的图像尺寸为640像素×640像素,原始苹果图像尺寸不固定。为满足检测网络对输入图像的要求,所有图像都使用OpenCV库的图像处理程序对原始苹果图像进行像素调整。

1.4 苹果分类模型训练

选用适用于多种类目标识别问题的分类交叉熵作为优化分类模型的成本函数[9]:

(1)

选用评估准确率作为评估性能指标。对于苹果检测网络的训练,使用以下成本函数:

(2)

2 实验分析

实验过程中所有苹果分类模型通过TensorFlow库实现,选用学习速率为1×10-3的AdaGrad优化器,文献[10]证明了该选择的合理性。在密集层中,基础苹果分类模型的权重采用Glorot Uniform技术做初始化处理,而特征提取层的权重采用ImageNet进行预先训练,ResNet50网络被选为模型的优化网络。

2.1 苹果检测网络的检测实验

为提升所构建模型的苹果分类效果,必须对基于Faster RCNN的苹果检测网络进行训练。为简化训练,该网络只检测苹果而不对它们进行分类。选用常用函数IoU(intersection over union)作为检测评价指标,该指标用于判断两个交叉边界框内的目标是否属于同一对象,即评估对象的预测框B与对象的真实框Bgt之间的差距。

(3)

式中:IloU为检测评价指标。

在Faster RCNN中,将IIoU用于非最大抑制(non-maximum suppression,NMS)步骤,即删除属于同一对象的所有低于最大IIoU的预测结果;如果所预测的最大IIoU低于0.5,也将被删除。此外,每张图像检测到的苹果数量限制在10个以内,并保留IIoU值最大的苹果。为了提高苹果检测网络的检测性能,对训练苹果图像数据库采用以下数据扩展方式:亮度调整、90°多次旋转、水平和垂直翻转。

由于在检测过程中存在苹果漏检或背景环境被检测为苹果的可能,选用检测精度Pprecision、召回率PRecall和F1分数PF1来描述苹果检测网络对苹果的检测效果和苹果分类模型对苹果的分类效果:

(4)

(5)

(6)

式中:NTP和NFP分别表示真阳性(边框内有目标对象且被检测到,true positive,TP)样本数和假阳性(边框内没有目标对象但检测到有目标对象,false positive,FP)样本数,NFN表示假阴性(边框内有目标对象但没被检测到,false negative,FN)样本数。

基于Faster RCNN的苹果检测网络对12类苹果的检测准确率见表1。为了确定检测到的边界框是否对应于具有真实标签的苹果,将IIoU的阈值设定为0.6。基于Faster RCNN的苹果检测网络对品种11苹果的检测精度最高,达到95.74%;对品种12苹果检测的召回率和F1分数最高,分别达到95.00%和93.83%,检测网络对不同品种苹果检测精度(简称精度)、召回率和F1分数的差异主要源于训练图像数据集中每张苹果图像中苹果数量的差异。

表1 基于Faster RCNN的苹果检测网络对苹果的检测准确率

2.2 苹果分类模型的分类实验

3种苹果分类模型对有数据扩展的苹果图像数据库和没有数据扩展的苹果图像数据库的处理结果见表2。由表可知,多重分割-完整图像苹果分类模型对2种数据库中苹果的分类准确率高于其他2种分类模型;该模型通过将多重分割图像苹果分类模型和完整图像苹果分类模型的输出集成,提升了对苹果的分类准确率,其对测试数据集中苹果的分类准确率达到95.69%。该结果表明,对完整图像和分割图像的处理均有助于提升对苹果的分类准确率。

表2 3种苹果分类模型对苹果的分类准确率和分类用时

使用完整图像苹果分类模型和分割图像苹果分类模型对苹果分类准确率的不同与以下规律有关:离苹果更近拍摄的照片的图像分辨率和清晰度更好,但单一图片中苹果的数量更少;而更远距离拍摄的照片的图像分辨率较低,但单一图片中苹果的数量更多。多重分割-完整图像苹果分类模型充分利用了以上事实。

表2还给出了每类苹果分类模型对苹果的分类时间(以秒为单位)。由于多重分割-完整图像苹果分类模型的步骤较多,故其分类耗时最长,但分类时间仍未超过1 s,在可接受范围内;且相对于分类时间的增加,多重分割-完整图像苹果分类模型对苹果分类准确率的明显提升才是应该关注的重点。

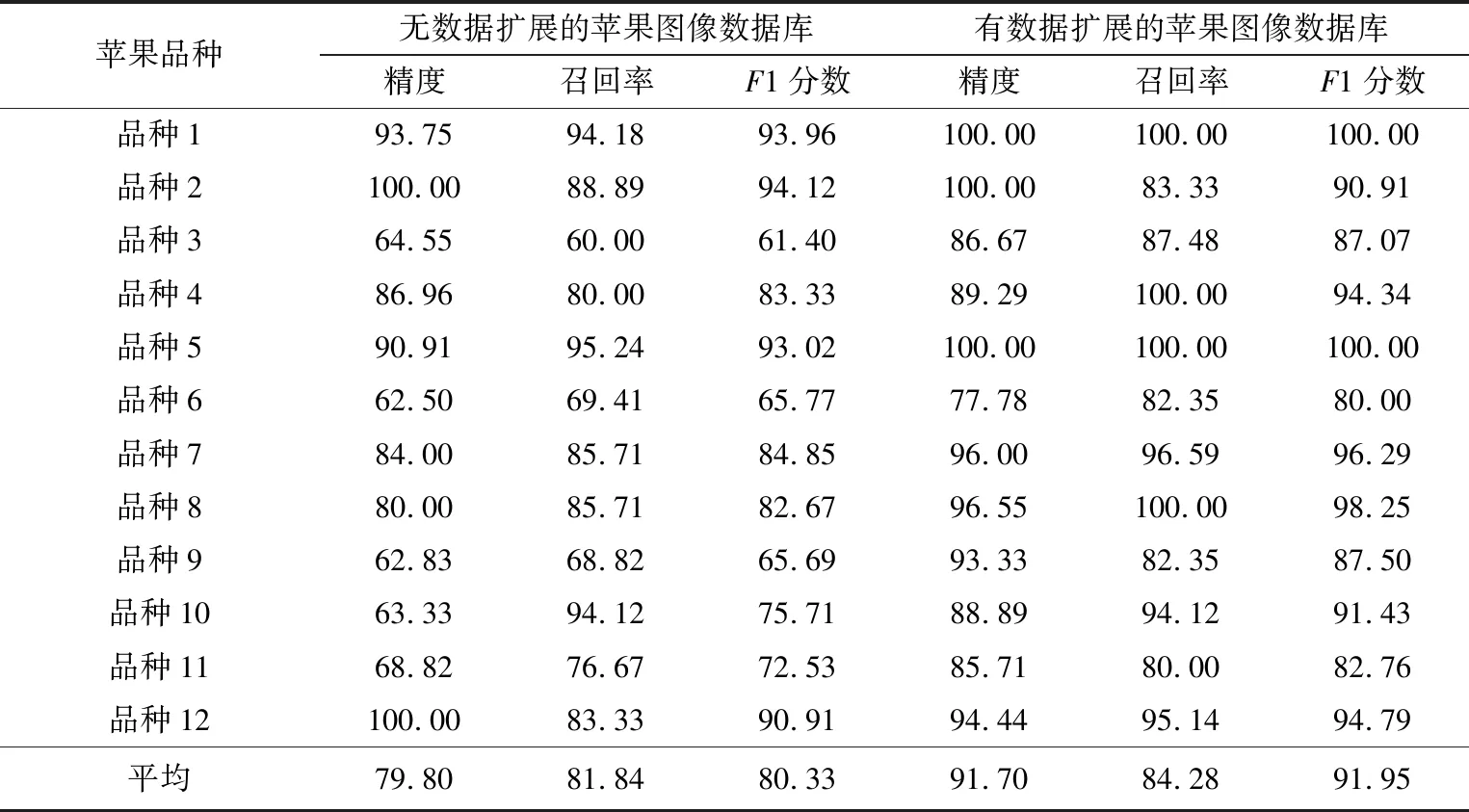

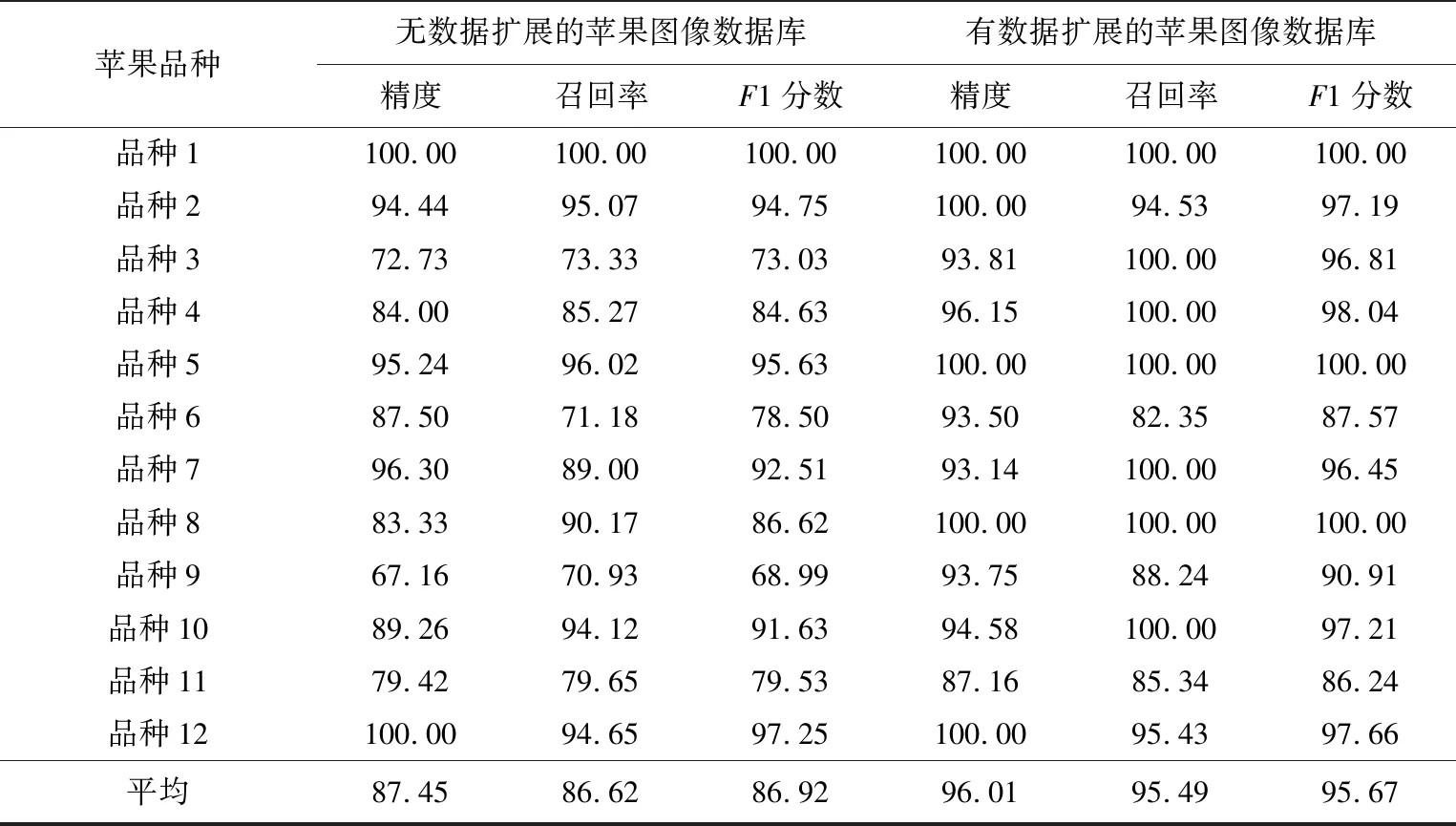

表3、4和5详细列出了3类苹果分类模型对苹果分类的精度、召回率和F1分数。由表3~表5可知,多重分割-完整图像苹果分类模型对苹果分类的精度、召回率和F1分数都优于其他2种分类模型。该模型对多种苹果的精度(品种1、品种2、品种5、品种8和品种10)、召回率(品种1、品种3、品种4、品种5、品种7、品种8和品种10)、F1分数(品种1、品种5和品种8)达到100.00%。对3种分类模型的苹果分类结果的对比表明,通过将多重分割图像苹果分类模型和完整图像苹果分类模型的输出集成,可加强苹果分类的鲁棒性。

表3 完整图像苹果分类模型对苹果的分类结果 %

表4 多重分割图像苹果分类模型对苹果的分类结果 %

表5 多重分割-完整图像苹果分类模型对苹果的分类结果 %

3 结束语

本文提出了基于图像分割和卷积神经网络的多重分割-完整图像苹果分类模型,通过对12种苹果、1 592张苹果图片的分类处理,验证了所构建苹果分类模型的有效性。该模型通过将多重切割图像苹果分类模型和完整图像苹果分类模型的输出集成,提升了对苹果的分类准确率,加强了苹果分类机器人对苹果分类的鲁棒性,证明所构建模型具有较好的实际应用前景。