基于小波包变换的自适应混沌信号降噪算法

2023-11-18刘云侠贝广霞蒋忠贇孟时慧喆

刘云侠 贝广霞 蒋忠贇孟 强 时慧喆

(山东科技大学工程实训中心 青岛 266590)

1 引言

混沌运动是一种貌似随机的不规则运动,在非线性系统中普遍存在[1–3]。由于自身和外在因素的 影响,实际得到的混沌信号都包含一定的噪声,噪声的存在严重破坏了混沌系统的内在动态特性,给参数的计算和变量的分析预测带来很大的困难,因此对实用可行的混沌信号降噪算法进行研究具有重要的理论意义和工程应用价值[4–8]。

通常,混沌信号具有内在行为似噪声性和功率宽带性,因此传统频谱分析方法,比如线性滤波器难以实现信噪分离[9,10]。近年来,作为一种有效的时频分析和多分辨率分析方法,小波变换可以很好地表征信号的局部特征。由于只对近似系数进行再分解,无法聚焦到信号的任意细节,因此限制了其在混沌信号降噪领域的应用[11–15]。

为了实现信号的多尺度细化分解,本文采用小波包对混沌信号进行变换,并对自适应降噪算法进行了研究[16–21]。首先,根据不同分解层近似系数和细节系数的相关性与能量不同,确定了最佳分解层数和最优小波包基。然后,结合不同的方法对变换后的最优小波包系数进行分析和自适应选择,最大限度地提取混沌信号的局部特征和细节信息,降低系统的重构误差。同时,本文还从多个角度对降噪效果进行评价,以验证所提算法对混沌信号降噪的有效性。

2 小波包降噪的基本原理

小波包分解算法是小波分解的进一步细化,通过一系列中心频率不同但带宽相同的滤波器,将信号投影到小波包基函数张成的空间,能够对分解后各个层次的小波包系数进行局部分析。

假设实际观测混沌信号为

其中,x(n)为混沌信号,η(n)为 高斯白噪声,n=1,2,···,N。

通过频带的多层次划分,小波包分解算法能够对细节系数再分解。利用小波包算法对混沌信号降噪主要包括4步:分解层数的确定、小波包基的选择、小波包系数的量化和重构。降噪效果的好坏主要取决于前3个环节,但是分解层数、小波包基和阈值的量化选取比较困难,因此限制了其在实际中的应用。

3 基于小波包变换的自适应混沌降噪算法

针对小波包降噪的缺陷,本文提出一种有效的自适应混沌信号降噪算法。本算法对小波包变换后最佳分解层数、最优小波包基和小波包系数的选择及确定进行了详细的分析与研究,具体算法如下。

3.1 最佳分解层数的确定

利用小波包对混沌信号进行变换分析,分解层数过大,会降低系统的内在动态特性;反之,系数中含有的过多噪声,会增大重构误差。因此,最佳分解层数的确定非常重要。

基于混沌结构的自相似性和噪声的随机性,混沌信号和噪声的相关性不同。本文通过对比每一分解层近似系数和细节系数的自相关系数来确定最佳的分解层数,自相关系数的定义为

其中,τ表示延迟,t=1,2。

通常,混沌具有较大的自相关系数,而高斯白噪声的自相关系数非常小。混沌信号经过小波包变换后,随着分解层数的增加,小波包系数的自相关系数绝对值会先减少再增加。在最佳分解层,不同小波包系数的自相关系数满足以下条件:

3.2 最优小波包基的选择

由于混沌信号的能量较大,噪声的能量较小,本文以对数能量熵作为代价函数,其定义为

其中,E(0)=0。

熵值反映了状态的合乎规律的程度,值越大,状态越有序;值越小,状态越不均匀。当细节高频部分进一步分解时,保留分解系数能量大于对应高频部分能量的系数,去掉其余系数。

3.3 小波包系数的量化

基本小波包降噪算法主要采用阈值量化对小波包系数进行取舍,但是硬阈值方法的阈值函数不连续,软阈值方法的通用阈值存在恒定偏差。针对这个问题,本文分别结合局部投影和神经网络对最优小波包系数进行量化。近似系数一般由低频信号组成,但仍然包含一定的噪声,在局部邻域内对其进行投影分析,能够减小真实值和重构值之间的偏差,最大限度地降低噪声的影响;细节系数一般由高频噪声组成,但仍然含有一定的有用信息,结合神经网络的自学习算法对其进行自适应选择,可以最大限度地保留有用信息,提高系统的信噪比。

3.3.1近似系数的局部投影分析

其中:D和R分别表示方向矩阵和对角权重矩阵,是高阶误差。

在重构的相空间中,总是存在一个超平面,而超平面和相点之间的偏差就代表噪声,这个偏差可以表示为

假设由噪声构成的零子空间的维数为Q,那么偏差在该零子空间上的投影可以写为

其中,qk表示归一化矢量。

在局部邻域内,计算Z(n)的协方差矩阵

通过式(11)求出协方差矩阵的特征值及特征矢量,去掉较小特征值对应的特征矢量,可以得到分析后的近似信号,即

3.3.2细节系数的自适应选择

考虑到软、硬阈值处理方法的不足,利用神经网络对细节系数进行自适应选取。假设为第i层第j个最优小波包细节系数,加入Sigmoid阈值滤波单元后,细节系数为

此时,重构信号可以表示为

为了获得令人满意的降噪性能,通常希望最小化式(15)的指标

利用梯度下降算法,分别求式(15)对参数α和β的导数,可得

其中,0<γ <1和 0<δ <1表示学习速率。

当指标E(α,β)达到最小时,就实现了细节系数的自适应选取。

3.3.3小波包系数的重构

将分析后的近似系数和细节系数进行重构,就得到了降噪后的信号,即

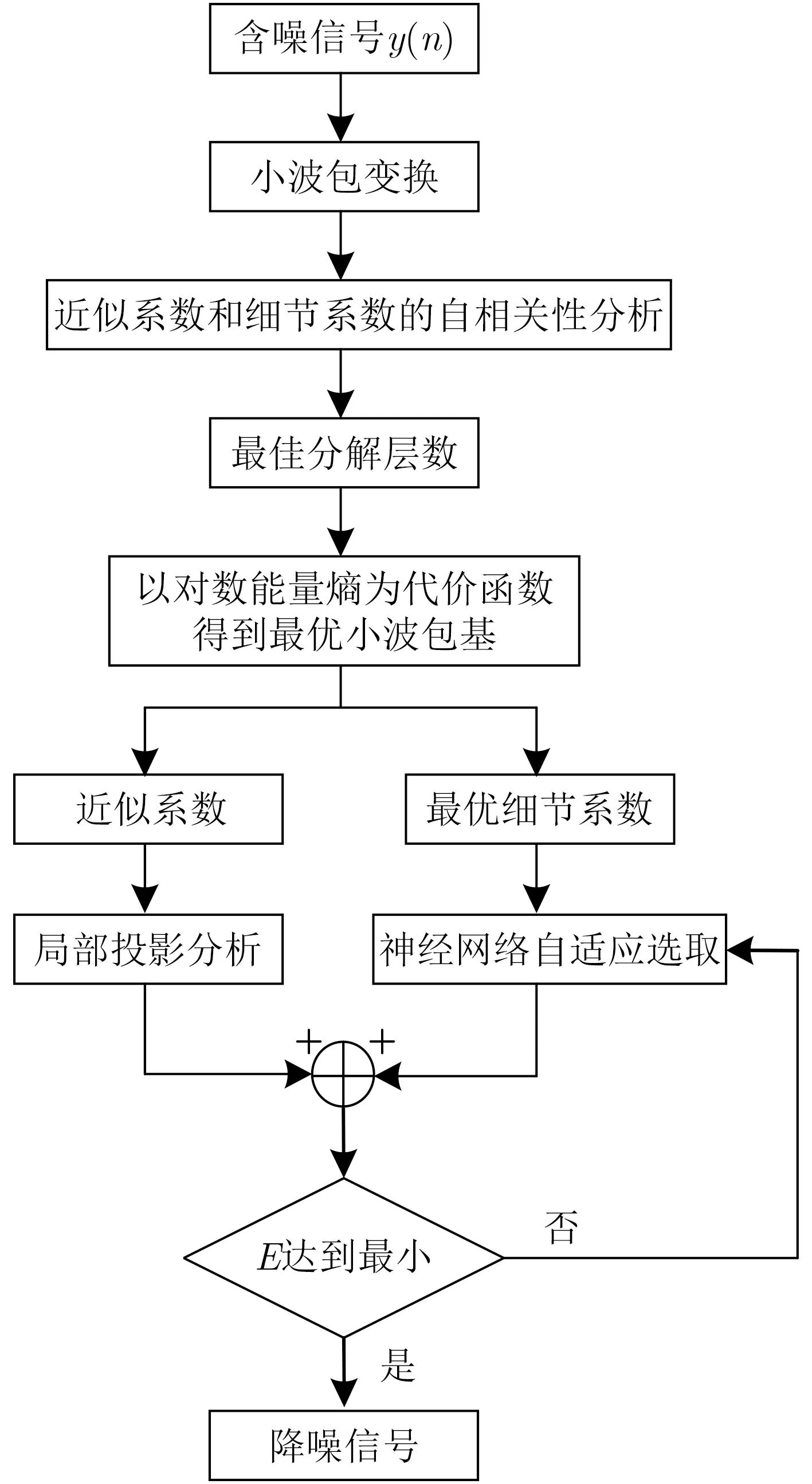

基于上述的理论分析,本文算法的具体流程如图1所示。

图1 基于小波包变换的自适应混沌降噪算法流程图

在图1中,本文算法首先对混沌信号进行小波包变换,根据混沌和噪声的相关性与能量差异,确定最佳分解层数和最优小波包基,在简化计算和提高效率的同时,最大限度地表示信号的内在规律性。然后,对近似系数进行相空间重构,并在局部邻域内对其进行投影分析,通过去掉较小的奇异值,有效表征混沌信号的局部特征。同时,结合神经网络的梯度下降算法,自适应提取混沌信号中的细节信息,进而克服阈值量化导致的重构误差大的缺点。该降噪算法具有很好的理论基础,每一步都具有确定的含义,实现简单,因此不仅能够很好地保持系统的内在动态特性,提高系统的信噪比,而且能增强稳定性和实用性。

3.4 降噪效果评判指标

主要从以下3个方面对降噪算法降噪效果进行评判。

(1)对降噪前后信号的信噪比(Signal-Noise Ratio,SNR)和均方根误差(Root M ean Square Error,RMSE)进行分析,这两个指标的公式为

SNR和RMSE都能够反映降噪能力的大小,SNR值越大,RMSE值越小,说明降噪的效果越好。

(2)在时域内,分析降噪前后信号的自相关函数。由于高斯白噪声自相关函数值比较小,混沌自相关函数值比较大,因此可以通过对比反映降噪效果。

(3)在频域内,分析信号的功率谱。功率谱是频域内提取有用信息的工具,功率谱的定义为

其中,ω表示角频率。

由于噪声具有高频性,混沌具有低频性,因此可以通过比较功率谱评价降噪效果。

4 仿真实例

为验证本文算法的有效实用性,以加高斯白噪声的Rossler混沌信号为研究对象,其动力学方程如式(21)所示

当d=0.2,e=0.2,f=5时,系统处于混沌状态。此时,分别选取x轴、y轴和z轴方向各2 000个时间序列数据进行仿真分析。

正交小波包能够对高频部分精细分解,重构时无相位失真,因此能够对混沌信号进行更好的时频局部化分析。正交小波包函数db n中的n代表消失矩,决定了逼近光滑信号的能力,阶数越大,频带划分效果越好。通常,选择n∈[2,10]。为了提高降噪算法的效率,本文选择db8小波包进行变换分析。

首先,利用db8小波包分别对加噪5%,10%,20%,35%,60%,90%的x轴方向的时间序列数据进行6层变换,并计算每一层的自相关系数及差值,得到的曲线如图2所示。

通过分析可以看出,在不同噪声水平下,当分解层数小于等于3时,的自相关系数高度相关,的自相关系数相关性很小,且两者自相关系数差值都大于0.5,因此最佳分解层数为3。对y轴和z轴方向的时间序列数据进行相同的分析,可以得到最佳分解层数分别为3和2。

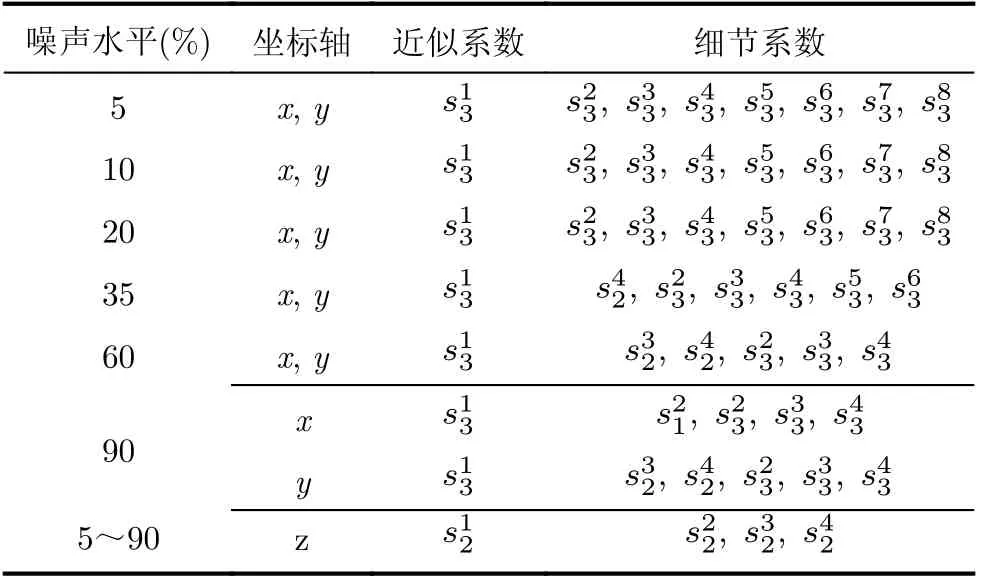

当分解层数为最佳分解层数时,对不同噪声水平下x轴、y轴和z轴方向的时间序列数据分别进行小波包变换,通过计算每一层每一个小波包系数的对数能量绝对值,可以得到对应轴时间序列数据的最优小波包基,如表1所示。

表1 不同噪声水平下的最优小波包基

通过图2和表1可以看出,针对不同的数据,随着噪声水平的提高和分解层数的增大,在一定范围内,近似系数的相关性会下降,细节系数的相关性会增加。以对数能量熵作为代价函数,可以得到信号的最优小波包基,从而最大限度地体现信号的内在规律。

然后,对近似系数进行局部投影分析,利用神经网络梯度下降算法对细节系数进行自适应选取。在本文中,为了减少误差曲面平坦区和极小点对细节系数收敛的影响,系数一般初始化为一个较小的数值,选择学习速率γ=0.1,δ=0.01。此时,对3个轴方向时间序列数据的细节系数进行分析,当迭代次数为50时,各轴误差平均值的变化曲线如图3所示。

图3 误差平均值变化曲线

通过图3可以看出,误差平均值会先减小再增大,之后呈下降趋势。取误差平均值到达最小值时所对应的值为分析后的细节系数。最后,对分析后的近似系数和细节系数进行重构,就可以得到降噪后的信号。

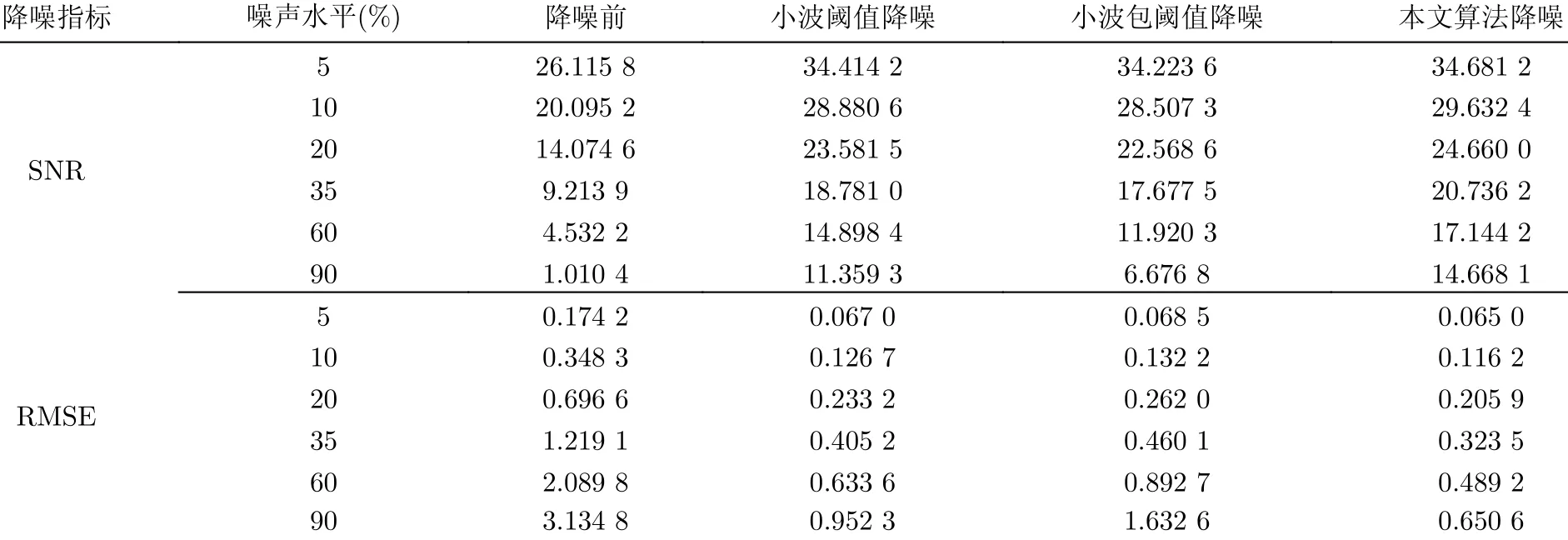

利用本文算法对加噪Rossler信号进行降噪分析,并与小波阈值降噪算法、小波包阈值降噪算法进行比较。对x轴方向时间序列数据,不同噪声水平下,降噪前后系统的SNR和RMSE对比如表2所示。

表2 SNR和RMSE对比表(x轴)

对y轴和z轴方向时间序列数据,当噪声水平为20%时,分别采用小波阈值降噪算法、小波包阈值降噪算法和本文算法对其进行降噪分析,降噪前后系统的SNR和RMSE对比如表3所示。

通过表2和表3可以看出,与两种阈值降噪算法相比,本文降噪算法更能体现降噪的优越性,噪声水平越高,降噪效果就越好。这主要有两方面原因:一方面,信号局部特征的有效提取提高了系统的信噪比;另一方面,细节系数的自适应选取进一步降低了系统的重构误差。

为了更加直观地展示降噪效果,加噪20%Rossler信号和采用3种算法降噪后信号的3维相空间图分别如图4(a)—图4(d)所示。

通过图4发现,本文降噪算法不仅有效地实现了信噪分离,而且很好地保持了系统的动态特性、非线性和平滑性。

为了进一步衡量降噪算法的优劣,下面以x轴方向时间序列数据为例,分别从时域和频域分析降噪前后系统的特性。

首先,在时域,当噪声水平不同,延迟时间分别为1 s,2 s和5 s时,降噪前和采用3种降噪算法降噪后信号的自相关系数如表4所示。

表4 信号的自相关函数值

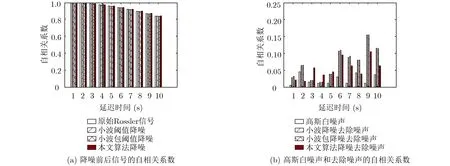

当噪声水平为20%,延迟时间为1~10 s时,降噪前后信号的自相关系数和去除噪声的自相关系数分别如图5(a)和图5(b)所示。

图5 自相关系数图

通过对比发现,本文降噪算法降噪后信号的自相关系数值更大,相关性更强,而去除噪声的自相关系数都非常小。同时,随着噪声水平的增大,降噪后信号的自相关系数相对稳定,都能够很好地表征信号的特征。因此,从侧面反映出本文降噪算法对不同噪声水平下混沌信号降噪的优越性能。

然后,在频域,同样以加噪20%的x轴方向时间序列数据为例,对降噪前和采用3种降噪算法降噪后的信号进行功率谱分析。原始信号、高斯白噪声、加噪信号和降噪算法降噪后信号的功率谱分别如图6(a)—图6(f)所示。

从中可以看出,本文方法降噪后信号的功率谱最接近于原始信号功率谱,不仅保持了信号的内在规律性,而且更大程度地降低了噪声的影响,很好地体现了本文提出算法在提取信号特征方面的有效性能。

经过分析发现,本文算法能够对已知模型的混沌信号进行有效降噪,在提高系统信噪比,降低重构误差的同时,很好地表征信号的内在动态特性。在自然界,虽然大部分运动产生的序列都属于未知模型,比如水文、天文、气象运动产生的年径流量、太阳黑子数、降雨量等,但是通过研究发现,这些序列都具有一定的混沌特性,因此也能够用本文算法进行降噪分析,从而为数据的进一步研究和相应参数的计算提供理论分析依据。

5 结束语

为了更加有效地实现信噪分离,结合局部投影和神经网络梯度下降方法,对小波包混沌信号降噪算法进行了改进。一方面,本文算法从局部对混沌信号进行细化和时频域分析,降低了重构误差。另一方面,通过最小化目标函数,实现了细节系数的自适应选取,克服了小波包降噪阈值量化困难的问题。同时,本文还给出了小波包变换最佳分解层数和最优小波包基的确定方法,为简化计算、提高效率提供了依据。为了体现降噪效果的优劣,采用本文算法对混沌信号进行降噪,并对降噪前后信号的信噪比、均方根误差、自相关系数和功率谱进行比较。通过分析发现,本文算法不仅能对混沌信号进行有效降噪,而且降噪后系统的性能稳定,具有一定的实用价值。