人工智能视域下教师课堂教学行为分析

——以物理课堂为例

2023-11-09管彤彤张立强彭朝阳

管彤彤 张立强 彭朝阳

(1.云南师范大学 物理与电子信息学院,云南 昆明 650500 2.北京师范大学 心理学部,北京 100875)

随着人工智能技术的不断升级和发展,人工智能赋能教育创新已经成为我国教育改革的重要抓手,基于证据意识的教育教学研究也逐渐引起了研究者广泛的关注[1]。当前,教师教育实践的科学性尚有不足,对教师课堂教学的评价往往是基于人力完成,耗时耗力,缺乏量化的证据支持,而人工智能技术凭借强大的数据挖掘以及计算分析功能,能够高效采集真实数据、识别数据并分析数据间的逻辑关系,为教师改进教学提供客观的证据支撑,强化课堂教学评价对教师教学与学生学习的反馈作用,助推课堂教学的智能化创新[2]。因此,人工智能与教育教学的深度融合将是提高教师教学能力及专业发展水平的关键途径。

目前,人工智能技术赋能课堂教学的相关研究方兴未艾,大多是利用智能手段监控课堂上学生的学习状态,以帮助教师调整和改进教学,而鲜少聚焦于课堂教学中的教师行为[3]。课堂作为学校教育的主阵地,教师的课堂教学行为对教学质量有着巨大影响,基于人工智能技术合理且广泛地采集课堂中教师自身的多模态数据,可以为其教学反思和能力提升提供事实依据。同时,当前的人工智能处于弱人工智能阶段[4],基于人工智能进行学科教学分析的研究更是相对匮乏。以物理学科为例,物理作为基础教育的科学课程之一,以培养学生核心素养为导向,有其独特的育人价值[5]。另外,物理课堂教学的目标不仅仅是提高学生的物理成绩,更多的是培养学生的物理学科核心素养及科学素养,满足学生终身发展的需求,而学生的科学素养很大程度上取决于教师的水平和能力。

因此,为提高物理课堂教学质量、提升物理教师教学水平,本研究选用物理教师课堂教学视频,结合人工智能技术对视频中教师的言语表达及情感状态等进行量化分析,利用人工智能算法和深度学习算法辅助评价教师的课堂教学能力,为教师反思和改进课堂教学提供决策依据,助推高质量、高素质、专业化教师的培养。

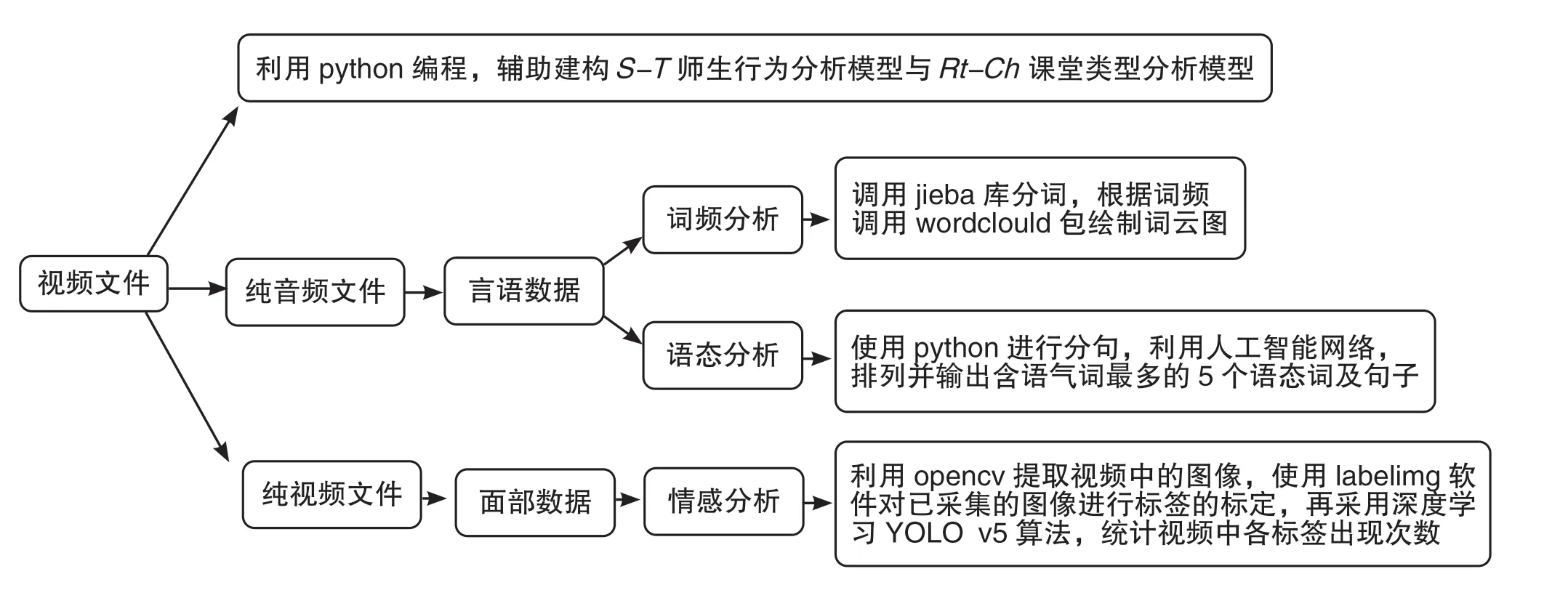

本研究的思路如下:首先介绍基于人工智能的课堂教学分析系统框架,再详细叙述基于人工智能的物理课堂教师行为研究路径,包括Python 编程辅助S-T分析法、人工智能技术对教师言语的处理及深度学习YOLO v5 算法对教师面部表情的处理,最后对选取的物理课堂教学视频进行对比分析,并结合新课程课堂评价表得出结论。

一、基于人工智能的课堂教学分析系统架构

结合目前人工智能技术对课堂教学分析的现实需求,基于人工智能的课堂教学分析系统架构分为对象层、数据层、技术层和应用层,如图1 所示。

图1 基于人工智能的课堂教学分析系统架构

课堂教学是一种师生双边互动活动,因此,人工智能视域下的分析是基于教师和学生两大对象。通过采集的多模态数据,包括言语、行为、心理、生理、学业以及脑数据等,设计并利用算法进行语音识别、姿态识别、表情识别和脑数据识别等,进而量化分析课堂教学,实现其在教师教学反馈、教师教研、教育评估、教学诊断等方面的应用价值。

二、基于人工智能的物理课堂教师行为研究路径

本研究选用A、B 两位物理教师的课堂教学视频,A教师的教学视频曾获全国青年教师讲课比赛一等奖,B 教师的教学视频是某中学的公开课,授课内容均为高中物理选择性必修二第二章第四节“互感与自感”。借助人工智能技术采集两位教师的言语数据和面部数据,对课堂师生互动、类型、词频、语态及情感进行分析,辅助教师及时反思和调整教学行为,推动教师专业化发展。为此,本研究基于人工智能技术开展研究,研究路径如图2 所示。

图2 基于人工智能的物理课堂教师行为研究路径

(一)python 编程辅助S-T 分析法

为直观地展示课堂上的师生行为情况,采用S-T分析法进行分析[6]。这是一种较为成熟的师生行为量化分析方法,它将课堂行为分为学生行为与教师行为,“S”代表学生行为,“T”代表教师行为,具体定义如表1 所示。

表1 S-T 分析法的行为定义

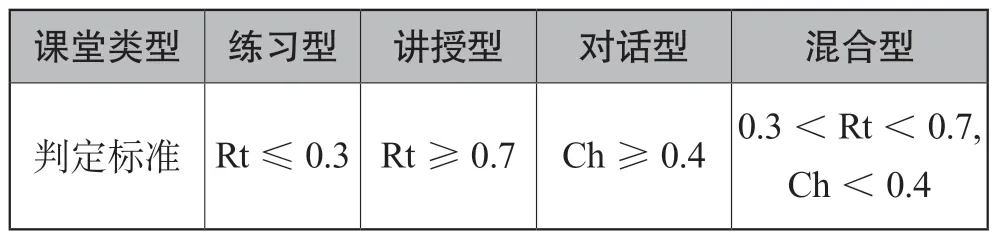

本研究设定每隔30s 进行采样,以手工的方式收集S、T数据后,采用python 代码对已经收集到的数据进行计数、排列,以T行为为横轴、S行为为纵轴,进而得到随时间变化的S-T曲线图。再根据公式Rt=Nt/N,Ch=(g-1)/ N进行计算。其中,Rt表示教师行为占有率,Rt值越高,则教师行为越多;Ch表示师生行为转换率,Ch值越高,则课堂师生互动越多;N表示师生行为总数,Nt表示教师行为总数,g为师生连续行为总数,g-1 为教师行为和学生行为间的转换次数。根据课堂类型判定标准(见表2),以Rt值为横坐标,Ch值为纵坐标,绘制Rt-Ch图框架并标记对应坐标点,依据点所在的位置判定课堂类型。

表2 S-T 分析法的课堂类型判定标准

(二)人工智能技术对言语数据的处理

为了对教师的行为有客观精确的评价,本研究将视频多模态化处理,利用iMovie 剪辑将单一的视频数据分割成纯音频数据和纯视频数据。

言语行为占据课堂教学行为的80%左右[7],而教师的言语又是教学内容传播的载体,决定教学活动的开展,影响学生学习的效果,因此,本研究分别对词频和语态进行分析,进而多角度评价教师的课堂语言。

在学科教学中,教师对关键概念和关键词的重复和强化可以引发学生的无意注意,使他们于不知不觉中对关键概念进行重复,加深对知识的理解。为此,在词频分析部分,本研究使用Python 编程语言,根据中国常用词库调用jieba 库分词,除去常用语气词及标点符号,筛选并统计词频,再调用wordclould 库绘制词云图,将教师的重复词一目了然地呈现出来。

为了多层次、多方面地研究教师的课堂语言,本研究同时分析了教师语态。教师语态的好坏是影响教学效果的关键之一,优秀教师的语言表达准确且生动,而语言能力差的教师在表达上往往词不达意、枯燥乏味。同时,好的教师要避免使用“啊、嗯、那么、是不是”等口头禅,保证教学语言的准确和规范。基于此,在语态分析部分,同样使用Python 编程语言对言语数据转化的文本进行分句,将分好的词组和句子输入搭建好的人工智能网络中,统计句子中出现的语态,将含有语态词最多的句子由大到小进行排列,并输出含语气词最多的前5 个句子和出现最多的前5 个语态词,帮助教师明晰自身课堂语态上存在的问题,进而修正语言行为,提高课堂教学质量。

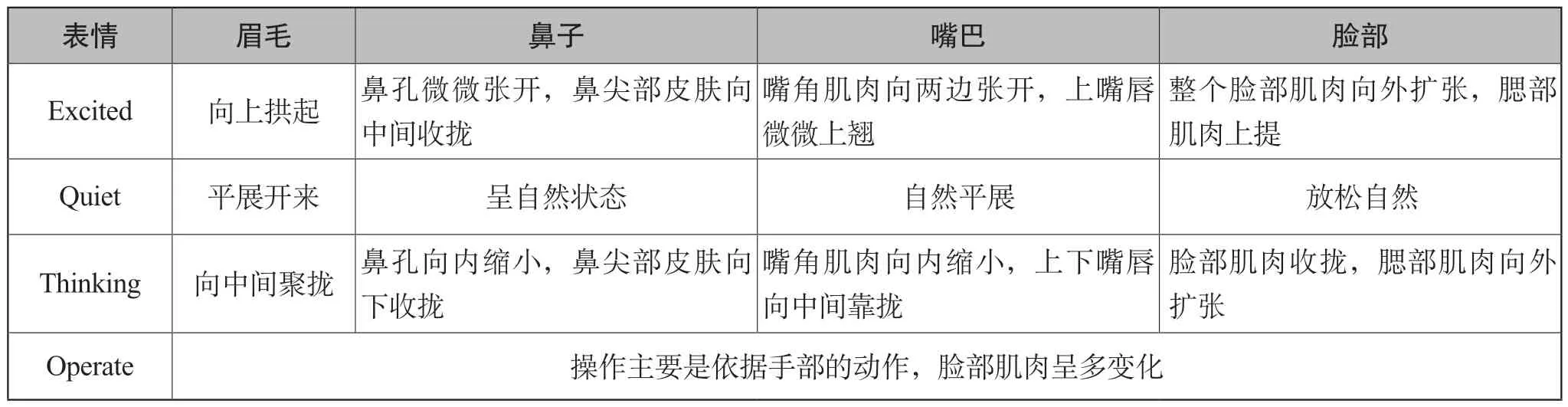

(三)人工智能技术对面部数据的处理

面部表情识别是通过捕捉人脸面部表情,利用人工智能技术识别并分析出人的表情所透露出来的情感、情绪。已有的研究更多地关注于课堂中学生的情绪状况,而少有对教师的课堂情绪进行研究。在教学过程中,教师情绪变化最明显的体现是其面部表情,教师通过面部传达其课堂教学的情绪,而教师情绪是影响学习者学习的中介变量,会影响学生的动机、认知和行为[8],进而直接影响教学质量与育人质量[9]。因此,借助人工智能技术采集教师面部数据[10],获取教师的情感特征,并反馈给教师,可以帮助教师及时调整课堂教学状态与教学方法。

本研究采用深度学习YOLO v5 网络识别教师的面部表情。YOLO v5 网络是YOLO 系列网络中现阶段较为前沿的一个网络[11],YOLO v5 主要由输入端、Backone、Neck 以及Prediction 四部分组成。其中,Backbone 是一种卷积神经网络,用于将不同图像的图像特征聚拢形成新的图像特征;Neck 将图像特征传递到预测层的网络层,用于混合和组合图像特征;Head 对图像特征进行预测,生成边界框并预测类别。此外,YOLO v5 还包含下列基础组件。CBL:由Conv+BN+Leaky_relu 激活函数组成;Res unit:一种残差结构,用来构建深层网络;CSP1_X:借鉴CSPNet 网络结构,该模块由CBL 模块、卷积层以及Res unint 模块、Concate组成;CSP2_X 通过模仿CSPNet 网络结构,由卷积层和X个Res unint 模块Concate 组合而成;Focus:首先将多个slice 结果Concat 起来,然后将其送入CBL 模块中;SPP:以金字塔池化方式对多尺度特征进行融合。

YOLO v5 算法在数据预处理上进行了改进,将数据集中的任意4 张照片以随机缩放、裁剪、排布的方式得到一张新图片,使得图像的结构变得充实、背景内容更加丰富,这是YOLO v5 算法中用来提升模型的训练速度和网络精度的Mosaic 数据增强方式。除了此种方式,YOLO v5 网络模型还通过自适应锚框计算和自适应图像缩放方式来辅助网络训练。因为本研究收集到的纯视频文件不符合YOLO v5 模型训练的要求,所以本实验基于“.avi”视频文件的特点调用opencv 库,按照每2s 的间隔对两份视频文件进行图像分割,并将分割完成的图像文件分别放入两个独立的文件夹中用于区分。因为YOLO v5 网络在训练时需要对图像进行标定,所以本研究用Labelimg 软件对已经分割的图像进行标定。当前已有研究者分别对教师及学生的面部表情进行分类研究[12],本研究根据物理课程的性质和教学特点,为视频中的教师打上这4 种标签: Excited(激情)、Quiet(冷静)、Thinking(思考)及Operate(操作演示)。具体如表3 所示。

表3 物理课堂教学教师表情的4 种标签

接着将标定完的图像格式转换成符合YOLO 网络框架的txt 格式,并放入YOLO v5 模型中训练,生成权重文件,再将原视频输入YOLO v5 网络中进行测试,进而比较这两个视频中4 个标签出现的次数。

为避免在网络训练时出现过拟合的现象,本研究对YOLO v5 网络训练的精确度进行了验证。选择100 张A教师教学视频的图像和100张B教师教学视频的图像,利用数据增强的方式(包括旋转、镜像、像素降低等)将原图像数据集扩充为2 000 张图像。

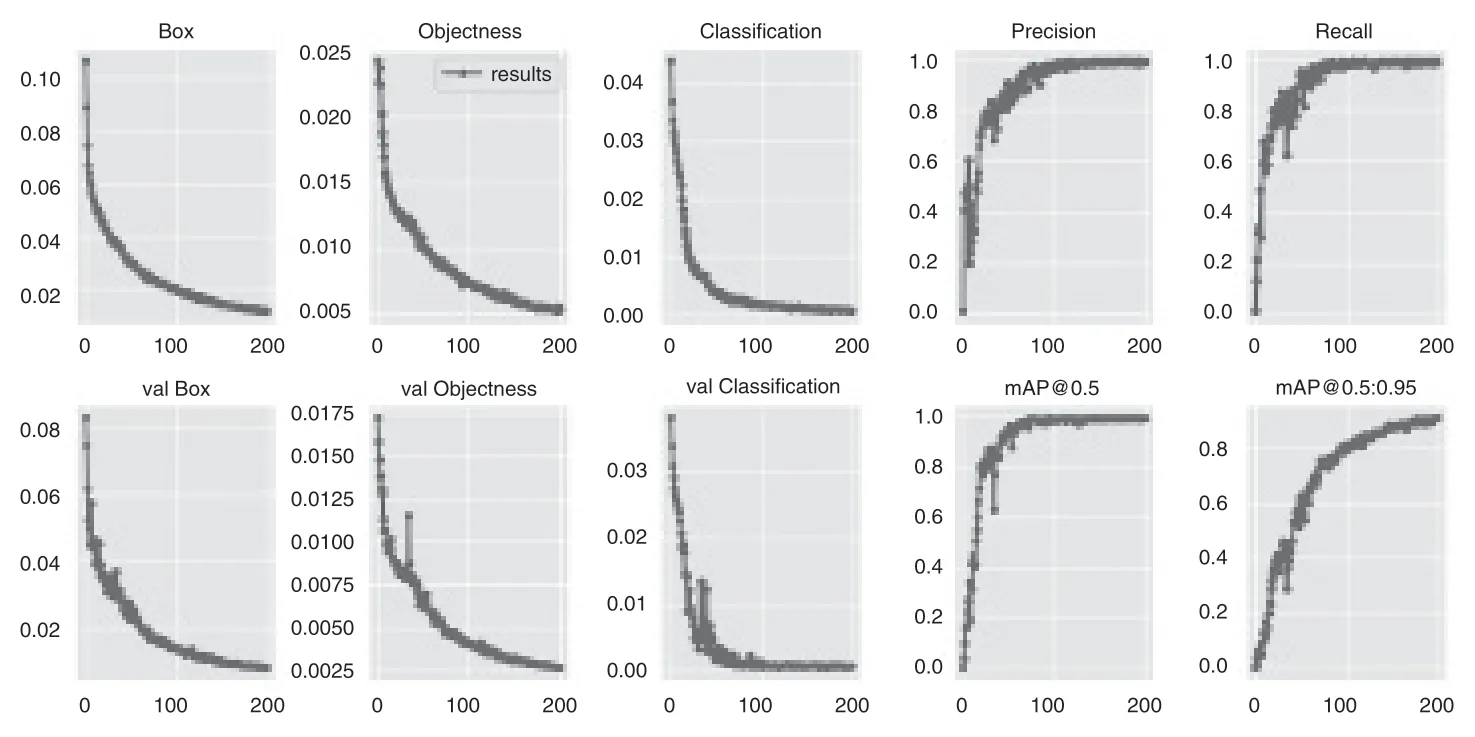

图3 展示的是YOLO v5 网络在训练时的损失值、精确度和回归率的变化。前3 列展示的是网络训练时训练集和验证集在Box、目的性和分类上的损失值变化。因为损失值表示真实值与预测值间的差距,其数值是越小越好,所以,如图3 所示,本实验中YOLO v5 网络的训练是非常成功的。在深度学习中,精确度展示的是模型网络预测正确的比值,回归率展示的是模型能够对真实数据预测的比值,二者在网络中都是越大表示模型训练得越好,因此,本实验中YOLO v5 网络不管是在训练集上还是验证集上,都有非常优异的表现。综上所述,本模型对A、B 两位教师在物理课堂上的面部表情变化能够做到精确预测。

图3 YOLO v5 网络训练图

三、基于人工智能的物理课堂教师行为实例分析

(一)S-T 分析及Rt-Ch 课堂类型判定

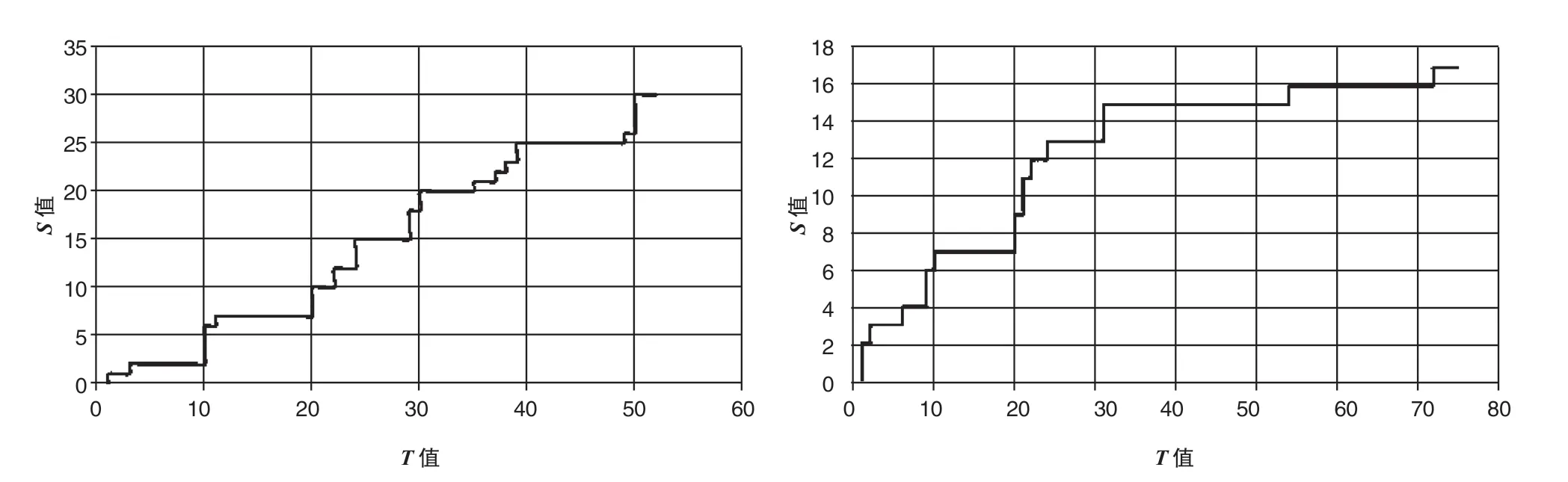

结合课堂言语与行为分析,采取S-T师生行为分析模型,分别对两段视频每隔30s 进行采样,收集并记录S、T数据,利用Python 语言编程得到A、B 两位教师的S-T曲线图(见图4)。A 教师课堂教师行为(占有率63%)明显少于B 教师课堂教师行为(占有率82%),说明B 教师在课堂中占据绝对的主体地位,而A 教师在课堂中并未牢牢地把持话语权,而是给予学生更多思考和表现的机会;A 教师课堂学生行为(占有率37%)明显多于B 教师课堂学生行为(占有率18%),说明B 教师课堂上学生的表现机会较少,主要都是在倾听教师的讲授,而A 教师课堂上的学生更加积极地参与课堂,主动思考、勇于表达,体现了学生的主体性。

图4 A 教师(左)和B 教师(右)课堂的Rt-Ch 课堂类型判定图

根据Rt-Ch课堂类型标准,运算得出A 教师课堂Rt=0.63,Ch=0.38,属于混合型课堂;B 教师课堂Rt=0.82,Ch=0.25,属于讲授型课堂。其中,A 教师课堂的Ch值大于B 教师的课堂,可见,A 教师课堂中的师生互动行为更多,课堂学习气氛活跃,更加民主、平等;相对来说,B 教师的课堂上,师生间交流少,课堂气氛较沉闷。

(二)词频及语态分析

通过Python 编程语言,分别对A、B 两位教师进行词频统计。A 教师和B 教师在课堂上输出频率最高的词都是“电流”,然而,A 教师输出频次为106,B 教师输出频次仅为51;A 教师和B 教师课堂上输出频率次高的词都是“线圈”,但是,A 教师输出频次为66,B 教师输出频次仅为43。显然,“电流”和“线圈”都是这两节课的关键词,但在关键词的重复和聚焦程度上,A 教师比B 教师做得更好,且A 教师无关的口语表达比B 教师要少。

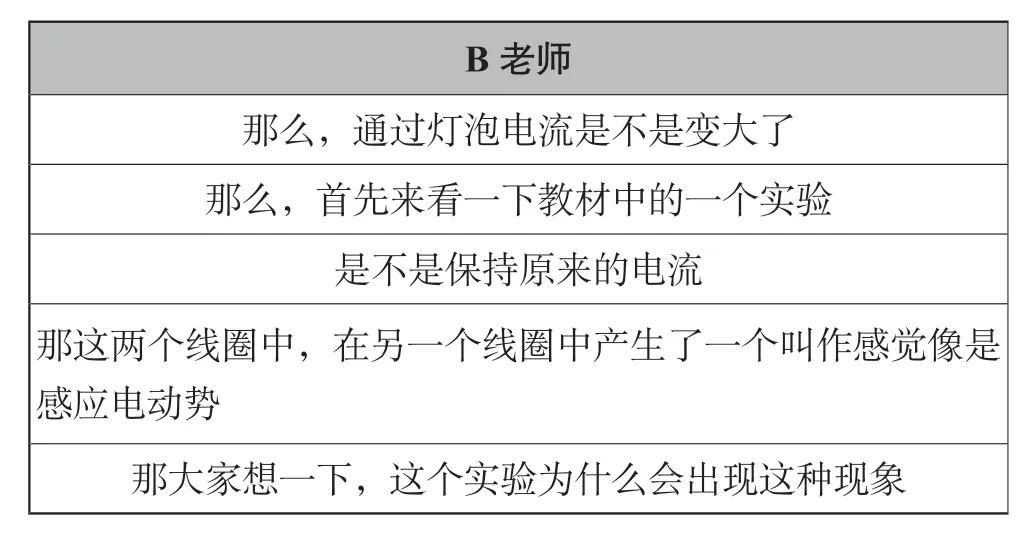

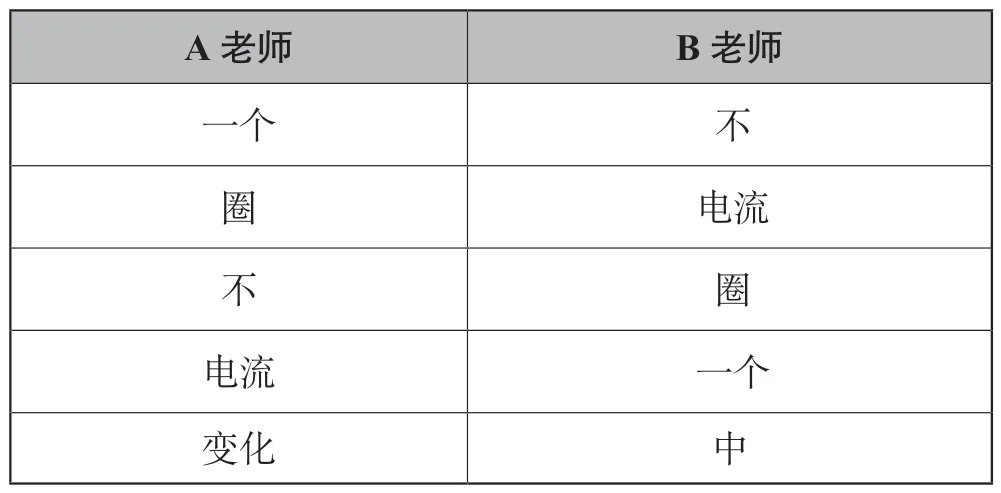

基于人工智能网络,进一步对教师语态进行分析。首先将已采集到的两位教师的言语txt 文件基于常用词标点符号进行语句分割,同时调用jieba 库分割出两者的常用词。接下来,利用Python 语言逐个统计已经得到的语句中的语态词,根据单个句子中语态词的多少判定句子的语气程度,最后输出每个txt 文件中语气程度最高的前5 句。与此同时,对照中国语态词库,输出采集到的两个txt 文件中出现频率最高的5 个语态词,得到的结果如下页表4、表5、表6 所示。

表4 A 教师语态分析的句子结果

表5 B 教师语态分析的句子结果

表6 A、B 教师前五的语态词

根据分析结果,A、B 教师的课堂作为公开课,在语态的处理上都有一定的规范性,都注重物理实验教学的引导性。仔细比较发现,B 教师的口头禅明显多于A教师,A 教师在语态处理上优于B 教师。结合具体教学内容来看,在“互感与自感”这一节中,教材深入分析了自感现象,总结了自感电动势的规律及影响因素,其目的是让学生了解互感现象是常见的电磁感应现象,为之后变压器的学习做铺垫。本小节的重难点是自感电动势方向的判断和自感现象中实际电流的特点分析。对照表4、表6 可以发现,A 教师多是围绕“电流的变化”“电流方向的变化”等,从实验现象到物理概念,循序渐进地引发学生思考,紧扣教学重难点;而对照表5、表6,B 教师的语态引导与提问大多是围绕教学实验现象展开的,相较于A 教师,其对重难点的引导较为欠缺。

(三)面部表情分析

本研究对YOLO v5 网络输出的视频文件每2s 提取出单个视频中的每帧图像,其中,A 教师共分割得到44 880张图像,B教师共得到34 659张图像。通过Labelimg 软件的标定,将分别带有Quiet(冷静)、Excited(激情)、Thinking(思考)以及Operate(操作演示)标签的图像放入YOLO v5 网络。在分析图像的过程中,本研究发现在单个图像中会存在两种不同标签的现象,所以通过代码对图像中的标签识别结果比例化,以便于对视频中的结果进行分析,得到的结果如图5 所示。

图5 A、B 教师情感百分比对比图

整体来说,A、B 教师都处于正向情绪状态。相对而言,A 教师在课堂中情绪更饱满、更有激情,在课堂中的实验操作、演示行为也更多,能够吸引学生学习物理的兴趣;而B 教师的课堂情绪相对平静,操作演示行为也较少。就教学内容来说,“互感与自感”这部分内容作为必修课基础之上的拓展,是达到促进学生个性发展目标的主要载体和手段。本小节有一定的难度,教师在教学过程中要充分利用实验教学,循序渐进,引发学生的好奇心和兴趣,不能使学生产生对物理学习的畏惧心理和认知障碍。另外,已有研究表明,教师的课堂情绪状态直接影响教师的课堂教学效果[14],积极情绪可以扩展人的瞬间思维活动,使思维更加灵活、开放,能够产生更多的问题解决策略。因此,物理教师在课堂中满怀激情,有助于课堂教学的逻辑推演和问题解决,有利于发挥教学机制的作用,也为物理教学提供了最佳情绪背景。由此可见,A 教师的教学情绪更能促进学生学习。

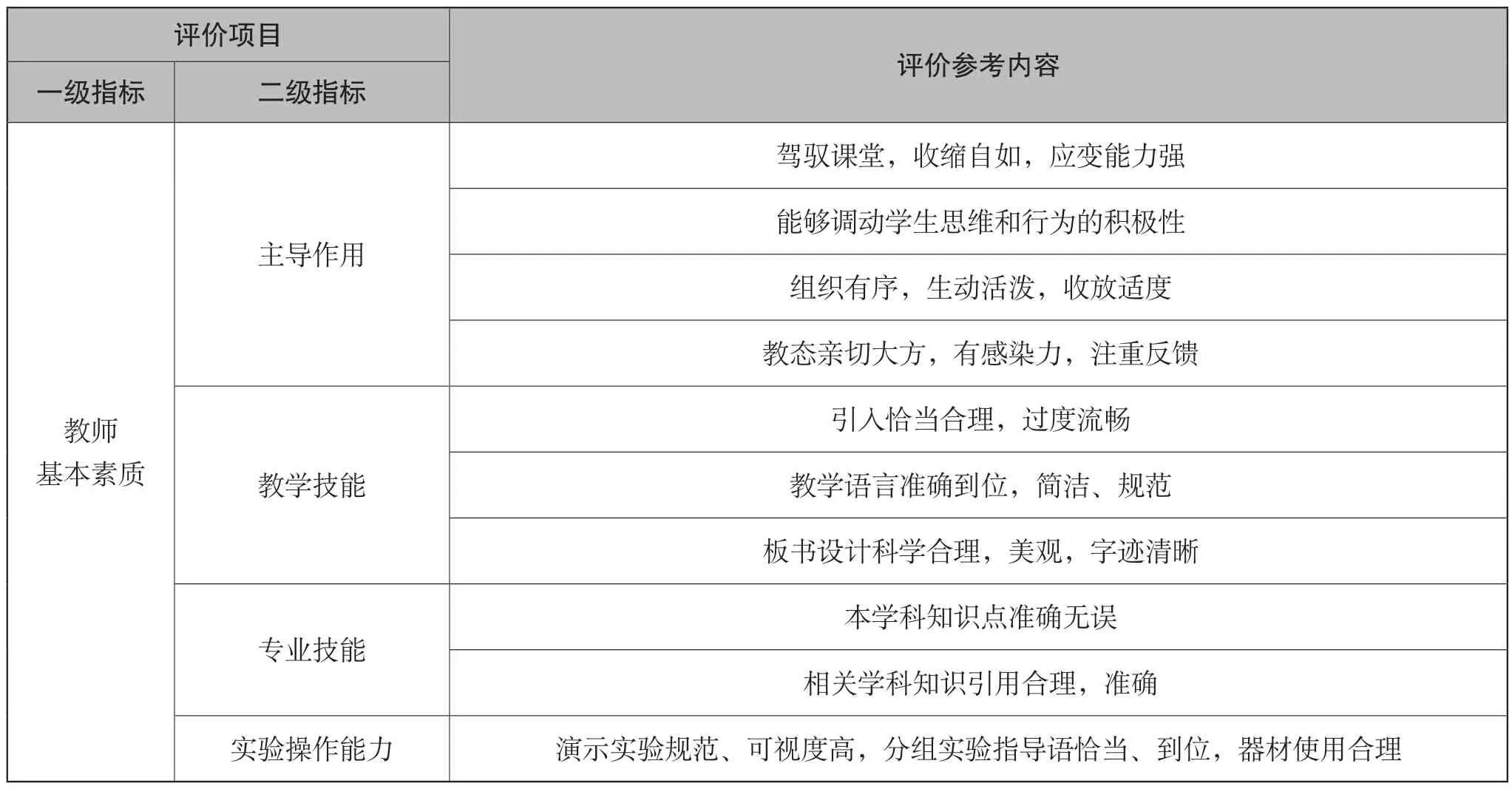

综上,本研究结合人工智能技术对课堂教学视频中两位物理教师的行为进行观测、统计与分析,基于新课程理念下中学课堂教学评价表中关于“教师基本素质”的评价内容(见下页表7)[15],得出以下结论。

表7 中学课堂教学中关于教师基本素质的评价内容

从主导作用上看,B教师课堂的话语权被教师掌握,学生行为较少,师生之间交流少,课堂情绪也较为平静,课堂气氛较沉闷;而A 教师的课堂更关注教师主导、学生主体,师生互动关系密切,教师的课堂教学情绪也更加饱满,能够引发学生学习物理的热情,学生的行为和思维更加积极,课堂学习气氛活跃。

从教学技能上看,B 教师在课堂中关注实验引入教学,但实验操作和演示较少,语言的无关表达较多;A 教师的课堂教学同样关注引导学生观察和解释实验现象,其言语更具规范性,紧扣教学重难点。本研究中人工智能技术对教师课堂教学的评价是过程性评价,通过对教师的言语、面部等行为的采集与分析,评价课堂中教师的主导作用、教学技能、课堂氛围等。但是,目前人工智能多是采用模式识别、图像识别等技术,还难以判断具体学科知识和学科教学特色。因此,基于主导作用和教学技能这两项来看,A 教师的基本素质更好,课堂教学效果更佳,更有利于促进学生的有效学习和认知发展。

四、总结与展望

目前,人工智能视域下基于证据对课堂教学进行可视化、量化分析是教育人工智能下一步推进的重点[15]。本研究通过利用人工智能技术对两位物理教师的语言、面部表情等行为数据进行采集与识别,运用人工智能算法对所采集的数据加以运算与分析,并结合新课程理念下中学课堂教学中关于教师素质的评价内容,对比分析两位教师的数据分析结果,辅助评价课堂教学中教师的主导作用、教学能力、教学技能等,帮助教师优化教学过程及改进教学方式。

关于基于人工智能技术对学科教学的研究,国内外已有不少教育工作者进行了理论探索和框架构建[16],但鲜有具体的实践分析。本研究立足于物理学科,在人工智能技术结合课堂教学分析的系统框架下,从教师教育的角度出发,以物理教师课堂教学行为为对象,进行了具体的尝试,帮助教师进行教学反思,实现以促进学生发展为目标的高质量教学。当然,本研究还存在着一定的不足,由于不同学科有着不同的知识体系,基于学科知识图谱的构建仍是一大挑战,人工智能技术与具体学科教学的融合还有待进一步深入研究。