保护数字世界的儿童:理念、工具与制度

2023-11-02张建军

【摘要】保护数量庞大的未成年人,应对相关的网络安全问题,是当下全球性的棘手难题。英国的《网络服务适龄设计实践准则》着眼建立普遍的数字内容出版制作标准,成为全球未成年人网络保护的重要制度创新。其秉持“保护数字世界中的儿童,而不是保护儿童远离数字世界”的理念;以“可能接触原则”划定准则适用范围;设立儿童利益最大化的三大原则框架;在数据保护、产品设计、关键技术等方面建立标准,以应用场景设定数据保护标准;以年龄段设立网络产品设计要求;规制助推、默认设置、推荐算法等关键技术。《网络服务适龄设计实践准则》对我国未成年人网络保护工作的理念转变、主体协调、制度构建等具有一定的借鉴意义。

【关键词】互联网内容制作准则 适龄设计 未成年人保护

【中图分类号】G239 【文献标识码】A 【文章编号】1003-6687(2023)8-105-08

【DOI】10.13786/j.cnki.cn14-1066/g2.2023.8.015

保护数量庞大的未成年人,应对相关的网络安全问题,是当下全球性的棘手难题,也是我国未成年人保护工作的重要挑战。中国互联网络信息中心(CNNIC)与共青团中央维护青少年权益部联合发布的《2021年全国未成年人互联网使用情况研究报告》显示,截至2021年12月,我国未成年网民达1.91亿人,未成年人互联网普及率为96.8%。[1]我国未成年网民群体呈现网络普及率高、数量大、低龄化等特征。保护这些未成年人的网络安全成为全社会关注的迫切问题。

近年来,我国通过制定《中华人民共和国未成年人保护法》(以下简称《未成年人保护法》)、《中华人民共和国个人信息保护法》(以下简称《个人信息保护法》)和《儿童个人信息网络保护规定》等法律法规来保护未成年人的网络安全,虽然取得了一定的成效,但依然存在不少问题。制度方面,宏观的法律法规较多,具体可操作的制度较少。宏观的保护性法律法规如何落实到具体的网络产品中,尚缺少明确、可操作的制度措施。如《未成年人保护法》第七十四条规定,网络产品和服务提供者不得向未成年人提供诱导其沉迷的产品和服务。[2]然而,在具体实践层面,企业应如何不提供导致未成年人沉迷的网络产品和服务,目前尚未见到可遵循的制度标准。保护主体方面,现有相关制度对不同年龄段的未成年人未做细分处理,但实际情况是,18岁以下的不同年龄层次的未成年人群体,相互间在网络需求和能力等方面的差异较大,整齐划一的标准缺乏针对性,有效性欠佳。虽然相关政府部门针对不同年龄段的未成年人,也嘗试开展差异化保护,但仍不深入。如国家新闻出版署在2019年11月发布的《关于防止未成年人沉迷网络游戏的通知》中提出:“网络游戏企业探索实施适龄提示制度,从多维度综合衡量,对不同年龄段用户给出相应提示,帮助未成年人、家长和老师等更好区分网络游戏,引导未成年人更好使用网络游戏。”[3]2020年12月,中国音像与数字出版协会游戏出版物工作委员会编制了游戏业《网络游戏适龄提示》团体标准,为未成年人及其监护人提供了解游戏产品是否适用的提示信息。适龄游戏提示主要在使用环节提供辅助提示信息,但在更为重要的网络内容生产制作环节,尚未见到有效举措。保护未成年人的网络安全,在源头上的网络产品与服务的制作出版阶段,就应建立具体、有针对性的可操作标准。

英国在2020年9月公布了《网络服务适龄设计实践准则》(Age Appropriate Design: a Code of Practice for Online Services,以下简称《准则》),针对所有儿童可能接触的网络服务产品,制定了分年龄段的设计制作指引,为企业提供了较为明确和可操作的规范标准。[4]《准则》给企业留有一年的调整期,2021年9月开始正式实施。英国信息专员办公室(ICO)在制定《准则》的过程中,参考了家长、儿童、学校、儿童运动团体、软件开发商、科技和游戏公司等各方意见,制定了15条具体的网络产品设计标准。

《准则》是全球未成年人网络保护制度的重要创新,对各国未成年人网络保护政策和各大互联网公司产生了显著影响。2022年9月,美国加州参考该《准则》,通过了《加州网络适龄设计规范法案》。受该《准则》影响,谷歌对未成年用户停止个性化广告推荐,关闭地理定位历史记录,自动开启安全搜索模式;TikTok将16岁以下账号默认设置为个人可见;Instagram不再允许成年用户直接私信18岁以下用户;YouTube移除自动播放功能,防止儿童沉迷于观看视频。

一、《准则》的理念

1. 保护数字世界中的儿童,而不是保护儿童远离数字世界

“保护数字世界的儿童,而不是保护儿童远离数字世界”,在《准则》的前言中,英国信息保护专员首先声明了《准则》设立的初衷。在当下信息化时代,为保护儿童免受可能的威胁而让他们远离互联网,显然不现实,也剥夺了儿童应有的使用数字信息技术学习、成长的权利。《准则》不是禁止未成年人使用网络信息服务产品,而是在网络内容生产领域制定措施,构建有益于未成年人成长的数字世界,保护数字世界中的儿童,很好地兼顾安全与发展两方面的需求。

《准则》的理念源于联合国《儿童权利公约》提倡的“儿童在生活的各方面需要特殊的保障”。在网络世界,儿童需要特殊保护。《准则》要求企业在网络产品设计中充分考虑可能的未成年人使用情景,首先确保产品和服务不会对未成年人产生不良影响,其次应对他们的健康成长有益。《准则》要求企业识别和评估产品和服务对儿童的可能风险、潜在影响,以及在数据处理中可能造成的任何伤害或损害——无论是身体、情感、发展还是物质的损害,包括身体伤害、网上诱导或其他性剥削;社交焦虑、自尊问题、欺凌或同伴压力;接触有害或不适当的内容;误导或不适当的限制信息;鼓励过度冒险或不健康的行为;破坏父母的权威或责任;丧失自主权或权力(包括对数据的控制);强迫性使用或注意力缺失症;过多的观看屏幕的时间;中断或不充分的睡眠模式;经济剥削或不公平的商业压力;任何其他重大的经济、社会或发展方面的不利因素等。《准则》对数字世界的未成年人可能遇到的安全威胁进行了具体详细的陈述。

2. 以儿童利益最大化为原则,设立儿童利益框架

构建有益于未成年人成长的数字世界,不单是保护未成年人不受伤害。《准则》明确要求企业在具体技术设计和产品开发中,以儿童利益最大化为首要考虑因素。《准则》将儿童利益最大化原则具体化为“儿童守则:最佳利益框架”,要求企业在提供网络信息服務和处理数据的过程中,基于儿童不断发展的能力,重点保护儿童三个方面的权利:儿童身心健康与发展的“自我”权利、获得资源的“支持”权利、“社会”权利。为保障这些权利的有效实施,《准则》设置了相应的保障条款。

“自我”权利是儿童身心健康和发展的权利,支持儿童不断发展能力,以利于其形成和表达身份、界限和自我意识。要确保儿童能够在对自己有影响的事务中表达观点,企业要为儿童实现这些权利提供适龄的在线辅助工具,在与儿童的互动中要采用符合其年龄特点、便于理解的信息形式等。

“支持”权利是儿童获得支持自身发展和成长资源的权利。产品设计要确保儿童获得父母以及社会的支持。《准则》对不同年龄阶段的儿童采取灵活的监护人同意要求,建立了以13岁为数据保护年龄界限的父母同意机制。在个人数据获取以及使用过程中,13岁以上的未成年人拥有一定的网络行为决定权,13岁以下的儿童则需要监护人授权。

“社会”权利是儿童群体的权利,包括那些脆弱的和有特殊需求的儿童。网络产品应承认儿童在社会共享的资源和制度中也拥有利害关系。

二、《准则》的内容

1. 以“可能接触原则”划定准则适用范围

通常,未成年人网络保护法律法规只针对面向未成年人的产品而制定。如美国的《儿童在线隐私保护法》(Children's Online Privacy Protection Act,COPPA),即针对面向儿童的在线服务而出台,不包括Facebook等大众化社交媒体。此类法律法规默认13岁以下的儿童不是大众化社交平台的主要受众,而企业对儿童正在使用这些产品也不知情。此法出台于1998年,当时上网的儿童还是比较少的,但当今互联网广泛普及,未成年人用户占全球互联网用户总数的近三分之一,互联网在社会中得到普遍应用,未成年人接触到各类面向成年人的网络产品和服务的概率增加。如只针对面向儿童的产品设定保护制度,保护的有效性将大为降低。

英国要求所有儿童可能接触到的信息产品和服务提供者都遵守《准则》,不仅限于专门针对儿童的信息产品和服务提供者。按照“可能接触原则”,信息产品和服务既包括应用程序和设备、搜索引擎、社交媒体平台、流媒体、在线游戏等通过互联网向用户提供的产品或服务,也包括联网玩具和其他设备。

“可能接触原则”以网络产品的应用场景设定规制范围,而不是以产品宣称的目标服务对象划定界线,解决了当前儿童触网途径多样的难题,既将当前众多的网络信息产品以及联网玩具、智能音箱等新型的数字产品涵盖其中,又适用于未来可能出现的新技术、新产品、新应用,具有较为普遍的适用性和良好的前瞻性。

2. 最小化使用数据,防止信息滥用与泄漏

未成年人在虚拟世界受到的安全威胁大部分与隐私相关,因此,有效保护未成年人相关的隐私数据至关重要。《准则》特别要求企业最小化使用未成年人相关数据,从原则、技术、存储三方面提出了具体要求。一是在原则方面,要求企业仅收集必需的、最低量的个人数据,这些数据应仅限于与保障服务有关的必要内容,且应在儿童或监护人知情的情况下进行收集。2023年4月4日,英国信息专员办公室宣布对TikTok公司罚款1 270万英镑,原因是该公司在未经监护人同意的情况下处理了近100万英国13岁以下儿童的数据。[5]二是在用户界面设计方面,要求产品默认采取高隐私设置,减少数据收集的行为。由于未成年人在使用相关产品时,很少改变默认设置,所以企业应将产品的默认设置定为高隐私标准,以减少数据收集与使用,从而保护未成年人的信息安全。且在用户改变默认设置时,企业要给出适龄、明显的提示信息,提醒未成年人应在与家长或其他成年人交流后再对设置进行改变。此外,对一些重要的隐私信息,《准则》特别作出强制性保护要求,如考虑到地理位置信息的泄漏可能直接威胁未成年人现实生活的安全,因此地理位置数据应默认关闭,除非企业提供了令人信服的合理理由。三是数据存储时间应尽可能短,只在必需的最短时间内存储数据。这一要求可减少因数据意外泄漏导致未成年人隐私泄漏的风险。《准则》还要求不得共享未成年人相关数据,除非有足够信服的合法理由。这种最小化使用数据的原则可以最大限度防范未成年人数据滥用与泄漏。

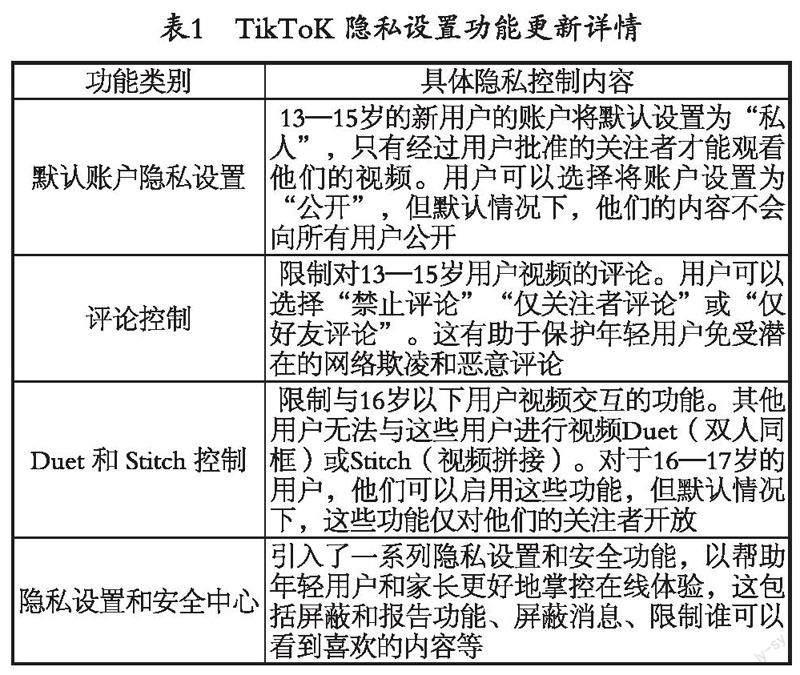

为符合英国的《准则》,全球众多互联网公司纷纷更新自己的产品和服务。如TikTok就在2021年2月,对16岁以下用户的默认隐私设置功能进行了更新(见表1),以符合《准则》要求。[6]

个人数据的保护需要兼顾用户使用相关网络产品和服务的体验,确保隐私保护与数据处理效率的平衡,《准则》因此确立了区分核心处理场景与非核心处理场景的差别授权模式。核心处理场景指处理的数据是提供网络核心服务不可或缺的,服务提供者已经与儿童订立服务合同且该儿童具有缔结合同的法律能力,出于维护儿童合法利益或执行公共任务的目的对儿童个人数据进行处理,无须征得监护人同意。①主要包括用户账户创建和管理、用户提交内容的处理和存储、为实现应用程序功能而进行的数据分析。[7]在核心处理场景中,企业无须每次在处理个人数据的行为时,寻求未成年人和监护人的授权,这就提高了相关信息的处理效率,确保了产品具有较好的用户体验。非核心处理场景指提供核心服务以外的其他业务(如开展营销、改进服务、使用cookies或类似技术、与第三方共享、特殊类别数据处理等),须征得13周岁以下儿童的监护人或13周岁以上未成年人本人的同意。

区分核心与非核心场景的数据处理原则,根据数据用途和未成年人的判断能力,赋予企业不同的处理权限和程序,这样既确保了对未成年人个人信息提供必要的保护,又保证了对必需、合法数据进行处理的效率,减少了部分不必要的监护人同意流程,避免监护人出现“同意疲劳”的情况,实现了未成年人网络保护的效率和效力的平衡。

3. 明确网络产品适龄设计要求

国际上将未成年人具备处理自身数据权力的年龄,称为数据同意年龄。英国和美国将13岁定为数据同意年龄,欧洲其他国家为16岁。我国《儿童个人信息网络保护规定》将数据同意年龄设定为14岁。不同年龄的未成年人在网络需求、判断能力和应对安全风险能力等方面存在差异,如6岁、9岁、14岁,三个年龄阶段的儿童网络需求和自我保护能力是完全不同的,通过单一年龄界限以二元化的方式对未成年人进行划分,会出现保护不足与保护过度并存的问题,影响保护制度的执行效力。

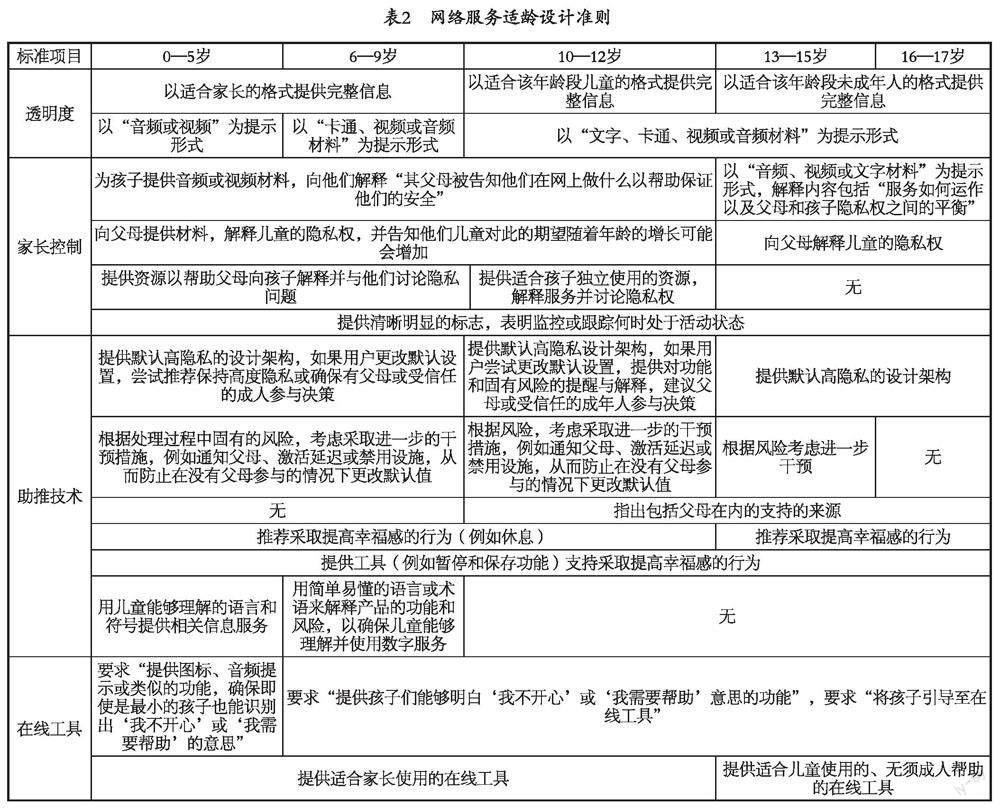

《准则》打破了以单一年龄界限二元式划分未成年人的网络保护模式,而是根据未成年人对规则的认知理解能力、社会关系参与程度、面临的数据风险情况、网络产品用途等指标,将18岁以下的未成年人分为五个年龄阶段:0—5岁为学龄前期、6—9岁为学龄初期、10—12岁为过渡期、13—15岁为青少年初期、16—17岁为即将成年期。《准则》围绕透明度、家长控制、助推技术、在线工具四方面,针对各年龄段未成年人用户设立了相应的网络产品设计指引(见下页表2)。指引不仅列出禁止企业做什么,还明确网络产品设计应该做什么,引导企业开发适合未成年人年龄阶段的产品和服务。对企业而言,《准则》具有非常强的可操作性,在开发和提供产品与服务的过程中能够有据可依。尤其是对一些中小企业而言,相较于禁止性指令,《准则》的要求更为明确和具有可操作性。

4. 为助推、算法推荐等关键技术画红线

手机应用程序等具有强大吸引力的原因,一定程度上是其在技术层面的某些设置容易致人沉迷上瘾,未成年人更是难以抵挡其诱惑。因此,需在产品开发设计阶段对这些关键技术设定应用边界,以有效保护未成年人。《准则》对助推和算法推荐等技术画定了应用红线。

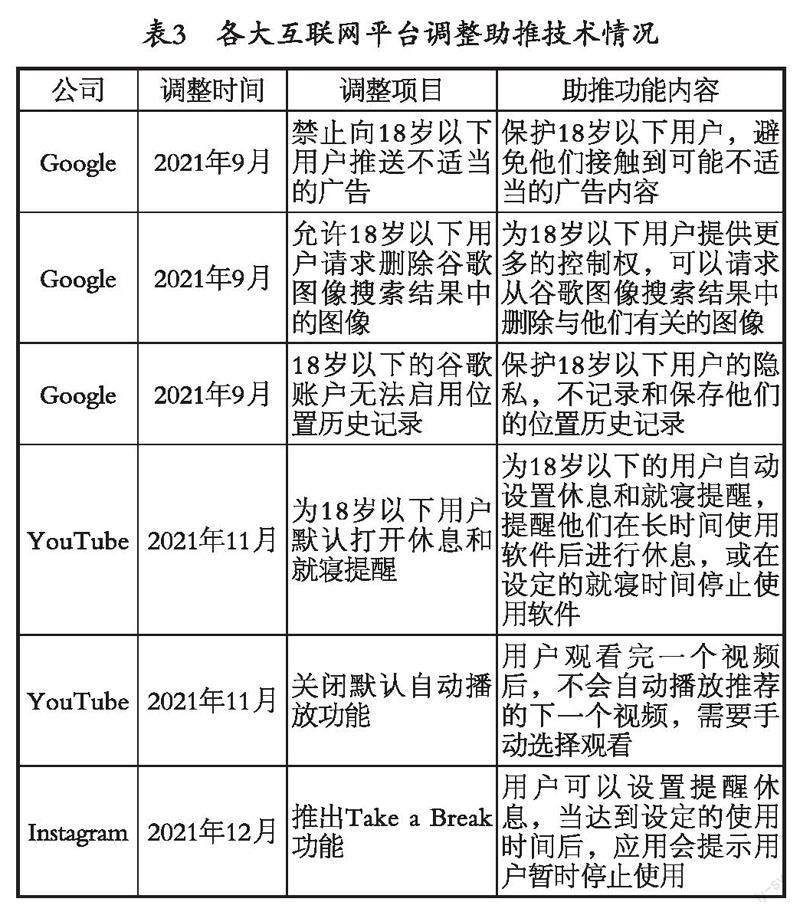

一方面,限制助推技术,保护儿童隐私。《准则》要求企业“不要使用助推技术来引导或鼓励儿童提供不必要的个人数据,以及削弱或关闭他们的隐私保护功能”。助推技术是指产品或服务的提供者刻意引导或鼓励用户在决策时遵循设计者设置的默认选项。如当一些设计者希望获得用户授权时,会把同意授权的选项做得更为显眼。《准则》认为,在线上服务设计中使用助推技术,可能导致用户被鼓励允许平台获取比他们自愿提供的更多的个人数据,损害儿童的利益。2018年,儿童保护组织5Rights曾发表报告,揭示商家会使用行为科学和心理学理论来操纵儿童放弃更多个人数据,包括延长他们的上网时间等,以获取更多商业利益。[8]《准则》限制助推技术潜在的不良应用场景,众多互联网公司都响应《准则》要求,对自己的产品进行了调整(见下页表3)。

《准则》鼓励善用助推技术以促进儿童健康成长和保护儿童隐私。如儿童应用POPJAM就使用助推技术来激励儿童进行创意表达和负责任的在线行为。当用户与其他用户进行积极互动时,平台会奖励其虚拟贴纸(见下页图1)和其他应用内物品。这种助推有助于营造一个支持性和适龄的儿童网络空间。[9]

另一方面,为算法推荐画红线,从技术底层防沉迷。当下,算法技术得到广泛应用,自动推荐已成为众多网络应用的标配。《准则》对这类技术画定了红线:企业对使用未成年用户个人数据进行内容推荐等信息处理行为负责,且应将使用用户数据进行特征分析的选项默认设置为“关闭”,只有用户主动设置为“开启”后,方可运行相关程序。上述对助推和算法推荐等关键技术的规制,可以从技术底层着手,减少使未成年人沉迷的信息产品的出现。

5. 为未成年人提供在线辅助工具

实现未成年人权利框架中的自我权利,支持未成年人在对自己有影响的事务中表达观点,企业需提供具体的技术支持。《准则》要求企业为未成年人提供在线辅助工具,帮助其简单轻松地行使自身权利。企业要建立儿童紧急投诉、请求机制,允许未成年人陈述紧急情况,并根据相应情况迅速采取行动。在使用用户的个人数据时,企业要适时通知并“一口气解释”,让未成年人及时与监护人进行交流。在未成年人试图改变隐私设置时,提供适合其年龄的解释和提示,以预防这种改变可能引发的风险。未成年人的注意力、理解力的特殊性,要求企业在沟通过程中,以与未成年人年龄相符的友好方式传达信息,通过图标、漫画、图形、视頻和音频等形式,以游戏化和交互方式,吸引未成年人的注意,激发未成年人的兴趣,而不是仅仅提供文字信息,以确保信息的有效传递。

6. 为家长提供在线控制工具

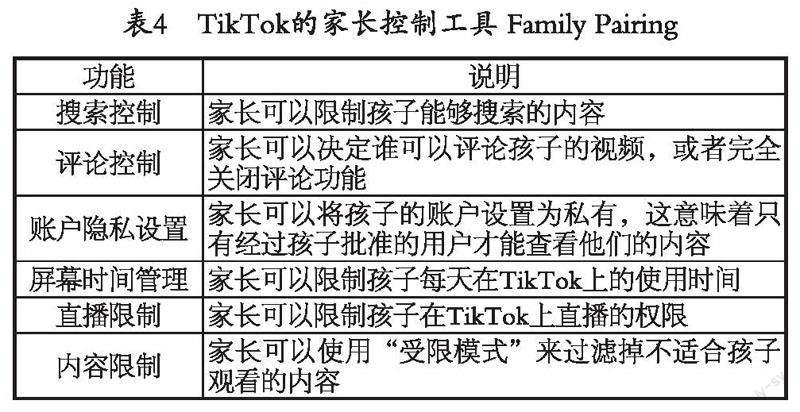

家长作为保护未成年人网络安全的重要主体,在网络空间履行监护义务时,面临一定的技术障碍。《准则》要求企业为父母或监护人提供在线活动控制工具。同时,对家长在线控制工具提供的功能做了较为详细的要求,主要包括:设置儿童使用时长、就寝时间、网站访问白名单、限制应用内购买、监控儿童在线活动、跟踪地理位置等功能。这些工具为家长保护未成年人的网络安全提供了较好的技术支持。《准则》公布后,众多企业都按照要求提供了相关的家长控制工具。2021年5月,TikTok推出了家长控制工具Family Pairing,帮助家长限制孩子接触到的内容,并确保其在线行为的安全(见表4)。[10]近年来,媒体报道众多未成年人在直播中巨额打赏、在氪金游戏中购买昂贵的装备等事件,如果相关应用程序提供了应用内购买限制功能,将极大减少此类事件的发生。此外,《准则》还要求企业提供家长工具时,需提示该选项适合的未成年人年龄信息,以便家长更好地履行监护义务赋能。《准则》还要求在运行家长控制工具时给未成年人显著提醒信息,以维护其必要的知情权。

企业提供功能强大的家长工具,一定程度上解决了家长在保护未成年人网络安全中能力不足的问题,有利于更好地发挥家庭在保护未成年人网络安全中的作用。

7. 为企业提供风险评估工具

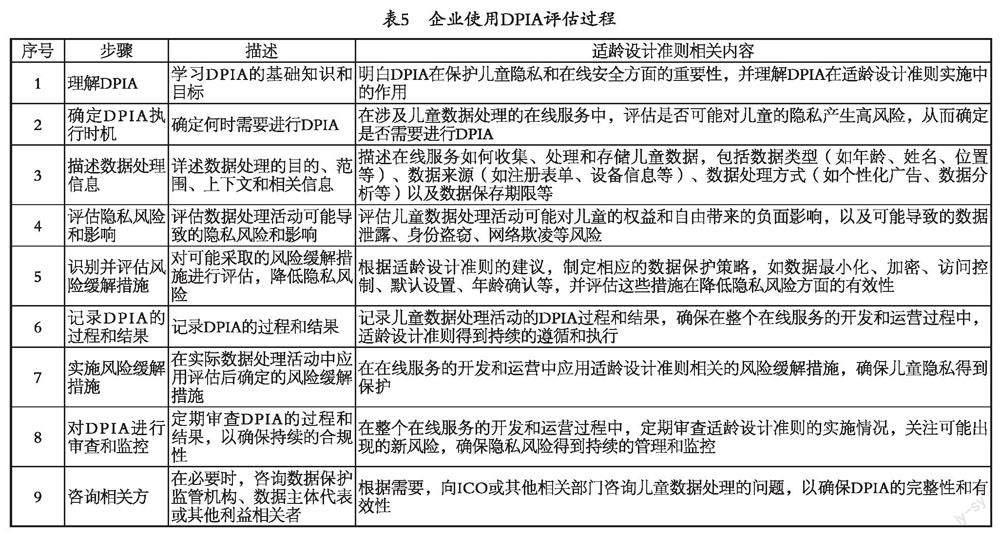

《准则》第2条要求,对企业处理未成年人数据可能给其权利带来的影响,应使用数据保护影响评估模板(Data Protection Impact Assessment,DPIA)等工具进行系统性分析,及时、准确了解自身履行相关责任情况。

数据保护影响评估模板是英国数据保护机构制定的一项个人数据保护制度,旨在帮助企业识别和降低风险。DPIA可以帮助企业遵循《准则》要求的数据最小化原则、访问控制工具、默认设置等要求(见下页表5),以保护儿童的隐私权和在线安全,降低企业无意违规的风险,避免可能的法律纠纷和罚款,还可提高用户对企业的信任度,增强品牌声誉和客户忠诚度。

8. 设置阶梯式执行工具箱

制度执行方面,《准则》设置了从轻到重的阶梯式执行工具箱,包括评估通知、警告、申斥、执行通知和处罚通知(行政罚款)。《准则》虽不具有法律约束力,却是整个英国数据保护制度的重要构件,英国《数据保护法》指出,信息服务需要遵循标准,以便“确保它们遵守数据保护法规定的保护儿童在线数据的义务”。对于严重违反数据保护原则的行为,可罚款2 000万欧元或企业每年全球营业额的4%,以较高者为准。这一套从提醒注意到高额经济处罚的执行工具,具有一定的可操作性和合理的处罚力度,为《准则》的有效实施提供了很好的保证。

三、《准则》的启示

当前,我国未成年人网络保护工作面临的主要问题有:一是理念方面,仍然延续数字化社会之前的保护远离的理念,未能针对互联网设备广泛普及的新情况更新保护理念;二是制度方面,宏观法律法规等制度较多,具体可实践可操作的标准鲜见,对网络产品的关键技术和功能的规制不足;三是相关保护制度对主客体差异性考虑不足,针对不同年龄阶段未成年网民需求和能力差异的考虑较少,对不同类型网络产品对未成年人的安全威胁程度的区分不够;四是对多元主体参与未成年人网络保护的具体支持不够,未成年人网络保护需要企业、家庭、社会等的多方参与,目前我国各主体参与度不够,特别是在技术支持方面还不是很充分。

1. 转变保护理念,从“保护儿童远离数字世界”到“保护数字世界的儿童”

我国未成年人网络保护工作主要依靠青少年保护模式等技术工具,这类工具限制使用时间、时长等,以减少未成年人与互联网的接触,这类基于远离理念的限制使用行为的措施,对防止未成年人沉迷于数字产品有一定的效果。不过,随着数字技术的发展,在当前的情况下,无论是在学习、娱乐还是生活中,让未成年人远离数字世界显然已不现实。

《准则》基于儿童利益最大化原则,依循“保护数字世界的儿童,而不是保护儿童远离数字世界”的理念,建立网络产品设计指引,推动建立有益于未成年人成长的数字生活环境。这一做法超越仅仅为目标提供保护的理念,兼顾未成年人的保护与赋权发展,着眼建立对儿童友好的数字世界,适应新的社会发展状况和儿童成长需求。

此外,在当下互联网产品众多的情况下,如何设立儿童网络安全保护边界是个难题,《准则》以未成年人“可能接触”原则,划定需遵循未成年人保护制度的网络产品范围,具有较好覆盖性和前瞻性。

2. 抓住未成年人网络保护的关键主体和核心环节,建立技术规范指引

虽然我国颁布了不少保护未成年人网络安全的法律法规,但大多为宏观的理念性、原则性表述,缺少对关键主体——互联网企业和核心环节网络产品的具体制度要求。企业为未成年人提供了具体的网络服务产品,进而构建了未成年人的网络生活环境,因此对企业和网络产品的规制至关重要。对企业开发设计网络产品应建立明确具体的约束制度,从而提高保护的效率和效力。

《准则》将法律法规的原则性条文转化为具体可操作的明确规则,为网络产品制定了具体的设计标准,给企业提供了可操作的遵循指南,让未成年人网络保护工作具有可操作性和可控制性。我国有必要依据《未成年人保护法》《个人信息保护法》《儿童个人信息网络保护规定》等法律法规,制定更为具体、可操作的网络产品制作出版标准,深化未成年人网络保护法律法规的实践指引。

《准则》围绕未成年人网络保护的关键主体和核心环节,针对互联网企业和网络产品设立有益于未成年人健康成长的设计标准。尽管网络产品千差万别,但抓住默认设置、数据使用、信息样式等核心功能和算法推荐、助推技术等关键技术制定相关规则,确实可以起到四两拨千斤的作用。这种对网络产品核心功能和关键细节立规定约的方式,是一种基于源头和底层进行治理的理念和方法,将极大提升未成年人网络保护的效果,值得我们参考和借鉴。

3. 制定针对性保护措施,提高制度效能

不同年龄阶段的未成年人在网络需求、应对安全风险和判断能力等方面均存在较大差異,简单划定一个年龄标准显然无法满足各年龄阶段未成年人的保护与发展需求。《准则》根据对规则的认知理解、社会关系的参与、面临的数据风险、数字应用的用途等指标,将18岁以下未成年人细分为五个年龄段,确立不同的设计标准,让保护制度的针对性极大提升。2022年9月,美国加利福尼亚州颁布的《加州适龄设计规范法案》(The California Age-Appropriate Design Code Act,AB 2273),也完全借鉴了英国《准则》的年龄划分标准,这种对未成年人进行分年龄段保护的做法正在被各国采纳。

当前,我国网络保护中的监护人同意模式有不少问题,众多功能应用频繁需要监护人同意,且相关内容冗长晦涩,不少监护人实际上没有阅读内容即勾选“同意”选项,“同意疲劳”现象较为普遍。此外,不少家长缺乏足够的时间与精力来监督孩子的上网时间和上网活动,对游戏等新奇的网络应用不熟悉、不了解,部分监护人自身不具备网络使用技能,家长监督的效果不佳。英国网络适龄设计制度区分应用的核心场景和非核心场景,根据同意内容的必要性实施同意确认程序,省去了监护人与儿童的部分不必要确认程序,既保证了重要、必要信息的高效处理,也提高了保护的效率和效力,这一做法值得我们参考。

4. 提供技术工具,赋权赋能多元主体有效参与

未成年人网络安全保护需企业、家庭、社会各方的共同参与,在实践中企业缺乏有效可靠的具体执行标准及自我核查工具,一些家长及未成年人在履行保护能力和条件方面存在一定的困难。《准则》为企业提供了产品设计的标准以及自我评估工具,让保护责任的落实更加明确和可操作。《准则》要求企业分别为家长及未成年人提供有效的网络保护工具,这种技术赋能极大提升了家长和未成年人自我保护的能力。这些赋能赋权举措,提高了相关主体参与保护的能力,有利于形成多元主体共同参与未成年人网络安全保护的良好格局。

参考文献:

[1] 共青团中央维护青少年权益部,中国互联网络信息中心. 2021年全国未成年人互联网使用情况研究报告[EB/OL].[2022-11-30].https://news.youth.cn/gn/202211/t20221130_14165457.htm.

[2] 中华人民共和国未成年人保护法[EB/OL].[2020-10-17].http://www.npc.gov.cn/npc/c30834/202010/82a8f1b84350432cac03b1e382ee1744.shtml.

[3] 国家新闻出版署. 国家新闻出版署关于防止未成年人沉迷网络游戏的通知[EB/OL].[2019-11-19].https://www.nppa.gov.cn/nppa/contents/312/74539.shtml.https://www.nppa.gov.cn/nppa/contents/312/74539.shtml.

[4] ICO. Background to the children's code[EB/OL].[2022-02-07]. https://ico.org.uk/about-the-ico/what-we-do/background-to-the-children-s-code/.

[5] McCallum S, Gerken T, Kleinman Z. TikTok fined £12.7m for misusing children's data[EB/OL].[2023-04-04].https://www.bbc.com/news/uk-65175902.

[6] TikTok. 隐私政策调整说明[EB/OL].[2021-01-31].https://newsroom.tiktok.com/en-us/strengthening-privacy-and-safety-for-youth.

[7] Shilton K. Data Leverage: A Framework for Empowering the Public in its Relationship with Technology Companies[J]. Journal of Information Policy, 2018(8):46-71.

[8] Baroness Beeban Kidron. Digital Childhood - Addressing Childhood Development Milestones in the Digital Environment[EB/OL].[2017-12-31]. https://5rightsfoundation.com/static/Digital_Childhood_report_-_EMBARGOED.pdf.

[9] PopJam[EB/OL].[2023-06-30].https://www.popjam.com/.

[10] TikTok. Introducing Family Pairing[EB/OL].[2023-06-30].https://newsroom.tiktok.com/en-us/introducing-family-pairing.

Protecting Children in the Digital World: Concepts, Tools and Systems

——UK Age Appropriate Design Code and Its Implications

ZHANG JIAN-jun(Journalism and Communication College, Tianjin Normal University, Tianjin 300387, China)

Abstract: Protecting the online safety of a vast number of minors is a pressing global issue. The UK's Age Appropriate Design Code aims to establish universal standards for digital content creation and has become a crucial institutional innovation for safeguarding minors online worldwide. The code adheres to the principle of "protecting children within the digital world, rather than shielding them from it", delineates the scope of application based on the "likelihood of access" principle, and sets up a three-principle framework to maximize children's interests. It establishes standards for data protection, product design, and essential technologies in various aspects, including setting data protection standards according to application scenarios, formulating online product design requirements based on age groups, and regulating critical technologies such as boosting, default settings, and recommendation algorithms. This code offers valuable insights for the conceptual shift, coordination of relevant stakeholders, and development of institutional frameworks in China's efforts to protect minors online.

Keywords: internet content production standards; age-appropriate design; protection of minors

基金項目:国家社会科学基金一般项目“我国互联网多元主体合作治理模式研究”(19BXW119)

作者信息:张建军(1979— ),男,内蒙古鄂尔多斯人,天津师范大学新闻传播学院副教授,主要研究方向:新媒体传播、互联网治理。