基于自适应截断模拟曝光和无监督融合的低照度真彩色图像增强算法

2023-10-08韩永成张闻文何伟基陈钱

韩永成,张闻文,何伟基,陈钱

(南京理工大学 电子工程与光电技术学院, 南京 210094)

0 引言

在弱光环境下获取的图像往往会出现一定程度的退化,采集到的图像会丢失大量信息,不利于后期分割、识别等高级图像任务,图像观赏性也大打折扣。尤其在夜间环境和背光场景,甚至在不均匀光照等恶劣环境下,采集的低照度图像与理想图像相去甚远。低照度图像增强是图像处理领域的研究热点,国内外研究人员提出了很多方法,常用的增强算法可以分为基于直方图均的增强、基于Retinex 理论的增强、基于图像融合的增强和基于深度学习的增强。其中基于图像融合的增强算法是在多幅图像中提取高信息熵的区域,然后进行互补融合,将具有特征优势的信息保留在最终增强结果中以此获得内容丰富、色彩饱满的增强结果。本文主要研究内容为基于曝光融合的低照度彩色图像增强算法,目的是提升待增强图像的亮度和对比度,恢复图像细节的同时保留色彩信息,使得增强结果具有自然感。

FU Xueyang 等[1]提出了一种基于融合的弱光照图像增强方法。该算法需要人为选择现有的增强手段作为中间步骤,鲁棒性不高。YING Zhenqiang 等[2]提出了用于微光图像增强的仿生多曝光融合框架。该方法需要先验的相机响应模型,只对缺失欠曝光的地方进行补光增强。LI Zhengguo 等[3]提出了细节增强的多尺度曝光融合,利用加权引导图像滤波器对所有低动态范围图像的加权映射高斯金字塔进行平滑处理,实现不同曝光程度的低动态范围图像的融合。WANG Wencheng 等[4]提出了一种基于非线性泛函变换的低照度图像校正方法,根据光照分量的分布特征自适应调整图像增强函数参数,生成中间状态增强图像,利用多尺度融合策略测提取图像特征信息,融合后得到高质量增强结果。REN Yurui 等[5]设计了类似仿生多曝光融合算法的基于相机响应性的模拟曝光融合方案,同样取得不错效果。XU Yadong 等[6]也提出了一种用于单幅低照度图像增强的多尺度融合算法。该方法直接进行亮度重映射,模拟曝光图像不自然且存在颜色失真问题。这些方法在某些程度上可以增强低照度图像,但是很容易出现亮部区域过度增强的问题,增强结果容易色彩失真,出现不自然的观感。本文提出的自适应模拟曝光方法和基于深度学习的融合方案可以有效避免过度增强现象,增强结果色彩更加真实自然。

1 理论

算法具备亮度抑制功能,首先设计了自适应截断模拟曝光方法,然后使用无监督网络模型融合曝光序列,实现灵活高效地融合固定尺寸的多张曝光图像。我们希望模拟多曝光序列中的图像各自包含不同的良好感知区域,通过融合多张图像便可以获得全局性的良好曝光图像。

1.1 自适应截断模拟曝光

经典的模拟曝光算法大都是直接对图像进行线性映射,或者使用直方图均衡化等现有的增强算法进行模拟。往往是人为确定模拟曝光次数,去追求尽可能多地涵盖不同亮度等级的曝光序列,这就导致模拟曝光序列中存在大量冗余图像,例如存在多个过亮区域。由于正常光照区域或亮部区域的图像经过增强后容易呈现过亮现象,这些区域极易影响融合质量,导致观感不佳。本算法首先将图像转到HSV 空间,对V 通道进行处理,这样可以节省计算量,同时不会丢失色彩信息。然后对图像进行高斯滤波减少噪声的影响,使用Otsu 阈值法[7]即可获得亮暗区域的子图像块Isubk。为了避免人工选择模拟多曝光图像,设计了亮度响应曲线G(x)来获得子图像块Isubk的平均亮度响应f(k),其计算方式如式(1)和(2)所示。

在获得亮部区域和暗部区域及其平均亮度响应后,进行自适应处理。相较于亮部区域,对暗部区域应该进行更大程度的增强;相较于暗部区域,对亮部区域进行增强的同时应该有所抑制,避免其产生过度增强现象。本文结合图像子块及其亮度响应得到增强序列Ienk,如式(3)所示。

式中,l表示输入图像Iinput中每个像素的强度值,lmax表示最大像素强度值,γk为局部自适应伽马因子。为了在融合质量和速度之间取得平衡,对低照度图像进行4 次模拟曝光,分别是针对暗部和亮部区域的一般性增强和亮度补偿性增强。针对亮暗区域子块的一般性伽马因子如式(4)所示。

式中,pdf(⋅)为像素概率密度函数,pdfw(⋅)为加权概率密度函数,表示为

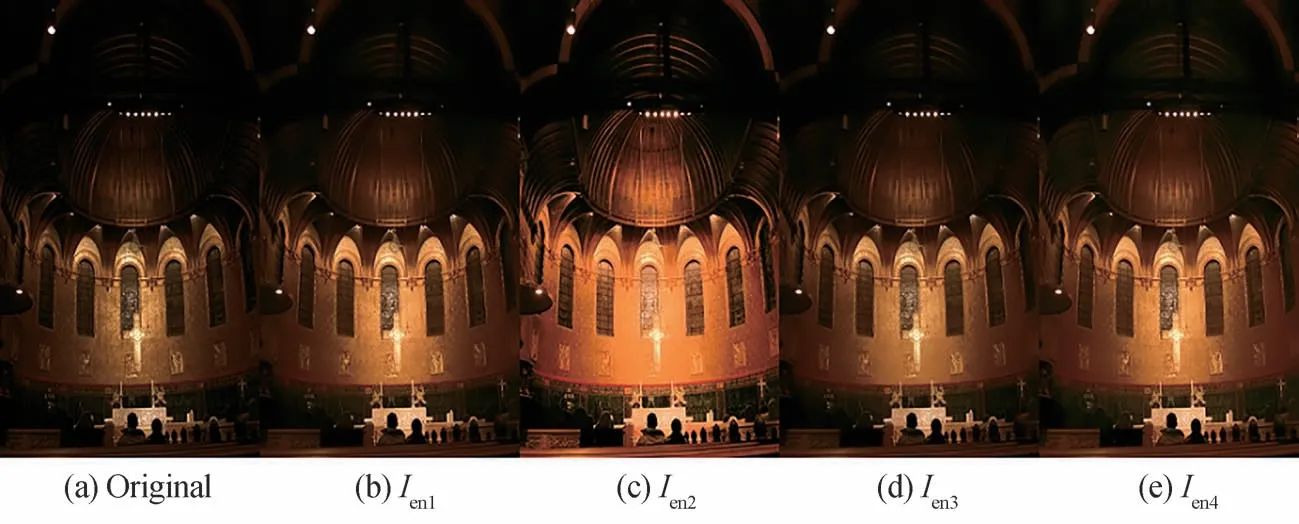

式中,fk与子图像块Isubk的平均亮度响应有关,max(·)表示取二者中的较大者。较大的指数因子意味着更大的加权概率密度函数pdfw(⋅),进而导致局部自适应伽马因子γk更小,使得增强效果更加明显。γ1,2如图1(a)所示,其对应的色调映射曲线如图1(b)所示,模拟曝光结果如图2(b)和(c)所示。

图1 带有截断因子的自适应伽马校正曲线Fig. 1 Adaptive gamma correction curve with truncation factor

图2 增强序列示意图Fig. 2 Schematic diagram of enhancement sequence

为了避免过度增强,引入截断因子,继续生成两种模拟曝光图像,如图2(d)、2(e)所示。其对应的局部自适应伽马因子γ3,4如式(6)所示。

式中,f(Isub1)表示原始低照度图像亮部子块Isub1的平均亮度响应,f(Isub2)表示暗部子块Isub2的平均亮度响应。例如,图1(a)中γ3曲线右侧像素强度值较大的亮部区域呈现相对原曲线较大的伽马值,即亮部子块的平均亮度响应f(Isub1),这意味着对亮部区域像素进行强度抑制,如图1(b)中γ3'曲线所示。这些亮部区域像素的色调映射变化不大,只进行了小幅度的增强,该方法有效保留的亮部区域的图像信息,如图像2(d)所示。同理,图1(a)中γ4曲线左侧像素强度值较小的暗部区域呈现相对原曲线较小的伽马值,即亮部子块平均亮度响应f(Isub1)的负相关1-f(Isub1),一定程度上提高了对暗部区域像素增强的程度,如图1(b)中γ4'曲线所示。这些暗部区域像素的色调映射变化比γ1'的映射幅度更大,该方法进一步增强了暗部区域的亮度水平,如图像2(e)所示。值得注意的是,γ4对应曲线暗部区域的数值略大于γ3对应曲线亮部区域的数值,这是式(6)所导致的。若令γ4取值为数值更小的暗部子块亮度响应f(Isub2),会对原始低照度图像产生严重的过度增强,这种模拟的过度曝光会不可避免地引入大量噪声,与实际情况不符合,不利于最终的融合,因此采取亮部子块亮度响应的负相关1-f(Isub2)来代替。实际上,本方案可以选择生成更多的模拟曝光序列,只需要更改不同的局部自适应伽马因子,或者增加图像子块区域,同第三章中结构提取和分割类似。但是综合考虑融合质量和速度,只模拟生成两次亮度补偿性曝光图像。

上述步骤自适应生成了不同曝光程度的增强序列,但是和实际曝光图像存在一定差异,这是由于低照度图像暗部区域噪声较大,甚至部分细节已经丢失。现实中增加相机曝光时间可以有效降低噪声,但是上述步骤仅仅提升了对比度和亮度,本文使用引导滤波进行去噪[8],分别对增强序列Ienk进行去噪,将去噪结果作为最终模拟曝光图像Iexpk。

1.2 无监督网络融合

目前针对单一低照度图像增强的融合方法主要是传统意义上的加权分层融合,计算量大,鲁棒性低,容易产生光晕及接缝现象,而深度学习技术凭借数据驱动的特点,在各个领域的表现逐渐优于传统算法。因此本文考虑使用数据驱动的方式融合模拟曝光图像,实现灵活快速地重构出最终增强结果,可以高效融合任意固定尺寸和曝光数量的序列,达到令人满意的融合和增强效果。

1.2.1 研究方法

基于深度学习的融合在本质上和经典图像融合一样,都是通过加权融合框架实现。我们希望通过卷积神经网络获得的权重图更加平滑,即使针对边缘锐利的区域,权值也可以很好的过渡到平坦区域。其次针对高对比度和良好曝光的区域,权重具有较高的响应值。最后,通过网络获得的权重图可以更好地保留图像整体结构信息。这种情况下,即使不在多尺度层面进行融合,最终处理结果也不会出现光晕和接缝现象。

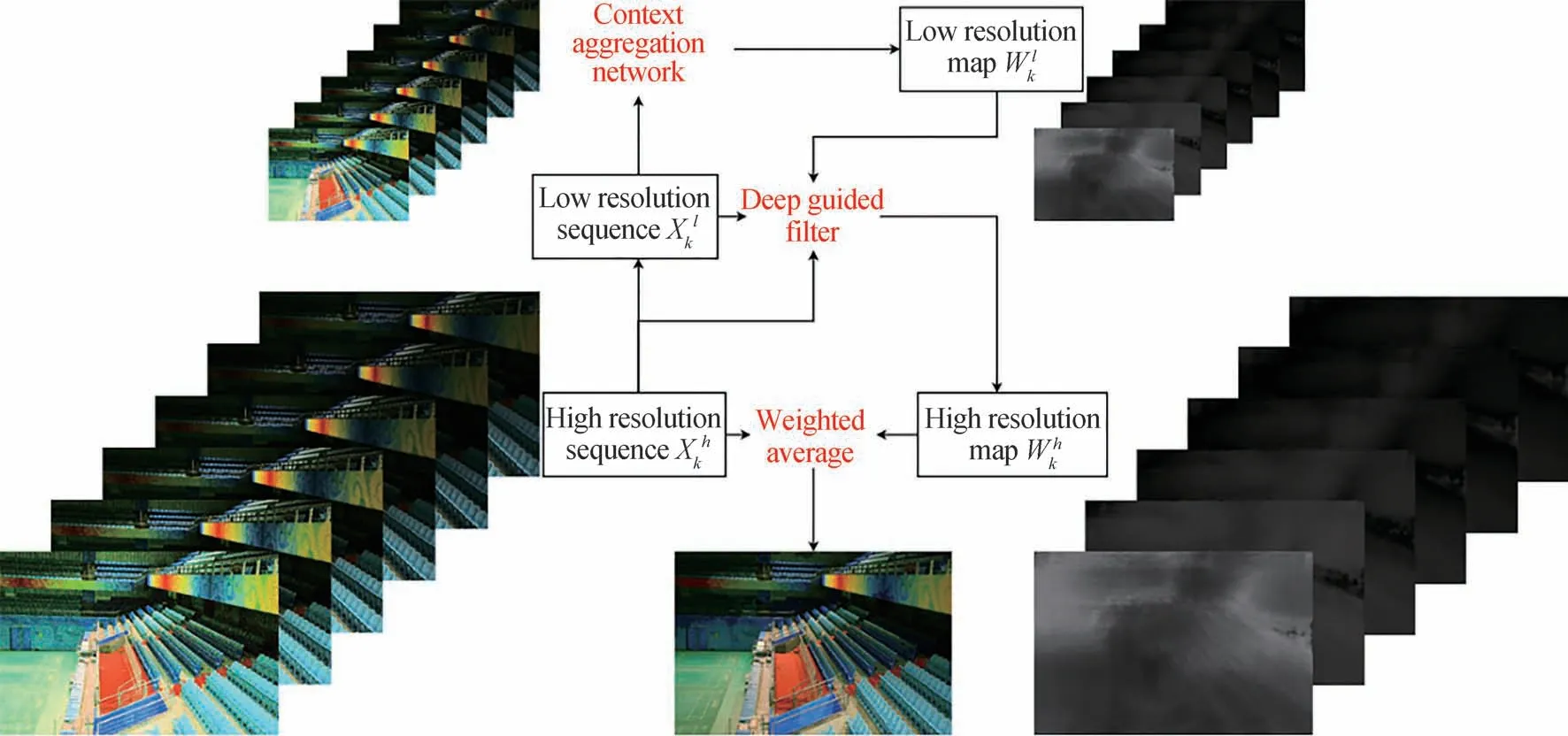

此外,除了高质量的融合结果,我们还希望网络具有灵活性,可以实现任意固定尺寸和数量的曝光序列的端到端融合。本文采用下采样处理和上采样恢复的方案。首先,将曝光序列的低分辨率版本输入到一个全卷积网络中,用于权重图预测。然后,在网络内部使用一个引导滤波器对权重图进行上采样,这样可以有效减少信息的丢失。最后,对全分辨率图像加权融合得到增强结果。融合具体过程如图3 所示,首先对输入的高分辨率序列Xhk进行下采样得到低分辨率序列Xlk,然后通过上下文聚合网络(Context Aggregation Network,CAN)获得低分辨率权重图Wlk,通过深度引导滤波(Deep Guided Filter,DGF)重构出高分辨率权重图Whk,对权重图归一化处理后加权融合。算法中存在两个关键步骤,一是使用空洞卷积对权重图进行密集预测,可以在不牺牲分辨率的情况下扩大感受野,该类方法也常被用于分割任务中[9]。二是引入可微的深度引导滤波层,对低分辨权重图进行联合上采样,实现端到端的图像输出[10]。

图3 基于深度学习的多曝光融合过程图Fig. 3 Multi-exposure fusion process diagram based on deep learning

1.2.2 网络结构

本节融合算法网络结构主要包括上下文聚合网络CAN 和深度引导滤波DGF。

1) 上下文聚合模块

CAN 的主要优点是在不牺牲空间分辨率的情况下具有较大的感受野,可以在更深层次上逐步聚合上下文信息,完成全局图像统计的计算,从而更好地进行像素级融合。本文采用锯齿状循环结构进行3×3 卷积核扩张,这种设置下可以较好地兼顾大小分辨率物体,2 倍扩张卷积侧重邻域内近心区域的信息,5 倍扩张卷积侧重于外围区域特征信息,而增加一次循环设置可以更好的均衡二者关系。本文在卷积操作之后立即使用自适应归一化,采用LeakyReLU 作为非线性单元,最后通过1×1 卷积输出权重图,无池化和非线性处理。自适应归一化方法如式(7)所示。

式中,γ和β为仿射系数,是可学习的标量。x表示输出的特征矩阵,xˉ是x的平均值,σ是其标准差,ε是一个较小值,为了避免分母为0。图4 为本节算法网络结构示意图,表1 给出了网络结构的具体配置,包含8 个卷积层,其输出响应与输入图像具有相同的分辨率。

表1 上下文聚合网络结构Table 1 Context aggregation network structure

图4 上下文聚合网络结构示意图Fig. 4 Context aggregation network structure diagram

2) 深度引导滤波模块

通过卷积网络可以获得低分辨率权重图,简单进行插值上采样会使融合结果丢失信息。引导滤波是一种有效的边缘保留算法,本文使用高分辨率曝光序列引导低分辨率权重图Wlk生成高分辨率权重图Whk,生成的Whk与Wlk具有相同的视觉特性,同时Whk会保留Xhk的边缘特性,其关系如式(8)所示。

表2 深度引导滤波模块算法步骤Table 2 Algorithm steps of depth guided filter module

图5 引导滤波层Fig. 5 Guided filtering layer

为了保持网络训练时梯度稳定,对曝光序列中每一幅模拟曝光图像Iexpk对应的权重图Whk进行绝对值归一化处理,这样可以更大限度的保留真实权重信息,同时可以避免加权融合后像素溢出,如式(9)所示。加权融合后的最终结果为Y,如式(10)所示。

1.2.3 损失函数

网络训练所使用的数据为多曝光序列,不存在配对参考图像,因此使用无参考质量评价函数MEFSSIM 进行融合质量评价[11]。在SSIM 的计算方式中,任何像素邻域块可以由对比度、结构和强度三个部分建模组成。与之类似,MEF-SSIM 也将模拟多曝光序列Xhk的像素邻域块xk分解为三个独立部分,如式(11)所示。

式中,μxk表示结构块xk的均值,=xk-μxk表示减去均值的结构块,ck、sk和lk分别表示图像内部结构块的对比度、结构和平均强度。最终融合块所期望的对比度分量̂由源图像块的最高对比度决定,其表达式为

针对平均强度,局部块的良好曝光情况和图像平均强度密不可分,图像过亮或图像过暗都会导致信息的丢失,这种情况下其权重值应该较小。而当亮度适中时,图像块包含的信息较多,此时权重值应该较大,可以利用式(14)二维高斯函数反映该关系。

式中,μk和lk分别表示图像Xk和局部图像块xk的均值,σg和σl代表标准差,μc和lc为常数。表示融合后的平均强度的分量l̂为

类似于SSIM 的表达式,MEF-SSIM 的构造方式为

式中,σ2x̂、σ2y表示给定局部块的方差,σx̂y表示局部块的协方差,C是较小的常数。S(·)为小于1 的正数,越接近1 表明融合质量越高。因此损失函数设置为

式中,N是输入模拟曝光序列的总数,p表示像素邻域块,M是邻域块的总数,xk和y分别表示输入的一组曝光序列机器融合结果。对所有邻域块取平均可以更好地反映融合结果和单张图像结构的相似性,而对所有输入序列取平均则保证了融合结果和所有曝光序列整体结构的一致性。

1.3 评价指标

为了公平起见,选取了有参考图像质量评价指标峰值信噪比(Peak Signal-to-Noise Ratio,PSNR)、结构相似性(Structural Similarity,SSIM)和无参考图像质量评价指标自然图像质量评估器(Natural Image Quality Evaluator,NIQE)等经典的评价指标来验证算法的有效性。考虑到图像观感很大程度上受到人们主观因素的影响,本文还重点从视觉观感的角度分析对比了各算法的增强结果,进一步验证所提算法的优越性。

1.3.1 峰值信噪比PSNR

PSNR 表示图像信号峰值与噪声的比值,该指标基于对应像素点间的误差,可以较好地反映图像信号的重建质量,单位是dB,数值越大表示图像信号失真越小,计算方式为

式中,MSE(x,y)表示均方误差(Mean Square Error,MSE),M和N分别表示图像长和宽,(i,j)表示像素位置,x和y分别表示输入图像和参考图像。

1.3.2 结构相似性SSIM

SSIM 一般用来衡量对比图像结构是否失真,通过图像的亮度、对比度和结构特性进行综合评价。SSIM 是感知模型,更符合人眼的直观感受。结构相似性数值结果在区间[0,1]内,数值越大,表明两幅图越相似,当亮度、对比度和结构特性占比相同时,计算方式为

式中,μx和μy是像素值平均值,σ2x和σ2y是方差,σxy是协方差,C1和C2为常数,避免分母为零。

1.3.3 自然图像质量评估器NIQE

NIQE 为常用的无参考图像质量评价指标,该评估方法在图像库中提取自然统计特征,这些特征源于一个高度正则化的空域模型。将测试图像中提取的自然统计特征的多元高斯模型与原始图像库中的多元高斯模型的距离作为NIQE 的分数,表示为[12]

式中,v1、v2、Σ1和Σ2分别是待测图像和原始图像库多元高斯模型的均值向量和协方差矩阵,NIQE 得分数值越小表明待测图像和标准库图像之间多元分布差异越小,即图像质量越高。NIQE 不需要测试图像的先验信息,可以较为客观地表现图像质量。

2 实验与分析

2.1 实验环境

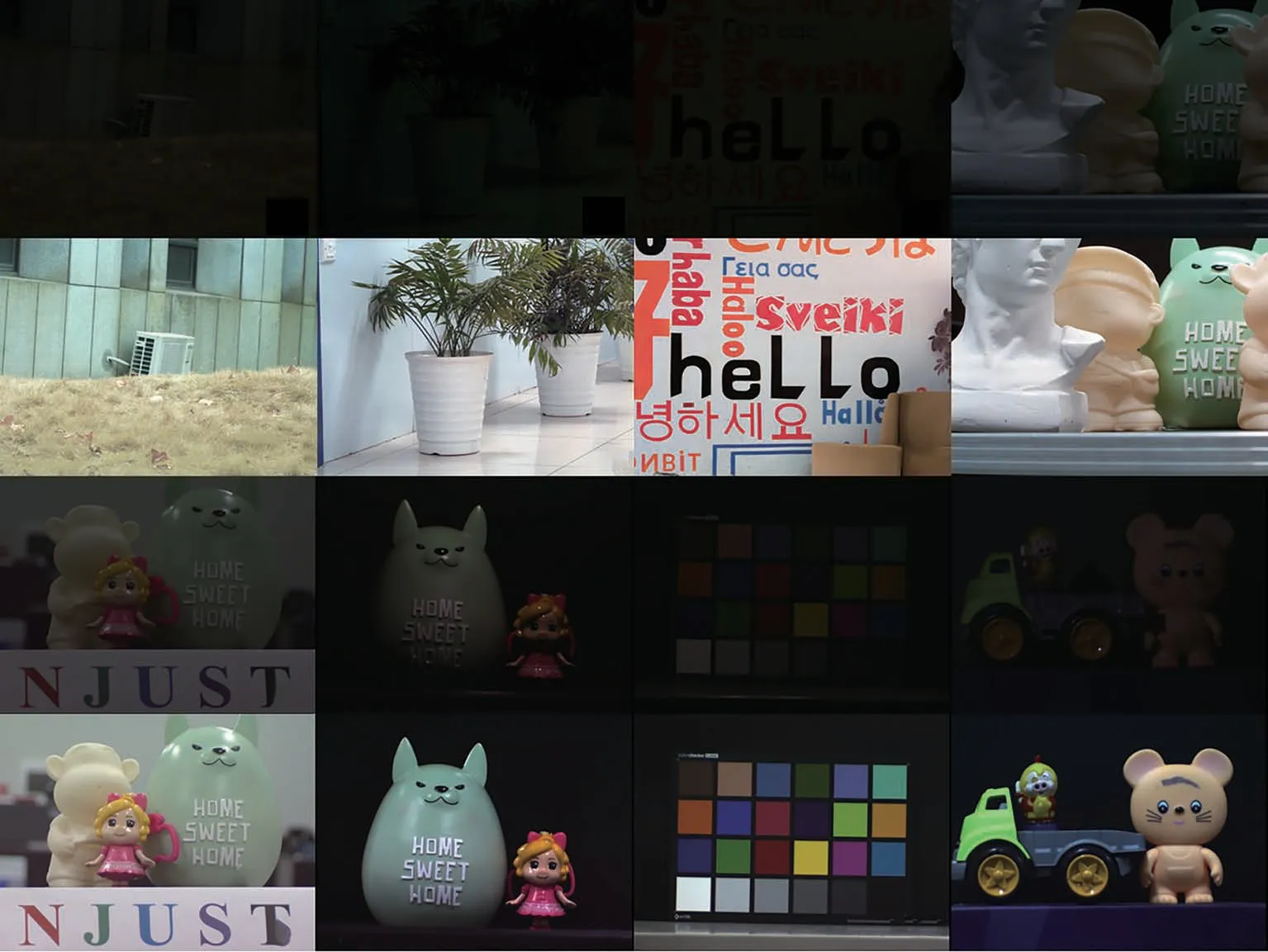

本文收集了大量的公开低照度图像测试数据,这些数据是由通用消费级相机拍摄获得,例如数码相机和智能手机。涉及经典的DICM[13]、MEF[11]、NPE[14]、LIME[15]以及LOL[16]数据集,包括94 张RGB 格式不同程度的低照度图像。为了进一步验证算法的鲁棒性,本文在公开数据集的基础上又收集了使用科研相机拍摄的低照度图像,相机传感器为EMCCD(Electron-Multiplying Charge-Coupled Device),型号是Onsemi KAE-02150。为了验证算法对色彩信息的有效保留,使用棱镜式真彩色工业相机JAI AP-3200T-USB 采集标准比色卡的图像进行对比验证,相机传感器型号为Sony IMX265。实验所涉及的环境光照度由远方PHOTO-2 000 m 弱光照度计测得,照度计量程为0.000 1 lx 至2 000 lx,测量5 次取均值作为结果。

2.2 测试集实验结果与分析

本算法的训练集选自SICE 数据集[17]中的229 组真实曝光序列,并对这些数据进行下采样,将低分辨率序列加入训练集。因此训练数据共包括458 组曝光序列,每组曝光序列包含7 到9 张真实曝光图像。选取其中18 组曝光序列作为验证集。网络的训练环境为Intel i9-9900K@3.6 GHz 处理器和Nvidia RTX 2080Ti 11 GB 显卡,测试环境为Intel i7-9750H@2.6 GHz 处理器和Nvidia GTX 1 650 4 GB 显卡。对比算法的增强结果均使用原作者给出的程序获得。

2.2.1 公开数据集

为了更清晰地对比各算法的效果,将测试数据分为三类,背光场景低照度图像、局部光照下微光场景和极低光照下场景。从各种场景中选取一幅典型图像进行对比,图6 为背光环境低照度场景,图7 为局部光照微光场景,图8 为极低光照场景。对比算法包括基于光照估计的增强算法LIME[15]、基于相机响应模型的增强算法LECARM[5]、基于融合的低照度图像增强算法FEM[1]、基于Retinex 理论的光照调节网络KinD[18]、基于协作先验结构搜索的RUAS 网络[19]和基于零参考曲线估计Zero-DCE 网络[20]。这些对比方法为现阶段较好的低照度图像增强算法,与之对比可以反映出本算法的优越性。

图6 背光环境下增强效果对比图Fig. 6 Comparison of enhancement effects in backlight environment

图7 局部光照微光环境增强效果对比Fig. 7 Comparison of enhancement effects in local light level environment

图8 极低光照环境增强效果对比Fig. 8 Comparison of enhancement effects in extremely low light environment

由图6 至8 可以发现,LIME 算法很难恢复出暗部区域信息,尤其是背光场景暗部区域和极低光照环境场景。例如图6(b)中书柜场景难以识别图,8(b)中拖线板无法被清晰识别。LECARM 算法相较于LIME算法可以更好地恢复出暗部区域信息,增强后的图像整体亮度有所提高,但是亮部区域极易出现过度增强现象,如图6(c)窗户外面的场景。此外,图7(c)中宇航员和太空车饱和度过高,增强结果不自然。图8(c)中增强结果存在明显噪声,拖线板位置增强效果不明显。FEM 算法整体增强效果较好,与本文处理结果较为接近,但其增强后图像色彩饱和度有所下降,尤其是背光场景中亮部区域和局部光照环境下的微光图像,如图6(d)中窗户外的绿植色彩不鲜艳,图7(d)中的宇航员和太空车的色彩饱和度均不高。KinD 算法增强结果对比度不高,如图7(e)中宇航员和太空车。值得注意的是,如图8(e)可以有效提高图像的亮度和对比图,增强结果色彩真实自然,这是由于该网络使用的训练集为LOL 数据集,而图8(a)恰好取自该数据集,与其训练集存在密切联系,所以该算法增强效果较好,从侧面体现出该算法鲁棒性不高。RUAS 算法在对比中表现最不佳,明显使得亮部区域过度增强,产生像素溢出,与此同时并未有效提高暗部区域亮度,如图6(f)中窗户外场景明显被过度增强,而热气球和书柜均未被有效增强。图7(f)中增强结果存在明显色彩失真。在极低照度下,图8(f)中图像亮度并没有显著提高。Zero-DCE 算法在提高图像整体亮度方面表现不错,但是增强结果存在色彩失真,图像饱和度较低,例如图6(g)中窗外绿植,图7(g)中的宇航员和太空车饱和度均较低,图8(g)中书本和订书机色彩均不够鲜艳。

综合对比发现,本文所提算法显著提高了图像亮度和对比度,在恢复图像暗部区域信息的同时,有效抑制了过度增强现象,并适当提高了色彩饱和度,增强结果令人眼满意。为了进一步表明算法的优越性,表3给出了各算法增强结果的NIQE 得分,测试图像包含DICM 数据集[13]、MEF 数据集[11]、NPE 数据集[14]和LIME 数据集[15],共计79 张低照度图像。从表中可以看出,本文所提算法在MEF 和LIME 数据集上的表现都是最好的,在DICM 数据集上得分弱于最优算法5.54%,在NPE 数据集上得分仅弱于最优算法0.53%。但是从所有图像测试结果的均值来看,本文所提算法最佳,强于次优算法4.49%。结合图6 至图8 的主观感受,可以有效反映出算法的优越性。

表3 不同算法下增强结果的NIQE 对比Table 3 NIQE comparison of enhancement results under different algorithms

2.2.2 实验室环境数据集

为了进一步验证算法的鲁棒性,本节对使用科研相机和工业相机收集的测试数据进行实验对比,部分场景低照度图像和参考图像如图9 所示,其中第一行和第三行是原始低照度图像,第二行和第四行是参考图像。针对Onsemi 相机,在镜头前加透射率为10%中性滤光片得到的微光图像,测试数据包括室内场景、建筑内自然光场景和室内白炽灯场景。部分实验结果如图10 和图11 所示,图中,数字1 表示场景1,数字2 表示场景2。

图9 部分实验室环境数据集Fig. 9 Sample images of laboratory environment testing images

图11 不同算法增强效果对比Fig. 11 Comparison of enhancement effects of different algorithms

从图10 和图11 可以发现本文算法可以有效提高图像的亮度和对比度,相较于其他主流算法,本算法更好地恢复出图像暗部区域特征,同时避免了过度增强现象,而且可以很好的保留图像色彩信息,增强结果具有合适的饱和度。图10 和图11 中目标场景的参考图像见图9 第一行。可以发现,LIME 算法无法有效恢复图像暗部区域信息,如图10(b)中的绿植和图11(b)中的沙发无法被人眼识别,且图10(b)中的草地和图11(b)中的玩偶饱和度过高。LECARM 算法结果图像对比度不高,整体亮度不高,如图10(c)、(c)和图11(c),且图11(c)中大卫鼻子处,玩偶头部位置存在过度增强现象。从图10 和图11 第4 列可以发现RUAS 算法结果图像亮度较低,存在明显色差,无法有效增强原始图像。Zero-DCE 算法增强结果较好,但是整体亮度仍低于本文所提算法,如图10(e)中的绿植和图11(e)中的沙发,且该算法增强结果对比度不高,如图11(e)中的玩偶。综合对比发现,本文所提算法增强效果明显,可以有效提高图像的亮度和对比度,同时不会产生过度增强现象,算法增强结果色彩真实自然,令人眼满意。实验室环境数据集共包括13 对图片,其中9 对图像分辨率为1 040×772,4 对图像分辨率为1 280×1 024,由上述Onsemi 和JAI 两种相机拍摄获得,输入低照度图像和参考图像如图9 所示。对各算法增强结果进行了定量统计对比,结果如表4 所示。可以发现本文算法评价指标取得优秀成绩,其中PSNR 指标强于次优算法4.28%,SSIM 指标强于次优算法1.94%,NIQE 指标仅次于KinD 算法。

表4 不同算法下增强结果的图像质量评价及所用时间对比Table 4 Image quality evaluation and time spent comparison of enhancement results under different algorithms

表4 还给出了各算法运行时间,其中LIME 算法涉及光照估计问题,需要根据优化条件进行大量计算,耗时最多。LECARM 和Zero-DCE 算法耗时最短,这是由于二者仅使用伽马校正的方式,只需对图像各个像素点的进行校正,虽然速度快但处理效果也较差。KinD 算法分为图像分解、反射率恢复和光照调节三个模块,运算时间也较慢。RUAS 算法引入先验约束,以结构搜索为手段,是一种轻量级网络,计算资源消耗少,用时较短但NIQE 的指标较差,这是由于该算法的照明估计模块不适用于复杂光照场景。本算法耗时中等,主要是生成模拟曝光序列耗时较多,但是综合各项图像质量评价指标最优,后期将在模拟曝光和曝光融合协同部分进行改善,以提高运行速度。

为了进一步评价所提算法增强结果的色彩质量,在暗室环境中使用JAI 相机采集了约8.71×10-2lx(第一行)和1.02×10-2lx(第三行)两种照度下X-Rite 标准比色卡的图像,该相机为棱镜式真彩色工业相机,传感器型号为Sony IMX265,各算法的增强效果如图12 所示。

图12 不同照度比色卡图像增强结果对比Fig. 12 Comparison of enhancement results of different illumination colorimetric cards

选取CIE LAB 色差对实验结果进行比较,色差定义如式(22)所示。CIE LAB 坐标系中两点的距离ΔE(x,y)可以较好地表征人眼感受到的色差,反映出待测图像色彩与目标参考图像的色彩匹配程度,数值越小表明二者色彩差异越小。

式中,L2、a2、b2和L1、a1、b1分别表示目标参考图像和待测图像的CIE LAB 颜色空间的明度分量L、从绿色到红色的分量a和从蓝色到黄色的分量b。选择各个色块中60×60 大小的区域进行计算,分别计算24 种颜色的色差,结果取平均。各算法对比结果如表5 所示,其中最优结果加粗显示。可以发现,本文所提算法增强结果最优,较好的保留了色彩信息,在8.71×10-2lx 下,色差优于第二名算法14.83%,在1.02×10-2lx 下,色差优于第二名算法3.05%。结合对图12 的人眼观察,本文所提算法表现最佳。

表5 不同照度下比色卡图像增强结果色差对比Table 5 Color difference comparison of color card image enhancement results under different illuminance

3 结论

本文提出了一种基于自适应截断模拟曝光和无监督融合的增强算法。首先介绍了模拟曝光生成方法,通过阈值分割技术得到亮暗区域,然后结合亮度响应和带有截断因子的自适应伽马校正,以及引导滤波算法得到模拟曝光序列。然后介绍了基于上下文聚合网络的融合方法,包括基于空洞卷积的权重学习模块和深度引导滤波上采样模块,实现加权融合获得增强结果。最后使用微光夜视相机和三通道真彩色相机收集了低照度图像测试集,并对公开数据集和实验室环境数据集进行实验,将实验结果和诸多优秀算法进行对比。实验结果表明本算法性能优越,鲁棒性较好。该算法可以有效提高图像亮度和对比度,在恢复图像暗部区域信息的同时有效抑制亮部区域过度增强现象,同时算法增强的图像具有较好的色彩信息,结果令人满意。