基于超图的双模态特征融合的作物病害识别算法

2023-09-11张净邵文文刘晓梅李贺亮高跃张轩诚

张净 邵文文 刘晓梅 李贺亮 高跃 张轩诚

摘要:农作物叶部病害已经严重影响农作物的产量和质量,为提高农作物叶片病害识别的效果、减少经济损失、提高种植者的收益,提出基于超图的双模态特征融合的农作物病害识别算法BimodalFINet。BimodalFINet由文本模态分支、图像模态分支和超图神经网络构成。首先利用循环神经网络和改进的卷积神经网络构造图像文本双分支并行结构,提取语义特征信息和富含空间位置信息的特征表示,得到2种模态特征,然后利用特征融合方法实现各分支特征信息的互补与融合,得到包含更加丰富的病害双模态特征信息。最后利用超图神经网络将上述融合后的双模态特征信息进行编码以获得数据之间的相关性和数据表示,提升模型识别准确率。结果表明,BimodalFINet的文本模态分支TextRNN取得91.28%的识别准确率,图像模态分支RexNext50-CA取得89.20%的识别准确率,相比于单个ResNext50模型提高了1.08百分点,联合模态分支取得92.32%的识别准确率,相比于图像和文本单模态模型分别提高了3.12百分点和1.04百分点,加入超图后模型取得94.83%的识别准确率,相比于联合模态模型提高了2.51百分点。嵌入超图后的模型具有更好的特征提取能力,能够为田间环境下农作物的病害识别提供有效技术支持。

关键词:农作物病害;超图神经网络;卷积神经网络;特征融合;双模态

中图分类号:TP391.41 文献标志码:A

文章编号:1002-1302(2023)15-0164-09

基金项目:国家重点研发计划(编号:2019YFC1606600)。

作者简介:张 净(1975—),女,江苏镇江人,博士,副教授,硕士生导师,研究方向为计算机应用。E-mail:jszj08062000@163.com。

通信作者:邵文文,硕士研究生,研究方向为机器视觉。E-mail:355060863@qq.com。

现阶段,农作物病害已经成为我国面临的重大挑战之一,随着农业生产能力的不断提升,生产环境随之复杂化,在生产过程中遇到病害的情况也越加频繁,对农作物的生长造成了非常严重的影响,从而加剧农作物食品安全问题[1-2]。随着计算机技术的不断进步,卷积神经网络在众多领域如图像识别方面不断取得新的突破,现阶段众多专家学者运用卷积神经网络提取病害特征,从而帮助农业工作者识别诊断农作物病害,及时发现农作物病害的症状并作出预防措施[3-6]。Too等基于PlantVillage数据库对VGG、ResNet、DenseNet和ResNext等卷积神经网络进行评估,最终DenseNet达到了最佳的分类效果[7-11]。侯志松等提出一种基于集成学习的图像分类模型,该模型平均准确率为96.9%,效果较好[12]。Hou等提出坐标注意力,该机制通过嵌入病害位置信息到通道注意力,在获取更大范围的病害信息的同时避免了较大开销,性能较好[13]。

由于卷积神经网络的相邻输入并无直接相关性,而语言又具有序列性,所以卷积神经网络在语言识别领域中效果较差。循环神经网络某一时刻v隐藏层的值是由v的输入和v-1时的输入所决定的,所以循环神经网络适合序列数据的建模。Lai等提出一种基于循环神经网络(RNN)的文本分类模型TextRNN,该模型利用RNN捕获更长的序列信息,从而获得更佳的识别效果[14]。

图是不规则结构且蕴含丰富的信息,卷积神经网络的卷积操作无法在图结构上进行有效的计算,而图神经网络节点通过边相连,将不同样本(节点)之间的关系等信息进行有效和充分的表达,从而图神经网络能够高效地利用样本(节点)实例之间的结构性特征,但普通图网络边的度仅被设置为2,不能建模数据之间的高阶关系,Berge提出超图理论并全面提出无相超图理论,同时对普通图和超图进行比较:超图是普通图的重要扩展,普通图仅能表现2个节点之间存在的相关性,而超图中的边即超边能包含任意数量的节点并能表现多个节点之间存在的某种关系[15-16]。黄汝激提出有向超图理论,并解释分解超图等概念[17]。Feng等提出超图神经网络(HGNN)框架,与普通图结构边的度被限制为2不同,超图神经网络可以使用无度超边编码数据之间的相关性并通过超边卷积运算处理表示学习过程中的数据相关性,从而通过超图神经网络有效提升双模态融合的效果,进而提升模型识别准确率[18]。

现阶段大部分农作物病害识别模型都是基于图像模态,但在使用图像单模态进行农作物病害识别时,现有方法未能有效利用农作物病害描述文本信息,而人们根据相关农作物病害图像作出的文本描述通常含有丰富的语义信息,其与图像模态在描述病害信息中存在高度相关性和互补性,两者的结合能融合2种模态之间的共性和特性,现如今已有相关学者对此进行探究,并充分挖掘双模态甚至是多模态的潜力。本研究提出一种基于超图的双模态特征融合的农作物病害识别算法,将图像模态、文本模态以及超图神经网络进行结合以改善现有农作物病害识别方法识别准确率低的问题。

1 农作物病害识別模型

1.1 病害图像模态分支

本节将ResNext50-CA网络作为特征提取模块,模块包括ResNext50和坐标注意力机制2个部分。ResNext是结合ResNet与Inception思想设计的特征提取网络,采用残差结构和多分路卷积,并引入分组卷积以解决Inception网络需要专门设成不同结构导致参数量增多的问题,相同的构造不仅简化了网络,而且增强了模型的特征表达能力。为有效获取长范围依赖的信息,使模型更准确地定位并识别目标区域,本研究在ResNext50网络中嵌入坐标注意力,见图1-a。坐标注意力将通道注意力分为2个一维特征编码过程,分别沿2个空间方向聚合特征,通过水平与垂直方向注意力图不仅能捕获特征的远程依赖关系,还可以有效保持精准的位置信息,提高网络识别目标的准确率。

图1-b为嵌入坐标注意力机制前ResNext50网络残差模块的结构图,其中图1-a(除虚线包含的部分)与图1-b所示网络严格等价。由图1-b可知,每个分组结构都是采用1×1和3×3卷积操作组合而成,图像首先经过1×1卷积层降低维度,降低后续卷积操作的计算量,然后通过3×3卷积层获得相关特征信息,其次通过嵌入的坐标注意力机制捕获特征远程依赖关系以及精准的位置信息,再通过1×1卷积层升维,最后对每个分组的输出进行加权计算。

如图2所示,坐标注意力网络主要包括2个部分,分别为坐标注意力生成和坐标信息嵌入。首先,对于输入特征图X分别设其长、宽和通道数为 H、W 和 C,先利用尺寸为 (H,1) 和 (1,W)的平均池化沿着水平和垂直方向对每1通道进行编码,得到1对方向感知特征图,此操作不仅能保存1个空间方向的精确位置信息,还能捕获到沿着另一个空间方向的长期相关性,使网络更加精准的定位感兴趣的目标。然后,将上述生成的特征图进行级联,使用1个共享的1×1卷积层进行变换以对通道进行降维,并通过1个非线性激活层,得到具有垂直和水平方向空间信息的中间特征图,图2中r表示下采样比例,用来控制模块大小。其次,沿着空间维度将中间特征图进行切分得到2个单独的张量,利用2个1×1卷积层将切分的2个单独张量变换到与输入特征图X相同的通道数,并用Sigmoid激活函数引入非线性,最后进行输入-输出残差连接操作。

1.2 病害文本模态分支

TextRNN利用循环神经网络的线性序列结构处理数据中的序列关系,但当序列较长时则会存在梯度消失问题,为解决这一问题,本研究选择使用长短期记忆网络(LSTM)对TextRNN中的循环单元进行改进。LSTM由3个门控(遗忘门、输入门和输出门)组成。遗忘门利用Sigmoid函数决定哪些信息会被遗忘。输入门主要由Sigmoid层和Tanh层组成,输入门先通过Sigmoid层决定哪部分数值需要更新,再通过Tanh层产生新的候选值向量并加入到细胞状态当中,从而实现对状态的更新。输出门决定什么信息需要输出,其主要利用Sigmoid函数来实现这一目的。然后利用Tanh层对细胞状态进行处理,两者相乘得到最终的输出信息。由上述可知,LSTM通过其门控结构使得网络在计算下一个单词的输出时,仍会考虑上一个单词的输出,实现有选择地遗忘不需要的信息,有选择地输入输出需要的信息,从而捕获更为详尽的长期与短期的文本特征。

文本模态分支结构见图3,TextRNN首先将句子中的词向量序列作为输入逐个输送到双向LSTM中,该层可以实现信息有选择地通过,其主要利用LSTM中的Sigmoid函数和点乘操作,并在单个LSTM基础上加入1个将信息流反向的LSTM以避免网络只关注数据的上文而忽略下文,以此捕捉数据长短期时间依赖,捕获完整的过去和未来的上下文信息。其次,将语句中的词向量输送到双向LSTM层后,在输出层可以获得每个时间步长神经元的正反双向信息流的输出,将二者拼接,形成最终的双向LSTM的输出。

1.3 特征融合层

ResNext50-CA網络和TextRNN网络分别提取图像和文本特征,并且在特征维度层进行融合,融合方式采用的是Concat方式,即拼接方式,拼接的特征融合方式直接将2种特征在通道数维度上拼接起来,增加了特征维度,保留所有的完整信息。拼接的融合方式可以让深度学习网络自己去学习每个信息的重要性,增加信息量的同时也降低了错误发生的概率。

1.4 超图神经网络

双模态融合网络利用模态之间的互补与融合实现正确分类,从而提升网络的识别准确率。超图神经网络利用其易于灵活的无度超边对数据之间的相关性进行建模,提升模态融合的效果,从而得到更好的识别准确率和稳定性,普通图和超图分别如图4、图5所示,图中圆圈表示顶点,曲线表示超边,普通图中边的度必须为2,而超图神经网络中边的度为任意非负整数,同一条超边可以连接不同的顶点用于表示相连接的顶点之间存在相关性。

本研究将病害图像模态分支与文本模态分支分别训练并进行特征融合后输送入超图神经网络,如图6所示。首先,超图神经网络利用双模态病害数据集的复杂相关性构建相应的超边组H1和H2,并对超边组进行拼接操作得到关联矩阵H,关联矩阵是描述图的一种矩阵表示,用以代表超图神经网络中顶点和超边之间的相关性,关联矩阵见图7。

除此以外,可以用公式(1)表示关联矩阵,公式如下:

式中:v表示超图顶点;e表示超边。如果顶点包含在超边中,则将关联矩阵中相应位置记为1,否则记为0。然后将超图的关联矩阵和数据集中所包含的节点特征输送到超边卷积层中进行卷积操作以学习高维数据的隐含特征,其中卷积操作可以用公式(2)、公式(3)表示。

式中:X(0)表示经两模态分支特征融合后的输入X;σ为非线性激活函数;X(l)∈RN×C表示超图神经网络在l层的信号;Dv和De表示归一化;θ(l)表示过滤处理矩阵,H表示关联矩阵,W表示各条超边权重的对角矩阵。最后输出病害类别标签,输出公式Y如下所示。

式中:θ表示可训练参数;Y表示可用于分类任务的超图卷积公式以此得到输出病害类别标签。

经过以上运算可以使超图更好地细化特性,可以有效处理学习过程中出现的复杂数据的相关性,从而更好地识别出各种农作物的病害。

1.5 BimodalFINet网络架构

BimodalFINet包括图像模态分支、文本模态分支和超图神经网络3个部分,BimodalFINet输入为农作物病害图像-文本对。

BimodalFINet网络架构见图8,网络由ResNext50-CA、TextRNN以及超图神经网络组成,网络架构图中各个方块表示模块所构造的参数和结构,其中ResNext50-CA架构图中的×3、×4、×6、×3 表示残差模块重复堆叠的数量,C表示为分组的数量,CA表示坐标注意力,1×1和3×3等表示卷积核的尺寸,K表示类别数量。图像数据先输入进ResNext50-CA模型中,再经过多个卷积层,得到的输出尺寸为7×7,最后输入到全连接层,得到的输出尺寸为1×1。经过图像分支后每张图像最终得到1×1 000的向量。

文本数据输入进TextRNN模型后,经过嵌入层与多个LSTM层以捕获更为详尽的长期与短期的文本特征,每张图像对应的文字描述最终得到1个 1×1 024的向量。2种模态通过特征融合得到1个融合的1×2 024特征向量,即超图神经网络的输入。由于真实的图往往是高维且难以处理的,所以图神经网络将高维图进行编码成低维向量表示来学习高维图结构信息。超图神经网络先将图中每个节点映射编码成对应的向量表示,节点的向量表示保留了图的结构和节点之间的连接,超图神经网络通过将原始特征映射到各个节点以及超边上,这样在保留特征的同时更可以保留每个特征之间的相关信息,提高模态之间的融合度。之后采用2个超边卷积层提取特征,其中每个超边卷积层包含16个隐藏节点,概率为0.5的Dropout层以防止过拟合,激活函数采用ReLU,最后通过输出的超图节点来预测得到标签。

2 农作物病害分类试验设计

2.1 数据集

试验应用的数据集为田间实际应用场景下拍摄的病害图像,数据集包括5种农作物(苹果、马铃薯、辣椒、玉米、番茄)下的7类病害(苹果黑星病、苹果锈病、马铃薯早疫病、马铃薯晚疫病、玉米叶枯病、甜椒叶斑病、番茄早疫病)图像,共包含5 178张图片(表1),均获取于Kaggle官方网站(https://www.kaggle.com),文本数据集共包含5 178条数据。每种病害所包含的样本量见表1。本研究抽取数据集中80%的图像作为训练集,其余20%的图像作为测试集,病害文本数据集是由2名农业研究员对照病害文本数据集中的图像进行描述,如表2所示,该数据集部分样本描述。

2.2 数据预处理

预处理主要将数据集中的图像裁剪为统一标准的224×224,使得在模型输入维度相同的情况下比较各模型之间的性能。

在病害文本输入循环神经网络前需要进行一系列处理。首先将文本数据集通过jieba分词工具进行中文分词,去除文本中如“的”“和”等无意义停用词和相应的标点符号,使得在试验中减少文本数据集中的噪声数据,提高分类算法的分类效果。此外,还需要将中文文本进行文本向量化,将文本向量表示后的数据作为TextRNN的输入,对中文文本进行训练。

2.3 试验环境及相关参数设置

本试验于2022年3—7月在江苏大学电气信息工程学院实验室完成模型训练和测试过程。本试验硬件环境为2个RTX2060s,软件环境则采用Ubuntu 16.04操作系统以及Pytorch深度学习框架,其CUDA API的版本为9.1,cuDNN的版本为9.0,算法实现语言采用Python 3.6.3版本。

本试验设计以及对照试验过程中参数设置:学习率为0.000 1,Batch-size设为32,本试验采用自适应距估计(adaptive moment estimation,Adam)优化算法,并设置参数β1=0.9,β2=0.999,ε=1×10-8,迭代次數为100。

3 结果与分析

3.1 试验评价指标

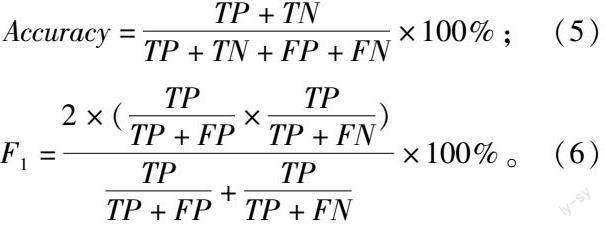

本研究将改进后的模型在数据集上进行训练和测试,采用准确率(Accuracy)和F1值对改进后的模型性能进行评价,公式如下:

式中:TP表示预测为正类,真实为正类;TN表示预测为负类,真实为负类;FP表示真实为负类,预测为正类;FN表示真实为正类,预测为负类。

3.2 图像分支模型对比试验

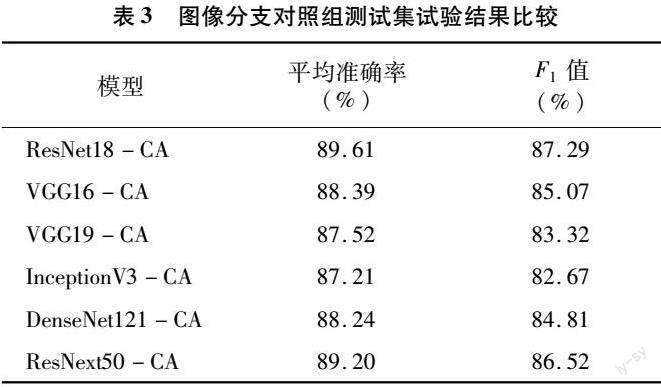

相同试验条件下,采用准确率和F1值作为模型性能的评价指标。由表3所知,对6种图像识别模型进行比较,结合各个模型在数据集上的表现,选择最优模型,本节图像分支模型采用Adam优化器,学习率为0.000 1,Dropout设置为0.5。

由表3可知,各个模型平均准确率均在87%以上,平均准确率排名第一的为ResNet18,平均准确率为89.61%,其次是ResNext50,其平均准确率为89.20%,说明深度学习模型应用于农作物病害识别中具有较好的表现。各个模型的F1值也达到82%~88%,F1值排名第一的为ResNet18,其F1值为87.29%,其次是ResNext50,其F1值为86.52%,表明图像分支对照组中的各模型在不同的类别中的表现差异相对较小,相对均衡。

不同模型的准确率曲线见图9。ResNet18和ResNext50均达到较高的准确率,分类效果优于其他模型。从收敛速度上来看,ResNext 50的收敛速度比较快,能够在第30次迭代左右趋于收敛,由此可以得出,ResNext50能够在较短的时间内训练出较为优秀的模型,其余图像单模态分支对照组中的各模型在训练过程中相对稳定,表现良好。

3.3 文本分支模型对比试验

本节使用TextRCNN、TextRNN、TextRNN_Attention和TextCNN 4种经典文本特征提取网络选取文本分支最优模型[19-21]。文本分支模型采用Adam,学习率为0.000 1,Dropout为0.5。由表4可以看出,所有文本分支对照组的测试集结果中4种网络的平均准确率均超过91%,其中TextRCNN的平均准确率最高,为91.72%,其次是TextRNN,其平均准确率为91.28%,各个网络的F1 值也均超过88%,其中最高的为TextRCNN,F1值为89.44%,其次是TextRNN,F1 值为88.75%,说明循环神经网络的线性序列结构能将之前输入的整个历史映射到每个输出,使得网络能够较为准确地提取农作物病害描述文本的特征并对其进行分类。由图10可知,文本分支各个模型在训练过程中相对稳定,由于TextRCNN通过双向RNN结构取代了TextCNN卷积层的特征提取,即由卷积层+池化层转化为双向RNN+池化层,所以其在病害文本数据集中的效果最优。

3.4 联合分支模型对比试验

在病害特征不突出的情况下,卷积神经网络较难从图像单模态中学习到足够的病害特征以实现正确分类。当存在不准确病害描述文本的情况下,仅使用文本进行病害判断也会导致准确率的下降。本节采用图像和文本双模态联合对农作物病害进行识别。考虑到各模型的准确率以及F1值,选择图像分支与文本分支中的部分网络进行组合,2个分支分别优化以达到最优的分类效果。本节优化器采用Adam,学习率采用0.000 1。

如表5所示,双模态对照组中采用图像分支中F1值高的4种网络分别与文本分支对照组中的不同网络进行结合,其中,采用的4种图像单模态分支网络分别为ResNet18-CA、VGG16-CA、ResNext50-CA、DenseNet121-CA,采用的联合分支对照组如表4中所示模型。

由表5可知,试验中的联合模型均取得了較好的识别准确率和F1值,其中平均准确率最高的为ResNext50-CA+TextRNN,平均准确率为93.22%,F1值为92.07%。但仅利用图像和文本单模态时,两种单模态模型的平均准确率为89.20%和91.28%,从而表明使用双模态联合分支模型比使用图像或文本单分支模型的分类效果更佳,并且从图11中可以看出,与图像和文本单分支对照组相比,联合分支中各个网络模型的平均准确率的上升速度较为明显。由此说明,2种模态相互结合的识别性能比单模态的要好。

3.5 加入超图后联合分支模型对比试验

为了更好地提升双模态融合效果,本节将5种网络分别输送入超图神经网络,利用超图神经网络多元复杂关系展示能力提升模态融合效果,得到更好的识别准确率,本节优化器采用Adam,学习率采用0.000 1,Dropout采用0.5,可以防止过拟合。

如表6和图12所示,联合分支对照组中各个模型加入超图神经网络后的识别准确率和F1值均有提升,其中5种网络加入超图神经网络后平均准确率分别提升1.55、1.42、1.03、1.54、1.61百分点。由此说明,超图神经网络能够利用超图构建和相关超边卷积计算表示复杂数据之间的相关性,从而增强图像和文本模态结合的融合度,进而提升网络的识别准确率。

3.6 消融试验

为了验证各个模块在BimodalFINet网络中的贡献,本研究在数据集上进行消融试验,各组试验所得到的平均准确率和F1值见表7。从表7可以看出,ResNext50未加入坐标注意力时,平均准确率为88.12%,嵌入坐标注意力机制后模型平均准确率提升1.08百分点,说明坐标注意力对于模型平均准确率的提升有一定促进作用。在ResNext50-CA基础上联合TextRNN,模型的平均准确率和F1 值进一步提升,分别提升近4.02、5.55百分点,说明双模态融合网络能有效利用图像模态以及根据病害图像作出的文本描述所含有的语义信息。在ResNext50联合坐标注意力和TextRNN后输送入超图神经网络,模型的识别准确率和F1值进一步提升,分别提升了1.61%、1.92%,说明超图神经网络通过构建超图和超边卷积运算能提升双模态之间的融合度,最终达到较高的平均准确率,综上所述,本模型在数据集上表现出了良好的识别效果,能够有效的对病害进行识别。

4 结论

本研究提出一种基于超图神经网络的双模态特征融合的农作物病害识别算法(BimodalFINet)用于农作物病害识别,从而避免传统方法依赖于费力且耗时的人工特征设计,该算法包含ResNext50-CA、TextRNN和超图神经网络3个部分,图像模态分支采用基于坐标注意力的卷积神经网络(ResNext50-CA)提取相关病害特征,坐标注意力机制通过在像素坐标系中的有效定位,使得模型能关注于感兴趣的区域,从而达到更好的分类效果。文本模态分支采用TextRNN,为了避免梯度消失等问题,本研究对TextRNN的循环单元进行改进,嵌入LSTM,使得网络能同时考虑到长期和短期的病害文本特征。图像和文本2种模态在特征维度层进行融合,并输送入超图神经网络进行分类,超图神经网络使用超图结构进行建模,即利用超图的无度超边(超越普通图的成对连接)编码数据之间的高阶关系,并通过超边卷积运算学习双模态之间复杂的数据相关性,从而超图神经网络能充分利用农作物病害图像与农作物病害文本描述之间的相关性,进一步增强网络的融合效果,得到更佳的识别准确率。综上所述,本研究提出的方法能有效改善单模态模型识别准确率低导致消耗过多人力财力的问题。此外,本研究所提出的模型是一种通用框架,在使用过程中可以使用更为优异的卷积神经网络、循环神经网络以及图神经网络以达到最优的识别效果。为了进一步提升模型的识别准确率,后期将会对模型进行改进,使得模型能够更好地应用于农业实践当中。

参考文献:

[1]王桂荣,王源超,杨光富,等. 农业病虫害绿色防控基础的前沿科学问题[J]. 中国科学基金,2020,34(4):374-380.

[2]王景凤. 农作物科学种植及病虫害防治技术[J]. 农业灾害研究,2021,11(8):166-167.

[3]张 珂,冯晓晗,郭玉荣,等. 图像分类的深度卷积神经网络模型综述[J]. 中国图象图形学报,2021,26(10):2305-2325.

[4]季长清,高志勇,秦 静,等. 基于卷积神经网络的图像分类算法综述[J]. 计算机应用,2022,42(4):1044-1049.

[5]陈 超,齐 峰.卷积神经网络的发展及其在计算机视觉领域中的应用综述[J]. 计算机科学,2019,46(3):63-73.

[6]李书琴,陈 聪,朱 彤,等. 基于轻量级残差网络的植物叶片病害识别[J]. 农业机械学报,2022,53(3):243-250.

[7]Too E C,Li Y J,Njuki S,et al. A comparative study of fine-tuning deep learning models for plant disease identification[J]. Computers and Electronics in Agriculture,2019,161:272-279.

[8]Simonyan K,Zisserman A.Very deep convolutional networks for large-scale image recognition[EB/OL]. (2014-09-14)[2022-10-05]. https://arxiv.org/abs/1409.1556.

[9]He K M,Zhang X Y,Ren S Q,et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Las Vegas:IEEE,2016:770-778.

[10]Huang G,Liu Z,van der Maaten L,et al. Densely connected convolutional networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu:IEEE,2017:2261-2269.

[11]Xie S N,Girshick R,Dollár P,et al. Aggregated residual transformations for deep neural networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu:IEEE,2017:5987-5995.

[12]侯志松,冀金泉,李國厚,等. 集成学习与迁移学习的作物病害图像识别算法[J]. 中国科技论文,2021,16(7):708-714.

[13]Hou Q B,Zhou D Q,Feng J S.Coordinate attention for efficient mobile network design[C]//2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Nashville:IEEE,2021:13708-13717.

[14]Lai S W,Xu L H,Liu K,et al. Recurrent convolutional neural networks for text classification[C]//Proceedings of the Twenty-Ninth AAAI Conference on Artificial Intelligence. New York:ACM,2015:2267-2273.

[15]Berge C. Graphs and hypergraphs[M]. Amsterdam:North-Holland Pub.Co.,1973.

[16]Berge C. Hypergraphs:combinatorics of finite sets[M]. Amsterdam:North-Holland,1989.

[17]黄汝激. 超网络的有向k超树分析法[J]. 电子科学学刊,1987,9(3):244-255.

[18]Feng Y F,You H X,Zhang Z Z,et al. Hypergraph neural networks[C]//Proceedings of the AAAI Conference on Artificial Intelligence,2019:3558-3565.

[19]Guo B,Zhang C X,Liu J M,et al. Improving text classification with weighted word embeddings via a multi-channel TextCNN model[J]. Neurocomputing,2019,363:366-374.

[20]Amajd M,Kaimuldenov Z,Voronkov I. Text classification with deep neural networks[C]//International Conference on Actual Problems of System and Software Engineering (APSSE). 2017:364-370.

[21]Yang Z C,Yang D Y,Dyer C,et al. Hierarchical attention networks for document classification[C]//Proceedings of the 2016 Conference of the North American Chapter of the Association for Computational Linguistics:Human Language Technologies.San Diego:Association for Computational Linguistics,2016:1480-1489.