基于BCE-YOLOv5的苹果叶部病害检测方法

2023-09-11曾晏林贺壹婷蔺瑶费加杰黎强杨毅

曾晏林 贺壹婷 蔺瑶 费加杰 黎强 杨毅

摘要:针对自然环境中,人工目视解译苹果叶部病害耗时耗力、人为主观因素强的问题。本研究提出了一种融合自注意力机制和Transformer模块的目标检测算法——BCE-YOLOv5,实现对自然环境下对苹果叶片病虫害的自动识别与检测。该算法首先使用BotNet、ConvNeXt模块分别替换Backbone网络和Neck网络的CSP结构,增加自注意力机制对目标的特征提取能力。通过将改进的CBAM引入YOLOv5的特征融合网络之后,使注意力机制对特征融合信息更加地关注。最后,用α-IoU损失函数替换IoU损失函数,使得网络在模型训练过程中收敛的更加稳定。BCE-YOLOv5算法在传统算法YOLOv5基础上平均精准率均值提升了2.9百分点,并且改进后的算法的模型大小和计算量较传统算法分别减小了0.2 M和0.9 GFLOPs。平均精度均值比YOLOv4s、YOLOv6s、YOLOx-s和YOLOv7模型分别高2.5、1.3、3.5、2.2百分点。该方法能快速准确识别苹果叶部病害,为苹果种植过程中提供智能化管理做参考。

关键词:苹果;叶片病害;识别;注意力机制;YOLOv5;BotNet;ConvNeXt;CBAM;α-IoU

中图分类号:TP391.41 文献标志码:A

文章编号:1002-1302(2023)15-0155-09

基金项目:云南省重大科技专项(编号:202002AE09001002)。

作者简介:曾晏林(1993—),男,四川广安人,硕士研究生,主要从事计算机视觉方面研究。E-mail:786823791@qq.com。

通信作者:杨 毅,教授,主要从事农业信息化方面研究。E-mail:yyang66@126.com。

苹果种植在我国已有2 000多年的发展历程,目前栽培面积正逐渐增加。在国家宏观经济政策的扶持下,中国传统苹果行业正逐渐地向现代化方向发展,我国已逐步发展为全球的苹果行业强国。但同时,在苹果栽培行业高速发展的背后,虫害防控问题始终是困惑果农的主要难点所在。

随着深度学习的崛起和计算机计算能力的增强,采用智慧农业物联网系统对农作物病虫害进行智能诊断,不仅省时省力,而且科学精准,从动态采集农作物的病虫害信息,到精准识别,提出有针对性的防治决策,全过程基本实现自动化、科学化,降低农业成本。

近年来,国内外学者提出许多基于传统机器学习算法来解决针对苹果叶部病害的识别。刘斌等研究了在移动端建立苹果叶部病虫害轻量级识别模型[1];龙满生等利用改进的Alex Net网络对棉花叶部病虫害进行识别[2];于洪涛等提出的VGG-F采用学习率的动态调整实现苹果病害的识别,该方法在复杂情况下识别准确率较差[3];王云露等基于Faster R-CNN 对苹果叶部病害进行识别,其算法时间效率不高[4];田靓靓等利用SSD网络对苹果叶片病害进行检测[5];Di等建立了基于改进卷积神经网络的苹果叶部病害检测方法[6];Tian等基于YOLOv3深度学习方法对果园苹果病斑进行检测[7-8];Li等利用YOLOv5对苹果早期叶部病害在移动终端进行识别[9];Wang等通过改进YOLOv5对苹果病害的精度和检测速度来提高识别率[10-12];晁晓菲等基于轻量级改进的YOLO对苹果叶部病害进行检测[13-14];在轻量级检测上Polder等在深度学习上利用智能相机进行苹果和葡萄的早期病害检测[15];Liu等基于深度卷积神经网络对苹果叶部病害进行识别[16]。虽然上述算法对苹果病害的检测过程做了一定优化,但是在检测能力方面仍舊存在不足,例如检测速度较慢、检测条件要求较高等问题。在基准模型YOLOv5的基础上,本研究提出一种基于YOLOv5的目标检测算法——BCE-YOLOv5。针对苹果叶片的病害检测任务,为了提高对苹果叶片病害检测精度和检测速率,以当前发现较严重的病害(斑叶病、灰斑病、铁锈病)为研究对象。

1 YOLOv5算法简述

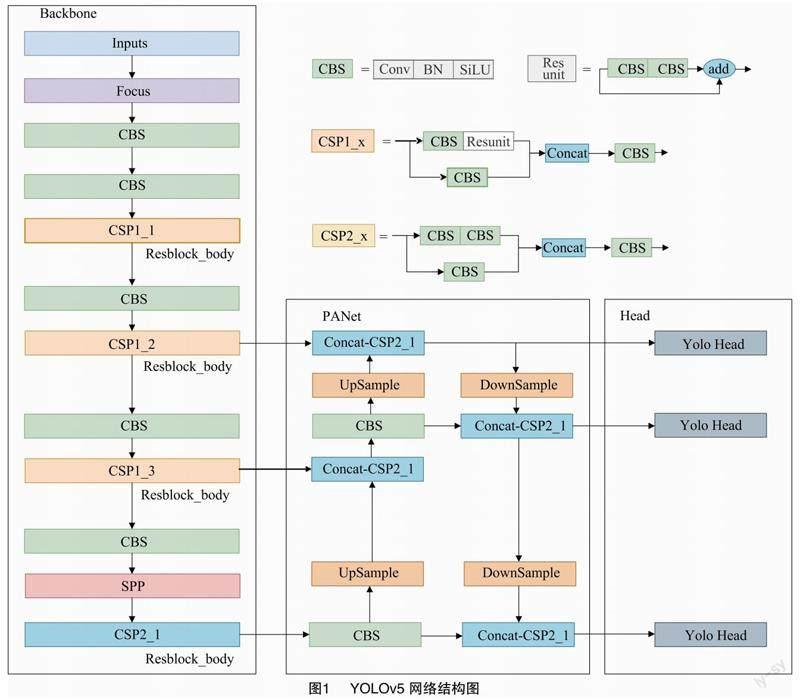

YOLOv5结构由4个部分组成,分别为输入端、骨干网络部分、多尺度特征融合部分、预测端,其网络结构如图1所示。

在输入端,YOLOv5可以通过Mosaic、自适应锚框算法、自适应图像压缩等信号增强手段,对输入信号进行预处理。Mosaic数据增强技术通过对多张数据以随机压缩、随机编辑、随机排布等的方法重新拼接到一起,使之进一步丰富了数据的样本,同时提高了系统的泛化性能。YOLOv5默认使用3个锚框对应检测不同大小的目,其锚框的参数范围为[10,13,16,30,33,23][30,61,62,45,59,119][116,90,156,198,373,326]分别对应尺度为80×80、40×40、20×20的特征图,自适应锚框是预测框值与实际框值之差,并利用数据迭代方法获得最佳的锚框值。而自适应图像压缩则是将数据集中在各个尺寸的特征图像,统一缩至相应的尺寸。

骨干网络(Backbone)由切片结构Focus、卷积模块CBS、瓶颈层CSP(cross stage partial network)模块以及空间金字塔池化(spatial pyramid pooling,SPP)组成。Focus模块采用隔列切片操作,把高分辨率特征图拆分成多个低分辨率的特征图,然后再拼接在一起。CBS基本模块由Conv2d+Batch Normalization+SiLu组成。CSP残差结构可以增加深层网络中层间反向传播的梯度值,避免了深层网络导致的梯度消失,加快了推理速度。SPP模块采用一个卷积层和3个多尺度最大池化进行多尺度融合。

多尺度特征融合(Neck)主要使用自上而下增强语义特征提取的特征金字塔网络(feature pyramid networks,FPN)结构,使用自底向上增强定位特征的路径聚合网络(path aggregation network,PAN)结构,实现不同尺寸目标特征信息的融合,解决了多尺度问题。

预测端头部网络(Head)采用3种损失函数分别计算分类、定位和置信度损失,通过非极大抑制(non maximum suppression,NMS)去除检测框重叠并提高多目标的检测能力。

2 YOLOv5算法改进

2.1 改进策略

植物叶片病虫害检测任务中容易存在背景干扰,待检测病斑被遮挡、尺寸小等问题。本研究在YOLOv5模型的基础上提出4点改进,首先改进骨干网络Backbone部分,使用改进后的SPPF替换原有的SPP层,并用BoTNet[17]结构替换相应的CSP结构,增加有效信息与位置感知关联。再引入改进的卷积块注意力模块(convolution block attention module,CBAM)提高了神经网络识别特征区域的能力,并选择有效的位置添加到 YOLOv5 网络中,使模型更加精准地定位和识别感兴趣的目标特征。再次用ConvNeXt[18-19]结构对Neck中的特征金字塔部分的CSPLayer层进行改进,增加对语义特征的提取能力,提高特征提取的精准度;最后在预测部分改进损失函数,用α-IoU替换现有的IoU损失计算方式。本研究改进的网络模型BCE-YOLOv5的结构如图2所示。

2.2 SPP结构替换

空间金字塔池化能将任意大小的图片转换成网络需要的固定大小特征向量,减少对候选区域的重复卷积计算,减少计算冗余。SPP的结构首先经过一个卷积再分别经过3个不同大小的最大池化后再做拼接,最后再经过一个卷积,這能够在一定程度上解决目标多尺度的问题。其结构如图3所示。

通过把SPP换成了SPPF,其作用是一样的,但后者效率更高。SPP需要指定3个最大池化(maxpool),池化核大小分别为5×5、9×9、13×13,而SPPF只需要指定3个大小为5×5的maxpool。

在结构上串行2个5×5大小的maxpool层和一个 9×9 大小的maxpool层计算结果是一样的,同样的串行3个maxpool层和一个13×13大小的maxpool层计算结果是一样的。但是SPPF在计算量上要比SPP小,并且效率上比SPP要更快。其结构如图4所示。

2.3 BoTNet结构

BotNet结构是一种基于Transformer的网络结构,它利用了卷积和自注意力的混合网络,以提升模型的性能,BotNet如图5所示。通过结合CNN+Transformer[20-21]的组合方式提出一种Bottleneck Transformer来代替ResNet Bottleneck,即仅在ResNet框架的最后3个bottleneck blocks中使用全局多头自注意力(multi-head selfattention,MHSA)替换3×3空间卷积。

MHSA层利用全局注意力对特征图中的信息进行捕获,增加全局特征之间的联系,可以有效地处理大图像,通过卷积进行空间下采样,让注意力能在小分辨率图像上获取特征信息。在MHSA模块中对Q(查询向量)、K(键向量)、V(值向量)进行自注意力变换,对过程重复h次(h为MHSA的头数)的结果进行拼接,最后进行线性变换得到MHSA模块的最终输出。

在YOLOv5的整体改进中,在最后一个阶段中的3个BottleNeck使用了MHSA模块,因为自注意力机制在训练过程中需要消耗巨大的计算量,而在Backbone的最后CSP模块加入的时候特征图的大小较小,从而可以使得整个网络的计算量减少。

2.4 注意力机制

在输入的病虫害叶片图像中,除了叶片的病斑,经常还伴有噪音,随着卷积的深度增加会产生大量的冗余信息,从而丢失部分有用信息,导致目标检测精度降低。为此,本研究提出了一种改进的CBAM[22],并选择有效的网络位置添加到YOLOv5网络中,这使得网络能够更准确地定位和识别感兴趣的区域。

CBAM 是一种即插即用并且使用方便的注意力机制,其由通道域和空间域组成。通道域关注不同通道上特征点的权重,利用权重对不同通道进行乘法运算,以增强网络对关键通道域的注意力。首先,特征图进入通道域,然后在宽度和高度上进行全局最大池化(global max pooling,GAP)和全局平均池化(global average pooling,GMP),并使用多层感知器(multi-layer perception,MLP)计算不同通道的注意力权重,接下来使用 Sigmoid 函数对这些权重进行归一化处理,最后通过每个通道的权重乘以原始输入特征图,以获得更准确的结果。

具体公式如下所示。

在公式(1)中,Fcavg和Fcmax分别表示平均池化和最大池化后的特征图,σ是 Sigmoid 激活函数,W1和W2表示2层全连接层的权重。

根据公式(1)得到的感兴趣的通道特征Mc与原始图像特征相乘,并送至空间域模块。空间域模块关注的是目标特征在图像上的位置信息,并将空间特征做对应的变换,从而将关键信息提取出来。通道注意特征Mc与原图像特征F相乘,得到一个新的特征图Fs,公式如下所示。

空间域经过全局最大池化和全局平均池化,得到新的特征图Fs的宽度和高度,使特征维度从H×W转化为1×1,然后通过卷积核进行7×7卷积,再通过Sigmoid激活函数进行归一化,最后与通道注意力输出特征图进行合并,公式如下所示。

在公式(3)中,f7×7表示7×7的卷积层。

通过公式(2)的Fs和公式(3)的Ms做乘积运算,再与原图像特征图F相加,经过ReLU激活函数,得到特征图MF,公式如下所示。

式中:表示特征合并操作;表示逐元素相乘;σ表示激活函数。

上述CBAM中的通道域采用全连接层,压缩通道特征的空间维度以降低模型的复杂性,通道特征被映射到一个较低维度的空间并再次映射。在降维中不可避免地导致一些通道域的感兴趣区域信息丢失,对于复杂的特征图,不可能获得完整的特征信息。因此,为了减少上述通道域感兴趣信息的丢失,以及提高病变识别网络检测的准确性,本研究引入改进的CBAM,其中原通道域使用改进通道注意力网络(efficient channel attention network,ECA-Net)进行替换,保留原空间域。

ECA-Net[23-24]模块使用一种不降维的局部跨通道交互策略,有效避免了降维对于通道注意力学习效果的影响。对每个特征图求均值,从一个H×W×C变成1×1×C,通过大小为K的一维卷积来有效实现,其中卷积核大小为K代表了局部跨信道交互的覆盖率。通过公式调整K值大小,公式如下所示。

在公式(5)中:C表示通道数;b设置为1;γ设置为2;|t|odd表示t的最接近奇数。

本研究通过把ECA-Net模块里面原图像特征图与经过Sigmoid函数处理的特征图的乘积处理去掉,得到新的ECA-Net应用于CBAM中的通道域,改进后的CBAM[25]结构图如图6所示。

2.5 ConvNeXt结构

ConvNeXt结构于2022年被提出,该网络结合了近年来卷积神经网络方面提出的各项主要改进,并将其融合[18]。ConvNeXt网络结构如图7所示,卷积块的输入数据为通道数维度(dim)的特征图。首先经过卷积块大小为7×7的深度卷积层,随后通过LN层进行归一化后再经过卷积块大小为 1×1 的卷积层,得到通道数变为原输入通道的4倍。再经过GELU激活函数赋予非线性,在此之后经过卷积块大小为1×1输出通道变回原来的维度。最后输入数据和输出数据通过一个残差连接进行拼接,得到最终的结果。

在深度卷积神经网络中,图像的语义信息得到了增强,但随着图像的不断卷积,详细的特征被减少。相反,浅层的图像细节表现能力强,但是语義信息表达较弱。YOLOv5 采用的特征金字塔结构来进行特征融合,FPN 结构是自顶向下传递高层图像的语义信息,但是在传递过程中会丢失位置细节信息。为使网络更加适合不同大小的病斑检测,在网络Neck部分原有的CSP结构上进行改进,替换CSPLayer层并使用ConvNeXt层。

2.6 改进损失函数

传统的YOLOv5采用LossGIoU作为回归损失的损失函数,当实际框与预测框水平或竖直重合或2个框为包含关系时,此时GIoU值相同,无法区分相对位置关系,从而LossGIoU退化成LossIoU,而LossIoU不能解决实际框与预测框不重合的问题。

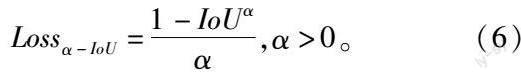

为了解决这个问题,本研究引入Lossα-IoU用于改进原损失函数[26],Lossα-IoU在保留原损失函数的性质时,同时可以更好地关注目标,提高了检测框回归的准确性。Lossα-IoU在原有的LossIoU上加上一个幂指数,以α为幂,其公式如下所示。

在不增加额外的参数和训练时间下,通过对 α-IoU 中的参数α进行调制,可以很容易地扩展到更复杂的具有多个IoU或惩罚项的损失函数。

本研究采用效果较好的LossCIoU改进为Lossα-CIoU,其公式如下所示。

公式(7)中:b、bgt分别表示预测框和真实框的中心线距离;ρ2α代表的是在2个中心点之间的欧式间隔;c是能容纳预测框和真实框的最小封闭区间的对角线长度;表示目标框的宽高比;表示预测框各自的宽高比。

3 试验与分析

3.1 试验数据集

苹果叶部病虫害收集了云南省昭通市邵阳区守望乡苹果种植和百度飞浆公开数据集共5 106张图片,共分为3类常见病害:斑点落叶病(alternaria boltch)、灰斑病(grey_spot)、锈病(rust)作为试验数据集,图8是部分数据集图像,其中有较大的病斑图像,有较小的病斑,还有阴影的病斑。

3.2 预训练

本研究训练使用的操作系统为Windows 10,CPU 型号为AMD Ryzen7 5800H,GPU型号为RTX 3060,深度学习框架为Pytorch 1.10.0以及CUDA 11.4版本框架。由于试验数据的样本数量不多,因此在训练过程中采用迁移学习策略来解决数据匮乏的问题,利用YOLOv5官方提供的预训练权重作为训练初始化参数。

3.3 评价标准

在目标检测领域,评价网络性能的指标是平均精准率均值(mean average precision,mAP)、模型大小以及计算量(GFLOPS)。mAP评价指标是对精准率(precision,P)、召回率(recall,R)的综合考量,可以评估模型的有效性。

精准率是指正确被预测为某类病斑目标占全部预测为该类正确病斑目标的比例,召回率是指正确被预测为某类病斑目标占实际上全部为该类病斑目标的比例。

模型大小能够表明模型对硬件内存的需求,对于外界复杂环境且硬件设备受限的情况下则需要轻量级模型;计算量反映了模型对硬件设备的计算单元的要求,同样对于硬件设备受限的情况下,计算量越小越好。

3.4 结果与对比

为了直观地体现改进后的YOLOv5算法的有效性,如图9所示,通过对比4组图片,分别使用传统的YOLOv5s和本研究改进的BCE-YOLOv5算法对测试图片进行检测,从对比图可以看出传统的YOLOv5检测的精度普遍较低,而改进后的YOLOv5检测精度有所提升。通过第3组对比图片可以看出,传统的YOLOv5存在漏检,而改进后的算法对叶片灰斑病细节更加注重,改善了对背景模糊的漏检。通过第4组对比图片可知,在大图片小目标叶片背景下病斑难以区分的情况下,传统的YOLOv5存在错检,而改进后的算法具有较好的识别能力。

3.5 消融试验

为了检验本研究中改进后的CBAM是否对训练有效,试验在YOLOv5颈部网络Neck后分别引入原始ECA注意力模块、原始CBAM以及改进后的CBAM,本研究将改进的CBAM表示为ECBAM。其试验对比结果如表1所示,在YOLOv5传统算法的相同位置上引入注意力机制其mAP均有提升,其中ECA和CBAM注意力模块分别贡献了0.2百分点和1.6百分点的提升,而ECBAM提升了1.8百分点。这表明改进后的ECBAM在通道域上不压缩感兴趣特征,而是对通道域进行全局池化然后再进行一维卷积,从而有效避免降维带来的通道特征丢失,提高ECBAM在聚合网络中的整体能力。结果显示,改进后的ECBAM能够有效提升网络性能。

为了验证本研究提出的改进模型的有效性,在训练参数和数据集相同的情况下对改进的YOLOv5网络进行对比试验,结果如表2所示,表中Backbone改进、Neck改进、CBAM改进分别表示在传统YOLOv5网络中加入改进方案。由表2可以分析得到,首先采用改进的Backbone后为模型提升了1.4百分点,这使得模型检测的准确性更高,并在一定程度上缓解了由于背景复杂的模糊图像造成的漏检或误检问题;其次,加入CBAM后,模型比基准mAP提升了2.5百分点,说明添加CBAM模块可以使网络更加注意病斑,使得整个模型的性能提升;再在原CBAM基础之上加以改进,得到新的注意力机制ECBAM,在模型中加入ECBAM后获得比原CBAM提升了0.4百分点,由此可以看出改进后的注意力机制较原注意力机制更能注重小目标;使用上述改进方法最终为模型的mAP比基线模型性能提高了2.9百分点的增益,证明了3种改进方法的有效性。

同时,图10清楚地显示了YOLOv5的学习过程中损失曲线在改进前后的变化。其中α-CIoU损失曲线在GIoU损失曲线的下方,说明α-CIoU损失值更低,同时在出现拐点之后α-CIoU损失值在10个Epoch后趋于平稳,而GIoU损失曲线在85个 Epoch后和α-CIoU曲线基本重合,说明α-CIoU损失在整个训练过程中网络可以更快、更平稳地收敛。

3.6 对比试验

对比本研究BCE-YOLOv5目标检测算法相比其他算法的优越性,本研究与各种先进的目标检测算法(YOLOv4s[27] 、YOLOxs[28]、YOLOv6s[29]、YOLOv7s[30])进行对比试验。由表3可以看出,改进后的YOLOv5s算法在检测精度上达到92.1%,优于其他算法,比YOLOv4s、YOLOxs、YOLOv6s和YOLOv7s分别高出2.5、3.5、1.3、2.2百分点;BCE-YOLOv5模型大小分别比其低230.5、58.3、24.6、61.3 M;在计算量上BCE-YOLOv5相比YOLOv5s、YOLOxs、YOLOv6s和YOLOv7s算法分别低0.9、29.0、11.7、88.3 GFLOPs。本研究改进的BCE-YOLOv5算法在模型大小、检测精度及计算量上均优于其他类算法,证明其改进算法的有效性。说明本研究的 BCE-YOLOv5 算法适合后续在边缘设备部署。

4 结论

针对苹果叶部病虫害检测的识别任务,本研究提出一种基于YOLOv5改进模型的苹果叶检测方法。首先将BotNet和ConvNeXt分别与原始YOLOv5的骨干網络和特征融合网络融合,利用Transformer的上下文理解能力,提高网络对图像特征的识别;其次使用CBAM注意力机制引入到YOLOv5多尺度特征融合模块之后,能够有效的提升对目标的检测精度;最后使用α-IoU损失函数代替原来的损失函数,使网络可以更快、更平稳地收敛,并改善了复杂图像的漏检和小目标识别效果差的问题。在消融试验对比中,本研究改进的 BCE-YOLOv5 与原 YOLOv5相比,其mAP提高了2.9百分点,具有较高的精准率。本研究改进的BCE-YOLOv5网络模型具有检测速度快、检测准确率高、计算量和模型小等特点。

为了达到推广应用的效果,今后还需开展以下研究:(1)加大对苹果叶部病害分类的研究;(2)进一步扩充数据,增加病害数据以及种类;(3)进一步优化模型,提高模型的训练效果在复杂背景下的识别水平;(4)研究在不同阶段对苹果叶部病害的识别能力,从而提高模型的泛化能力。

参考文献:

[1]刘 斌,贾润昌,朱先语,等. 面向移动端的苹果叶部病虫害轻量级识别模型[J]. 农业工程学报,2022,38(6):130-139.

[2]龙满生,欧阳春娟,刘 欢,等. 基于卷积神经网络与迁移学习的油茶病害图像识别[J]. 农业工程学报,2018,34(18):194-201.

[3]于洪涛,袁明新,王 琪,等. 基于VGG-F动态学习模型的苹果病虫害识别[J]. 科学技术与工程,2019,19(32):249-253.

[4]王云露,吴杰芳,兰 鹏,等. 基于改进Faster R-CNN的苹果叶部病害识别方法[J]. 林业工程学报,2022,7(1):153-159.

[5]田靓靓. 基于SSD网络的苹果叶片病害检测方法研究[D]. 杨凌:西北农林科技大学,2022.

[6]Di J,Li Q. A method of detecting apple leaf diseases based on improved convolutional neural network[J]. PLoS One,2022,17(2):e0262629.

[7]Tian Y,Yang G,Wang Z,et al. Detection of apple lesions in orchards based on deep learning methods of cyclegan and yolov3-dense[J]. Journal of Sensors,2019,2019.

[8]Mathew M P,Mahesh T Y. Determining the region of apple leaf affected by disease using YOLO V3[C]//2021 International Conference on Communication,Control and Information Sciences (ICCISc). IduKKi,India,2021:1-4.

[9]Li J,Zhu X,Jia R,et al. Apple-YOLO:a novel mobile terminal detector based on YOLOv5 for early apple leaf diseases[C]//2022 IEEE 46th Annual Computers,Software,and Applications Conference (COMPSAC). Los Alamitos,CA,USA,2022:352-361.

[10]Wang Y L,Sun F G,Wang Z J,et al. Apple leaf disease identification method based on improved YoloV5[M]//Sun J D,Wang Y,Huo M Y,et al. Signal and information processing,networking and computers. Singapore:Springer,2023:1246-1252.

[11]Kuznetsova A,Maleva T,Soloviev V. YOLOv5 versus YOLOv3 for apple detection[M]//Kravets A G,Bolshakov A A,Shcherbakov M.Cyber-physical systems:modelling and intelligent control. Cham:Springer,2021:349-358.

[12]Chen Z,Wu R,Lin Y,et al. Plant disease recognition model based on improved YOLOv5[J]. Agronomy,2022,12(2):365.

[13]晁曉菲,池敬柯,张继伟,等. 基于PSA-YOLO网络的苹果叶片病斑检测[J]. 农业机械学报,2022,53(8):329-336.

[14]邸 洁,曲建华.基于Tiny-YOLO的苹果叶部病害检测[J]. 山东师范大学学报(自然科学版),2020,35(1):78-83.

[15]Polder G,Blok P M,van Daalen J T,et al. Early disease detection in apple and grape using deep learning on a smart-camera[C]//Proceedings of the European Conference on Agricultural Engineering. EurAgEng,Cranfield,2021:51-56.

[16]Liu B,Zhang Y,He D J,et al. Identification of apple leaf diseases based on deep convolutional neural networks[J]. Symmetry,2017,10(1):11.

[17]Srinivas A,Lin T Y,Parmar N,et al. Bottleneck transformers for visual recognition[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. Kuala Lumpur,2021:16519-16529.

[18]Liu Z,Mao H Z,Wu C Y,et al. A convnet for the 2020s[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. New Orleans,2022:11976-11986.

[19]黄文博,黄钰翔,姚 远,等. 融合注意力的ConvNeXt视网膜病变自动分级[J]. 光学精密工程,2022,30(17):2147-2154.

[20]Zhang Z,Lu X,Cao G,et al. ViT-YOLO:Transformer-based YOLO for object detection[C]//Proceedings of the IEEE/CVF International Conference on Computer Vision. 2021:2799-2808.

[21]Liu Y,He G,Wang Z,et al. NRT-YOLO:Improved YOLOv5 based on nested residual transformer for tiny remote sensing object detection[J]. Sensors,2022,22(13):4953.

[22]Woo S,Park J,Lee J Y,et al. Cbam:Convolutional block attention module[C]//Proceedings of the European Conference on Computer Vision (ECCV). Munich,2018:3-19.

[23]Wang Q L,Wu B G,Zhu P F,et al. Eca-net:Efficient channel attention for deep convolutional neural networks[C]//2020 IEEE Conference on Computer Vision and Pattern Recognition. Seattle,2020.

[24]Wang Q,Wu B,Zhu P,et al. Supplementary material for ‘ECA-Net:efficient channel attention for deep convolutional neural networks[C]//Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition,IEEE,Seattle,WA,USA. 2020:13-19.

[25]Li X,Xia H,Lu L. ECA-CBAM:Classification of diabetic retinopathy:classification of diabetic retinopathy by cross-combined attention mechanism[C]//2022 the 6th International Conference on Innovation in Artificial Intelligence (ICIAI). 2022:78-82.

[26]He J B,Erfani S M,Ma X J,et al. Alpha -IoU:a family of power intersection over union losses for bounding box regression[J]. Advances in Neural Information Processing Systems,2021,34:20230-20242.

[27]Bochkovskiy A,Wang C Y,Liao H Y M. Yolov4:Optimal speed and accuracy of object detection[EB/OL]. [2022-12-12].https://arxiv.org/abs/2004.10934.

[28]Ge Z,Liu S T,Wang F,et al. Yolox:Exceeding yolo series in 2021[EB/OL]. [2022-12-12]. https://arxiv.org/abs/2107.08430.

[29]Li C,Li L,Jiang H,et al. YOLOv6:A single-stage object detection framework for industrial applications[EB/OL]. [2022-12-12].https://https://arxiv.org/abs/2209.02976.

[30]Wang C Y,Bochkovskiy A,Liao H Y M. YOLOv7:Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[EB/OL]. [2022-12-12]. http://arXiv.ORG/ABS/2207.02696.