基于多深度对抗网络的ROV水下目标检测

2023-04-13陆地陈伟魏庆宇

陆地 陈伟 魏庆宇

摘 要: 有缆水下机器人ROV是水下工程作业的重要工具,但由于不同水质特性及水中散射折射的影响,ROV水下图像普遍存在失真模糊、分辨率低等问题。为此构建深度分离可变形卷积代替原始卷积,采用高效表达稀疏性的特征提取结构实现对ROV水下目标的特征提取;再运用多深度机制的改进GAN网络生成器和类似马尔可夫架构的判别器建立数据集,增强水下图像;最后构建多项损失函数,提升网络的泛化性能并实现对ROV目标的快速检测。水下实验结果表明,该水下图像增强方法提高了ROV目标检测精度,符合预期要求。

关键词: 图像增强; 深度分离可变形; 多深度机制; 深度学习

中图分类号:TP242.6 文献标识码:A 文章编号:1006-8228(2023)04-05-06

Abstract: The cabled underwater robot ROV is an important tool for underwater engineering operations, but due to different water quality characteristics and the influence of scattered refraction in water, ROV underwater images generally have problems such as distortion blur and low resolution. To this end, depthwise separable and deformable convolution is constructed instead of the original convolution, and the feature extraction structure that efficiently expresses the sparsity is used to achieve feature extraction of the ROV underwater target. Then the improved GAN network generator with multi-depth mechanism and the discriminator similar to the Markov architecture are used to establish the data set to enhance the underwater image. Finally, a number of loss functions are constructed to improve the generalization performance of the network and realize the rapid detection of the ROV target. The results of underwater experiments show that the proposed ROV underwater image enhancement method improves the accuracy of ROV target detection, and meets the expected requirements.

Key words: image enhancement; depthwise separable and deformable; multi-depth mechanism; deep learning

0 引言

有缆水下机器人(Remotely operated submersible,ROV)广泛应用于渔业、军事、水下工程等领域。ROV作为水下探索的重要装备,具有稳定性高,安全可靠等优势,可以代替潜水员进行水下危险作业[1-2]。水下目标检测能力是衡量ROV的重要指标,然而由于水体环境复杂以及水下光的散射、折射现象,严重影响了ROV作业能力,因此ROV水下图像增强方法研究是开发ROV的必要前提[3-5]。

目前,国内外水下机器人图像处理一般采用图像增强和图像恢复的方法。但是不同波长的光在水中衰减速率不同,会让水下图像产生不同程度的失真[6-8]。水中颗粒物的散射会使图像产生模糊“雾化”现象,而深水处的弱光性也会使水下图像对比度将低,这严重影响了水下圖像的真实性[9-11]。然而传统的水下图像处理方法往往达不到预期效果。

针对ROV在不同水环境的目标检测,可采用不同的水下图像增强方法。例如针对水下图像纹理细节发散,光照不均匀/失真、图像对比度低相关问题,Peng[12]等提出了一种水下图像光学成像自适应优化算法,能有效恢复水下图像结构,但算法较复杂,实时性不够好。Dong[13]提出SRCNN算法,用低分辨率的卷积神经网络(CNN)输入,重建算法映射函数解决超分辨率重建问题,得到了高分辨率输出。此后基于CNN网络的图像超分辨重建取得了重大进展,卷积神经网络残差模块和生成对抗网络的模型相继被提出[14-15]。也有些用于特定条件下的特定的图像复原算法,这些算法可以在特定的场景下对图像复原起到不错的效果,不过局限性稍差。Liu等提出一种锚定邻域回归和CNN相结合的图像重建方法[16-17],重建效果得到了进一步改善,其算法特别针对有效特征选取,提高了测试结果的准确度,但这些水下图像增强方法在颜色校正方面还有待提升。Gao[18]等提出了一种有效生成对抗网络模型,该网络模型可以实时增强水下图像。但是增强后的水下图像会使颜色失真。

本文以实际ROV系统视觉感知为背景,基于深度学习,研究适合水下作业环境的ROV目标检测方法。针对现有ROV水下图像处理方法所存在的不足,提出一种基于可变形卷积对GAN(对抗网络)改进,将深度分离卷积与可变形卷积相融合,并且在生成器网络中提出一种新的特征提取模块,利用生成网络学习退化水下图像与清晰水下图像间的映射关系,结合了残差学习模块多深度提取有效特征值,对图像偏色来校正,恢复图像轮廓细节,判别对抗损失函数,保留地面真实情况的图像特征;使用频谱归一化稳定判别器的训练,快速并入GAN训练中,进而提高主观和客观视觉感受指标,最终通过建立数据集在真实水下环境对ROV实验证明了该方法的有效性。

1 基于对抗网络的ROV水下目标检测

1.1 基于可变形卷积对网络的改进

ROV采集的水下图像上存在光斑映射与畸变发生,质量往往不高,原有目标检测方法在使用时,检测效果较差,目标召回率低,检测精度不高。传统卷积遵循卷积核按固定路线平移的规则,池化层中池化比例固定,当图像发生形变时,依然会机械的按照固定轨迹进行卷积运算,整个网络运行效率过低。可变形卷积为每个卷积核增加偏移变量,采样区域更贴近检测目标的轮廓[19-20]。学习过程如图1所示。首先根据输入图像数据信息,使用传统卷积核进行特征图提取。接着对特征图进行卷积操作,结果作为可变形卷积核偏移量。然后根据卷积核与偏移量进行卷积操作,此时,卷积核将根据偏移量进行可变形卷积操作。ROV在运行目标检测时,需要较高的实时性,处理后的视频帧数在30FPS以上才可满足水下目标实时检测的需求。可变形卷积的运用既增加网络对复杂环境的适应能力,提高目标检测准确性,又可以降低网络参数,加快网络运行速度。

1.2 特征提取结构

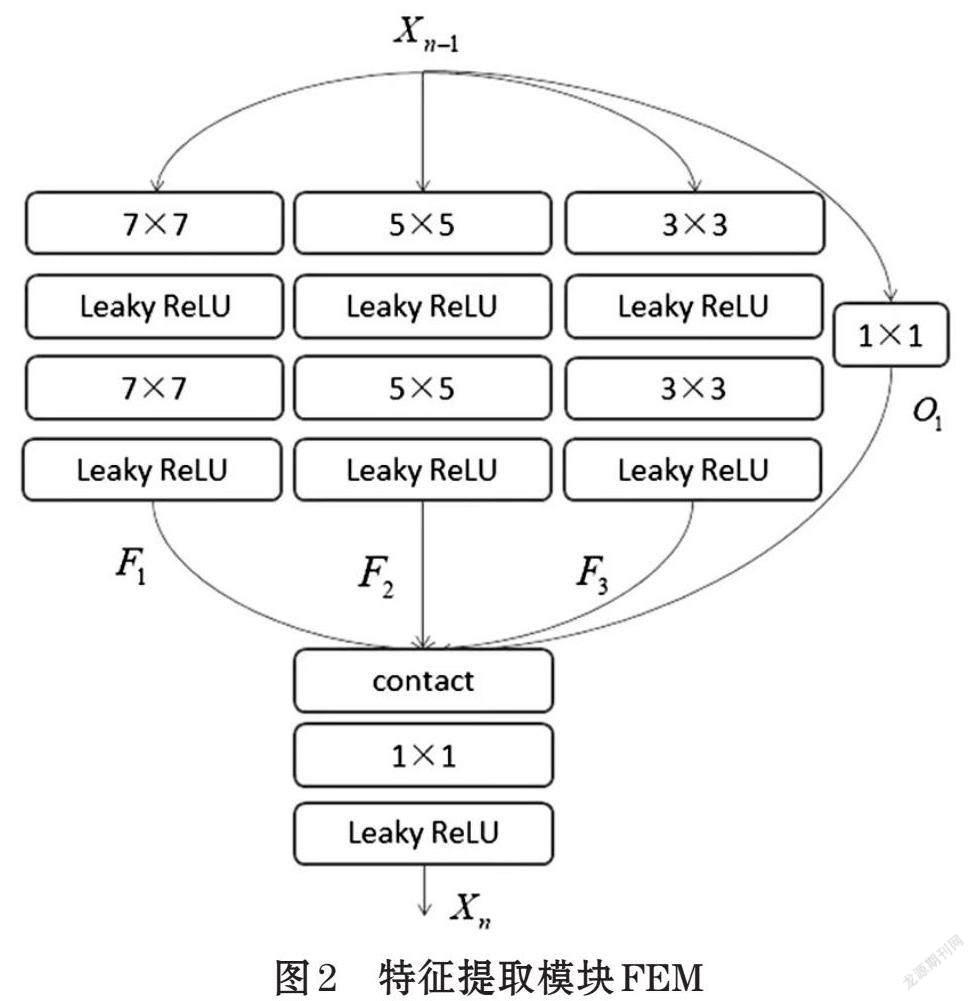

为解决复杂环境下ROV进行目标实时检测困难的问题。本文提出一种新的特征提取模块,利用不同大小卷积核实现不同尺度的特征提取。如图2所示。

该模块加入了跳跃连接,增强了信息的传递,是一种高效表达特征的稀疏性结构。充分利用图像特征,其上一层的输出可以直接为下一场的输入;三条中间路径的内核大小不同,以便检测不同比例的特征图;引入1×1卷积,促进了特征融合并提高了计算效率。其结构如图2所示,生成器模型负责生成图片及其网络结构前面两层编码部分(卷积层)。第一层由64个5×5大小的卷积核组成,第二层由128个3×3大小的卷积核组成。卷积层后面跟随了归一化BN层。卷积层后的LReLU(Leaky-ReLU) 激活函数使得输入映射到输出。FEM(Feature extraction module)可以通过前层结构获得富余特征。而图像重组部分则通过解码部分完成。用双曲正切函数Tanh来调配[-1,1]的传入部分,并通过反卷积层映射到输入通道数。

1.3 判别器网络结构

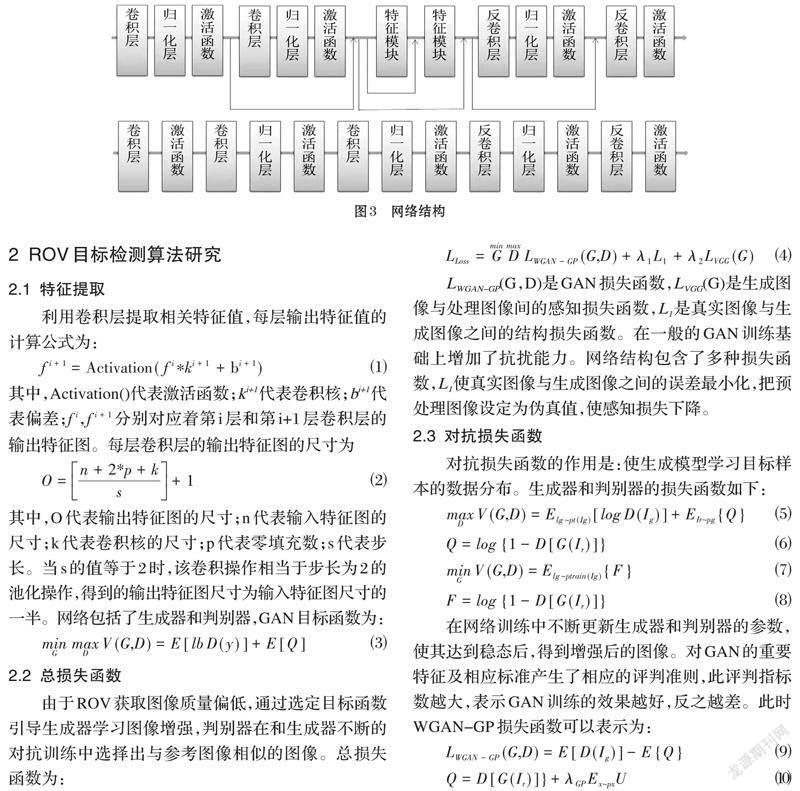

判别器包含五层,其结构是基于马尔科夫判别器的改进,第一层和最后一层没有使用BN,第二、三、四层使用BN[19-20]。即BN-LReLU结,网络结构如图3。判别器网络的输入是生成器生成的图像和参考图像,输出结果是16×16×1的补丁块。如果判别结果为1,则说明生成结果与真实图像相似。如果判别结果为0,则说明生成结果与真实图像存在差异。由于补丁块是与图像局部进行对比,所以减少了人为干扰。

对判别器进行频谱归一化操作,使数据指标之间具有可比性,由于判别器的利普希茨常数问题,使得判别器的训练稳定性较差。而该过程类似于向量的归一化操作,可以有效解决该问题。

2 ROV目标检测算法研究

2.1 特征提取

利用卷积层提取相关特征值,每层输出特征值的计算公式为:

其中,O代表输出特征图的尺寸;n代表输入特征图的尺寸;k代表卷积核的尺寸;p代表零填充数;s代表步长。当s的值等于2时,该卷积操作相当于步长为2的池化操作,得到的输出特征图尺寸为输入特征图尺寸的一半。网络包括了生成器和判别器,GAN目标函数为:

2.2 总损失函数

由于ROV获取图像质量偏低,通过选定目标函数引导生成器学习图像增强,判别器在和生成器不断的对抗训练中选择出与参考图像相似的图像。总损失函数为:

LWGAN-GP(G,D)是GAN损失函数,LVGG(G)是生成图像与处理图像间的感知损失函数,L1是真实图像与生成图像之间的结构损失函数。在一般的GAN训练基础上增加了抗扰能力。网络结构包含了多种损失函数,L1使真实图像与生成图像之间的误差最小化,把预处理图像设定为伪真值,使感知损失下降。

2.3 对抗损失函数

对抗损失函数的作用是:使生成模型学习目标样本的数据分布。生成器和判别器的损失函数如下:

在网络训练中不断更新生成器和判别器的参数,使其达到稳态后,得到增强后的图像。对GAN的重要特征及相应标准产生了相应的评判准则,此评判指标数越大,表示GAN训练的效果越好,反之越差。此时WGAN-GP损失函数可以表示为:

其中,[?x]为梯度,[λGP]为权重因子,[Ex~px]为样本分布,PX为生成数据与真实数据之间的点对直线样本。L1为绝对误差损失,即生成图像和真实图像之间的损失。L1损失对于异常值的抗扰能力较强,因此,引入L1损失,使生成图像和真实图像尽可能相似。其损失函数为:

3 实验与分析

3.1 ROV实验平台

设计开发的20kg级ROV系统由水下运动部分和水上控制平台两大部分组成,水下运动部分搭载一部1080p低照度摄像机,摄像头能见度达三米直接与工控机相连,实时获取水下及机体运行信息。水上控制平台搭载一台英伟达3080图像处理器。ROV系统实物如图4所示。

3.2 网络训练

⑴ 数据集建立

基于深度学习的水下目標检测网络需要使用数据集进行训练,因此需事先准备数据集进行模型的训练与测试。以海参、海胆和贝壳为水下目标检测典型来构建数据集。在URPC水产品数据集基础上,使用爬虫收集海参、海胆和贝壳图片,后期通过人工筛选,扩充数据集。准备的数据集共分为三部分,第一部分为URPC水产品数据集,第二部分为收集的水下目标陆地图像,第三部分为复原处理后的URPC水产品数据集图像,共9000张图,部分数据集如图5所示。多种环境下的水下目标图像,有利于增加水下目标检测模型鲁棒性,数据集中的8000张图片作为训练集,1000张图片作为测试集。使用图片标注工具LabelImge对每个图像中的海参、海胆与贝壳进行标注,生成xml文件,记录水下目标所在位置与类别名称等信息。

⑵ 訓练细节

训练过程中,首先在[-1,1]之间进行数据规范化处理。将用于进行实验的图像的大小为256×256×3。初始学习率为0.0001,我们使用λg= 10,λ1= 60和LReLU(斜率为0.2)。用Adam算法进行网络优化, Batch设置为16;使用TensorFlow架构在GTX 1080 Ti上完成了网络训练60个epoch。在生成器完成生成时,鉴别器将迭代五次。

3.3 水下图像复原处理实验

将改进的水下图像除水处理方法应用于水下图像数据集,得到的部分结果如图6所示,上方为URPC水产品数据集原始图像,下方为处理后的图像。处理后的水下数据集图像具有较好的观感,同时保留物理成像特征,后期可进行深度等信息提取。

ROV采集的原始图像经水下图像复原处理方法优化后,部分结果如图7所示,上方为采集的原始水下视频图像,下方为处理后的视频图像。优化后的视频图像具有更好的视觉效果,可以去除水下气泡杂质的干扰,增加对比度,还原图像颜色,降低操作人员观测水下环境图像难度。

由图6、图7可以看出,水下图像处理方法可以提高水下数据集和ROV采集的水下视频图像质量。扩充后的数据集可用于水下目标检测网络训练,可使用处理后的水下视频图像作为检测网络输入。同时,使用Xavier权重初始化方法,减少梯度消失问题,提升训练效率,保证训练成功率。

我们先后使用原始数据集与图像处理扩充后的数据集训练网络,检测结果如表1所示。由表1实验结果可知,在原始目标检测方法基础上增加水下图像复原处理方法,可有效提高ROV水下目标检测效果。最后通过人工水池实验同时放入多个海参、海胆和扇贝,操作地面控制台遥控 ROV进行巡游,检测结果如图8所示。海参、海胆和扇贝水下目标物各类数量较多,同类之间颜色、大小和形状等方面存在差异性的情况下,水下摄像头视野内水下目标物均可被 ROV 同时检测到。即使水下目标物尺寸较小且位于距离较远处,依然具有较好的检测效果。

4 结论

为了提高水下机器人自主能力,对ROV图像检测方法进行深入研究。提出了一种基于深度分离可变形卷积对GAN的改进,以及多深度对抗网络下的图像增强方法,提高了网络的检测速度、增加了检测适应性、提升了检测精度。在生成器网络加入FEM模块来提升网络性能,有效的减少了由于训练度过产生的过拟合现象。通过构造损失函数,搭建ROV实验平台,建立水下目标数据集,通过网络训练有效的增强了ROV水下目标图像质量。最后通过实验,选择实验参数与测试结果对比,将提出的图像复原处理方法应用在ROV水下目标检测上,ROV水上控制平台显示图像与图像数据集质量得到明显提升,水下目标检测效果相比之前有明显改进,验证了本文方法改进的有效性。未来可进一步优化网络,减少其所需计算资源,在控制成本的同时加大应用范围。

参考文献(References):

[1] Nomura K, Sugimura D, Hamamoto T. Underwater imagecolor correction using exposure-bracketing imaging[J]. IEEE Signal Processing Letters,2018,25(6):893-897

[2] Zhang H, Patel V M. Densely connected pyramid dehazing network[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. Salt Lake City, Utah:IEEE,2018:3194-3203

[3] Chen X, Yu J, Wu Z. Temporally identity-aware SSD with attentional LSTM[J]. IEEE transactions on cybernetics, 2019,50(6):2674-2686

[4] Yang M, Hu K, Du Y, et al. Underwater image enhancement based on conditional generative adversarial network[J].Signal Processing:Image Communication,2020,81:115723.188-194

[5] Li C, Guo J, Guo C. Emerging from water: Underwater image color correction based on weakly supervised color transfer[J]. IEEE Signal processing letters,2018,25(3):323-327

[6] Wang Y, Zhang J, Cao Y, et al. A deep CNN method for underwater image enhancement[C]//2017 IEEE International Conference on Image Processing (ICIP). Beijing, China:IEEE,2017:1382-1386

[7] Zhuang P, Ding X. Underwater image enhancement using an edge-preserving filtering Retinex algorithm[J]. Multimedia Tools and Applications,2020,79(25):17257-17277

[8] Akkaynak D, Treibitz T. Sea-thru: A method for removing water from underwater images[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. CA, USA: IEEE,2019:1682-1691

[9] Liu M Y, Breuel T, Kautz J. Unsupervised image-to-image translation networks[J]. Advances in neural information processing systems,2017,30:1579-1594

[10] Song W, Wang Y, Huang D, et al. Enhancement of underwater images with statistical model of background light and optimization of transmission map[J]. IEEE Transactions on Broadcasting,2020,66(1):153-169

[11] Liu W, Anguelov D, Erhan D, et al. Ssd: Single shotmultibox detector[C] //European conference on computer vision. Springer, Cham,2016:21-37

[12] Peng Y T, Cosman P C. Underwater image restorationbased on image blurriness and light absorption[J]. IEEE transactions on image processing,2017,26(4):1579-1594

[13] Berman D, Levy D, Avidan S, et al. Underwater singleimage color restoration using haze-lines and a new quantitative dataset[J]. IEEE transactions on pattern analysis and machine intelligence,2020,43(8):2822-2837

[14] Van Noord N, Postma E. A learned representation of artist-specific colourisation[C]//Proceedings of the IEEE International Conference on Computer Vision Workshops. Hawaii,USA:IEEE,2017:2907-2915

[15] Berman D, Treibitz T, Avidan S. Diving into haze-lines: Color restoration of underwater images[C]//Proc. British Machine Vision Conference (BMVC). London:IEEE,2017,1(2):88-95

[16] Yoon J, Shin M, Lee J Y, et al. RNA interference (RNAi)-based plasmonic nanomaterials for cancer diagnosis and therapy[J]. Journal of Controlled Release,2022:181-188

[17] Liu R, Fan X, Zhu M, et al. Real-world underwater enhancement: Challenges, benchmarks, and solutions under natural light[J]. IEEE Transactions on Circuits and Systems for Video Technology,2020,30(12): 4861-4875

[18] Gao S B, Zhang M, Zhao Q, et al. Underwater image enhancement using adaptive retinal mechanisms[J]. IEEE Transactions on Image Processing,2019,28(11): 5580-5595

[19] Dong H, Neekhara P, Wu C, et al. Unsupervised image-to-image translation with generative adversarial networks[J]. arXiv preprint arXiv:1701.02676,2017:108-115

[20] Zhu J Y, Park T, Isola P, et al. Unpaired image-to-image translation using cycle-consistent adversarial networks[C]//Proceedings of the IEEE international conference on computer vision. Hawaii,USA:IEEE,2017:2223-2232

*基金項目:常州市科技支撑计划项目(CE20212025); 常州市国际科技合作项目(CZ20210013)

作者简介:陆地(1995-),男,安徽省合肥人,硕士研究生,主要研究方向:水下机器人视觉。