基于改进型U-net神经网络的焊缝图像处理

2023-03-15申俊琦刘晨帆胡绳荪吴定勇

申俊琦 ,刘晨帆 ,胡绳荪 ,杨 辉,张 超,吴定勇

(1.天津大学材料科学与工程学院,天津 300354;2.天津市现代连接技术重点实验室,天津 300354;3.中交天和机械设备制造有限公司,苏州 215557)

焊接机器人被广泛应用于工业制造领域,并可以借助各种传感器获取焊缝信息,实现对机器人焊接过程的实时跟踪与控制,从而提高机器人焊接的质量和效率[1-2].线结构光视觉传感具有非接触、结构简单、信息丰富和测量精度高等优点,因此在焊缝跟踪领域得到了广泛的应用[3-5].线结构光被投射到焊缝表面形成包含焊缝信息的图像,但焊接过程中的弧光、飞溅、烟尘等噪声会对焊缝信息提取造成严重干扰,因此可以通过图像分割的方法从采集到的图像中提取出焊缝信息.

目前,几何中心法[6]和Sterger算法[7]等已被用于焊缝图像处理中,并取得了一定的效果.此外,研究者基于焊缝图像的特点及图像处理新技术改进了传统的图像处理算法,并相继提出了一些新的焊缝信息提取方法,取得了较好的效果[8-12].

深层神经网络具有优异的特征学习能力,能够从大量焊缝标签图像中学习焊缝的特征信息,从而增强焊缝信息提取的精度和稳定性.张永帅等[13]使用全卷积网络(fully convolutional networks,FCN)从焊缝图像中提取出激光线条,并证明了该模型在多种焊接条件下的稳定性.Zhao等[14]提出了基于 ERF-Net网络的强噪声图像焊缝信息提取算法,算法在多层多道焊缝图像处理中表现出较强的鲁棒性.

本文提出并构建了一种基于改进型 U-net全卷积神经网络的焊缝图像处理模型,以实现准确、快速的焊缝信息提取,为适用于强干扰焊接环境的线结构光视觉焊缝跟踪系统的开发与应用奠定基础.

1 焊接方法和设备

1.1 焊接方法

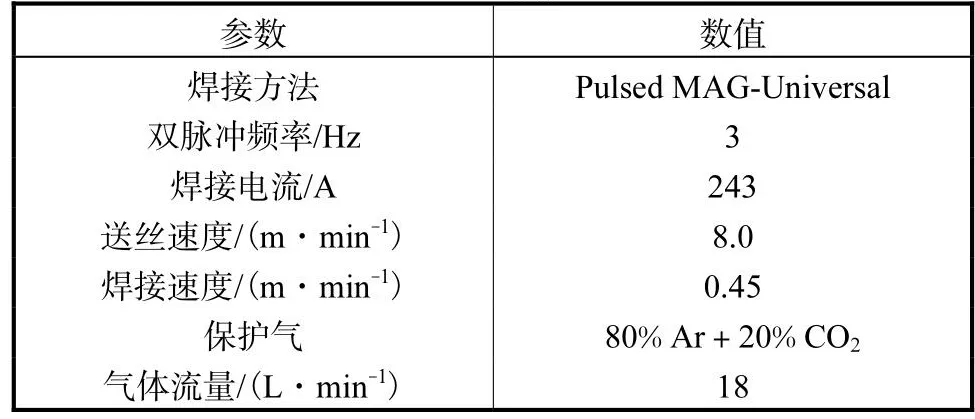

本文针对 Q235钢中厚板机器人熔化极气体保护焊(GMAW)过程中的焊缝图像处理开展研究.试验时的试件厚度为 30mm、V 型坡口角度为 60°、钝边为 1mm.所使用的 GMAW 焊接工艺参数如表1所示.

表1 焊接工艺参数Tab.1 Welding parameters

1.2 焊缝图像采集和处理设备

图1为焊缝图像采集和处理系统的示意.由文献[15]可知,弧光在波长 625~660nm 范围时强度最弱,因此选用 650nm线性激光器和 CA-160 CMOS工业相机激光视觉图像采集系统,并在工业相机镜头前加装 650nm 的窄带滤光片以减弱弧光的干扰.在计算机中构建焊缝图像处理模型以提取焊缝特征信息,计算机处理器为 Intel(R)Core(TM)i7-6700HQ CPU@2.60GHz,内存为 8.0GB,操作系统为Windows10 64位系统,运行平台为Python3.7.4.

图1 焊缝图像采集和处理系统示意Fig.1 Schematic of the weld seam image acquisition and processing system

2 U-net模型建立与训练

2.1 U-net全卷积神经网络

U-net全卷积神经网络采用编码-解码的架构,通过像素点端到端地训练,从而实现被观测信息的语义分割[16-17].如图2所示,原生 U-net网络可分为下采样和上采样两个阶段,且都使用相同数量的卷积层;通过跳跃的方式连接下采样层和上采样层,从而将下采样层中获得的深层特征信息传递到上采样层,并在上采样阶段实现特征融合.因此,U-net网络具有较强的图像局部细节敏感度,能够充分考虑像素和像素之间的联系,从而保持像素间的空间一致性.

图2 U-net神经网络原理示意Fig.2 Schematic of the U-net neural network

2.2 改进型U-net神经网络结构

根据上述原生 U-net网络结构,提出了一种基于改进型U-net全卷积神经网络的焊缝图像处理模型,改进型U-net网络的结构与训练过程如图3所示.改进型 U-net网络将原生 U-net网络中的单个 U型结构重构为两个U型结构,使单个 U型结构的卷积层和反卷积层数均减少 1/2,使得图像下采样倍率从 16倍变成 4倍,从而保留了更多的空间信息.使用桥接的方式将第 1阶段下采样分割的焊缝信息传入第 2阶段上采样过程中,为深层抽象的焊缝特征融入更多的空间信息.将原生 U-net的修正线性单元(rectified linear unit,ReLU)激活函数改为带泄漏的修正线性单元(leaky rectified linear unit,LReLU),并将超参数 α设置为0.01,从而有效避免原生U-net网络的神经元坏死现象.引入批标准化(batch normalization,BatchNorm)层实现数据的正则化,以减少梯度弥散并使神经网络使用较大的学习率来训练,从而提升收敛速度并增强像素分类效果.

图3 改进型U-net神经网络结构及训练过程Fig.3 Structure and training process of the improved U-net neural network

改进型 U-net网络的下采样阶段共有 4个卷积层,均采用卷积-LReLU-BatchNorm 的结构,每层都使用 LReLU函数激活卷积运算的结果.上采样阶段共有 4个反卷积层,均采用反卷积-LReLUBatchNorm的结构,同样使用 LReLU函数激活反卷积运算的结果,但在最后一个反卷积层中关闭BatchNorm.下采样和上采样阶段的卷积层和反卷积层均使用大小为3×3的卷积核,滑动步长设置为1;下采样开始前和上采样结束后,使用大小为 1×1的卷积核分别增加和降低图像的维度.

改进型U-net神经网络的损失函数L为

式中:X表示改进型 U-net神经网络提取的焊缝位置;Y表示人工标注的焊缝位置;N为样本数量;S(X,Y)表示 X和 Y的接近程度,可以用式(2)计算获得.

因此,改进型 U-net全卷积神经网络总的损失函数Lt为

式中λ为L1正则化损失函数的权重,本文设置为1.

2.3 改进型U-net神经网络训练

相机采集的全分辨率(1600像素×1600像素)焊缝图像如图4(a)所示,从图中可看出,焊缝信息集中分布在图像中的某一区域内,若直接处理原始的图像,不仅会引入过多的噪声和无关信息,还会影响算法的实时性.因此,通过感兴趣区域(region of interest,ROI)提取的方法处理全分辨的图像,结果如图4(b)所示,ROI提取后焊缝图像的分辨率为 320像素×320像素.为防止过拟合现象产生,本文使用图像增强的手段增加了焊缝图像的多样性.

图4 采集焊缝图像的ROI提取Fig.4 ROI extraction of the captured weld seam image

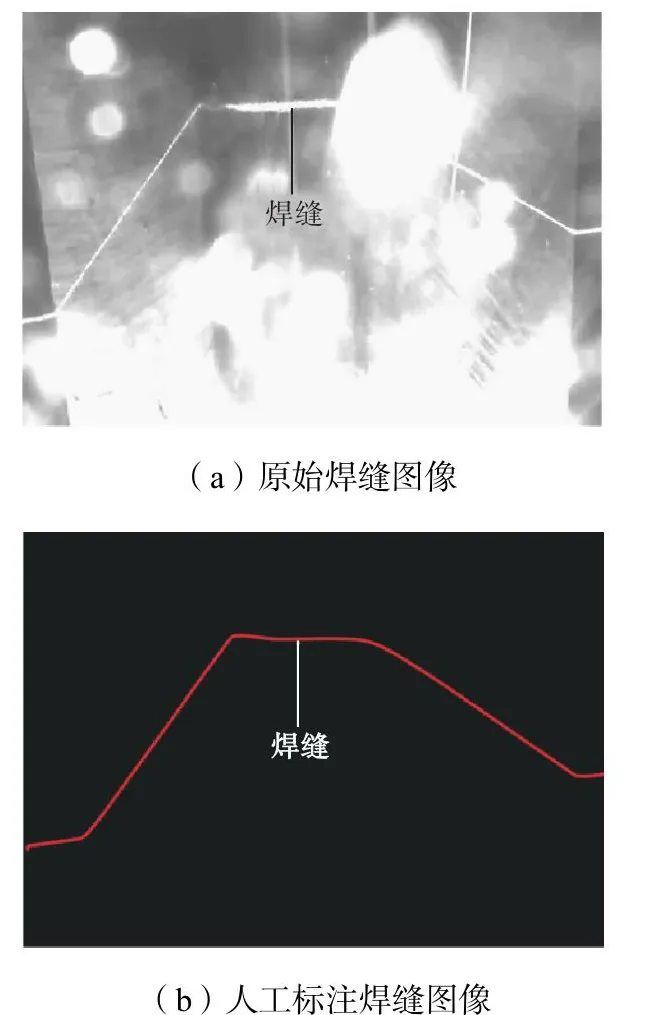

训练神经网络需要准备如图5(a)所示的原始焊缝图像和图5(b)所示的人工标注焊缝图像两类数据,其中人工标注焊缝图像基于未起弧状态的图像制作,依次使用灰度变换、滤波和阈值处理等去除图像中的无关信息,并使用 Sterger算法提取激光条纹的中心,最后通过 Labelme软件标注出焊缝的特征信息.最终分别将1050组和450组如图5所示的图像作为训练集和测试集.

图5 改进型U-net网络图像训练数据Fig.5 Image data used for training the improved U-net network

使用PyTorch深度学习框架构建改进型U-net网络.训练中初始学习率为 0.0005,批量大小为 32,训练迭代次数为 50;选用 Adam 算法加速和优化训练过程,使模型的权值调整到最优.

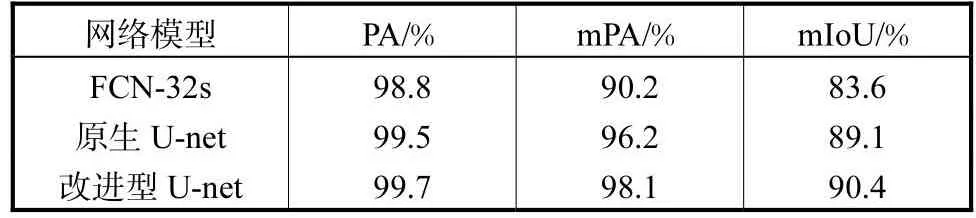

采用相同的数据集训练 FCN-32s网络、原生 U-net网络和改进型 U-net网络,并通过像素精度(PA)、平均像素精度(mPA)和平均交集对联合(mIoU) 3个指标定量评估各模型的焊缝信息提取效果,结果如表2所示.PA、mPA和mIoU的计算式分别为

式中K为修正参数.

网络中引入L1正则化,以防止过拟合现象产生,并提升网络的分割效果,其表达式为

式中:TP是真阳性数;TN是真阴性数;FP是假阳性数;FN是假阴性数.

由表2可知,改进型U-net网络从焊缝图像中准确提取出的焊缝像素信息最多,提取的焊缝位置与人工标注的焊缝位置最为接近,对不同类焊缝图像提取的稳定性也最好.

表2 3种神经网络的训练结果Tab.2 Training results of three neural networks

3 结果与讨论

分别使用Sterger算法、FCN-32s和改进型U-net全卷积神经网络处理测试集中的图像以测试不同算法的焊缝信息提取效果.图6为部分测试的结果.

从图6(b)可以看出,Sterger算法虽然分割了被观测物和背景,但无法区分焊缝信息和噪声信息,将两者的边界混杂在一起,因此提取结果没有实用价值.图6(c)表明,FCN-32s网络可以区分焊缝信息和噪声信息,但由于 FCN-32s网络的上采样阶段仅对底层的抽象特征采用反卷积的方法恢复宏观形貌,未考虑像素点间的相对位置关系,割裂了空间信息的一致性,从而导致提起出的焊缝信息出现了间断和扭曲.如前所述,改进型 U-net网络在下采样阶段降低了采样倍率,因此保留了更多的焊缝像素点的空间信息,并在两次上采样阶段都融合了所保留的焊缝空间信息,从而提升了焊缝信息的提取效果,提取结果如从图6(d)所示.

图6 3种模型焊缝分割结果对比Fig.6 Weld seam segmentation by three models

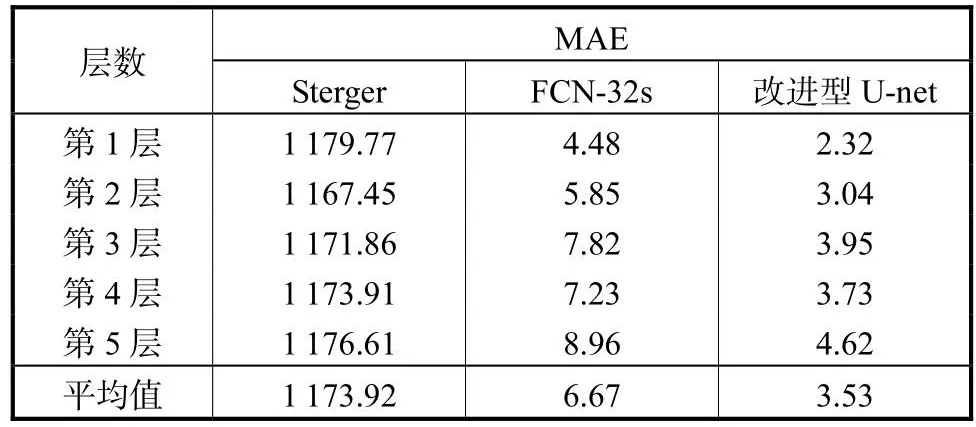

分别计算 3个模型的焊缝信息提取平均绝对误差(MAE)、均方根误差(RMSE)以及处理单张焊缝图像的时长以定量分析各个模型的焊缝信息提取精度和速度,计算结果如表3~表5所示.

从表3~表5可以看出,使用传统 Sterger算法提取焊缝信息的偏差最大且耗时最长,表明其不适合从包含强噪声的焊缝图像中提取焊缝信息.由表3和表4可知,改进型U-net网络模型提取各层焊缝信息的精度均优于FCN-32s网络;通过坐标转换,计算出改进型 U-net网络模型的焊缝位置提取平均偏差为1.64mm.多层多道焊接时,随着焊接层数的增加,焊缝表面逐渐趋于平滑,从而使得线结构光条纹的形状愈发复杂,因此焊缝信息提取的难度也随之增加,从而使得 FCN-32s网络和改进型 U-net网络的焊缝位置提取 MAE和 RMSE都随着焊接层数的增加而增加.由表5可知,两个模型在焊缝信息提取时均有较快的处理速度.

表3 不同焊接层焊缝位置提取的MAETab.3 MAE of weld seam extraction in different welding layers

表4 不同焊接层焊缝位置提取的RMSETab.4 RMSE of weld seam extraction in different layers

表5 不同焊缝提取算法运算时长Tab.5 Calculation time required by different algorithms for weld seam extraction

4 结 论

(1) 针对机器人熔化极气体保护焊线结构光焊缝跟踪系统中焊缝信息提取过程容易受到弧光、飞溅和烟尘等噪声干扰的问题,提出了一种基于改进型U-net全卷积神经网络的图像处理模型,实现了图像中焊缝位置信息的有效提取.

(2) 采用相同数据集训练的条件下,改进型 U-net网络具有比FCN-32s和原生U-net网络更高的像素精度、平均像素精度和平均交集对联合;实验结果表明,与传统 Sterger算法和 FCN-32s网络模型相比,改进型U-net网络的焊缝位置提取精度更高且图像处理速度更快.

(3) 基于改进型 U-net全卷积神经网络的焊缝信息提取的平均绝对误差为 3.53、均方根误差为4.42,焊缝位置提取的平均偏差为 1.64mm,单帧焊缝图像处理时间为 6.4ms,可以满足线结构光视觉焊缝跟踪的精度和实时性需求.