面向文本情感分析的BiTCN-SA模型的研究①

2022-12-15卞玉露

卞玉露

(安徽理工大学 计算机科学与工程学院,安徽 淮南 232001)

0 引 言

随着互联网使用成本的逐渐降低,人们越来越倾向于在各类网络平台上发表评论,消费者可以根据平台涵盖的评论快速了解信息。这些非结构化数据既包含了对行业极具价值的数据也存在不少冗余数据,[1]若单纯依靠人工进行逐条处理是不可取的,不仅耗费成本而且会影响最终情感预测结果,这就使得我们必须采用先进技术提取更高价值的信息。[2]所以针对海量数据进行情感倾向性判断也变得极为重要。

目前应用于情感分析的主流方法分为三大类。[3-4]1)基于词典的方法[5-7]需要构建一个由大量主观情感特征词构成的情感词典,然后根据给定文本中带有情感特征的词汇得到情感分数,使用相应计算方法得到最后的文本情感值,最后通过分值大小对情感倾向进行区分。该方法虽易于实现且不依赖于手动标注的语料集,但性能却极大地依赖于情感词典中数据的质量,且大多数情感词典均缺乏领域词。2)基于机器学习的方法[8-11]首先经过特征提取获取合适的特征,随后依据统计学方法对特征词进行选取,从文字中抽取挖掘词义信息并获取有价值的数据特征从而提升模型的学习效果,通过分类算法对经过特征选择后的特征项进行分类。目前该方法已取得不错的成绩,相较于情感词典方法在情感分类性能上也有了较高的提升,但却很难提取到更深层的语义特征。3)基于深度学习的方法最初在图像处理上取得了较好结果,后被广泛应用于文本领域。近年来由于人工神经网络强大的特征自动学习能力,研究者也更多地结合深度学习技术进行情感分析。[12-14]卷积神经网络模型(Convolutional Neural Network,CNN)[15-16]利用卷积计算获得上下文词和方面词的表示,在挖掘文本局部特征上具有极大优势。它因计算速度快而被推崇,但大多都没有考虑文本中先出现的词对后面出现词即词序的影响。循环神经网络模型(Recurrent Neural Network,RNN)[17]是通过循环迭代结构来处理信息的,是一类用于与时间序列相关任务的人工神经网络,但在训练过程中容易出现一系列梯度问题,导致网络缺乏长期记忆性。随后长短时记忆网络(Long and Short Term Memory Network,LSTM)在一定程度上弥补了RNN在梯度传递的缺陷缓解了梯度问题。近年来出现了一种在CNN基础上具备处理序列问题的网络模型,时间卷积神经网络模型(Temporal Convolutional Networks,TCN)[18-20],与普通一维卷积相比多了空洞卷积和因果卷积两个操作。该模型可以借助因果卷积实现记忆功能,通过改变扩张因子数灵活调控感受野,通过并行处理以减少训练时间,通过反向传播很好地缓解梯度问题。TCN对文本序列特征的提取不够全面,所以文献[21]针对该问题提出使用BiTCN提取文本特征并对中文数据集进行实验验证,但仍存在不能完整地获取文本特征表示以及上下文信息使用不足的问题,同时对其中重要词的关注程度不够。

基于上述研究,借助TCN在处理序列问题时对词序特征的处理优势提出一种新的基于BiTCN的情感分析方法。使用BiTCN从两个方向共同完成对文本信息的特征提取,引入自注意力层捕捉文本中特征的内部相关性,构建BiTCN-SA模型,随后将模型应用于大众点评餐厅评论数据集完成情感分析。以BiTCN作为基线模型,通过6组实验对比,验证所提模型的可行性和提升效果。

1 相关理论

1.1 TCN基本原理

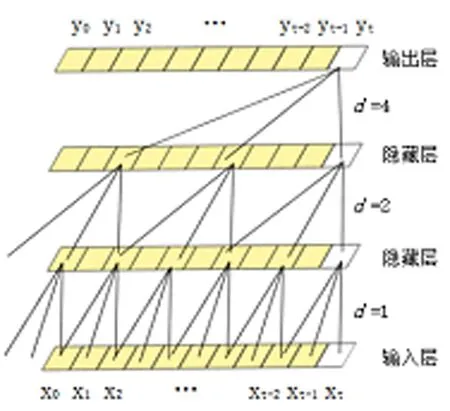

与CNN相比,TCN通过改变扩张因子数合理调控感受野,通过叠加多个扩张因果卷积层以获取更完整的语义特征,通过残差连接防止网络层过高导致的梯度问题。[20]网络结构如图1所示。

图1 TCN网络结构图

(1)因果卷积

某时刻的信息只能依据此前参数值进行预测,只能由当前输入xi和x1,x2,…,xi-1计算如式(1):

(1)

滑动窗口通过从左至右计算进行特征提取,在保证充分利用该时刻前信息的同时,也确保了不使用该时刻后的信息,严格受限于时间序列,具备很强的因果性质。

(2)扩张卷积

卷积层数越高,卷积窗口就越大,窗口中的空洞也就越多,通过引入扩张卷积可以弥补对卷积核大小的限制。添加了扩张卷积的卷积核大小为式(2):

fk-d=(d-1)×(fk-1)+fk

(2)

fk为当前层卷积核大小,通过设定不同扩张因子数d对文本序列采样,通过增大扩张因子数增大感受野,学习更大范围的信息。

(3)残差连接

对输入x和经过非线性变换后的F(x)求和形成短路链接,避免由网络层数过大引起的梯度问题如式(3):

R=x+F(x)

(3)

1.2 注意力机制

注意力机制类比人类的视觉系统,对于一张图或一段文字中某些特定信息有更多的注意,从而抓取到更多有用的特征。计算过程如下:

计算多个查询和每个键值的相关性,求出键值对应的权重系数如式(4):

(4)

对权值矩阵归一化处理如式(5):

(5)

将添加的权重和对应的键值加权求和得到所求注意力值如式(6):

(6)

式(6)中Lx为数据长度,Q表示查询,K表示键,V表示值。通过对文本中的情感特征赋予不同权重以区分其中信息的重要程度,从注意力角度强调分类的准确率。

2 BiTCN-SA模型架构

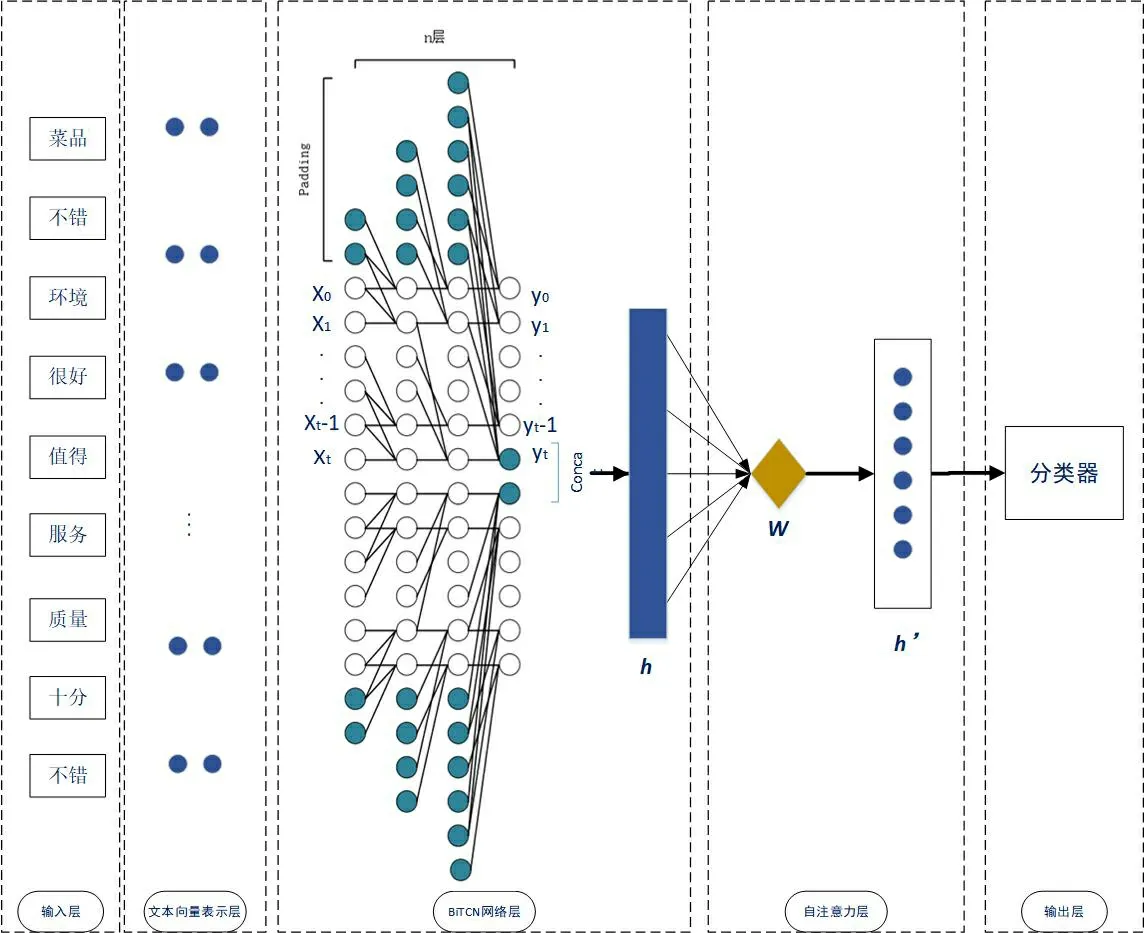

模型有5层。1)输入层用于输入用户评论文本;2)文本向量表示层用于将输入层的结果转化为词向量表示;3)网络层借助双向TCN提取文本的全局序列特征,同时能够联系上下文特征;4)自注意力层将提取的序列特征映射成添加了注意力权重的序列;5)在输出层使用softmax对权重矩阵归一化处理完成情感分类。模型架构如图2所示。

图2 BiTCN-SA模型架构图

2.1 文本向量表示层

采用Skip-gram模型对文本词向量表示。根据给定评论词得到该词汇出现在上下文中的概率P如式(7):

(7)

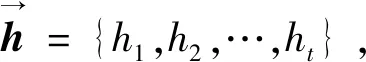

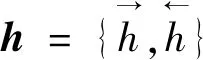

2.2 网络层

2.3 自注意力层

自注意力机制是注意力机制的一种,多用于处理数据集内部和任务内部的计算,它不依赖于外部知识,只捕捉文本的内部相关性,重点强调文本词与词之间的关系。过程如下:

(8)

对权重矩阵归一化处理如式(9):

α=Softmax(W)

(9)

用权重乘上向量集合H求得自注意力值如式(10):

Att(H)=αH

(10)

最终的句子表示如式(11):

h*=tanh(Att(H))

(11)

2.4 模型训练

在训练过程中使用交叉熵误差作为损失函数最小化训练样本和实际值误差如式(12):

(12)

3 实验流程

3.1 数据预处理

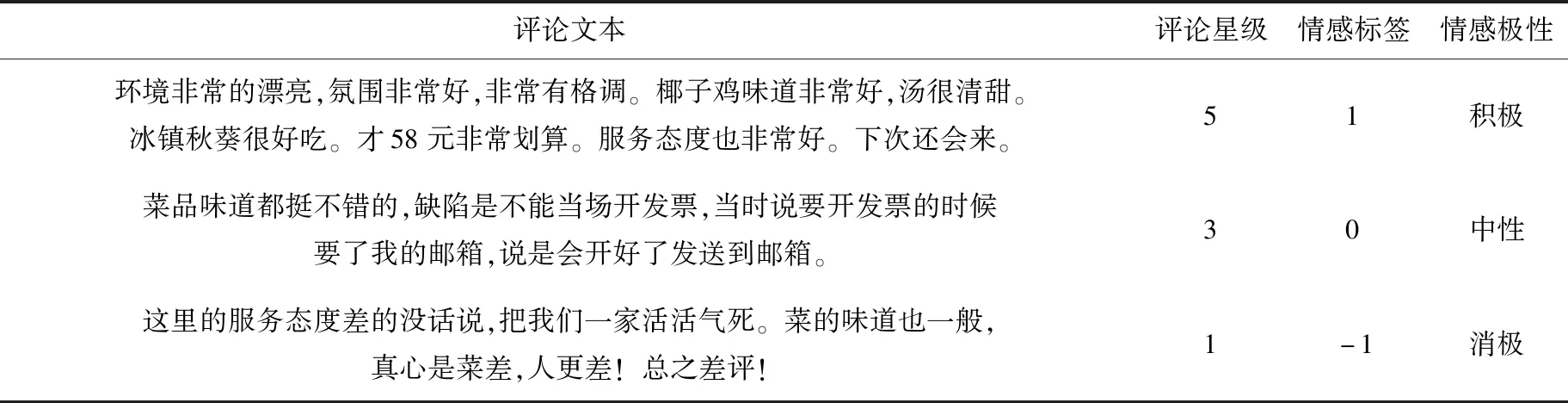

从北大数据库平台大众点评餐厅评论数据集中选取15000条,每条数据包括评论观点、整体评价星级等内容。根据评分星级(4-5星,3星,1-2星)使用标签(1,0,-1)标注对应的情感极性(积极,中性,消极)即三元分类。

表1 实验数据样例

(1)首先对数据预处理,对数据进行扫描,过滤无用的数据,修正错误和不规范数据,从经过滤后的数据中选择其中80%作为训练集,20%为测试集。

(2)采用结巴分词工具自动为文本分词,并参照停用词表去除停用词。

(3)通过剪切、长度补齐等操作对数据格式标准化,保证其长度统一。

(4)对分词后的文本进行词向量表示,将评论文本表示成词向量矩阵结构,将词向量序列作为网络模型的输入。

3.2 实验环境搭建

所用实验环境的具体信息如下:使用WIN10操作系统,CPU为Intel®CoreTM i5-7300 HQ 3.5Hz。使用的开发语言是Python 3.8版本,深度学习框架为PyTorch 1.2.0。

3.3 设置实验参数

采用word2Vec中的Skip-gram模型训练词向量,词向量维度设为200;在BiTCN网络层中卷积核大小设为6,扩张因果卷积层数设为4,扩张因子数为2n[1,2,4,8],隐藏层数设为128;Dropout参数设为0.2,Adam优化器的学习率设为0.01,训练批次的长度为32。

3.4 实验结果与分析

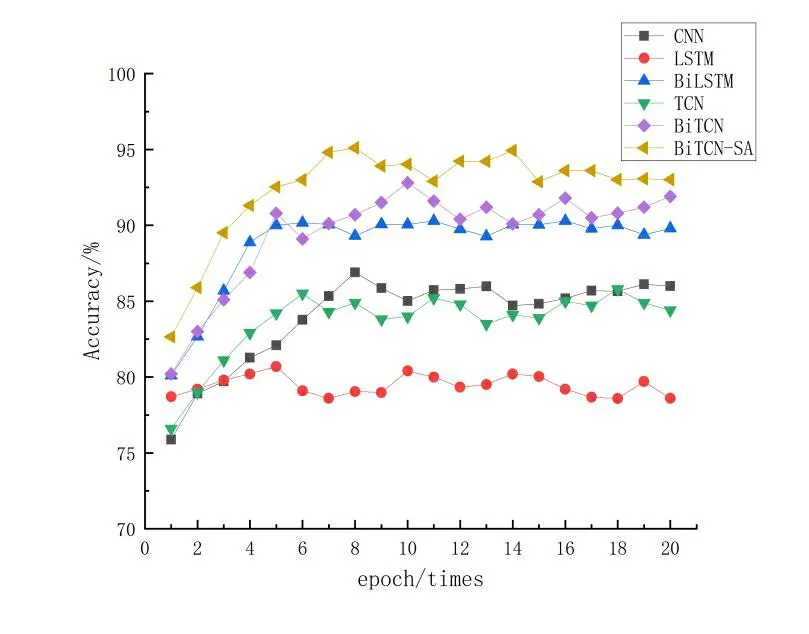

在同一实验环境下设置六组对比实验,不同模型的实验结果如图3所示。

CNN:利用卷积计算获得上下文词和方面词的表示,计算速度快,在对文本局部特征的挖掘上有极大优势。与基线模型BiTCN相比,其准确率提升了8.2%;

图3 六种模型的准确率对比图

LSTM:通过添加门控机制选择性地提取文本特征信息,是继RNN后具有记忆功能的、在一定程度上弥补RNN梯度缺陷的优化模型。与BiTCN相比,准确率提升了14.4%;

BiLSTM:使用两个LSTM分别提取文本的前、后向特征,再将两个方向上的特征融合后输入分类器完成情感分类。与BiTCN相比,准确率提升了4.8%;

TCN:考虑文本序列中词序的影响,利用多层因果卷积和扩张卷积结构提取具有词序特征的信息。与BiTCN相比,准确率提升了9.6%;

BiTCN:融合了前后两个方向的特征编码参与情感倾向性判断,准确率达到95.1%;

BiTCN-SA:在基线模型基础上添加了自注意力机制捕捉文本中特征的内部相关性,帮助模型优化特征向量。与BiTCN相比,该模型的准确率有了2.3%的提升。

4 结 语

提出BiTCN-SA模型并应用于大众点评餐厅评论数据集。首先使用Skip-gram模型对输入文本进行词向量表示;然后借助BiTCN从两个方向提取文本全局特征;最后引入自注意力机制,重点关注其中对情感判断影响较大的特征词,以提升模型分类的准确率。6组对比实验表明,在相同条件下所提模型有较好的分类效果。实验中发现:1)迭代训练次数过少,模型的鲁棒性仍不够好;2)仅以准确率为评价指标,在文本情感分析的性能上仍不够精确,还需要结合其他评价指标共同判断。因此,后续的研究将着眼于如何进一步提升模型的准确率和性能的问题上。