边缘先验信息下的多类型肠道息肉图像分类网络

2022-11-24叶淑芳何熊熊

李 胜 曹 婧 叶淑芳 代 飞 何熊熊

1(浙江工业大学信息工程学院,杭州 310012)

2(丽水市人民医院消化内镜中心,浙江丽水 323020)

引言

近年来,我国每年结直肠癌新增病例超过52.1万,而死亡病例也接近24.8 万[1],结直肠癌发病率逐年上升,严重威胁国民的健康[2]。大多数结直肠癌从良性息肉逐步发展而成,长期随访研究证实,对癌前腺瘤性息肉的早期检出与干预能够有效地降低结直肠癌的死亡率[3]。因此,对结直肠息肉,尤其是对腺瘤性息肉的检测显得尤为重要。

结肠镜检查是结直肠癌筛查最重要的诊断方法,内镜医生会对可疑区域进行拍照并取样进行组织病理活检[4]。组织病理学检查是肠道息肉分型的“金标准”,但是大量的病理检查导致病理医生工作强度很大,且切除息肉会带来一定的出血和穿孔等并发症风险。为了更快、更经济、更安全地对肠道息肉进行分型,许多专家建议使用窄带成像(narrow band imaging,NBI)内镜[5]、超扩大细胞内镜[6]等设备进行光学活检,这些设备能够更好的显示血管模式以及腺体形态细节,从而无需进行组织病理活检就能较为准确地预测肠道息肉的类型[7-8]。然而,上述新的内镜设备在大多数医院还未能普及,且对息肉类型的判断依赖操作者的经验和临场状态,容易发生漏诊和误诊。本研究设计了一个边缘先验信息下的肠道息肉图像分类网络,在白光结肠镜手术中实现对肠道息肉不同类型的区分,为医生进行辅助决策。

早期基于传统图像处理的肠道息肉分类方法通过设计手工特征并结合分类器实现。Häfner等[9]结合息肉表面腺体凹坑的视觉结构,通过分割凹坑区域结构并分析其形状和纹理特征,从而实现对结直肠癌的自动检测。Tamaki 等[10]探索了一种基于局部特征视觉词袋的识别方法并结合了新的采样方案,实现对NBI 内镜下息肉图像的三分类。Mesejo 等[11]利用三维形状特征和机器学习提高息肉分类的准确率,这是避免对可疑增生组织进行活检的第一步。杨建军等[12]通过设计局部颜色差异直方图并结合特征袋,实现内窥镜图像的精准分类。手工特征描述下的息肉分类方法存在泛化性能差的不足,只适合特定的数据集且效果有限。近年来,更多的学者将目光投向了更具潜力的基于深度学习的医学图像分类算法。Zhang 等[13]提出了一种基于深度卷积神经网络的迁移学习方法实现增生性息肉与腺瘤性息肉的分类,将从自然图像学习到的特征迁移到医学图像分类任务中。Byrne等[14]通过提取内窥镜检查视频的关键帧构建息肉分类数据集,实现实时评估结肠道息肉图像。黄佩云等[15]提出双流网络,包含处理原始图像的原始流和关注病灶区域的检测流来实现肠道息肉分类。潘燕七等[16]通过融合传统方法提取的浅层特征和卷积神经网络的深层特征,为医生临床诊断提供决策支持。基于深度学习的分类算法在区分差异度大的增生性和腺瘤性息肉能达到较高的分类准确率,但对于类间相似性较大的非腺瘤性与腺瘤低级别息肉、以及腺瘤高级别与腺癌,上述网络的分类准确率非常有限。在临床中,判断肠道息肉类型的重要依据是息肉的边缘特征,例如息肉边缘的周长大小,边缘是否光滑等,因此引入了边缘先验特征来提高网络对肠道息肉的区分能力。

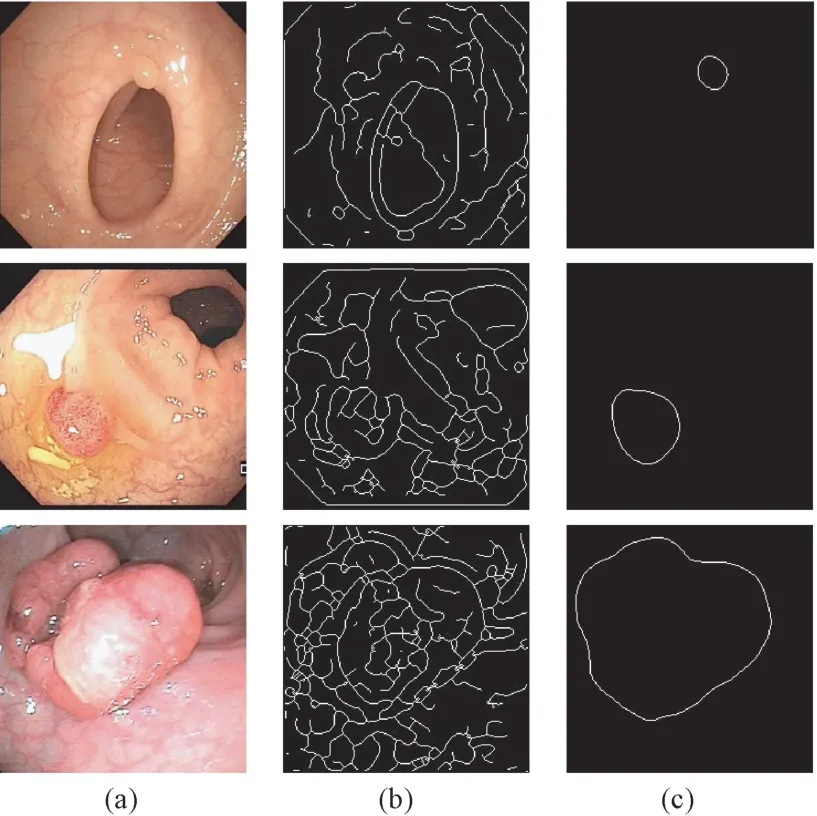

早期的边缘特征提取方法依靠先验知识指导制作手工特征来实现内窥镜图像感兴趣区域的检测与分类。Wang 等[17]提出一种基于几何形状、光照差异和沿边缘范数方向强度变化的局部特征来评判结肠镜检查中阑尾孔的质量,确保结肠检查完整贯穿。Wang 等[18]引入了一种边缘横截面自动检测结肠镜中突出息肉的新技术,通过计算边缘截面轮廓的导数函数,并将轮廓分割为部分,接着建模提取适合每个部分的特征,该方法有效地描述了突出息肉的复杂特性,包括息肉的形状、纹理以及突出的平滑性。Tajbakhsh 等[19]设计了一种混合上下文和形状信息的计算机辅助诊断系统检测结肠镜检查视频中的息肉,先通过Canny 检测提取尽可能多的边缘,再利用边缘点梯度与上下文信息去除非息肉结构,并通过形状信息来定位息肉。基于纹理特征的息肉检测方法需要使用固定大小的分析窗且严重依赖图像训练集的准确性。Hwang 等[20]为了克服上述问题,提出了一种聚焦椭圆拟合形状的息肉检测方法,可获得肠道图像中的大多数边缘信息,其中也包含了噪声,例如光斑、气泡、血管、管腔以及结肠壁褶皱等,后续需要设计相应的后处理算法去除非息肉边缘,且存在边缘连接的问题,如图1(b)所示,传统的Canny 边缘提取方法提取了图像中的大量边缘,很难有针对性地对息肉边缘进行下一步的特征提取。所提出的息肉分类算法基于边缘信息,因此需要得到准确的息肉边缘。Fan 等[21]提出的平行反向注意网络(PraNet)使用并行部分解码器在高层聚合特征以精确地分割息肉,提高边缘分割的准确性,该网络在多个息肉分割公开数据集中验证了其较优的泛化性能。将会利用PraNet 作为息肉分割的主干网络,设计并嵌入一个边缘检测阶段的反向注意力边缘监督模块(reverse attention edge monitoring module,RAEM)得到更为精确的息肉边缘,为后续息肉边缘相对大小和光滑度的特征提取做铺垫。

图1 息肉边缘提取。(a) 原图;(b) Canny 边缘检测;(c) PraNet 边缘检测Fig.1 Polyp edge extraction. (a) Original image; (b) Canny edge detection; (c) PraNet edge detection

在获取边缘信息后,为了利用普通白光内窥镜图像实现肠道息肉的类型区分,提出了一种边缘先验信息下的肠道息肉图像分类网络(fusion edge prior convolutional neural network,FEP-CNN),主要贡献如下:

(1)在边缘检测阶段以PraNet 为主干网络,设计并插入反向注意力边缘监督模块RAEM,细化肠道息肉边缘的提取,并在此基础上设计边缘特征描述子作为医生诊断的先验信息融入到分类网络。边缘特征描述子包括医生在诊断时关注的息肉边缘周长大小和边缘光滑性特征,其中周长大小用相对大小来衡量,边缘光滑性通过计算像素点的凹凸性来描述。

(2)在息肉分类阶段设计了针对肠道息肉分类的通道注意力模块(channel attention module,CA),使得网络能够自适应地捕获区分多类型息肉所需的判别性特征,提高网络的分类准确率。

(3) 构建了一个包含非腺瘤性息肉(nonadenomatous polyps,NAP)、低级别不典型增生腺瘤性息肉(adenomatous polyps with low grade dysplasia,ALP)、高级别不典型增生腺瘤性息肉(adenomatous polyps with high grade dysplasia, AHP) 和腺癌(adenocarcinoma,AC)等4 种类别的息肉分型数据集。

1 材料与方法

1.1 FEP-CNN 网络整体架构

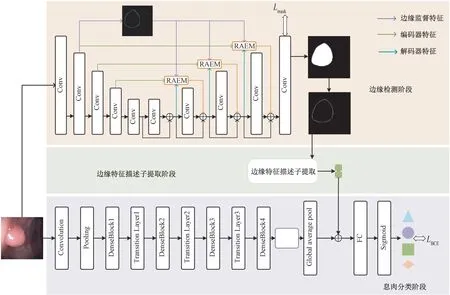

针对息肉分类任务,提出了一个边缘先验信息下的肠道息肉图像分类网络,包括边缘检测阶段、边缘特征描述子提取阶段以及息肉分类阶段。在边缘检测阶段,其主要功能是定位息肉边缘,因此在本阶段,以PraNet[21]为主干网络设计并插入了反向注意力边缘监督模块,进一步地提高了息肉边缘定位的准确性。随着深度学习在医学图像分类领域中的应用,基于ResNet[22]、DenseNet[23]等基础网络提出的改进网络[24-26]对胃肠镜图像疾病分类任务已经达到了较高的分类准确率,这是由于各类疾病其临床表现的特征差异较大,深度学习网络能够很好的捕获到具有判别性的特征。然而对于息肉这一特定疾病的分类工作大多集中在区分正常和非正常、腺瘤和非腺瘤,未对腺瘤性息肉的高低级别进行划分,分类结果也受到类间特征差异小的限制。因此所提网络的边缘特征描述子提取阶段,通过结合内窥镜医生临床诊断时考虑的息肉边缘先验信息,增加了网络的鲁棒性,使得网络不仅仅使用单一卷积层提取特征。最后将边缘特征描述子提取阶段得到的特征拼接到息肉分类阶段得到的一维向量中,即将医生关注的先验知识息肉边缘的周长大小和边缘光滑性对网络进行优化。对于息肉分类阶段采用了DenseNet121 作为分类的主干网络,并引入了通道注意力模块来自适应地选取判别性特征。所提网络的具体结构如图2 所示,网络中所使用的主要模块将在后续小节中继续讨论。

图2 FEP-CNN 整体架构Fig.2 FEP-CNN overall architecture

卷积神经网络在特征提取和分类任务上都表现出了优异的性能,FEP-CNN 网络结构的息肉分类阶段使用DenseNet121 作为主干网络,由卷积层、池化层、4 个Dense Block、3 个Transition Layer 以及全连接层构成,其中最主要的模块是Dense Block 结构,4 个Dense Block 的层数分别为6、12、24 和16。Dense Block 内每一层的输入都是前面所有层输出的级联,可以表示为

式中,x0到xl-1为第0 层到l -1 层的输出特征图,C为逐通道的拼接操作,Hl为第l层包含批标准化(batch normalization, BN)、修正线性单元(rectified linear units, ReLU) 以及卷积操作(convolution,Conv)的复合函数。这样做的好处是可以使得网络在变得更深的同时减少参数,而且每一层都连接前面所有层的输出,因此DenseNet 内梯度传递非常有效,避免了梯度消失的问题。经过DenseBlock 后,输出特征图的通道数会急剧增加,在每两个DenseBlock 之间加入 Transition Layer, Transition Layer 包括一个卷积核大小为1×1 的卷积运算和平均池化操作,1×1 的卷积运算用来降低输出特征图的通道维数,将其缩减到输入特征图通道数的一半,通过Transition Layer 来减少网络的参数。

1.2 边缘检测阶段的反向注意力边缘监督模块

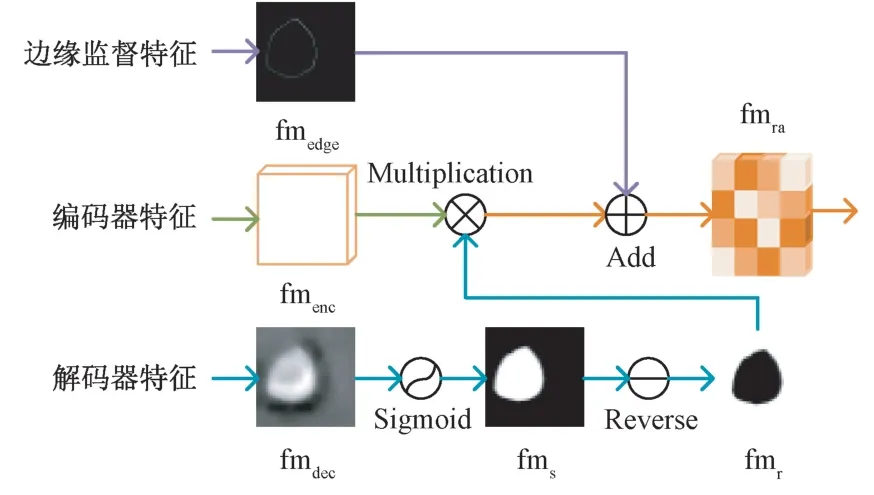

注意力机制(attention mechanism, AM)[27]已经被广泛地应用于图像分类中,通过增强判别性特征或图像区域,抑制不相关的区域,提高对图像中重要信息的聚焦能力。分类网络模型基于息肉边缘先验信息,得到息肉的准确边缘是前提。内窥镜医生在注释息肉时,通常先粗略定位息肉区域,再根据局部特征细分其边缘,可以看出区域和边缘是标注息肉的关键特征。而经典的U 型分割网络仅仅将编码器特征与解码器特征进行简单拼接,此时解码器的特征来自较深的卷积层,只能够捕获息肉相对粗略的位置信息而丢失了边缘细节。为解决该问题,在边缘检测阶段的PraNet 主干网中增加了反向注意力边缘监督模块来优化息肉分割结果,RAEM 模块的具体结构如图3 所示。

图3 反向注意力边缘监督模块Fig.3 Reverse attention edge monitor module

具体来说,将边缘监督特征、编码器提取的特征与解码器提取的特征同时输入到反向注意力边缘监督模块中,解码器特征经过上采样操作得到fmdec∈ℝW×H×C,接着输入到sigmoid 激活函数得到fms,再通过反转运算得到fmr,将fmr与编码器特征fmenc逐像素相乘得到的特征图与边缘监督特征fmedge相加得到最终的反向注意力特征fmra, 其中fms,fmr,fmenc,fmedge,fmra∈ℝW×H×C,整个过程可以表示为

式中,σ为sigmoid 函数,R为反转运算, fmr=1 -fms,⊗为逐像素相乘, ⊕为逐像素相加操作。反向注意力边缘监督模块通过擦除解码器特征中前景对象的方式逐步挖掘息肉的边缘细节信息,再结合边缘监督特征对分割结果进行细化,可以进一步自适应地学习特征权重,将模糊的息肉分割结果调整为带有精确边缘的分割结果。此处选取PraNet中第二层卷积层生成的边缘预测图作为边缘监督特征,这是由于低层卷积层接近原始图像,包含过多的冗余信息,缺少对息肉区域的聚焦,而高层卷积层能很好地捕获息肉位置,但缺少边缘细节信息。

1.3 边缘特征描述子提取

用于区分多类型息肉,成像设备是白光内窥镜,不能够很好地获得息肉表面的腺管分布信息,导致不能使用pit pattern[28]对息肉分型,很难达到较高的分类准确率。而医生在诊断肠镜息肉图像时,在分析组织病理学结果的同时也会结合观察息肉边缘的周长大小与边缘光滑性的临床表现。因此认为息肉的边缘周长大小和边缘光滑性是区分不同息肉类别的重要特征,引入了边缘特征描述子作为医生的先验知识。

针对肠道息肉边缘周长大小特征,将边缘检测阶段得到的区域分割结果进一步处理,得到息肉的边缘。尽管拍摄时内窥镜的远近和角度会造成成像息肉的大小不同,而成像图像中不存在固定大小的参照物可以用来作为校准点,因此很难获取息肉的真实尺寸。使用息肉在图像中相对大小来表示边缘周长大小特征,即直接计算图像中展示的息肉边缘像素点个数,将其定义为

式中,pedge表示边缘像素点的数量,pmax表示数据集中最长边缘的像素点数量,这样可标准化边缘周长大小特征描述子,否则不同特征之间的尺度不同,导致反向传播优化网络时收敛难。特征标准化加快梯度下降求最优解的速度同时提高网络准确率。

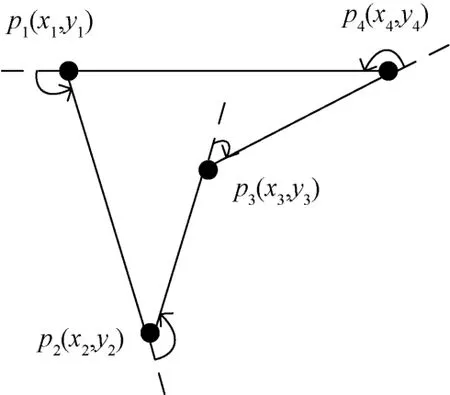

对于肠道息肉边缘光滑性特征,通过计算边缘分割结果中边缘像素点的凹凸性来获得,如图4 所示,由向量叉乘运算来判断像素点的凹凸性。选取3 个连续的边缘像素点p1,p2,p3,计算向量与向量的叉乘,其结果大于零则表示向量位于向量延长线的逆时针方向,即边缘像素点p2为凸点;反之若选取相邻边缘像素点p2,p3,p4, 向量与向量叉乘结果小于零,则向量位于向量延长线的顺时针方向,即边缘像素点p3为凹点。以r为间隔将边缘像素点坐标按逆时针顺序表示为点的集合{v1,v1+r,...,vn},其中vk表示为第k个像素点的坐标,共有n个像素点。为了尽可能保留息肉边缘信息并减少后续算法的复杂性,设置r =5。通过对边缘像素点集合进行遍历,计算凹点的数量。假设边缘像素点vk的坐标为(xk,yk),其相邻的边缘像素点可以记为vk-r(xk-r,yk-r) 和vk+r(xk+r,yk+r),则向量记为(xk - xk-r,yk -yk-r),向量记为(xk+r - xk,yk+r - yk),第k个像素点vk的凹凸性指标icck表示为

图4 边缘像素点的凹凸性Fig.4 The convexity and concavity of edge pixels

若icc 为1,则表示该像素点为凹点,反之则为凸点,边缘光滑性描述子可以定义为

式中,pointconcave表示边缘像素点集合中属于凹点的数量,pointtotal表示为边缘像素点集合中的总数,最终边缘特征描述子提取阶段得到的边缘特征向量记为(esi,esm) 。

所提出的边缘特征描述子考虑了息肉边缘的周长大小和光滑性特征,有效地将医生诊断时的先验知识融入到深度学习网络模型中。由临床医生的诊断经验可知,较为相似的非腺瘤性息肉(NAP)和腺瘤低级别息肉(ALP)直径均较小,但NAP 的边缘相较于ALP 更为光滑。此外,多数直径较大的腺瘤高级别息肉(AHP)和腺癌(AC),其边缘光滑程度也存在差异,AC 的边缘更为粗糙。单一的深度学习网络模型对于类间相似性大的图片很难分类准确,而加入了边缘特征描述子的网络能够更好地区分非腺瘤性息肉与腺瘤低级别息肉以及腺瘤高级别与腺癌。在以往的研究中,肠道息肉边缘常用来检测息肉的有无与确定息肉的位置,通常的做法是通过传统边缘提取算法获得息肉边缘,计算边缘的梯度来描述息肉的形状、纹理以及凸起程度[17]-[18][19],这类边缘特征提取方法检测到的边缘不连续,只提取了部分显著性边缘,息肉边缘的整体光滑性不能得到体现,这样的特征不足以用来进行息肉分型,且通常需要求边缘的一阶导数或高阶导数,计算复杂度较大,在息肉多分类任务中不能达到较好分类效果。

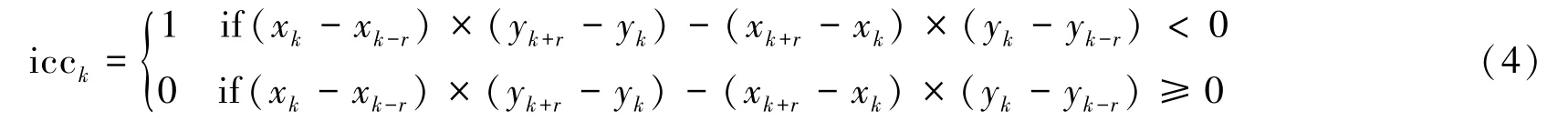

1.4 息肉分类阶段的通道注意力模块

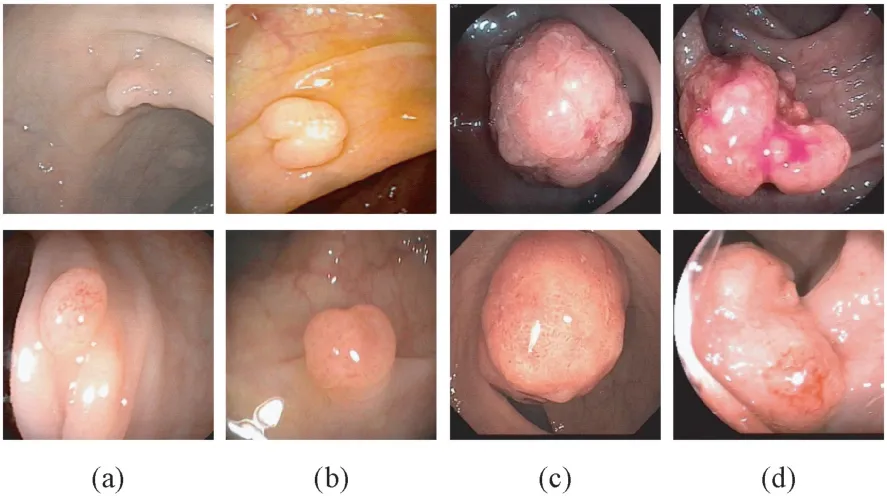

图5 为息肉分类阶段中所涉及的通道注意力模块的具体结构。假设Dense Block4 输出的特征图为x∈ℝW×H×C,其中W,H,C分别表示特征图的宽度、高度和通道数,则由通道注意力模块生成的权重可以表示为

图5 通道注意力模块Fig.5 Channel attention module

式中,G表示通道方向上的池化操作,在后续的实验中,将对比采用全局平均池化层和最大池化网络的性能。xij表示特征图x中第i行第j列的像素,Conv1D表示为一维卷积操作,卷积核大小设为1×3,σ为sigmoid 函数。通道注意力模块建模特征图表示各个通道在该分类任务中的重要性。传统的注意力模块通过全连接层将信道特征映射到低维空间,再通过全连接层将低维空间特征映射回原特征的尺寸大小,使得通道数与通道注意力权重之间的对应是间接的。而通道注意力模块通过一维卷积避免了降维操作,一方面降低了模型参数量,另一方面建立通道数与权重之间的直接对应关系,提高对判别性特征的筛选能力,对肠道息肉类别的判断具有更好的性能。

1.5 构建数据集

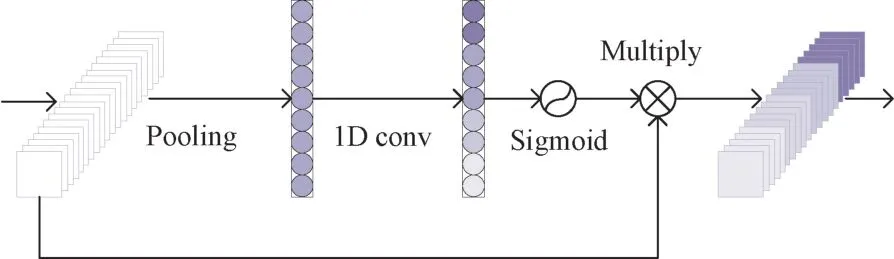

所使用的数据集来自丽水市人民医院消化内窥镜中心2018年至2019年的脱敏数据,共包含1 050张内窥镜图像,来自1 050 例患者,数据收集过程均按照已批准的指引和法规进行。3 位经验丰富的内窥镜医生对图像进行回顾性收集和复查,根据病理组织学报告将内窥镜图像分为非腺瘤性息肉(NAP)、低级别不典型增生腺瘤性息肉(ALP)、高级别不典型增生腺瘤性息肉(AHP)和腺癌(AC)。如图6 所示,第一行为不同息肉类别中的典型图像,第二行为类间相似性大的图像,可以看到,非腺瘤性息肉与腺瘤低级别息肉可能非常相似,而腺瘤高级别息肉与腺癌也可能存在高度的相似性。数据收集过程中内窥镜医生首先检查患者的组织学报告,再到数据库中检索相应的息肉图像,虽然每个息肉存在多个图像,但针对每个病灶只选取一张最佳图像。最终,由标准的白光结肠镜拍摄并被病理组织学证实的图像被纳入数据集。

图6 不同类型息肉图像。(a) NAP;(b) ALP;(c)AHP;(d) ACFig.6 Different types of polyps. (a) NAP; (b)ALP; (c) AHP; (d) AC

采集到的结肠镜图像最初包含用于显示检查仪器系统信息的黑色区域。此外,采集系统和拍摄设置存在差异,原始结肠镜图像的分辨率也不相同。为了标准化的数据集,对原始图像进行预处理,通过mask 技术去除不必要的黑色区域,并将图像剪裁为480 像素×480 像素大小。医学图像数据集由于样本数量较小,类间数据不平衡的问题[29],通常会通过数据增强操作来扩充数据集并增加噪声数据,增强网络模型的泛化性能与鲁棒性[30]。数据集的构建选取了包含旋转、平移、翻转、高斯噪声、模糊、对比度调整、亮度调整一系列图像增强方法,结果如图7 所示。

图7 图像数据增强。(a) 剪裁后图像;(b) 旋转操作;(c) 平移操作;(d) 水平翻转;(e) 高斯噪声;(f) 模糊操作;(g) 调整对比度;(h) 调整亮度Fig.7 Image data augmentation. (a) Cropped image; (b) Rotation operation; (c) Translation operation; (d) Horizontal reversal; (e) Gaussian noise; ( f) Fuzzy operation; ( g) Adjusting contrast; (h) Adjust brightness

根据肠道息肉活检的组织病理结果构建了一个息肉四分类数据集,其中包含非腺瘤性息肉图像(NAP)300 张、低级别不典型增生腺瘤性息肉图像(ALP)400 张、高级别不典型增生腺瘤性息肉图像(AHP)200 张和腺癌(AC)图像150 张。所有类别按照4 ∶1的比例将数据随机划分为训练集与测试集,确保训练集和测试集独立不重叠,并在此基础上进行五折交叉验证。由于获得的原始数据集各个类别存在数据不平衡,因此采用数据增强的方法平衡补充数据集,对非腺瘤性息肉图像随机扩充4倍,对低级别不典型增生腺瘤性息肉图像随机扩充3 倍,对高级别不典型增生腺瘤性息肉图像随机扩充6 倍,对腺癌图像随机扩充8 倍,数据集具体规模如表1 所示。

表1 数据集的具体规模Tab.1 The specific size of the dataset

1.6 实验细节

所提出的网络模型是在服务器上使用PyTorch实现的,使用显卡型号均为NVIDIA2080Super,算力7.5。网络训练采用二阶段训练方案,在第一阶段,考虑到所构建的数据集只包含类别标签而不存在分割标签,因此边缘检测阶段的网络先在公开数据集ColonDB[19]上进行训练,初始化学习率设为1×10-5学习率的衰减率设为0.1,每50 轮衰减一次,输入的batch size 设置为8 以及训练epoch 大小设置为200;在第二阶段,固定边缘检测阶段所使用网络的最优参数,使用构建的数据集对息肉分类阶段所使用的网络进行训练,此处选择Adam 优化方法,其中β1=0.5,β2=0.999,batch size 设为32,权重衰减常量设为1e-5,初始学习率设为0.001,每30 轮下降0.1,epoch 设为100。

1.7 损失函数与评价指标

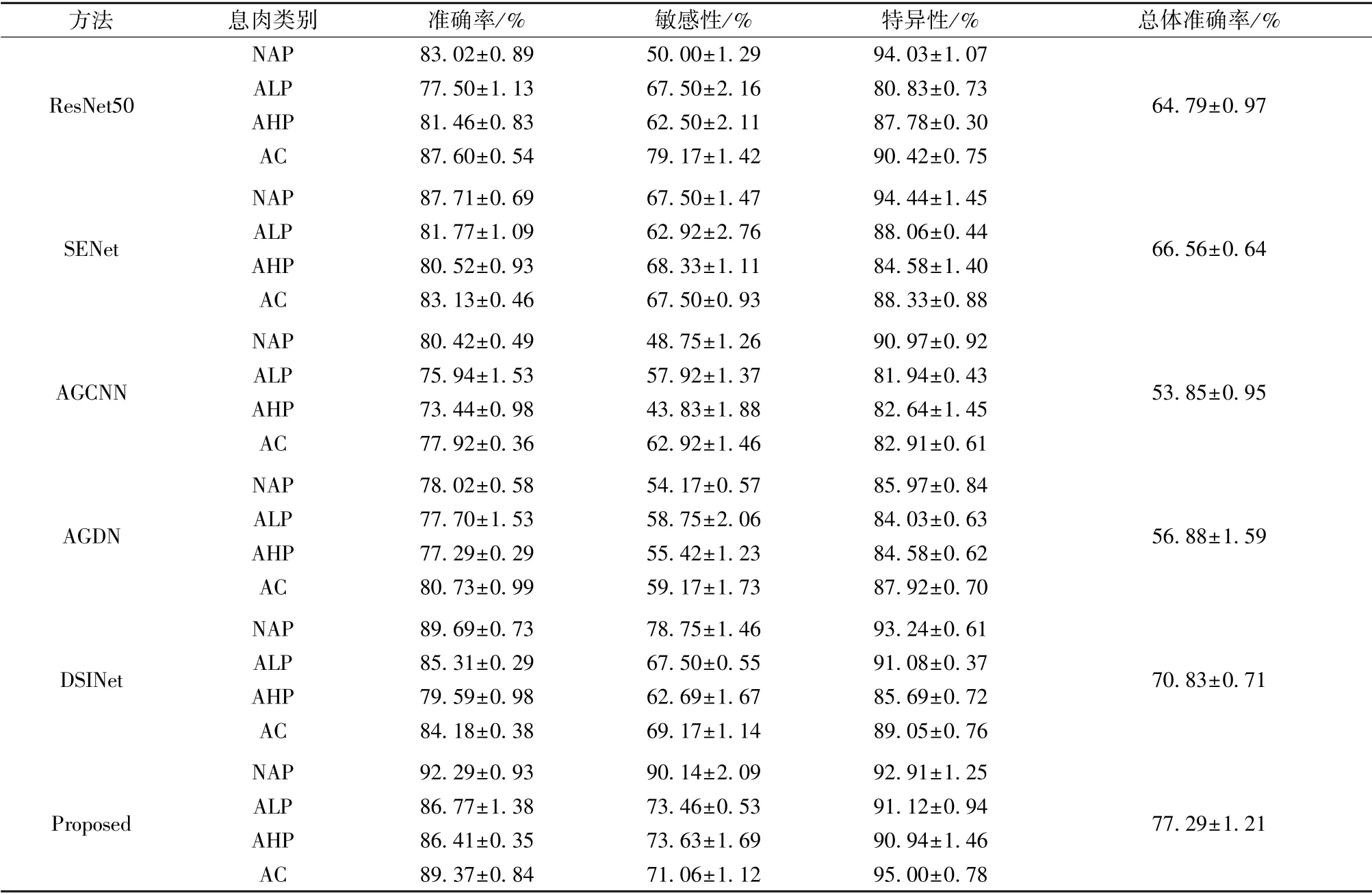

采用传统的二值交叉熵损失函数来训练的网络,通过最小化训练样本网络预测值和真实标签之间的交叉熵,其定义如下:

式中,I为输入训练图像,表示将输入图像I预测为第c类的概率,lc表示输入图像真实标签的one-hot 编码格式,C为总类别数,此处为4。

对于多分类任务,通常使用总体准确率(Overall Accuracy,OA)、准确率(Accuracy)和两个临床指标:敏感性(真正类率,Sensitivity),用来描述网络识别出的真阳性样本占所有阳样本的比例,特异性(真负类率,Specificity),用来描述网络检出真阴性患者的能力,来评价分类算法。

式中,NNAP、NALP、NAHP、NAC分别表示非腺瘤性息肉、腺瘤低级别、腺瘤高级别以及腺癌四种类型中正确分类的样本数量,Ntotal表示测试集中总的样本数量,TP、TN、FP、FN 分别代表图像预测为真阳性,真阴性,假阳性,假阴性的数量。

2 结果

2.1 消融实验

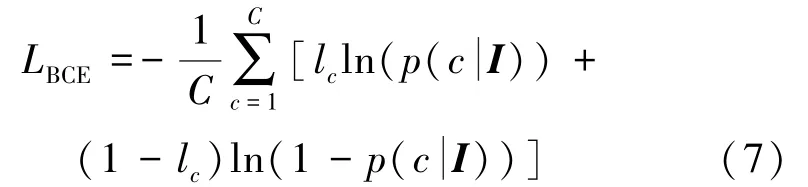

所提出方法主要由3 个关键部分组成,反向注意力边缘监督(reverse attention edge monitoring,RAEM)模块,边缘特征描述子提取和通道注意力(channel attention,CA)模块。在本小节中,在所构建的数据集上设计了一个消融实验来验证所提方法的性能,具体的实验结果如表2 所示。Baseline1是DenseNet121 骨干网络结果,消融实验结果在第2到4 行,最后一行显示了所提网络的性能。总体来说,在消融实验中逐个增加所提出的模块时,评价指标均得到一定程度的提高,所提出的方法展现了最佳的分类性能,总体准确率为77.29%。大多数错误分类的图像集中在非腺瘤性息肉和低级别腺瘤性息肉以及腺瘤高级别和腺癌之间,这是由于两两类别之间在内窥镜检查拍摄的图像上表现非常相似,即使是经过专业训练的内窥镜医生也难以保证较高的分类精度。所提出方法在非腺瘤性息肉、腺瘤低级别性息肉、腺瘤高级别性息肉以及腺癌的分类准确率分别达到92.29%、86.77%、86.41%和89.37%,与DenseNet121 骨干网络相比,分别提高了4.69%、5.31%、11.93%和0.93%,体现了FEPCNN 的有效性。

表2 消融实验结果Tab.2 Results of ablation experiment

在边缘检测阶段的主干网络中加入了RAEM 模块,能够更精准地提取息肉的边界,辅助后续对息肉边缘特征的提取。消融实验中Baseline4(加入了边缘特征描述子提取和RAEM)相比于Baseline3(仅加入边缘特征描述子提取)的分类总体准确率提高了0.92%,进一步验证了RAEM 的有效性。边缘特征描述子提取增强了分类网络的性能,将医生诊断时的先验信息融入网络,增强了分类网络的鲁棒性,可以看到,Baseline4 相较于Baseline1 总体分类准确率增加了7.17%。此外,在通道注意力模块中选择不同池化操作来验证对网络分类性能的影响。通过比较Baseline6(利用最大池化生成后续特征图) 和Baseline5(利用平均池化生成后续特征图)的分类性能,可以看出,利用最大池化生成后续特征图的网络对高级别腺瘤性息肉和腺癌有较好的区分度,但网络的总体分类准确率与利用平均池化所得结果相近。总体而言,引入CA 模块能够通过通道注意力自适应地选取具有判别性的特征,为重要性不同的特征添加不同的权重,从而提高分类准确率。

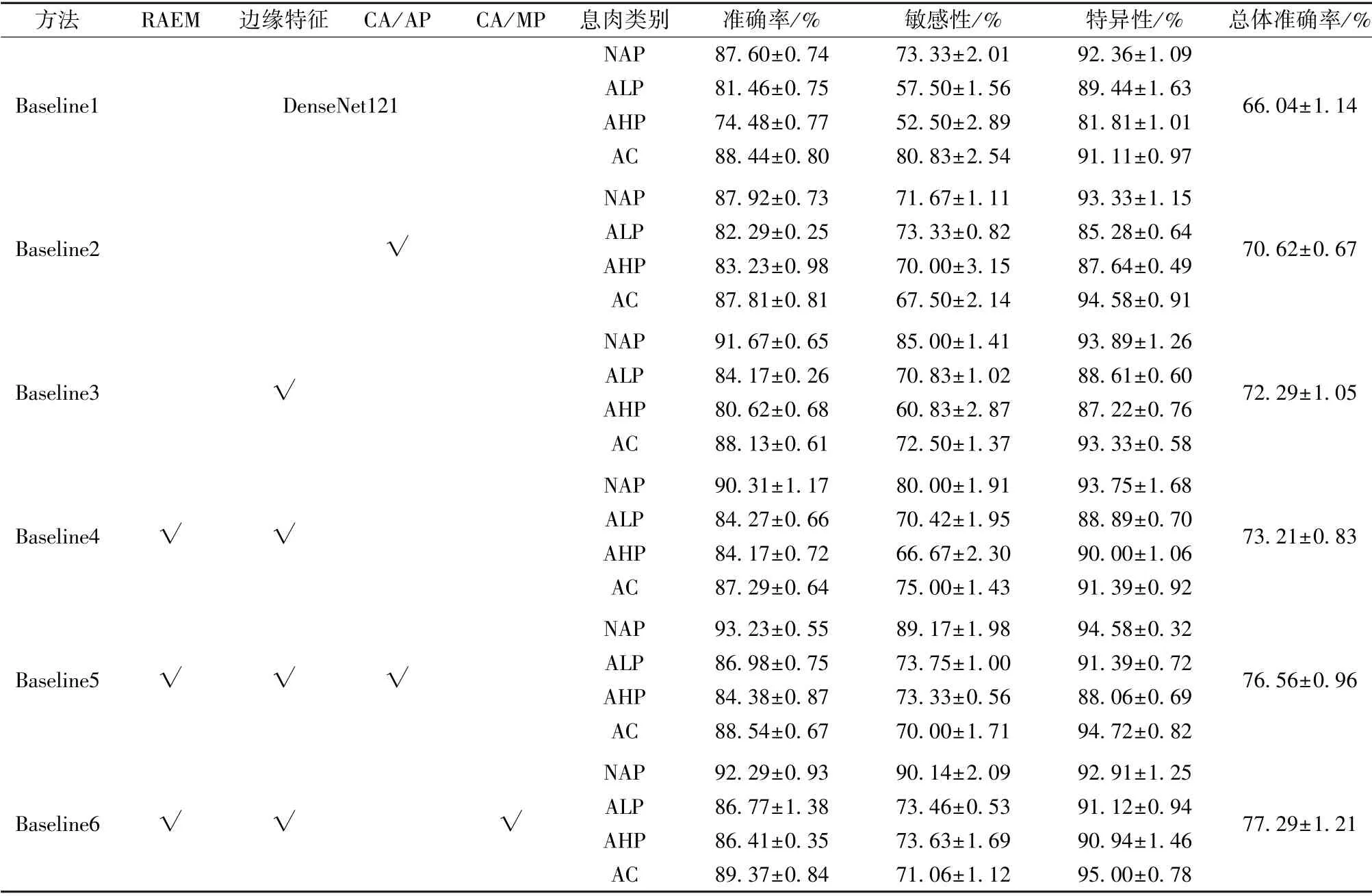

2.2 对比实验

与经典的深度学习方法 ResNet50[22],SENet[31],AGCNN[32]以及专门用于肠道图像分类的网络AGDN[25],DSINet[33]进行了比较,进一步说明所提网络的性能,实验结果如表3 所示。其中,AGDN[25]和DSINet[33]是现有较为出色的肠道图像分类网络。所有的对比网络均在所构建的息肉四分类数据集上进行五折交叉验证,通过分析准确率、敏感性、特异性和总体准确率这4 个指标来说明FEP-CNN 的息肉分级性能。为了进行公平的对比,对比方法均按照其作者在参考文献中提供的实验细节来实现。通过表3 实验结果可以看出,模型表现优于其它现有的分类网络模型。与专门用于肠道图像疾病分类的AGDN 和DSINet 网络相比,所提出的边缘先验信息下的深度学习息肉分类网络在息肉四分类数据集上的总体分类准确率达到了77.29%,分别提高了20.41%和6.46%。

表3 与其它深度学习方法进行性能比较Tab.3 Performance comparison with other deep learning methods

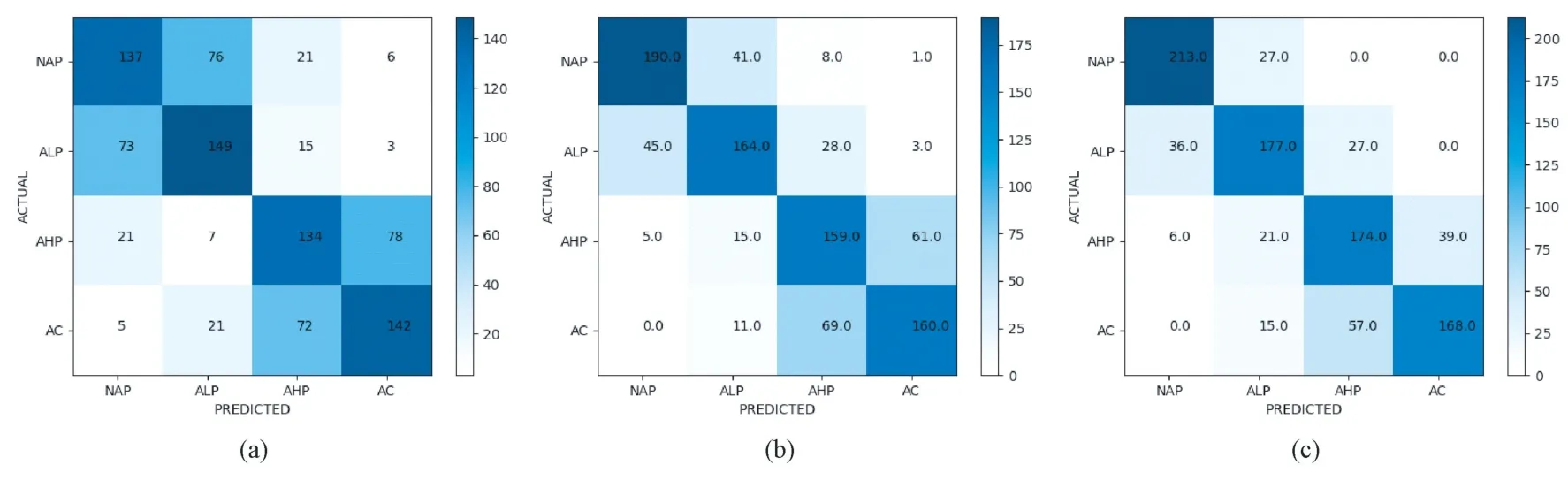

通过可视化AGDN、DSINet 以及方法的混淆矩阵,如图8 所示。与AGDN 和DSINet 相比,所提网络能够更好地区分两组类间相似性高的息肉类别:非腺瘤性息肉(NAP)与腺瘤低级别息肉(ALP)、腺瘤高级别(AHP)与腺癌(AC)。针对数据集中的各个类别NAP、ALP、AHP 以及AC,所提网络在不同息肉类别上的准确率、敏感性和特异性指标相较于其它方法多数都获得了一定程度的提高。

图8 混淆矩阵可视化。(a)AGDN;(b)DSINet;(c)本方法Fig.8 Confusion matrix visualization. (a) AGDN; (b) DSINet; (c) Proposed

3 讨论

本研究为了提高对息肉类间高相似度图像的区分能力,设计了一种边缘先验信息下的肠道息肉多分类算法(FEP-CNN),并结合数据增强策略来进一步提高其分类准确率。

通常而言,提高CNN 特征学习能力主要有两个途径:增加网络的宽度或增加网络的深度。但是网络过深通常会带来训练参数过多,误差积累以及梯度消失等问题,在训练集样本数量小的情况下,也会产生网络过拟合的问题。Huang 等[23]提出的DenseNet 从特征的角度入手,通过充分利用浅层特征以达到更好的效果,能够更好地提取特征,并有效减少了网络参数量,具有很好的抗过拟合能力,泛化性更强,更适合用于医学图像数据集小的场景。因此,FEP-CNN 选取了DenseNet121 作为息肉分类阶段的主干网。

对于胃肠道息肉图像分类任务,先前的工作大多都基于单一的深度学习网络对增生性息肉与腺瘤性息肉进行分类。尽管深度学习在自然图像以及一些区分度较高的医学图像分类任务中表现出了优越的特征提取能力,然而在息肉多分类任务中,由于肠道环境复杂且不同类型息肉病灶的相似度较高,仅靠单一的深度学习网络难以提取到具有较高判别性的特征。在表3 所示的实验结果中,FEP-CNN 与专门用于肠道图像分类的网络AGDN[25],以及DSINet[33]也进行了比较。由于DSINet 包含分割和分类的协同网络,也能够达到较好的分类结果;而AGDN 注意引导变形网络通过单一的卷积神经网络来提取息肉特征,难以区分类间相似性高的图像。本研究所提出的FEP-CNN 分类总体准确率与AGDN 和DSINet 相比分别提高了20.41%和6.46%,这是由于该网络融入了临床中医生的诊断经验。经验丰富的内窥镜医生在诊断时通常会关注息肉的真实大小和边缘是否粗糙。雍和礼等[34]通过临床实验数据说明息肉越大,表面越粗糙,不典型程度越重,发生癌变的几率越高。Fu等[35]指出腺瘤的高低级别划分与其大小和发育不良程度直接相关。Rodriguez-Diaz 等[36]通过统计数据集中息肉类别与其大小分布,也说明了息肉大小能够作为辅助信息来对息肉进行分类。因此FEPCNN 通过评估息肉边缘周长相对大小并结合边缘光滑性来提高息肉多分类的准确率。于俊清等[37]指出融合高层语义信息和底层语义信息能够更好地利用各个特征的互补性。因此,FEP-CNN 将医生关注的边缘视觉特征与深度学习网络进行融合,补充了单一深度学习网络提取的深层语义特征的不足,优于传统深度学习在息肉多分类任务上的表现。

本研究还存在一些局限:有标注的息肉多分类图像数据集较难获取,若能增大原始图像数量,可进一步提高网络的分类准确性与鲁棒性;临床中医生诊断时通常会从多个角度观察同一病灶,可视为利用病灶的多幅图像联合进行分类,本研究的方法还是针对单幅图像进行分析,若能扩展到分析多幅图像,则分类精度有望进一步提高。

4 结论

针对肠道息肉多分类任务中存在类间相似性高的问题,提出了一种边缘先验信息下的分类网络(FEP-CNN)。边缘检测阶段的反向注意力边缘监督模块,捕获更多的息肉边缘细节信息。边缘特征描述子提取阶段提取了息肉边缘周长大小以及光滑度特征作为医生临床诊断的先验信息融合到后续的分类网络。息肉分类阶段的通道注意力能够自适应地捕获判别性特征。在构建的四分类数据集上验证了FEP-CNN 更适合类间相似性高的息肉分型任务,通过引入边缘先验信息提高模型分类精度。在后续的工作中,会加大受试者的数量,扩充数据集,增强模型的稳定性和泛化性,并考虑将设计的网络模型移植到无线胶囊内窥镜成像领域中。