高风险场景下微表情高暴露的可能性实证研究

2022-10-18鲁绍愿李婧婷东子朝马崟桓王甦菁庄东哲

鲁绍愿, 李婧婷, 东子朝, 王 港, 李 振, 马崟桓, 王甦菁, 庄东哲

(1.中国科学院心理研究所, 北京 100101;2.中国科学院大学心理学系, 北京 100049;3.江苏科技大学, 江苏镇江 212000;4.济宁职业技术学院, 山东济宁 272000;5.中国人民公安大学, 北京 100038)

0 引言

面部表情作为情感的外在表现,分为微表情和宏表情,这两种表情的区别在于持续时间和强度等。宏表情通常涉及整个面部范围的运动,持续时间较长,在0.5 ~4 s 之间。 即使受到眨眼或吞咽等小范围动作的影响,也可以很容易地识别宏表情[1]。 相反,微表情是自发的、微妙的、带有情绪体验的局部动作,持续0.04 ~0.2 s[2]。 当人们试图隐藏或抑制自己的真实情绪时,尤其是在高风险场景下,即使宏表情可以被掩饰,微表情也会泄露出来,从而暴露出真实的情绪[3]。 因此,通过微表情分析识别隐藏情绪的研究正在迅速增多[5],主要集中在微表情自动化检测和识别技术上。

随着深度学习技术的出现,计算机视觉在人脸情感识别方面取得了重大进展。 多种面部线索被用作情感计算的特征。 如Benitez-Quiroz 等人提出,利用模型学习面部颜色特征,可以识别个体的面部表情[6]。 此外,微表情作为一种揭示人类情感的线索, 主要的数据库有 CASME[7-9], SMIC[10],SAMM[11]和MMEW[12],大约1 000 个视频样本。 其中,由中国科学院心理研究所创建的CASME 系列数据库(CASME、CASME Ⅱ、CAS(ME)2)已被来自50 多个国家的600 多个研究团队申请使用。 在这些数据库的基础上,很多学者对自动微表情分析进行了大量的研究,如图1 所示。 微表情自动分析包括微表情检测和识别,微表情检测是对未知视频中的微表情片段进行定位,微表情识别是对给定的视频片段进行表情分类。 微表情检测的方法正在从手工特征差异比较方法[13-14]向深度学习方法[15-16]过渡。 同时,早期的微表情识别的方法是手工特征与机器学习[17-19]相结合,但目前主流的算法是基于深度学习识别微表情[20-22]。

图1 自动微表情分析的研究趋势

然而,与微表情自动分析研究相比,关于微表情背后的认知和生理机制的研究却很少。 这样的研究是至关重要的,因为在更好地理解微表情背后心理活动的基础上,可以发展出更准确的分类方法。 最早关于微表情理论的研究是达尔文在《人与动物的表情》中提出,一些面部表情是无法抑制的,即便有极大的主观努力也无法做到[23]。 而微表情最早是Haggard 和Isaacs 在临床研究中发现的[24]。 他们认为,微表情是由无意识的冲突抑制引发的一种快速且微弱的表情。 后来,Ekman 和Friesen 逐帧检查了来访者的访谈视频,发现微表情的本质是个体试图抑制或管理自己的面部动作[25]。 这种无意识的情感泄露通常只会持续很短的时间,然后被隐藏或消失[4]。 研究者们普遍认为,说谎者在高压下可能会经历沉重的认知负担,因为欺骗行为很可能会导致严重的后果,主要是被揭露后受到的惩罚[26],在这种情况下,自主和非自主的表情对抗会产生微表情。虽然许多实验假设微表情与高风险场景高度相关,但没有实证研究证明它们之间的关系。

模拟犯罪范式具有较高的生态效度,它模拟了一个现实中用于决策的风险场景。 在模拟犯罪研究中,为了激励被试提供无罪释放的动机[27],成功作弊的被试会得到奖励(更多酬劳),失败的被试会受到惩罚(做数学题)[28]。 而选择不说谎的被试不会得到任何额外的奖励和惩罚。 因此对于被试而言,高风险往往意味着高回报,被试可以根据奖惩设置自愿选择[29-30]。 此外,研究表明,与正常人相比,嫌疑人在回答与犯罪相关的问题时有更明显的生理反应,包括皮肤电导增加、呼吸抑制更大、心率下降更明显等[31]。 因此在隐藏信息测试(CIT)过程中,通过与真实回答作进行比较,研究人员可以识别针对欺骗反应的特定生理指标[32],从而区分说谎者和非说谎者[31]。

由于微表情能够识别隐藏情绪的特性,使微表情在公安侦讯、国家安全等领域具有巨大的应用潜力。 为了保证微表情分析在这类高风险场景下的可靠性和有效性,我们在本文中进行了实证研究,探讨微表情的产生机制。 具体来说,为了满足高生态效度、可行性和伦理要求,在本研究中使用模拟犯罪范式研究欺骗行为,使用CIT 方法进行基于定向反应假说的欺骗检测实验过程。 CIT 方法是一种标准化的、易于复制的程序,且不需要专业的训练[33],因此未经训练的审讯者也能够很好地完成。 此外,实验通过设置不同的奖惩规则,模拟两种风险水平下的欺骗检测场景,既具有真实性也符合伦理要求。 本实验目的是研究风险场景和微表情之间的关系,从而验证微表情的产生机制假设:与低风险场景相比,当个体在高风险场景中存在欺骗行为时,会产生更多的微表情。

1 方法

在本文中,我们使用了模拟犯罪和CIT 的组合范式,旨在揭示欺骗检测中微表情的基本原理。 基于此微表情持续时间的定义,本实验探索了模拟犯罪场景下两种风险水平的微表情表达规律。 在CIT问题询问中也进行了创新,加入与问题同步的提示图片作为视觉刺激,目的是增加被试的认知负荷,从而收集到生态效度高的微表情样本。 分析数据时,对实验中录制的视频进行编码,以识别微表情的起始帧和结束帧。 通过编码微表情视频的起始帧,可以截取到相应区间的生理信号,即皮肤电活动(EDA)。 通过对数据模态的扩展,我们可以从多个维度分析微表情。 本实验旨在探讨不同风险水平下,生理指标是否有显著变化,微表情泄露程度是否有显著差异。

1.1 被试

实验共招募62 名被试,所有被试的平均年龄为21.22 岁,年龄标准差为0.95,两两分为一组,获得31 组有效数据。 在每组中,一名被试是模拟犯罪和接受审问的被试,另一名被试是审问过程中的审讯员。 各组设置满足以下条件:每组的被试是同性别的(实验中共有15 对男性和16 对女性);每组被试彼此不认识,来自不同学校或同一学校不同专业;所有被试的年龄在18 ~26 岁之间;均无精神病史、无心理或认知障碍;均为右利手。

1.2 设备和材料

实验设备:一个BIOPAC MP160 多通道生理仪器;一个Intel RealSense D415 深度摄像机;一个阵列麦克风和两台带有两个显示器的计算机。 具体来说,实验使用一对11 mm 接触的Ag-AgCl121 一次性电极,填充等渗凝胶,收集EDA 信号。 传感器放置在非优势手手指指腹下方,并用医用胶带固定。 实验中以以200 Hz 的采样率记录数据,设备导出数据是相对于每个被试的基线水平的变化值。 深度相机的分辨率为1 280 720 像素,帧率为30 fps。

实验需要两个房间分别执行两项任务。 设置模拟犯罪室和模拟审讯室,使被试在整个实验中充分体验执行实际偷窃行为和接受审讯的过程。 为了提高偷窃动机,我们设置了两个等级的奖惩规则,允许被试自主选择。 在审讯过程中,使用深度相机收集面部图像,并使用阵列麦克风记录语音对话。 模拟讯问过程采用CIT 问题和开放式问题。 当被试回答CIT 问题时,他们面前的显示器会同时显示相关问题中提到的关键线索的图片,以增加被试在模拟审问中的视觉刺激和认知负荷。 最后以开放性问题结束审讯过程。 通过设置不同的奖惩规则,本研究模拟两种不同水平的欺骗风险,探讨高、低风险场景下的微表情暴露程度。

1.2.1 模拟犯罪室设置

图2 和图3 呈现了房间的布局和关键线索。 门的左边挂着一把伞。 一张长桌子放在离门1 m 远的地方。 一个笔记本放在桌子上,其中一页上写着行李箱的密码:320。 另外一张桌子下的行李箱里有一套钥匙和一个立方体(五面为白色,一面为黄色箭头)。 桌子右边1 m 的地方有一把椅子。 椅子后面放着一个柜子。 手提箱里的钥匙可以打开柜子上的锁。 第一个抽屉里有一个手电筒,第二个抽屉是空的。 第三个抽屉里有一个鼠标,鼠标下面压着两张100 元的钞票。

图2 模拟犯罪室设置

图3 模拟犯罪室内的线索

1.2.2 模拟审讯室设置

在入口1 m 处有一张长桌子,桌子后面放着一把椅子(被试的座位),桌子中间有一个电脑显示屏,如图4 所示。 在显示屏前放置阵列麦克风,在显示屏上方放置Intel RealSense D415 深度摄像机,在显示屏后放置BIOPAC MP160 多通道生理仪。 在桌子的左右两侧,有一个辅助灯;桌子的前面是审讯员的座位,生理仪器数据显示放在桌子的旁边,前面右边是陪审员(主试)的座位。

图4 模拟审讯室设置

1.2.3 审讯过程

在模拟审讯室中,我们使用54 个CIT 问题和开放式问题与被试进行交流。 测谎过程中的所有问题都是基于模拟犯罪室内的关键线索,如图3 所示。只有一个问题的线索真实存在于模拟犯罪室中,其他问题的线索都是假的。 要求被试对任务相关的CIT 问题作否定回答,对与个人相关的CIT 问题作肯定回答。 每一组问题中与任务不相关的问题即干扰问题,以确保被试认真倾听每一个问题并进行不同的回答。 审讯问题例如:

①对于与任务相关的CIT 问题,“桌子上有信封吗?”,要求被试回答:“没有”;

②对于与个人有关的CIT 问题,被问及者要回答“是”;

③对于开放式问题,被试需要根据自己的场景和想法做出陈述。

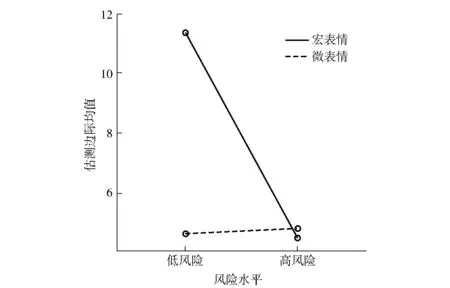

1.3 程序

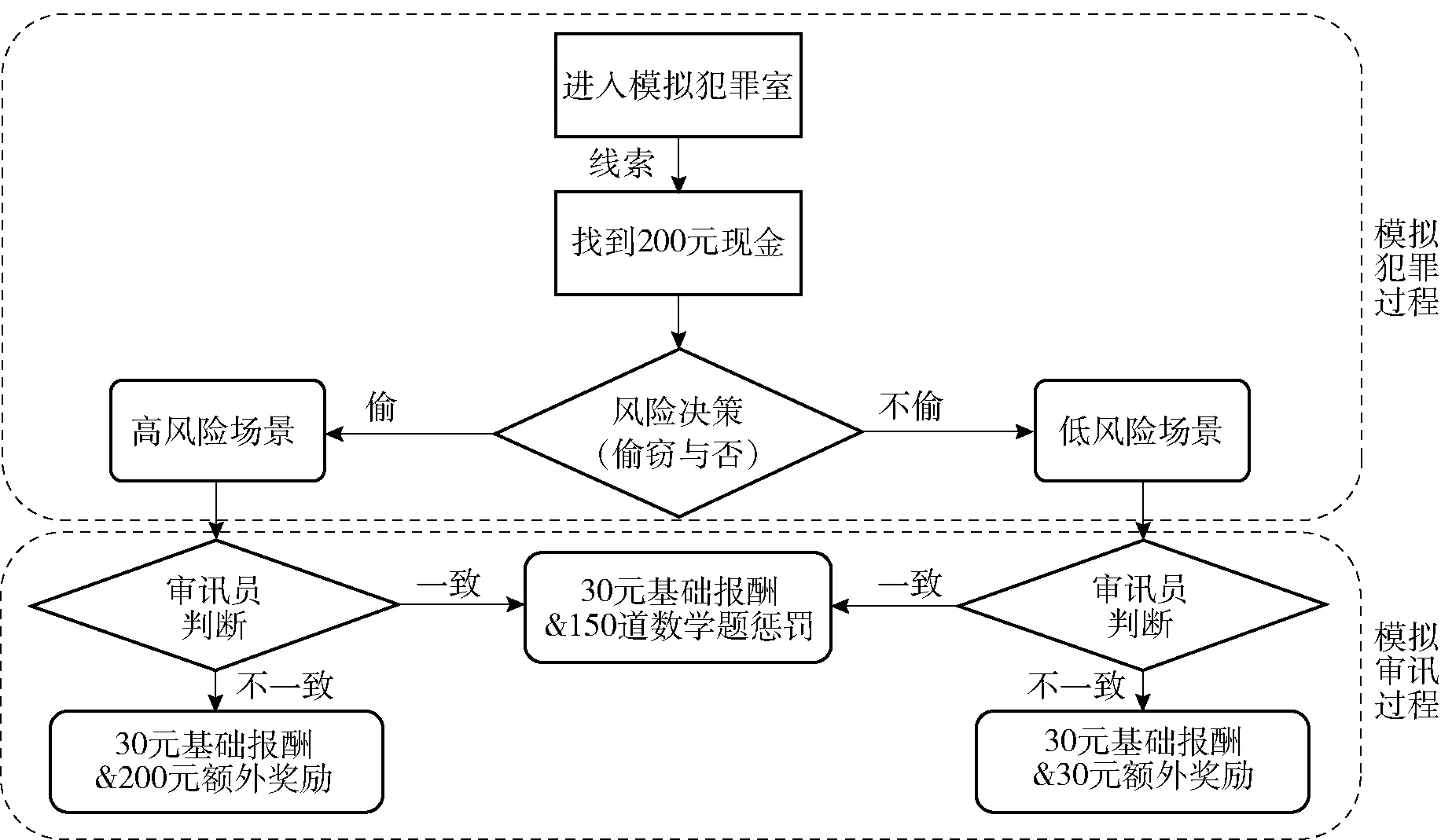

在本实验中,被试首先被要求单独进入模拟犯罪室完成风险决策任务。 具体来说,我们鼓励被试根据房间里的线索找到隐藏的现金。 在找到现金后,被试可以独立选择是否偷窃即完成高风险任务或低风险任务。 高风险和低风险的任务是由他们的行为决定的,如把钱放在口袋里即选择了高风险任务。 整个任务流程如图5 的上半部分所示。 在这一过程中,审讯员并不在场。 然后被试需要写下他们的选择,并把它们放在信封里。 直到模拟审讯结束后,将打开信封进行结果评估。

在完成模拟犯罪过程后,被试进行模拟审讯任务,在此过程中我们记录了视频、音频和生理数据。被试回答一些与任务相关或不相关(与个人相关)的问题,并回答一些开放式问题。 对于与任务相关的问题,被试应该给出否定的回答,即“不是”。 对与任务无关的问题即一些个人相关的问题,被试应该给出肯定的答案,回答“是”。 对于开放式问题,要求被试根据实际情况如实回答。

最后,我们根据被试在模拟犯罪过程中的选择和被试在模拟审问任务中的表现来确定被试的报酬。 如果被试选择了高风险的任务,而审讯员判断准确,即被试没有成功欺骗审讯员,只能得到30 元的基本费用。 此外,被试还将被罚150 道基础数学问题,并要求在10 min 内完成,准确率在95%以上。如果被试选择了高风险的任务,但审讯员判断错误,即为被试成功欺骗审讯员,将获得30 元的基本费用,并获得他们之前偷窃的200 元额外现金。 如果被试选择了一个低风险的任务,但审讯员判断错误,那么被试将获得30 元的基本费用和额外的30 元作为奖励。 否则,如果审讯员有同样的判断,也就是说,被试没有成功对审讯员说谎,这个被试会收到30 元基本费用,以及与上述相同的处罚。 模拟审讯过程中的判断见图5 的下半部分。

图5 模拟犯罪室和审讯程序图

1.4 数据分析

我们对实验中记录的原始数据分别进行处理,包括微表情视频的标注和生理数据的分析。 由Intel RealSense D415 深度相机录制的视频样本被输入微表情编码与共享系统MECSS①http://mecss.psych.ac.cn/进行编码。 本研究使用的MECSS 是中国科学院心理研究所开发的微表情编码系统。 在微表情编码后,根据标注的时间区间截取对应的生理信号,EDA 作为情感和交感神经的敏感、标准的生理指标[34]被输入到Social Science 26.0 SPSS 的Statistical Package 中进行分析,用于证明在高危环境中的有效性。

本实验使用了双人编码的方法,编码人员以0.5 倍的速度观看每个被试的审讯视频,并在MECSS 系统上标注出与情绪相关的面部动作。 在编码过程中,只关注有情感意义的表情,排除由眨眼和说话引起的表情。 根据Intelr RealSenseTM D415 相机的参数,15 帧意味着500 ms 的持续时间。 根据微表情持续时间的定义,我们以500 ms(15 帧)为基础,将录像中已标注的面部表情分为微表情和宏表情。然而,在视频采集过程中帧丢失是不可避免的。 考虑到误差的存在,我们将微表情的帧数判别标准定为小于等于16 帧。 为了避免实验者效应,两位编码员都没有参与实验设计和数据收集过程(包括选择的风险场景和询问内容)。 详细的微表情编码方法请参考CASME 系列数据库的文章[7-9,37]。 最终两名编码人员协商了双重编码的结果。 共编码648 个表情,排除135 个表情,排除率为20.8%,其中15.8%为重复表情;5%是不一致的。 每个表情起始帧和结束帧被用来编码EDA 数据对应的时间区间。

2 结果

本实验使用深度相机和BIOPAC 共采集31 组数据。 人工标注面部表情起始帧和终止帧后,截取相应时间区间内的EDA 变化值。 我们利用SPSS 软件的方差分析检验各组间差异,采用Levene 程序检验方差齐性,比较被试在不同风险场景下的平均值和标准差。

2.1 个体层面分析

本实验分析了31 名被试的数据,其中18 名被试选择了高风险场景,13 名被试选择了低风险场景。

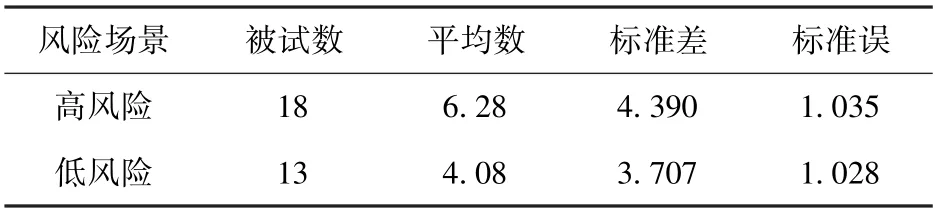

首先,我们比较了高风险和低风险下微表情的平均数量。 高风险和低风险的人均微表情数之比为1.53。 本文报告的统计结果来自95%置信水平下的独立样本t检验,差异无统计学意义,t(29) =-1.467,p= 0.153,d= 0.541。 然而,高风险组(M=6.28,SD=4.39)产生的微表情数量高于低风险组(M=4.08,SD=3.71),如表1 所示。 也就是说,在高风险的情况下,微表情有较高的泄漏可能性的趋势,如图6 所示。 箱线图分别表示高风险和低风险下的微表情数量。 水平线表示平均值,同心圆表示中位数。 从图中可以看出,高风险下微表情的暴露量更大。

表1 高风险场景和低风险场景的微表情组统计

图6 高风险和低风险下微表情的差异图

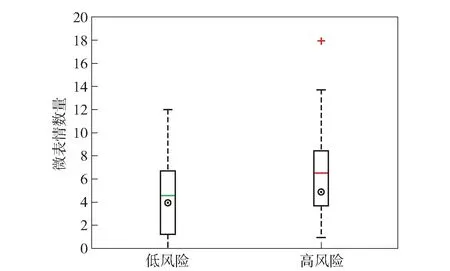

随后,我们还比较了高风险(t(29) =0.382,p=0.707,d=0.640 )和低风险(M=11.85,SD=9.34)下的平均宏表情数的差异,发现高风险(M=10.72,SD= 5.20)和低风险(M= 11.85,SD=9.34)下的宏表情数差异不显著。 但我们发现,在95%置信水平下,每个被试的微和宏表情差异显著,t(30) =4.336,p<0.01,d=0.78。 宏表情的平均次数(M=11.19,SD=7.42)显著高于微表情的平均次数(M=5.35,SD=4.20)。 但每个被试的微和宏表情数量之间不存在相关性(r(29) =0.26,p=0.15)。

2.2 表情层面分析

为了便于在EDA 中直接比较高风险和低风险场景,我们计算了表情区间内EDA 的平均值。 此外,采用单因素方差分析(One-way ANOVA)评价模拟犯罪和CIT 设计在诱导生理觉醒方面的有效性。方差齐性检验的结果是假设方差相等不成立。 同时,最大振幅方差分析结果显示,风险的主效应显著,F(1,511) =13.82,p<0.01,η2= 0.026。 低风险场景下EDA 的变化(M=7.25,SD=9.79)明显大于高风险场景(M=4.46,SD=7.18)。

最后,对各表情的EDA 数据进行被试间方差分析。 在收集的数据中,对于每个表情,将表情类型(微表情/宏表情)和风险场景(高风险/低风险)进行分组变量。 2*2 方差分析显示,风险场景对EDA的变化有显著的主效应:F(1511) =4.85,p<0.01,偏η2=0.01,低风险场景(M=6.29,SD=9.78)的EDA 数据显著高于高风险场景(M=4.48,SD=7.18)。 同时,表情类型对EDA 的变化也有显著的主效应,F(1511) =5.39,p<0.01, 偏η2=0.01,宏表情的主效应(M=6.33,SD=8.91)显著高于微表情的主效应(M=4.43,SD=7.23)。 表情类型与风险场景之间存在显著交互作用,F(1,511) =6.15,p<0.05,偏η2=0.01。 相互作用效应趋势如图7 所示。 表情类型与风险场景的交互作用表明,不同风险场景下的表情存在不同的生理机制。 同时,不同情景下表情的生理机制与表情类型高度相关[26]。因此,该结论表明,微表情出现在高风险场景下的概率较高。

图7 表情类型和风险场景的交互作用图

3 讨论

在本节中,我们对实验中被试的表现和实验结果进行讨论,从而探讨可能的原因。 首先讨论被试的风险偏好,然后区分被试在高风险场景和低风险场景中产生的不同心理过程,最后得出微表情在高风险场景中更有可能出现的结论。

第一,不同风险场景下收益权衡导致风险偏好。本实验的创新之处在于使用被试自愿选择风险场景的范式。 在收集的31 名被试中,有18 名被试自愿选择高风险,只有13 名被试选择低风险。 这种对回报的风险偏好与以往的研究一致。 心理学研究表明,当人们在不可避免的损失和额外收益之间做出选择时,风险偏好就会普遍存在[35]。 无论选择高赌注还是低赌注,这个实验都有可能获得额外的奖励和惩罚。 因此,在面对足够的金钱诱惑时,参与模拟犯罪过程的被试表现出经济收益的风险偏好,所以我们实验中的被试出现了偏好高风险的现象。

第二,本文统计结果支持高风险与微表情高度相关的假设。 实验结果表明,在高风险场景中产生的微表情比例高于低风险场景,这证实了Ekman 等人的观点,即微表情作为泄露信息的线索,适用于高风险的欺骗检测[25]。 此外,被试在低风险下的欺骗行为不是不偷钱,而是假装偷了钱。 因为没有不道德的行为,这种结构使被试缺乏紧张感和罪恶感[36]。 因此,在低风险场景下,人们通常认为自己的欺骗行为并没有想象的那么严重,所以当欺骗发生时,他们的表情泄露得更少。 在本实验中,高风险场景下的面部表情泄露与低风险场景下的面部表情泄露相比虽然没有统计学上的显著性差异,但是存在高风险下微表情产生更多的趋势,也就是说,在高风险场景下产生的微表情数量更多。 这很可能是因为人们在成功实施欺骗的时候会产生一种成就感,这种成就感受到道德的约束时被压抑,而在高风险下会更难以控制,最终产生情绪泄露,以微表情的形式表现出来。 因此,相比低风险场景,个体在高风险场景时更可能产生表情线索的泄露——微表情。

第三,不同的风险场景和不同的表情类型下EDA 指标存在显著差异,且两者存在交互作用。EDA 指标作为情感和交感神经的敏感、标准的生理指标,可以一定程度上反映出被试内心的真实心理状态,也就是说,在高风险和低风险场景下被试的交感神经活动存在显著的差异,同时,在微表情和宏表情下被试的情绪和情感也存在显著的差异;另外,实验结果还可以证明在风险场景和表情类型的交互作用下,被试的生理和心理状态都存在不同。

4 结论

综上所述,本研究探讨了高、低风险场景下生理指标的差异以及高风险场景对微表情的影响。 (1)实验结果证明了一个以前没有被实证研究的结论:微表情有更高的概率发生在高风险场景下在生理指标上;(2)不同场景(高风险/低风险)下产生的不同表情(微表情/宏表情)的EDA 指标存在显著的差异;(3)表情类型(微表情/宏表情)和风险场景(高风险/低风险)存在相互的影响。 因此,在未来的微表情提取和分析中,需要更多地关注高风险场景。并且, 这一结论为后续微表情研究提供了生理机制基础。

本文的研究使用EDA 来区分高风险和低风险场景。 在未来的研究中,更多的生理指标可以添加到分析过程中。 另外,被试人数的限制也可能是导致实验结果没有显著差异的原因。 因此,未来可以通过增加被试数量开展进一步的结果分析。 同时,我们将尝试在更多的高风险范式中捕捉微表情,并研究相应的微表情生成机制。