无人机自主降落标识检测方法若干研究进展

2022-10-12赵良玉李丹赵辰悦蒋飞

赵良玉,李丹,赵辰悦,蒋飞

1. 北京理工大学 宇航学院,北京 100081 2. 武警研究院,北京 100012

随着科学技术的飞速发展和军事变革的持续推进,战争的全域化、闪击化、无人化、未知化、非对称化、远程打击化和高精准化要求日益突出,如何构建海、陆、空、天、电全要素作战力量体系,将成为各军事强国亟需解决的重大问题。由于无人平台具备执行“枯燥的、恶劣的、危险的、纵深的”(Dull, Dirty, Dangerous, Deep, 4D)任务的特性,异构无人装备一体化协同作战被认为是推动未来战争从信息化向智能化转变的关键理念之一。此外,利用无人机(Unmanned Aerial Vehicles, UAV)实施非接触空中精确打击正在逐渐成为局部或小规模战争的主要手段,并成为当前跨域无人系统的研究热点。无人机与无人车/无人艇的协同作为一种新的装备战术运用方法可以将异构平台优势互补,有效弥补车辆等运动体的环境感知能力有限这一缺陷,增强其战场态势感知能力和行为能力,有效扩大侦察范围,最大化综合作战效能。除军事用途外,无人机与无人车/无人艇等无人装备的协同也成为辅助人类监测环境、探索自然、维护社会安全、参与救灾抢险等重大任务过程中不可或缺的技术支撑。

作为一种可有限重复使用的飞行器,对完成工作任务的无人机进行回收,最大程度保证其自主复飞能力,增强系统自组织和自适应能力,是提高其效费比和协同能力的前提,这使得无人机能否自主精准降落成为影响其协同作业的关键,也是飞行控制领域的研究热点和难点。美国国防部2004年公布的技术报告指出,美国的固定翼无人机,如“猎人”和“先锋”,有近50%在自主降落过程中出现事故。降落过程作为无人机事故频发的一个阶段,如何实现鲁棒的自主降落成为无人机协同任务研究中最重要和最具挑战性的课题之一。

无人车/无人艇等平台具有运动速度快、区域小、干扰多等特点,这就要求系统在回收末端具备高精度的导航定位能力。由于视觉导航所具有的自主性强、抗干扰性好、精度高等优点,已成为近年来无人机自主着陆段导航方法的首选。视觉引导无人机自主降落一般分为2种,一种是基于人工标识检测实现自主降落,另一种是基于场景识别的自主降落。当下,前者是最主要的研究方向,这使得对降落标识准确识别成为实现无人机在静、动平台自主降落的基础。

国外对基于视觉的无人机自主降落技术的研究起步较早,并取得了丰硕的成果,美国、日本、法国等国家的研究走在世界前列。近些年,国内许多研究机构及学者也致力于无人机与无人车/无人艇协同方面的研究,自2004年举办第一届中国空中机器人大赛以来,陆续实现了无人机的自主起飞、自主飞行和自主降落。北京理工大学在2017年国际机器人挑战赛(Mohamed Bin Zayed International Robotics Challenge, MBZIRC)中斩获移动车辆自主降落项目的冠军,上海交通大学于2018年在国内最早实现基于视觉的旋翼无人机自主水上精准降落,华中科技大学于2019年成功完成无人机/无人艇协同起降试验,进一步推动国内无人机/无人艇协同技术的发展。除此之外,瑞士、奥地利、新加坡等其他国家也一直在从事该方向的研究。

近年来,人工智能技术的快速发展和目标检测方法的不断创新,相关学术论文和技术报告快速涌现,如国内外专家学者针对通用目标检测方法、无人机目标检测技术、机艇协同技术、无人机自主着陆、无人机自主着舰等进行了综述。然而,目前已公开发表的针对无人机自主降落过程中标识检测方法的系统性介绍还比较少,文献[19-20]也只是简要梳理综述了近年来基于人工标识的自主降落方法,并没有针对标识检测算法进行详细介绍。为了进一步促进中国无人机与无人车/无人艇协同领域的研究和发展,有必要对无人机自主降落标识检测方向的研究成果和进展进行梳理。为此,本文将重点介绍近年来无人机自主降落标识检测技术的研究进展,归纳和总结代表性的标识检测方法及成果。同时,结合具体应用场景,对该领域当前研究中存在的问题及未来发展趋势进行展望。

1 视觉引导无人机自主降落流程

无人机与无人车/无人艇的协同工作中,当无人机完成工作任务进行回收时,应尽可能减少平台辅助设备的使用,减少无人机回收对载体平台正常工作的影响,同时最大程度保证其复飞能力。因此,实现全自主精准降落是无人机与无人车/无人艇异构平台协同作业的关键,对于保证全天候任务可靠执行具有重要意义。

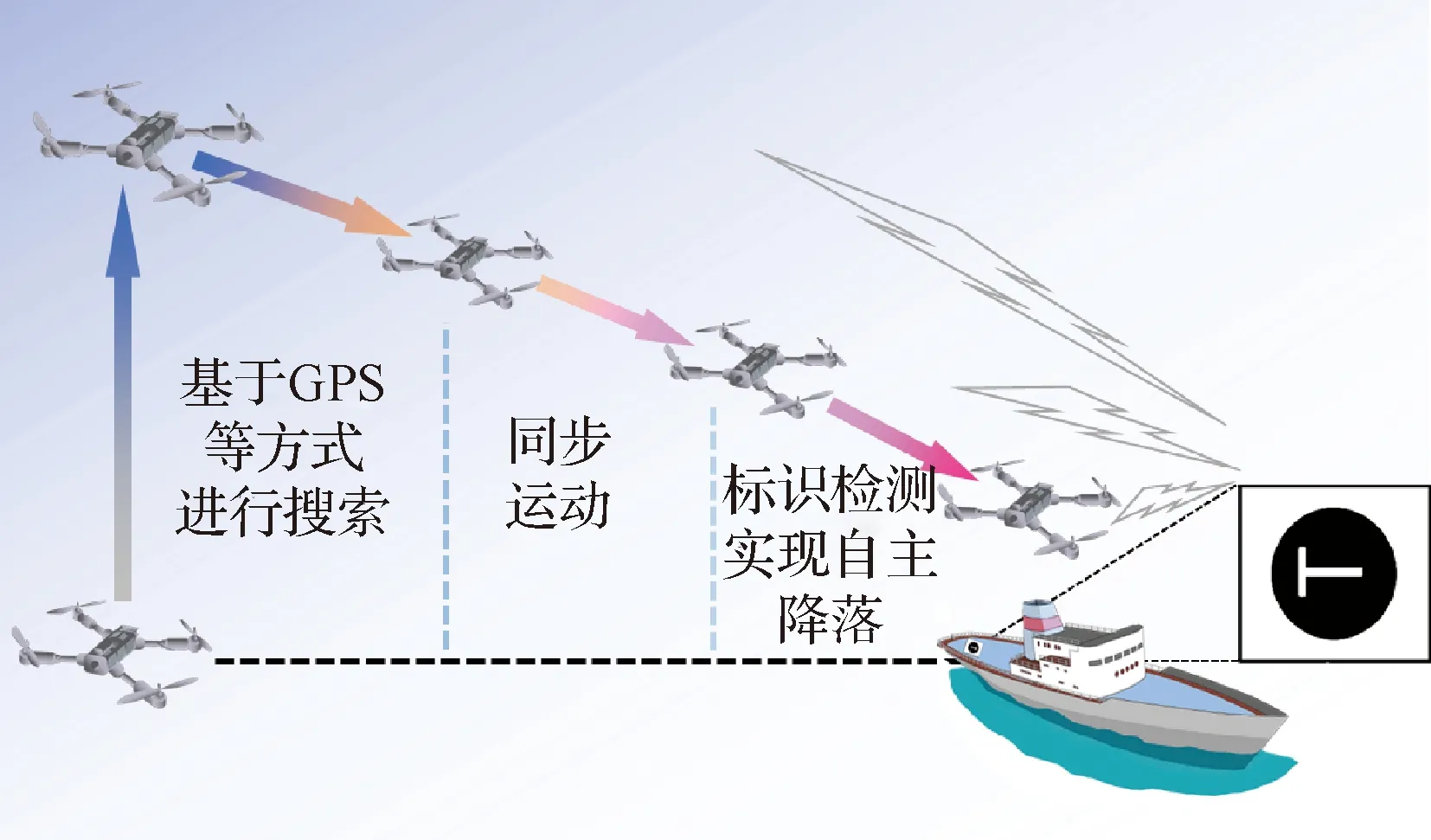

以图1所示基于人工标识的旋翼无人机降落舰艇为例,简单介绍视觉引导无人机自主降落任务的流程。由于视觉设备可观察范围有限,在远程导引阶段,即视觉设备无法捕获标识信息时,采用卫星导航等方式将无人机引导到降落区域,之后采用视觉导引方法进行降落。视觉引导无人机自主降落流程主要包括标识检测、导引飞行和受控降落3个阶段:

1) 由无人机携带的相机等视觉传感器对降落区域的图像信息进行采集,经图像预处理、特征提取、特征匹配等实现标识的检测和跟踪,并不断生成无人机和标识之间的相对位置和相对运动关系。

2) 无人机的飞行控制系统根据上述相对位置和运动关系生成导引指令,引导无人机以合适的方位和速度向标识指定区域抵近。

3) 同样是无人机的飞行控制系统将导引指令转化为其飞行姿态和速度的控制指令,控制无人机精准、快速达到期望状态,如此循环,直到无人机到达标识指定位置,完成降落任务。

图1 基于人工标识的旋翼无人机自主降落Fig.1 Flow chart of rotorcraft autonomous landing based on artificial markers

可以看出,降落标识的检测是实现无人机自主降落任务的前提,其检测结果直接影响无人机自主降落任务的整个过程。其中,标识检测的准确性决定了无人机自主降落任务的成败,标识检测的实时性决定了无人机降落过程中的机动强度和能量需求。

2 标识检测方法

目标检测是计算机视觉及图像处理领域的一个重要研究方向,其基本思想是“what is where”,即在图像中快速准确地识别出待检测目标的类别并精确确定目标的位置。标识检测是目标检测在无人机降落任务中的特殊应用,将目标限制为人工设计的特定标识,通过检测算法快速识别出降落标识并确定其位置信息。从发展历史来看,标识检测技术的进步离不开通用目标检测技术的发展;从检测算法来看,标识检测算法大多沿用通用的目标检测算法,由于基于深度学习的目标检测算法存在计算量大、模型复杂等问题,基于深度学习的标识检测算法大多根据实际应用场景由目标检测算法修改而来。因此,本节在梳理标识检测方法的同时,简要介绍了基于深度学习的目标检测技术的发展脉络,归纳总结了基于图像分割的标识检测方法、基于分类器的标识检测方法和基于深度学习的标识检测方法。

2.1 基于图像分割的标识检测方法

图像分割是根据图像的灰度、纹理、边缘等特性,将图像分割为多个区域。常用的图像分割方法有:最大类间方差法(OSTU)、最大熵法(Maximum Entropy Principle, MEP)、K均值聚类算法(K-means Clustering Algorithm, K-means)等。基于图像分割的检测方法的基本思想是在图像分割的基础上,对标识图像进行特征提取,将提取的特征与模板图像进行匹配以识别标识,再对识别的标识进行定位,达到标识检测的效果。特征的选取主要有:根据标识尺寸信息得到的统计特征;纹理、形状等视觉特征;霍夫变换(Hough Transform, HT)、小波变换(Wavelet Transform, WT)等变换特征。然而,基于分割的标识检测方法只适用于单一场景,针对背景杂乱、快速运动和遮挡等复杂场景检测效果较差,难以满足实际复杂环境下标识检测的快速性和准确性要求。

2.2 基于分类器的标识检测方法

基于分类器的标识检测与其他目标的检测任务相似,是滑动窗口(Slide Window, SW)和机器学习相结合的方法,对于每一个窗口内的图像,提取其特征作为分类器的输入,训练得到最终的学习模型,从而对未知图像进行检测。经典的用于生成特征描述子的算法有:尺度不变特征变换(Scale Invariant Feature Transform, SIFT)匹配算法、加速鲁棒特征(Speeded Up Robust Features, SURF)算法、梯度方向直方图(Histogram of Oriented Gradient, HOG)等;常用的分类器有:支持向量机(Support Vector Machine, SVM)、AdaBoost、K最邻近法(K-Nearest Neighbor, KNN)等。在降落标识检测中,通常根据背景信息与标识图像提取不同特征,或采用联合多个特征的方式进行标识检测,虽然这类方法在一定情况下检测精度较高,但人工提取的局部浅层特征缺乏鲁棒性,且对于不同应用场景下的不同标识,需要设计不同的特征提取方法,算法可移植性较差。此外,这类方法大多基于滑动窗口的方式提取特征,会造成数据冗余和速度减慢,在无人机自主降落中具有一定的局限性。

2.3 基于深度学习的标识检测方法

为了让计算机模拟人类提取特征的过程,更自然地提取图像信息,研究人员不断进行尝试。2006年,机器学习专家Hinton教授在《Science》上发文,提出深度神经网络能够从大量数据中学习高层语义特征的思想,掀起了工业界和学术界对人工神经网络的研究热潮。随着深度学习的迅速发展,卷积神经网络(Convolutional Neural Networks, CNN)与传统目标检测算法相融合,并引入迁移学习的概念,其应用领域迅速扩展,取得优异的成果。Lecun等于2015年在《Nature》上的文章也肯定了深度学习在语音识别、目标检测等领域的贡献。

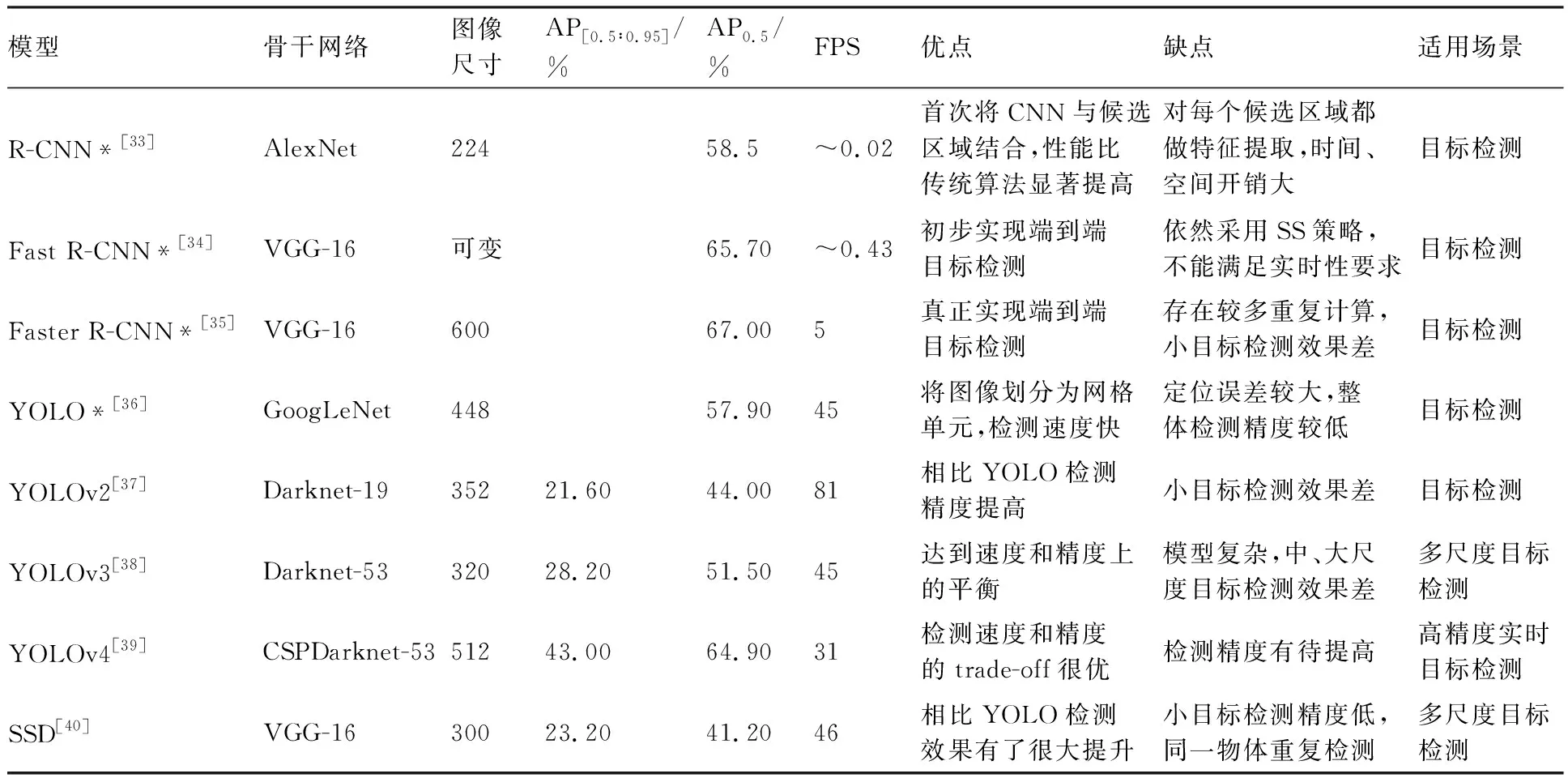

基于深度学习的目标检测算法主要分为基于候选区域的二阶段检测算法和基于回归的一阶段检测算法,发展路线如图2所示,时间轴上方展示了二阶段检测算法的发展历程,时间轴下方展示了一阶段检测算法的发展历程。基于候选区域的检测算法的基本思想是:首先通过SS、Edge boxes等方法,生成目标候选区域,然后利用深度卷积神经网络提取目标候选区域的深层特征,使用这些特征进行目标分类和真实边界框拟合。最具代表性的是Girshick等提出的R-CNN系列检测算法,目前使用较成熟的是Faster R-CNN网络。基于回归的目标检测算法直接从完整图像中预测出目标的类别概率和位置信息,是一种端到端的网络,可以实现检测性能端到端优化。这类算法中最经典的是YOLO系列算法和SSD系列算法。为便于比较各种算法的检测性能、优缺点和适用场景,对经典的目标检测算法进行梳理,汇总于表1,可以看出,一阶段检测算法的速度远远高于二阶段检测算法,但检测精度相对较低。

图2 基于深度学习的目标检测算法发展路线Fig.2 A route for development of deep learning-based object detection algorithms

表1 基于深度学习的目标检测算法对比[13,33-40]

基于深度学习的目标检测技术的快速发展,为标识检测的研究注入了新血液。考虑机载设备的计算能力约束和实时检测需求,基于深度学习的标识检测算法大多在现有目标检测算法的基础上进行优化,以达到兼顾检测速度和检测精度的效果。文献[43]对YOLOv2的特征提取网络进行优化提出LightDenseYOLO算法;文献[44]将改进的SSD与核相关滤波(Kernel Correlation Filter, KCF)算法融合,达到检测速度和检测精度的平衡;文献[45]融合SlimDeblurGAN和YOLOv2算法,解决了自主降落过程中易产生的运动模糊问题。另外,近些年提出的轻量化检测算法如EfficientDet、Gaussian YOLOv3、SlimYOLOv3、Mixed YOLOv3-LITE等,检测速度与精度不断提升,更适用于无人机平台。

简而言之,基于深度学习的标识检测算法的基本思想是:从检测速度、检测精度和模型轻量化的角度对目标检测算法进行优化,融合去雾、去模糊等算法以适应实际应用中的复杂场景,达到标识检测的高精度和高实时性要求。与传统标识检测算法相比,基于深度学习的标识检测算法泛化性好,对特定标识的依赖性小,鲁棒性高,具有广阔的应用前景。

3 自主降落标识检测研究机构及成果

无人机作为无人车/无人艇的重要协作平台,在跨域协同工作中发挥着巨大的作用,国内外很多研究机构及学者围绕无人机自主降落方向开展研究,并在诸多关键技术领域取得十分丰富的成果。

由于车辆、舰艇等平台在无人机降落时可能处于静止和运动2种状态,相较于平台静止状态下标识固定、检测直接,车辆、舰艇等的运动状态则通常具有多维特征,故而增加了很多技术难点和挑战。如运动过程带来的视野变化,要求无人机具有更广阔的视野范围,并能够从不同角度实现标识检测。同时,无人机在进行运动标识检测时,将不可避免地受到更多环境干扰,如背景杂乱、遮挡、光照变化等,这都对标识检测系统提出了更高的技术要求。另外,相比于静平台自主降落任务,如何克服快速运动导致的运动模糊问题也是一大技术难点。为此,本节分别针对静平台和动平台自主降落标识检测研究机构及成果进行归纳,并对当前常用的降落标识及其检测方法和效果进行梳理总结。

3.1 静平台

针对静平台的无人机自主降落研究起步较早。加州大学伯克利分校的Shakernia等在1999年就进行了相关研究。2001年,团队设计了一种由6个白色矩形和1个黑色矩形组成的合作目标,通过图像处理及分割算法检测降落标识,飞行试验表明,系统轴向定位精度为5 cm,姿态角精度误差在5°范围内。美国南加州大学机器人学与嵌入式系统研究室的Saripalli等采用“H”形图标作为降落标识,利用先验知识在预处理后的图像中分割出可能包含目标的区域,通过提取不变矩特征筛选出正确标识,最后利用透视投影不变性完成飞行参数估计。大量测试结果表明,该算法具有一定的准确性和可重复性,这在当时被很多研究者认为是一个突破性的工作,但系统依赖于以下2点假设:① 标识具有明确的几何形状;② 着陆标识的所有特征点共面。清华大学Zeng等利用自适应阈值实现图像分割,通过图像配准识别“H”字符,利用Hough直线检测和面积关系识别三角形以确定航向,算法具有快速、鲁棒、计算成本低的优点,平均检测成功率为97.42%,在2008年的中国机器人大赛中,获得空中机器人组的金奖。

然而基于视觉的自主降落存在一定的局限性,无人机飞行高度较高时,由于标识在相机拍摄的图像中像素占比较小,容易丢失目标,当高度较低时,由于标识成像不完整,也会影响到检测效果。为此,很多研究机构及学者从设计复杂的标识和提出新的检测策略等方向开展研究,如斯坦福大学航空机器人实验室的Lange等围绕视觉引导无人机自主着陆课题进行研究,设计了由内外径比值不同的同心圆环组成的降落标识,其主要思路是对207 WM摄像机采集的无失真图像进行轮廓提取,然后进行圆环和圆度检测,通过计算圆环内外轮廓中心的距离确定出降落标识,最后通过计算内外环面积比确定环数。测试结果表明,该系统平均定位偏差为3.8 cm,并且可以在不同高度下实现降落标识的实时检测。武汉理工大学的Yuan等设计了一种基于视觉分层的定位方法,将降落过程分为“目标靠近”“位姿调整”和“稳定接触”3个阶段,在不同阶段提取不同尺度的视觉特征,测试结果表明,该系统与其他定位精度同为厘米级的着陆系统相比,检测距离较高,可以实现20 m范围内的标识检测与定位。比利时安特卫普大学的Wubben等提出一种基于组合ArUco标识的着陆方案,可以在30 m的高度准确检测到着陆位置,实验结果表明,在引入较小额外时间开销的同时,平均着陆误差为11 cm。韩国科学技术院航天工程系的Jung等针对近距离相机视野下标识显示不完全和图像畸变等问题,设计了一种由同心圆和字母“H”组成的新型合作目标,提出使用基于直接最小二乘的椭圆拟合方法(Direct Least Squares Fitting of Ellipses, DLS)近距离检测标识,解决了近距离成像不完整问题,但当图像中仅显示小部分圆时,参数计算误差较大。

除相机高度带来的影响外,标识遮挡、光照变化等复杂环境因素也是需要考虑的内容。西北工业大学的张咪等对无人机自主降落系统开展研究,提出通过识别多层嵌套二维编码的降落标识达到在多尺度上定位的效果。仿真与飞行测试表明,该系统鲁棒性好,不易受光照、温度、噪声等环境干扰,对计算性能要求低,但系统依托于阶层标识进行相对定位,未充分利用其他环境信息。西班牙国立远程教育大学的García-Pulido等设计了一个由圆和椭圆组成的复杂标识,该标识由于其嵌套设计,在部分遮挡的情况下仍能有效检测。南京航空航天大学的梅立春等设计了一种级联三角形标识,检测算法的核心思想是采用Suzuki-Abe算法对预处理后的图像提取嵌套轮廓,然后利用改进的Douglas-Peucker算法进行多边形拟合检测角点,该方法大大减少了计算量,降低了算法的时间复杂度,角点检测效率是Shi-Tomasi算法的7倍,且在距离较远及标识部分缺失的场景下仍能有效检测,适用于硬件配置有限的无人机平台。

部分学者将基于深度学习的检测方法与其他算法结合,以降低实际应用中的硬件成本,克服传统检测方法受限于特定标识这一局限性,提高算法的准确率和泛化能力,如韩国的Nguyen等针对2017年研究中存在的远距离标识难以检测问题,提出一种速度与精度平衡的LightDenseYOLO算法,充分利用了LightDenseNet良好的特征提取能力和YOLOv2的快速检测能力,实现50 m高度下的标识检测。LightDenseYOLO在台式机上的计算速度为50 FPS,在Snapdragon 835平台约25 FPS。Truong等提出使用LightDenseYOLO和超分辨率重建策略检测自定义的降落标识,该方法依靠成本低廉、分辨率较低的可见光相机即可完成任务,并且一定程度上提高了检测距离,但算法在Jetson TX2普通模式下的运行速度仅4.4 FPS,在Snapdragon 835平台约12 FPS。Chen等设计了一种由同心圆和五边形组成的降落标识,提出使用Faster R-CNN进行标识检测,然后基于最小二乘椭圆拟合方法和Shi-Tomasi角点检测算法估计位置和方向,标识检测速度接近每帧81 ms,准确率达到97.8%,可以满足实时着陆要求。中国石油大学的Yu等设计了一种基于CNN的端到端检测算法,模型的输入是机载摄像头捕获的RGB三通道图像,经过4个由卷积层和池化层组成的复合层、一个全连接层和一个检测层,最后输出标识的位置信息,检测速率达21 FPS,算法对于不同的标识均表现出良好的检测效果,并且对不同的背景和光照均具有较好的鲁棒性。

在无人机自主降落任务中,除使用通用降落标识外,设计与环境区分度较高的标识可以在一定程度上提高检测精度。针对无人机飞行高度过高或过低导致的标识丢失和成像不完整问题,设计级联标识或采用视觉分层的检测策略,可以有效改善不同高度下的标识检测效果,增大检测距离。并且,由于嵌套标识包含丰富的视觉信息,在部分遮挡等环境因素影响下仍能有效检测标识。此外,基于深度学习的检测方法相比传统方法具有更好的泛化能力,能克服传统检测方法受限于特定标识这一局限性,与其他算法融合提高检测效率可以在一定情况下降低硬件成本,具有广阔的发展前景。

3.2 动平台

3.2.1 车载动平台

无人机在执行侦察、打击等任务过程中,在车辆等动平台实现自主降落将很大程度上增大其作业范围。美国南加州大学的Saripalli等在文献[52-53]的基础上进一步研究,在假设相机平面与标识平面平行且标识仅在和方向移动的前提下,通过提取Hu不变矩特征实现了慢速运动下降落标识的检测。中山大学的Cheng等利用基于霍夫变换的检测算法实现地面无人车(Unmanned Ground Vehicle, UGV)上白色圆形降落标识的识别,由于其图像处理算法在笔记本电脑上运行,然后通过数据链发送到无人机,因此只能在UGV速度较慢的情况下完成自主降落。新加坡国立大学的Chen等提出一种基于视觉与激光雷达的定位与跟踪算法,设计了由红色矩形和蓝色圆形组成的降落标识,通过矩形检测与圆检测实现标识识别,利用激光雷达扫描测距仪来确定高度,飞行测试验证了该系统在速度为1 m/s 的运动平台降落的有效性。捷克技术大学的Baca等在2017年国际机器人挑战赛中,利用图像分割和几何形状约束完成降落标识的检测,最终无人机在25 s内成功降落在速度为15 km/h 运动车辆上,获得MBZIRC竞赛团队总分第一名。

针对环境影响这一问题,Lee等设计了一种运动车辆上无人机自主降落系统,采用货车搭载与环境对比较大的红色标识,利用HSV颜色分割方法进行识别,最后通过户外飞行测试进行验证,但该方法在周围环境中存在其他红色矩形区域时容易产生误检。Benini等设计了一组圆形组成的降落标识,标识检测算法分为标识主体结构搜索和内椭圆检测2个阶段,采用GPU并行计算的方式完成。实验结果表明,该算法能够在帧率为30 FPS的情况下,检测误差小于标识直径的8%,并且在背景杂乱的环境中仍能有效检测降落标识。

此外,有研究人员通过设计复杂的组合降落标识以增大运动平台标识检测的距离,如克兰菲尔德大学的Araar等提出通过检测由28个二维码组成的标识来扩大检测距离,增强系统对环境变化的鲁棒性。北京理工大学的邢伯阳等围绕复合标识导航的自主降落优化方法开展研究,设计了一种由圆环和二维码组成的降落标识,实现了相机距离在0.5~6.0 m内的完整定位,且分别在动平台处于直线运动和圆周运动的情况下完成飞行测试,定位精度最高0.1 m。

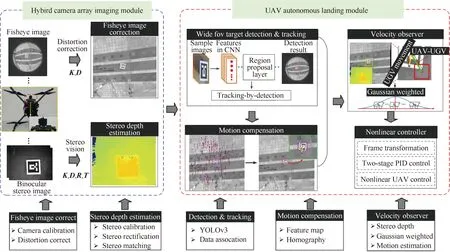

将基于深度学习的检测算法与硬件模块和其他算法结合,可以获得更好的性能,解决运动场景中的视野变化和运动模糊等问题。西北工业大学的Yang等设计了一个基于混合相机阵列的相对位置估计系统,如图3所示。其中,表示相机的内部参数;表示相机的畸变系数;和为相机的外部参数,为旋转矩阵,为平移矩阵。该系统主要包括2个部分:混合相机阵列成像模块和UAV自主着陆算法模块,扩大了相机视野范围。系统采用改进的YOLOv3算法检测ArUco标识,仿真验证了该方法可以高效、鲁棒地引导无人机着陆,其中检测模块对于单张图像平均耗时为51.24 ms,但该系统在背景为白色或纹理不明显时效果较差。2020年,Truong等考虑着陆阶段的运动模糊问题,提出一种结合运动去模糊和标识检测的两阶段框架系统,设计了SlimDeblurGAN算法用于去除快速运动过程中产生的模糊现象,采用YOLOv2模型对去模糊后的图像进行标识检测,实验结果表明,该系统可以很好地处理着陆阶段的模糊问题,并可应用于嵌入式平台,但仅对算法进行推理仿真,并未进行飞行测试。与文献[63]一样,未来可考虑将2个网络结合到1个模型,减少网络层数和参数量,提高算法效率。

图3 基于混合相机阵列的着陆系统框架[74]Fig.3 Overview of the hybrid camera array-based landing system[74]

3.2.2 舰艇平台

不同于车辆的二维运动,舰艇受不同等级海况影响运动呈现三维特征,无人机在自主降落过程中需获得与舰艇的6自由度相对姿态信息,同时,海上水雾等恶劣环境会严重降低图像质量,影响标识检测效果,大大增加了自主降落的难度。因此,大量研究人员针对无人机在舰艇甲板上的降落问题开展研究,如北京航空航天大学邱力为等于2003年提出的一种用于无人机自主着舰的双目立体视觉系统,已经达到无人直升机自主着舰的实时性和实用性要求。Bagen等采用由5个圆和1个“H”组成的降落标识,利用仿射不变矩特征和模糊识别方法进行检测。

针对可见光图像对光照依赖性较高,无法实现全天候标识检测问题,南京航空航天大学的Xu在“T”形标识上安装加热模块,利用红外相机实现夜间标识识别,测试结果显示,该系统的平均识别时间为17.2 ms,检测准确率为97.2%。同年,夏正浩等针对浓雾天气下着舰过程中的红外目标分割问题,提出一种新的分割改进方法,首先根据图像的能量信息分割出感兴趣区域,同时采用双OSTU算法对原图像进行分割,将两者的结果进行逻辑“与”运算以得到最终结果。与单独使用经典OTSU算法和最大熵算法相比,该算法能够同时克服OSTU算法的误分割问题和最大熵算法带来的干扰噪声问题,分割效果得到明显改善。虽然采用红外标识可以一定程度上克服水雾等恶劣环境影响,但红外标识的检测结果受温度影响,在实际着舰场景中也具有一定的局限性。

针对着舰过程中的环境干扰及海浪影响,亚利桑那州立大学的Sanchez-Lopez等提出利用Hu不变矩特征以及包含多层感知机和其他几何性质的决策树判别单元检测国际通用着陆标识,在实验室场景下测试显示,该算法在不同高度和角度以及部分遮挡的情况下均能准确检测标识,并且对光照变化不敏感。Polvara等围绕无人机舰艇甲板着陆问题开展研究,采用AR Drone2.0和Husky A200移动机器人来模拟着舰场景,选用高对比度的增强现实(Augmented Reality, AR)标记作为着陆标识,理论上系统可获得无人机与标识的六自由度相对姿态信息,但由于试验条件限制,没有对算法进行完整测试。随后于2018年Polvara等进一步研究,通过模拟真实海上运动场景对文献[80]提出的方法进行测试,试验结果表明系统在添加不同干扰的情况下均具有较好的鲁棒性。

另外,有研究人员将基于深度学习的检测算法用于舰艇平台的标识检测,凭借其优秀的特征提取能力解决实际应用中因高度变化带来的问题,如南京航空航天大学的Li等针对无人直升机滑翔过程中机载相机视野中目标尺寸小、尺度变化大等问题开展研究,在SSD算法框架的基础上提出一种新的特征提取结构,以增强模型对中小目标的检测能力,改进后的算法检测准确率达到93.3%。为充分结合深度学习算法的高精度和核相关滤波(Kernel Correlation Filter, KCF)算法的强实时性,系统采用互补滤波融合策略,用改进SSD算法的检测结果对KCF算法进行修正,提出的融合检测算法成功率达到91.1%,平均处理速度为9 ms,基本满足了无人机在舰艇平台自主降落要求。

对于无人机在动平台的自主降落,同样通过设计嵌套标识或分级检测策略来增大检测距离。不同于静平台自主降落,无人机在运动平台降落时,由于车辆或舰艇存在的二维或三维运动特征,不可避免地受到更多环境干扰或海浪影响,设计与环境对比鲜明的标识至关重要。同时,采用基于深度学习的检测算法与去模糊算法融合可以有效解决快速运动导致的运动模糊问题。采用红外标识可以一定程度上克服水雾影响,但在实际场景中具有一定的局限性,可将基于深度学习的检测算法与去雾算法融合,提高恶劣天气下的检测精度。然而,当前的检测算法大多关注降落标识本身,缺乏对运动平台的考虑,扩展对动平台整体的检测识别将有效增大检测距离、提高视觉算法的环境适应性和检测效率。

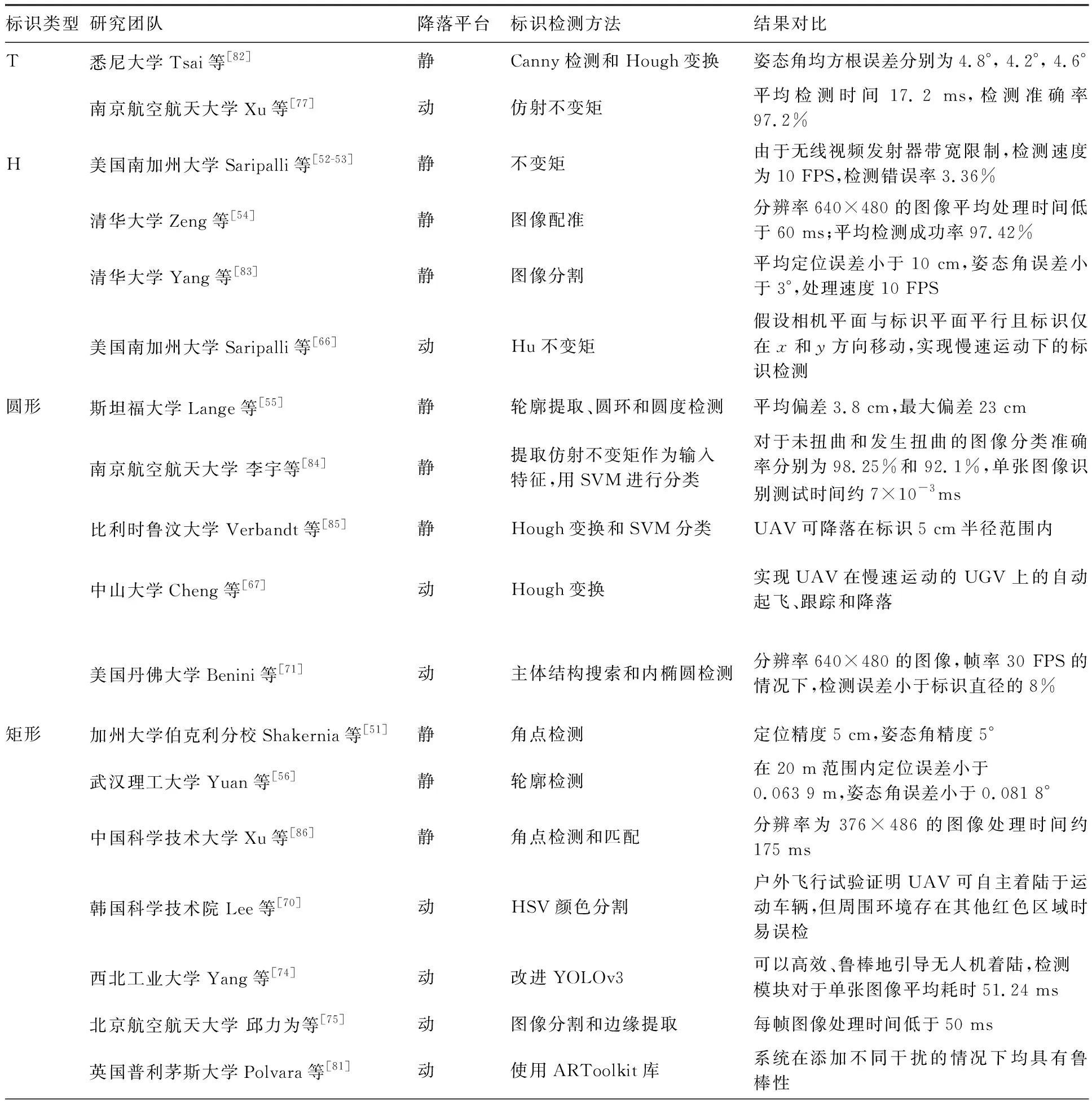

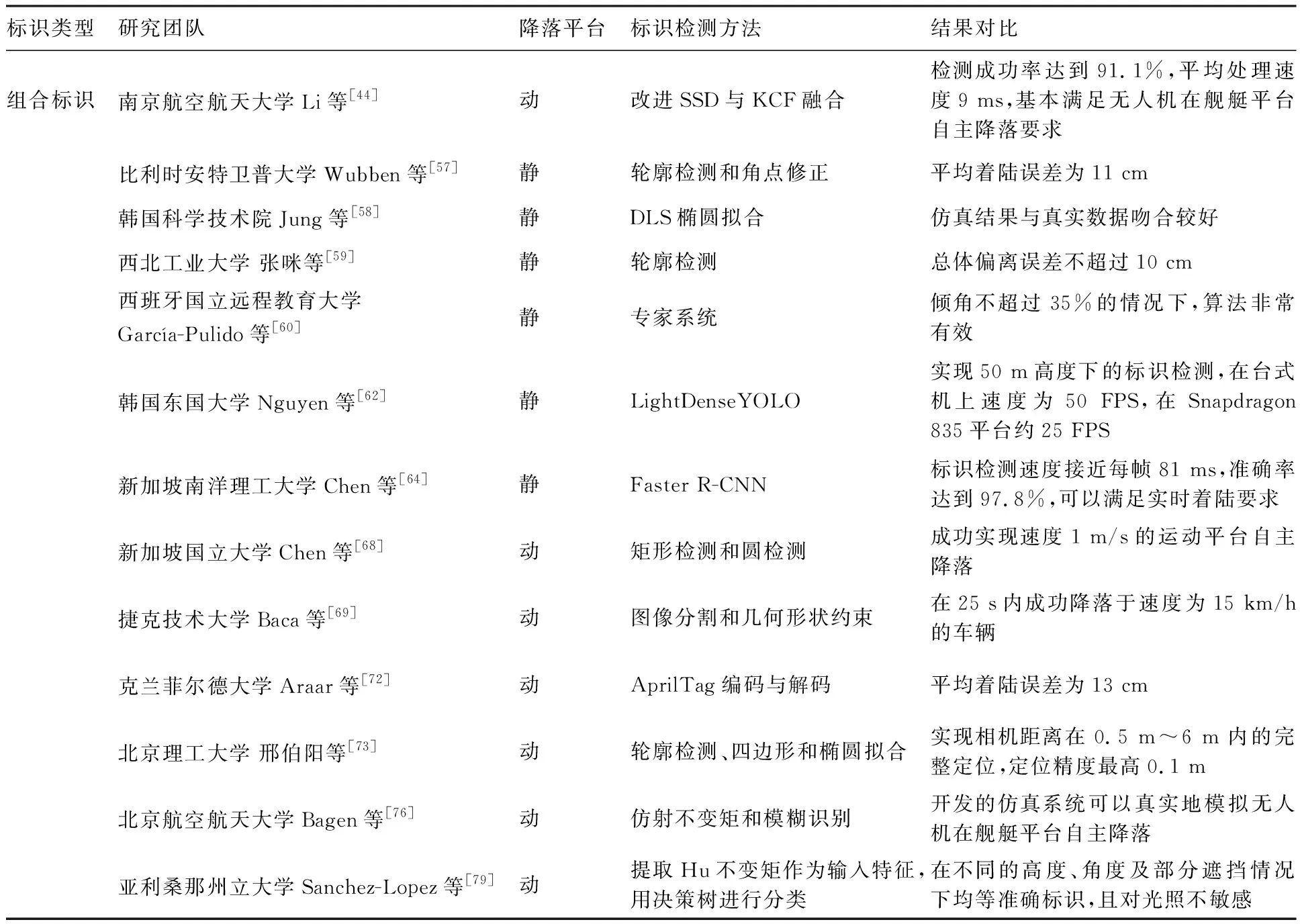

总的来说,目前常用的降落标识可以分为以下5类:T形、H形、圆形、矩形和组合标识。为便于对比各研究机构采用的检测方法及识别效果,对视觉引导无人机自主降落的相关文献进行梳理,汇总于表2,部分标识图像如图4所示。

表2 标识类型、检测方法及结果对比Table 2 Comparison of markers’ shapes, detection methods, and results

续表2

图4 部分降落标识[51-53, 58, 69, 77, 85]Fig.4 Some markers with variations[51-53, 58, 69, 77, 85]

4 存在的问题及未来发展思考

1) 当前及未来复杂环境下,实现对降落标识的精细化检测与识别,达到检测速度与精度的同步提升,仍有很大的研究空间。针对实际场景中雾霾和雨雪天气、快速运动、水面反光等问题,除了根据实际环境设计对比度更高的标识,融合去雾、去模糊等算法,提出更轻量的高精度一体化检测算法,克服恶劣环境对图像采集质量的影响,保证检测算法的高鲁棒性和环境适应性,是未来的重要发展方向。

2) 无人机与无人车/无人艇协同作业过程中,如何精准检测运动体搭载的降落标识非常关键,目前研究人员大多关注于检测标识本身,缺乏对运动平台的考虑,对于快速运动的降落标识准确检测是无人机自主降落研究的短板。扩展对动平台整体的检测识别将对于增大检测距离、提高视觉算法的环境适应性和检测效率起到至关重要的作用。

3) 目前基于深度学习的标识检测方法是一种有监督学习的方式,具有训练所需样本量大、网络参数多、主干网络设计复杂等局限性,并且在实际工程应用中,样本的采集受到环境限制,针对某一任务设计一个最优的网络架构工作复杂。为此,在有限的计算资源和复杂的环境影响下,基于小样本的轻量化标识检测算法的研究还有很大提升空间,采用自动神经结构搜索方法提升标识检测效率是未来的关键。

4) 采用单一传感器获取降落标识图像具有一定的局限性,如光学图像分辨率高但易受天气影响,红外图像能实现全天候标识检测但易受温度影响,充分利用不同数据间的优势互补信息具有很大的必要性。融合不同源图像实现高精度全天候标识检测,通过多源数据间冗余信息增强标识检测的可靠性将可能成为研究热点之一。

5) 对于无人机载标识检测系统,除了软件算法的效率之外,硬件系统的成本也是一个值得考虑的问题,目前选用低成本的硬件在一定程度上需要软件算法的突破来进行补偿。未来,综合考虑无人机平台的负载能力与计算能力,如何在保证信息采集质量的同时,实现硬件系统的微型化和低成本化仍有待探索。

6) 总的来说,目前基于人工标识的无人机自主降落是主流研究方向,提高标识检测算法的泛化性,增强系统对快速运动及复杂环境的适应性是未来的发展趋势。然而,关于未知、非合作环境下无人机自主降落系统的研究凤毛麟角,现有的非深度学习方法本质上对环境的鲁棒性较低,在利用深度学习的思路进行安全降落区域检测这一方向,尚缺乏可工程实用的研究成果。因此,未来可考虑将深度学习的思想用于未知环境中安全降落区域检测,增强检测算法对环境的鲁棒性,克服自主降落依赖人工标识这一局限性,提高在不可预见的条件下自主降落系统的总体性能,对于未来复杂战场环境下、突发任务及异常状态下无人机紧急迫降和抗灾救援等方面,将具有重大的工程应用价值。

5 结束语

近年来,随着无人系统向智能化、数字化、自动化、集群化的方向快速发展,无人机与无人车/无人艇的协同不仅在民用领域具有较大的应用价值,也将很大程度上改变未来海/陆空作战体系,很有必要对基于视觉的无人机自主降落技术开展深入研究。针对视觉引导无人机自主降落问题,本文在简要介绍通用目标检测方法的基础上,梳理和归纳了当前自主降落标识检测技术的若干研究进展。从目前的研究成果来看,国外在该方向的研究领先于国内,但公开发表的国内外研究成果针对静平台自主降落研究较多,部分学者提出了运动车辆/舰船等动平台降落方案,但检测算法大多关注于标识本身,较少涉及动平台自身的检测问题。此外,无人机平台自身存在的负载及计算资源有限等问题,以及实际应用场景的复杂性,使得该方向的研究仍面临较多困难,许多研究成果仍停留在实验室仿真阶段,缺乏有效的飞行验证和实际应用考证。

针对无人机在动/静平台自主降落的基础理论和工程应用方面的难点,如果能抓住现有研究问题中存在的主要矛盾,顺应深度学习等人工智能技术的发展潮流,在标识检测技术上取得突破性进展,将极大促进无人机与无人车/无人艇协同技术的发展。未来,在致力于系统轻量化及微型化的同时,进一步提高检测算法的准确性、实时性和鲁棒性,提高系统在各种复杂环境下的自适应与学习能力,将具有十分重要的实用价值。软件算法的不断突破与硬件设备的快速革新,必将促进视觉引导无人机自主降落技术的飞速发展,推动海/陆空跨域协同技术发展到一个新台阶。