Bin-Picking中无纹理工件的分割

2022-09-22伍世虔

刘 瑶,赵 慧,伍世虔,陈 彬

(1.武汉科技大学机械自动化学院,湖北 武汉 430081;2.武汉科技大学机器人与智能系统研究院,湖北 武汉 430081;3.武汉科技大学信息科学与工程学院,湖北 武汉 430081)

1 引言

Bin-picking系统的分拣功能在现代工业智能生产和制造等领域中发挥着重要的作用,如航空航天和汽车制造领域中的焊接与装配,物流领域中的码垛、分拣,工业2D、3D自动化检测等具体生产场景中有着广泛的应用前景。其中,利用视觉检测对分拣目标进行分割在整个Bin-picking系统中发挥着基础性作用,是“智能化”的一个重要体现。

目前分割算法大多基于图像的颜色和纹理信息,这些信息获取方式简便且廉价。文献[1]针对含有不同纹理图像提出基于连续纹理梯度信息的各向异性分割。文献[2]提出一种基于FFT 的Hu矩的目标形状特征提取,利用特征形状进行目标分割。文献[3]使用形态学处理生成标记图,利用标记图辅助分水岭。但Binpicking系统面对的目标大多是缺乏表面纹理特征,形状相似且无序堆叠,因此单独利用图像的颜色和纹理信息对目标进行分割,会导致分割范围不准确,出现欠分割现象。

随着深度传感器技术的成熟发展,越来越多的研究者利用场景的3D特征对兴趣目标进行分割。深度传感器采集的深度信息表示的是物体到相机的距离,其不受光照、背景遮挡等因素的影响,因此较于颜色纹理信息更加稳定。文献[4]以三维点云中视点特征直方图作为特征,文献[5]则是统计深度图法向量差方作为特征,二者依据特征信息进行目标分割。但仅利用深度信息会受传感器的影响有局部空洞,引发目标缺失、过分割等问题。

因此将目标的颜色信息和深度信息相结合,是提高分割的准确性的一个有效途径。文献[6]使用RGBD信息,计算颜色,3维坐标,光流直方图,使用直方图差异构建最小树作为分层分割结果。文献[7]利用深度梯度图像、法向量梯度图像和彩色梯度图像的融合进行标记提取,最后使用标记分水岭分割。

文献[8]提出使用3D图神经网络(3DGNN)实现场景分割。这些方法存在执行复杂,需要大量的特征计算,分割时间较长的缺陷且不适应工业场景。针对上述问题,这里提出基于RGB-D无纹理工件分割方法,实验结果表明,对于无纹理工件的遮挡具有较强的鲁棒性且运行快速可满足检测的实时性要求。

2 RGB-D无纹理工件分割算法

2.1 算法描述

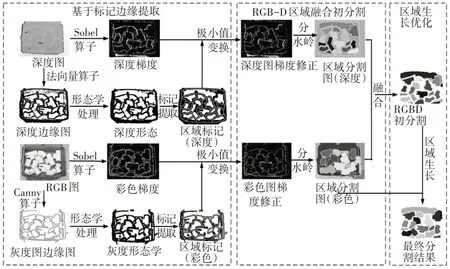

针对无纹理工件目标分割这一问题,提出首先利用边缘图像生成标记图辅助分水岭,缓解因梯度图伪极值点造成的分割不准确问题;而后,将深度信息与颜色信息相融合作为初始分割结果;最后,使用颜色域信息辅助初分割区域生长法优化分割结果。该法充分结合了颜色域分割的边缘更加精准,深度域分割目标更加完整这一特点,将两者进行融合,有效抑制了颜色域中欠分割与深度域中过分割现象,获得了更好得分割结果。这里所阐述的Bin-Picking中无纹理目标的分割方法总体框架,如图1所示。

图1 算法流程图Fig.1 Diagram of the Algorithm

2.2 基于边缘的标记提取

分水岭算法在多数分割场景中具有较好的效果,但由于其对噪声敏感,易出现分割区域不准确。而使用标记修改原始梯度图可有效抑制这种现象。如何提取标记图像是分水岭分割的重点,根据目标表面纹理特性提出一种基于目标边缘图提取标记方法,并将其分别应用于深度域和颜色域中。

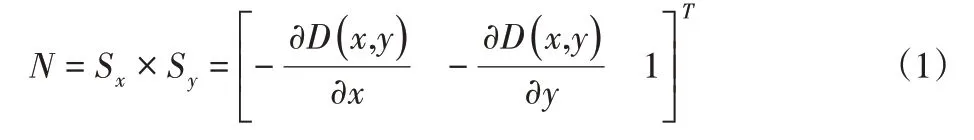

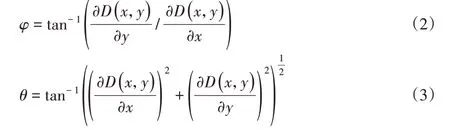

在深度域,利用法向量信息计算边缘信息。深度图中的每个像素表示为其中x,y表示深度图像中的像素点的坐标,D(x,y) 为相应像素坐标位置的深度值。

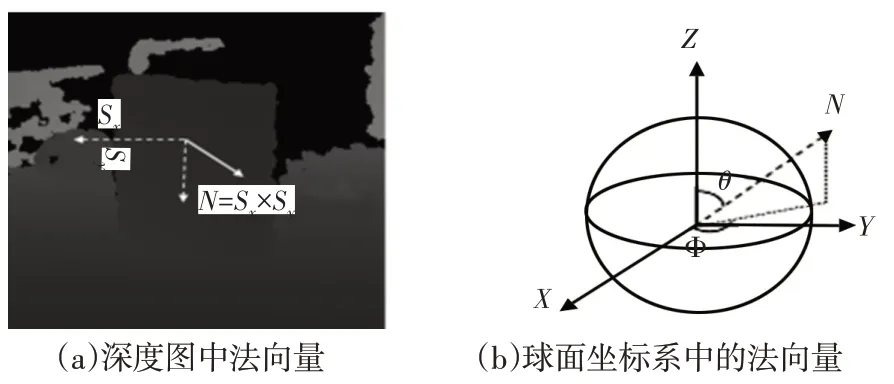

深度图中法向量,如图2(a)中所示,N—物体表面p点(其坐标为(x,y))处的法向量梯度,图2(b)中的θ,φ为法向量梯度θ与X,Z轴的夹角。法向量梯度N可通过向量的叉积表示为:

其中,点P处的法向量梯度N在Z轴方向的参数为1,为P点处在X轴和Y轴方向上的梯度。如图2(b)中θ和φ角可由下述公式可得:

图2 深度图的法向量Fig.2 Normal Vector of the Depth

使用θ和φ可描述深度图每个像素点的法向量梯度的方向。而在计算φ时,噪声过大[9],因此选择θ作为深度域的边缘。相应地,在颜色域采用Canny边缘检测来计算边缘信息,在此就不再赘述。通过分别对深度域D和RGB彩色域进行处理获得了关于同一拍摄场景的两类边缘信息:深度域边缘信息和颜色域边缘信息。3D相机采集的深度图和彩色图,如图3(a)、图3(c)所示。上述计算的深度域边缘图,如图3(b)所示。经过canny算子检测的颜色域边缘图,如图3(d)所示。

图3 边缘图Fig.3 Edges of the Image

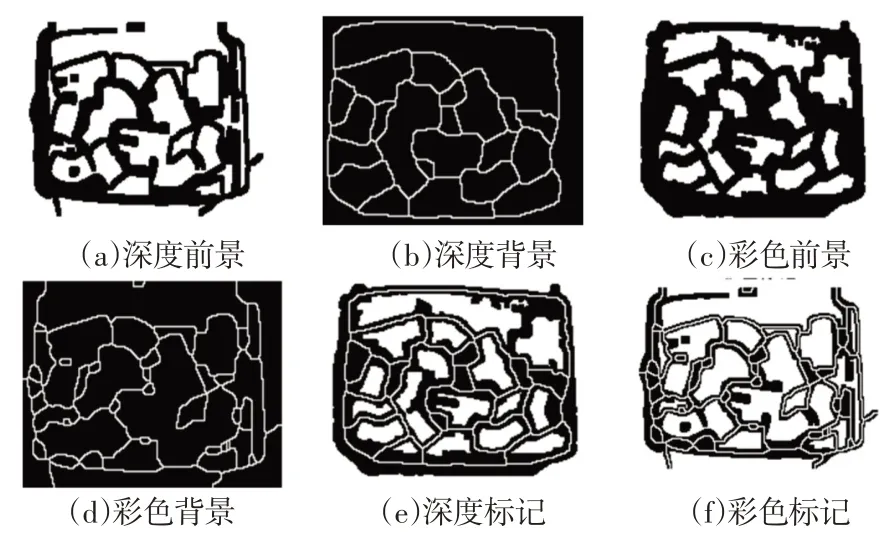

工件物体表面纹理信息较弱,如图3(a)、图3(c)所示。边缘提取后保留了目标轮廓信息,如图3(b)、图3(d)所示。且有效抑制了其他噪声因素的影响。因此提取的标记不受其他伪极小值的干扰。对二者进行形态学处理[3]提取前景与背景标记,利用下式将前景与背景合并:

式中:MD、MRGB—深度域标记图,和颜色域标记图;fD、fRGB—深度域、颜色域前景标记,bD、bRGB—深度域、颜色域背景标记,效果,如图4所示。

图4 标记图Fig.4 Marks of the Image

2.3 RGB-D区域融合初分割

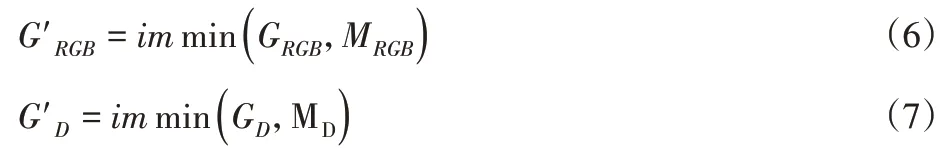

在式(4)、式(5)所示的标记图基础上,采用极小值标定技术[10]对颜色域和深度域梯度图像进行修正。使用极小值标定技术利用标记图像MD、MRGB对原始颜色域梯度图像GRGB和GD进行修改(在此,梯度图像G依据Sobel算子[11]计算),获得修正后的颜色域和深度域的梯度图像即:

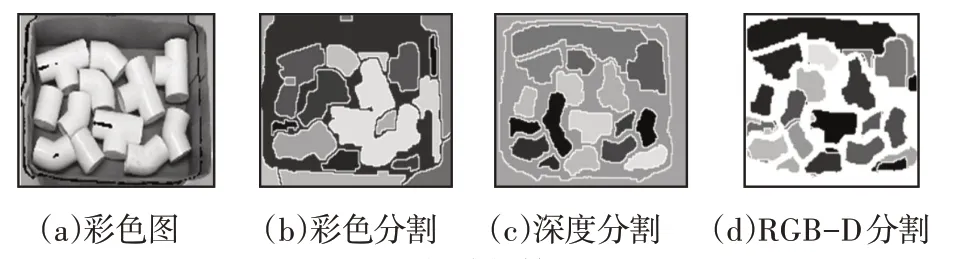

其中,immin()—极小值标定操作,减少分水岭分割的区域。在修改后的彩色以及深度边缘梯度图使用分水岭分割即可得到最终的分割结果SD和SRGB。基于边缘标记分水岭在颜色域与深度域分割效果,如图5(b)、图5(c)所示。

在深度域的分割出大部分工件,分割边界较为清晰,如图5(c)所示。而与此同时,在颜色域中对无纹理目标进行上文所述的分割操作时,由于纹理信息的缺失极易造成目标物体的欠分割,如图5(b)所示。工件两两相接部分并没有分割出来。

针对于上述问题,在分别获得颜色域及深度域分割结果的基础上,利用式(8)将二者的分割结果相融合作为RGB-D初分割结果,即:

式中:SRGBD—RGB-D 的初分割结果;SRGB—颜色域的分割结果;SD—深度域分割结果;&—运算,根据上式(8)分割效果,如图5所示。

图5 初分割结果Fig.5 Segmentations of the Result

通过上述方法融合后的RGB-D 初分割结果所示有效地融合了两种分割结果,保留二者的分割边缘。区域融合初分割结果,如图5(d)所示。相对于基于颜色域分割改善了欠分割情况,如图5(b)所示。

2.4 区域生长优化

初分割结果主要融合了深度分割的信息和部分颜色域分割信息。但是融合后的工件区域面积小于实际工件面积,虽然在颜色域中的标记分水岭分割结果存在欠分割,如图5(d)所示。但是分割出来的工件边界较为准确。因此获取RGB-D 初分割结果后,将颜色域分割范围定义为生长弹性范围,使用弹性范围与区域生长法来调整分割后的目标假设范围,改善了初分割中过分割的现象,以提供更准确的潜在目标区域。

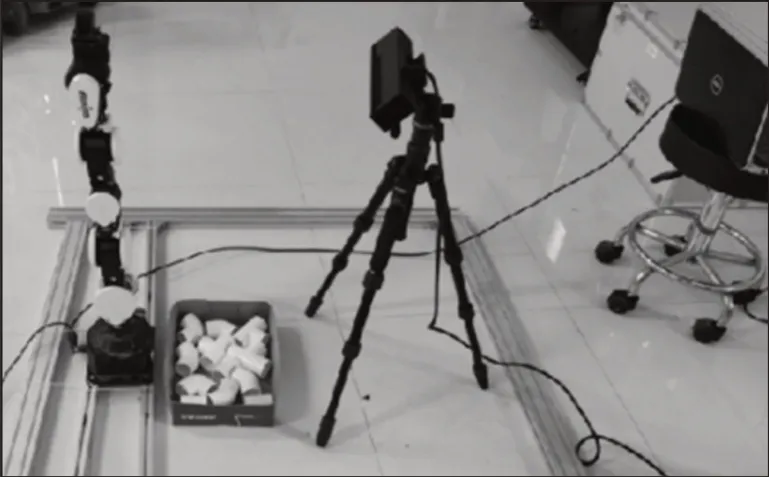

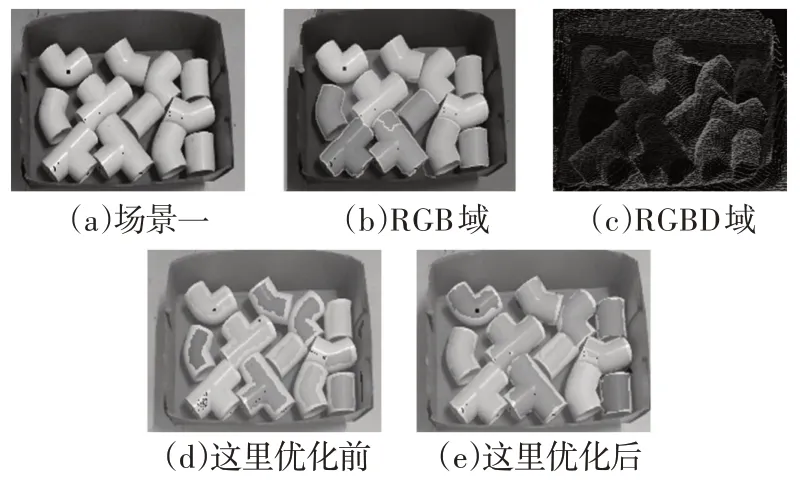

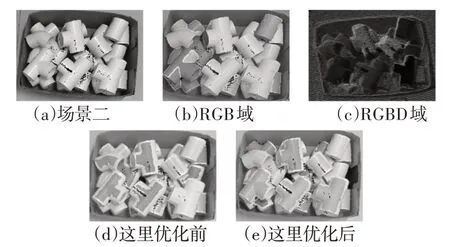

式中:p—一个像素点。具体生长规则如下

(a)C为生长法的种子区域,即初分割结果的轮廓;(b)将设为生长停止边界;(c)从种子区域C中选取一个种子Ci;(d)从弹性区域中Se找出与种子Ci的8领域连通点集合E;(e)将集合E中满足条件|DEj-DCi| 根据上述步骤,生长效果图,如图6所示。从图6可知,相比较RGB-D初分割图6(b),经过RGB-D区域生长优化的图6(c)更加接近真实目标区域大小S. 图6 区域生长优化结果Fig.6 Regions Growing 这里使用3D 相机Kinect2和vs2013搭建视觉检测平台,获取RGB-D信息,并且对3D相机进行畸变矫正和深度域、彩色域对齐。以直通管、三通管、弯管作为识别对象,将分割目标随意堆叠摆放在物料框中,如图7所示。运用RGB-D 无纹理工件分割算法分割杂乱堆叠的工件。 图7 实验场景Fig.7 Experimental Platform 为验证文中算法的鲁棒性,实验场景分为两类场景,一类是工件平铺摆放,另一类是杂乱堆叠场景。为了对比验证文中区域融合初分割的有效性,将提出的分割方法与在RGB域分割方法[3]以及在RGBD域分割方法[6]进行了比较。同时将这里生长优化前后的结果进行对比,验证了算法优化的有效性。 实验场景一是工件平铺摆放在容器框内,该场景的RGB图,如图8(a)所示。分割结果,如图8(b)~图8(e)所示。图8(b)中有两处弯管与直管相连的边缘没有被分割出来,图8(c)中三个绿色工件区域、两个红色三通管以及两个弯管相边缘都没有分割出来。图8(d)为所提出的融合分割结果以及图8(e)优化后的结果,工件分割区域的数目明显增加,其中可以看出图8(e)的分割区域更加接近真实区域。因此提出的算法提高了分割的正确率,使得分割结果更加接近真实工件区域。 图8 场景一对比实验分割结果Fig.8 Segmentation Results for Scene One Achieved by Different Algorithms 实验场景二是工件任意堆叠的。场景二的RGB 图,如图9(a)所示;分割结果,如图9(b)~图9(e)所示。从图9(b)上层工件与下层工件基本都没有被分割出来。图9(c)红色区域的工件与蓝色区域工件也存在顶层与下层的工件没有被分割出来,并且上层的三通管与直管之间也没有分割出来。相比较图9(d)和图9(e)分割正确。从中可以看出,算法实现较好的分割效果,而且优化后的分割结果图9(e)更加接近工件的真实区域。 图9 场景二对比实验分割结果Fig.9 Segmentation Results for Scene Two Achieved by Different Algorithms 从上述实验结果可以看出,这里方法与在颜色域分割相比,由于加入了深度信息,在工件紧邻和工件堆叠时分割效果较好,对于复杂场景具有鲁棒性。与在RGBD域分割方法二相比,这里分割数目错误率较低,分割数目接近真实数目。此外在RGBD域分割是基于较为复杂点云的三个特征,算法复杂、运算时间较长。而本文算法步骤简单,复杂度较低。对于相同场景做处理,这里算法对一幅图片分割只需要1min,而使用RGBD点云信息分割至少需要10min。 为了对验证这里提出优化的有效性,针对优化前后的分割结果与人工标定结果进行对比。计算分割范围的准确性则是采用IOU(并交比),计算假设框重叠率。重叠标准为每个人工选择的工件目标最大矩形框和分割结果的目标假设框交集和并集之比,衡量两个边界框的重叠相对大小,Ri为真实假设框的区域,Si为分割假设框的区域。i,j=1…n。公式如下表示: 由实验效果图8、图9及表1的正确率对比分析可知。优化后的准确率得到明显提升。 表1 优化前后正确率对比分析Tab.1 Analysis and Comparison Between the Original Algorithms and Optimized Algorithms 综上所述,这里提出的算法与在颜色域和RGBD 域典型算法相比,优化之后在分割效果上有所提高,且分割速度较快。在本文提出基于RGB-D无纹理工件分割算法下,达到了分割较为准确且运行速度快的效果,可满足Bin-picking的实时性和鲁棒性要求 在Bin-picking的无纹理目标的识别场景中,将颜色域和深度域相融合可分割出纹理信息较弱的潜在区域。针对无纹理的目标轮廓信息的重要性,算法提取了深度域以及颜色域边缘特征,使用边缘特征生成二者标记图,依靠标记图辅助分水岭分割,减少因工件表面伪极值点引起的小区域。然后将二者的分割区域相融合得到初分割结果,缓解基于颜色域的欠分割现象。最后利用颜色域分割区域为生长边界限制初分割目标区域生长范围,解决RGBD信息相融合引起的过分现象,优化目标潜在区域,提高分割区域的准确性。实验结果表明,这里算法分割效果优于在颜色域和RGBD域分割的典型算法,可在堆叠复杂场景中分割出完整的目标区域,算法运行速度较快,具有实时性和较强鲁棒性。下一步的工作是利用分割目标的潜在位置方法替代滑动窗口实现对工件的识别和位姿估计,以此保持识别模块的准确性基础上提高运算效率。

3 实验与分析

4 结语