基于动态卷积的胸部X光片疾病分类算法

2022-07-04赵启蒙

李 锵,赵启蒙,关 欣

基于动态卷积的胸部X光片疾病分类算法

李 锵,赵启蒙,关 欣

(天津大学微电子学院,天津 300072)

胸部疾病严重威胁人类健康,及时并精准地检测胸部疾病对患者的治疗与康复具有重要意义.胸部疾病经常通过胸部X光片进行诊断,但由于胸部疾病的多样性以及病理特征的复杂性,现有的胸部X光片疾病分类算法存在分类准确度较低、模型复杂度较高等问题.针对以上问题,提出一种基于动态卷积的胸部X光片疾病分类算法.将动态卷积模块加入密集连接网络,在不显著增加网络模型尺寸的前提下,增强网络对多尺度信息的特征提取能力,在提升分类准确度的同时保持高效推理;使用Meta-ACON改进ReLU(rectified linear units)激活函数,通过线性-非线性切换因子自适应地选择是否激活以及使用何种激活函数,从而增强网络的泛化能力;提出加权焦点损失函数,在焦点损失函数的基础上加入权重调整因子,使网络依据分类的难易程度为每种疾病合理分配权重,增大较难分类疾病的损失占比以提高其分类准确度,进而优化整体性能;对数据加载方式进行优化,增大批数据处理量以提升批归一化效果;在测试阶段使用测试时数据增强策略,综合分析多个维度的分类结果,提高分类的准确性与鲁棒性.在chest X-ray14数据集上的实验结果表明,在密集连接网络中加入动态卷积模块、Meta-ACON激活函数、加权焦点损失函数并在实验时优化数据加载方式、使用测试时数据增强策略的算法对14种胸部疾病分类的平均受试者工作特征曲线下面积(area under receiver operating characteristic curve,AUC)值达到0.8361,针对单个疾病标签的AUC值最高可达0.9534,高于目前6种先进算法.实验结果表明,基于动态卷积的胸部X光片疾病分类算法具有分类准确度高、模型鲁棒性强等优势,可良好地适用于胸部X光片疾病分类任务.

胸部X光片;疾病分类;密集连接网络;动态卷积;ACON激活函数;加权焦点损失函数

胸部疾病是威胁人类健康的关键因素之一,及时并精准地检测胸部疾病,对患者的治疗与康复具有重要意义.胸部X光片(chest X-ray,CXR)是医生用来诊断胸部疾病的重要手段,但依靠专业医生对胸部X光片的逐一手动标注是一项耗时耗力的工作[1].随着深度学习(deep learning)的兴起与快速发展,计算机辅助诊断(computer aided diagnosis,CAD)逐渐成为临床常用的诊断方法,如糖尿病、眼病诊断[2-3]、肺结节检测[4-5]和癌转移检测定位等[6-7].利用CAD技术辅助诊断胸部疾病,即通过智能算法对胸部X光片中的病灶特征进行提取、分割、分析,并给出诊断结果,可以大大减少医生的工作量,降低人工诊断的误差.

Lakhani等[8]评估了AlexNet[9]和GoogLeNet[10]两种卷积神经网络(convolutional neural network,CNN)模型在CXR图像上检测肺结核的性能,单项疾病分类的平均受试者曲线下面积(area under receiver operating characteristic curve,AUC)值最高可达0.99,远超传统的分类器分类方法.Li等[11]基于多实例弱监督的深度学习模型,通过去除残差网络(residual network,ResNet)[12]的最终分类层和全局池化层,实现了CXR图像病灶区域定位与疾病分类的同步.然而,深度学习算法往往需要海量数据集才能够取得较好的训练效果,而胸部疾病的数据集样本较少,为更好地将深度学习应用于胸部疾病分类,2017年,美国国立卫生研究院首次公开了chest X-ray14数据集[13],Wang等[13]基于此数据集,通过保留CNN的结构与卷积层大部分权重参数,移除全连接层,加入过渡层、全局池化层的方式,设计了一种适用于胸部疾病分类的深度卷积神经网络(deep convolutional neural network,DCNN)架构.Guendel等[14]在密集连接网络(densely connected convolutional networks,DenseNet)[15]结构基础上增加两个卷积层,使网络模型在对数据集预处理时不需要进行图像压缩等操作,可保留CXR图像的原始分辨率,从而更加精确地获取病灶区域特征,并结合病灶区域位置信息对胸部疾病进行可视化分类.张智睿等[16]在DenseNet的结构基础上加入密集挤压激励模块与非对称卷积块以增强特征通道的信息表达能力,并使用焦点损失函数平衡网络对不同疾病识别能力的差异,实现了分类准确度的提升.Teixeira等[17]使用ResNet与DenseNet分别对同一张CXR图像进行互补特征学习,并将两个网络的全连接层相连进行融合分类,以关注病灶区域最显著的特征,从而实现分类准确度的提升.Chen等[18]提出分别对CXR图像的肺部区域与全局区域进行互补特征学习与自适应加权融合,并不断调整融合流,获得分类结果的方法,该方法降低了胸部X光片中无关区域的噪声干扰,实现了分类准确度的提升.Ho等[19]建立从CXR图像到疾病类别标签的显著性映射以提取病灶区域特征信息,并使用知识蒸馏(knowledge distillation,KD)[20]训练策略在ResNet、DenseNet的基准模型上取得了较好的胸部疾病可视化分类效果.

综上所述,以卷积神经网络为基础的深度学习方法可高效并广泛地应用于胸部X光片疾病分类,适合解决复杂的分类问题,并具有学习能力强、运算速度快、可移植性好等优势.然而,基于深度学习方法对胸部X光片分类在准确度提升的任务上仍面临如下挑战:①CXR图像病灶区域的纹理、位置等特征表现多种多样且较为复杂,部分网络对于这种复杂信息的学习能力不足,从而影响分类准确度的提升;②在数据集中,各类型疾病的样本数目存在较为严重的类不均衡现象,网络在训练过程中易出现过拟合等问题,影响网络性能;③更高性能深度网络模型的训练需要高昂的计算与存储成本,这在一定程度上限制了网络对CXR图像进行更高效的学习与更准确的分类.针对以上问题,本文提出基于动态卷积(dynamic convolution)[21-22]的胸部X光片疾病分类算法,命名为DC-DenseNet(densely connected network based on dynamic convolution),具体内容如下.

(1) 使用DenseNet作为基本构建模块,去除该网络中的全部3×3卷积并加入动态卷积构成动态卷积模块(dynamic convolution block,DC-Block),从而获得更好的特征提取能力,且不会显著增加网络模型尺寸,有效提升网络性能.

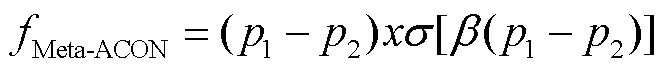

(2) 使用Meta-ACON激活函数[23]替换网络中的ReLU激活函数,Meta-ACON激活函数可以自适应选择是否激活,并依据不同情况选择不同的激活函数,可以增强网络的泛化性能,从而提升网络的分类准确度.

(3) 提出加权焦点损失函数的方法,根据每种疾病分类的难易程度为每种疾病赋予不同的损失权重,增加较难分类疾病的权重使网络的计算资源向其倾斜,从而提高较难分类疾病的分类准确度,进而提升整体分类准确度.

(4) 对显卡的数据加载方式进行优化,以提高显卡的利用率,增大批处理数据容量,进而提升网络的训练效果;在测试阶段使用测试时数据增强策略,扩展测试数据集,并综合分析多个维度的分类结果,提升分类准确度.

本文提出的DC-DenseNet算法在Chest X-ray14数据集上进行有效性评估实验,实验结果表明,该算法对胸部X光片疾病具有较高的分类准确度.

1 算法框架

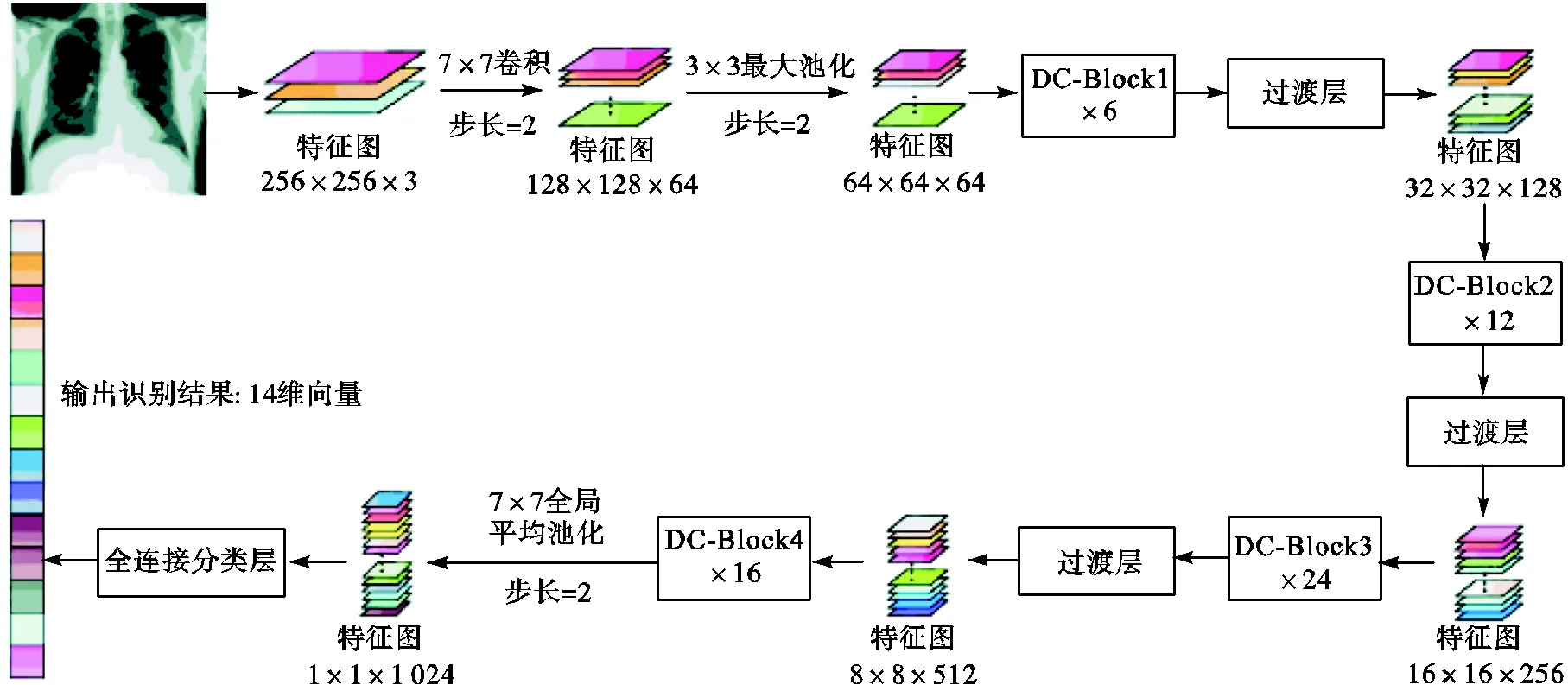

本文算法框架如图1所示,其具体网络结构配置如表1所示.本文算法在DenseNet模型的基础上进行改进,构建DC-DenseNet模型,其中包含4个动态卷积模块,每个动态卷积模块由过渡层进行连接.首先,CXR图像在经过预处理、卷积与池化操作后被输入到第1个动态卷积模块(DC-Block1).动态卷积模块包含ReLU激活函数、1×1卷积层和3×3动态卷积层,1×1卷积操作的目的是对输入特征图进行降维,并融合各个通道的特征,3×3动态卷积是DC-Block的核心结构,其目的是充分提取特征图的多尺度信息,DC-Block结合了密集连接与动态卷积的优势,既可以缓解梯度消失问题,又可以在不增大卷积核尺寸的前提下提升网络模型的容量.然后,将所得到的特征图输入过渡层.过渡层中包含Meta-ACON激活函数、1×1卷积层和2×2平均池化层,1×1卷积层对上一个DC-Block的输出进行降维处理以避免信息冗余,2×2平均池化层是特征图进入下一个DC-Block的预处理.过渡层输出的特征图进入DC-Block2,并进行多轮循环.特征图在经过最后一个动态卷积模块(DC-Block4)后进入全连接分类层.最终,全连接分类层通过对特征图进行7×7全局平均池化操作,建立14维特征向量的全连接,从而输出图像分类识别结果,实现一个完整的训练过程.

图1 算法整体框架

表1 DC-DenseNet的具体结构配置

本节将详细介绍算法整体结构与动态卷积、Meta-ACON激活函数、加权焦点损失函数的实现.

1.1 密集连接网络

2017年,Huang等[15]在深度残差网络的基础上提出了密集连接网络.ResNet通过残差学习有效缓解了深度网络的退化问题[24].与ResNet层级间直接加和的连接方式不同的是,DenseNet通过级联组合前面所有层的特征值,以确保层级之间的最大信息流,有效缓解梯度消失问题,鼓励特征复用,增强特征传播,因而更适用于多标签分类问题.

DenseNet主要由密集连接模块与过渡层构成.图2展示了一种包含3个密集连接模块的DenseNet结构模型.在DenseNet结构中,上一级密集连接模块输出的特征图在经过卷积与池化处理后,进入下一级密集连接模块.密集连接模块中每个卷积层的输入均包括先前所有层的输出,并将每一层的输出作为所有后续层的输入,在一个层的密集连接模块中便有(+1)/2个连接.

胸部疾病分类问题的CXR图像中包含有关14种疾病的特征信息,因此需要神经网络对图像有很强的特征提取能力,而DenseNet通过卷积层之间的密集连接,鼓励特征信息多次复用,适合应用于多种疾病的分类任务.因此,本文采用DenseNet作为基础网络进行算法结构设计.

1.2 动态卷积模块

动态卷积原理与条件参数化卷积(conditionally parameterized convolutions,CondConv)[22]的原理相同,均等同于多分支卷积层,即每个卷积层中设置有多个卷积核,根据卷积层的输入决定各个卷积核的权重,再对这些卷积核加权求和得到一个适合该输入的动态卷积核,最后只需对输入执行一次卷积操作便可达到与多个卷积核相当的训练效果.这种方法可以提高卷积层对多尺度信息的特征提取能力,在有效提升模型容量的同时保持高效推理.

图2 DenseNet基本网络结构

CNN在许多计算机任务中取得了最先进的性能.因为不同尺寸的卷积核能够提取到不同尺度的特征信息,所以多个尺寸卷积核的集合总是能获得更好的特征提取效果.但多个卷积核的使用会造成模型尺寸的急剧增加,增加网络部署难度.而动态卷积可以在达到多卷积核集成效果的同时,不会造成计算量的急剧增加,因此可以在不增加模型尺寸的前提下,有效提升模型的训练与推理速度.

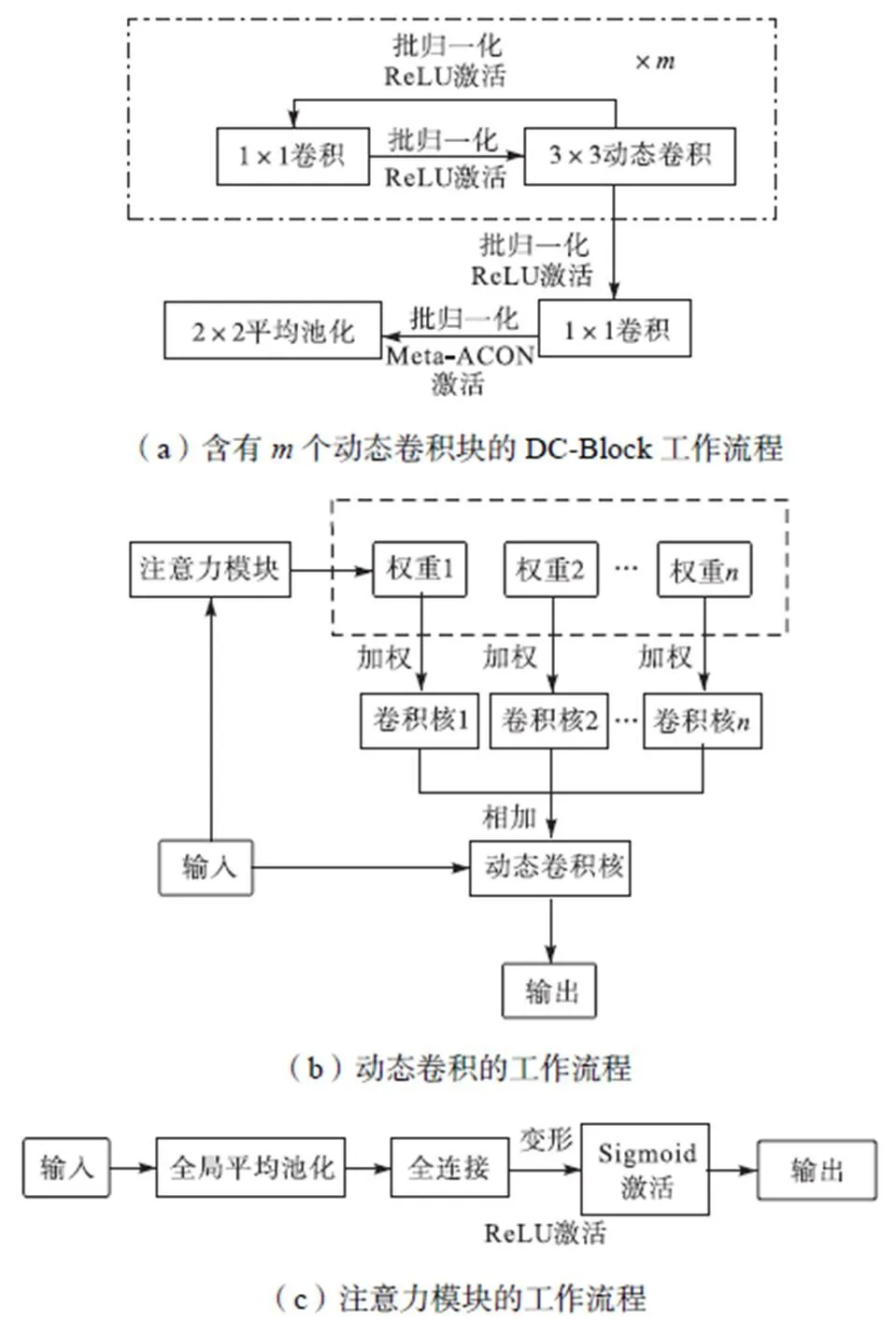

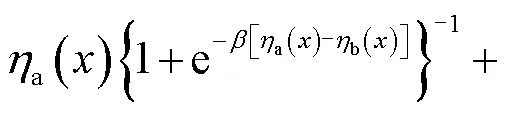

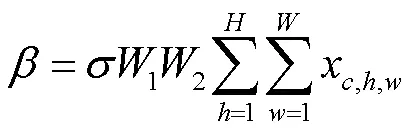

动态卷积模块的构成如图3所示.图3(a)虚线框内的部分表示含有个动态卷积块的DC-Block工作流程,的取值表示该模块含有的动态卷积块数量,分别对应表1中4个DC-Block包含的动态卷积块数量,DC-Block的输出经过批归一化与ReLU激活进入由图中1×1卷积、Meta-ACON激活函数和 2×2平均池化组成的过渡层.图3(b)表示动态卷积的工作流程,本文使用含有3个卷积核的动态卷积,即=3.图3(c)表示动态卷积注意力模块的工作 流程.

图3 动态卷积模块

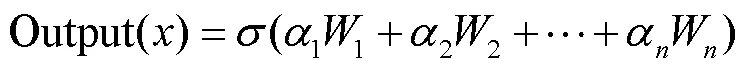

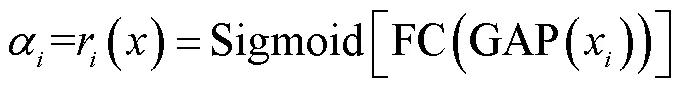

动态卷积输出为

每个普通卷积核的权重系数α通过注意力模块得到,注意力模块如图3(c)所示,其包含3个步骤:全局平均池化(golbal average pooling,GAP)、全连接(fully connection,FC)和Sigmoid激活.

该过程可按式(2)表示,即

DenseNet-121模型的Dense Block由大量1×1卷积与3×3卷积构成.一方面,在Dense Block的卷积层结构中,主要通过3×3卷积提取输入数据的特征信息,1×1卷积的作用则是通过对数据进行降维,辅助数据训练与特征提取更加直观有效地进行;另一方面,将普通卷积替换为动态卷积虽然能够增强网络的性能,但也会带来网络参数量的增加.由于3×3动态卷积比同尺寸的3×3卷积具有更高的计算效率与更强的特征表示能力,因此,为尽可能地增强卷积层对多尺度特征信息的提取能力,同时保证网络性能与负载的均衡,本文将DenseNet模型中所有的3×3卷积替换为3×3动态卷积,构成动态卷积模块.

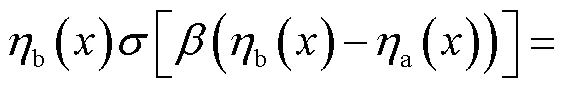

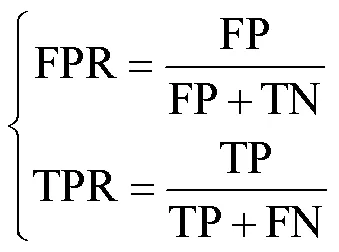

1.3 Meta-ACON激活函数

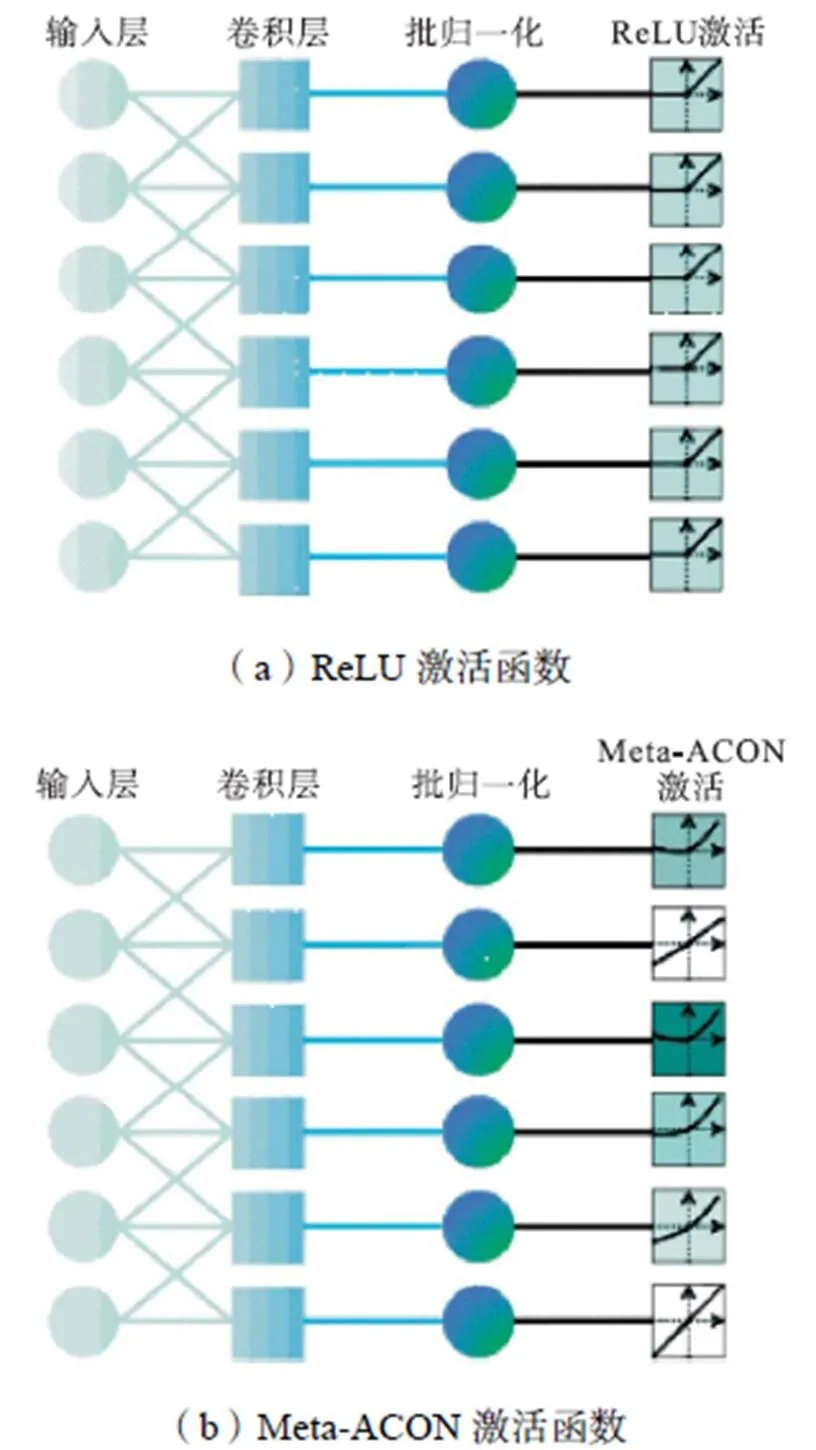

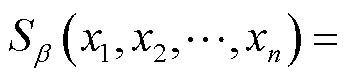

Meta-ACON激活函数是对ReLU激活函数的光滑近似.作为ReLU激活函数的改进形式,Meta-ACON激活函数通过在ReLU激活函数的基础上设置切换因子,可以自适应地选择是否激活,以及使用何种激活函数,这种自定义的激活操作有助于提升网络的泛化能力和信息传输性能,取得了比ReLU激活函数更好的效果.如图4所示,图4(a)、(b)分别表示ReLU激活、Meta-ACON激活在不同输入下的激活状态,其中不同深浅的蓝色色块表示Meta-ACON激活函数的不同激活状态,白色色块表示未激活,色块内为经过自适应选择后的Meta-ACON激活函数.

Meta-ACON激活函数的推导过程如下.

ReLU激活函数本质是一个max函数,即

ReLU激活函数是最常用的激活函数,只需判断ReLU函数的输入是否大于0即可,具有非常快的计算速度,但当的取值落入区间(-∞,0)时,函数的梯度为0,导致相应的参数一直无法更新,ReLU激活函数会因梯度消失而永久关闭[25].

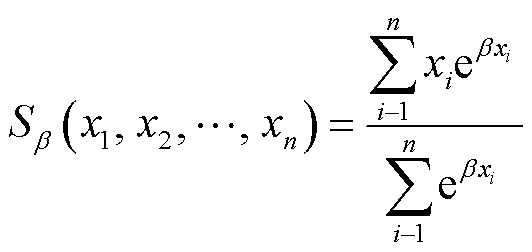

max函数的平滑近似称为光滑最大值(smooth maximum)函数,其公式为

图4 ReLU激活函数与Meta-ACON激活函数

DenseNet模型中存在大量的ReLU激活函数,主要目的是在线性的网络模型中引入非线性元素,并增强网络稀疏性以缓解网络过拟合.一方面,DenseNet模型的过渡层需要处理不同Dense Block的输出,输入情况较为复杂,因此过渡层需要具有更强自适应能力的激活函数;另一方面,对比式(3)与式(6)可知,Meta-ACON激活函数的公式更加繁杂,需要更多的计算量与参数量.因此,为增强网络结构的泛化性能,同时尽量减少Meta-ACON激活函数对网络复杂度的影响,本文只将所有过渡层的ReLU激活函数替换为Meta-ACON激活函数.

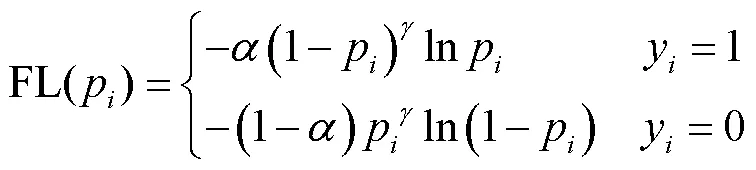

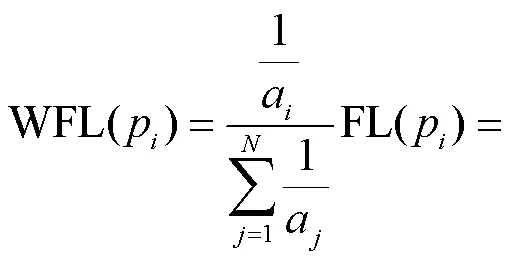

1.4 加权焦点损失函数

本文使用Chest X-ray14数据集,该数据集每张胸片的标签可以表示为一个14维向量,即

多次实验结果表明,不同疾病的分类准确度有很大差异,如肺结节分类准确度较高,而肺实变分类准确度较低.在神经网络的训练过程中,为提高较难分类疾病的分类准确度,从而实现整体分类性能的提升,最直接的方法就是提升较难分类疾病的权重,并降低较易分类疾病的权重.此外,较难分类疾病准确度与平均准确度相差越大,该疾病相应的权重变化值就应当越大,则其相关损失函数的变化幅度就越大,从而使得网络计算资源向较难分类的疾病倾斜.因此,为使网络更有效地依据疾病分类的难易程度调节对应的权重,本文在焦点损失函数的基础上添加权重系数,作为本文每种疾病对应的损失函数,并称其为加权焦点损失(weighted focal loss,WFL)函数,定 义为

由式(10)可知,损失权重与疾病分类准确度倒数呈线性相关,因此可以增加较难分类疾病的损失占比,使网络对其施加更多的关注,从而达到提高较难分类疾病准确度,进而提升整体分类准确度的效果.

2 实验结果及分析

2.1 实验平台与实验数据

本文实验使用PyTorch深度学习框架,硬件平台为Nvidia RTX2080Ti(11GB)GPU×4、Intel Core i7-9900X 3.5GHz CPU,操作系统为Ubuntu16.04.

本文实验在Chest X-ray14数据集上测试DC-DenseNet的性能,并验证该算法的优化方案与各个模块的有效性.Chest X-ray14数据集由30805名不同患者的112120张胸部X光片组成,每幅图像大小为1024×1024,具有8位灰度值,均使用一个或多个标签进行标记,其中14个病理学标签分别表示 14种疾病,标记为未检出(no finding)的CXR图像不含疾病标签.为保证实验结果真实性,随机将数据集以7∶1∶2的比例分割成训练集、验证集、测试集,分别应用于网络训练、训练完成后验证、测试训练效果3个步骤.实验预处理流程如下.

(1)为适配网络模型、减少网络计算量并提高网络学习效率,将原始图像缩放至256×256,然后随机裁剪为224×224的低分辨率图像.

(2)为增加数据的多样性以增强模型的鲁棒 性[27],并避免过拟合现象的发生[28],将图像进行3个维度的随机数据增强处理:①依概率=0.5的水平翻转;②在区间[-5°,5°]之间随机旋转;③对比度与饱和度分别随机增强90%~110%,并使色相偏移幅度在区间[-0.1,0.1]内随机取值.

(3)将数据进行批归一化处理,为接下来的训练做准备.本实验在训练过程中将每批处理数据量(batch size)大小设置为150.

2.2 数据加载方式及后处理优化

本文对多显卡的数据加载方式进行了优化,并使用测试时数据增强策略对测试数据集进行后处理 操作.

在多GPU并行计算中,默认为4张卡分配相同的批处理数据量.然而,由于主卡通常需要承担数据信息的整合计算任务,而副卡仅执行数据处理操作,当为4张卡设置相同的批处理数据量时,相较于主卡而言,副卡仍有剩余空间可以承担更多的数据处理工作,即副卡的批处理数据量可以设置为更高.因此,为充分利用副卡的显存资源,从而充分发挥每张显卡的算力,本文在实验过程中通过优化数据加载方式,分别将每张显卡的批处理数据量设置为30(主卡)、40(副卡1)、40(副卡2)、40(副卡3),相较于默认情况下每张卡的batch size只能设置为30,总和为120,该优化方式下的总batch size最高可设置为150,比默认方式提升25%,从而减少单轮训练迭代次数,减缓训练振荡,提高批归一化效果.

此外,为了在测试时获得更稳健的预测效果,本文使用了测试时数据增强(test time augmentation,TTA)策略,将测试数据进行多个维度的翻转并分别预测,然后对多个预测结果综合分析得到最终输 出[29],该策略可以有效提升分类准确度并降低测试时的泛化误差.实验中发现,水平翻转可以有效提高分类准确度,而垂直翻转后的预测结果并不理想.这是由于Chest X-ray14数据集中仅存在正、反面两种有效样本类型的胸部X光片,因此在测试过程中,水平翻转可扩大测试数据集中有效样本的数量,使识别结果更加准确.而本文在网络的训练过程中,出于对人体空间结构特征与实际应用场景的考虑,并未对样本进行垂直翻转的预处理,因此网络未对垂直翻转后的CXR图像病灶区域特征进行学习,因此,在测试过程中若将样本进行垂直翻转的增强处理,将导致网络无法对处理后的CXR图像病灶区域进行正确识别并分类.

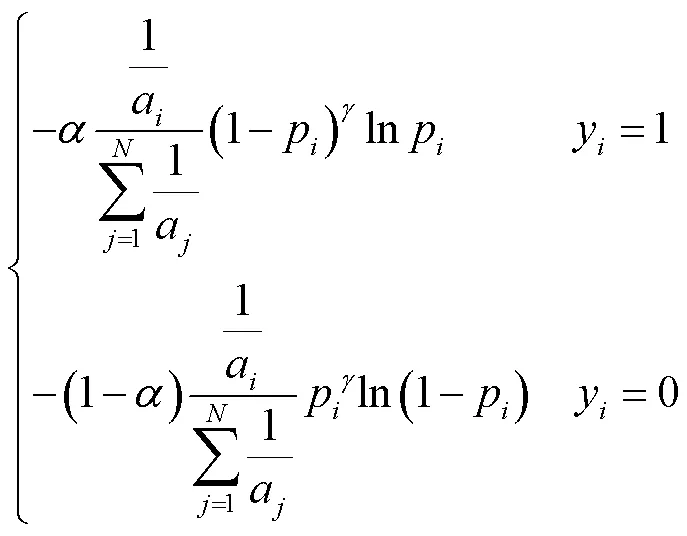

2.3 评价标准

本文使用受试者工作特征曲线(receiver operating characteristic,ROC)与该曲线下面积(area under ROC curve,AUC)的数值作为算法性能的评价指标,并以此为依据与其他算法进行比较.

ROC曲线用于分析二元分类模型的分类效果,二元分类模型输出正类和负类.在ROC曲线中,横轴为假正类率(false positive rate,FPR)特异度,定义为被错误判断为正类的负类在所有负类中所占的比例;纵轴为真正类率(true positive rate,TPR)敏感度,定义为被正确判断的正类在所有原始正类中所占的比例,即

2.4 实验结果

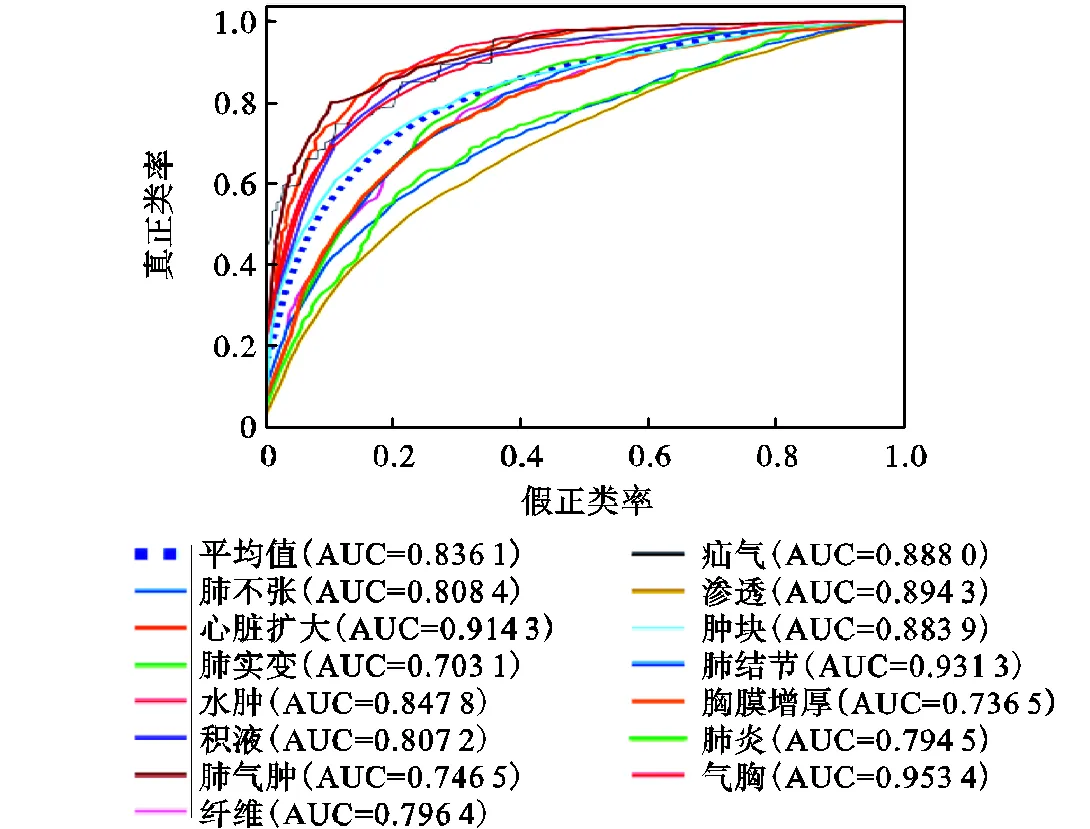

根据本文算法在Chest X-ray14数据集上的分类结果绘制ROC曲线如图5所示,其中,不同颜色的实线分别代表14种疾病,虚线表示该14种疾病的平均水平,可见曲线大部分位于左上角,表明该算法具有良好的分类性能.

图5 ROC曲线

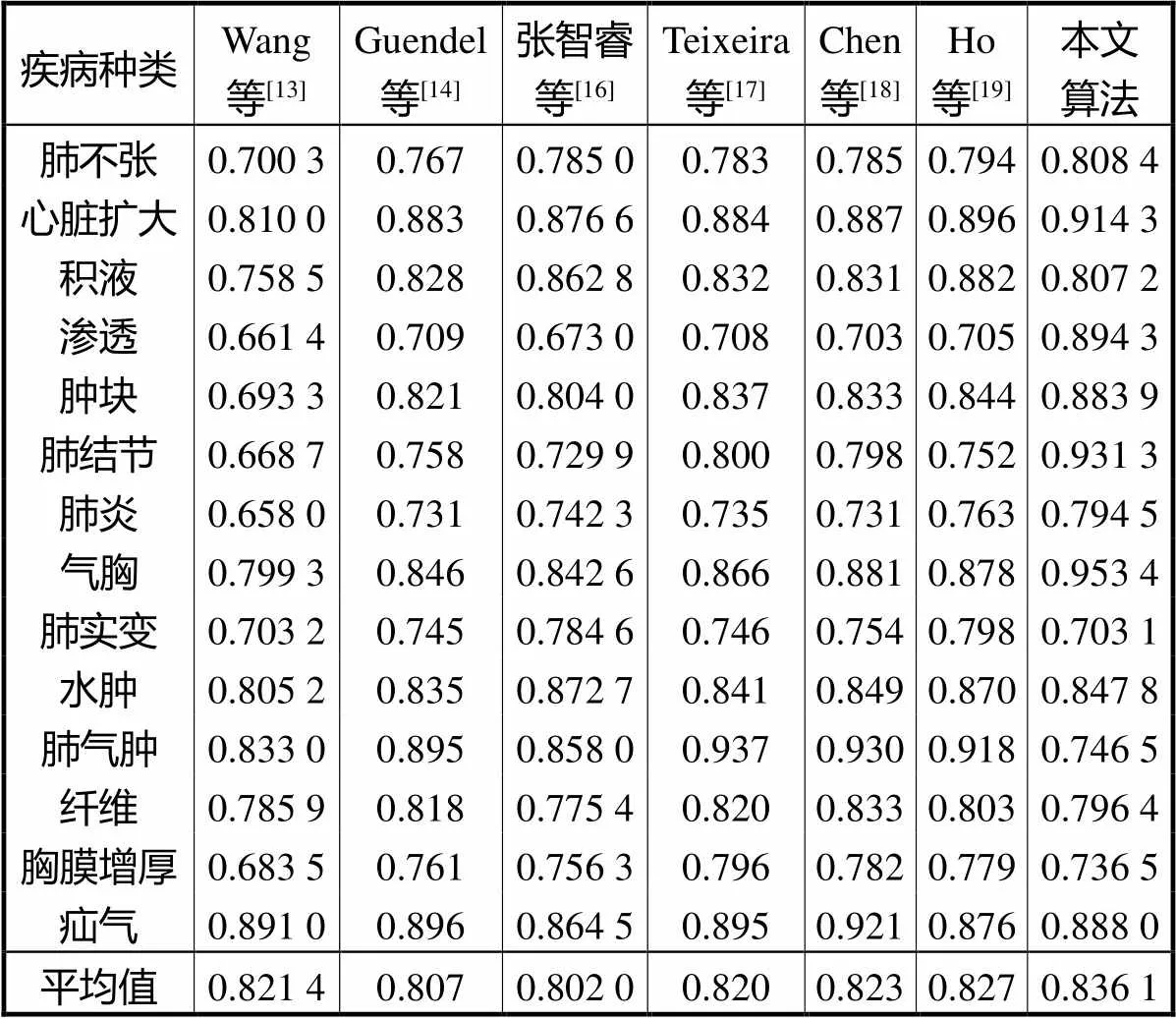

表2总结实验结果,并将本文算法对各项疾病分类的AUC值及其平均值与其他算法[13-14,16-19]进行比较.结果显示,本文提出的算法对于14种胸部疾病分类的AUC平均值达到了0.8361,优于Wang 等[13]、Guendel等[14]、Zhang等[16]、Teixeira等[17]、Chen等[18]、Ho等[19]的研究.具体表现为:对肺不张、心脏扩大、渗透、肿块、肺结节、肺炎、气胸7种疾病的分类效果均显著优于以上几种算法;其中,本文提出的算法对气胸疾病的分类准确度最高,其AUC值达到0.9534,相较Chen等[18]的研究提升了约7.24%.实验表明,本文提出的基于动态卷积的胸部X光片分类算法具有较高的准确度.

表2 各算法的比较

2.5 加权焦点损失函数有效性研究

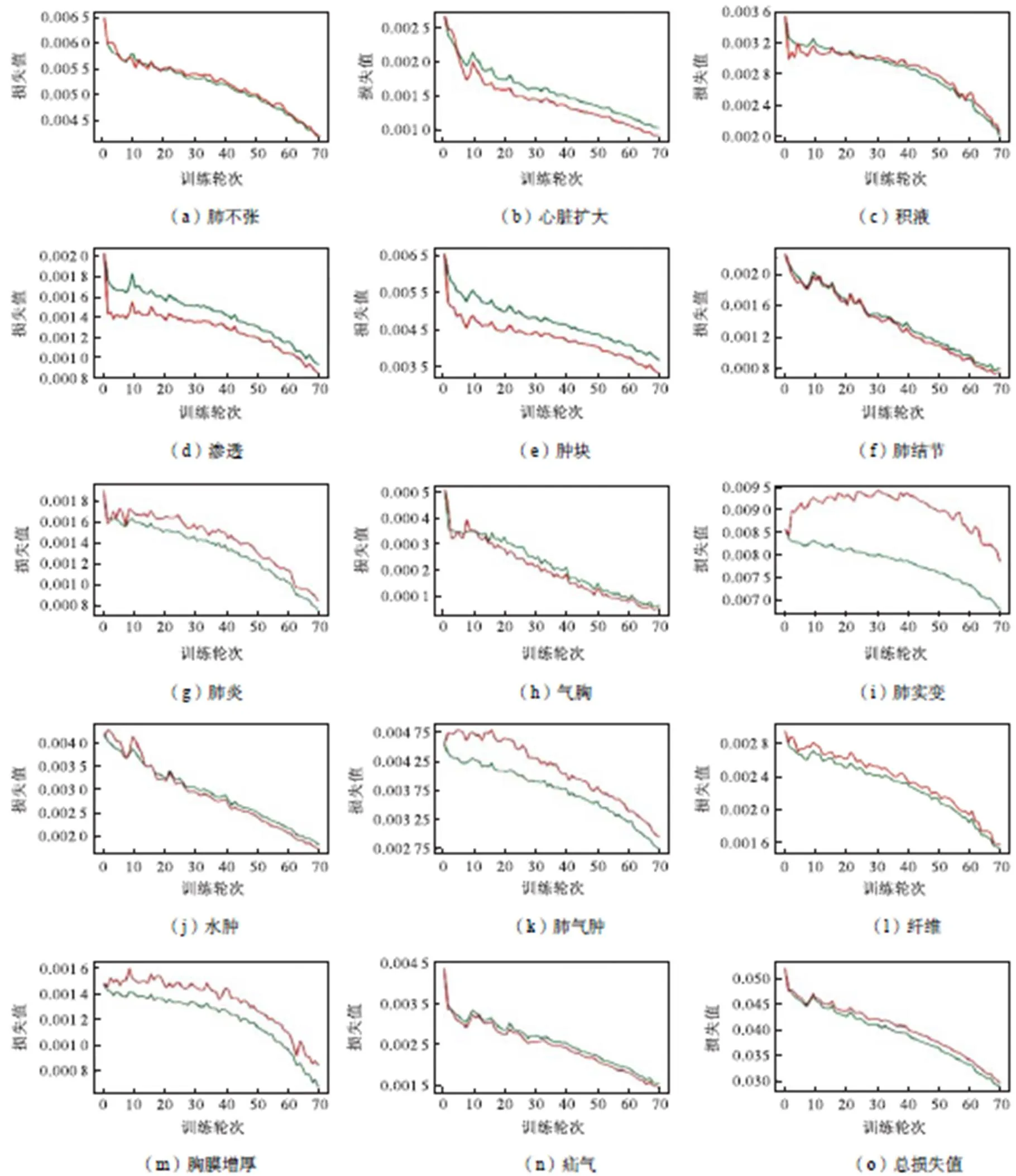

为验证加权损失函数对算法性能提升的有效性,分别在本文提出的DC-DenseNet算法上应用焦点损失函数与加权焦点损失函数进行对比实验.分别记录两次实验中的总损失值以及每种疾病的损失值,并以训练轮次为横坐标,损失值为纵坐标,在同一坐标系上绘制曲线.图6(a)~(o)分别展示了两次实验过程中14种疾病损失与总损失的变化情况.其中绿色曲线表示使用焦点损失(FL)函数的网络模型,红色曲线表示使用加权焦点损失(WFL)函数的网络模型.

根据图6中损失值的变化状况,结合表2分析可得以下结论.

图6 损失函数优化前后对比

(1) 在图6(b)心脏扩大、(d)渗透、(e)肿块、(f)肺结节、(h)气胸、(j)水肿、(n)疝气7种疾病的损失值变化曲线中,应用加权损失函数时,网络模型的损失值始终低于应用焦点损失函数时的损失值,对应表2中这7种疾病的AUC值均高于AUC平均值,表明应用加权损失函数时,算法将这7种疾病识别为较易分类疾病,故降低其权重,表现为其损失值小于应用焦点损失函数时的损失值.

(2) 在图6(a)肺不张、(c)积液、(g)肺炎、(i)肺实变、(k)肺气肿、(l)纤维、(m)胸膜增厚7种疾病的损失值变化曲线中,应用加权损失函数时,网络模型的损失值始终高于应用焦点损失函数时的损失值,对应表2中这7种疾病的AUC值均低于AUC平均值,表明应用加权损失函数时,算法将这7种疾病识别为较难分类疾病,故降低其权重,表现为其损失值大于应用焦点损失函数时的损失值.

(3) 每种疾病的AUC值与AUC平均值相差越大,应用焦点损失函数时的损失变化曲线与应用加权焦点损失函数时的损失变化曲线相差幅度就越大,表明网络模型在训练过程中可根据不同疾病的分类准确度调整其损失值的权重.对于图6中AUC值与AUC平均值差距较大的较难分类疾病,如图6(i)肺实变、(k)肺气肿的AUC值分别只有0.7031、0.7454,算法对其权重的增加幅度较大,其损失值有较为明显的提升;对于AUC值与AUC平均值差距较小的较难分类疾病,如图6(a)肺不张、图6(c)积液的AUC值分别为0.8084、0.8072,算法对其权重的增加幅度较小,因此其损失值的提升幅度较小.

(4) 图6(o)展示了分别应用两种损失函数时网络模型的总体损失变化.应用加权损失函数时网络模型的损失值始终高于应用焦点损失函数时的损失值,说明加权焦点损失函数对算法学习能力的提升效果优于焦点损失函数.

2.6 对比实验

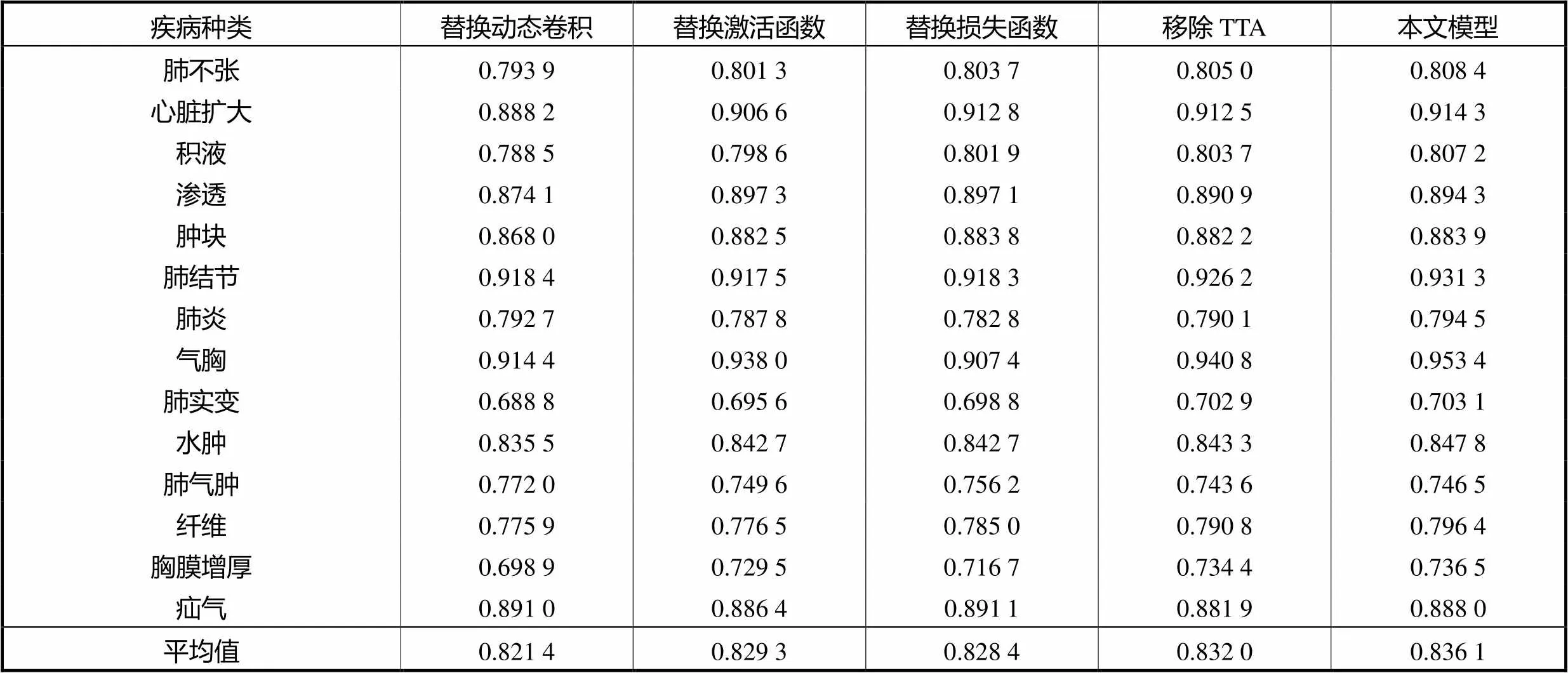

本文在保持基本算法结构完整的前提下,分别移除各个创新模块以验证其有效性,实验结果如表3所示.具体操作分别为:用普通3×3卷积替代网络中所有的3×3动态分卷积,用ReLU激活函数代替所有的Meta-ACON激活函数,用焦点损失函数代替加权焦点损失函数,移除TTA(测试时数据增强)模块.

表3 对比实验

实验结果显示,4个创新模块对算法的分类性能均有提升,且4个模块组合应用时,对于算法分类准确度的提升最为显著.替换动态卷积以移除动态卷积模块后,算法的AUC值下降了约0.015,表明动态卷积的应用可以增强网络的特征提取能力,从而有效提升分类准确度;替换激活函数以移除Meta-ACON激活函数后,AUC值下降约0.007,表明Meta-ACON激活函数有效地提高了激活函数的自适应能力,从而增强网络性能;替换损失函数以去除加权焦点损失函数后,AUC值下降了约0.011,表明加权损失函数可以有效地提升网络学习效果;移除TTA模块后,AUC值下降约0.004,幅度较小,但也可以说明TTA模块的处理有助于网络在测试阶段对疾病进行更加准确的识别与分类.对比各项实验结果表明,本文提出的DC-DenseNet算法中的各个创新模块确实有助于提升网络对于胸部X光片疾病的分类准确度.

3 结 论

针对现有的深度学习方法在胸部X光片分类领域存在的分类准确度较低、网络模型复杂度较高等问题,本文提出基于动态卷积的胸部X光片疾病分类算法,创新之处体现在5个方面:

(1)加入动态卷积模块,增强网络对样本的特征提取能力,有效地提高分类准确度,且不显著增加网络模型的宽度与深度,实现网络分类性能与计算速度的均衡;

(2)使用鲁棒高效的Meta-ACON激活函数替换过渡层中原始的ReLU函数,改善激活函数在梯度消失时永久失活的特性,并使网络能自适应地选择是否激活以及使用何种激活函数,从而使网络的泛化能力得到增强;

(3)提出加权焦点损失函数,使网络可以有针对性地增加较难分类疾病的损失权重,提高网络对较难分类疾病的关注度,从而提升较难分类疾病的分类准确度,最终使整体的分类准确度得到提升;

(4)优化数据加载方式,增大批处理量,提高批归一化效果,以使训练速度和训练效果得到提升;

(5)使用测试时数据增强策略对测试集进行处理,综合分析多个维度的预测结果,提高模型对CXR图像的疾病分类性能.

实验结果表明,本文提出的DC-DenseNet算法对胸部X光片疾病分类具有较高的AUC平均值,表明该算法具有较高的分类准确度,且各创新模块的加入均可有效提升算法整体的分类准确度.

[1] 李 锵,武昱忻,关 欣. 基于SRD感受野自调节的肺炎病灶检测[J]. 天津大学学报(自然科学与工程技术版),2021,54(5):508-516.

Li Qiang,Wu Yuxin,Guan Xin. The pneumonia focus detection based on SRD with receptive field self-regulation[J]. Journal of Tianjin University (Science and Technology),2021,54(5):508-516(in Chinese).

[2] Gulshan V,Peng L,Coram M,et al. Development and validation of a deep learning algorithm for detection of diabetic retinopathy in retinal fundus photographs[J]. JAMA Cardiology,2016,316(22):2402-2410.

[3] Zhao Z Y,Chopra K,Zeng Z,et al. Sea-Net:Squeeze-and-excitation attention net for diabetic retinopathy grading[C]//2020 IEEE International Conference on Image Processing(ICIP). Abu Dhabi,The United Arab Emirates,2020:2496-2500.

[4] Wang Z,Xu H,Sun M. Deep learning-based nodule detection from pulmonary CT images[C]//IEEE 2017 10th International Symposium on Computational Intelligence and Design(ISCID). Hangzhou,China,2017:370-373.

[5] Setio A A A,Traverso A,de Bel T,et al. Validation,comparison,and combination of algorithms for automatic detection of pulmonary nodules in computed tomography images:The luna16 challenge[J]. Medical Image Analysis,2017,42:1-13.

[6] Chen C,Kavuri V C,Wang X,et al. Multi-frequency diffuse optical tomography for cancer detection[C]//2015 IEEE 12th International Symposium on Biomedical Imaging(ISBI). New York,USA,2015:67-70.

[7] Li R Y,Huang J Z. Fast regions-of-interest detection in whole slide histopathology images[C]//International Workshop on Patch-Based Techniquesin Medical Imaging. Munich,Germany,2015:120-127.

[8] Lakhani P,Sundaram B. Deep learning at chest radiography:Automated classification of pulmonary tuberculosis by using convolutional neural networks[J]. Radiology,2017,284(2):574-582.

[9] Iandola F N,Han S,Moskewicz M W,et al. SqueezeNet:AlexNet-level accuracy with 50x fewer parameters and <0.5MB model size[EB/OL]. https:// arXiv.org/ads/1602.07360,2016-02-24.

[10] Szegedy C,Liu Wei,Jia Yangqing,et al. Going deeper with convolutions[C]//2015 IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Boston,USA,2015:1-9.

[11] Li Z,Wang C,Han M,et al. Thoracic disease identification and localization with limited supervision [C]//2018 IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Salt Lake City,USA,2018:139-161.

[12] He K M,Zang X,Ren S,et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Las Vegas,USA,2016:770-778.

[13] Wang X,Peng Y,Lu L,et al. Chest X-ray8:Hospital-scale chest X-ray database and benchmarks on weakly-supervised classification and localization of common thorax diseases[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Honolulu,USA,2017:2097-2106.

[14] Guendel S,Grbic S,Georgescu B,et al. Learning to recognize abnormalities in chest X-rays with location-aware dense networks[C]//2018 Progress in Pattern Recognition,Image Analysis,Computer Vision,and Applications. Madrid,Spain,2018:757-765.

[15] Huang G,Liu Z,Weinberger,et al. Densely connected convolutional networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Honolulu,USA,2017:2261-2269.

[16] 张智睿,李 锵,关 欣. 密集挤压激励网络的多标签胸部X光片疾病分类[J]. 中国图象图形学报,2020,25(10):2238-2248.

Zhang Zhirui,Li Qiang,Guan Xin. Multi-label chest X-ray disease classification based on dense squeeze excitation network[J]. Journal of Image and Graphics,2020,25(10):2238-2248(in Chinese).

[17] Teixeira V,Braz L,Pedrini H,et al. DuaLAnet:Dual lesion attention network for thoracic disease classification in chest X-rays[C]//2020 International Conference on Systems,Signals and Image Processing(IWSSIP). Niteroi,Brazil,2020:69-74.

[18] Chen B Z,Zhang Z,Lin J Y,et al. Two-stream collaborative network for multi-label chest X-ray image classification with lung segmentation[J]. Pattern Recognition Letters,2020,135:221-227.

[19] Ho T K K,Gwak J. Utilizing knowledge distillation in deep learning for classification of chest X-Ray abnormalities[J]. IEEE Access,2020,8:1-14.

[20] Hinton G,Vinyals O,Dean J. Distilling the knowledge in a neural network[J]. Computer Science,2015,14(7):38-39.

[21] Chen Y P,Dai X Y,Liu M C,et al. Dynamic Convolution:Attention over convolution kernels[C]//2020 IEEE Conference on Computer Vision and Pattern Rec-ognition(CVPR). Seattle,USA,2020:11027-11036.

[22] Yang B,Bender G,Le Q V,et al. CondConv:Conditionally parameterized convolutions for efficient inference[C]//33rd Conference on Neural Information Processing Systems (NeurIPS 2019). Vancouver,Canada,2019:1305-1316.

[23] Ma N N,Zhang X Y,Liu M,et al. Activate or not: Learning customized activation[EB/OL]. https://arxiv. org/pdf/2009.04759.pdf,2021-04-16.

[24] 李 锵,姚麟倩,关 欣. 基于级联卷积神经网络的服饰关键点定位算法[J]. 天津大学学报(自然科学与工程技术版),2020,53(3):229-236.

Li Qiang,Yao Linqian,Guan Xin. Clothing key points detection algorithm based on cascade convolutional neural network[J]. Journal of Tianjin University(Science and Technology),2020,53(3):229-236(in Chinese).

[25] Haldar M,Abdool M,Ramanathan P,et al. Applying deep learning to airbnbsearch[EB/OL]. https://arxiv.org/ pdf/1810.09591.pdf,2018-10-24.

[26] Lin T Y,Goyal P,Girshick R,et al. Focal loss for dense object detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2020,42(2):318-327.

[27] 黄志清,贾 翔,郭一帆,等. 基于深度学习的端到端乐谱音符识别[J]. 天津大学学报(自然科学与工程技术版),2020,53(6):653-660.

Huang Zhiqing,Jia Xiang,Guo Yifan,et al. End-to-end music note recognition based on deep learning[J]. Journal of Tianjin University(Science and Technol-ogy),2020,53(6):653-660(in Chinese).

[28] 梁 煜,张金铭,张 为. 一种改进的卷积神经网络的室内深度估计方法[J]. 天津大学学报(自然科学与工程技术版),2020,53(8):840-846.

Liang Yu,Zhang Jinming,Zhang Wei. An improved indoor depth estimation method using convolutional neural networks[J]. Journal of Tianjin University(Science and Technology),2020,53(8):840-846(in Chinese).

[29] Mikołajczyk A,Grochowski M. Data augmentation for improving deep learning in image classification problem[C]//2018 International Interdisciplinary PhD Workshop(IIPhDW). Świnouście,Poland,2018:117-122.

Classification Algorithm for Chest X-Ray Diseases Based on Dynamic Convolution

Li Qiang,Zhao Qimeng,Guan Xin

(School of Microelectronics,Tianjin University,Tianjin 300072,China)

Chest diseases are a severe threat to human health. The timely and accurate detection of chest diseases has great significance on patients’ treatment and rehabilitation. Chest X-rays are usually used to diagnose chest diseases. However,the existing classification algorithms for chest X-ray diseases are inaccurate due to the diverse chest diseases and their complex pathological characteristics,including low classification accuracy and high model complexity. In response to the above problems,a new classification algorithm for chest X-ray diseases was proposed based on dynamic convolution. The dynamic convolution blocks were added to the densely connected network. The feature extraction capability of the network for multiscale information was enhanced under the premise of not significantly increasing the size of the network model and reducing efficient inference while improving the classification accuracy. The ReLU(rectified linear units)activation function was improved using Meta-ACON,and the generalization ability of the network was enhanced by adaptively selecting the linear-nonlinear switching factor to activate and which activation function to use. The weighted focal loss function was proposed based on a weight adjustment factor added into the focus loss function so that the network reasonably allocated the weight for each disease according to the classification difficulty. To improve their classification accuracy,the overall performance was optimized by increasing the percentage loss of difficult-to-classify diseases. To improve the batch normalization,the data loading method was optimized and batch size increased. In the testing phase,a test-time data augmentation was used to analyze the multiple dimensions classification results and increase the accuracy and robustness of the classification. We found that the average value of the area under the receiver operating characteristic curve(AUC)of the proposed algorithm for the 14 chest diseases was 0.8361 after adding dynamic convolution blocks,Meta-ACON activation function,and weighted focus loss function into the densely connected network,optimizing the data loading method and using test-time data enhancement strategy. Furthermore,the AUC value of a single disease label was up to 0.9534,which is higher than that of the existing six state-of-the-art algorithms. Our results are higher than those of the six recent existing advanced algorithms. The experimental results show that the classification algorithms for chest X-ray diseases based on dynamic convolution have a higher classification accuracy and stronger model robustness. Hence,the algorithm could be well applied to the chest X-ray diseases classification task.

chest X-ray;disease classification;dense connection network;dynamic convolution;ACON activation function;weighted focal loss function

TP391.4

A

0493-2137(2022)09-0953-12

10.11784/tdxbz202105005

2021-05-03;

2021-08-30.

李 锵(1974— ),男,博士,教授.

李 锵,liqiang@tju.edu.cn.

国家自然科学基金资助项目(61471263);天津市自然科学基金资助项目(16JCZDJC31100);天津大学自主创新基金资助项目(2021XZC-0024).

the National Natural Science Foundation of China(No.61471263),the Natural Science Foundation of Tianjin,China (No.16JCZDJC31100),the Seed Foundation of Tianjin University(No.2021XZC-0024).

(责任编辑:王晓燕)