基于可控方向直方图算法的掌纹图像特征提取技术

2022-05-28陈小祥

陈小祥

(安庆职业技术学院 信息技术学院,安徽 安庆 246003)

当今互联网、物联网、大数据等智能技术逐渐成为时代热潮,新兴信息技术引领智能生活走向主流[1]。智能手机作为多种新兴信息技术的融合产物,不仅可以进行信息快速有效获取和高速交互,且不受时间地点的限制[2]。然而人们在享受信息网络带来的便利时,也面临着信息透明化下的人身、财产等各个方面的安全威胁,用户的信息安全问题已经成为信息技术发展的焦点问题,进行用户身份认证是保护用户信息安全的重要且有效的手段[3]。传统的身份认证或利用身份标识知识,如口令和密码,或利用身份标识物品,如各种通用证件[4]。这些传统技术对信息安全有着一定程度的保护作用,但随着科技和信息化技术的发展,一方面物品伪造、信息窃取等高端犯罪手段层出不穷;另一方面,信息智能化时代迫切需要方便安全的电子化身份认证方式[5]。基于此,以生物特征识别进行用户身份认证方式,成为了信息安全问题的研究与应用趋势。

1 生物特征识别与掌纹识别技术

生物特征识别的本质是模式识别,它将个体特征进行提取、匹配,从而实现对个体的身份识别。用户要实现其对用户的识别功能,需完成两个步骤,首先需要通过注册、验证完成用户数据的采集和存档(存入数据库),接下来才能使用该系统实现用户特征的提取、匹配,进而完成身份认证。在生物特征识别中,目前常用的有掌纹识别、指纹识别、人脸识别、DNA 识别等,而掌纹识别稳定性、可鉴别性、可采集性等特征识别性能良好,且人的掌纹信息包含着丰富的图像内容,由于掌纹位于手心的位置,因此不容易受到破坏,不易被伪造[6]。掌纹信息作为生物特征信息中的一种,掌纹识别系统与生物特征识别系统的结构基本一致,区别在于掌纹信息主要是一种图像信息,因此信息采集的第一步为掌纹图像采集。图像信息的识别经过预处理环节,以保证特征的有效性,在特征提取后,将提取特征与数据库信息进行特征匹配,并得到识别结果。

掌纹识别主要包括特征信息的提取和匹配两个阶段,其中特征提取是掌纹识别的关键环节,但掌纹识别中的图像处理技术对内存有所要求,且基于PC 端的研究应用较多。目前智能手机在人们日常生活中的普及性更高,实用性更强,但掌纹识别技术作为信息安全的保障,在智能手机端的研究必须保证在足够的识别率的前提下,进行内存计算的效率优化。基于此,本次研究以掌纹特征提取为重点,进行了基于算法优化的掌线方向特征提取研究。

2 基于可控方向直方图算法的掌纹识别技术

2.1 梯度方向直方图算法

由于掌纹具有丰富的图像信息,因此经过多年发展,形成了许多关于掌纹特征信息提取的理论方法,如基于结构特征的识别方法、基于图像纹理的识别方法、基于图像方向特征的识别方法、基于图像低维空间映射的子空间识别方法、基于相关滤波器的识别方法等[7-8]。有研究表明,掌纹线的纹理走向具有较多的辨识信息,手掌等背景的灰度值与掌纹线的灰度值之间存在较强的差异性,且这种差异不易受到采集环境和图像处理操作的影响,因此这里以掌纹线的方向特征进行特征信息的识别提取。

梯度方向直方图(Histogram of Gradient,HOG)算法的本质是以梯度方向统计局部特征信息,通过密度分布描述其形状及表象。其实现方法分为两个步骤,一是将局部目标划分为双层区域,并进行梯度方向的特征统计计算;二是在固定维数串联梯度特征,得到梯度方向直方图。这种方法当前已被广泛应用于目标检测识别领域。图1 所示为HOG 梯度方向直方图算法的具体操作流程,以HOG 算法进行特征提取,首先需要进行图像的两层区域划分,第一层是由一个个小的联通区域所构成,这些小区域被称为细胞单元(cell),每个细胞单元都分布着固定量的像素;第二层是由多个细胞单元组成的区块(block),是图像的第二层区域,区块与区块之间可以重叠。

图1 HOG 梯度方向直方图算法具体操作流程

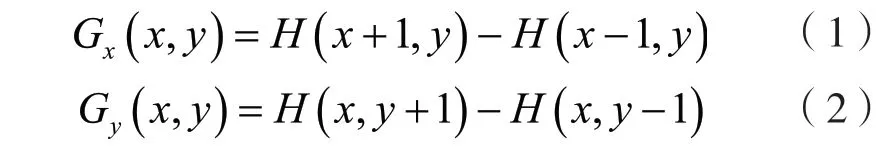

双层区域划分完成后,便可开始计算图像计算梯度方向像素值。设图像像素点坐标为(x,y),则式(1)、(2)分别表示其在水平方向和垂直方向的梯度值,该梯度值则是由梯度方向像素值之差得到。其中G表示梯度值,H表示像素值。

在上式基础上,梯度幅值G(x,y)和梯度方向α(x,y)的计算式如下。

在完成梯度方向的计算后,需要将构造梯度方向直方图。在180°以内将目标区域等间隔划分为k 个小区域,并以bin 表示;将cell 单元的梯度值进行k 维梯度幅度的累加,可得到梯度方向直方图。第一层区域的细胞单元具有剧烈的梯度变化,此时需要进行区块(block)的特征归一化,以此对阴影、光照、边缘信息进行进一步的压缩。这里假设一个区块为一个扫描窗口,对区块内的细胞单元进行特征统计,当区块长度大于扫描步长时,会出现区块间重叠现象,这就造成单个细胞单元会被计算多次,于是在最终的特征向量中,单个细胞单元有不同的结果值。重叠块的信息对分类结果具有改善效果,因此区块的归一化效果对于特征提取很重要。

2.2 方向可控滤波器算法

方向可控滤波器算法与梯度方向直方图算法的区别在于其可以获取的多方向特征信息,这种方法通过图像中像素点的方向幅值和方向信息,寻找最优方向,并以此提高掌纹识别率。这里的方向信息和方向幅值的获取,需要以任意方向的滤波器进行图像卷积运算,从而得到所有方向上对应的方向响应值,这种方式使得像素方向信息有了全方位的拓展,掌纹的方向信息更为丰富。

方向可控滤波器以已知“基滤波器”进行线性组合,以此构造全方位的滤波器,“基滤波器”用二维高斯函数的一阶导数表示,二维高斯函数如式(5)所示,由此可得到0°和90°方向的基滤波器,如式(6)(7)所示。

以θ表示滤波器的方向输入控制,通过式(6)和式(7)的线性组合,可以对全方向滤波器用下述方程式表达。

2.3 方向可控直方图算法

结合上述可知,HOG 算法中通过区域划分和梯度方向幅值信息可以很好地改善特征信息分类情况,而方向可控滤波器算法可以进行方向信息的全方位拓展,对掌纹图像的表达信息进行了极大的丰富。基于前述两种算法的优势,在这里将HOG 梯度方向直方图算法与方向可控滤波器算法进行结合,首先以方向可控滤波器算法进行全方位方向响应值和幅值信息的获取;其次将获取的信息进行区域划分和全方向的直方图构建,最终得到包含任意方向的掌纹识别直方图算法结果,在这里以HOS(Historgrams of Oriented Steerable Filter)方向可控直方图对这种方法进行命名。

图2 表示方向可控直方图的算法实现过程,主要包括两个阶段,第一阶段进行最佳方向特征的提取和对应方向幅值的计算,第二阶段根据方向和幅值信息进行区域划分和方向可控直方图的构建。第一阶段主要是以方向可控滤波器算法为主,组织和挑选掌线信息中的方向信息,其中描述信息的最佳方向个数通过方向特征的识别率进行判断。将得到的方向信息代入公式(8),通过计算得到信息的方向幅值,从而获得对应的方向图。第二阶段以HOG 算法进行特征信息的统计,通过双层区域划分,建立细胞单元与重叠区块,通过对区块中各个细胞单元的直方图进行归一化处理,以区块进行细胞单元的特征扫描,最后串联所有区块的方向直方图,得到完整区域内的方向直方图。

图2 HOS 方向可控直方图算法实现过程

在掌纹图像的预处理中,需要进行原始图像的二值化,因为原始图像为彩色图像,其中包含许多无关信息,所以需要将其转换为灰度图,这里利用转换公式Gray=0.3R+0.59G+0.11B实现。通过设置背景和人手两者不同的灰度阈值,对图像进行灰度等级划分,可以将背景和人手两者区分开来。

通过计算训练图像和测试图像之间的相似度大小,可以得到掌纹的特征匹配情况,这也是掌纹识别的关键任务,可控方向直方图算法中这一任务可以转化为计算直方图的相似度大小,在此以无参数统计中的曼哈顿距离和卡方距离进行匹配。曼哈顿距离又被称为出租车距离,因为出租车司机计算两个位置的距离是以曼哈顿地区横平竖直的街区坐标先进行分别相减,再相加。这种划分与本次研究中的图像区域划分有异曲同工之妙,式(9)为它的计算公式,以标准坐标系中两点的横坐标绝对值与纵坐标绝对值之和进行表示。

卡方距离是以卡方统计量为基准,衡量对象间的差异性,其计算公式如式(10)所示。

其中,S代表测试图像的方向可控直方图,M代表训练图像的方向可控直方图。用B表示bin 数,b则表示这个直方图的第i 个bin,通过式(10)可以计算训练图像和测试图像直方图之间的距离。在得到图像直方图距离后,将提前设置的距离阈值与计算结果进行比对,当计算的距离大小在距离阈值范围内时,则说明测试图像与训练图像为正确的匹配结果。

香港理工大学的掌纹数据库(PolyU II)中有7752 张掌纹灰度图像数据,这些数据来源于386只手掌,其中每一只手大约有20 张不同的样本图像。为验证上面所提出的HOS 算法性能,对PolyU II 掌纹数据库中的386 只手掌掌纹进行数据采集,采集分两次进行,每次采集10 张左右,两次分别采集了3874 张和3868 张图像。

为保证验证实验的可靠性,选择了一些算法与HOS 算法进行性能对比,分别是HOG 梯度方向直方图算法(HOG)、kirsch方向统计方法(kirsch)、LBP局部二值模式(LBP)、LTP 局部三值模式(LTP)、LDP 局部方向模式(LDP)、融合Gabor 特征和LBP 方法(LBP_G),其中kirsch 卷积方法是与Steerable filter 进行方向信息获取性能的比较。对各种方法的参数设定进行描述,选择128×128 像素的图像作为识别对象,HOG 算法选择7×7 块细胞单元cell,每块像素大小为32×32,可细分为4 个区块,且有部分重叠,梯度方向选择9,特征维度为1764;kirsch 方法选择kirsch 算子,卷积响应值以每个像素8 个方向进行计算,将每个图像划分为8×8 个区块,每个区块像素为16×16,无部分重叠,则特征维度为512;HOS 算法以Steerable filter 进行9 个方向的特征计算,σ=1.5,每个像素图像划分为8×8 个区块,每个区块像素大小为16×16,无部分重叠,特征维度为579;LBP 和LTP 设置P 值为8,有 28个模式,每个图像划分为8×8 个区块,每个区块像素大小为16*16,无部分重叠,则LBP 特征维度为16384,LTP 特征维度为23768;LDP 采用kirsch卷积方法,相关设置与kirsch 方法一致,共 28个模式,则特征维度为16384;LBP_G 采用gabor 滤波器进行小波滤波,σ=5.6179,8 个方向,5 种尺度,将每个图像划分为2×2 个区块,均匀模式下有59 种,则特征维度为9440。这里以等错误率EER 进行算法性能评价指标。

为了对训练图像和测试图像进行相似度大小的度量,采用曼哈顿距离和卡方距离进行相似性度量,表1 为各个算法下的卡方距离和曼哈顿距离,图3 以柱形图对各个算法下两种距离度量进行了直观表示。从图3 的统计结果可以看出,HOS 算法明显优于其他算法,无论是曼哈顿距离统计,还是卡方距离统计,其识别效率均达到99%以上;在保证单一变量的情况下,将HOS的Steerable filter 与kirsch 卷积方法进行方向信息获取性能的对比,Steerable filter 方法比kirsch 卷积方法获取的方向信息更为丰富,算法识别率更高。除此之外,曼哈顿距离和卡方距离这两种方法对大部分算法的识别率判断差距较小,但其在LBP 和LDP 两种算法的识别率判断上存在较大分歧。

表1 卡方距离和曼哈顿距离下各算法识别率

图3 曼哈顿距离和卡方距离匹配下各算法识别率对比

在评价智能算法的工作性能时,通常会用到FRR、FAR、ARR、ROC 等指标。本次研究采用ROC 曲线对研究算法的工作性能进行评价,它由FAR 和FRR 组成,相对全面地反映了系统工作性能;ROC 曲线上斜率为1 的点表示等错误率EER,反映了算法的精确性。在这里以曼哈顿距离和卡方距离的等错误率EER 对各个算法进行性能评价,结果如表2 所示,观察数据结果可以看出,HOS 算法下的卡方距离EER 值为0.6563,曼哈顿距离EER 值为0.5308,HOS 算法的EER 值远小于其他算法,这说明HOS 算法的性能最好,能对掌纹的纹理走向进行更为准确的识别。

表2 各算法性能评价

3 结论

本研究以掌纹特征识别为研究对象,对掌纹纹理走向特征提取进行算法优化。研究结果显示:HOS 算法下的卡方距离EER 值和曼哈顿距离EER值分别为0.6563 和0.5308,HOS算法的EER 值远小于其他算法。通过验证对比实验说明,在目前所提出的掌纹图像特征提取识别技术中,HOS 可控方向直方图算法具有较好的识别性能,这为目前的图像识别算法提供了一种新的组合思路,但研究仍旧存在一些不足,如在算法的参数上没有进行进一步的优化,这会在后续研究中进行深入开展。