基于优化卷积神经网络的人脸图片微表情识别方法研究

2022-03-29张爱民

张爱民

(中共涡阳县委党校,安徽 涡阳 233600)

0 引言

面部表情是社会交往过程中,除了通过面部识别一个人的身份外,还可以通过面部表情实现信息交流,如微笑表示交流的开心,蹙眉表示存在不同的意见,眨眼表示交换意见等[1]。因此,通过人的面部部位变化,可以直接显示一个人的心情。然而,人脸微表情不像人脸表情那样明显,所隐藏的情绪更加直观,多为人物自发式产生的表情,不受他人主观意识控制,多表现在瞳孔、肌肉组织的细微变化,具有持续时间短、幅度小、局部化呈现的特点[2]。所以,人物微表情对于刑侦破案、心理治疗、危险规避等方面,具有非常大的应用价值[3]。基于此,人脸微表情识别具有极高的社会价值。

国内外面对人脸微表情在各个领域所能发挥的应用价值,将人脸微表情识别任务划分为检测和分类两个方向[4-5],随着计算机技术的发展,让这两个方向上的任务得以实现。文献[6]依据微表情特点,将时空特征和微表情联系在一起,提高微表情区分度,增强识别效果。文献[7]将微表情特征融入长短期记忆网络中,让网络学习记忆微表情特征,从而通过网络的分类器,识别微表情。文献[8]针对微表情识别存在的难题,采用平衡微表情数据样本采集的方式,让微表情识别模型具有较高的微表情识别精度。上述方法在识别人脸图片微表情时,存在严重的微表情识别混淆问题,为此引入优化卷积神经网络,提出人脸图片微表情识别方法,提高识别方法对微表情特征提取能力,最大程度地避免微表情识别混淆。

1 人脸图片微表情识别方法研究

1.1 预处理人脸图片

优化卷积神经网络需要通过数据集训练的方式,识别微表情。但是,在训练数据集过程中,可能存在表情序列帧数不统一、个体微表情差异大、微表情无关区域范围广等问题[9]。为此,采用齐剪裁、图像序列插帧和帧数归一化3种方式,预处理人脸图片训练数据集。

1.1.1 数据集对齐剪裁 对人脸图片微表情数据集进行第一帧变换处理,则有:

公式(1)中,ς表示变换矩阵;i表示第i个人脸图片微表情数据;LWM()∙表示局部加权平均函数;n表示人脸图片微表情数据集中含有的人脸图片数;χ()Ni表示第i个人脸图片微表情数据,所含有的N个微表情特征;χ(mi,1)表示第i个人脸图片微表情数据中,第一帧图像提取出来的m个微表情特征[10]。

在公式(1)的变换基础上,再针对ς得到的图像对其进行处理,则有:

公式(2)中,k表示帧数;f′i,j表示第i个人脸图片微表情数据中,第j帧人脸对齐后得到的图像;fi,j表示经过公式(1)变换后,得到的第i个人脸图片微表情数据中,第j帧人脸图像。

由于数据集中的人脸图片微表情尺寸大小不一,根据微表情动态特征影响小、图像比例尺寸与原比例尺寸相近、图像大小为原来的2倍等原则,归一化处理人脸图片微表情尺寸。

1.1.2 图片序列插帧 为了避免帧数归一化,造成图片特征损失,在人脸图片的连续两帧的中间,插入一帧图像,以此来增加帧数归一化处理后的图像,与原来图像的相似度。

采用优化卷积神经网络反卷积的运算过程,依据图像两帧特征,在两帧中间生成中间帧。基于此,选择MSE损失函数S(I1,I2):

公式(3)中,ij表示人脸图片中像素点的位置;表示人脸图片真实中间帧;表示优化卷积神经网络预测的人脸图片中间帧[11]。

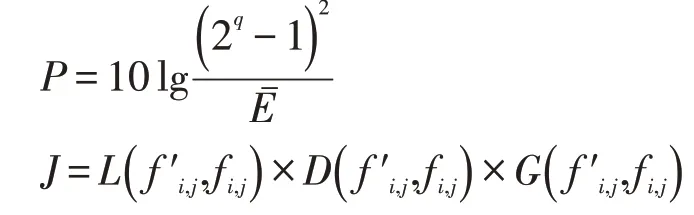

为保证图片插入帧质量,采用峰值信噪比P、结构相似性J、平均结构相似性Jˉ3个指标,评价人脸图片插帧质量。

公式(4)中,Eˉ表示插帧图片f′i,j与原始图片fi,j的均方误差;q表示像素比特数;L(f′i,j,fi,j)表示亮度相似度;D(f′i,j,fi,j)表示对比度相似度;G(f′i,j,fi,j)表示结构相似度;n表示图片结构指标数量;κ表示图片中任意一个结构指标;f′i,j(κ) 表示图片f′i,j的均值;fi,j(κ) 表示图片fi,j的均值[12]。

满足公式(4)对插帧质量评价结果,停止网络反卷积运算过程,得到最优预测人脸图片中间帧,插入人脸图片中。

1.1.3 人脸图片帧数归一化 假设微表情序列帧数为M,归一化处理后,得到离散化向量T:

根据公式(5),对人脸图片中任意像素点(i,j)的像素值向量Ii,j建立时间内插模型C:

公式(6)中,Curve()∙表示曲线拟合函数。综合公式(5)和公式(6),完成图片帧数归一化处理[13]。

综合上述数据集进行对齐剪裁、图像序列插帧和帧数归一化处理步骤,完成图片预处理,此时,即可对人脸图片微表情特征进行提取。

1.2 提取人脸图片微表情特征

依据上一小节得到的预处理图片f′i,j,采用局部二值模式提取人脸图片特征。将描述纹理方向信息的单演相位值量化在[0°,360°]之间,划分为N个等角度的区间,即。当同一个角度区间,同时存在图片中心像素i和邻域像素j的单演相位φ值时,则将其记为0,反之记为1。

基于此,假设i的灰度值为O1,第n个区间j的灰度值为On,则图片中心像素i和邻域像素j的单演相位编码为:

公式(7)中,n∈N,表示第n个区间;Z表示二进制数;Q表示图片方向信息[14]。

图片的单演方向信息与单演相位信息计算过程类似,当两类像素单演方向ε在同一角度区间,则图片像素记录的信息方向相同,记为0,反之记为1,则有:

公式(10)中,W表示人脸图片尺度数;R表示划分的区域个数;F1(s,r)表示人脸图片微表情s尺度上的第r个区域的直方图。

公式(10)得到的人脸图片微表情局部直方图F,记为微表情特征集,用于网络卷积训练,识别人脸图片微表情。

1.3 基于优化卷积神经网络识别人脸图片微表情

优化卷积神经网络,训练人脸图片微表情特征数据集,可以从图片特征出发,不受其他因素干扰,为此采用其识别人脸图片微表情。

在此次研究中,采用的优化卷积神经网络的基本单元包括输入和输出两部分,其中,可以输入n个人脸图片微表情特征数据集,得到一个人脸图片微表情识别结果,假设神经元偏置为b;网络激活函数为f()∙,则其计算公式如下式所示:

公式(11)中,y表示网络训练输入值后,得到的输出值;xi表示网络第o个神经元接收的第i个人脸图片微表情特征数据;ωi表示xi与o之间的联系权重[15]。

从公式(11)中可以看出,优化卷积神经网络具有线性特征,为了避免输出结果,只有线性关系,选择sigmoid和tanh两个非线性函数激活网络,则有:

根据公式(12)所示的激活函数,激活网络每一层卷积神经元,得到y值计算过程,作为网络的前向传播过程。同时,通过反向传播训练数据集,调整ω和b值,将网络的损失尽可能降至最小。

假设人脸图片微表情特征数据样本xi的标签为yi,属于网络正向传播的输出,则网络反向训练的输出为γω,b(xi)。此时,网络反向训练数据样本,产生的网络损失函数ξ(ω,b;xi,yi)公式如下式所示:

在公式(13)所示的网络损失函数下,为避免求取的ω和b属于局部最优解,设置ω和b迭代更新约束条件:

公式(14)中,l表示第l层神经元;η表示学习速率;∂表示求偏导;表示第i个数据样本和第o个神经元之间的联系权重;

采用公式(12)激活网络,得到的激活值,作为反向训练样本,则其训练算法如下,步骤1:计算网络中L层第o个神经元的残差;步骤2:逐层计算网络中每一层残差步骤3:在神经元残差计算结果基础上,根据ω和b迭代更新设置约束条件,求取ω和b的偏导。

按照上述计算过程,针对人脸图片微表情特征数据集,进行正向训练和反向训练,从而根据图片特征,得到人脸图片微表情识别结果。

2 实验与分析

选择基于细粒度的微表情识别方法(文献[6]方法)和基于长短期记忆网络的微表情识别算法(文献[7]方法)作为此次实验的对比方法,采用JAFFE和Cohn-Kanade两个国际标准微表情测试数据库,作为此次研究设计的实验数据库,验证此次研究的基于优化卷积神经网络的人脸图片微表情识别方法。

2.1 数据集介绍

此次实验选择的JAFFE和Cohn-Kanade两个国际标准微表情测试数据库,共包括蔑视、厌恶、恐惧、开心、压抑、悲伤、惊讶、紧张等8种微表情。其中,JAFFE微表情测试数据库,主要为亚洲人种微表情,数据量相对较小,所存储的人脸图片具有面部区域变化弱;Cohn-Kanade微表情测试数据库,采集的人脸图片分布于全球,样本数量较多,所存储的图片光照不均匀,类别信息划分不明显。

根据JAFFE和Cohn-Kanade存储的图像数量比例,选择186张JAFFE微表情测试数据库中图片,作为此次实验图片,并将其划分为3组,每组62张图片,选择其中2组作为实验训练集,其中,1组作为实验测试集。从Cohn-Kanade微表情测试数据库中,选择786张人脸微表情图片,作为此次实验图片,并将其划分为3组,每组262张图片。

从2个数据库中,分别选择2组图片作为训练集,一组图片作为实验测试集。针对此次实验选择的972张图片进行预处理,每张图片的尺寸设置为30*36,图像分辨率设置为254 dpi。

2.2 实验步骤

采用3组微表情识别方法,分别训练2组微表情训练集图片,当3组方法对人脸图片微表情识别率达到最高时,用3组方法分别识别2组微表情测试集图片,通过交叉验证的方式,对比3组方法识别2组微表情测试集图片混淆问题严重程度。

2.3 结果分析

2.3.1 检测JAFFE人脸图片微表情识别混淆情况 交叉验证3组方法,识别JAFFE微表情测试数据库8种微表情,得到的混淆矩阵见图1。

图1 JAFFE人脸图片微表情识别混淆情况Fig.1 The facial image micro expression recognition confusion based on JAFFE method

从图1中可以看出,细粒度分层时空特征描述符的微表情识别方法,识别8种微表情,存在17种微表情识别混淆;基于长短期记忆网络与特征融合的微表情识别算法,存在15种微表情识别混淆;而研究方法仅存在8种微表情识别混淆,相较此次实验选择的2组方法,混淆种类分别减少9种和7种。可见,此次研究方法,明显减少了微表情识别混淆种类。

2.3.2 检测Cohn-Kanade人脸图片微表情识别混淆情况 交叉验证3组方法,识别Cohn-Kanade微表情测试数据库8种微表情,得到的混淆矩阵见图2。

图2 Cohn-Kanade人脸图片微表情识别混淆情况Fig.2 The facial image micro expression recognition confusion based on Cohn-Kanade method

从图2中可以看出,3组方法识别Cohn-Kanade数据库中微表情,产生的混淆次数明显少于JAFFE数据库。研究方法仅存在3种微表情识别混淆,细粒度分层时空特征描述符的微表情识别方法存在11种微表情识别混淆,基于长短期记忆网络与特征融合的微表情识别算法存在8种微表情识别混淆,由此可见研究方法混淆种类对比其他两种方法分别减少8种和5种。可见,此次研究方法最大程度地避免了微表情识别混淆。

3 结束语

此次研究充分利用优化卷积神经网络,提高了图片特征提取能力,减少人脸图片微表情识别出现的混淆问题种类。但是此次研究的识别方法,识别人脸图片微表情仍然存在微表情识别混淆现象。因此,在今后的研究中还需深入研究人脸图片微表情识别方法,避免微表情识别混淆问题,从而提高人脸图片微表情识别准确率。