基于MR的机电装备智能检测维修

2022-03-21洪学峰雷松贵

王 崴,洪学峰,雷松贵

基于MR的机电装备智能检测维修

王 崴,洪学峰,雷松贵

(空军工程大学,陕西 西安 710038)

研究Faster R-CNN目标检测网络的基本结构与训练方法;建立了机电装备状态数据集,训练了目标检测网络,一步实现了指针式仪表区域的提取、数字式仪表读数的识别以及开关、插头状态的识别;在不同视角和光照强度下对目标检测网络进行了测试,结果表明模型在不同的环境中均能保持90%以上的准确度。并以此为依据推理故障的原因,最后根据推理结果,使用基于Unity 3D软件与Hololens 2硬件开发的机电装备智能维修辅助系统来调取混合现实(MR)全息诱导维修信息,以指导保障人员进行操作。实验验证了系统的可用性,实验结果显示使用MR可以快速、高效地完成维修任务。并依据操作耗时和问卷调查进行测试与评价,对系统的优越性进行了定性分析。

混合现实;Faster R-CNN;智能故障诊断;维修辅助;实验验证

在设计制造技术高速发展的背景下,各种机电产品的技术复杂程度也在不断提升,对机电产品的维修和保养工作也变得愈发困难和繁重,同时对维修人员提出了更高的要求。随着计算机技术的发展,对机电产品的维修保养问题多集中在,如何运用人工智能技术辅助人们进行机电状态指示识别与故障诊断。本文基于混合现实(mixed reality,MR)机电产品智能维修辅助技术,实现对故障的智能判断及MR可视化诱导维修。

目前,关于MR装备维修辅助技术,意大利空军基于Hololens开发了用于维修的C41系统,专家通过网络对维修人员进行远程指导[1];海军工程大学将基于Vega Prime的交互式实时虚拟维修系统,运用在舰艇减摇鳍虚拟维修中[2]。而关于智能维修辅助技术,在MR中的应用很少[3],但也有如新西兰坎特伯雷大学的Westerfield等,通过自动推理故障指导手工装配任务的培训,并运用于计算机主板的装配中[4]。

1 相关工作准备

系统硬件主要包括高性能图形工作站、MR显示设备、扩展显示设备、自组网设备等。其中图形工作站本系统选用了Dell AWL17C-3858移动图形工作站,处理器型号为Inter i9-8950HK,运行内存16 GB,显示卡为NVIDIA GeForce GTX 1080 OC;MR显示设备选用HoloLens2。扩展显示器设备选用Lenovo Y7000笔记本电脑,处理器为i5-8300H,运行内存8 GB,显示卡为NVIDIA GeForce GTX 1060。本系统选用的自组网设备采用1.4 GHz频段进行通信。

2 基于深度学习的机电装备状态指示识别技术

由于模板匹配的识别方法对图像的质量要求较高,图像稍有变形将会导致识别失败,所以通过拍摄图像对机电装备状态进行图像识别的方法满足不了系统性能的要求[5]。针对该情况,结合深度学习目标检测算法,其对图像要求较低,且具有可识别多目标的特点。采用Faster R-CNN目标检测网络识别数字式仪表读数、开关插头状态,同时检测指针式仪表区域以提高读数识别效率。

2.1 Faster R-CNN目标检测网络[6]

深度学习目标检测算法的基本思想是,采用选择性搜索获取图像中潜在峰物体候选框,然后通过分类和合并的方法获取目标检测结果。常用算法有R-CNN,Fast R-CNN,Faster R-CNN,SSD和YOLO,在VOOC2007数据集中,YOLO,SSD,R-CNN,Fast R-CNN和Faster R-CNN算法的平均准确率分别为66.05%,75.00%,66.00%,70.00%,73.20%,其中SSD和Faster R-CNN的平均精度优于其他算法。在实际应用中,SSD算法对大型目标的检测准确率较高,但易遗漏小型目标,而该目标检测均为较小目标。为了保证检测精度,本文选用Faster R-CNN对机电装备图像进行目标检测。

2.2 网络框架结构

Faster R-CNN是由区域建议网络和Fast R-CNN检测器2个模块构成,是一个用于目标检测的统一的神经网络。区域建议网络[7](region proposal network,RPN)可预测目标所在的区域并将信息与Fast R-CNN共享,通过修正目标区域得到精确的目标位置[8]。

2.3 区域建议网络

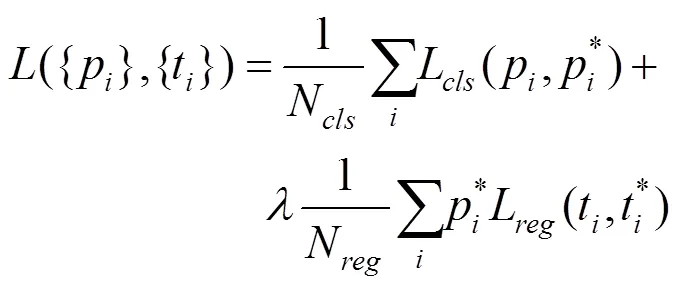

RPN是一个全卷积网络,其以任意大小的图像为输入,输出一组带有目标得分的矩形区域建议框。基于RPN的结构原理及训练思想,网络的损失函数可定义为

RPN的回归损失函数为

RPN可通过误差反向传播和随机梯度下降法进行端到端的训练。在训练时,每一个Mini-batch是由一幅图像中任意选取的256个建议构成,其中正负标签的样本比例为1﹕1。在实际训练中,经常出现正样本数量较少的情况,此时应增加负样本的数量使得建议数保持为256个;另一些RPN建议区域会出现相互重叠情况。为了减少冗余,网络采用基于分类评分的非极大值抑制法对其进行筛选。一般可将交叠率的阈值设为0.7,只保留高于该值的候选框。

2.4 网络训练步骤

Faster R-CNN训练的是在已训练好的模型(此处为ResNet)基础上进行的,与RPN共有的层参数可以直接拷贝经ImageNet预先训练得到的参数,非共有层的参数用标准差为0.01的高斯分布进行初始化。

3 机电装备目标检测网络的训练

3.1 机电装备目标数据集的制作[9]

目标检测的对象为机电设备,检测目标为仪表、开关、插头等。在不同拍摄角度,使用相机对设备进行连续拍照,形成图像集。为了防止发生过拟合现象,本文对原始图片进行缩放、平移、翻转以及亮度变化来扩展数据,最终经处理得到2 000张图片作为制作数据集。Faster R-CNN的训练要求数据集为VOC格式,本文使用labellmg软件对图片进行标记,生成VOC格式的数据集。在xml文件中的object包含了图像中目标类型、名称及标记框的左上角与右下角的坐标值。本文数据集共包含16种目标类型,分别为“0”~“9”10个数字,“p1”,“p2”和“p3”3个指针式仪表,“on”,“off”2个乒乓开关状态,以及“joint”1个插头类型。

3.2 目标检测网络的训练

训练前需对文件进行索引,其中用于测试的数据集占比为10%。再将目标设置为机电装备状态的类别,运行真实标记框索引文件,且每一行对应图片中真实标记框的位置。接着调节训练的世代数以及每个世代的迭代次数,本文设置的训练世代数为50,每个世代需迭代2 000次,最后运行训练主函数。第一个世代内的损失函数以及所有50个世代的损失函数曲线如图1所示。

通过图1可以看出,本文使用的损失函数在一个世代中的250次迭代内迅速下降,整体在10个世代内迅速下降。这说明此设计的损失函数收敛速度较快,训练能够快速地得到理想的目标检测网络。

图1 Faster R-CNN损失函数曲线图((a)第一个世代内损失函数曲线;(b)历代损失函数曲线)

3.3 目标检测网络的测试

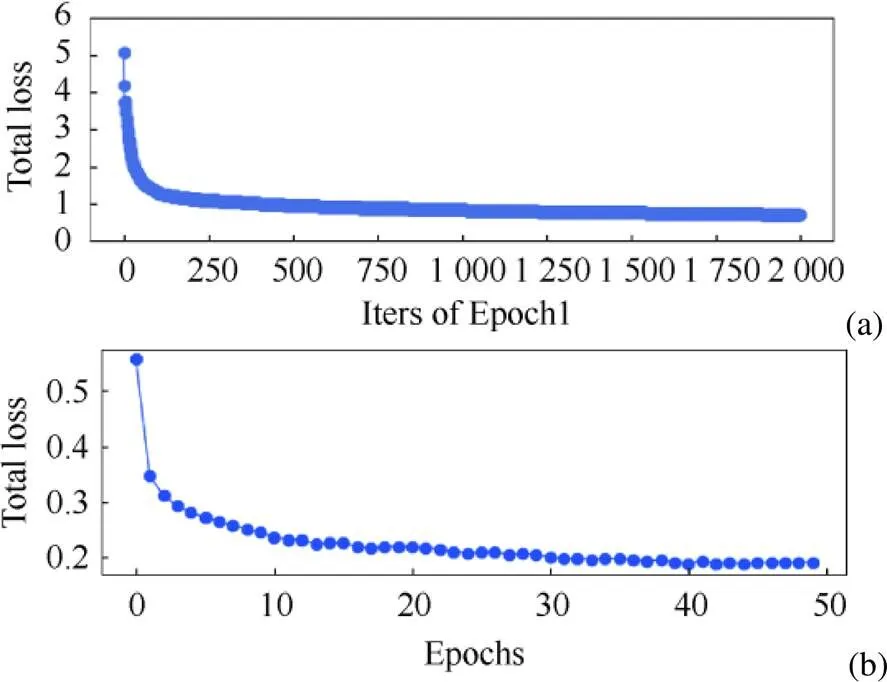

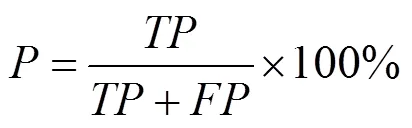

为了验证训练的目标检测网络准确率,本文使用数据集中未参与训练的200张图片进行测试。首先使用训练好的模型逐一检测图片中的目标,并生成目标预测框;然后计算预测框与真实标记框的交叠率IoU,若其值大于等于0.5,则认为预测目标是准确的,循环该过程直至检测完毕。图2为测试集中一张图片的检测结果,其中蓝色框为真实的标记框,绿色框为IoU的值大于等于0.5的预测框,说明检测成功,红色框为小于0.5的预测框,即检测失败。

图2 模型测试结果

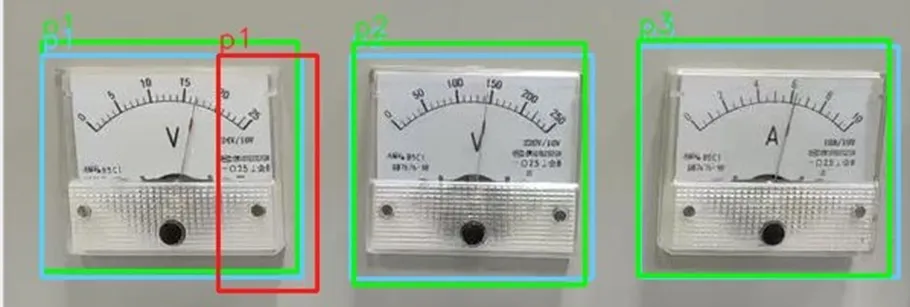

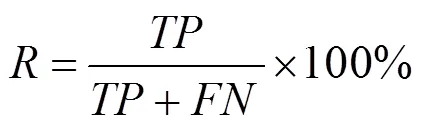

检测完毕后,通过计算模型的精确度P、召回率R、准确度均值以及所有目标类型的准确度均值,对机电装备状态目标检测模型进行综合评价。精确度与召回率的计算如下[10]

其中,为分类器认为是正样本且实际为正样本的例子;为分类器认为是正样本但实际不是正样本的例子;为分类器认为是负样本但实际不是负样本的例子。

精确度是检测到的正样本与真正是正样本的比例,而召回率是实际正样与网络认为是正样本的比例。

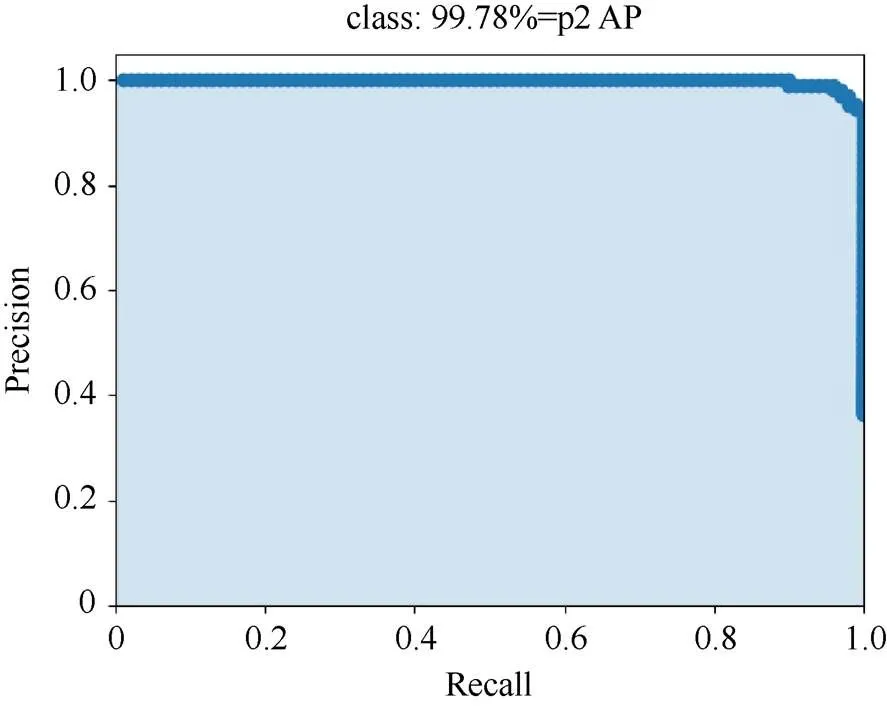

单独使用精确度或召回率均不能客观反映网络模型的好坏,为解决这一问题,本文使用P-R曲线下包围的面积作为衡量尺度,即准确度均值AP,该值越大代表模型越优。本文训练的目标检测模型中指针式仪表“p2”的P-R曲线如图3所示。计算图中曲线包含的面积,其AP值为99.78%,表明该模型能够很好地检测到指针式仪表“p2”。

图3 指针式仪表p2的P-R曲线图

mAP即检测所有训练目标的AP值总和除以目标类型数的结果,mAP是评价目标检测网络综合能力的重要指标,其值越大表示目标检测网络对所有训练目标的检测效果越好。本文16个目标类型的AP值及训练的目标检测网络的mAP值如图4所示。通过图4可以看出:“0”~“9”10个数字、插头、“on”和“p2”的AP值接近1.0,“p3”,“p1”和“off”的AP值相对低一些,整个网络的mAP值为96.72%,说明训练的机电装备目标检测网络能够较好地检测到图片中的所有目标。

图4 所有目标类型的AP值及mAP值

3.4 目标检测实验结果与分析

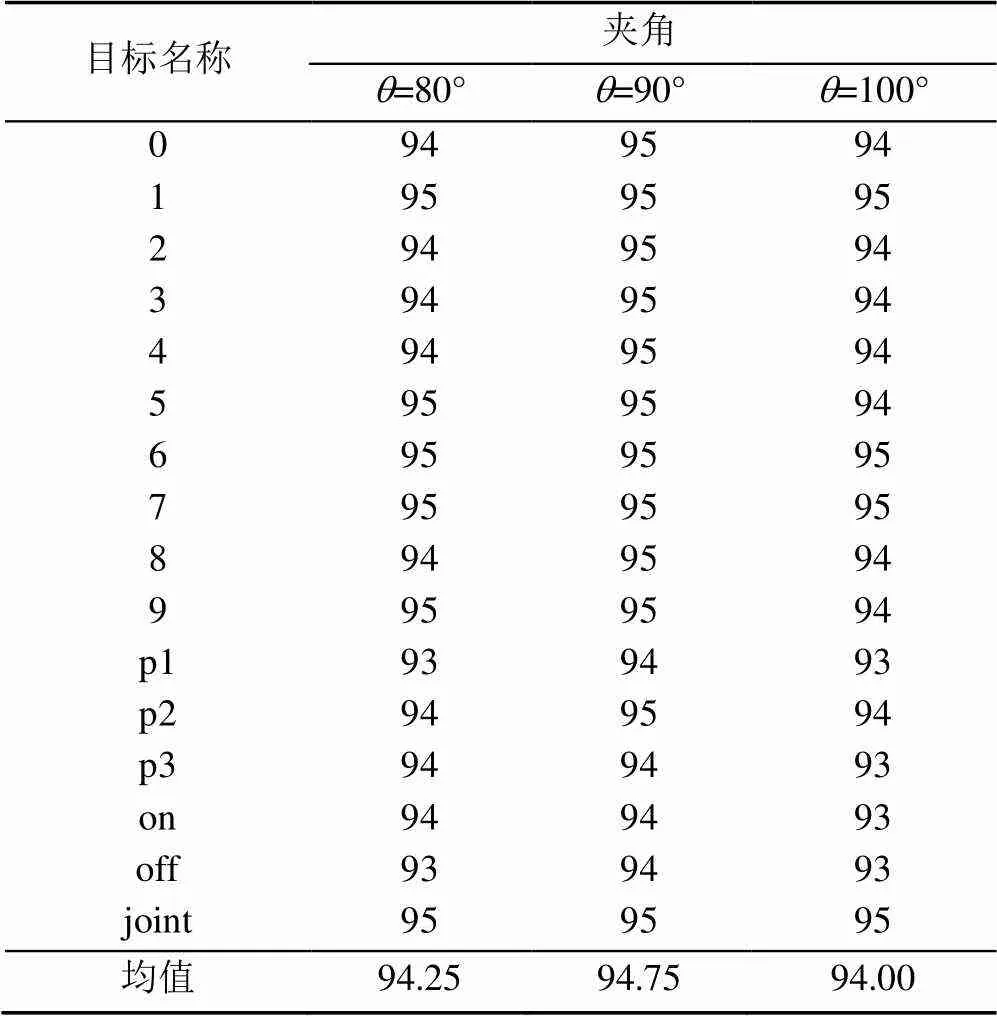

为了更真实地反映模型在复杂条件下的综合性能,本文采用视线与装备平面的夹角分别为80°,90°和100°的3种视角,及光照分别为较暗、正常、较亮的条件下对目标检测网络进行测试。本文针对每种条件分别采集100张图片,测试结果见表1和表2。

表1 3种不同视角机电装备状态图像识别准确率(%)

表2 3种不同光照条件机电装备状态图像识别准确率(%)

通过表1和表2可以看出,图片拍摄的角度与光照条件对机电装备状态目标的检测具有一定的影响,但各类目标的准确度仍能保持在91%以上,准确率均值在93%以上,平均识别时间为1.18 s,说明本文训练的模型能够较好地检测到各种目标。

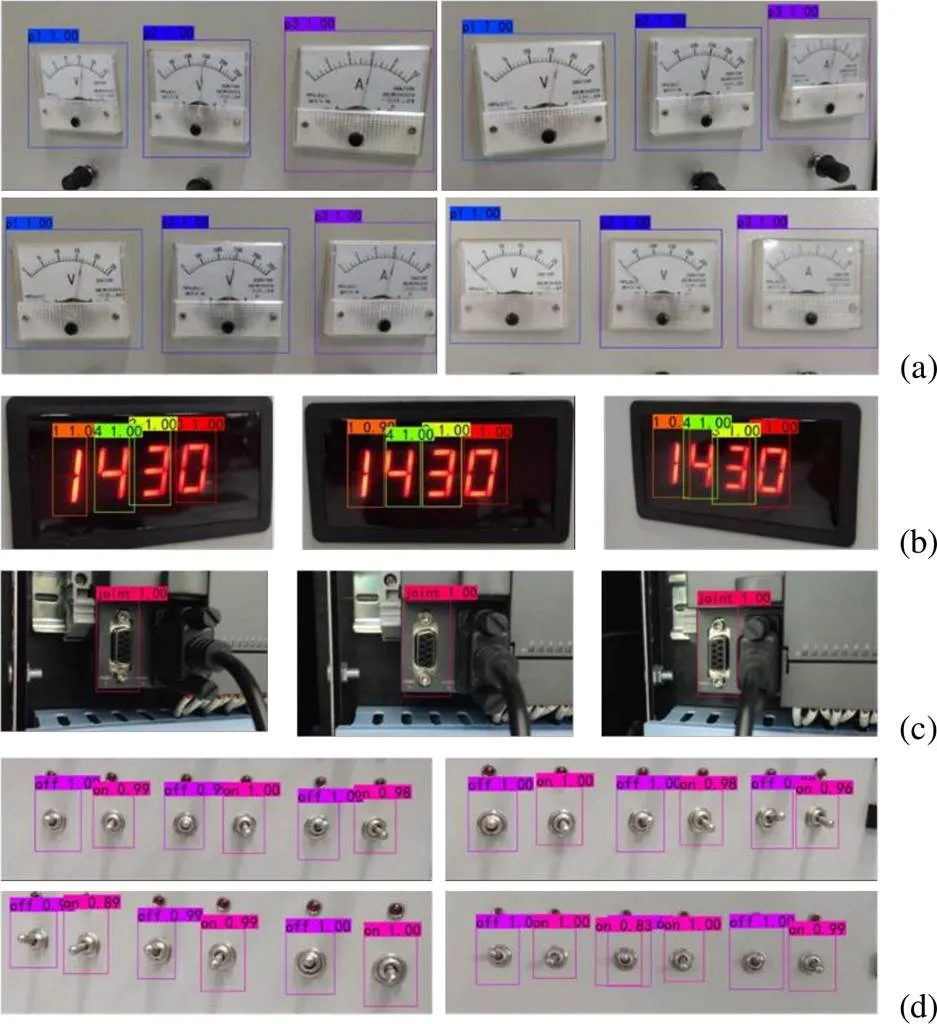

图5为部分图片的检测结果,从图中可以看出在不同拍摄角度与不同亮度的图片中,本文训练的模型均能较准确地识别指针式仪表、数字、插头与开关状态。

图5 检测结果图((a)指针式仪表检测结果图;(b)数字仪表检测结果图;(c)插头检测结果图;(d)开关检测结果图)

通过目标图片中预测框分类结果与坐标位置,可以对目标进行排序输出。如图5(b)中数字式仪表的读数为“1430”;图5(c)中的插头状态为“未插入线缆”;图5(d)中开关的状态从左到右依次为“关、开、关、开、关、开”。

在实现了基于深度学习的机电装备状态指示识别技术后,便可将机电装备状态图片作为输入,将机电装备的状态参数作为输出。

4 智能故障诊断功能的实现

本文系统涉及的机电装备故障推理内容属于小规模问题,所以,采用基于规则的故障推理专家系统诊断故障原因。模块以机电装备状态参数为输入,以机电装备故障的具体原因为输出(图6)。

本文采用产生式规则来代表装备保障专家的知识,基本形式表示为P→Q或IF P,THEN Q。其中P被称为前件,是产生式规则的前提;Q为一组结论或操作。

本文使用正向推理从初始事实数据开始,朝故障原因这一目标方向不断推进。推理过程为,首先搜索规则对机电装备状态参数进行匹配,若匹配成功则输出对应的结论;反之则使用下一条规则进行判断,重复上述过程直至输出最后的结论。此外,本文还设计了动态规则生成程序,能够在推理过程中不断丰富规则库。本文使用Python编写故障推理模块部分的程序,使用if语句对机电装备状态参数进行推理判断,最后将对应结论编号的数值置为“1”,代表推理出该故障的原因。

图6 故障推理流程

故障推理模块输出的机电装备故障原因后,MR诱导维修功能可以据此调取正确的全息指导信息,显示在佩戴Hololens 2的操作者视野中,达到指导维修的目的。

5 MR诱导维修功能的实现

MR诱导维修功能的实现主要依靠诱导信息生成、数据管理、人机交互以及消息通讯4个模块,其为保障人员提供直观的全息指导信息。

5.1 诱导信息生成模块

当故障推理模块输出故障原因后,诱导信息生成模块需要匹配对应的诱导信息指导保障人员进行相关操作,并将诱导信息稳定地叠加显示在机电装备对应的位置上。为了实现以上功能,本文首先将Inventor建立的模型以OBJ格式导出,再导入3D MAX进行部件坐标轴中心调整、减少面片,最后导出FBX格式的模型文件,该格式能够直接导入Unity中。采用基于Vuforia的跟踪注册技术使虚拟信息能够准确地在空间定位;使用Unity 3D引擎开发制作了诱导信息的编辑器,并进行维修脚本编辑,最后将其导入主程序场景中,与其他场景元素一起渲染[11-12]。

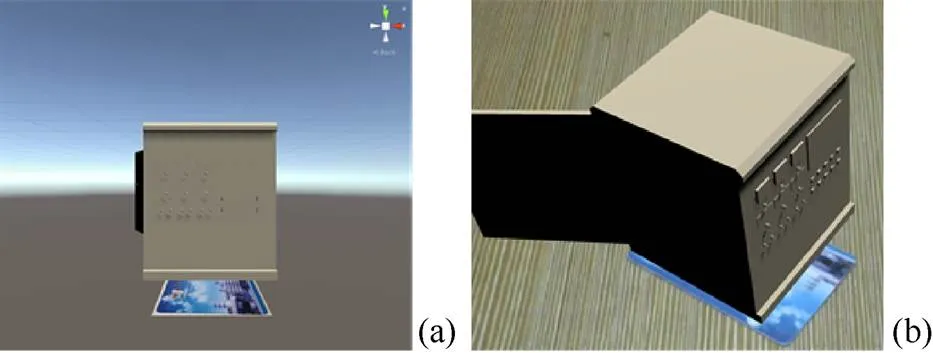

(1) Vuforia的跟踪注册技术。该技术在系统软件中的实施步骤为:①将需要识别的图片上传到Vuforia网站上的Target Manager中,并将图像转换为可以识别的标识,接着导出标识数据包;②在unity项目中导入数据包,将原场景中的摄像机删除,添加ARCamera,将密钥复制在Unity中的AR Camera的Vuforia Behaviour组件中;③在场景中添加ImageTaraget组件,在组件中选择图像标识,并添加要显示的虚拟物体,调整其与标志图像到正确的位置。开发完毕,将其部署应用在Hololens2中,当摄像头扫描到标识图像后,将会显示预先设置的虚拟信息[12]。软件虚拟场景及真实场景显示效果如图7所示。

图7 跟踪注册效果图((a)虚拟场景显示效果;(b)真实场景显示效果)

(2) 指导操作。为了指导保障人员按照正确的步骤进行操作,系统要告知每一步需要什么工具、如何操作、注意事项等内容。本文在MR中使用图片与动画相结合的方式提供上述信息,将维修步骤的具体内容称为维修脚本。大多脚本的编辑过程基本相同,为了减少后续编辑工作量并提高效率,本文使用Unity开发了机电装备维修脚本编辑器,编辑器界面如图8所示。

图8 维修脚本编辑器界面

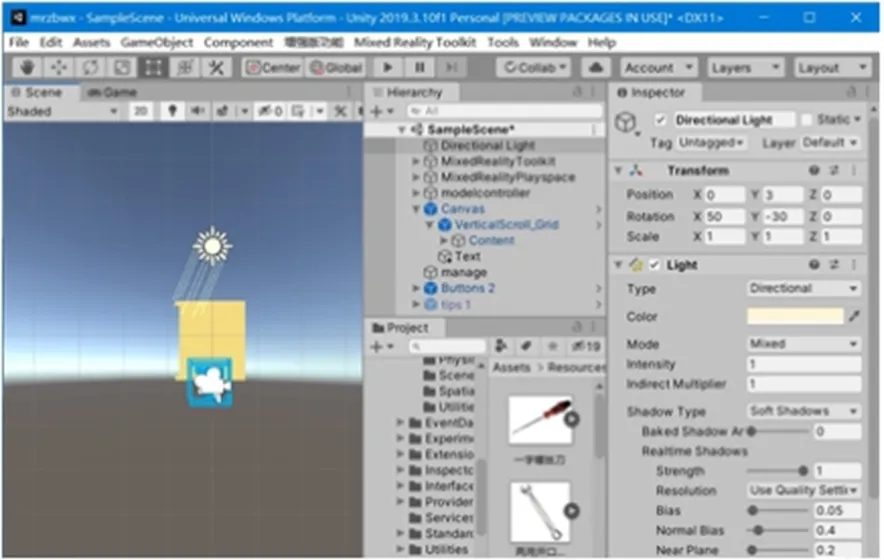

(3) 渲染。在制作完诱导维修动画后,需要在诱导维修主程序中对MR场景进行渲染,主要包含场景光照和模型材质的设置。主程序场景如图9所示。

5.2 数据管理模块

本文将使用的信息资源分为装备数据管理与用户资料数据管理2部分。装备数据包括三维模型、维修科目、维修动画等信息;用户数据包括用户类型、用户账号与密码、用户过程记录等信息。各数据按照设计的格式以表的形式存储在Mysql数据库中[13]。

图9诱导维修主程序场景

5.3 人机交互模块

在MR系统中,人机交互模块使用户能够流畅地与系统进行沟通,提高系统的易用性。本文利用的人机交互技术主要有用户图形界面技术、语音交互以及手势交互技术。

本文使用Unity的UGUI组件进行用户界面的设计和布局。系统采用Canvas组件作为界面基础,Image组件作为界面背景;Text组件用于显示固定的文字;使用Button组件定义各功能按键,并添加C#脚本组件,与手势交互配合,在用户点击时实现对应的功能;使用InputField组件显示其他程序输入的信息

5.4 消息通讯模块

本文采用Unity Unet消息通信框架,该框架的独特优势在于无需单独开发通讯客户端与服务器,便可容纳多个客户端。若系统中不设置专用的通讯服务器,则最先被开启的客户端将自动承担服务器的任务。此时将该客户端称为Host,其即包括客户端进程也包含服务器进程,可将客户端称为LocalClient,服务器称为Sever,两者共享场景,LocalClient可以直接使用函数调用或消息队列与本地服务器Sever通信。其余外部客户端可称为RemoteClient,其通过有线网或局域网与Host通信。利用该特性可直接在同一台计算机上测试系统软件的客户端与服务器的连接[14]。

6 系统验证实验

为了验证开发的机电装备维修辅助系统的功能与性能,本文设计了系统功能与系统性能验证实验,结合实验台对系统进行了应用验证。

实验台前面板安装的元器件主要有:指针式电压表与电流表、四位数字式仪表、旋钮、乒乓开关、触摸屏等;实验台的内部安装的元器件主要有:电源模块、PLC(可编程逻辑控制器)、信号发生器等。为了实现多种不同的实验,采用PLC与触摸屏互连,通过编写不同的程序实现不同的要求。实验台前面板的右侧按键预设了不同的故障现象,在实验过程中通过按键可以快速切换实验项目。实验台前面板与内部结构如图10所示。

图10 实验台实物图((a)前面板;(b)内部结构)

功能验证实验的任务是验证系统设计的功能,主要包含检查、调试、维护、修理4个方面的任务,其中在实际操作中调试与维护的流程基本相同,本实验将二者归为一类。

本实验的设备主要有Hololens 2、图形工作站及实验台,实验场地为光照充足的实验室,实验场景如图11所示。

图11 实验场景图

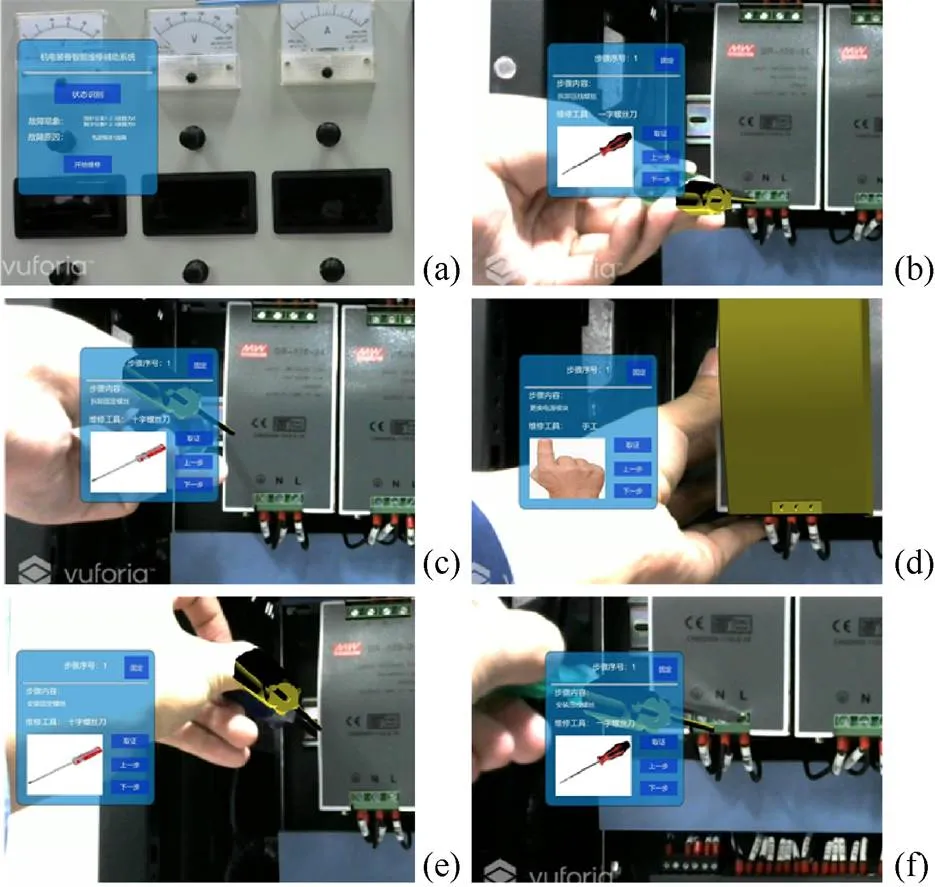

检查任务步骤:①使用实验台模拟机电装备状态,实验人员先开启图像工作站上的服务器,然后佩戴Hololens 2设备开启系统客户端,服务器与客户端自动建立连接;②实验人员站在面板前使用手势或语音交互触发“状态识别”按钮,客户端拍摄机电装备状态图片发送到服务器中;③服务器返回状态指示识别结果与故障原因到客户端中进行显示。调试任务与修理任务的前3步与检查任务相同,本文实验设计的调试任务是调节检查任务中识别的故障。

本文实验设计的修理任务是更换损坏的电源模块,当检查出故障后客户端自动调取对应的诱导信息开始指导实验人员进行操作。实验人员通过手势或语音交互触发“上一步”与“下一步”按钮控制进程,操作人员在客户端进行步骤切换或触发“取证”按钮时,分别截取图片与视频存储在服务器数据库中,任务步骤如图12所示。

图12 维修任务截图((a)状态识别;(b)拆卸压线螺丝;(c)拆卸固定螺丝;(d)更换电源模块;(e)安装固定螺丝;(f)安装压线螺丝)

通过实验可以看出,本文系统可很好地满足检查任务、调试任务、修理任务要求,系统的主要功能得到了验证。

7 系统测试与评价

本文从客观和主观2个方向出发,通过操作耗时统计以及问卷调查的方式对系统进行了测试与评价。本文选择年龄18~22岁、身体各项指标正常的本校50名男性本科生为测试对象,为了避免不确定因素带来的影响,将其分为A,B,C,D和E 5组,每组人数10人。测试前向每人发放实验台说明书,并向其讲解系统的操作方法,待全部对象理解检查任务、调试任务、维修任务以及操作方法后开始进行测试。图13为统计测试对象在不使用本文系统与使用本文系统完成3个任务的平均耗时。

图13 任务评价耗时统计图((a)检查任务耗时对比;(b)调试任务耗时对;(c)维修任务操作耗时对比)

8 小 结

随着国防科技的迅速发展,机电装备的技术复杂度越来越高,对应的装备保障工作也越来越难,对保障人员的要求也越来越高[15]。保障人员在高强度、高压力的工作中无法避免地出现故障诊断与维修操作的失误,这将为装备的长期稳定运行埋下隐患[16]。对此,本文以提高装备保障工作的智能化水平为出发点,将状态指示识别、混合现实等新技术引入维修辅助工作中,开发了基于MR的机电装备智能维修辅助系统,为装备保障工作提出了新的发展路线。

[1] ULLO S L, PIEDIMONTE P, LECCESE F, et al. A step toward the standardization of maintenance and training services in C4I military systems with Mixed Reality application[J]. Measurement, 2019, 138: 149-156.

[2] 苏群星, 刘鹏远. 大型复杂装备虚拟维修训练系统设计[J]. 兵工学报, 2006, 27(1): 79-83.

SU Q X, LIU P Y. Study of the virtual maintenance training system for large complex equipment[J]. Acta Armamentarii, 2006, 27(1): 79-83 (in Chinese).

[3] 张王卫, 苏群星, 刘鹏远, 等. 面向装备维修的虚拟拆卸系统关键技术研究[J]. 系统仿真学报, 2013, 25(12): 2879-2885.

ZHANG W W, SU Q X, LIU P Y, et al. Research on key technologies in virtual disassembly system for equipment maintenance[J]. Journal of System Simulation, 2013, 25(12): 2879-2885 (in Chinese).

[4] 崔波, 王崴, 瞿珏, 等. 基于增强现实的装备诱导维修系统设计与实现[J]. 火力与指挥控制, 2016, 41(11): 176-181.

CUI B, WANG W, QU J, et al. Design and implementation of equipment maintenance guiding system based on augmented reality[J]. Fire Control & Command Control, 2016, 41(11): 176-181 (in Chinese)

[5] 罗又文, 王崴, 瞿珏. 基于Faster R-CNN的诱导维修自动交互设计[J]. 计算机工程与应用, 2019, 55(12): 181-187.

LUO Y W, WANG W, QU J. Automatic induced maintenance process interaction design based on faster R-CNN[J]. Computer Engineering and Applications, 2019, 55(12): 181-187 (in Chinese).

[6] 王慧玲, 綦小龙, 武港山. 基于深度卷积神经网络的目标检测技术的研究进展[J]. 计算机科学, 2018, 45(9): 11-19.

WANG H L, QI X L, WU G S. Research progress of object detection technology based on convolutional neural network in deep learning[J]. Computer Science, 2018, 45(9): 11-19 (in Chinese).

[7] 杨丝琪, 陈维, 张晴晴, 等. 基于规则推理的输电网络故障诊断方法[J]. 电子科技, 2019, 32(3): 42-46.

YANG S Q, CHEN W, ZHANG Q Q, et al. Fault diagnosis method of transmission network based on rule reasoning[J]. Electronic Science and Technology, 2019, 32(3): 42-46 (in Chinese).

[8] 吴帅, 徐勇, 赵东宁. 基于深度卷积网络的目标检测综述[J]. 模式识别与人工智能, 2018, 31(4): 335-346.

WU S, XU Y, ZHAO D N. Survey of object detection based on deep convolutional network[J]. Pattern Recognition and Artificial Intelligence, 2018, 31(4): 335-346 (in Chinese).

[9] 王浩. 基于规则的故障诊断专家系统[J]. 计算机与现代化, 2010(10): 1-3, 7.

WANG H. Rule-based troubleshooting expert system[J].Computer and Modernization, 2010(10): 1-3,7(in Chinese).

[10] WEBEL S, BOCKHOLT U, ENGELKE T, et al. An augmented reality training platform for assembly and maintenance skills[J]. Robotics and Autonomous Systems, 2013, 61(4): 398-403.

[11] ESCHEN H, KÖTTER T, RODECK R, et al. Augmented and virtual reality for inspection and maintenance processes in the aviation industry[J]. Procedia Manufacturing, 2018, 19: 156-163.

[12] 李晓红, 徐可. 国外军工制造领域增强现实技术应用现状分析[J]. 国防制造技术, 2019(3): 6-11.

LI X H, XU K. Analysis of the current situation of augmented reality technology application in the foreign military manufacturing field[J]. Defense Manufacturing Technology, 2019(3): 6-11 (in Chinese).

[13] XUE H, SHARMA P, WILD F. User satisfaction in augmented reality-based training using microsoft HoloLens[J]. Computers, 2019, 8(1):9.

[14] DODEVSKA Z A, MIHIC M, MANASIJEVI S. The role of augmented reality in defensive activities[EB/OL]. [2021-04-25]. https://www.researchgate.net/publication/328580806_The_Role_of_Augmented_Reality_in_Defensive_Activities.

[15] 黄进, 韩冬奇, 陈毅能, 等. 混合现实中的人机交互综述[J]. 计算机辅助设计与图形学学报, 2016, 28(6): 869-880.

HUANG J, HAN D Q, CHEN Y N, et al. A survey on human-computer interaction in mixed reality[J]. Journal of Computer-Aided Design & Computer Graphics, 2016, 28(6): 869-880 (in Chinese).

[16] PING J M, WENG D D, LIU Y, et al. Depth perception in shuffleboard: Depth cues effect on depth perception in virtual and augmented reality system[J]. Journal of the Society for Information Display, 2020, 28(2): 164-176.

Intelligent inspection and maintenance of mechanical and electrical equipment based on MR

WANG Wei, HONG Xue-feng, LEI Song-gui

(Air Force Engineering University, Xi’an Shaanxi 710038, China)

This paperexamined the basic structure and training method of Faster R-CNN (convolutional neural networks) target detection network. The state data set of mechanical and electrical equipment was established, and the target detection network was trained. In a single step, the region of pointer instrument could be extracted, and the reading of digital instrument and the state of switch and plug could be recognized. The target detection network was tested under different viewing angles and illumination intensities. The results show that the model can maintain the accuracy of more than 90% in different environments. Finally, based on the reasoning results, the intelligent maintenance assistant system for mechanical and electrical equipment developed based on Unity 3D software and HoloLens 2 hardware was applied to the retrieval of the mixed reality (MR) holographic induction maintenance information, thus guiding the operation of the support personnel. In order to verify the availability of the system, the experimental verification process was added, and the experimental results show that the experimenter could complete the maintenance task quickly and efficiently using MR. In addition, test and evaluation were conducted based on the operation time and questionnaire survey, and qualitative analysis was carried out regarding the advantages of the system.

mixed reality; faster R-CNN; intelligent fault diagnosis; maintenance assistance; experimental verification

15 June,2021;

TP 391

10.11996/JG.j.2095-302X.2022010141

A

2095-302X(2022)01-0141-08

2021-06-15;

2021-09-10

10 September,2021

国家自然科学基金项目(51675530)

National Natural Science Foundation of China (51675530)

王 崴(1974–),男,教授,博士。主要研究方向为人机工程、诱导维修等。E-mail:164423432@qq.com

WANG Wei (1974–), professor, Ph.D. His main research interests cover ergonomics, induction maintenance, etc. E-mail:164423432@qq.com