基于仿生学的人工智能方法论模型及架构评价体系

2022-03-11陈诗军杜娟林登萍薛兵李俊强

陈诗军 杜娟 林登萍 薛兵 李俊强

学术研究

基于仿生学的人工智能方法论模型及架构评价体系

陈诗军1杜娟2林登萍2薛兵1李俊强1

(1.中兴通讯股份有限公司,广东 深圳 518057 2.华南理工大学自动化科学与工程学院,广东 广州 510461)

目前,人工智能领域面临的适应性、学习效率、可解析性等问题约束了其发展,也一定程度上预示着人工智能理论体系偏离了生物智能方向。从人工智能工作机制及局限性、人脑学习行为过程及工作机制等方面进行分析阐述,提出基于仿生学的人工智能方法论模型、人工智能架构评价体系以及一种新的学习机制。

人工智能;仿生学;方法论模型;架构评价体系

0 引言

人工智能(artificial intelligence, AI)作为计算机科学的前沿技术之一,自1956年在达特茅斯会议上被正式提出就一直备受关注。早期的AI技术受当时的显示芯片算力、采集终端技术、后端算法以及整体方案成熟度等影响,绝大多数算法实际部署时效果差强人意。2015年Google开源了Tensor Flow源代码,使深度学习的训练系统第一次暴露在公众视野中,随之引爆了整个人工智能算法行业[1],这使AI技术取得了较大的研究进展。2016年英伟达发布了基于人工智能深度优化的全新Pascal架构,并在GTC2016上发布基于完整P100大核心的Tesla系列显卡Tesla P40及Tesla P4,同年发布针对深度学习神经网络的嵌入式芯片NVIDIA Jetson TX1,都为AI技术发展提供算力支撑。2017年谷歌旗下公司开发的AI机器人AlphaGo对战世界围棋冠军柯洁,并以3∶0大获全胜;2019年特斯拉推出自动驾驶FSD车载芯片,引领汽车产业的商业模式变革;2020年百度发布百度大脑6.0,核心AI技术进一步夯实;同年,谷歌推出了CvxNet、3D形状的深层隐式函数、神经体素渲染和CoReNet等算法模型,以上这些都展示了AI技术的重大突破,但离实现真正意义上的以“机”代“脑”仍有差距。

尽管人类大脑尚未被探索穷尽,但从神经科学来看,人类大脑的能力可归结于3个基本观察:广泛的连通性、结构和功能化的组织层次、时间依赖的神经元突触连接[3]。

人工智能的初衷是通过学习人类的思维方式实现智能系统,因此仿照人类大脑的神经元结构提出了神经网络基本结构。神经网络作为AI技术的一个重要分支,可以代替人脑有效地处理一些复杂问题,从而推动AI发展。人工神经网络(artificial neural networks, ANN)又称为人工神经元的连接单元的集合,每个连接如人类大脑的神经元突触,可在神经元之间传递信号;接收信号的神经元对其进行处理,并发信号通知与之相连的其他神经元。

随着现代科学技术和硬件设备的快速发展,ANN在处理大量数据或复杂问题时发挥越来越重要的作用[2]。基于人类大脑“脉冲”模拟计算框架下的脉冲神经网络(spiking neural networks, SNN)、神经形态计算有望在实现人工智能的同时,降低计算能耗。

人工智能发展经历了自动控制、神经元网络、深度学习的过程。但随着人工智能的发展,出现了学习效率低、复杂度高、适应性差等问题,并且对于这些问题缺乏有效的解决方法,这在某种程度上预示着人工智能的发展方向和路线偏离了生物智能方向。为此,本文从人工智能工作机制及局限性、人脑学习行为过程及工作机制等方面进行分析及论述,提出基于仿生学的人工智能方法论模型及架构评价体系。

1 人工智能工作机制及局限性

1.1 人工智能工作机制

从感觉生理学角度来说,人处理信息大致分为3个过程:

1)获取感官信息;

2)感官信息处理,神经末梢因受刺激产生脉冲信号等神经信号;

3)神经信号引起意识事件,即感官信息通过刺激激活相同细胞来产生相应的意识事件[4]。

人工智能模仿人处理信息的过程展开研究,重点是感知信息处理。目前,针对感知信息处理有2个立场[4]:

1)感知信息以编码表征或图像形式存储,感官刺激和储存方式之间有一对一的映射关系;

2)刺激图像不会被记录,人的中枢神经系统像一个复杂的交换网络,记忆是活动中采用的一种新连接路径,以一种特殊回应的偏好形式储存记忆。

目前,大脑模型都是基于立场1),围绕编码表征、记忆理念展开研究,深度神经网络也是如此。

20世纪60年代,HUBEL等人[5]的生物学研究表明,视觉信息是通过多个层次的感受野激发,从视网膜传递到大脑[6]。基于这些研究结果,神经网络通过编码搭建网络框架,每一层的响应都由上一层的局部感受野激发得到。同时模仿动物学习的“尝试”机制,利用数据集训练神经网络以获得较好效果。

首先,初始化网络框架参数、定义损失函数,通过前向传播得到每一层的损失项。

然后,根据总损失,利用反向传播算法,通过链式求导,依次更新每层的每一个神经元的权重和偏移量。

最后,通过更新权重和偏移量不断纠错,直至损失降至最低,此时神经网络模型可以实现特定功能。

1.2 人工智能的学习效率

神经网络模型虽然可以获得相应情况下较好的效果,但神经网络需要对数据集进行上千次epoch训练,1.1×108次左右的权重和偏移。这个不断纠错、构建正确决策的过程,训练速度慢,消耗大量时间;储存参数达上百万个,计算量庞大,能耗巨大;同时占据的存储空间大,对计算机的要求较高。而人类大脑的每个神经元通过突触与其他上千个神经元连接[7],这些突触通过电脉冲信号传递信息,持续时间短于千分之一秒,传播速度约为1~100 m/s[8]。目前,神经网络传递信息以及计算更新参数的速度远远比不上人类大脑。神经网络与人类大脑训练量和训练时间对比图如图1所示。

图1 神经网络与人类大脑训练量和训练时间对比图

因此,如何提高人工智能的学习效率是待解决的问题。

1.3 人工智能的适应性

尽管神经网络模型在某些特定情况下可以实现相应功能,获得较好的精度和性能,但它仍然存在鲁棒性。某个神经网络模型仅针对某些特定情况具有较好的精度,一旦变换应用场景,可能造成精度大幅度下降,性能变差。如一个预估视差的神经网络模型可以在室内获得较好效果,但在室外效果就变得很差。这是由于此神经网络模型训练时,选用室内的数据集进行训练,针对室内场景的情况不断更新参数,不断纠错。但室外场景由于光线等问题与室内场景不同,且神经网络无法判断室内与室外,导致效果较差。若想在室外场景取得较好效果,需选取室外数据集训练神经网络模型,并改变神经网络模型框架。而人类大脑经环境刺激引起一系列的神经元活动后,通过不断学习进化,可以迅速判断各个场景,并且自动切换场景,针对相应的情况迅速做出相应的反应和决策。

因此,直接训练一个能够容忍环境变化的神经网络模型是待解决的问题。

1.4 人工智能的可解析性

尽管神经网络模型在很多领域都具有较好的性能[9],但在某些领域无法替换传统算法的大规模部署,如计算机网络系统。计算机网络工程师更倾向于直接使用简单的逻辑规则表示神经网络,而不是分析其复杂的激活规律。由于神经网络内部结构以及更新计算参数过程的可解析性较低,导致不能直接对神经网络系统进行调试、修正、部署。

因此,如何简单、高效地提供通用性神经网络的可解析性是待解决的问题。

2 人脑学习行为过程及工作机制

针对人工智能存在的学习效率、适应性、可解析性等问题,通过分析人类大脑学习行为的生理基础,阐述学习行为的工作机制。

2.1 学习行为概述

学习行为是指通过神经系统接受环境变化而获得行为习惯或经验的过程,是大脑神经网络的重要功能之一,由众多神经共同作用完成。

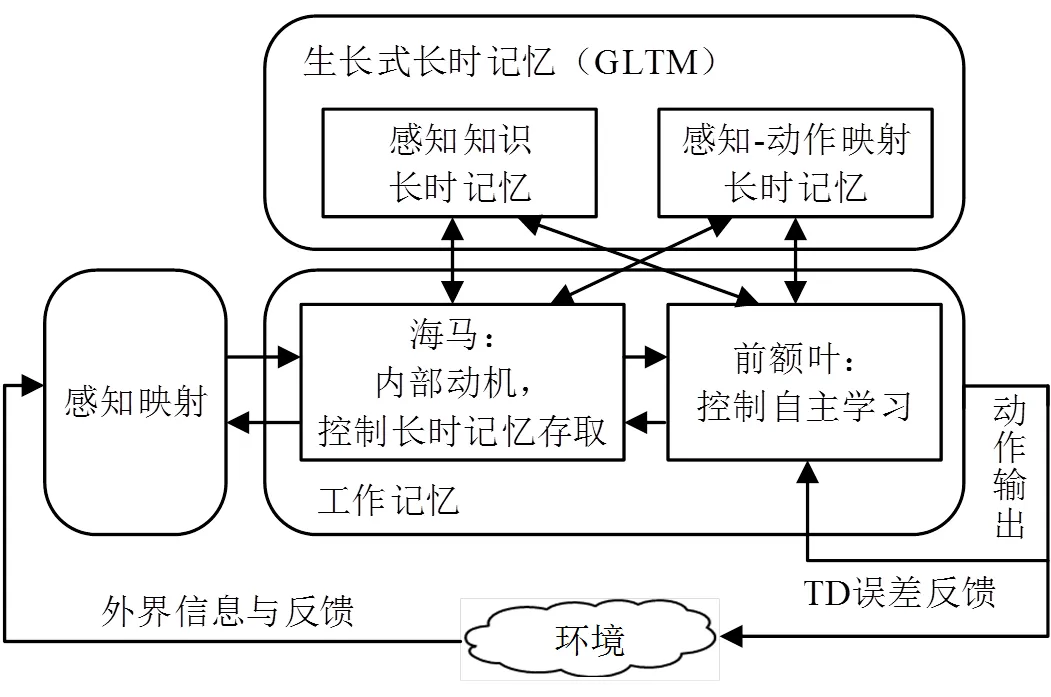

近年来,随着认知神经科学的发展,人们对于学习行为的脑机制研究更加深入。认知神经科学认为:学习是大脑信息加工的过程;是心智网络在大脑与环境的相互作用下形成的活动;是大脑对刺激产生的反应,包括大脑对信息的感知、处理和整合[11-12]。人类大脑记忆认知原理图如图2所示。

此外,大脑处理信息时加入了时间维度,即动态信息处理,而人工神经网络主要用于静态信息处理。目前,可实现的神经网络规模距离人类大脑规模还有1 000倍以上的差别[13]。

图2 人类大脑记忆认知原理图

2.2 学习行为的生理基础

认知神经科学强调:学习以大脑的生物性为支撑;以大脑的可塑性为基础;以大脑镜像神经元系统为主的自身活动不断丰富学习主体的经验感知,并在此基础上进行模仿学习。

2.2.1 神经联结

大脑在学习过程中,单个神经元会联结形成神经网络,复杂的神经网络可以承载复杂的认知结构。联结主义模型表明[14],神经网络对一切学习内容进行编码,而神经元激活的数量、频率、模式以及信号传递的有效性,都取决于外部刺激是如何激活网络的[15],且已经习得的神经网络会随着学习而不断强化。

2.2.2 多感官共同作用

大脑的不同区域负责编码不同的信息。在学习过程中,大脑接受的大部分信息是多感官的,故要求在不同功能的脑区间建立连接。学习内容累积式地存储在神经网络,倘若2个脑区先前已联结,即使后来的类似体验缺失了一部分感知信息,相同的区域仍被激活,即大脑可以自动补全从外界接收的不完整信息。

2.2.3 终身可塑性

大脑一生都能根据学习行为发生显著变化。通过神经元突触不断形成、修建、增强、减弱,神经联结不断得到修饰。在不断强化、减弱和消除原有神经联结,产生新神经联结的过程中,大脑结构发生改变[11]。大脑这种适应环境的能力即为可塑性。

2.2.4 电生理机制

学习行为伴随着大脑的电变化,如条件的Alpha波阻断,皮质的慢波活动和高频节律等[16]。神经系统传递信息采用脉冲频率编码[17]。神经脉冲按照“全或无”的规律工作,当刺激低于某阈值时,无脉冲产生;当刺激达到某阈值时,产生一个脉冲。大脑皮质的神经元,在没有明显外加刺激的情况下,能产生持续的节律性电位波动,称为Alpha波。当大脑充满Alpha波时,人的意识活动明显受到抑制,无法进行逻辑思维和推理活动,而当思考问题或感受到新异刺激时,会出现Alpha波阻断,这种Alpha波阻断与学习行为息息相关。

2.3 学习行为的工作机制

2.3.1 神经元的通信

神经元接受、整合大量信息,并将信息汇总输出,在神经元之间传递,进而形成特定的网络通路。借助网络通路,神经元可与不直接相连的神经元进行通信,从而在不同神经联结间建立相对稳固的网络联系,记忆分布在神经元的相互联结中,心智网络即被建构。

2.3.2 心智网络的重构

认知神经学认为,学习是一个心智网络不断形成与优化的过程,即心智网络的每一次变化都在原有基础上进行。学习机制的运行从激活原有心智网络开始,通过重构与融合过渡到更合理的网络,以此来处理既定情境[17]。

神经网络通过突触产生过剩并选择性消失、突触修正与增添2种方式改变大脑结构,进而对心智网络进行重组。在这种重组机制下,大脑不断地适应新环境,并结合经验逐渐发展为最佳结构。

2.3.3 大脑的工作模式

当学习行为发生时,特定的皮层区域负责特定的任务,每一个任务的完成又与多个皮层区域的神经网络相关,同一个皮层区域又参与多个神经网络的活动。多个皮层区域神经网络的活动具有协同性和整体性,各自分工又相互联系,它们之间的联合互动保证了学习的顺利进行。

3 基于仿生学的人工智能方法论模型

针对目前人工智能存在的问题和人脑学习行为过程及工作机制,本文在方法论的层面重新思考人工智能的方法,提出基于仿生学的人工智能方法论模型,如图3所示。

图3 基于仿生学的人工智能方法论模型

基于仿生学的人工智能方法论模型包括问题域、过程域和结果域3部分。

1)在问题域,人工智能方法和生物输入同样的问题或任务。

2)在过程域,比较人工智能方法与生物智能的差异。

根据生物行为和思维将问题/任务分解为过程序列:

式中:

人工智能方法过程或模块序列为

式中:

式中:

3)在结果域,对人工智能方法输出的结果与生物智能执行的结果进行比较。

基于仿生学的人工智能方法论模型,相比传统的人工智能方法,增加了过程域。在过程域,用过程序列的方法进行模块化处理,保证人工智能方法能够逼近生物智能过程,避免在研究过程中方向偏差越来越大。

4 基于仿生学的人工智能架构评价体系

人工智能主要在结构层次上模拟神经元结构,采用深度学习,通过训练集,在输入层和输出层之间训练多个隐藏层的参数,这些隐藏层具有不可解析性,束缚了仿生学更高层次智能(如逻辑、精神、抽象等)架构体系的研究和构建。人工智能高层次智能架构研究的不足限制了人工智能实现生物智能的程度。基于仿生学的人工智能架构设计是目前亟需解决的重要问题,但首先要明确如何评价人工智能和生物智能架构的一致性。

本文从评估角度出发,提出基于仿生学的人工智能架构评价体系,如图4所示。

图4 基于仿生学的人工智能架构评价体系

基于仿生学的人工智能架构评价体系把人工智能组织架构和机理设计分为内在视角和外在视角2个方面。

1)内在视角主要评价人工智能架构和机理的结构、智能过程、结果与生物智能的相似度,与人工智能方法论模型的一致性。

2)外在视角主要评价人工智能架构和机理在学习效率、效益、适应性方面与生物智能的差异程度。

①学习效率方面。对于学习一个新事物,人类一般不需要太多样本,一两个实例就可以达到学习目的。因此,基于仿生学的人工智能架构和机理需具有小样本学习的特征。

②效益方面。人类对一个事物的识别不需要复杂运算、消耗太多能量,而目前的深度学习,识别一幅图像需要进行复杂的卷积运算,经过多达数十层的深度才能完成学习,同时带来一系列问题,如复杂度、梯度、过拟合等,并且深度学习带来的功耗问题更加严峻。因此,基于仿生学的人工智能架构和机理需具有低复杂度、低功耗的特征。

③适应性方面。经过深度学习的人工智能在环境发生变化后,不能很好地适应其他环境,这和人类经过学习后,在各种复杂的环境下,能够表现出很好的适应性有较大差距。因此,基于仿生学的人工智能架构和机理需具有较强的泛化能力。

5 一种新的学习机制

人工神经网络具有内部结构及更新计算参数过程可解析性低的局限,借鉴人类大脑的工作机制[10],本文提出一种新的学习机制设想,拓展类人的学习机制思路。

神经生物学家将学习与记忆分为工作记忆、情节记忆、语义记忆、工具学习和动作学习5种。其中,工作记忆是大脑保持当下任务的暂时记忆;情节记忆是回忆特定事件的细节能力;语义记忆是学习事实和关系的能力;工具学习是根据奖惩来改变行为的能力;动作学习是通过练习或者单纯的重复来改善身体运动模式的能力。

在学习与记忆的启发之下,本文尝试提出一种新的学习机制工作设想,如图5所示。

图5 一种新的学习机制工作设想

一种新的学习机制工作设想采用分区学习、分区存储的方式,包括工作区、语义区、情节区、工具区和动作区。每个区互相关联,互相影响。每个区由许多小模块组成,每个小模块都具备一个刺激信号。当刺激信号遇到其他模块传来的类似刺激信号时会被激活,开启此区域或模块的学习更新进程。工作区始终保存最佳模型,并根据学习产生各种相应的刺激信号,通过匹配类似的刺激信号来调度其他4个区开启学习更新。

一种新的学习机制的学习进程:

1)情节区保存曾经学习的情节,学习成熟的情节成为之后学习的部分先验知识,辅助语义区学习;

2)语义区保持当前学习整个事实之间关系的模型,通过学习更新情节区;

3)工具区保存奖惩机制,根据学习情况,若是有利的参数标注奖励,否则标注抑制,确保工作区和语义区的学习向正确方向进行;

4)动作区保存正确动作,即正确决策,若感官刺激是学习过的,则激活相应的刺激信号,被激活的刺激信号返回相应的决策,每经历一次学习,动作区就会随着更新。

一种新的学习机制具体学习更新过程如下:

1)输入感官信息,产生一个刺激信号,将这个刺激信号传送到工作区,激活工作区的刺激信号;

2)开启工作区,工作区根据当前的最佳模型开展学习,并产生相应的刺激信号;

3)匹配其他区的刺激信号,激活相应的区,调度语义区和工具区开启合作学习;

4)语义区根据情况产生相应的激活信号,匹配语义区的刺激信号,调用相应情节区的信息同时配合工具区的奖惩机制进行学习;

5)每次学习后,工作区更新为当前调度的最佳模型并自动删除旧模型;新学习的情节保存到情节区并且根据工具区的奖惩机制结果自动删除奖励较低的情节;语义区保存最新的情节之间关系并根据学习结果自动删除旧情节关系;动作区根据学习情况更新为最佳决策。以上更新过程中,相应的旧激活信号也会随着更新替换成新的激活信号。

通过分区学习,分区存储,并在学习过程中更新模型和参数时自动删除不利的模型和参数,相比目前的人工智能学习方法,减少参数的存储空间,提高学习效率。

6 结语

作为新一轮科技革命和产业变革的核心驱动力,人工智能正在叠加释放历次科技革命和产业变革积蓄的能量,快速催生新产品、新服务、新业态,培育经济发展新动能,重塑经济社会运行模式,改变人类生产和生活方式,促进社会经济发展的整体大幅跃升。本文对人工智能及人工神经网络的发展进行梳理,对基于仿生学的人工智能进行深入分析,在方法论、评价体系、学习机制等方面提出新的见解,助力推动基于仿生的人工智能新一轮产业变革和科技革命。本方法论具体的定量分析及应用,将作为下一步的工作内容进行展开。

[1] 任成.人工智能技术发展综述[J].中国安防,2020(10):81-83.

[2] 夏瑜潞.人工神经网络的发展综述[J].电脑知识与技术,2019, 15(20):227-229.

[3] KAUSHIK Roy, AKHILESH Jaiswal, PRIYADARSHINI Panda. Towards spike-based machine intelligence with neuromorphic computing[J]. Nature, 2019,575:607-617.

[4] 章航.人工神经网路进路研究[D].上海:华东师范大学,2019.

[5] HUBEL D H,WIESEL T N. Receptive fields binocular inter-action and functional architecture in the cat's visual cortex [J]. Journal of Physiology, 1962,160(1):106-154.

[6] 李彦冬,郝宗波,雷航.卷积神经网络研究综述[J].计算机应用,2016,36(9):2508-2515,2565.

[7] DOUGLAS, RJ, MARTIN, KA. Neuronal circuits of the neocortex[J]. Journal of Annual Review of Neuroscience, 2004, 27:419-451.

[8] BARNETT MW, LARKMAN PM. The action potential[J]. Practical Neurology, 2007,7(3):192-197.

[9] 郑莹,段庆洋,林利祥,等.深度强化学习在典型网络系统中的应用综述[J].无线电通信技术,2020,46(6):603-623.

[10] 徐承东.学习与记忆生理机制研究综述[J].楚雄师专学报(社会科学版),1991(1):63-66.

[11] 崔亚萌.学生学习机制研究——基于认知神经科学的视角[D].开封:河南大学,2017.

[12] 赵学武.基于群智能算法的人脑功能划分方法研究[D].北京:北京工业大学,2018.

[13] 刘亚东,胡德文.脑科学视角下的高性能计算[J].计算机学报,2017,40(9):2148-2166.

[14] 霍鹏飞,吴玮.大脑的学习机制及其对教育的启示[J].集美大学学报(教育科学版),2011,12(2):50-53.

[15] MUNAKATA Y. Graded representations in behavioral dissociations[J].Trends in Cognitive Sciences,2001,5(7):309-315.

[16] 余建林.学习行为的生理基础和心理基础[J].长江大学学报(社会科学版),2011,34(3):142-143.

[17] 王英华,王玉茹,张少白.大脑高级智能活动的生理学基础[J].自动化技术与应用,2001(4):10-12.

[18] 乔石.基于人脑学习与记忆的多源信息融合算法研究[D].天津:河北工业大学,2015.

[19]MICHAEL McKinley, VALERIE DEAN O'Loughlin. Human anatomy [M]. 3rd ed. McGraw-Hill, 2011: 416.

[20]SPORNS O. Networks of the Brain[J]. MIT Press,2010:143.

[21]WILLIAMS R W, HERRUP K. The control of neuron number [J]. Annual Review of Neuroscience,1988,11(1):423-453.

[22]SCHMIDT-RHAESA A. The Evolution of Organ Systems[M]. Oxford University, UK, 2007.

[23] KRISTAN W B, CALABRESE R L, FRIESEN W O. Neuro-nal control of leech behavior[J]. Progress Neurobiology, 2005, 76(5):279-327.

[24] BARNES R D. Invertebrate Zoology 5th[M]. Saunders College Pub, America, 1987.

[25]BUTLER A B. Chordate evolution and the origin of craniates: an old brain in a new head[J]. Anatomical Record, 2000,261(3): 111-125.

[26]SHIN H S, BARGIELLO T A, CLARK B T, et al. An unusual coding sequence from a drosophila clock gene is conserved in vertebrates[J]. Nature, 1985,317(6036):445-448.

[27]HODGKIN J. Caenorhabditis elegans. Brenner S, Miller JH.Encyclopedia of Genetics[J]. Elsevier, 2001:251-256.

[28]MARKS A R. In search of memory The emergence of a new science of mind[J]. Journal of Clinical Investigation, 2007, 116(5):1380-1381.

[29] NORTHCUTT R G. Forebrain evolution in bony fishes[J]. Brain Research Bulletin, 2008,75(24):191-205.

[30]D KELLY Flemming. Essential Neuroscience[J]. Mayo Clinic Proceedings, 2006,81(10):1409.

[31] RADINSKY L, JERISON H. Evolution of the Brain and Intelligence [J]. Evolution, 1975,29(1):190.

[32] FOSTER A C, KEMP J A. Glutamate and GABA-based CNS therapeutics[J]. Current Opinion in Pharmacology, 2006,6(1): 7-17.

Artificial Intelligence Methodology Model and Architecture Measurement System Based on Bionics

CHEN Shijun1DU Juan2LIN Dengping2XUE Bing1LI Junqiang1

(1.Zhongxing Telecom Equipment, Shenzhen 518057, China 2.School of Automation Science and Engineering, South China University of Technology, Guangzhou 510641, China)

At present, the problems faced by the field of artificial intelligence, such as adaptability, learning efficiency and analysability, restrict its development and indicate that the theoretical system of artificial intelligence deviates from the direction of biological intelligence to a certain extent. This paper analyses and expounds the working mechanism and limitations of artificial intelligence, the learning behaviour process and working mechanism of human brain, and puts forward the artificial intelligence methodology model based on bionics, the artificial intelligence architecture evaluation system and a new learning mechanism.

artificial intelligence; bionics; methodology model; architecture evaluation system

陈诗军,杜娟,林登萍,等.基于仿生学的人工智能方法论模型及架构评价体系[J].自动化与信息工程,2022, 43(1):7-14.

CHEN Shijun, DU Juan, LIN Dengping, et al. Artificial intelligence methodology model and architecture measure-ment system based on bionics[J]. Automation & Information Engineering, 2022,43(1):7-14.

陈诗军,男,1972年生,硕士,高级工程师,主要研究方向:高精度定位技术、无线信道仿真技术、MIMO和CoMP技术。E-mail: chen.shijun@zte.com.cn

杜娟,女,1975年生,博士,副教授,主要研究方向:图像处理、机器视觉和智能系统技术。E-mail: dujuan@scut.edu.cn

林登萍,女,1996年生,在读硕士,主要研究方向:机器视觉。E-mail: 283728289@qq.com

薛兵,男,1984年生,硕士,工程师,主要研究方向:5G移动通信、射频技术、高精度时间同步。E-mail: xue.bing1@zte.com.cn

李俊强,男,1992年生,硕士,工程师,主要研究方向:室内定位技术研究、传感器定位算法以及应用领域。E-mail: li.junqiang1@zte.com.cn

TP183

A

1674-2605(2022)01-0002-08

10.3969/j.issn.1674-2605.2022.01.002