基于Kinect V3深度传感器的田间植株点云配准方法

2022-01-27李修华何嘉西李民赞张木清温标堂

李修华,魏 鹏,何嘉西,李民赞,张木清,温标堂

基于Kinect V3深度传感器的田间植株点云配准方法

李修华1,2,魏 鹏1,何嘉西1,李民赞3,张木清2,温标堂4

(1. 广西大学电气工程学院,南宁 530004; 2. 广西甘蔗生物学重点实验室,南宁 530004;3. 中国农业大学现代精细农业系统集成研究教育部重点实验室,北京 100083; 4. 捷佳润科技集团股份有限公司,南宁 530001)

准确建立植物的三维点云是以点云方式高通量获取植株各部位物理参数的前提。为实现田间复杂环境下的植株三维点云配准,该研究提出了一种基于多标定球的田间植株点云自动配准方法,并分别在室内简单场景及大田复杂场景下从不同角度对多种作物采集的点云数据进行验证。该方法采用随机抽样一致性算法(Random Sample Consensus, RANSAC)结合点云减法的概念从下采样后的点云中实现多标定球的自动提取,弥补了RANSAC一次只能提取单个物体的缺点。然后基于各标定球的球心距离信息实现三维点集的自动匹配。最后使用奇异值分解算法解算旋转平移矩阵,实现点云的自动配准。不同场景下各作物的配准结果表明,各植株的水平90°、180°、270°以及垂直方向上的点云配准到水平0°点云下的平均轴向误差在5.8~17.4 mm之间,平均点位误差在13.1~28.9 mm之间,与手动配准的商用同类软件LiDAR360的配准结果相当,但配准过程的自动化程度明显提高,效率提高了67%。该文所提出的方法可在田间复杂环境下对低成本深度相机获取的植株点云实现高精度的自动配准,为田间植物表型参数的提取提供了低成本的可行方案。

自动化;传感器;点云;植株三维建模;点匹配;RANSAC;Kinect

0 引 言

三维重建是指在计算机中建立表达客观世界的一种虚拟现实技术,广泛应用于医学治疗、文物保护、游戏开发、工业设计、航天航海等领域[1]。在现代化农业中,三维重建技术在提取植株表型参数、提取土壤表面形状、建立植株生长模型等研究领域也发挥着越来越重要的作用[2-3]。

Kinect V3是一款基于飞行时间算法(Time of Flight,ToF)的深度传感器,可以同时采集目标物体的RGB图像和深度图像,体积更小、精度更高、抗干扰能力更强,更适合在田间环境下采集植株点云数据。

点云配准是点云三维重建的核心步骤,按原理可分为:基于重叠区域的点云配准和基于标定物的点云配准。基于重叠区域的点云配准主要通过计算源点云与目标点云的特征描述符进行配准,但需要源点云与目标点云高度重叠才能达到较好的配准效果。主要的特征描述符有自选图像描述符(Spin Image,SI)[4]、形状上下文描述符(3D Shape Context,3DSC)[5]、方向直方图描述符(Signature of Histogram of Orientation, SHOT)[6]、旋转投影统计描述符(Rotational Projection Statistics, RoPS)[7]、快速点特征直方图描述符(Fast Point Feature Histogram, FPFH)[8]。杨玉泽等[9]使用了基于快速点特征直方图(Fast Point Feature Histogram,FPFH)和正态分布变换(Normal Distributions Transform,NDT)的算法对水曲柳进行了点云配准;郑立华等[10]使用FPFH描述符结合法线对齐的径向特征(Normal aligned radial feature,NARF)对两个角度的苹果树点云进行了配准。Garrido等[11]使用激光雷达和移动小车对玉米点云进行了多步融合。由于植物的各向异性生长,使得植物带有不断变化的拓扑结构,因此除了通过计算特征描述的方法之外,还可以通过提取植物点云的骨架进行配准。Chebrolu等[12]利用隐马尔科夫模型(Hidden Markov Model,HMM)对土豆和玉米植株进行了点云配准。

基于重叠区域的点云配准方法受环境影响大,不适合应用于田间复杂环境,为克服这种情况,Yu等[13]使用红色标定球按其颜色信息进行点云配准,但其标定球的匹配过程缺乏自动化功能;Zhou等[14]使用标定球按其几何信息对室外植株进行了点云配准,但该方法不适用于田间地面起伏较大的情况。

激光扫描仪或激光雷达所获取的点云数据精度高、噪点少,但价格昂贵(数十万元),随着深度传感器技术的进步,其测量精度逐渐提高,且价格低廉(千元级),成为农业上作物点云采集的低成本方案。另外目前可获取的大部分点云处理软件如Cloudcompare、Meshlab等均需要人为寻找同名点对进行手动配准,自动化程度低。

针对三维点云采集成本高、配准自动化程度低等问题,本文开发了1个基于Kinect V3深度传感器的低成本点云数据采集平台,提出了一种自动提取多个标定球并利用距离信息自动配准点云的算法,以实现大田复杂场景下植株点云数据的快速采集及自动配准,为作物表型参数的准确提取提供技术支撑。

1 材料与方法

本试验通过Kinect V3采集香蕉植株的原始点云并对其进行数据处理。原始点云数据的处理流程如图1所示。首先进行预处理,降低数据量,滤除噪点;然后根据随机抽样一致性算法(Random Sample Consensus, RANSAC)提取标定球点云,并解出球心坐标;接着采用本文提出的方法自动匹配不同角度同名球的球心坐标,从而解出各角度的旋转平移矩阵;最后进行点云融合及点云平滑,建立香蕉幼株3D模型。

图1 点云处理流程图

1.1 数据采集

为验证系统和算法的有效性和稳定性,分别针对室内简单场景及大田复杂场景对多种作物进行试验。Kinect V3及其拍摄角度如图2所示。Kinect V3深度相机采用NFOV非压缩模式,分辨率为640×576(像素);彩色相机采用32位RGBA模式,分辨率为1 280×720(像素);帧率30帧/s。试验采用直径为14 cm的4个白色标定球为配准辅件,使用Dell Precision 7530专业图形移动工作站(CPU:Intel(R) Core(TM) i9-8950HK;GPU:NVIDIA Quadro P2000)作为数据采集及处理平台。要实现标定球的自动匹配,标定球的数量和摆放方式需满足一定规则,即需要3个以上的标定球摆放于不同的方位,两两距离不等且不共面。本文提出了一种简单易操作的四标定球摆放方式,如图2a所示。从俯视角度看,球1~4分别按90°的角度差顺时针摆放于植株(图中以香蕉苗为例)周边,球1、球2与植株外围的距离约为,球3、球4与植株外围的距离约为2。球2和球3摆放高度与Kinect V3传感器的放置高度保持基本一致,球1和球4的摆放高度分别适当高于或低于球2和球3。以该方式摆放的标定球,可确保两两距离不等,满足准确计算转换矩阵的必要条件,且方便拍摄。试验时,Kinect V3分别从拍摄对象的4个水平方向及垂直向下共5个方向进行点云采集。

注:r为标定球与植株的距离,cm。

1)室内简单场景:分别选取单株甘蔗苗和高粱苗放置于空旷的室内,通过上述规则摆放标定球后,从水平及垂直5个方向进行点云采集。试验场景如图3a所示。

2)大田复杂场景:选择广西扶绥县广西大学农科新城的一处香蕉种植园作为拍摄地点。香蕉是当地的主要经济作物之一,属于芭蕉科芭蕉属的大型草本植物,主要通过母株球茎处抽生的吸芽进行繁殖。田间试验采用Kinect V3在原地从5个不同方向对3株香蕉幼苗(6~8叶期)进行拍摄,现场如图3b所示。由于Kinect V3深度传感器易受外部强光的影响,在白天阳光较强时采集的数据具有较大噪声,因此本试验选择在傍晚阳光较弱时进行。水平方向各角度拍摄得到点云数量约为20万点,垂直向下方向点云数量约为27万点。可视化原始点云如图4所示。

1.2 点云数据预处理

由于Kinect V3的IR(Infrared Radiation)信号饱和、IR信号强度低、多路径干扰等原因可能会导致原始香蕉点云数据存在一定的噪声。另外,田间环境复杂,采集得到的点云数据量大,若直接进行标定球提取,不仅耗时长,且容易导致误提取。因此,首先需对点云进行直通滤波和点云下采样等预处理。

1.2.1 直通滤波

直通滤波是常见的点云滤波方法,其基于点云空间坐标系设定空间阈值,仅保留空间阈值内的点云。根据现场获得的经验值设置、、轴方向上的阈值min、max、min、max、min和max分别为–700、700、–700、700、0和1400 mm。

1.2.2 下采样

采用包围盒压缩算法进行下采样。图5展示了包围盒压缩点云的原理。首先构建整体点云的一个大包围盒(假设其边长为1),如图5a所示;再按照2的边长构建小包围盒(2可根据需求设定),选择每个小包围盒中最靠近其质心的点作为该包围盒的采样点,如图5b所示。通过多次尝试,本文的2设置为10 mm。

1.3 提取标定球

本文采用随机采样一致性算法(Random Sample Consensus,RANSAC)[15]对标定球进行提取。该算法可以从一组包含噪点的数据集中,通过迭代的方式找出符合预设数学模型的点,其准确率随着迭代次数的增加而增加。已知标定球外形的数学模型为半径7 cm的球体,一个球体模型需要至少4个空间中的点才可确定,因此随机采样的最小子集(初始局内点)为4。本文RANSAC算法提取标定球的具体过程如下:

1)随机抽取点云数据中的4个点作为初始局内点;

2)计算其决定的球体模型的半径和球心(,,),若在6~8 cm内,则认为该初始点集接近预设模型,进入下一步,否则回到步骤1);

3)计算其他点到球心的距离,将距离在±5 mm内的点认定为此模型的局内点,并统计所有局内点的数量;

4)重复步骤1)~3),直到达到最大迭代次数 (500000次)为止,局内点最多的点云集即为最终输出。

RANSAC算法在一个场景里一次只能提取出一个球体。针对这一问题,本文引入点云减法的概念,设计了一种自动提取所有球体的方法。定义两点云的减法为:在两片包含关系的点云中,在目标点云中除去被包含的那部分点云。假设存在图6a所示一目标点云,图6b为被包含的点云1,则-1结果如图6c所示。

假设存在一个包含多个标定球的目标点云,自动提取所有标定球的方法如下:

1)采用RANSAC算法提取出第一个球体点云1并保存;

2)对与1做减法操作(在PCL点云库中不存在对两片包含关系点云做减法的方法)。首先对1建立kd-tree拓扑关系[16];接着遍历1中的点,用p表示,并搜寻中与p距离为0的点用q表示,则q即为包含点;将中所有的包含点去除,剩下的点云集合即为两点云相减的结果;

3)用更新重复步骤1)~3),直至提取完场景中所有标定球或达到RANSAC算法的最大迭代次数为止。

1.4 匹配标定球

在提取出同一场景不同视角的标定球及其球心坐标后进行同名标定球的匹配。本文提出一种基于距离特征描述符的同名点对自动匹配方法。该描述符不随刚性变换而变换,能唯一指定一个三维点,具体如下:

假设存在一点集如式(1)所示,中包含个特征点,两两特征点的距离不等。本文一特征点代表一个标定球球心。

将每个点与其他各点的距离作为该点的特征,那么点集的个特征点就可表示为个距离特征的集合,即为距离特征描述符,记为feature,如式(2)所示。

以包含3个特征点的点集(如图7所示)举例说明该算法的原理。设存在两点集、,点集由点集经过一定旋转平移得到。

构建点集中每个点的距离特征为该点到其他所有点之间的距离集合。如点集中1点的距离特征为集合为{12,13};同时为了使得构建的距离特征不受排序的影响,需对距离特征集合做排序(本文采用从小到大的顺序),用Sort表示,即a1=Sort(12,13),那么点集的距离特征描述符feature即可表示为式(3)。同理可得点集的特征描述符feature如式(4)所示。

由上述分析不难得出,当||a1–b1||=0、||a1–b2||与||a1–b3||均不为0时,即可确定b1所对应的1点为1点经旋转平移得到,即1与1为同名点对。该方法可进一步推广到包含更多特征点的一般情况,此处不再重复阐述。

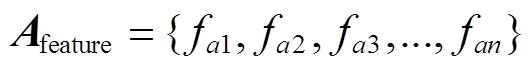

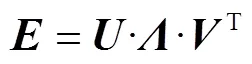

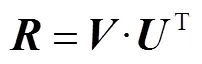

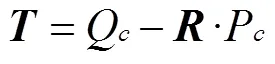

1.5 求解旋转平移矩阵

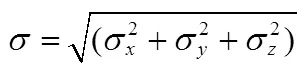

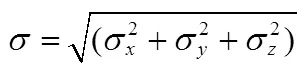

确定同名点集后,使用奇异值分解法(Singular value decomposition,SVD)近似求解旋转平移矩阵[17]。假设两同名点集、,求解、之间旋转平移矩阵的具体步骤如下:

式中w表示权重;P(x,y,z),Q(x,y,z)为点集内各点三维坐标。

2) 根据式(7)计算协方差矩阵,其中为×维矩阵;,为×维矩阵;=diag(1,2,3,…,w)。

3) 根据式(8)对协方差矩阵进行奇异值分解,和矩阵均为对角矩阵,则推得旋转矩阵,平移矩阵如式(9)~(10)所示。

1.6 点云平滑

由于环境中风、光线等引起的系统误差以及配准过程中产生的配准误差,叠加、配准后的点云表面通常较为粗糙。本文进一步使用移动最小二乘法对点云曲面进行平滑[18],以达到优化三维模型的效果。

2 结果与分析

2.1 点云预处理结果

以香蕉园某株香蕉苗的0°原始点云为例,其直通滤波后的效果如图8a所示,下采样结果如图8b所示。可以看出,直通滤波有效滤除了原始点云中的背景。下采样后,点云变得稀疏,点云量减少了约91%,可极大提高后续算法的处理速度。

2.2 标定球提取结果

本文方法得到的多标定球自动提取结果如图9所示(以0°点云为例)。可以看出,该方法可将经过直通滤波和下采样之后场景中所有球体点云准确地提取出来。4个标定球的提取时间约为2.3 s。

图9 标定球提取结果示例

2.3 配准结果及误差分析

以水平0°点云为源点云,将水平90°、180°、270°及垂直向下角度的点云分别变换到0°点云坐标系下进行配准。室内场景下的甘蔗和高粱植株自动配准的结果如图10a所示。可以看出,各方向的点云成功配准到0°点云坐标系中,植株形态完整,没有出现明显分层。进一步采用商用点云处理软件LiDAR360对点云进行手动配准,结果如图10b所示。可以看出,二者的配准效果非常接近。

受复杂环境的影响,田间场景下的配准难度更高。图11和图12分别展示了采用本方法及LiDAR360对大田场景下香蕉幼株的其他角度点云自动配准到0°点云的结果。可以看出,本文自动配准方法成功地实现了配准,与LiDAR360的手动配准基本一致。从提取标定球到得出配准结果这一个过程所需的运算时间上比较,本文自动匹配方法平均耗时约50 s,LiDAR360在人工选择同名点的情况下耗时约150 s。本方法效率提高了67%。

为进一步量化评价配准结果,以标定球的球心坐标为参考依据,分别计算各角度点云转换到0°源点云坐标下的新球心坐标与源点云球心坐标之差,得到平均轴向误差及平均点位误差如表1所示。

Fig.11 Automatic registration results with the method proposed in this study

表1 本文提出的自动配准方法与LiDAR360手动配准方法的误差对比

从表1可以看出,室内场景下,本文方法的平均轴向误差最小值为5.8 mm,平均点位误差为21.0 mm;LiDAR360手动配准的平均轴向误差最小值为8.5 mm,平均点位误差为21.9 mm。大田场景下,本文自动配准方法的平均轴向误差最小值为7.3 mm,平均点位误差为20.5 mm;LiDAR360手动配准的平均轴向误差最小值为7.3 mm,平均点位误差为20.8 mm。室内场景和大田场景下本文自动配准方法的平均轴向误差在5.8~17.4 mm之间,平均点位误差在13.1~28.9 mm之间;平均点位误差分别比LiDAR360手动配准的结果低0.9 mm、0.3 mm。表明本文提出的方法在不同场景下均达到了商业化软件配准水平。

经点云平滑后,香蕉幼株的三维重建结果如图13所示,可以看出,本文方法所提取的香蕉幼株三维模型包含了清晰的立体植株几何信息,为全面检测植株的生长状态奠定了技术基础。

3 讨 论

本文方法在大田环境下的平均点位误差为20.5 mm,比LiDAR360的配准误差略低。尤其是香蕉植株1的现场背景最复杂、环境干扰最大,但其平均点位误差为 22.0 mm,比LiDAR360的配准误差小4.26%,显示出本方法针对复杂场景的良好性能。但是,从室内简单场景下的配准结果可以看出,本文方法针对2种植株所得的平均点位误差相差2倍以上,而LiDAR360的平均点位误差在20~23 mm的范围内,本文方法的稳定性还有待进一步提高。余秀丽[19]针对Kinect采集的点云,采用最小二乘法求取球面点云球心、三点法求取转换矩阵进行粗配准,然后应用最近点迭代(Iterative Closest Point, ICP)进行精配准,最大距离误差为18.6 mm,最小距 离误差为7.2 mm;邵小宁[20]针对Kinect采集的点云,采用颜色分割提取待配准数据中的标定物,并去除了离散点与不符合配准要求的标定物,最后用基于欧氏距离约束的ICP算法进行精配准,最小的距离误差为 7.13 mm。而本文提出的方法在未进行精配准的情况下,最小平均点位误差为13.1 mm,接近以上文献中精配准的效果。

进一步分析本文方法的误差来源主要包括:

1)Kinect V3深度传感器本身的设备误差以及获取数据的距离限制,使得原始点云数据存在一些空洞和噪点。

2)随机采样一致性算法具有一定的不确定性,可能会将一些并不是标定球的点归类为靶球,从而导致提取的圆心存在偏差。

3)旋转平移矩阵求取过程中,采用了泰勒展开,忽略了高阶项,也引入一定误差。

4)阳光、香蕉树表面材质等环境因素会影响IR信号的反射,进而导致原始点云采集时出现一定的误差。

本研究通过提出的多标定球自动提取方法及基于距离特征信息的同名点自动匹配方法实现了不同点云的自动化配准,相较于目前大部分商业软件需要人工参与才能实现较好配准的情况,在配准效率上具有较大的优势。不同植株的配准结果充分反映了本方法自动化程度高、配准误差低,能有效满足农作物三维建模的需求。本文方法还可结合更高精度的其他点云获取设备实现更高质量的配准。

下一步可继续优化算法,进一步降低点云配准的速度;还可结合改进的ICP算法等进行精配准,进一步提高点云配准的精度。

4 结 论

本文采用低成本的Kinect V3深度传感器结合标定球实现田间复杂环境下香蕉作物植株的多角度点云采集,并通过点云预处理、自动提取标定球、自动匹配标定球、求解旋转平移矩阵以及点云平滑等步骤实现了自动配准及香蕉植株的三维重建,主要结论如下:

1)通过直通滤波和下采样可大量滤除背景和冗余信息,在保持原始点云特征不变的前提下显著减少了点云的数量(减少约91%),提高了处理速度。

2)提出了一种基于距离的同名点匹配算法,并将其运用于标定球的匹配中,点云配准的效率提高了67%。

本文方法同基于公共重叠区域的配准方法相比, 能够实现大角度的点云配准,适合在复杂多变的田间 环境作业;同基于标定球的手动配准方法相比更加自 动化。

[1] 张彦雯,胡凯,王鹏盛. 三维重建算法研究综述[J]. 南京信息工程大学学报:自然科学版,2020,12(5):591-602.

Zhang Yanwen, Hu Kai, Wang Pengsheng. Review of 3D reconstruction algorithms[J]. Journal of Nanjing University of Information Science & Technology: Natural Science, 2020, 12(5): 591-602. (in Chinese with English abstract)

[2] 唐丽玉,张浩,黄洪宇,等. 基于点云数据的树木三维重建方法改进[J]. 农业机械学报,2017,48(2):186-194.

Tang Liyu, Zhang Hao, Huang Hongyu, et al. Improved method for 3D reconstruction of tree model based on point cloud data[J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(2): 186-194. (in Chinese with English abstract)

[3] 刘振,杨玮,李民赞,等. 基于Kinect相机的土壤表面三维点云配准方法[J]. 农业机械学报,2019,50(S1):144-149.

Liu Zhen, Yang Wei, Li Minzan, et al. Three-dimensional point cloud registration method for soil surface based on Kinect camera[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(S1): 144-149. (in Chinese with English abstract)

[4] Johnson A E, Hebert M. Using spin images for efficient object recognition in cluttered 3D scenes[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2002, 21(5): 433-449.

[5] Frome A, Huber D, Kolluri R, et al. Recognizing objects in range data using regional point descriptors[C]// European Conference on Computer Vision. Springer, Berlin, Heidelberg, 2004.

[6] Salti S, Tombari F, Stefano L D. SHOT: Unique signatures of histograms for surface and texture description[J]. Computer Vision & Image Understanding, 2014, 125: 251-264.

[7] Guo Y, Ferdous S, Bennamoun M, et al. Rotational projection statistics for 3D local surface description and object recognition[J]. International Journal of Computer Vision, 2013, 105(1): 63-86.

[8] Rusu R B, Blodow N, Beetz M. Fast point feature histograms (FPFH) for 3D registration[C]// IEEE International Conference on Robotics & Automation. IEEE, 2009.

[9] 杨玉泽,孙英伟,林文树. 基于FPFH特征和NDT算法 的树木点云配准[J]. 西北林学院学报,2019,34(5):141-146.

Yang Yuze, Sun Yingwei, Lin Wenshu. Tree point cloud registration based on FPFH feature and NDT algorithm[J]. Journal of Northwest Forestry University, 2019, 34(5): 141-146. (in Chinese with English abstract)

[10] 郑立华,麦春艳,廖崴,等. 基于Kinect相机的苹果树三维点云配准[J]. 农业机械学报,2016,47(5):9-14.

Zheng Lihua, Mai Chunyan, Liao Wei, et al. 3D point cloud registration for apple tree base on Kinect camera[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(5): 9-14. (in Chinese with English abstract)

[11] Garrido M, Paraforos D, Reiser D, et al. 3D maize plant reconstruction based on georeferenced overlapping LiDAR point clouds[J]. Remote Sensing, 2015, 7(12): 17077-17096.

[12] Chebrolu N, Magistri F, Läbe T, et al. Registration of spatio-temporal point clouds of plants for phenotyping[J]. PLoS One, 2021, 16(2): e0247243.

[13] Yu X, Song H, Wang S. Capture of multi-view point clouds and registration of plants based on Kinect[J]. International Agricultural Engineering Journal, 2016, 25(1): 74-84.

[14] Zhou S, Kang F, Li W, et al. Point cloud registration for agriculture and forestry crops based on calibration balls using Kinect V2[J]. International Journal of Agricultural and Biological Engineering, 2020, 13(1): 198-205.

[15] Fischler M A, Bolles R C. Random sample consensus: A paradigm for model fitting with applications to image analysis and automated cartography[J]. Communications of the ACM, 1981, 24(6): 381-395.

[16] 邹际祥. 基于KD-TREE加速的点云数据配准技术研究[D]. 合肥:安徽大学,2013.

Zou Jixiang. The Research of Point Cloud Data Registration Technique Based on KD-Tree Acceleration[D]. Hefei:Anhui University, 2013. (in Chinese with English abstract)

[17] Sorkine O, Rabinovich M. Least-squares rigid motion using SVD [J]. Computing, 2017, 1(1): 1-5.

[18] 曾清红,卢德唐. 基于移动最小二乘法的曲线曲面拟合[J]. 工程图学学报,2004,25(1):84-89.

Zeng Qinghong, Lu Detang. Curve and surface fitting based on moving least square method[J]. Journal of Engineering Graphics, 2004, 25(1): 84-89. (in Chinese with English abstract)

[19] 余秀丽. 基于Kinect的苹果树三维重建方法研究[D]. 杨凌:西北农林科技大学,2016.

Yu Xiuli. Reconstruction of Apple Tree Based on Kinect[D]. Yangling: Northwest A&F University, 2016. (in Chinese with English abstract)

[20] 邵小宁. 基于Kinect的植物三维点云获取与重建方法研究[D]. 杨凌:西北农林科技大学,2016.

Shao Xiaoning. Research on 3D Point Cloud Acquisition and Reconstruction of Plants Based on Kinect[D]. Yangling: Northwest A&F University, 2016. (in Chinese with English abstract)

Field plant point cloud registration method based on Kinect V3 depth sensors

Li Xiuhua1,2, Wei Peng1, He Jiaxi1, Li Minzan3, Zhang Muqing2, Wen Biaotang4

(1.530004,;2.530004,; 3.100083,; 4.530001,)

An accurate modeling of three-dimensional (3D) point cloud has been a crucial step to extract the physical phenotyping parameters of plants, such as the plant height, leaf quantity, and leaf area. In this study, an automatic registration of point clouds with multiple calibration balls was proposed to realize the 3D modeling of plants under a complex background in the field. A low-cost depth sensor (such as Kinect V3) was also selected to capture the images. The performance of the registration was then evaluated using the multiple angles of several plants under the indoor and in-field scenes. Four procedures were included the point cloud filtering and down sampling, multiple calibration balls extraction, correspondence points matching, as well as the calculation and registration of transformation matrix. 1) The pass-through filtering with only several boundary thresholds was used to reduce the noises, while the bounding box compression was used to down sampling the point clouds. 2) A Random Sampling Consistency (RANSAC) was also used in the multiple calibration balls extraction. Furthermore, a concept of point cloud subtraction was proposed to combine with the RANSAC, in order to form an automatic extraction of multiple calibration balls. Among them, the RANSAC was utilized to extract one single object at one time. As such, the center coordinates of each calibration ball were then calculated as the featured points. 3) The distances of any two feature points were calculated in the correspondence points matching. An automatic matching of correspondence points using the distance information was also proposed to realize the self-matching of the calibration balls. 4) The singular value decomposition was adopted to solve the transformation (rotation and translation) matrix, and then the registration of two pieces of point clouds was realized eventually. The experiments were carried out in two scenes: one was the indoor scene with the flat and clean surface, and another was the field scene with the uneven and complex conditions. Five plants were chosen as the research objects, including one sugarcane (indoor), one sorghum (indoor), and three young banana plants (in-field). The Kinect V3 sensor was utilized to capture the point clouds of each object in five orientations (the horizontal orientation of 0º, 90º, 180º, 270º, and one vertical orientation). A commercial point cloud processing software named LiDAR360 was adopted for comparison with the man-aid registration. After that, the object point clouds (horizontal 90°, 180°, 270°, and vertical) of each plant was used to implement the registration into the coordinate system of the source point cloud (horizontal 0°). The registration performance was evaluated to calculate the axial errors and point errors of the transformed coordinates, as well as the source coordinates of the centers of all the calibration balls. The results showed that the registration of different point clouds was successfully implemented in the different orientations, no matter in the indoor or in-field environment. Particularly, the generated 3D model of the plant was clear in shape. Specifically, there were an average axial error of 5.8-17.4 mm and an average point position error of 13.1-28.9 mm for the registration in the different scenes, similar to the registration in the manual registration software LiDAR360. In the required calculation time, the automatic matching took about 50 s on average for the process from the extraction of calibration sphere to the registration, whereas, the LiDAR360 took about 150 s with the manual selection of the correspondence points, indicating the efficiency increased by 67%. Consequently, it can be widely expected to serve a high-precision and automatic registration of plant point clouds acquired by low-cost depth cameras in complex field environments. The finding can provide a low-cost feasible solution for the 3D modeling and the extraction of phenotyping parameters of field plants.

automation; sensors; point cloud; plant 3D modeling; point matching; RANSAC; Kinect

10.11975/j.issn.1002-6819.2021.21.006

S24

A

1002-6819(2021)-21-0045-08

李修华,魏鹏,何嘉西,等.基于Kinect V3深度传感器的田间植株点云配准方法[J]. 农业工程学报,2021,37(21):45-52.doi:10.11975/j.issn.1002-6819.2021.21.006 http://www.tcsae.org

Li Xiuhua, Wei Peng, He Jiaxi, et al. Field plant point cloud registration method based on Kinect V3 depth sensors[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(21): 45-52. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.21.006 http://www.tcsae.org

2021-07-14

2021-10-15

广西科技重大专项(桂科AA18118037、桂科2018-266-Z01);国家自然科学基金项目(31760342)

李修华,博士,副教授,研究方向为作物长势及表型检测。Email:lixh@gxu.edu.cn