自然语言处理在其他学科领域的影响考察*

——基于CNKI的中文文献挖掘

2022-01-21蒋彦廷胡韧奋

蒋彦廷 胡韧奋

(1. 成都航空职业技术学院 成都 610100;2. 四川传媒学院 成都 611745;3. 北京师范大学中文信息处理研究所 北京 100875;4. 北京师范大学汉语文化学院 北京 100875)

0 引 言

近年来,自然语言处理(Natural Language Processing, NLP)作为人工智能的一个分支蓬勃发展。作为一门让计算机有效地理解与处理人类语言的学科,它在文本分类[1]、信息检索[2]、机器翻译[3]、阅读理解[4]等技术上均取得了长足进步。随着社会经济科技发展,信息传播越来越便捷,各个专业学科相互沟通、相互交融的趋势愈加明显。边缘学科乃至跨学科的专著、论文也不断涌现[5]。考察自然语言处理在其他专业的影响,探索NLP与其他学科的交叉领域,不仅有利于在学科专业之间找到创新点,助力科学研究;而且也能推动NLP技术在各领域应用落地,促进产研合作与研究成果转化。

1 相关研究

在既往的研究中,一些研究者注意到了自然语言处理与其他学科的交叉领域。例如王煜[6]介绍了词频分析、依存句法分析、文本分类、信息检索和知识图谱等技术在建筑工程领域的用途,包括合同管理、工程舆情分析、施工事故原因识别等。薛蕊等[7]指出铁路领域有着大量非结构化文本,NLP技术能将数据结构化,在铁路智能客服、资产设备管理、智能维修、辅助决策等方面发挥作用。此外还有介绍NLP在法律[8]、军事地理情报[9]、教育[10]、社会传播学[11]的应用情况。这一类文献往往是综述性质的,关注NLP在某一个具体方面的成果,且考察方式为定性分析。而通过定量方式、尽可能全面展示NLP与其他学科领域交融发展、NLP知识扩散的情况,还是一个值得填补的研究空白。

在运用定量手段发现学科交叉主题、探索跨学科知识扩散的研究中,引文网络、共词分析、聚类法是常用的方法。

引文网络法基于这样假设:引用相似文献的两篇论文,在研究主题上也具有相似性。通过构建共被引网络、进行网络密度、核心度等指标的复杂网络分析,可发现具有相似主题的文献,进而发现学科间主题交叉、知识扩散的现象[12, 13]。采用引文网络进行跨学科的知识扩散探索,主要的关注点是文献之间的引用关系[14],忽略了文献本身的主题内容,主题粒度较粗[15]。该方法难以探寻具体研究主题的跨学科扩散状况。

共词分析法主要以文献关键词为计量项,通过寻找不同学科文献之中共同出现的关键词,构建共现网络,发现交叉研究的主题。共词分析法简便易行,但许多学术文献的关键词设置有很强的人为主观性。一方面部分文献关键词不规范、概念混乱、粒度大小不一[16];另一方面也难以解决多词一义、一词多义的问题,例如论文关键词中的“LSTM”与“LSTM模型”、“LSTM网络”、“长短期记忆”、“长短期记忆神经网络”多词一义;而“深度学习”概念在教育学和人工智能领域的含义大相径庭。

聚类法首先通过对不同学科的文献进行语义聚类,构建学科交叉文献集。每一个聚类簇内可能包含学科不同但主题相似的文献。进而对每一个类簇,运用以LDA(Latent Dirichlet Allocation)为代表的主题模型求解,将交叉文献转变为交叉主题[15]。这是一种无监督数据挖掘的方法,不依赖人为标注的数据。但聚类方法的类别数量往往需要人为设置。在数据量大、样本成员之间总体的语义距离较小的情况下,聚类的效果往往不尽如人意。此外,以LDA为代表的主题模型会生成由若干关键词构成的主题,主题的意义需要人为归纳。

我们认为,发现学科交叉研究的主题,包含两个子任务:第一是交叉领域文献集的确定;第二是交叉领域文献集主题的识别。针对这两个任务,该文的研究方法将在第2节中详述。

2 研究方法

本文的研究方法涉及两方面。第一,针对交叉领域文献集的确定,我们将利用《中国图书馆分类法》与文献之间的引证关系,确定NLP与其他领域的交叉研究文献。第二,针对交叉领域文献集的主题识别,我们构建了一个“数据资源-算法模型-关键技术-应用系统”的4层级的NLP知识分类体系与文献数据集,通过文献的多标签分类(Multi-label classification),实现有监督的文献主题识别,从而使NLP在其他领域的影响作用更具体地呈现出来。

2.1依据文献分类号、引证关系构建交叉领域文献集要发现NLP在其他学科领域的影响力,首先需要收集NLP与其他学科交叉研究的文献。在中国知网(CNKI)论文数据库中,许多论文均标注了文献分类号。文献分类号设置的依据就是《中国图书馆分类法》(以下简称“《中图法》”)。《中图法》是一个针对图书、文献的大型知识分类体系,是当今国内图书馆使用最广泛的分类体系。《中图法》包含22个一级类别,以下又区分约250个二级类别和更多的小类,层层隶属,逐级细分。

NLP在《中图法》知识分类体系中的定位是怎样的?我们经过对代表性NLP论文所属分类号的分析调研,认为具有以下《中图法》分类号(以下简称“中图分类号”)的文献,就属于NLP的典型文献,如表1所示。

表1 自然语言处理的典型中图分类号及其含义

根据《中图法》,TP391.1“文字信息处理”不仅包括文字录入技术,而且也涉及范围更广的、非语音而是书写形式的文字处理系统。TP391.2“翻译系统”与H085“机器翻译”两个分类号的区别在于,前者主要收录与翻译软件及其应用相关的图书文献,后者则偏重机器翻译及其理论[17]。每篇文献的分类号,由作者或期刊编辑人工标记确定,严谨性和准确性较强。

我们依据上述分类号,从CNKI中国知网数据库中收集了2159篇文献的题名、刊物名、摘要、关键词、中图分类号等信息。这些包含表1典型NLP分类号的文献,就是NLP领域的典型文献。值得指出的是,这2159篇典型文献中,也有不少文献包含了多个中图分类号。

除了采集NLP领域的典型文献,我们也收集了NLP领域的非典型文献。我们对于NLP领域非典型文献的界定标准是:它们虽然本身不含表1所示的NLP文献分类号,但引用参考了NLP领域的典型文献。我们依照此标准,搜寻NLP典型文献的引证文献,从中采集了1376篇NLP的非典型论文。

2.2建立NLP知识分类体系,构建论文主题数据集“NLP-others”如第1节所述,学术论文关键词普遍存在主观性强,一致性较弱的现象。一词多义、多词一义、上位词和下位词的问题也不利于直接通过统计关键词,反映NLP与其他学科领域交叉研究的研究主题。另外,根据我们对3535篇NLP典型与非典型论文的数据统计,论文的关键词同时存在于摘要或标题中的比例不到30%。这意味着难以通过词向量学习,在论文的标题或摘要中获得关键词的嵌入(embedding)表示。

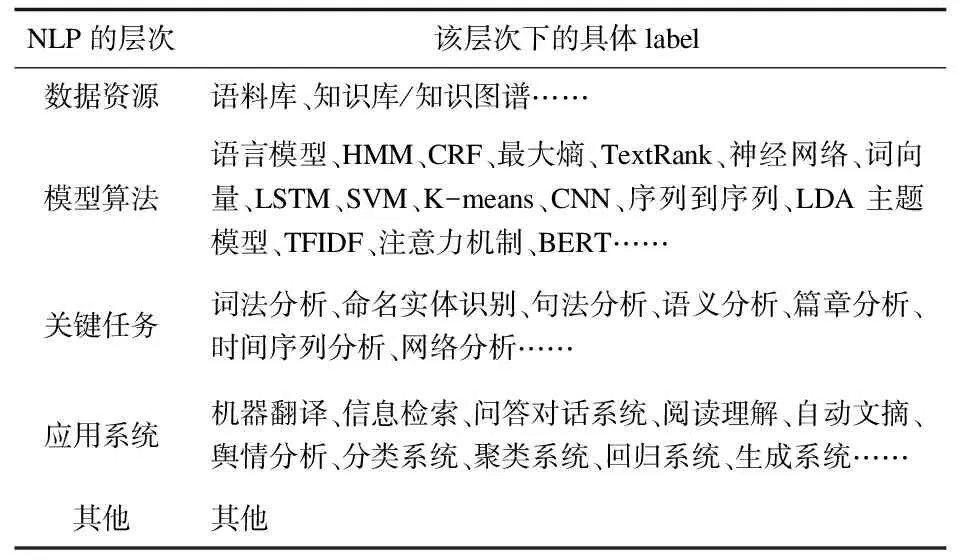

针对这样的情况,我们依据参考对采集到的部分论文主题的考察,并参考宗成庆[18]对NLP领域内容、层次的梳理,构建了一个4层级的NLP知识分类体系,并据此体系,人工标注了一个NLP与其他领域交叉研究的论文主题的多标签分类数据集“NLP-others”。该NLP知识分类体系如表2所示。

表2 NLP的4层级知识多标签分类体系

NLP的4层级知识多标签分类体系的第一层次是“数据资源”,任何一个信息处理系统,都离不开数据和知识库的支持, 自然语言处理系统也不例外。第二层次是“模型算法”,它主要涉及自然语言处理领域的统计方法与机器学习方法。第三层次是“关键任务”,主要涉及从词语、句子序列、篇章等角度,对自然语言文本进行分析并从中提取有价值的信息。第四层次是“应用系统”,它是NLP知识分类体系中最宏观抽象的一层,其下包含的具体label,通常都是集成性、实用性较强的落地的系统。

为了让表2的分类体系更好地指导NLP文献主题数据标注,增强标注的准确度与一致性。我们对该体系做出如下标注说明:

a.知识库/知识图谱。知识库与知识图谱都属于经由人为提炼、加工后的形式化的知识资源,因此归入同一个label中。词典、辞书、本体、语义网、图数据库等主题也归入该label中。

b. 语言模型。包括但不限于经典的n-gram语言模型与预训练深层语言模型。

c.神经网络。“神经网络”label包括“词向量”“LSTM”“CNN”“BERT”等下位概念。当一篇文献中包括这些下位概念时,也需要标注“神经网络”这一上位概念。

d.词向量、LSTM、CNN、LDA主题模型等。这些标签分别是所属的一类模型算法的通称。与它们密切相关的改进、变种版算法/模型,也归入对应的标签里。例如“循环神经网络(Recurrent Neural Network)”、“双向的长短期记忆(Bi-LSTM)”模型也归入“LSTM”标签中。

e.词法分析。该label具体包括自动分词、词性标注、词频统计与词语共现相关的内容。另外有关语素(Morpheme)、词类、复合词内部结构等的语言理论研究,也归入此label。而“关键词抽取”相关内容不归入此label,而归入“应用系统”层次的“自动文摘”label。

f.句法分析。该label既涉及短语结构语法、依存语法的自动分析,也包括形式语言、自动机理论、构式语法等语言学语法理论的探索。

g.语义分析。该label主要涉及对语言意义的分析研究,包括语义角色标注、语义依存、词义消歧等。也包括理论语言学领域相关的语义研究(如动词配价理论)。“知识库/知识图谱”label中涉及语言意义形式化分析的内容(如WordNet、HowNet知网),也同时归入“语义分析”label中。

h.网络分析。包括图论、复杂网络、社会网络分析等内容。该label与“知识图谱”的区别在于,“网络分析”侧重于动态的算法过程与网络性质的分析,例如社群发现、关键节点挖掘、网络表示学习等。

i.舆情分析。该label主要包括监测、情感分析、谣言识别、信息传播等内容。它与网络社交媒体密切相关。

j.分类系统。该label主要包括句子分类、文本分类,也包括广义上的机器学习分类任务。若“舆情分析”label中涉及到分类任务,也同时标记“分类系统”这个label。但同层级除了“舆情分析”的其他label,如命名实体识别、信息检索、问答系统、阅读理解、自动文摘等若涉及了分类的子任务,也不再标记“分类系统”label,以避免类别范围无限制地扩大。

k.回归系统。该label主要涉及对样本数值的预测。例如电影评分预测、温度预测、广告点击率预测、作文评分预测。

l.其他。当一篇文献不属于其他任何一个label时,就标记为“其他”类别。

该分类体系在指导文献主题标注时,以文献的简介信息(包括标题、摘要、关键词)为参考的材料依据。一篇文献可能只有一个label,也可能有多个label。在主题标注时,应当彰显文献论述的显式的重点,例如若文献简介明确提到了词向量,除非在文献简介也明确提到了自动分词、词性标注等内容,否则该文献仅标注“词向量”的label,不标注“词法分析”的label。

我们依据此分类体系,对采集的文献进行主题标注。在一位NLP专业的教师、两位NLP专业研究生的合作下,人工标注了每篇NLP相关论文的主题label,构建了NLP与其他领域交叉研究的论文主题数据集“NLP-others”。下载链接为:https://www.mediafire.com/file/q5gy8iurtr7am76/NLP_topic_classification_dataset.xlsx/file。它包含1484篇带NLP主题标记的论文。这1 484篇论文或多或少均与其他学科领域有所关联(如表3所示)。这为后续的主题统计、论文多主题识别奠定了基础。

3 实验数据

如第2.1节所述,实验数据包括1 376篇NLP非典型文献,以及2 159篇NLP的典型文献。而标注的NLP论文主题数据集,则包括1 376篇NLP非典型文献的全部,以及108篇典型文献。这108篇典型文献同时包含了表1的NLP典型分类号,以及表1之外的其他中图分类号。如表3所示。

表3 实验数据的类型及其规模

4 实验过程与分析

4.1文献的来源期刊分析我们首先统计了NLP的典型文献、非典型文献来源的期刊分布情况,根据期刊的频次高低绘制了词云图。如图1、图2所示。

对比图1、图2可以发现,NLP领域的典型文献主要来源于计算机学科相关的学术杂志,尤其以《中文信息学报》《计算机学报》《软件学报》《计算机研究与发展》等为代表。而NLP领域的非典型文献,则主要分布在图书馆学、情报学领域的学术期刊中,如《图书情报工作》《情报理论与实践》《情报科学》。这说明,图情领域的许多论文虽然没有标注NLP的中图分类号,但参考引用了NLP领域的许多典型文献,受到NLP的影响较大。

图1 2 159篇NLP典型文献的来源期刊

图2 1 376篇NLP非典型文献的来源期刊

总的来看,除计算机学科外,图情学科与NLP的关联最为密切。此外,也可以看到其他领域的学术杂志涉及了一些NLP的边缘性、交叉性研究,如医学领域的《医学信息学杂志》、农业领域的《农业机械学报》、教育学领域的《中国远程教育》、传播学领域的《现代传播》、语言学领域的《语言文字应用》、《语言科学》等。

4.2文献的中图分类号分析NLP在其他领域的影响力,可以由NLP文献涉及的其他学科分类号的出现频次来定量地衡量。我们统计了3 535篇NLP典型与非典型的文献中,除表1以外的其他中图分类号频次。这些中图分类号要么与典型的NLP分类号同现,要么是参考引用了NLP典型论文的文献的分类号。它们代表着与NLP相关的其他学科领域。经归并小类的整理,如表4所示。

表4 与NLP相关的其他领域分类号(部分)

由表4可知,与NLP有联系的领域十分广泛。限于篇幅,我们阐述分析频次前8位的分类号对应的领域。分类号频次最突出的是TP18人工智能理论领域,分类号出现的频次高达639。NLP作为人工智能的一个分支,与人工智能中的机器学习、知识工程、人工神经网络有着千丝万缕的联系[17]。

频次位居第二是G353“情报资料处理”的领域。根据对该领域下198篇文献的考察,它们主要探讨了各领域知识图谱的构建与应用,以及科研学术信息的挖掘与分析。具体涉及知识图谱[19-21]、主题发现及演化[22, 23]等技术。

频次第三的是G206“传播理论”。该领域涉及舆情管理分析、社交媒体数据挖掘与计算视角下的传播学研究。如唐存琛等[24]通过模块化采集、文本分类与聚类,提升了获取社交网站舆情信息的速度与质量。胡吉明[25]、麻友[26]等分别利用BiLSTM-CRF、LDA模型从微博等社交媒体中抽取机构、观点等关键实体,实现舆情的挖掘与结构化。谭振华[27]、刘丽群[28]、徐建民[29]等则从网络传播的角度,对用户转发微博的行为进行特点分析或建模预测。

频次第四的是G252“信息资源服务、文献检索”领域。如名称所示,该领域着眼于为用户提供有效的信息资源。主要涉及相关数据库、开放数据集的建设[30-31]、知识检索[32-33]、智能推荐[34-36]、问答服务[37]等。

频次第五的是F724、F274“商品流通、企业营销管理与市场”领域。NLP在该领域处理的文本类型,既包括电商平台的消费者评论[38-40],也涉及招聘网站信息[41]与企业微博内容[42]。NLP发挥的作用主要是挖掘文本关键信息,为企业人员与消费者提供决策支持。

频次第六的是G254“信息组织理论”领域。该领域的文献主要涉及信息加工、知识标注与结构化工作。例如学术知识描述体系[43]、古籍知识本体[44]、就业知识需求模型的构建[45, 46],也包括机器学习对图书[5]、文献[47]多标签分类相关的研究等等。

频次第七的是G250“图书馆学,情报学工作”。该领域与NLP交叉研究的突出主题,就是图书馆工作的网络化与自动化(数字图书馆)。数字图书馆是未来图书馆的发展趋势,数字人文、文化遗产的数字化[48]以及移动图书馆、数字出版、数字资源的共享[49]都是与NLP紧密联系的领域。

频次第八的是G434“计算机化教学、电化教学”领域。该领域与NLP交叉研究的领域较为广泛。包括学生书面成绩的自动评价[50, 51]、学习者情感文本分析[52, 53]、运用深度学习方法的MOOC在线课程信息挖掘[54-56]、知识推荐[57]与教育知识图谱[58]等。

我们按照《中图法》将中图分类号转化成领域名称,根据分类号出现的频次,绘制了图3所示的词云图。可以看出,NLP与自然、社会与人文学科均有程度不同的影响力。这反映了当代学科间的相互渗透、融合的趋势。只要某领域存在需要处理分析的大量文本,NLP就能发挥重要作用,例如渔业标准的命名实体识别[59]。此外,NLP技术甚至在非自然语言的序列中,也有用武之地,例如向量空间模型用于RNA序列物种鉴定[60];又如注意力机制、LSTM模型用于基于实时负荷、历史电价、日期类型、天气等非文本特征的未来电价预测[61]。

图3 NLP联系密切的其他领域一览图

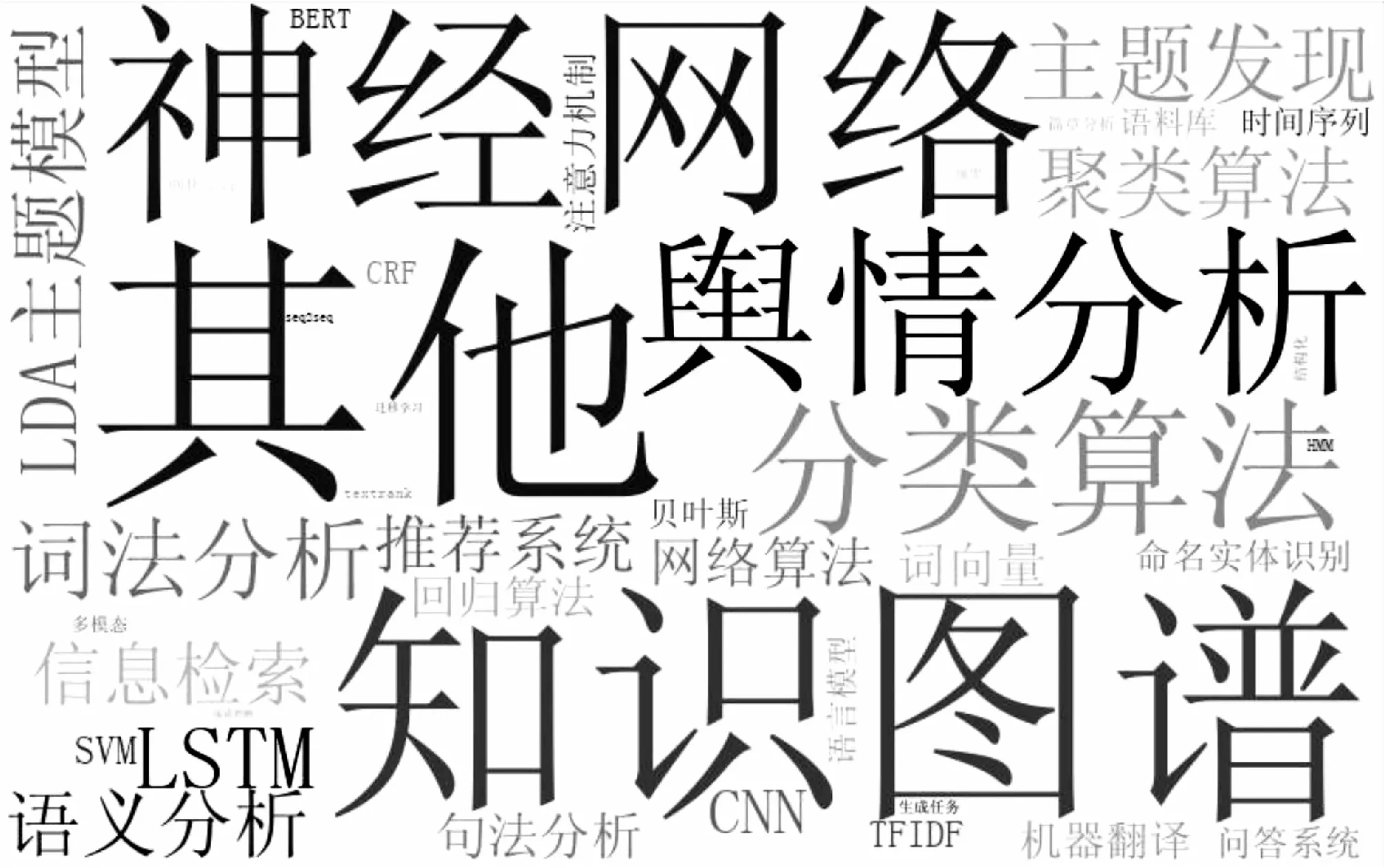

4.3“NLP-others”论文主题数据集的统计与多标签分类“NLP-others”论文主题数据集标注工作完成后,我们统计了NLP主题标签的数量,依据频次绘制了如图4的词云,它反映了NLP的数据资源、模型算法、关键任务、应用系统被其他学科领域提及或应用的频繁程度。

图4 NLP主题在其他学科领域提及/应用的频繁程度

由图4可以看出,知识库与知识图谱(占比约9.71%)、神经网络(占比约9.23%)、舆情分析(占比约9.16%)是在其他学科领域广泛提及或应用的NLP知识的前3位。而篇章分析、阅读理解、自然语言生成、多模态信息处理等目前仍然是富有挑战的NLP任务,还有较大的发展空间,因此这些主题在其他领域还较少被提及或应用。在具体模型算法上,擅长序列分析的LSTM相关模型、擅长序列标注的CRF模型、擅长主题挖掘的LDA相关模型、擅长分类的SVM模型在其他领域应用较为广泛。此外,近年来兴起的预训练语言模型BERT也迅速被与NLP相关的其他领域所应用。

为了预测未来产生的NLP相关论文的主题,发挥“NLP-others”的主题识别作用,实现知识扩散的精细化探测。我们在“NLP-others”数据集上进行多标签分类。我们选取了label数量最高的前30个label作为多标签分类的标签,其余低频的label均转变为“其他”label。

文本多标签分类(Multi-label classification)意味着给每个文本分配一个或多个label。例如一篇文献同时论述了词向量与语言模型相关的内容,那么它至少应标记表2中“词向量”、“语言模型”两个label。在样本量较少的情况下,它至今仍是一个充满挑战的NLP任务[62]。对于多标签分类,目前的常用方法是通过一定手段,将其转化成单标签分类的任务。手段包括二元关联(Binary Relevance)、分类器链(Classifier Chains)、标签子集(Label Powerset)[63]。

二元关联是最简易的方法,对于总计N个标签的多标签分类任务,它将训练集中所有属于类别i的数据标记为正类,包括多标签的情况,而不属于类别i的数据标记为负类别,以此构建N个二元分类器。分类器链则在二元关联的基础上,考虑了标签之间的相关性:首个二元分类器只在输入数据上进行训练,之后的分类器则在训练数据和所有之前的分类器上进行训练。标签子集则将数据集中每个多标签的组合情况,都转换为一个单独的类别。从而将原任务转化成单标签的多类分类任务。

我们对所有的文本均按字切分,使用单字、2-gram、3-gram与TF-IDF特征,并把每个label的名称在文本中的出现次数作为补充特征。我们选用支持向量机(SVM)与逻辑回归(Logistic Regression,LR)作为分类器。按9∶1的比例划分训练集与测试集,进行10折交叉验证(10-fold Cross-validation)。在测试集上计算每个样本的每个真实label的准确率、召回率与F1值,如表5所示。

表5 “NLP-others”数据集的多标签分类实验结果

如表5所示,SVM分类器显著优于逻辑回归。另外Label Powerset的多标签分类策略,略优于Binary Relevance与Classifier Chains,这是因为Label Powerset方法把问题转化成单标签多类的分类任务,比起另外两者“一对多”的二元分类,类别间数据不平衡问题有所缓解。30类多标签分类的F1值最优达到76.60%。这证明对于NLP与其他学科交叉研究的文献,“NLP-others”数据集可以成为预测它们论文主题的基础性资源。

5 结 语

该文依据《中图法》文献分类号与文献之间的引证关系,从CNKI数据库采集了3 535篇NLP典型与非典型文献。提出了4层级的NLP知识分类体系,并据此构建了NLP论文主题识别数据集“NLP-others”。实验发现自然语言处理在图书馆学情报学、传播学、企业营销与市场、电化教学、医学信息学、军事学、行政管理、英语翻译、地理信息系统、电力系统等领域均有着广泛的影响。学科领域交叉的态势显著。知识库与知识图谱、神经网络、舆情分析等NLP技术在其他学科领域被广泛提及或应用。而篇章分析、阅读理解、自然语言生成等技术在其他领域的应用发展还有较大潜力。我们在“NLP-others”数据集上进行30类的论文多标签分类,基于Label Powerset方法的SVM分类器取得了当前最好效果,F1值达到76.60%。实验证明,该文提出的NLP主题分类体系,与构建的数据集“NLP-others”能为未来相关论文主题识别、NLP跨学科研究提供有力支撑。当未来在其他领域出现了引用NLP典型论文的文献时,我们不仅可以根据引证关系,将其识别为受NLP影响的文献,而且可以利用“NLP-others”数据集与多标签分类算法,识别出NLP的哪些具体的数据资源、模型算法、关键任务、应用系统对该领域文献产生了影响。实现知识扩散路径的精细化探测。

由于与NLP相关的外文文献大都未标注《中图法》分类号,本研究的数据采集范围限于CNKI数据库的中文文献。在未来的研究中,我们将基于外文NLP文献数据,探索自然语言处理在其他领域的知识扩散情况。