用于弹载线阵红外与激光扫描成像引信的轻量化卷积神经网络目标识别方法

2021-10-08武军安刘荣忠柯尊贵

武军安,郭 锐,刘荣忠,柯尊贵

(1.南京理工大学 智能弹药技术国防重点学科实验室,江苏 南京 210094;2.西南技术物理研究所,四川 成都 610041)

末敏弹是一种将复合探测、稳态扫描与爆炸成形弹丸技术应用于子母弹的灵巧化弹药,其中的复合探测技术是其核心技术。纵观国内外已装备的末敏弹,主要以点元红外敏感器、主动毫米波雷达和被动毫米波辐射计作为探测器,并将几种探测器进行组合实现复合探测体制。探测信号大多是以一维的数据形式对扫描区域进行描述,对目标的细节特征描述有限[1]。然而随着现代战场环境的复杂化以及干扰、隐身等对抗技术的发展,基于点元探测器的末敏弹越来越难以满足现代战场环境下的作战要求。因此需要对扫描区域进行更为精细化的成像式探测来提高末敏弹在复杂战场环境下的适应能力。线阵红外与激光雷达探测器是将像元以线列形式排列的探测器,成像需要结合扫描运动才能实现。而末敏弹工作时恰好做螺旋稳态扫描运动,因此利用线阵探测器可以很容易地实现对地面目标的扫描成像,将二者进行复合式探测既能获取较高分辨率的红外辐射信息,也能获取对目标三维几何描述的距离信息,对末敏弹的目标判断和场景分析提供了更加全面、完整和丰富的特征信息[2-3]。

基于卷积神经网络(convolutional neural network,CNN)的识别算法避免了传统识别算法中复杂的目标分割、特征提取等过程,是一种将原图像直接作为输入的端到端的识别模型。2015年HE等[4]提出的ResNet在ImageNet数据集上的分类误差降低到了3.57%,其性能已经远远超过传统特征提取的识别算法,由此可见CNN对复杂环境下的目标识别具有明显优势,这也为末敏弹在复杂环境下的目标识别提供了新的研究方向。CNN强大的图像特征提取能力使其在目标识别领域得到了广泛的运用,一些学者已经将CNN运用在异源图像的目标识别任务中。刘峰等[5]在AlexNet基础上提出了一种CNN融合识别模型,先利用CNN对三波段的可见光图像、长波红外图像和短波红外图像分别进行特征提取,然后采用基于互信息特征选择的方法对特征量进行压缩,最后再利用全连接层完成了海上目标分类任务。Gao等[6]同样利用AlexNet将可见光图像与激光雷达上采样后的距离图像拼接构成4通道的RGB-D数据,实现了车辆目标分类识别任务。江泽涛等[7]对可将光图像与红外图像利用加权融合规则进行融合,将融合后的图像作为CNN的输入,实现了对不同场景的识别,经实验验证,融合后的图像比单独使用源图像的识别准确率更高。

虽然利用CNN对异源图像进行目标识别取得了较好的效果,但对红外像和距离像上的研究较少,同时还需满足弹载对实时性的要求对CNN网络需要轻量化设计,来减少模型量计算量。因此,本文根据弹载应用场景以及距离像和红外像的成像特点,提出了一种分布式融合轻量级卷积神经网络(distributed fusion convolutional neural net,DF-Net),通过图像融合、分布式卷积和深度可分离卷积实现了CNN的轻量化设计,并利用缩比场景的自建数据集对本文所提方法及网络结构进行实验分析与讨论。

1 末敏弹线阵扫描成像模型

弹载线阵探测器的扫描成像是借助末敏弹的稳态旋转扫描运动来实现的,其成像示意图如图1所示。图中,β为末敏弹的扫描角;γ为线阵探测器俯仰方向上的视场角,线阵红外与线阵激光的视场角相同并且被像元等分;τ为转动角,即子弹在一段时间内绕回转轴转过的角度;ρi为视场中线阵探测器第i个像元光路与铅锤方向的夹角。

图1 线阵扫描成像模型示意图

为了保证两幅图像的配准,红外与激光接收端为同视场,并且在同一时刻采集。线阵激光雷达通过计算每个像元的激光发射与接收回波之间的时间差来实现测距,设APD的像元数量为M,当扫描线转过τ时会在地面形成一个局部扫描区域Ω,区域Ω由N次扫描的扫描线数据构成,将扫描线数据按先后顺序进行拼接可获得一个大小为M×N的二维距离矩阵D′:

D′=(dij)M×N

(1)

式中:i=1,2,…,M;j=1,2,…,N。线阵红外探测器则直接通过接收热辐射得到红外辐射灰度信息R:

R=(rij)M×N

(2)

式中:dij和rij分别为第i个激光与红外像元在第j次采样时测得的距离值和红外强度值。

由于获得的红外数据R本身就是8 bit量化后的灰度值,因此R可直接作为红外图像。而对于扫描得到的距离数据则需要进行一步处理。首先将距离数据转换为激光脚点与子弹的相对高度数据H′:

H′=D′cosρi

(3)

然后选择合适的量化区间S,对H′进行8 bit量化即可作为本文CNN与图像融合算法所需的距离灰度像D:

(4)

式中:“[·]”表示取整,hmax为H′中的最大值,h′ij为H′中的元素。

2 分布式-融合轻量化卷积神经网络算法模型

2.1 基于导向滤波的红外像与距离像融合算法

在本文中将融合图像作为前级卷积神经网络的输入数据,目的是增加输入特征的多样性,提高轻量化CNN对目标分类的准确率,因此对融合图像,希望能在充分反映互补特征的同时具有较低的算法复杂度,以满足弹载环境对实时性的要求。本文融合算法的具体过程如下。

①源图像分解。

首先通过高斯滤波对图像进行平滑处理得到图像的低频分量LD和LR:

LD=D*g,LR=R*g

(5)

式中:g为高斯平滑核;“*”表示卷积。高斯核参数的选取应保证尽可能滤除细节特征。获得图像的低频分量后得到高频分量HD和HR:

HD=D-LD,HR=R-LR

(6)

对于小尺寸、纹理特征不丰富的图像经一次低通滤波就可以得到很平滑的低频图像,因此本文对源图像只进行了一次分解。

②低频融合系数的构建。

图像的低频子图保留了原图像的近似特征,对于本文的低频子图而言,由于只进行了一次非降采样的分解,直接使用平均融合容易导致图像边缘模糊、对比度降低,因此对低频融合系数进行如下处理:首先建立2个与源图像尺寸一致且系数均为0.5的初始融合系数矩阵mR和mD;然后将源图像作为引导图对初始系数进行导向滤波,即:

(7)

(8)

根据导向滤波的特性可知[12],若图像中某一区域的局部方差较小,则认为处于引导图像的平坦区域,此时滤波器的输出即为相邻像素的平均值;若局部方差较大,此时只有一边的权重会被平均,从而保证了边缘不被模糊,因此初始权重经导向滤波后保证了空间上的连续性。

③高频融合系数的构建。

在高频子图中主要包含了场景中边缘特征、目标纹理特征、边界变化特征等灰度值变化较为强烈的区域,为了在融合图像中更好地体现上述特征,对于高频分量通常选用“绝对值取大”的方法进行融合,首先构建初始融合权重CR,CD:

(9)

CD=1-CR

(10)

同理,为了让融合权重具有空间连续性,与低频分量处理一样,使用导向滤波对初始权重进行处理,即:

(11)

经归一化后得到高频融合系数:

(12)

④重建融合图像。

利用②和③获得的融合系数分别对高频子图和低频子图进行加权求和,则融合后的高频图HF和低频图LF分别为

(13)

式中:“·”表示矩阵元素点积运算。最终的融合图像F只需将融合高频图HF和融合低频图LF相加即可获得,即:

F=HF+LF

(14)

2.2 分布式-融合卷积神经网络结构

本文设计的DF-Net网络框架从整体上将网络分为:前级的分布式特征提取网络和后级融合网络。在前级网络中,距离像、红外像以及融合像各自拥有独立的卷积网络,同时卷积操作并未使用传统卷积加池化下采样或者直接利用深度可分离卷积进行提取,而是由2组步长为2步长(s=2)的3×3卷积(3×3 Conv)和1×1卷积(1×1 Conv)构成。这种方式虽然比深度可分离卷积的计算量大,但学习特征能力更强;与传统卷积加池化下采样的方式相比,省去池化操作(Pool)的同时进一步降低网络的计算复杂度。图2是以上3种结构的实现方式,设输入特征图为M×N×Cin,输出特征图均为(M/2)×(N/2)×2Cin,图中N1为本文卷积结构,N2为深度可分离卷积结构,N3为带有池化下采样的卷积结构,所有网络均使用了批次归一化层(batch normalizing,BN)[11],表1为3种网络结构的计算量和参数量,表中,Cin为输入的通道数,P为输入图像大小。通过表1中计算量与参数量的对比,本文结构虽然比N2结构计算复杂度高,但相比N3的传统结构计算量下降了约79.6%,参数量下降了37.5%。

表1 不同卷积结构计算复杂度对比

图2 3种结构的实现方式

网络的后级则是对上述特征量进行融合、提取与压缩,并最终给出分类结果。对前级的特征融合,利用双尺度卷积核进行融合,首先对3个通道的特征图进行首尾拼接;然后利用3×3卷积核和1×1卷积核分别对拼接后的特征图进行卷积以实现特征间的融合。最后再将卷积后的特征图进行拼接并送入后续卷积层中。对融合后的特征图利用深度可分离卷积模块进行卷积,根据文献[11]指出的深层特征对网络性能的贡献高于浅层网络特征,因此在融合卷积层后面又增加了多组深度可分离卷积模块来提高网络对特征的学习能力。表2给出了本文DF-Net网络具体的结构设计参数,输入的距离像、红外像以及融合图像先经13层CNN卷积得到4×4×528的特征图,最后利用全局平均池化将特征图变为1×528的一维特征向量,并与输出分类数量一致的神经元构成全连接层,并利用SoftMax层得到每种类别的分类概率。网络在每个卷积层和激活层之间增加了批次归一化层,用于加快网络的训练收敛速度和防止过拟合的发生。每个卷积层之间选用RL6作为网络的激活函数,即:

RL6=min(max(0,x),6)

(15)

表2中,C表示普通卷积;GC表示可分离卷积;B表示批次归一化操作;RL6为ReLU6激活函数层,No为最终的分类数。

表2 DF-Net 网络设计参数及计算复杂度

3 实验与结果分析

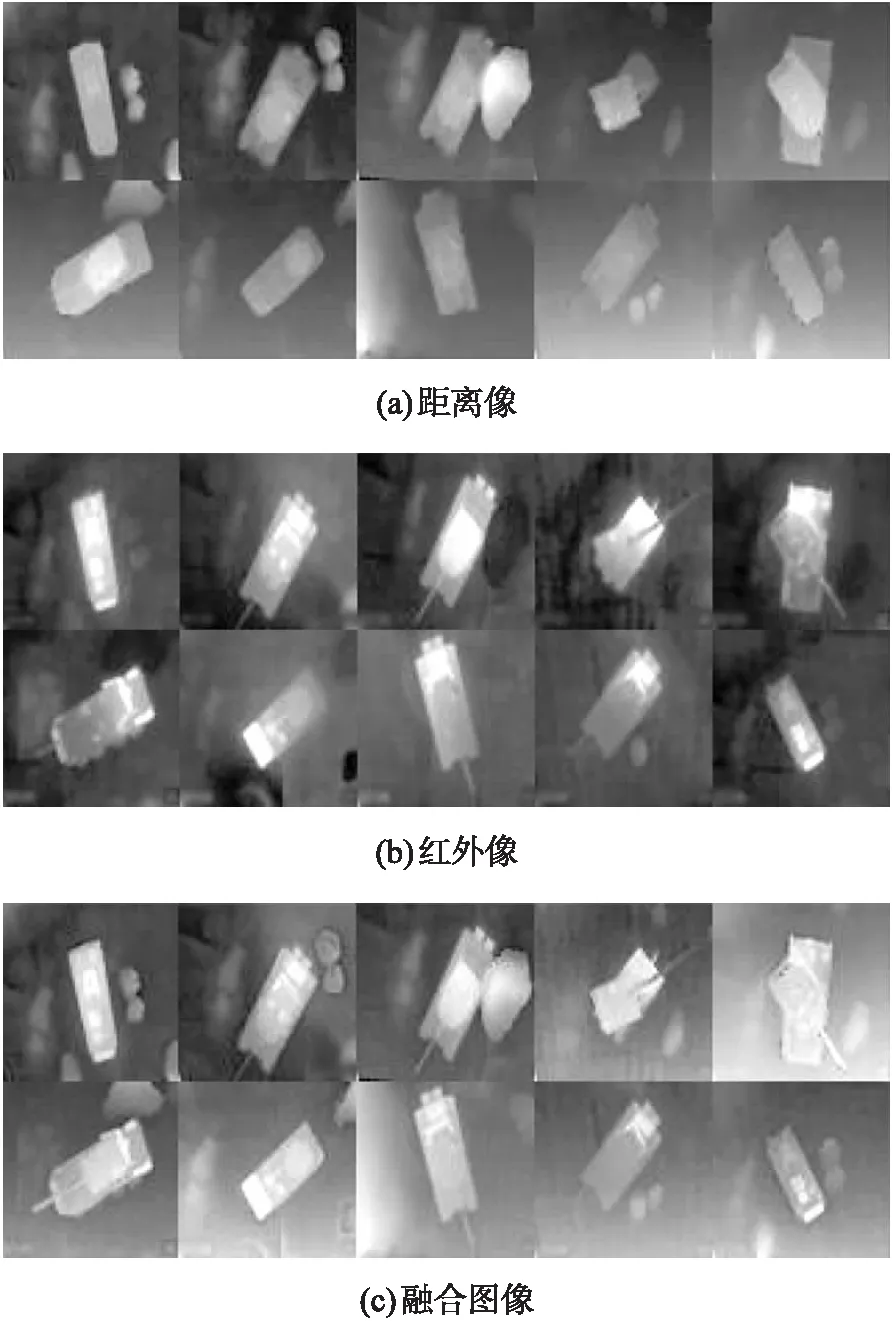

实验所用数据集通过实验室搭建的缩比实验平台获得。在模拟场景搭建时考虑了装甲目标在真实战场环境下的工作情况,为了让数据更加真实,模拟了在不同坡度、不同地形、不同高度、目标存在局部遮挡以及目标周围存在障碍物情况下的实验场景。装甲目标选取了主战坦克、装甲运兵车、自行火炮等多种模拟目标,目标缩比比例为1∶24(平均长、宽、高分别约为36 cm,13 cm,10 cm),探测器最大探测高度3 m,同时为了模拟红外特征在装甲目标发热处内部设计了电子恒温加热装置,保证与地面温差大于10 ℃。样本的获取首先利用缩比模拟场景共获取4 000组样本,样本中图像大小为64×64,然后利用翻转、平移、旋转和随机裁剪等方法对样本进行增广,最后将样本数据分为4类装甲目标(坦克目标、运兵车目标、自行火炮和导弹车,每类各11 000)和非装甲目标(由不含装甲目标的背景构成共44 000)。对装甲目标样本进行分类后,CNN网络不仅可以建立目标识别的二分类网络(装甲目标44 000和非装甲目标40 000),也可建立目标分类的五分类网络(4类装甲目标各11 000个,非装甲目标从40 000中随机抽取11 000作为样本),从而验证网络对装甲目标分类判别的能力。在数据集划分上,选取总数据集的80%作为训练集,剩下的20%作为测试集,分别用于网络的训练和测试阶段。图3为数据集中部分样本示例,数据集中包含装甲目标的部分红外图像、距离图像和融合图像。

图3 数据集中部分样本示例

在实验中所有网络均采用了带动量的小批量随机梯度下降算法作为网络模型训练的优化算法,训练一次的样本量(Batch size)根据GPU内存容量设置为100,为了保证网络训练的稳定收敛,学习率的调整策略选用阶梯式(STEP)策略,设初始学习率α0=0.01,每经过一次阶跃步长k新的学习率α衰减为

α=α0×ω⎣t/k」

(16)

式中:ω为衰减系数;“⎣·」”为向上取整符号;t为当前迭代训练次数。在本文中k=10 000,ω=0.1,即网络每进行10 000次的迭代训练,学习率衰减为原来的10%,总迭代次数为50 000次。实验在PC机上进行,主要配置如下:CPU Intel I7-8700k,GPU NVIDIA GeForce GTX1080Ti(显存8G),内存 DDR4 16G,网络模型在Caffe开源架构上进行训练与测试,操作系统运行环境为Ubuntu 16.04。

实验结果如下:

①不同网络结构对性能的影响。 将本文网络与流行的轻量化网络Mobilenet128[10]以及将DF-Net中前级分布式卷积改为N3结构的DF-Net(2)进行了性能对比,结果如表3所示,可以看出:虽然DF-Net准确率较Mobilenet128降低了1.3%,但计算量仅为Mobilenet128的12%;对本文图像,前级网络使用深度可分离卷积不利于网络对特征的学习,以N1和N3作为网络前级效果较好,二者性能相当,在准确率上只高了0.3%,但从计算量和参数量上来看N1结构更具有优势。

表3 测试集准确率与计算量对比

②融合图像对网络性能的影响。 当删除融合图像时网络在测试集上的准确率为94%,下降了2.1%,可以看出,引入融合图像可以提高网络对特征的提取能力。

③DF-Net在复杂环境下的网络性能。 利用模拟场景采集背景环境较为复杂的距离图像和红外图像样本,并利用样本增强方法将数据扩充到400组(包含4类装甲目标的样本每类50组,其余为不含装甲目标的样本),来验证网络模型的泛化能力以及对复杂背景环境下的目标识别能力,并用混淆矩阵对性能进行评估。图4(a)是五分类预测的混淆矩阵(TANK坦克,APC运兵车,SPG自行火炮,MV导弹车),图4(b)是二分类混淆矩阵(T装甲目标,N无目标),混淆矩阵中纵坐标表示真实样本分类,横坐标表示预测样本分类,矩阵中数字均为百分比。

图4 DF-Net网络模型目标分类混淆矩阵

从混淆矩阵可以看出,五分类的总体准确率为86.8%,二分类为90.5%,相比之前在测试集上的实验结果有所降低,但总体上看,DF-Net模型依然具有较强的目标识别和分类能力。在图4(a)中可以发现,五分类任务的准确率要低于二分类任务,而且在对4类装甲进行预测时均出现了少部分目标被误判为非目标的情况,同时装甲运兵车(APC)和反坦克导弹车(MV)之间还出现了一定程度的混淆。出现上述情况主要有以下两方面原因:①实验环境的局限使得训练样本无法包括所有可能性,导致模型训练不够充分;②不同类装甲目标的车身主体存在相似的情况(例如装甲运兵车和反坦克导弹车),当只扫描到目标局部或者目标遮挡较为严重时,模型无法得到准确的判定信息从而造成分类混淆,或者探测高度较高时目标在低分辨的图像上特征丢失严重也可能造成分类混淆。

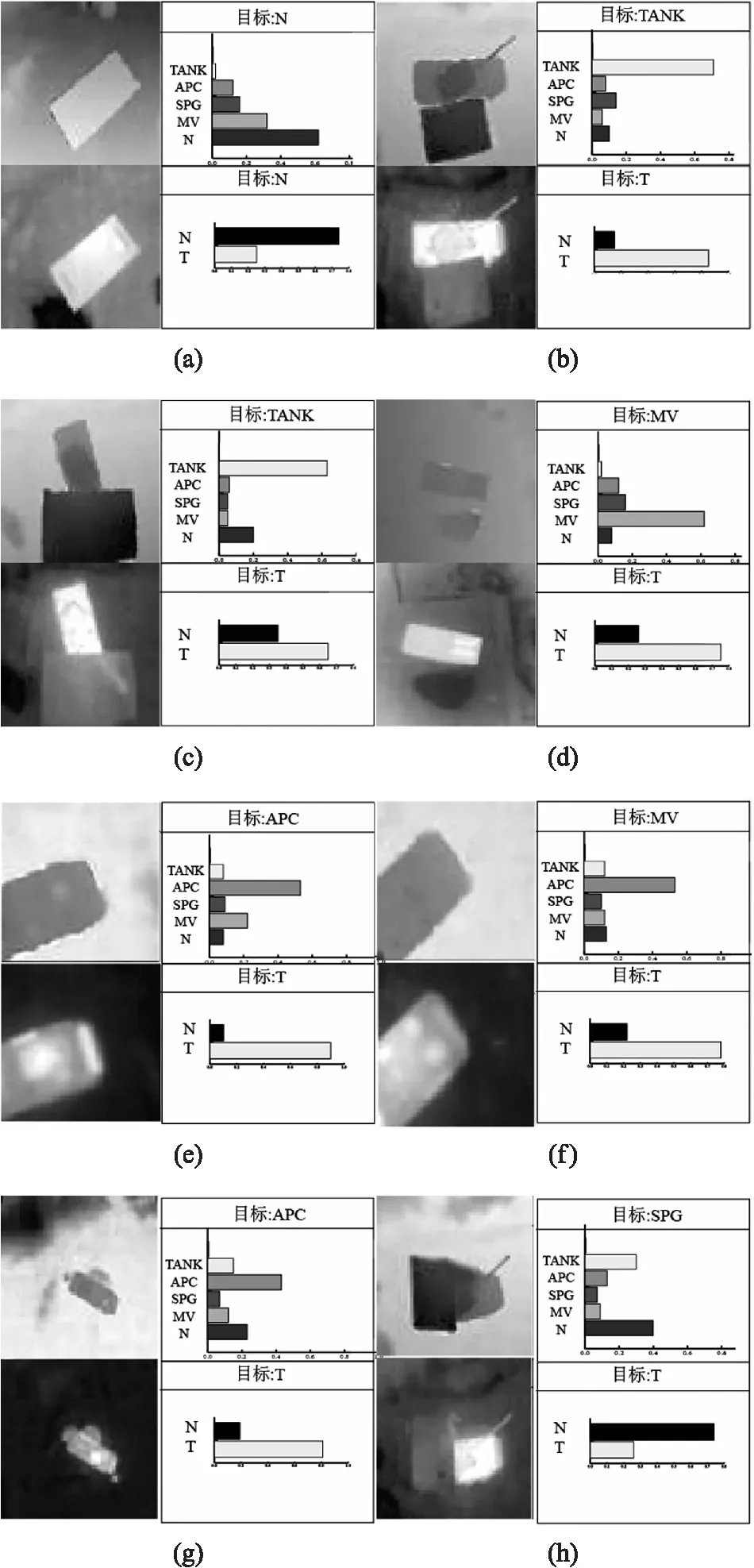

图5是从数据集中选取的8组实验样本并利用DF-Net分别进行2分类和5分类的结果,图5(a)为假目标样本,图5(b)~图5(d)为目标四周有障碍物或者局部遮挡的情况,图5(e)、图5(f)为目标局部扫描样本,图5(g)为在高处探测时目标四周有大量干扰的样本,图5(h)为目标超过50%被遮挡的样本。

图5 部分样本识别结果

从实验结果上可以看出:网络在样本a~e中均准确识别出了目标,样本a是长宽高与装甲目标相似的矩形伪目标,由于在训练样本中加入了此类伪目标,因而未产生虚警,样本b~d是目标周围有障碍物或者存在局部遮挡的情况,此时网络也做出了正确识别;样本e和f是车体相似的两类不同的目标,由于是局部图像,两个目标的特征较为相似,因此在五分类任务中将反坦克导弹车错误分类成了运兵车,但是在二分类的装甲目标识别任务中被准确分类;对样本e进行分类时,虽然此时目标在视场中比例较小,周围还存在热源与障碍物干扰,但DF-Net依然给出了正确分类;对于样本h,由于此时目标被大面积遮挡,其特征不能被充分描述,从而导致目标分类错误。

4 结束语

本文为了提高末敏弹在复杂背景环境下对装甲目标的识别能力,利用CNN在图像处理上的优势,提出了一种适用于低分辨距离像和红外图像的融合-分布式轻量化卷积神经网络模型DF-Net。通过实验表明:

①融合图像的引入可以提高网络对特征的提取能力,在相同网络层数下能够获得更好的识别精度,对于低分辨的红外图像和距离像应尽可能选取计算量小、更好保留边缘纹理特征的算法来提高系统的实时性;

②DF-Net通过前级N1结构的分布式卷积处理和后级的深度可分离卷积,让网络具有更少计算量,同时也具有优异的目标识别性能;

③CNN具有强大的特征提取能力,因此本文方法适用于背景环境复杂以及对抗环境干扰要求较高的战场环境。