基于深度边缘特征的轨道扣件状态检测方法

2021-05-09郑丹阳李立明孙睿柴晓冬郑树彬罗文成

郑丹阳 李立明 孙睿 柴晓冬 郑树彬 罗文成

(1.上海工程技术大学城市轨道交通学院,上海 201620;2.常州路航轨道交通科技有限公司,江苏常州 213100)

线路上的扣件状态检测主要通过人工巡检来完成。人工巡检的方式具有简单、低成本等优势,但存在检测效率低、漏检率高等缺陷。近年来,随着自动化巡检需求的不断提升,国内外许多学者对利用机器视觉技术实现轨道扣件状态检测的方法进行了研究。目前主要的扣件状态检测方法都是利用传统的图像处理方法对扣件螺栓或弹条的特征进行识别检测。李永波等[1]通过设置扣件图像的感兴趣区域(Region of Interest,ROI),提取ROI 区域的方向梯度直方图(Histogram of Oriented Gradient,HOG)特征进行状态检测。WANG等[2]通过使用二维主成分分析法提取扣件螺栓的特征进行分类。陈小艳等[3]提出利用改进的局部二值模式(Local Binary Pattern,LBP)编码算法突出扣件图像的边缘特征,再使用隐含狄利克雷分配(Latent Dirichlet Allocation,LDA)词包来描述扣件的主题进行状态检测。代先星等[4]提出通过可以减少自然光影响的激光测量法采集扣件图像的三维数据,再利用扣件图像的深度梯度特征(Height Gradient Orientation Histograms,HGOH)对扣件状态进行检测分类。也有学者对基于深度学习的扣件状态检测方法进行了研究,龙炎等[5]使用卷积神经网络(Convolutional Neural Network,CNN)提取扣件的浅层和深层特征,再根据扣件特征使用Faster-RCNN(Region Convolutional Neural Network)网络进行状态分类。Xavier 等[6]利用定制化的全卷积网络对扣件的高度抽象特征进行提取和扣件类型识别,针对不同类型扣件使用定制化的支持向量机进行状态分类。与传统的方法相比,采用深度学习技术的算法检测准确率较高,但通常需要使用定制化的扣件数据集对网络进行训练,对于不同类型的扣件网络通用性较差。

作为新一代轨道扣件产品,快速弹条扣件已经在国内外被广泛应用。与传统的轨道扣件不同,快速弹条扣件是一种开关型扣件,它的状态可以根据弹条形状和弹条所处的位置检测,而传统的轨道扣件检测方法对这一类扣件的状态检测效果并不理想。针对这一问题,本文提出了一种融合扣件图像深度边缘特征和HOG特征的状态检测方法,具体流程如图1所示。

图1 基于深度边缘特征的轨道扣件状态检测方法流程

1 深度边缘特征提取

1.1 传统扣件边缘检测方法

目前,轨道扣件的边缘特征主要利用Sobel,Canny等方法进行检测[7-8]。传统的检测方法使用简单、在某些场景下检测效果良好,但这类方法只考虑了图像梯度、纹理等低层特征,存在噪声敏感、阈值参数设置要求高等问题。近几年,采用卷积神经网络的边缘检测方法开始出现,卷积神经网络可以提取图像中高层的语义特征,在检测精度、抗噪能力等方面要明显好于传统的检测方法。因此,本文采用卷积神经网络模型来提取轨道扣件的边缘特征。

1.2 HED网络

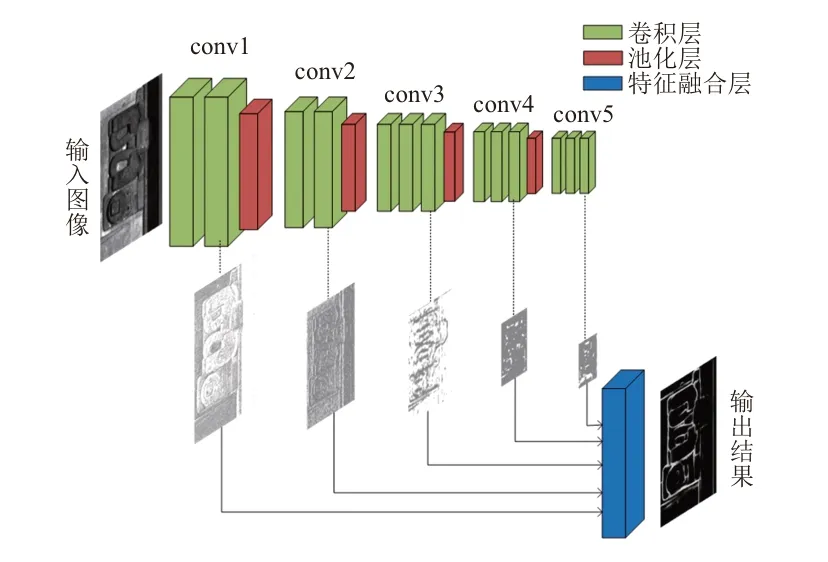

整体嵌套边缘检测(Holistically-Nested Edge Detection,HED)网络[9]是一种检测物体边缘特征的方法,由16 层的视觉几何组(Visual Geometry Group,VGG)网络改进而来,其网络结构如图2所示。

图2 HED网络结构

相较于VGG16 网络,HED 网络做了以下改进[10-12]:①去除了VGG16 网络conv5 的最后一个池化层以及之后的三个全连接层和Softmax 层。去除了这些结构可以使HED 网络输入图像的大小不必像VGG网络一样限制在224×224,而是实现了对任何大小图像的输入。②对conv1—conv5 的最后一个卷积层分别连接一个侧边输出层,这些输出层的感受野大小见表1。可知,HED 网络的输出是多尺度和多层级的,随着感受野尺寸的不断变大,侧边输出的图像尺寸不断减小,同时侧面输出图像的边缘特征信息不断丰富。然后将侧边输出图像进行反卷积,使各侧面输出层输出的图像尺寸一致,最后利用特征融合层将多尺度的边缘特征信息图像进行融合来预测图像的边缘。

表1 侧边输出层的感受野大小

HED 网络通过对各个侧面输出层同时训练将输出结果进行融合的方式,对网络训练的过程进行了简化,提升了训练速度。对于轨道扣件图像,只有10%的像素属于边缘区域,边缘区域和非边缘区域的像素占比差异巨大,会造成HED 网络使用常规的损失函数进行训练时出现模型不稳定的现象。为解决这个问题HED 网络对损失函数进行了修改。HED 网络共有5 个侧面输出层,每个侧面输出层均与一个分类器相连接,其中分类器的响应权重为w={w(1),...,w(5)}。网络最终的目标函数Lside(W,w)为

式中:W为所有网络参数的集合;lside为各个侧面输出层的损失函数;ak为各个侧面输出层的损失函数在全部损失函数中的占比。

网络引入平衡因子β来解决上文提到图像边缘区域和非边缘区域的像素数量差异巨大的问题,得到各侧面输出层的损失函数l(k)side(W,w(k)),即

式中:β为标签标注的非边缘像素|Z-|和总像素|Z|的比值,β= |Z-|/|Z|;1-β为边缘像素|Z+|和总像素|Z|的比值,1-β= |Z+|/|Z|;Pr(yj= 1|X;W,w(k))通过侧边输出的激活函数计算得到;X为原始输入图像的所有像素;yj为像素点j处对应的真值边缘映射,yj∈{0,1}。

为了使用侧面输出层对边缘进行预测,网络添加了一个特征融合层将各个侧面输出层的输出结果进行融合训练,特征融合层的损失函数Lfuse(W,w,h)为

式中:h为融合权重,h={h1,...,h5};D(Z,Z^fuse)为融合后标签的标注结果和预测结果之间的距离,Z^fuse=是侧面输出层的输出。

将侧面输出层的损失函数与权重融合层的损失函数利用梯度下降方法进行优化得到总体的损失函数L(W,w,h),即

1.3 深度边缘特征提取结果

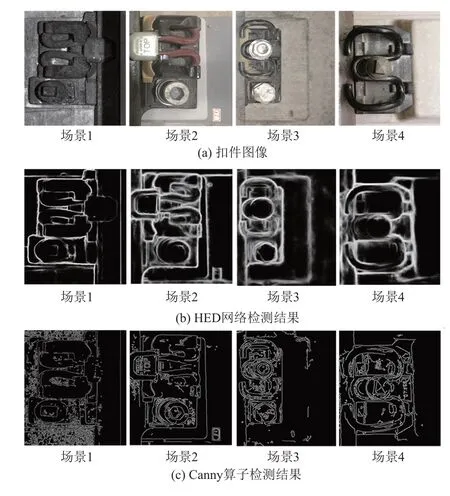

为了检验网络边缘特征提取的性能,本文采用与传统的Canny 算子进行比较,边缘特征提取结果见图3。图3(a)为4 种不同场景不同类型的轨道扣件图像,图3(b)为经过HED网络处理得到的深度边缘特征图像,图3(c)为经过图像平滑处理,再使用Canny算子提取到的边缘特征图像。

图3 不同场景不同类型的轨道扣件边缘特征提取结果

由图3 可知:①Canny 算子利用高斯滤波器进行图像平滑处理,再利用双阈值算法来检测图像边缘,对于对比度强的扣件图像可以完整地检测出扣件边缘。但是对于对比度低的现场扣件图像,Canny 算子难以实现完整检测,同时Canny 算子存在容易将噪声点误判为图像边缘信息的缺点,造成图像中出现许多虚假边缘。②HED 网络采用多尺度、多层级的方式进行学习,去噪声能力明显强于Canny算子,不但可以完整地检测出强边缘,而且可以完整地检测出许多弱边缘,对不同场景不同类型扣件图像的边缘信息均可以比较完整地检测出来,同时在低对比度的现场扣件图像中能较好地抑制背景噪声。

2 HOG特征提取

本文提出的基于深度边缘特征的扣件状态检测方法,首先将同步控制线阵相机采集到的轨道扣件图像利用HED 网络得到深度边缘特征图,然后对得到的深度边缘特征图进行HOG特征提取,最后把两者的融合特征作为特征描述算子输入到分类器中,对不同状态的扣件进行识别分类。

HOG 特征是一种描述图像中目标对象特征的方法[12-13]。它将图像划分成若干个细胞单元,通过计算每个细胞单元内的梯度方向信息并统计成直方图来构成特征。由于HOG 特征是将图像划分成更小的细胞单元进行操作,因此可以有效减少光源位置和拍摄角度的影响,从而提高扣件识别的准确率。

提取图像HOG特征的具体步骤为:

1)图像预处理。首先将扣件深度边缘特征图转化为灰度图,再利用Gamma校正法对灰度图进行标准化处理。这种预处理方式可以有效减少图像局部阴影和光照的影响。

2)计算图像梯度。在像素点(x,y)处利用(-1,0,1),(1,0,- 1)T算子计算出该点处x轴方向的梯度和y轴方向的梯度,进而计算出该点处梯度幅值G(x,y)和梯度方向α(x,y),分别为

式中:Gx(x,y),Gy(x,y)分别为输入图像中像素点(x,y)处的水平方向梯度和垂直方向梯度。

3)构建细胞单元的梯度直方图。先将图像均匀划分成若干个互不相交、大小为16×16个像素的细胞单元,然后根据步骤2)计算每个细胞单元的梯度幅值和梯度方向。再将细胞单元的梯度方向均匀划分成12 个区间,每个区间占30°。然后将细胞单元内的每个像素加权投影到所属的区间中,权重大小用梯度幅值来表示。最后用直方图来统计每个细胞单元内各个区间的梯度信息。

4)形成HOG特征。将细胞单元组成块,每个块内包含8×8个细胞单元。由于不同细胞单元之间梯度差异可能较大,所以在块内采用L1范数对方向梯度直方图进行归一化。最后利用窗口将所有块的HOG 特征进行整合作为该扣件图像的HOG特征。

将扣件深度边缘特征和HOG特征进行融合,不同状态扣件融合特征见图4。

图4 不同状态扣件及融合特征

3 扣件状态检测算法

采用的扣件状态检测算法是把扣件图像经过深度边缘特征提取和HOG 特征提取后的结果输入给支持向量机(Support Vector Machine,SVM)训练,将得到的模型作为分类器实现对轨道扣件状态的检测。

3.1 扣件状态判断标准

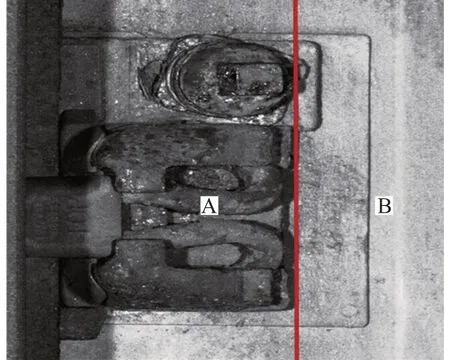

采用SFC 快速弹条扣件作为试验样本。与传统的螺栓型扣件不同,快速弹条扣件的状态可以根据弹条所处的位置进行判断。图5给出了SFC 快速弹条的常见状态,本文只针对扣件扣紧和扣件弹出这两种状态进行研究。根据现场人工巡检的经验值,将扣件区域划分成图6所示的两部分作为状态判断标准。当弹条完全处于区域A 时,认为扣件处于扣紧状态;当弹条出现在区域B时,认为扣件处于弹出状态。

图5 SFC快速弹条扣件常见状态

图6 扣件状态判定区域划分

3.2 SVM

SVM 是一类按监督学习方式对数据进行二元分类的线性分类器,在解决分类和识别等问题中有着广泛的应用。由于HOG 特征的维度较高,而SVM 可以避开高维空间的复杂性,利用核函数简化高维特征,同时在解决小样本问题上有较强的泛化能力,因此本文选用SVM作为分类器。

在构建SVM 模型对特征进行分类时,须要选择核函数和惩罚因子C。多数情况下,训练样本不是线性可分的,使用线性分类会造成大量样本分类错误,因此,须要利用核函数将原始的特征映射到更高维的特征空间中,使得样本可以被超平面分类。惩罚因子C为分类器对误差的容忍度,C值越大,对减少误差要求越高。C值的过大或过小都会降低分类的准确率,根据经验判断和大量试验对比,本文选用线性核作为核函数,惩罚因子C设置为1.2。

4 试验与分析

4.1 试验数据集

选用2500 张在石太(石家庄—太原)客运专线用线阵相机采集的轨道扣件图片作为数据集,包括2004张扣件扣紧图片和496张扣件弹出图片。将数据集划分成训练集和测试集。其中1000 张扣件图片作为训练集,其余1500张扣件图片作为测试集。

4.2 试验平台

本文试验在Win 10 环境下运行,硬件环境包括:NIVIDIA RTX 2080Ti 11GB 显 卡,Intel Xeon Silver 42142.2GHz 双CPU,64G 内存。基于深度学习的深度边缘特征提取网络在pytorch框架下完成。

4.3 试验评价指标

试验选用准确率(Accuracy)、精确率(Precision)和召回率(Recall)作为扣件状态检测算法的评价指标[14]。准确率A为被正确识别扣件占所有扣件的比例,精确率P为识别为扣紧状态的扣件中正确的个数占所有识别为扣紧状态扣件的比例,召回率R为识别为扣紧状态的扣件中正确的个数占所有扣紧状态扣件的比例。具体计算公式为

式中:TP为人工标注为扣紧状态的扣件被分类器正确识别的个数;TN为人工标注为弹出状态的扣件被分类器正确识别的个数;FP为人工标注为弹出状态的扣件被分类器错误识别的个数;FN为人工标注为扣紧状态的扣件被分类器错误识别的个数。

4.4 试验结果与分析

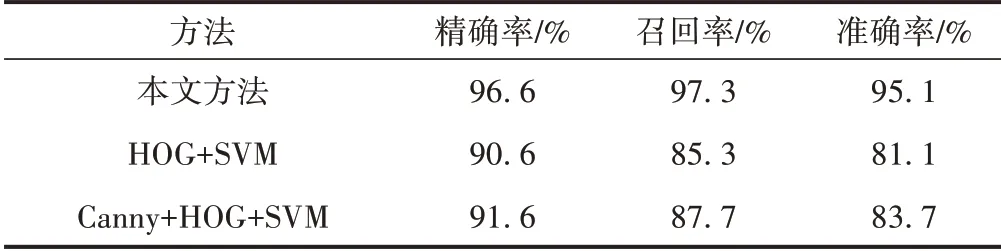

在相同的试验环境下,将本文方法与HOG+SVM、采用Canny 算子提取扣件边缘特征+HOG+SVM 的算法进行对比,结果见表2。

表2 不同算法试验结果

由表2 可知:使用Canny+HOG+SVM 的识别方法与传统HOG+SVM 识别方法相比在精确率、召回率和准确率上提高并不明显,而本文方法在这三项指标上均取得明显提高。这是因为使用HED 网络提取扣件的深度边缘特征可以有效减少背景噪声和无用特征对检测结果的影响。因此,本文方法有更高的识别准确性和更强的鲁棒性。

5 结语

本文提出了一种基于深度边缘特征的轨道扣件状态检测方法:利用深度学习网络提取扣件图像的深度边缘特征,再利用方向梯度直方图来描述深度边缘特征,将形成的融合特征输入给SVM 进行训练,最后利用训练好的SVM作为分类器对扣件状态进行检测。

本文方法的准确率、召回率、精确率分别达到95.1%,97.3%,96.6%,均高于其他检测方法,同时本文方法具有较强的鲁棒性,满足轨道扣件状态检测的要求。