多特征结合引导滤波的多聚焦图像融合*

2020-03-22胥小波

陈 蔓,胥小波

(中国电子科技集团 中国电子科技网络信息安全有限公司,四川 成都 610000)

0 引言

图像融合是将多幅源图像中的互补信息结合到一起,合成一幅包含所有互补信息的过程。图像融合被广泛地应用到了各个领域,如数码成像[1]、遥感图像[2]、视频监控以及医学诊断等[3]。多聚焦图像融合是图像融合领域的一个重要分支,通过设置光学镜头的焦距,CCD 图像传感器得到的图像中只有景深(Depth of Field,DoF)范围内的物体呈清晰状态,其他物体则呈模糊状态,该图像也称为多聚焦图像。因此,需通过多聚焦图像融合算法提取所有多聚焦图像中的清晰信息,合成一幅完全聚焦的图像,进一步用于图像识别等领域。图像融合领域已提出了大量算法,大致可分为两类:一是基于空间域的算法,二是基于变换域的算法。基于空间域的算法主要使用像素或图像块的梯度类信息进行清晰度评价,如Guo 等[4]利用图像的自相似和深度信息进行图像融合,Li 等[5]提出使用区域分割和空间频率特征的图像融合,De 等[6]提出基于q-d 树的图像融合,Li 等[7]提出引入引导滤波优化决策系数的图像融合等。随着深度学习的不断发展,基于卷积神经网络的特征也应用到了图像融合[8-9]。基于空间域的算法空间结构保持较好,但细节保留不足,虽卷积神经网络特征使融合效果有明显提升,但仅限于两幅源图像,不适用于多幅源图像。而基于变换域的算法起源较早,且随着多尺度分解技术的不断发展,从早期Burt 等[10]提出的拉普拉斯金字塔图像融合和Jian 等[11]提出的基于小波变换的图像融合,到最近基于其他变换和表示的图像融合算法[12-14],图像融合的质量都有着持续提升。基于变换域的算法虽细节保持能力较好,但空间连续性较差。

本文提出一种多特征结合引导滤波的多聚焦图像融合算法。该算法包括以下几部分内容:(1)使用多清晰度评价特征,利用特征间的互补特性,克服单清晰度评价的局限性;(2)使用单个特征计算初始决策图之前,源图像作为引导图像进行引导滤波,提升清晰度评价结果的细节信息;(3)根据多特征的有效性,计算单个特征的置信图对融合结果进行加权;(4)对初始决策图再次使用源图像作为引导图像进行引导滤波,使决策边界更加平滑,进一步提升了空间连续性。实验结果表明,多特征结合引导滤波的图像融合算法在两幅或多幅图像融合结果的局部细节保留能力、空间结构保持以及空间连续性方面都取得了良好结果。

1 多特征

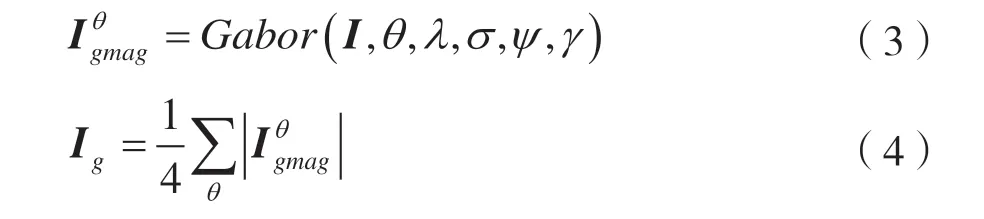

1.1 Gabor 特征

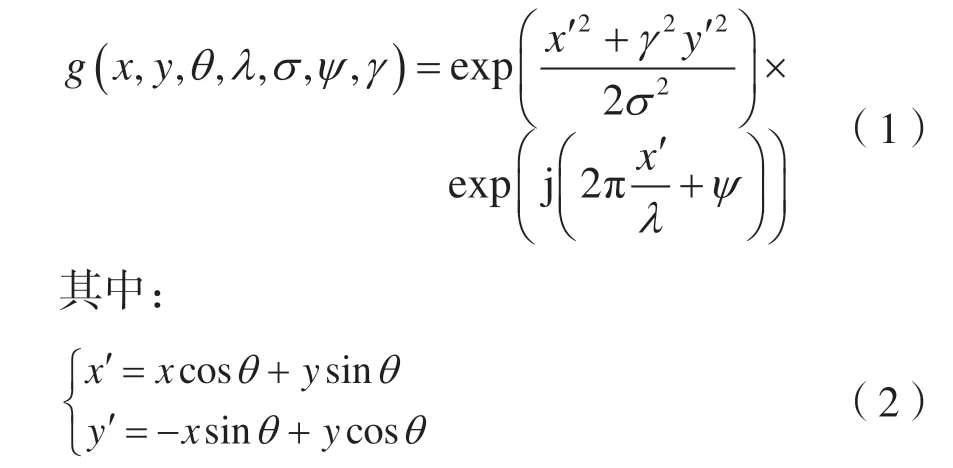

Gabor 滤波器[15]是一种由高斯包络调制的正弦函数,已经广泛应用于计算机视觉与图像处理领域,如图像识别、图像压缩、图像分割等。而二维Gabor 滤波器可同时获得空间域和频率域的局部信息,其一般形式为:

式中θ、λ分别为正弦波的方向和波长,σ为高斯包络的标准差,ψ为相位偏移,γ为空间横纵比。

本文取θ={0°,45°,90°,135°}4 个方向的Gabor 滤波器,见图1。然后提取源图像的Gabor 特征,即取4 个方向Gabor 滤波后的幅值绝对值之和的均值,公式如下:

式中I为源图像,为源图像I在θ方向的幅值,Ig为源图像I的最终Gabor 特征。

图1 4 个方向的Gabor 滤波器

1.2 改进的Laplacian 和特征

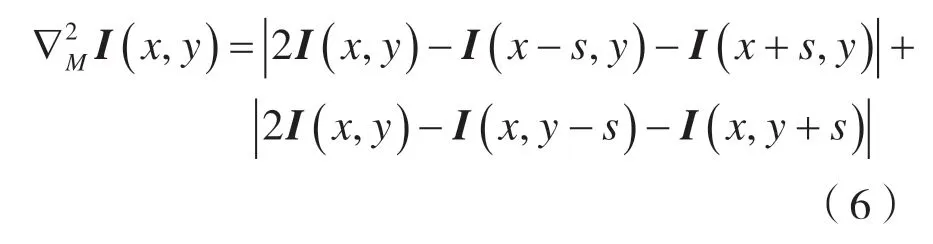

Laplacian 算子是n维空间中的二阶微分算子。若针对图像,则n=2,即求x、y方向的二阶微分。由于二阶微分在x和y方向上的符号可能相反且倾向于互相抵消,为克服这一问题,使用改进的Laplacian(Modified Laplacian,ML),公式如下:

式中s为步长,通常s=1。为了抑制单点特征的噪声,提升特征的鲁棒性,对局部窗口的ML 特征求和,得到改进的Laplacian 和(Sum of Modified Laplacian,SML),公式如下:

式中w(x,y)为以(x,y)为中心的窗口内像素点的集合,p、q为窗口内元素的下标。

1.3 密集SIFT 特征

传统的SIFT 算法包括特征检测和特征描述两个步骤,广泛应用在多类计算机视觉领域,如图像配准、目标识别等。具有旋转不变、尺度不变的SIFT 描述子是通过表征感兴趣的极值点周围的局部信息而生成。因此,只有感兴趣的点会计算SIFT描述子。SIFT 特征是图像的稀疏特征表示,不能直接用于图像融合。

密集SIFT[16]没有特征检测步骤,且局部特征描述子不再只针对感兴趣的点,而是对每一个像素点,具体描述如下。

对图像的每一个像素点,如取其48×48 的邻域,分割成4×4 的单元阵列,对每一个单元阵列计算8个方向的方向直方图,用于量化梯度信息,得到共4×4×8=128 维的特征向量。使用符号化表示为:

式中Idsift为源图像I的密集SIFT 特征,若I∈Rm×n,则Idsift∈Rm×n×128(本文使用128 维向量)。为与1.1 节和1.2 节特征维度保持一致,将Idsift沿第3 维求和,公式如下:

式中Id为最终的密集SIFT 特征,x、y、z分别为3 个方向的坐标。

2 本文算法

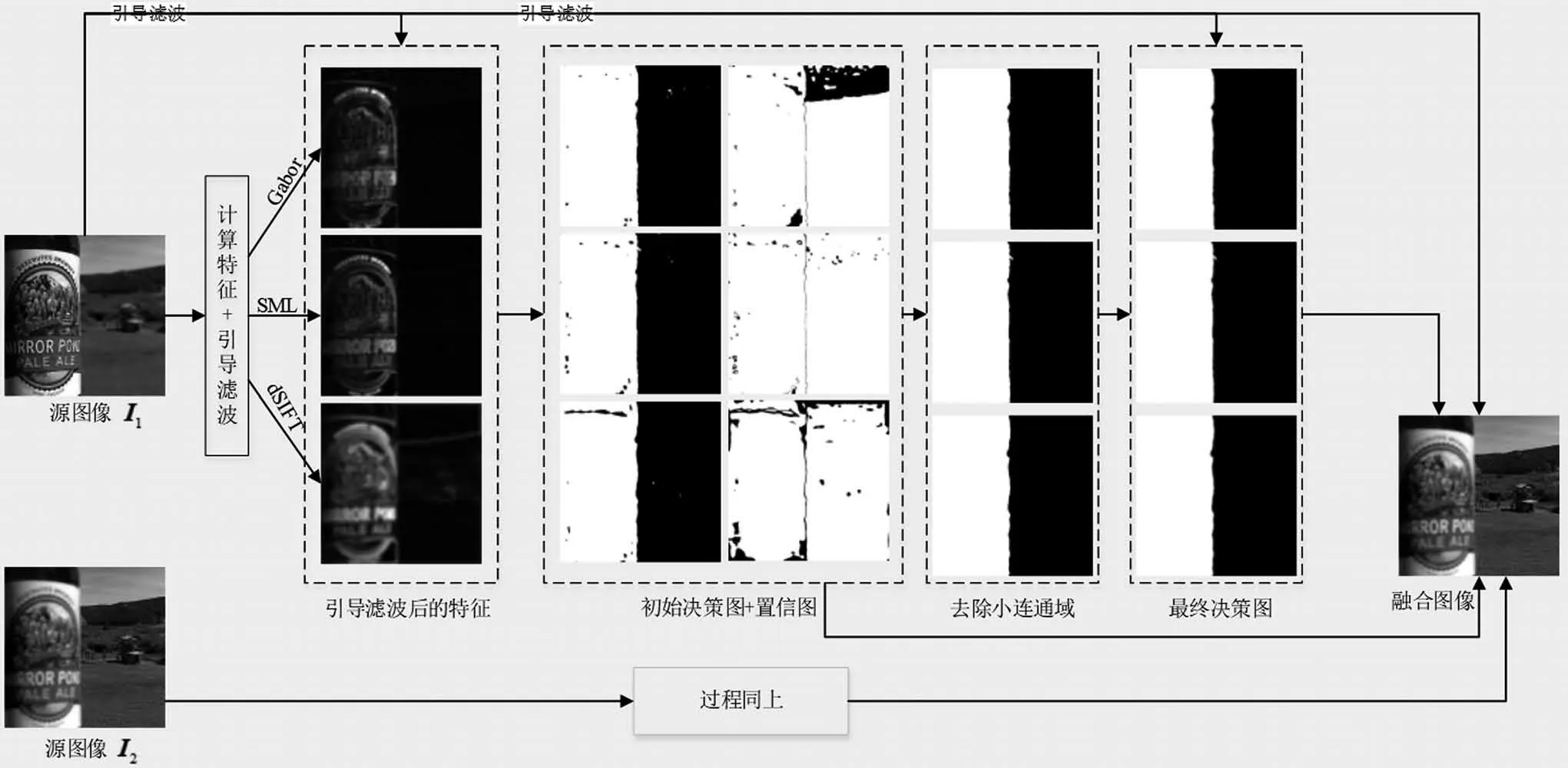

本文提出的多特征结合引导滤波的多聚图像融合算法主要包括5 个主要步骤。

2.1 计算源图像多个特征

本文算法使用3 类具有代表性的特征:(1)Gabor 特征,具有多尺度多方向性,其频率和方向与人类视觉系统(Human Visual System,HVS)相似,适合纹理的表示与判别;(2)Laplacian 和特征,根据文献[17]的结论,Laplacian 和特征能够较好地反映图像的清晰度;(3)密集SIFT 特征,能够较好地反映图像的局部特征。

源图像为Ii(i=0,2,…,N-1),其中N为源图像总数,设W、H分别为源图像的宽、高。计算源图像的3 类特征,分别得到,即:

式中I即Ii。

2.2 多特征引导滤波

由于引导图像的高频信息会转移到输出图像[1],因此可通过使用源图像作为引导图像对特征图进行引导滤波,使特征图获取更多的高频信息,效果见图2。引导滤波计算公式如下:

式中G为特征引导滤波的结果,x、y为图像像素的坐标,i为图像下标,t={1,2,3}为特征索引值,fr,ε为引导滤波函数,r为引导滤波窗口大小,ε为引导滤波的模糊度参数。

图2 SML 特征引导滤波结果

2.3 计算初始决策图和置信图

2.3.1 计算初始决策图

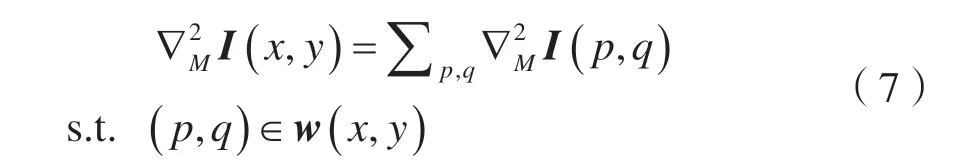

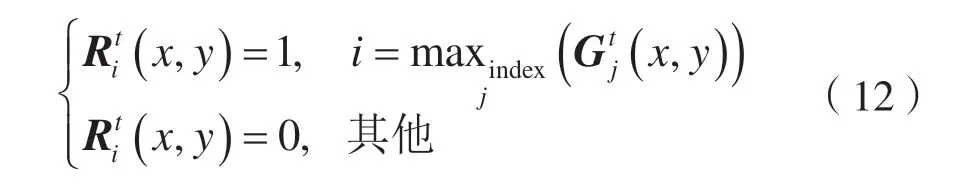

由于特征提取的是源图像的高频信息,能够反映图像的聚焦程度,因此若特征为沿图像序列方向的最大值,则对应的初始决策图位置置1,否则置0,计算公式如下:

式中R为初始决策图,maxindex为计算最大下标,j为图像下标。

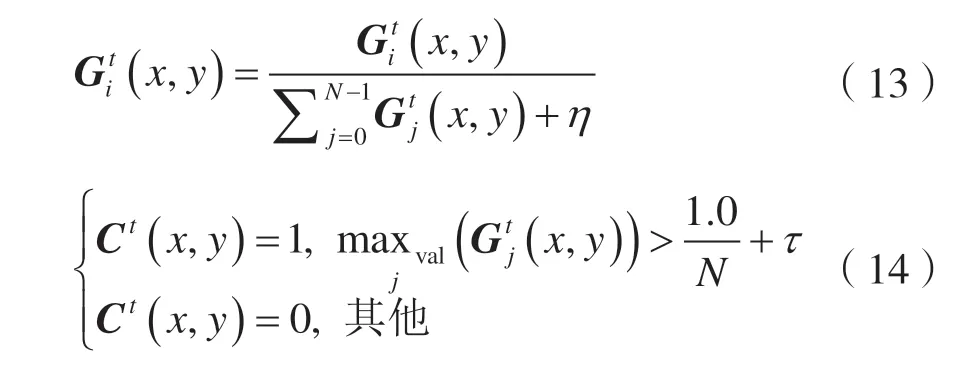

2.3.2 计算置信图

若特征在某位置沿图像序列方向的最大值与其他值的差距较大,则认为该特征在该位置进行清晰度评价是可靠的,对应位置的置信度取1,否则取0。由于涉及到多幅源图像融合,可转变为将特征值先沿图像序列方向进行比例归一化,再判断最大值比例与阈值大小,公式如下:

式中,C为对置信图;η为极小正值,防止分母为0;maxval为计算最大值;τ为均值往上浮动的阈值。

由于置信图的特性,会出现以下2 种情况。

(1)情况1:同一位置,3 类特征的置信度值存在至少一个1,取1 的特征求均值即可,公式如下:

式中tt为特征索引值。

(2)情况2:同一位置,3 类特征的置信值全部为0,直接取简单平均即可,即:

置信图说明见图3,由方框内容可见各特征间具有互补特性。

2.4 计算最终决策图

由于平坦位置的聚焦和离焦图像均不存在明显高频信息,导致初始决策图存在局部较小孤立连通区域。针对这种情况可采用形态学滤波的方法,去除面积小于阈值T的连通域。

为进一步平滑决策边界,增强融合图像的空间连续性,再次使用引导滤波,公式如下:

式中D为最终决策图。

图3 置信图的互补特性

2.5 融合规则

得到每类特征的决策图后,沿图像序列方向进行归一化,公式如下:

再使用置信图对归一化后的决策图加权,即:

最后将加权后的决策图与源图像对应相乘再相加即可,公式如下:

式中IF为最终融合图。

整个融合过程见图4。

3 实验及分析

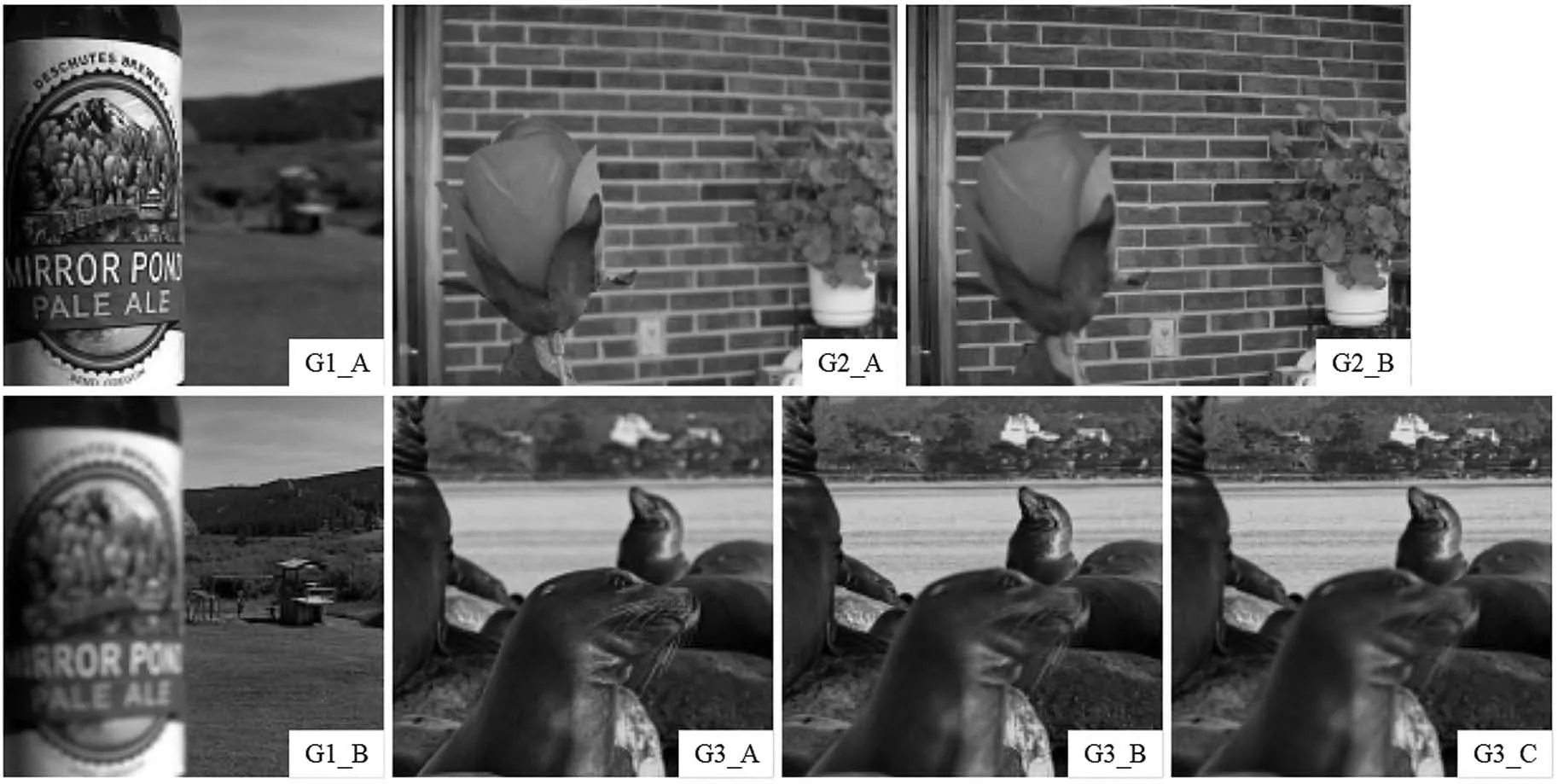

3.1 实验数据和相关设置

为验证提出算法的有效性,使用3 组实验数据,包括2 组2 幅源图像、1 组3 幅源图像,见图5。并与以下算法进行对比分析:基于引导滤波的图像融合[7](Image Fusion based on Guided Filtering,IF-GF)算法、基于非下采样轮廓波变换的图像融合[12](Image Fusion based on Non-Subsampled Contourlet Transform,IF-NSCT)算法、基于密集SIFT 的图像融合[16](Image Fusion based on Dense SIFT,IF-DSIFT)算法进行对比分析。本文涉及参数设置如下:Gabor 滤波除了方向外的其他参数参考文献[15]设置,密集SIFT 的参数参考文献[16]设置,描述子为128 维,引导滤波窗口大小设置为7,引导滤波模糊度设置为0.3,具体可参考文献[1],浮动阈值τ=0.2,最新连通域阈值T=0.001(T为总面积的百分比)。

图4 算法整体流程

图5 多聚焦图像数据

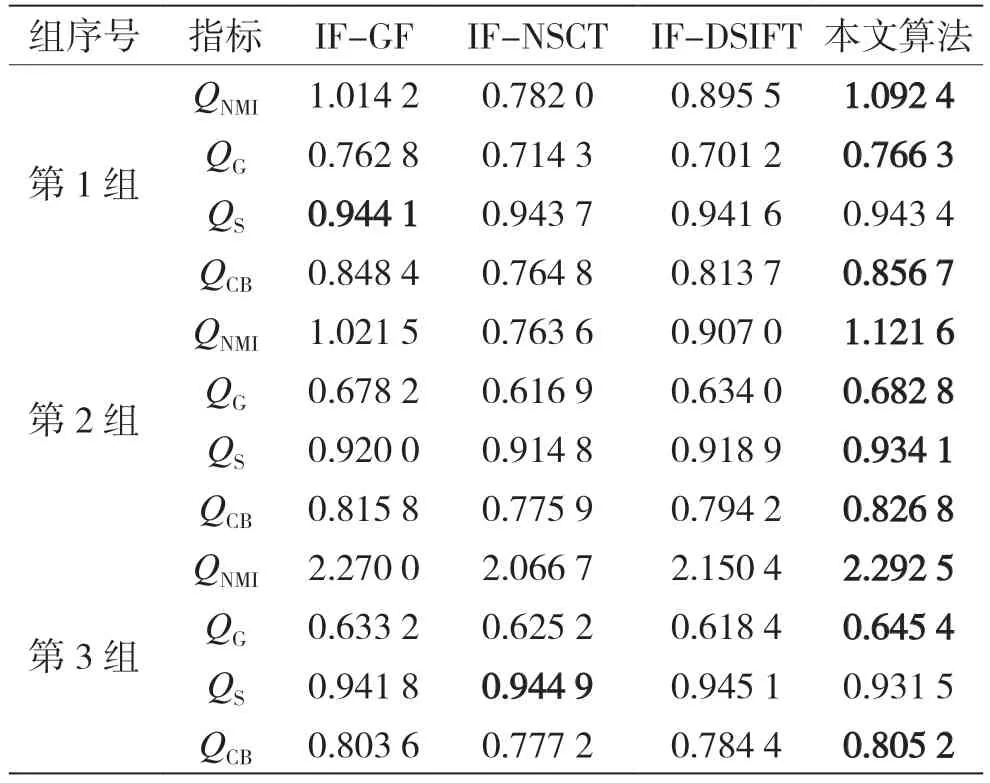

3.2 融合图像质量评价

由于实际情况中很难获取完全聚焦的图像,融合图像质量不能使用均方差等简单评价函数进行衡量。但是,可借助一些已有融合评价指标,从融合图像的结构、对比度等方面进行比较。本文使用4类质量评价函数[18],每类评价函数均是值越大,表示融合质量越好。

(1)归一化的互信息(Normalized Mutual Information,QNMI)来源于信息论,能够测量融合图像包含了多少源图像的信息,式(21)使用其改进形式:

式中H(Si)、H(F) 为对应图像的信息熵,MI(Si,F)为图像间的互信息,其中i={0,2,…,N-1}。

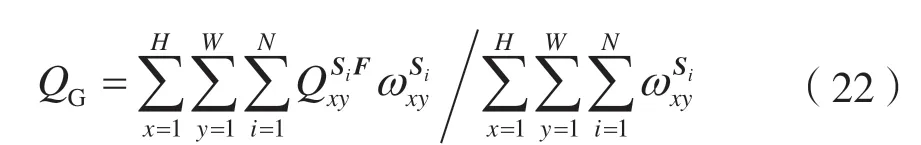

(2)梯度相关性(Gradient-based Fusion Metric,QG)能够度量融合图像和源图像边缘信息之间的相关性,公式如下:

式中,x、y为图像的坐标;QSiF为边缘信息保留值;ωSi为权重,反映QSiF的重要程度。

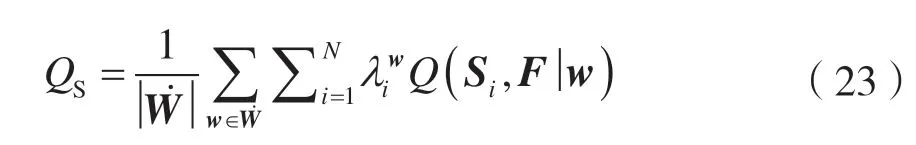

(3)结构相似度(Structural Similarity,QS)是一直符合人类直觉的质量评价标准,能够近似地反映出融合图像的形变情况,公式如下:

式中W为局部窗口的集合,为W˙元素个数,为w显著度的比值,Q(Si,F|w)为通用质量指数(Universal Image Quality Index,UIQI)。

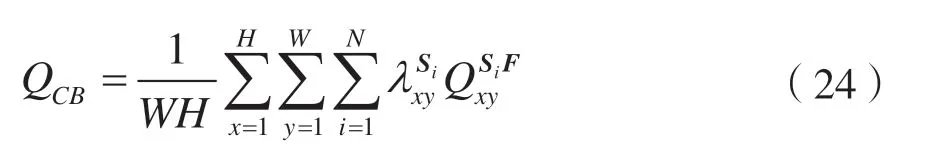

(4)Chen-Blum 度量法(Chen-Blum Metrics,QCB)能够计算融合图像保留源图像对比度的情况,公式如下:

式中x、y为图像的坐标,λSi为对应源图像的显著特征,QSiF为信息保留值。

3.3 融合结果分析

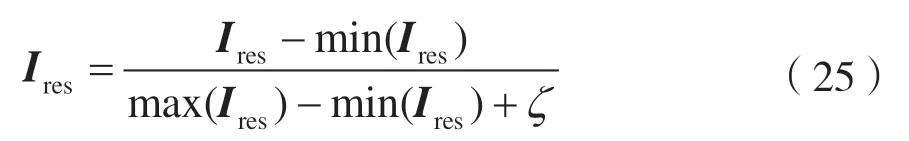

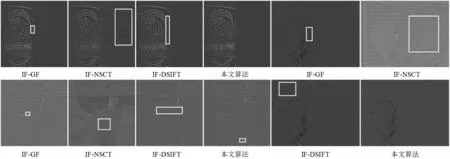

图6 分别显示了IF-GF、IF-NSCT、IF-DSIFT和本文算法对3 组图像的融合结果。为进一步分析细节,对3 组图像分别求了残差(见图7),即将融合图像与其中某幅源图像(如第1 幅)相减。此外,为了显示直观,对残差图做了如下处理:

式中,Ires为残差图像;max(Ires)、min(Ires)分别为Ires的最大值、最小值;ζ>0 为极小的正数,防止分母为0。

图6 多聚焦图像融合结果

图7 残差图

从残差图中可看出,3 组实验的IF-NSCT 均存在较明显误差,如对应的方框所示,表明IF-NSCT空间连续性较差;IF-GF 和IF-DSIFT 则效果较好,但是在模糊与清晰的融合边界处有一些瑕疵,边界融合没有本文算法表现好,如方框所示;本文算法则在内容区域和边界区域都有较好的表现,异常不明显。

除了对融合图与源图像的残差图进行分析外,还使用融合评价指标对3组实验数据进行定量分析。本文使用3.2 节的4 个融合质量评价指标,见表1。表1 中的数据可看出,本文算法各项指标的数值在大多数情况下都较高,说明该算法在原始信息保留、细节保留、结构保持、对比度保持等方面都表现较好。此外,本文算法较单独使用密集SIFT 特征的结果有一定提升,进一步说明了置信图互补的有效性。

表1 不同融合算法的融合质量比较

4 结语

本文提出了一种多特征结合引导滤波的多聚焦图像融合算法。该算法使用两次引导滤波,分别增强了清晰度评价特征的细节和融合结果的空间连续性,并选择3 个鲁棒性较高的特征,借助置信图的方式,将其优势相结合,进一步提升融合的质量。通过选取3 组广泛应用于研究的多聚焦图像,使用4 类通用质量评价指标验证了提出算法在原始信息保留、空间连续性、对比度保持等方面的有效性。