医疗AI技术研发中的伦理思考与探索

2020-01-17董枫

文/董枫

医疗AI技术为临床诊疗注入了无限可能,但所面临的伦理挑战同样值得深思。

医疗人工智能正在越来越多的医疗场景和院外场景中被使用,作为人类科技史上又一次生产力飞跃,医疗AI第一次将诊疗技术的载体从“人脑”扩展为“医生+AI”,使得人类第一次拥有了将诊疗能力批量复制的可能;更高的阅片、诊断效率,更精准、规范的诊断结果,更优化的诊疗流程,以及与大数据、物联网、5G技术所结合的空前广阔的应用场景令人心动,但由此而来的,对医学伦理、信息安全、隐私保护、数据分享与利用等前沿领域也提出了更为严峻的思考与挑战。

如何客观评价医疗AI产品的实际价值?如何正确看待医疗AI技术临床应用所面临的数据分享与利用、隐私保护等伦理问题?面对上述难题,临床医师及医疗机构管理者又有哪些对策?

价值凸显

在2019年的全球顶级放射学会议——北美放射学年会(RSNA)上,1400余场口头报告中,中国学者的比例已经超过15%;总的文章发表数中,与AI相关的文章也已超过100篇,远超日韩总和。中国医疗AI的发展速度与水平可见一斑。

以复旦大学附属肿瘤医院为代表的顶级三甲医院是医疗AI技术探索的主力军,在门诊流程优化、智能辅助诊断、智能科研等领域均有诸多经验。从研发与试用经验来看,医疗人工智能技术的核心价值主要体现在以下三个方面。

第一,高效。医疗AI技术的出现使得医生摆脱繁重的体力劳动,将部分重复的基础性工作,如病灶检出、结构化报告撰写等工作以AI的方式压缩至数秒钟完成,医生能够拥有更高的阅片效率,劳动力得到释放。

第二,精准。以乳腺X线钼靶阅片为例,乳腺X线钼靶阅片难度较高,需要丰富的临床经验与高水平专家的教学指导,复旦大学附属肿瘤医院在该领域长期处于国内领先水平,但培养成本高、培养周期长、阅片难度大、影像数量少等难题长期制约基层医院相关人才的培养,阅片质量难以提升。如何解决?能够“学习”顶级医院诊疗能力的AI应用或可能带来新的改变。

第三,一致性。AI系统在未来有望解决全国各个区域、不同层级医疗机构之间对于乳腺X线钼靶阅片的一致性难题,让偏远地区的乳腺癌患者也能够享受“复旦水准”的医学影像诊断服务。

顶级医疗资源长期且必然处于极度紧缺状态,不同层级医疗机构之间诊疗能力难以短时间内实现均质。而人工智能则可能将诊疗能力工具化,通过深度学习技术复制顶级医疗机构的诊疗能力,显著提升基层医疗机构诊疗能力,以技术手段实现诊疗能力的传播,是人类社会未来解决优质医疗资源短缺,推动医疗资源供给侧改革,实现社会公平,民众医疗资源获得感提升的重要工具。

伦理困境

AI技术在医学领域的飞速发展,为临床诊疗注入了无限可能,也带来了新的诸如医学伦理、信息安全、隐私保护、数据分享与利用等前沿领域的伦理问题。

一是安全性风险。医疗AI在大幅提升诊断效率、精确度以及一致性的情况下,依然不可避免地存在一定的误诊漏诊现象,未来的临床应用中必然面临责任界定问题。目前,日本与欧盟的监管机构曾提出:应将AI系统与“工具”等同,即由操作“工具”的医生来承担主体责任,而我国目前尚无相关法律明文规定,对AI的推广应用带来一定的不确定性。

此外,安全性风险还涉及医疗人工智能产品的临床效能评定及质量控制体系建设,医疗人工智能技术的应用者需要结合病种特点及科室实际工作流建立新的工作模式及质量控制体系,以确保医疗安全。

二是数据隐私保护风险。医疗数据所包含的患者健康管理高度敏感,一旦泄露可能对患者造成重大的经济影响,甚至生命威胁。欧美等多个国家和地区均对医疗数据提出了严格的保护政策。以欧盟2018年颁布的《通用数据保护条例》(GDPR)为例,一方面,新法规使患者有更多权利控制其个人数据的收集及使用;另一方面,对相关数据的不合规行为可导致重罚。

而与此同时,我国虽然关于医疗大数据的总体性纲领不断涌现,但对于医疗中的隐私及数据保护散见在一些法律法规中,如《民法总则》《中华人民共和国执业医师法》《医疗机构病历管理规定》《全国人民代表大会常务委员会关于加强网络信息保护的决定》等,且对于侵犯医疗数据隐私的惩处条例相对宽松,以行政处罚和经济惩罚为主,相对较轻。

三是算法偏见问题。“算法偏见”是指在看似没有恶意的程序设计中带着创建者的偏见,或者所采用的数据是带有偏见的。这种偏见最初出现在人脸识别程序中对于部分人种的识别困难,但在医疗领域中,“算法偏见”并不罕见。

以乳腺X线AI的研发为例,不少企业及高校利用海外数据集进行原始模型构建,但由于欧美女性多为脂肪型乳腺,而中国女性则为致密性乳腺,加之清晰度不足、标注质量低下等原因,依靠单一的公开数据集中公开的欧美女性乳腺影像所研发出来的AI产品无一例外,均在医疗机构实地运行中出现“水土不服”,性能出现大幅跳水。这也对医疗人工智能产品研发过程中的数据质量、数据来源多样性提出了严峻挑战。

同时,不同区域、不同医疗机构对于同一疾病的认知也可能存在差异,当AI的“老师”意见不一致时,最终产出的医疗AI产品性能也会存在差异。

四是医师培养体制进步。该种现象当前并不明显,但未来很有可能发生。以医疗AI技术影响最为深刻的放射科而言,随着技术进步,越来越多的阅片工作与流程将实现自动化、智能化,放射医师的主要工作将从体力劳动者化身医疗AI的训练者与监督者,其日常工作重心及培养方式将不可避免地发生变化。正如马车夫被汽车驾驶员淘汰一样,未来放射医师的学习重点也可能随着医疗AI技术的进步而发生改变。探索路径

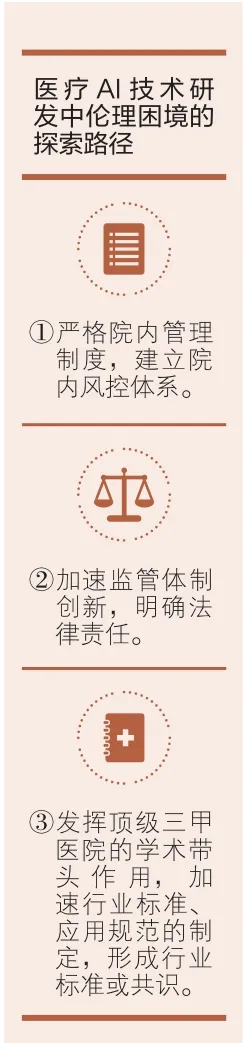

医疗人工智能早已不是“新生事物”,医疗机构医教研管的每一个环节都已经能看到医疗人工智能的身影。作为临床医务工作者和管理者,我们必须以开放且积极的态度拥抱医疗人工智能,正视医疗人工智能发展中所面临的技术难题、伦理难题、法律难题,并寻求相关对策,推动医学技术进步,以技术创新让人人享有更好的医疗。

首先,严格院内管理制度,建立院内风控体系。新技术的应用必然对院内医疗安全产生影响,隐私保护、医疗责任归属、产品风险防范等问题必须在医疗AI产品落地之前即进行严格论证,建立产品性能及风险评价体系,明确产品应用范围,遵守“数据不出院”等基础原则,为医疗安全建立第一道屏障。

其次,加速监管体制创新,明确法律责任。医疗AI产品的监管难点之一在于其技术处于飞速进步之中,相较于传统药品及器械品种动辄3~5年,甚至5~10年的审批流程,医疗AI的技术进步以1年计,甚至每半年都会有新功能推出,行业组织及相关部委必须研究“高频创新”时代的新监管体系及理念,建立动态准入及监管机制,既鼓励新技术研发的同时,也确保只有真正有用、有价值的医疗AI产品才能落地临床。

同时,诸多伦理难题,尤其是医疗数据的归属、利用、开发、分享等细则必须进一步明确,以法律条文的形式为行业发展奠定基调,明确法律责任之后,必将大力推动相关行业进步,充分利用中国这个全球最大的医疗数据资源宝库。

再次,发挥顶级三甲医院的学术带头作用,加速行业标准、应用规范的制定,形成行业标准或共识。当前医疗AI产品开发中良莠不齐现象严重,水平差距较大,数量虽多但精品稀缺,顶级三甲医院作为优质医疗资源高地及医疗AI应用先行者,一方面能够以顶级的数据基础及诊疗水平成为医疗AI产品的高水平“导师”;另一方面,也有能力以区域组织或医联体为单位推动医疗AI产品的质量评定、信息安全、伦理审查等体系建设,形成区域或行业标准并进行推广。