无人机影像正射纠正与拼接技术的研究与应用

2019-11-12孟凡东

孟凡东

(新疆维吾尔自治区第二测绘院,新疆 乌鲁木齐 830001)

1 引言

无人机影像拼接技术在地质灾害监测、新农村建设、自然资源调查等领域具有十分广阔的应用前景[1-2]。但是由于无人机影像飞行高度与数码相机视场角的限制,像片数量多,单幅影像覆盖范围较小,影像倾角过大等问题[3],难以有效覆盖目标区域。为了解决影像视场范围与分辨率之间的矛盾,需要将所获得的影像快速拼接成大视场全景图[4]。国外学者Richard提出基于运动的全景影像拼接模型[5],Kim 等提出在规则格网特征空间采用连续块匹配的全景影像快速拼接方法[6]。国内学者刘庆元通过DGPS 位置参数对影像正射纠正,使拼接影像具有了地理位置信息[7];袁晓亚提出基于改进Harris 角点特征匹配的图像拼接方法[8]。

本文详细分析了无人机影像拼接误差产生的原因,在此基础上根据航飞POS 参数,对无人机影像进行正射纠正,采用SIFT 算法和SURF 算法对尺度不变特征进行提取,根据特征描述符间的欧氏距离进行特征匹配,利用RANSAC 算法剔除误匹配点对,并计算投影变换矩阵,最后利用加权平均法对影像进行融合,得到无拼接缝的影像。

2 无人机影像拼接误差分析

无人机影像拼接的误差主要包括影像拼接系统误差、影像拼接偶然误差、影像拼接粗差。

(1)首先,无人机飞行过程中由于质量小、惯性小,受气流影响比较大,飞行不稳定,导致飞行航线平移,其曲线轨迹、俯仰角、侧滚角、旋偏角变化较快,相邻影像的航向和旁向重叠度变化大;其次,由于相邻影像的旋偏角大,传统的灰度相关算法较难实现 ;再次,飞行器的飞行高度、俯仰角和侧滚角受气流影响发生变化,造成相邻影像间的比例尺差异较大,灰度相关的成功率和准确性降低。将不同影像投影到同一平面进行影像处理时,采用放射变换模型不能很好地消除影像畸变,其误差会随着原影像被传递到合成的新影像中[3]。

(2)由于相邻影像的左右和上下重叠度变化大,在相邻影像的接边处,会出现多张影像同时存在相同区域的现象,对重叠区域进行颜色融合拼接处理会引起误差[3]。

(3)在影像拼接过程中,由于影像本身的质量问题或者算法不合适,会出现大量的匹配点错误,从而引起匹配粗差,影响无人机影像的拼接质量。

3 关键技术

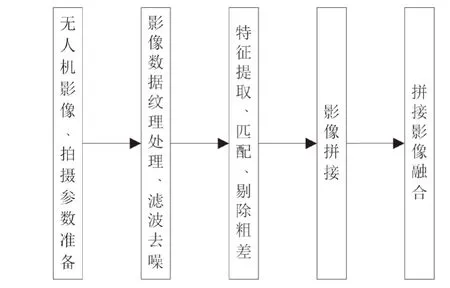

本文通过POS 参数对无人机影像正射纠正,采用基于特征的影像匹配方法,利用RANSAC 算法剔除误匹配点对,并计算投影变换矩阵,最后利用加权平均法对影像进行融合,得到无拼接缝的影像。影像拼接的总体流程如图1 所示。

图1 影像拼接总体流程

3.1 无人机图像的正射纠正

无人机影像在成像瞬间,由于受地球曲率、大气遮光、地形起伏等因素影响,影像中各像点均存在不同程度的几何变形,需要对影像进行正射纠正。通常采用共线方程进行正射纠正,具体步骤如下。

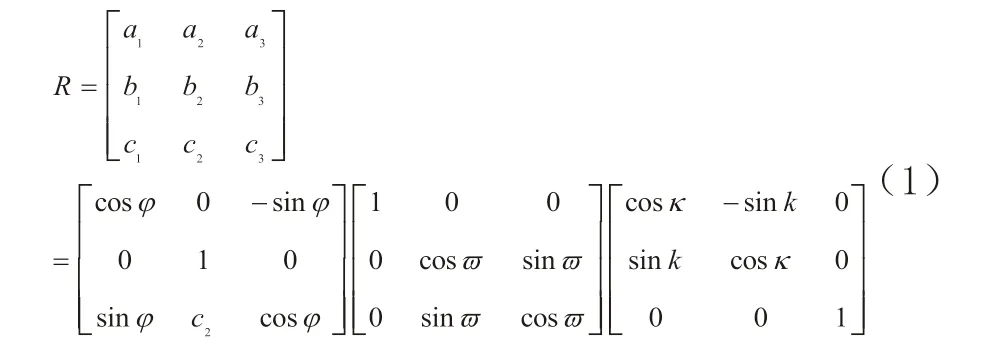

(1)利用POS 数据,应用公式(1)计算旋转系数:

(2)根据相机检校参数所得内方位元素焦距f,像主点坐标(x0,y0),确定图像四个角点在像平面坐标系上的坐标,分别为(-w/2-x0,h/2-y0)(w/2-x0,h/2-y0)(w/2-x0,-h/2-y0)和(-w/2-x0,-h/2-y0)。其中,w为影像的列数,h为影像的行数。

(3)应用公式(2)计算四个角点相应的大地坐标。式中X、Y为角点大地坐标,Z对应为地面点真实高程,在这里可采用测区地面平均高程替代。

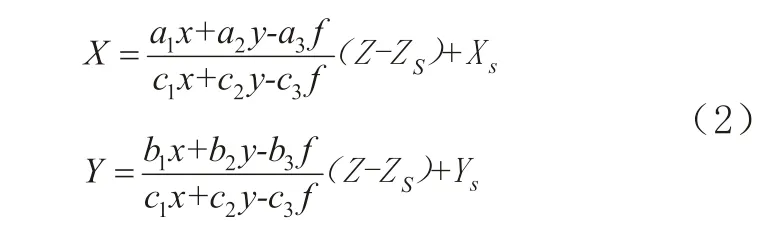

(4)用四个角点的大地坐标确定纠正后像素的行列数,并以此建立正射影像的框架,计算框架内每个点的地理坐标。

其中,resolution为图像的分辨率,(i,j)为正摄影像框架中的索引值。

(5)计算正射影像每个像素的像平面坐标和图像坐标。

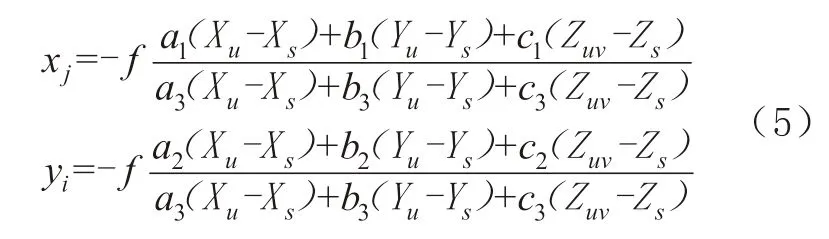

zuv取测区的平均高程,然后应用公式(5)计算像素在影像坐标系中的坐标,如 此即完成影像的正射纠正[9]。

3.2 特征提取与匹配

尺度不变特征包括特征点和特征描述符两部分,其提取算法主要有SIFT 算法和SURF 算法两种。SIFT 算法是在构建的尺度空间中进行极值检测,并对提取到的极值点进行筛选,剔除不稳定的点,定义每个稳定特征点的主方向,最后根据特征点周围图像的局部特性形成特征描述符,用以匹配。SURF算法是SIFT 算法的一种改进,主要使用Hessian-Laplacian 来近似Gaussian-Laplacian,并使用方框滤波代替二阶高斯滤波进行计算,从而实现更快的特征提取速度[10]。

3.3 影像配准与融合

两幅影像经过投影变换可以映射至同一坐标系下,影像I1和I2的对应关系可以表示为I2=H×I1,H为透视变换矩阵,它是一个3×3 满秩矩阵,通常表示为如下形式:

矩阵H共有8 个未知参数,使用线性方法求解至少需要4 对特征点的坐标,联立8 个方程,才可以求得变换矩阵。经过特征匹配得到的匹配点中一般都存在误匹配,因此需要根据几何限制和其他附加约束消除错误匹配,提高鲁棒性。本文用RANSAC 算法计算变换矩阵,求出变换矩阵后,进行影像融合[4]。影像融合需要消除成像时间、曝光时间、大气等因素的干扰,导致无人机图像在重叠区存在较明显的灰度、色彩差异,出现影像拼接缝。采用重叠影像处的像素灰度值取加权算数平均值法融合影像。

4 实验及分析

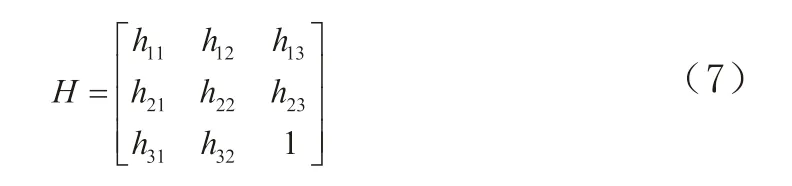

实验选取固始县某区域的航拍影像进行拼接,同时对SIFT 算法和SURF 算法在C++环境下进行测试,第一组是相邻航带上的两幅影像,相机为索尼a5100,像幅大小为6000×4000 像素,如图2 所示。第二组是同一条航带上的两幅影像,相机为尼康D810,像幅大小为7360×4912 像素,如图3 所示。在同样条件下进行两种情况影像匹配的各项评判因素对比,通过实验分析确定哪种方法更适合无人机影像的快速拼接。

在相同环境下,对两组影像分别进行SIFT 算法和SURF 算法特征匹配实验,实验中SURF 算法运算过程中的Hessian 矩阵行列式阈值设为3000、匹配阈值取0.6,计算初始H矩阵时RANSAC 阈值设为5。实验结果如表1 所示。

图2 第一组实验影像

图3 第二组实验影像

表1 SIFT算法与SURF算法实验结果比较

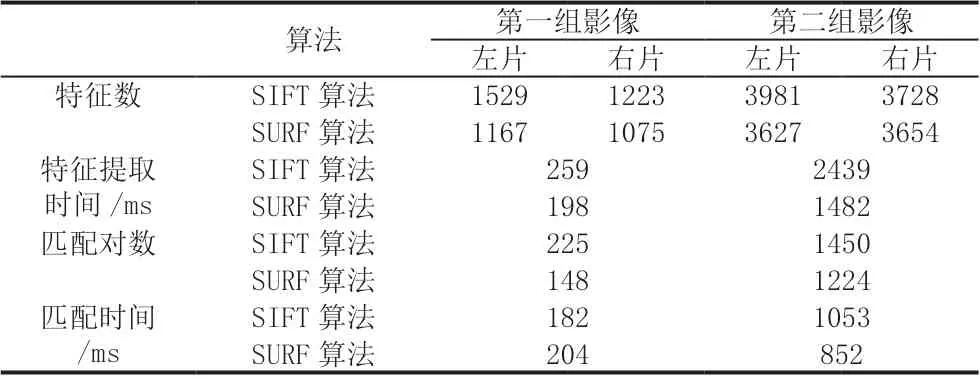

从实验数据可知,影像越大,特征越丰富,能够提取出的特征数量也就越多,匹配的特征点对数也相应增加;在SIFT 算法和SURF 算法的比较中,SIFT 算法的特征提取耗时较长,SURF 算法的优势明显;在匹配时间的比较上,两种算法的区别不大,主要与数据量的大小有关。剔除误匹配点对的特征匹配效果如图4 所示。

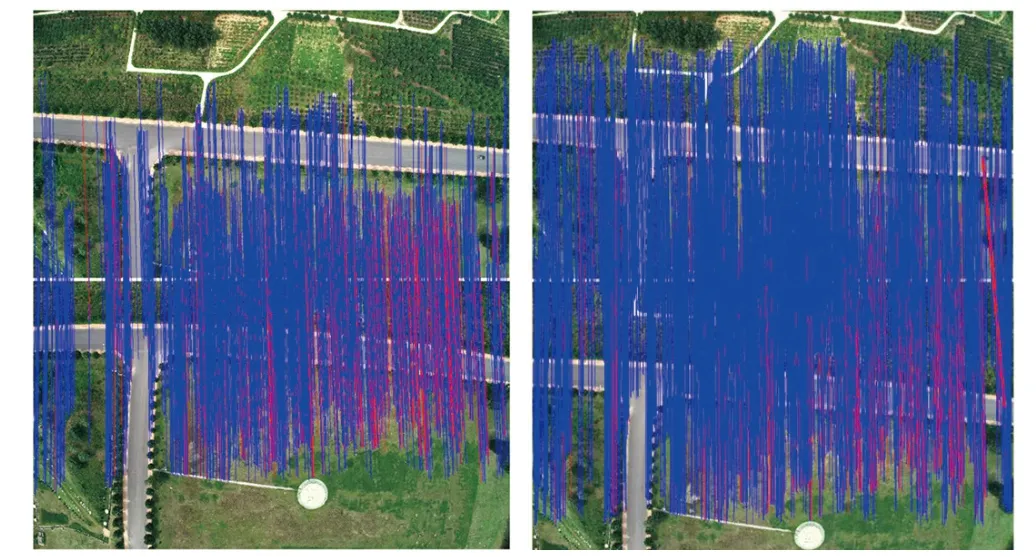

完成精确匹配后,第二组影像的拼接效果如图5所示。

图4 特征匹配效果

图5 影像拼接效果

5 结语

本文针对无人机影像拼接存在的问题,采用SIFT和SURF 算法对尺度不变特征进行提取,根据特征描述符间的欧氏距离进行特征匹配。实验结果最终验证,SURF 算法在提取效果、速度等方面优于SIFT 算法,RANSAC 算法也能够有效地进行精确匹配,得到的单应性矩阵进行无人机影像拼接效果良好,可提高拼接精度和效率。本文研究的不足之处,如高斯平滑滤波中参数设置问题、算法效率问题等,将在以后研究中完善。