基于级联Vnet-S网络的CT影像单一器官自动分割算法

2019-10-23徐宝泉凌彤辉

徐宝泉 凌彤辉

摘 要:为了快速准确地对计算机断层扫描(CT)影像中的器官进行分割,提出基于级联Vnet-S网络的单一器官自动分割算法。首先,使用第一个Vnet-S网络对CT影像中的器官进行粗分割;然后,选择分割结果中的最大连接通量做两次膨胀,根据膨胀后的最大连接通量确定器官边界并提取器官区域;最后,使用第二个Vnet-S网络对器官进行细分割。为了验证算法的性能,采用MICCAI 2017 Liver Tumor Segmentation Challenge (LiTS)数据集进行肝脏分割实验,采用ISBI LUng Nodule Analysis 2016 (LUNA16)数据集进行肺分割实验。级联Vnet-S算法在LiTS的70例线上测试数据上的Dice系数为0.9600,在LUNA16的288例测试数据上的Dice系数为0.9810,均高于Vnet-S网络和Vnet网络。实验结果表明,基于级联Vnet-S网络的单一器官分割算法可以准确地对器官进行分割,而且级联Vnet-S算法的计算量小于Unet网络和Vnet网络。

关键词:器官分割;Vnet-S;深度学习;分割网络;级联网络结构

中图分类号: TP391.4

文献标志码:A

Automatic segmentation algorithm for single organ of CT images based on cascaded Vnet-S network

XU Baoquan1,2, LING Tonghui1*

1.Shanghai Institute of Technical Physics,Chinese Academy of Sciences, Shanghai 200083, China ;

2.University of Chinese Academy of Sciences, Beijing 100049, China

Abstract: In order to realize fast and accurate segmentation of organs in Computed Tomography (CT) images, a automatic segmentation algorithm for single organ based on cascaded Vnet-S network was proposed. Firstly, the organ in the CT image was coarsely segmented by using the first Vnet-S network. Then, the maximum connection flux in the segmentation result was selected and expanded twice, and the organ boundary was determined and the organ area was extracted according to the maximum connection flux after expansion. Finally, the organ was finely segmented by using the second Vnet-S network. In order to verify the performance of the proposed algorithm, a liver segmentation experiment was carried out on the MICCAI 2017 Liver Tumor Segmentation Challenge (LiTS) dataset, and a lung segmentation experiment was carried out on the ISBI LUng Nodule Analysis 2016 (LUNA16) dataset. The cascaded Vnet-S algorithm has a Dice coefficient of 0.9600 on the online test data of 70 cases in LiTS and a Dice coefficient of 0.9810 on the 288 cases in LUNA16, which are higher than those of Vnet-S network and Vnet network. Experimental results show that the single organ segmentation algorithm based on cascaded Vnet-S network can accurately segment organs with lower computational complexity compared with Vnet and Unet networks.

Key words: organ segmentation; Vnet-S; deep learning; segmentation network; cascaded network structure

0 引言

醫学图像的器官自动分割技术是对人体器官进行定性和定量分析的基础,可以帮助医生诊断和制定患者的治疗计划,也是图像引导手术、肿瘤放疗和临床治疗评价的主要前提,是介入消融和磁感应热疗等技术中必不可缺的一环,对医生的临床工作有极大的价值。计算机断层扫描(Computed Tomography, CT)是获取人体内部信息的主要手段。但是针对CT影像中的器官实现快速准确的自动化分割是非常困难的任务,因为CT影像非常复杂,存在伪影、灰度不均匀、不同组织间灰度相似等问题,而且在图像特征方面也缺少简单的线性特征,这些都增加了算法的设计难度。另一方面CT影像属于三维图像,数据规模大,要完成一例CT影像的分割计算,容易出现计算量大、耗时长的问题。在器官分割领域,研究者们采用的图像分割算法主要分为传统图像算法和深度学习的方法。传统图像分割算法主要有三种:基于图像灰度的算法[1-4]、基于统计形状模型的算法[5-7]和基于纹理特征的算法[8-10]。而深度学习的方法主要分为二维分割网络和三维分割网络:二维分割网络包括全卷积神经网络(Fully Convolutional Network, FCN)网络[11]和2D Unet网络[12]等;三维分割网络包括3D Unet网络[13]和Vnet网络[14]等。

传统器官分割算法都存在不足之处: 基于灰度的算法需要器官和背景有较大的差异,当差异较小时,分割的准确度会大幅下降;基于统计形状模型的算法对形状不规则的器官无法准确分割;基于纹理特征的算法依赖于特征分类器和人工提取的特征,人工提取特征费时费力,无法保证泛化能力,分类器的性能也会大大影响算法的性能。

深度学习的方法也存在一定的问题。针对CT影像,二维分割网络比三维分割网络分割准确度低,原因在于CT影像作为三维图像,图像中的三维空间信息非常丰富,但是二维分割网络无法利用这些信息。通过将多层CT轴切片图像作为二维分割网络的输入可以缓解这个问题,但是对三维空间信息的利用仍不够充分。三维分割网络的问题在于运行时需要占用大量显存,而目前图形处理器(Graphics Processing Unit, GPU)显存较小,这个硬件的限制导致三维分割网络需要大尺度缩小输入图像尺寸,从而导致图像特征丢失,影响分割精度。同时三维分割网络的深度相比二维分割网络也需要缩减,感受野随之减小。图像的大尺度缩小和小感受野导致三维分割网络在器官分割的准确度仍然不够理想。

为解决器官的快速准确分割问题,本文提出一种基于级联Vnet-S网络的单一器官自动分割算法。该算法属于有监督学习算法,需要采用不同器官的数据集对算法进行训练,得到对应的器官分割算法,适用于CT影像中多种大型器官。该算法为端到端的结构,只需要输入图像,通过计算便可直接得到器官的分割结果。该算法的核心是采用级联Vnet-S网络结构,由两个Vnet-S网络搭建而成,分别用于器官的定位和分割。该算法的特点是准确度高、计算量小。本文针对肝脏和肺这两个器官进行了实验,利用公开数据集验证了算法的分割准确度,并评估了算法的计算量,验证了算法低计算量的特点。

1 相關工作

文献[11]中提出了全卷积神经网络(FCN),实现了对图像的端到端语义分割。FCN由卷积层、下采样层、上采样层和激活函数组成,它本质上是对图像进行像素级的分类。2D Unet网络则在FCN基础上进行了优化,采用了对称级联结构,中间的级联层弥补了细颗粒度图像特征和位置信息。3D Unet网络则将Unet网络从2D扩展到3D,即网络输入从二维图像变为三维图像。Vnet网络同样也是三维网络,但是在结构上对3D Unet网络进行了优化,改变了卷积层结构和池化的方式,增加了网络的深度。

在器官分割领域,研究者们基于深度学习的方法取得了很多研究成果。例如:文献[15]中的方法采用了改进的全卷积神经网络对肝脏进行分割;文献[16]中提出了一种肺分割算法,先利用阈值对肺进行定位,然后利用Vnet网络对肺进行分割;文献[17]中的方法针对肝脏分割问题采用三维分割网络结合条件随机场的方式,取得了较高的准确率。

针对CT影像中的器官分割,三维分割网络是目前主要采用的方法之一,因为三维分割网络可以充分利用CT影像中的空间信息;但是三维分割网络存在因缩小图像尺寸导致分割精度不高的问题,为此可以采用级联网络结构来缓解这个问题。级联网络结构的主要思想是通过一个前置网络缩小分割网络需要计算的区域范围,从而减小图像需要缩小的比例,缓解了三维分割网络的问题。例如:文献[18]中的方法使用了一个三维卷积神经网络对脊椎的边界位置进行回归,得到脊椎的定位框,然后将定位切割出的脊椎图像放入三维分割网络中进行分割;文献[19]中的方法是使用了两个3D Unet网络,第一个3D Unet网络采用扫描的方式对图像进行粗分割,第二个3D Unet网络再对粗分割的结果进行细分割。级联网络结构在缩小计算区域的同时还提高了目标在图像数据中的比例,能缓解类别不平衡问题,提高分割准确度。

考虑到三维分割网络在器官分割上的优势,并借鉴级联网络结构的思想,本文提出了基于级联Vnet-S网络的单一器官自动分割算法。Vnet-S网络作为三维分割网络,是基于Vnet网络设计和改进的,感受野较大,有着和Vnet网络相似的性能;但是它的参数量和计算量大大减少,更适合部署。而整个算法框架是由两个Vnet-S网络搭建而成:第一个Vnet-S网络用于对器官进行定位,定位的方式是利用Vnet-S网络的粗分割结果再结合一定的后处理;第二个Vnet-S网络对定位的器官进行准确分割。

2 Vnet-S网络

Vnet网络是三维分割网络,在三维图像分割方面有着广泛的应用。Vnet网络成对称结构:左半部分为特征提取过程,由卷积层和池化层组成;右半部分为特征重构过程,由卷积层和反卷积层组成。特征提取和特征重构中间为级联层。Vnet网络有着优秀的拟合能力,但是用于肝脏和肺这类器官分割时,其网络结构过大,网络的拟合能力溢出,容易过拟合,而且网络过大会增加硬件的负担。因此在Vnet网络结构的基础上,本文提出Vnet-S网络结构。

Vnet-S网络结构如图1所示。Vnet-S网络相比Vnet网络改进的地方主要是网络结构和卷积单元:Vnet-S网络每个卷积层都只包含2个卷积单元,而Vnet网络除了在左2卷积层和右2卷积层包含2个卷积单元外,其余卷积层都包含3个卷积单元;Vnet-S网络的卷积单元由卷积核大小为3×3×3的卷积、批归一化(Batch Normalization, BN)[20]和PReLU激活函数组成,而Vnet网络中卷积单元由卷积核大小为5×5×5的卷积和PReLU激活函数组成。BN的加入可以加快模型收敛,缓解过拟合。Vnet-S网络另一处改进是在级联过程中加入了Dropout[21],Dropout提供了正则化效果,可以缓解模型的过拟合问题。

Vnet-S网络其他结构和Vnet网络保持一致,包括加入级联层、采用卷积池化和采用残差学习结构。级联层的作用是将特征重构的特征图与特征提取中等大小的特征图进行拼接,再进行卷积,从而弥补了细颗粒度图像特征和目标的位置信息。卷积池化,即使用2×2×2 的卷积核对特征图进行卷积,步伐大小为2,从而达到池化的效果。卷积池化的好处在于训练网络时占用更小的内存。残差学习结构是在文献[22]中提出的结构,即将卷积层的输入与卷积层最后的输出进行加和,缓解了梯度消失的问题。

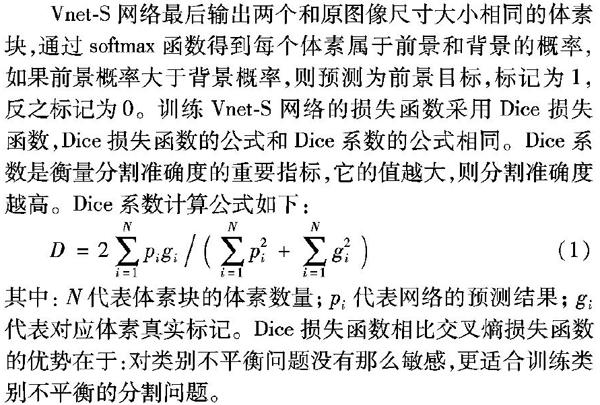

Vnet-S网络最后输出两个和原图像尺寸大小相同的体素块,通过softmax函数得到每个体素属于前景和背景的概率,

如果前景概率大于背景概率,则预测为前景目标,标记为1,反之标记为0。训练Vnet-S网络的损失函数采用Dice损失函数,Dice损失函数的公式和Dice系数的公式相同。Dice系数是衡量分割准确度的重要指标,它的值越大,则分割准确度越高。Dice系数计算公式如下:

D=2∑ N i=1 pigi / ( ∑ N i=1 p2i+∑ N i=1 g2i )

(1)

其中:N代表体素块的体素数量;pi代表网络的预测结果;gi代表对应体素真实标记。Dice损失函数相比交叉熵损失函数的优势在于:对类别不平衡问题没有那么敏感,更适合训练类别不平衡的分割问题。

Vnet-S网络在网络深度上和2D Unet网络是相同的,比3D Unet网络多一层,有着比3D Unet网络更大的感受野。大的感受野可以让网络对输入体数据中的全局内容进行感知,Vnet-S网络各层感受野如表1所示。

3 器官分割算法

器官分割算法是在Vnet-S网络基础上搭建而成,采用两个Vnet-S网络分别用于器官的定位和分割。整个算法流程如图2所示:先读入CT影像,提取图像数据,对数据进行预处理;然后进行器官定位,根据定位结果对数据进行提取;最后进行器官分割,并返回分割结果。

3.1 预处理

预处理主要包括:分辨率标准化、调窗处理和灰度值标准化。CT影像由于机器的差别或者参数设置的差异,分辨率大相径庭,因此需要对医学图像进行分辨率的标准化。对于肝脏分割实验,选择分辨率0.69mm×0.69mm×1.0mm对图像进行标准化;而对于肺分割实验,选择1.0mm×1.0mm×1.0mm進行标准化。然后是针对不同的器官选择合适的灰度值窗口,该操作可以过滤不相关的组织器官,提高分割准确率。肝脏分割实验选择灰度窗口范围为[-250,250],肺分割实验因为肺部与其他组织灰度值差异较大,不需要截取灰度值窗口。最后分别统计肝脏和肺训练数据所有图像数据的灰度值均值和标准差,利用这个均值和标准差对图像灰度值进行标准化。

3.2 器官定位

本文采用图像分割的方法来进行定位,具体步骤如下:1)通过分割网络计算得到分割结果;2)选择分割结果中的最大连接通量(对于肺分割,则选择最大的两个连接通量);3)对最大连接通量做两次膨胀;4)根据最大连接通量的范围确定器官的边界。定位算法最后得到6个值,分别是器官在x轴、y轴和z轴边界的最大最小值。

选择最大连接通量是为了过滤图像分割结果中的假阳性。选择最大连接通量的方式是先标记分割结果中的连接通量,然后选择体素点最多的连接通量。两次膨胀操作是为了保证定位的区域边界能够包含全部器官体素点。因为后续的器官分割是根据器官定位的结果提取目标区域再进行分割,当定位出现偏差,会导致提取的器官不完整,将严重影响分割结果,因此做了两次膨胀,放宽了边界的大小。器官定位的Vnet-S网络在计算前需要将图像缩小到原来的1/4。

3.3 器官分割

根据器官定位提供的区域边界,从预处理后的图像数据中将该区域切割出来;然后使用Vnet-S网络对其进行分割计算,网络计算前先将提取的图像数据缩小到原来的1/2;再对分割结果进行还原得到最后的分割结果。

还原操作如下:先采用最近邻插值算法将分割结果放大2倍;然后利用区域边界对分割结果进行填补还原为切割前的图像大小;最后根据原始分辨率对分割结果进行缩放得到最终的分割结果。

4 评价指标

为了更全面地衡量图像分割的准确度,除了采用Dice系数指标外,还采用以下指标对器官分割结果进行评估,这四个评价指标都是数值越小,代表分割精度越高。

1)体积重叠误差(Volume Overlap Error, VOE):

VOE(A,B)=1- | A∩B | / | A∪B |

(2)

2)相对体积偏差(Relative Volume Difference, RVD):

RVD(A,B)= (| B | - | A |)/ | A |

(3)

3)平均对称面距(Average Symmetric Surface Distance, ASSD):

ASSD(A,B)= 1 | S(A) | + | S(B) | ·

( ∑ sA∈S(A) d(sA,S(B))+∑ sB∈S(B) d(sB,S(A)) )

(4)

其中:d(v, S(A))表示像素v到表面体素S(A)的最短欧氏距离。

4)最大对称面距(Maximum Symmetric Surface Distance, MSSD):

MSSD=

max{max sA∈S(A) d2(sA,S(B)),max sB∈S(B) d2(sB,S(A))}

(5)

其中:A代表真实标记的器官区域,B代表预测的器官区域;S代表表面体素点,S(A)和S(B)代表A和B的表面体素点。

5 实验结果与讨论

实验所用的硬件配置如下:GTX 1080GPU两块,GPU显存大小为8GB;开发工具为python和pytorch。

5.1 数据

为了验证所提算法模型的性能,本文针对肝脏和肺这两个器官,利用公开数据集进行了分割实验,对于肝脏分割实验采用了MICCAI 2017 Liver Tumor Segmentation Challenge(LiTS)的数据集进行实验。LiTS数据集包含了200例腹部CT影像,其中130例作为训练集,70例作为线上测试集。这些CT影像轴向分辨率在0.55~1.0mm,层厚在0.45~6.0mm。对于肺分割实验采用了ISBI LUng Nodule Analysis 2016(LUNA16)的数据进行实验,LUNA16的数据来自LIDC-IDRI数据集,剔除了层厚大于2.5mm的CT影像,总共包含888例胸部CT影像。这两个数据集分别提供了肝脏和肺的分割结果图,可用于算法的训练和测试。

训练网络时需要划分出部分训练数据作为验证集,防止模型过拟合。本文采用15%的比例从训练数据中随机抽取数据作为验证集。因此对于LiTS数据集的130例训练集,抽取了20例图像作为验证集;而对于LUNA16数据集,先是随机抽取了288例数据作为测试集,然后在剩余数据中随机选择了510例数据作为训练集,90例数据作为验证集。

5.2 网络的训练和测试

本文使用LiTS数据集和LUNA16数据集分别进行了肝脏分割和肺分割实验,实验步骤为:先处理数据,然后使用训练数据进行模型的训练,再使用训练好的模型搭建算法,最后使用测试集验证算法的性能。肝脏分割和肺分割实验的步骤一致,模型训练的方法和参数设置也基本一致。

数据的处理主要是对数据进行分辨率标准化和裁剪切割。数据的调窗处理和灰度值标准化是在训练和测试过程中动态进行的。器官定位的Vnet-S網络的训练数据需要将原始数据裁剪到相同大小;器官分割的Vnet-S网络的训练数据则需要根据真实标记从原始数据中将器官区域切割出来作为训练数据,该数据也需要进行处理保证大小相同。

训练器官定位和器官分割的Vnet-S网络设置的超参数相同:Batch size设置为4,损失函数设置为Dice损失函数,采用Adam算法[23]进行自适应梯度下降来拟合网络参数,学习率设置为0.001,梯度和平方梯度的系数设置为0.9和0999,权重衰减系数设置为1×10-8。训练网络中需要加入数据增强来提高模型的泛化能力,本文采用的数据增强包括在制作训练数据时加入随机平移,模型训练中加入动态的随机旋转,以及借鉴3D Unet加入动态B样条插值[13]。训练迭代次数设置为200,在出现过拟合时,提前停止训练。

通过上述操作,完成器官定位和器官分割中的Vnet-S网络训练,然后完成对网络模型的算法集成,最后使用测试集验证算法性能。为了进行对比,还训练了单一的Vnet网络和单一的Vnet-S网络进行测试。

肝脏分割实验的线上测试集共有70例,表2统计了级联Vnet-S算法、Vnet网络和Vnet-S网络的线上测试结果。为了对比算法的准确度,本文罗列了其他肝脏分割算法的线上测试结果。肺分割实验采用线下测试,测试集有288例,表3统计了级联Vnet-S、Vnet和Vnet-S的线下测试结果。

通过表2、3可以看出,在肝脏分割和肺分割的测试集上,级联Vnet-S算法的各项指标都比单一Vnet网络和单一Vnet-S网络取得了更好的结果,说明它的性能明显优于单一Vnet网络和Vnet-S网络;同时也可以发现Vnet网络和Vnet-S网络各项指标基本相同,说明二者的性能基本相同。

表2统计了各种肝脏分割方法的LiTS线上测试结果。文献[24]方法采用一个改进的2D FCN进行肝脏分割,加入了简单的后处理去除假阳性。通过表2可以看出,该方法分割准确度远低于Vnet-S网络和级联Vnet-S算法,其原因在于2D FCN无法利用CT影像中的空间信息。文献[25]方法也是采用2D FCN进行分割,在网络结构和特征利用上进行了改进,分割Dice系数达到0.9510,但依然低于级联Vnet-S算法,不足之处依然是没有利用三维空间信息。文献[26]方法是采用两个2D FCN分别进行粗分割和细分割,再利用一个3D FCN进行后处理,3D FCN可以组合三维空间信息,分割Dice系数达到0.9610。文献[27]方法同样是采用两个FCN分别粗分割和细分割,但是采用将多层CT影像切片作为输入的方式,弥补了三维空间信息,分割Dice系数达到0.9630。文献[26]方法和文献[27]方法在分割准确度上都略微高于级联Vnet-S算法,但是这两个方法的计算量都较大。相比这两个方法,级联Vnet-S算法的计算量控制在较低的水准,更适合临床应用。关于Vnet-S网络的计算量将在后续讨论。

最后使用可视化工具对级联Vnet-S算法的分割结果进行可视化。可视化采用多平面重建、生成横断面、矢状图和冠状图,并和真实标记的多平面重建结果进行对比,观察级联Vnet-S算法的分割结果和真实标记之间的吻合度。对比结果如图3所示,可以看出, 级联Vnet-S算法的分割结果和真实标记基本相同,说明级联Vnet-S算法分割器官有着较高的准确度,符合临床应用的要求。

5.3 Vnet-S网络讨论

Vnet-S网络是在Vnet网络基础上进行了改进, Vnet网络的问题在于网络过大,对于肝脏和肺这类器官分割,Vnet网络的拟合能力溢出,容易过拟合,同时网络过大会增加硬件的负担。Vnet-S 改进的地方主要是网络结构和卷积单元。网络结构和卷积单元的调整大大缩减了参数量和计算量,与之对应的是网络的感受野也随之缩减,但是Vnet-S网络的感受野足够大,能够满足网络学习全局的特征。使用LiTS数据集训练Vnet网络和Vnet-S网络(未加入BN和Dropout),在模型训练过程中,Vnet网络验证集Dice最高可以达到0.9412,Vnet-S网络验证集Dice最高可以达到0.9405,说明两个网络在肝脏分割上性能差别很小。为了加快模型收敛,增强模型的泛化能力,在Vnet-S网络中加入了BN和Dropout。通过表2~3可以发现:Vnet-S网络在肝脏分割和肺分割测试集上的平均Dice系数分别比Vnet网络高0.001和0.0007,说明BN和Dropout的加入提升了模型泛化能力。Vnet-S网络和Vnet网络性能基本接近,但是Vnet-S网络规模更小、参数量更少,因此更具优势。

为了更准确地对比和评估Vnet-S网络大小和计算量,本文统计了2D Unet网络、Vnet-S网络和Vnet网络的参数量和计算量,如表4所示,相同输入大小,Vnet网络的参数量是Vnet-S网络的6.42倍,计算量是Vnet-S网络的4.67倍, Vnet网络的参数量和计算量都远大于Vnet-S网络。级联Vnet-S网络结构由两个Vnet-S网络搭建而成,因此参数量为Vnet-S网络的2倍;而计算量方面,考虑到选择最大连接通量和膨胀操作的计算量远小于模型的计算量,因此级联Vnet-S网络的计算量约等于Vnet-S计算量的2倍。所以级联Vnet-S网络的参数量为20.30×106,计算量约为215.66×109,都小于Vnet网络参数量和计算量,但级联Vnet-S分割准确度远高于Vnet网络。Vnet-S网络相比二维分割网络在网络大小和计算量上仍然具有优势。可以发现输入大小为572×572的2D Unet网络在计算量和参数量上都大于Vnet-S网络,如果采用256×256大小的输入,2D Unet网络的计算量会小于Vnet-S网络,但是二维分割网络需要对医学图像中的每层切片进行计算,而三维分割网络是对医学图像进行三维计算,一般只需要计算一次或者数次就可以得到分割结果,因此整体计算量二维分割网络一般是远大于三维分割网络的。同理,2D Unet网络的计算量也大于级联Vnet-S算法。文献[26]和文献[27]的方法不光采用了二维分割网络,还采用了级联结构,在计算量上是远大于级联Vnet-S算法,在准确度接近的情况下,级联Vnet-S算法在临床应用方面具有更大的优势。

5.4 定位算法讨论

本文的器官定位采用了图像分割的方式,但直接利用图像分割结果无法对器官进行准确定位,因为Vnet-S网络给出的分割结果存在假阳性,部分假阳性体素点和器官没有连接,对这部分假阳性点直接采用选择最大连接通量的方式进行过滤,过滤之后的分割结果仍然无法进行合适的定位。 本文随机抽取了20例肝脏CT影像数据进行测试,直接使用过滤后的分割结果进行定位,平均查全率(区域边界包含的器官体素点占器官所有体素点的比例)为0.9978,即在一些测试用例中,定位的器官边界没有包含全部属于器官的体素点,这将会导致后续的器官分割算法无法对完整的器官进行分割。没有准确定位的原因在于图像尺寸缩小到原来的1/4,丢失了边缘细节,導致器官边缘的分割精度不高,从而出现定位不准的问题。因此对过滤后的分割结果进行膨胀操作,放宽定位边界,以保证定位边界可以包含全部器官体素点。膨胀一次后查全率达到0.9999,膨胀两次后查全率为1.0000,因此本文采用膨胀两次再进行定位的方式。

5.5 级联Vnet-S讨论

与单一Vnet-S网络分割相比,先定位再分割的级联Vnet-S算法的分割准确度有明显提升。从表2、3可以看出,级联Vnet-S算法的分割准确度明显高于单一Vnet-S网络。

经过分析,提升的原因主要为以下两点:1)定位操作减小了背景的比例,缓解了类别不平衡问题,因为图像分割本质上是像素级的分类问题,类别不平衡会影响分割的准确度。本文对肝脏和肺数据集随机抽取了部分数据,统计定位前后器官体素和背景体素的比例,肝脏抽取了20例图像,肺抽取了100例图像,定位前后肝脏数据平均目标背景比值由0.022提高到0.160,肺平均目标背景比值由0.161提高到0.501,可以看出定位操作大大减小了背景的比例。

2)减小了缩小的比例,使用单一的Vnet-S网络时需要将图像数据缩小到原来的1/4,而级联Vnet-S网络结构在切割出器官区域后,只需缩小到原来的1/2,这样可以让分割的边缘细节准确度更高,因为过分缩小会丢失过多的图像特征,在将分割结果上采样还原的过程中,会出现较大的误差。

5.6 算法的不足

本文算法只适用于较大的器官,例如肺、肝脏、肾脏等,而人体中还存在像胰腺这类较小的器官,这类小型器官的分割对定位算法有更高的要求。本文提出的定位算法对小型器官无法进行准确的定位,原因在于:本文提出的图像分割式定位算法是先将图像缩小到原来的1/4,再对图像整体进行分割,因缩小图像而丢失的图像特征对于小型器官来说是过多的,导致分割结果会存在大量的假阳性,无法准确定位小型器官。对应的解决方案是采用较小的缩小系数进行扫描计算,并结合器官的位置信息作为先验,减少扫描范围。

本文提出的算法为有监督学习算法,在搭建器官的分割算法时,需要采用对应器官的数据集对模型进行训练,模型的训练依赖于数据的数量和质量,数量影响模型的泛化能力,质量决定模型的质量,对数据的依赖是该算法的一个弊端。

有效的后处理可以提高分割的准确度,例如条件随机场,因为Vnet-S模型的输出是一个高质量的概率图谱,可以使用条件随机场来优化分割结果。本文算法由于对整体计算量的考虑,没有采用后处理来优化分割结果,如果在某些应用场景中对分割准确度有更高的需求,可以加入后处理来继续提高分割的准确度。

6 结语

本文提出了Vnet-S网络和基于级联Vnet-S网络的单一器官自动分割算法。Vnet-S网络是在Vnet网络基础上改进得到的,相比Vnet网络,它需要的参数量和计算量更少。器官分割算法采用级联结构,由两个Vnet-S网络级联而成,分别用于器官定位和器官分割,通过先定位再分割的方式有效提高了分割准确率。肝脏分割和肺分割实验的结果验证了本文算法能够准确快速地对器官进行分割。但该算法也存在不足之处,如只适用于较大的器官、依赖准确的真实标记数据来训练模型、缺少后处理等,后续将针对这些不足作进一步研究。

参考文献

[1] MORTEL K J, CANTISANI V, TROISI R, et al. Preoperative liver donor evaluation: imaging and pitfalls [J]. Liver Transplantation, 2003, 9(9): S6-S14.

[2] SUZUKI K, KOHLBRENNER R, EPSTEIN M L, et al. Computer-aided measurement of liver volumes in CT by means of geodesic active contour segmentation coupled with level-set algorithms[J]. Medical Physics, 2010, 37(5): 2159-2166.

[3] ARMATO S G 3rd, SENSAKOVIC W F. Automated lung segmentation for thoracic CT: impact on computer-aided diagnosis [J]. Academic Radiology, 2004, 11(9): 1011-1021.

[4] UKIL S, REINHARDT J M. Smoothing lung segmentation surfaces in three-dimensional x-ray CT images using anatomic guidance [J]. Academic Radiology, 2005, 12(12): 1502-1511.

[5] ZHANG X, TIAN J, DENG K, et al. Automatic liver segmentation using a statistical shape model with optimal surface detection [J]. IEEE Transactions on Biomedical Engineering, 2010, 57(10): 2622-2626.

[6] BADAKHSHANNOORY H, SAEEDI P. A model-based validation scheme for organ segmentation in CT scan volumes [J]. IEEE Transactions on Biomedical Engineering, 2011, 58(9): 2681-2693.

[7] SUN SH, BAUER C, BEICHEL R. Automated 3-D segmentation of lungs with lung cancer in CT data using a novel robust active shape model approach [J]. IEEE Transactions on Medical Imaging, 2012, 31(2): 449-460.

[8] JI H, HE J, YANG X, et al. ACM-based automatic liver segmentation from 3-D CT images by combining multiple atlases and improved mean-shift techniques [J]. IEEE Journal of Biomedical and Health Informatics, 2013, 17(3): 690-698.

[9] ZHANG X, TIAN J, XIANG D, et al. Interactive liver tumor segmentation from CT scans using support vector classification with watershed [C]// Proceedings of the 2011 Annual International Conference of the IEEE Engineering in Medicine and Biology Society. Piscataway, NJ: IEEE, 2011: 6005-6008.

[10] KORFIATIS P, KALOGEROPOULOU C, KARAHALIOU A, et al. Texture classification-based segmentation of lung affected by interstitial pneumonia in high-resolution CT [J]. Medical Physics, 2008, 35(12): 5290-5302.

[11] SHELHAMER E, LONG J, DARRELL T. Fully convolutional networks for semantic segmentation [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(4): 640-651.

[12] RONNEBERGER O, FISCHER P, BROX T. U-Net: convolutional networks for biomedical image segmentation [C]// Proceedings of the 2015 International Conference on Medical Image Computing and Computer-Assisted Intervention, LNCS 9351. Cham: Springer, 2015: 234-241.

[13] IEK , ABDULKADIR A, LIENKAMP S S, et al. 3D U-Net: learning dense volumetric segmentation from sparse annotation [C]// Proceedings of the 2016 International Conference on Medical Image Computing and Computer-Assisted Intervention, LNCS 9901. Cham: Springer, 2016: 424-432.

[14] MILLETARI F, NAVAB N, AHMADI S. V-Net: fully convolutional neural networks for volumetric medical image segmentation [C]// Proceedings of the 4th International Conference on 3D Vision. Piscataway, NJ: IEEE, 2016: 565-571.

[15] 郭樹旭, 马树志, 李晶,等. 基于全卷积神经网络的肝脏CT影像分割研究[J]. 计算机工程与应用, 2017, 53(18): 126-131. (GUO S X, MA S Z, LI J, et al. Fully convolutional neural network for liver segmentation in CT image [J]. Computer Engineering and Applications, 2017, 53(18): 126-131.)

[16] NEGAHDAR M, BEYMER D, SYEDA-MAHMOOD T. Automated volumetric lung segmentation of thoracic CT images using fully convolutional neural network [C]// Proceedings of the Medical Imaging 2018: Computer-Aided Diagnosis, SPIE 10575. Bellingham, WA: SPIE, 2018: 1-6.

[17] 孫明建, 徐军, 马伟,等. 基于新型深度全卷积网络的肝脏CT影像三维区域自动分割[J]. 中国生物医学工程学报, 2018, 37(4): 385-393. (SUN M J, XU J, MA W, et al. A new fully convolutional network for 3D liver region segmentation on CT images [J]. Chinese Journal of Biomedical Engineering, 2018, 37(4): 385-393.)

[18] JANSSENS R, ZENG G, ZHENG G. Fully automatic segmentation of lumbar vertebrae from CT images using cascaded 3D fully convolutional networks [C]// Proceedings of the 2018 IEEE 15th International Symposium on Biomedical Imaging. Piscataway, NJ: IEEE, 2018: 893-897.

[19] ROTH H R, ODA H, HAYASHI Y, et al. Hierarchical 3D fully convolutional networks for multi-organ segmentation [J]. arXiv E-print, 2017: arXiv:1704.06382. [EB/OL]. [2017-04-21]. http://arxiv.org/abs/1704.06382.pdf.

[20] IOFFE S, SZEGEDY C. Batch normalization: accelerating deep network training by reducing internal covariate shift [C]// Proceedings of the 32nd International Conference on International Conference on Machine Learning. [S.l.]: JMLR, 2015: 448-456.

http://de.arxiv.org/pdf/1502.03167

[21] HE K, ZHANG X, REN S, et al. Deep residual learning for image recognition [C]// Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2016: 770-778.

[22] SRIVASTAVA N, HINTON G, KRIZHEVSKY A, et al. Dropout: a simple way to prevent neural networks from overfitting[J]. The Journal of Machine Learning Research, 2014, 15(1): 1929-1958.

[23] KINGMA D P, BA J L. Adam: a method for stochastic optimization [J]. arXiv E-print, 2017: arXiv:1412.6980. [EB/OL]. [2017-01-30]. https://arxiv.org/abs/1412.6980.pdf.

[24] KALUVA K C, KHENED M, KORI A,et al. 2D-densely connected convolution neural networks for automatic liver and tumor segmentation [J]. arXiv E-print, 2018: arXiv:1802.02182. [EB/OL]. [2018-01-05]. http://arxiv.org/abs/1802.02182.pdf.

[25] VORONTSOV E, TANG A, PAL C, et al. Liver lesion segmentation informed by joint liver segmentation [C]// Proceedings of the IEEE 15th International Symposium on Biomedical Imaging. Piscataway, NJ: IEEE, 2018: 1332-1335.

[26] LI X, CHEN, QI X, et al. H-DenseUNet: hybrid densely connected UNet for liver and tumor segmentation from CT volumes [J]. IEEE Transactions on Medical Imaging, 2018, 37(12): 2663-2674.

[27] YUAN Y, BUCKSTEIN M, LO Y. Automatic liver and tumor segmentation using hierarchical convolutional-deconvolutional neural networks with jaccard distance [J]. Medical Physics, 2018, 45(6): E516.