加权信息熵与增强局部二值模式结合的人脸识别

2019-10-23丁莲静刘光帅李旭瑞陈晓文

丁莲静 刘光帅 李旭瑞 陈晓文

摘 要:針对人脸识别因光照、姿态、表情、遮挡及噪声等多种因素的影响而导致的识别率不高的问题,提出一种加权信息熵(IEw)与自适应阈值环形局部二值模式(ATRLBP)算子相结合的人脸识别方法(IE(w)ATR-LBP)。首先,从原始人脸图像分块提取信息熵,得到每个子块的IEw;然后,利用ATRLBP算子分别对每个人脸子块提取特征从而得到概率直方图;最后,将各个块的IEw与概率直方图相乘,再串联成为原始人脸图像最后的特征直方图,并利用支持向量机(SVM)对人脸进行识别。在AR人脸库的表情、光照、遮挡A和遮挡B四个数据集上,IE(w)ATR-LBP方法分别取得了98.37%、94.17%、98.20%和99.34%的识别率。在ORL人脸库上,IE(w)ATR-LBP方法的最大识别率为99.85%;而且在ORL人脸库5次不同训练样本的实验中,与无噪声时相比,加入高斯和椒盐噪声后的平均识别率分别下降了14.04和2.95个百分点。实验结果表明,IE(w)ATR-LBP方法能够有效提高人脸在受光照、姿态、遮挡等影响时的识别率,尤其是存在表情变化及脉冲类噪声干扰时的识别率。

关键词:人脸识别;局部二值模式;加权信息熵;自适应阈值;深度学习

中图分类号: TP391.4

文献标志码:A

Face recognition combining weighted information entropy with enhanced local binary pattern

DING Lianjing, LIU Guangshuai*, LI Xurui, CHEN Xiaowen

School of Mechanical Engineering, Southwest Jiaotong University, Chengdu Sichuan 610031, China

Abstract: Under the influence of illumination, pose, expression, occlusion and noise, the recognition rate of faces is excessively low, therefore a method combining weighted Information Entropy (IEw) with Adaptive-Threshold Ring Local Binary Pattern (ATRLBP) (IEwATR-LBP) was proposed. Firstly, the information entropy was extracted from the sub-blocks of the original face image, and then the IEw of each sub-block was obtained. Secondly, the probability histogram was obtained by using ATRLBP operator to extract the features of face sub-blocks. Finally, the final feature histogram of original face image was obtained by concatenating the multiplications of each IEw with the probability histogram, and the recognition result was calculated through Support Vector Machine (SVM). In the comparison experiments on the illumination, pose, expression and occlusion datasets from AR face database, the proposed method achieved recognition rates of 98.37%, 94.17%, 98.20%, and 99.34% respectively; meanwile, it also achieved the maximum recognition rate of 99.85% on ORL face database. And the average recognition rates in 5 experiments with different training samples were compared to conclude that the recognition rate of samples with Gauss noise was 14.04 percentage points lower than that of samples without noise, while the recognition rate of samples with salt & pepper noise was only 2.95 percentage points lower than that of samples without noise. Experimental results show that the proposed method can effectively improve the recognition rate of faces under the influence of illumination, pose, occlusion, expression and impulse noise.

本文提出了一种结合加权信息熵与自适应阈值环形局部二值模式的人脸识别方法,利用信息熵对被分块的人脸图像信息加权,以确定提取特征在识别中的比重,提出的环形局部模式算子在原始LBP基础上,进一步优化了局部特征的提取方式,再加上自适应阈值的融合,在增加抗干扰能力的同时,最后的人脸识别率有了显著提高。实验结果表明,该方法能够有效提高人脸在光照、姿态、遮挡、噪声等影响下,尤其表情变化下的识别率。

1 局部二值模式及相关变体

1.1 LBP特征

LBP最初由Ojala等[13]提出来,被看作是一种灰度范围内的纹理度量。最起初的LBP算子定义为:在某中心像素及其周围大小为3×3的矩形邻域,将中心像素的每个邻域像素值以该中心像素的灰度值为阈值进行二值量化,大于或等于中心像素的像素值则编码为1,小于则编码为0,以此形成一个局部二进制模式,将阈值化后的值(即0或者1)分别与对应位置像素的权重相乘,8个乘积的和即为该邻域的LBP值(即十进制值)。具体计算方法举例如图 1所示。

编码公式如下:

LBP(xc,yc)=∑ P-1 p=0 2ps(ip-ic);

s(x)= 1, x≥00, 其他

(1)

式中:(xc,yc)是中心像素,ic為其灰度值;P为邻域内除中心像素外像素总数;第p个像素灰度值为ip;s(x)为符号函数。

LBP最终得到的直方图维数为2P,即维数将会随邻域样本点个数P的增加呈现指数形式的增加,所以Ojala等[14]又提出了ULBP算子对原始LBP提取到的结果进行映射降维,很大程度地降低了计算量。

1.2 CS-LBP特征

CS-LBP[15]是取关于中心点对称的一对像素进行差值计算,在LBP基础上,CS-LBP减少了计算量,其计算量只有基本LBP的一半。它的编码方式如下:

CS-LBPR,N,T(x,y)= ∑ (N/2)-1 i=0 s(ni-ni+(N+2))2i;

s(x)= 1, x≥T0, 其他

(2)

式中:ni和ni+(N+2)分别是关于中心点对称两个点的像素灰度值,N是计算区域内除中心像素外的像素总数,T为阈值。

1.3 MB-CSLBP特征

MB-CSLBP[16]是在CS-LBP基础上,把图像分成大小相等的正方形块,然后求取各个块的平均值,把CS-LBP算子中的单个像素点的灰度值替换成用块所求得的平均灰度值,从而得到最后的二进制编码,该方法编码过程举例如图2所示。与CS-LBP一样,该算子与LBP算子相比,最后得到的维数较低,对噪声具有鲁棒性,同时也在某种程度上表达了图像的宏观结构,降低了图像空间信息的损失,增强了分类效果。它的编码方式如下:

MB-CSLBP=∑ 3 i=0 s(Bi-Bi+4)2i;

B=∑ L2-1 k=0 gk, s(x)= 1, x≥T0, 其他

(3)

式中:Bi为第i个正方形块平均灰度值,gk为原图像第k个像素点灰度值,L为正方形块边长,T为阈值。

2 加权信息熵

Shannon[23]在1948年提出了信息熵(Information Entropy,IE)的概念,将热力学概率扩展到系统各种信息源的发生概率,一个离散随机信号X(x1,x2,…,xt)发生的概率为p(x1),p(x2),p(x3),…,p(xt),则它们的信息熵H(x)可以描述为:

H(x)=∑ t i=1 p(xi)lg 1 p(xi) =-∑ t i=1 p(xi)lgp(xi)

(4)

计算机采用高低电频(开关数0或者1)进行计算,取对数底为2,一幅数字图像的f(x,y)信息熵E可以表示如下:

E=-∑ k k=1 pklb(pk); 0≤pk≤1, ∑ 255 k=1 (pk)=1

(5)

式中:k表示像素级数,由于选取的图像为灰度人脸图像,所以0≤k≤255,pk表示第k级像素点出现的概率。E表示信息的无序程度,其值越大,该类信息对最后的识别贡献越低。假设人脸被分为m块,第i块信息熵Ei决定它在最后直方图中的占比,Ei越大,则赋予它越小的权重。由此,定义信息偏差度:

di=1-Ei

(6)

得第i块的权重为:

wi= di ∑ m i=1 di = 1-Ei m-∑ m i=1 Ei ;

wi∈(0,1),∑(wi)=1, i=1,2,…,m

(7)

3 本文方法

3.1 自适应阈值环形局部二值模式

受MB-CSLBP算子启发,本文提出自适应阈值环形局部二值模式(Adaptive Threshold Ring Local Binary Pattern, ATRLBP)提取人脸特征,如图3,即以一个像素点nc为中心,结合其周围的8个相邻像素点,形成一个3×3局部邻域。首先,分别按环形作差值计算周围8个像素,得到8对差值,其中差值形式有绝对值和非绝对值两种,分别定义为yesABS、noABS;其次,将每个差值与阈值T比较,如果大于或等于T,该值为1,否则为0,生成8位二进制编码字符串,其中的阈值T为该邻域块均值大小的n(%)倍,n为自适应值,范围为[0.01,0.09],根据实验最终确定最佳值;最后,利用ULBP算子进行降维映射(mapping)。对于一张256阶灰度人脸图,最终得到与原始图像大小相同的结果矩阵,直方图维数为59。编码方式如下:

ATRLBP= s(n1-n2)20+s(n2-n3)21+, …,+s(n8-n1)27;

s(u)= 1, u≥T0, 其他 ;

T=n× 1 P+1 ∑ P-1 i=0 (ni+nc)

(8)

式中:n1到n8为邻域内依次排列的8个像素点,nc为中心像素点。

采用ATRLBP算子在ORL人脸库分别随机提取两个人各5张图片生成的人脸图像纹理特征如图4所示。

3.2 结合IE(w)的ATRLBP特征

文献[24]首次在人脸识别中提出了分块,由于增强了空间性,在一定程度上提高了识别率;但该方法只是单纯地把人脸图像划分为横竖N×N大小的子块,并未讨论划分后的各个子块所包含的信息对最终识别的贡献。实际上,每个人脸子块表达了不同的纹理细节,对于具有丰富纹理细节的子块,应该赋予该子块更大的权重,使最后得到的纹理特征最大限度反映人脸图像。

由第2章知,对人脸图像进行分块以保留人脸空间信息,采用ATRLBP算子提取出各个人脸子块的纹理特征,将其与各个人脸子块信息熵(IE)对应的权值wi融合起来得到最后的特征直方圖V,并定义为IE(w)ATR-LBP,整个流程如图5

所示。此处需要注意,为了准确表示各个级别所得直方图横纵轴数值级别,图5中所有直方图来自实验中的随机时刻,具 体数值并不对应所显示人脸图片,只是作流程说明,但是所有直方图横纵轴所对应的数值级别一致。

V =(w1v1,w2v2,…,wmvm)

(9)

式中:(v1,v2,…,vm)表示各个人脸子块用本文ATRLBP算子

提取到的概率直方图向量;(w1,w2,…,wm)分别为1到m块的信息熵权重; V 为一张人脸图像最终直方图向量。

采用所提出的IE(w)ATR-LBP方法遍历256阶灰度人脸图像一次,结果为28维,即最终得到256维直方图;如果分块4×4并统一映射降维,则一张人脸图像的最终直方图维数为59×16=944。

从ORL人脸库随机挑选一张人脸图像,采用ATR-LBP算子,在有/无加权信息熵两种情况下生成直方图,如图6所示,分块大小为4×4。

4 差值形式与自适应阈值的确定

确定差值形式与自适应阈值

4.1 实验用人脸库

本文所有实验均选用AR和ORL两大标准人脸图像数据库作训练及测试用,其中的部分人脸图像示例如图7、8所示。

AR人脸库由100人、每人26张彩色图像组成,大小为 165×120。这些图像均来自同一个体在两个不同时期当表情、遮挡、光照等一系列条件变化时的情况。前期拍摄出前13张照片,后13张来自于第二个时期,时间上前后相差仅仅14天。实验中所有图像均为灰度化之后的图像。图7是其中一个个体的26张灰度图,从左到右:第1张为原始参考;第2~4张为表情变化;第5~7张为光照变化,光源方向依次为右、左、正面;后6张为物品遮挡,包含遮挡集A(眼镜)和遮挡集B(围脖),同时附带光照变化。

ORL人脸数据库包含2年内采集的40个人(不同年龄、性别、种族对象),每个人10张112×92大小的人脸灰度图像,包括微小光照变化、表情变化(睁/闭眼,笑/不笑)、人脸细节(带/不带眼镜)、人脸姿态变化、20%以内的尺度变化等。该库是目前使用最广泛的标准人脸数据库之一,它含有大量的比较结果。图8是裁剪为80×80的两个对象的例子。

4.2 差值形式

在AR、ORL人脸库分别设置对比实验,本文的所有分类任务均采用台湾大学林智仁(Lin Chih-Jen)副教授等开发设计的libSVM分类器进行分类识别,且识别率是10次识别的均值。mapping/noABS中mapping表示采用了统一描述算子降维,noABS表示环形相邻点之间差值形式不采用绝对值,其余以此类推。

1)AR人脸数据库。每个人有26张人脸图像,从中随机选取训练样本数从1到13张,形成13次结果数据,结果如图9所示。

可以看出,在识别率方面,随着训练样本数量的增加,四种特征提取方法的识别率都呈现对数式增加。nomapping/noABS方法同样本条件下识别率最高,当训练样本数达到13时,识别率高达98.30%;紧随其后为mapping/noABS,其整体识别率与前者相差并不大,最高也能达到9786%;采用绝对值(yesABS)的方法的识别率较低。这说明降维或者不降维对本文提出的IE(w)ATR-LBP方法的识别率没有决定性影响,如若采用绝对值的形式,得到的识别率较低。在历时方面,noMapping/noABC与noMapping/yesABC两种方法基本重合,计算量都很大;另外两种方法计算量却小很多。

2)ORL人脸数据库。

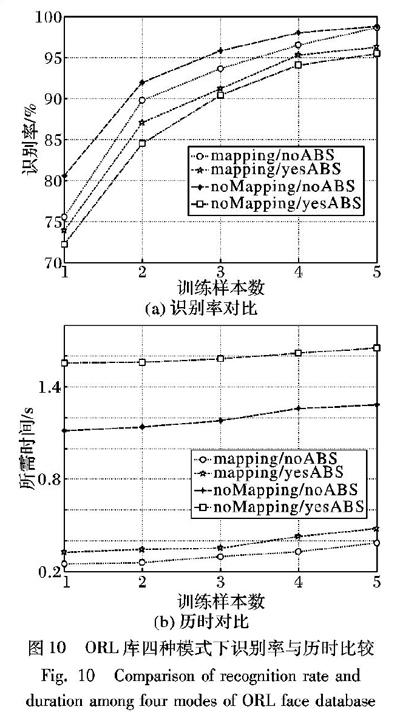

每个人有10张样本,从中随机选取训练样本数1到5,得到5次实验数据,结果如图10所示。

ORL人脸库的实验结果表明,除去与AR人脸库本身的差异外,两组数据趋势严格保持一致。

结合AR及ORL人脸库实验结果,综合考虑识别率和计算量,mapping/noABS是个很好的选择,既达到了本文需要的识别精度,计算量也相对较少。

4.3 自适应阈值

为了得到最佳自适应阈值T,采用IE(w)ATR-LBP方法,在mapping/noABS模式下,取n值分别为0到0.09,步长为0.01的十组数,分别针对AR和ORL人脸库,得到十组实验结果,从而确定最终的n值。

AR人脸库每个个体采用10个训练样本,ORL人脸库则采用4个训练样本,实验结果如图 11所示。从AR的实验结果来看,当n=0.01时,有最大识别率,当n=0时,识别率仅次于n=0.01时,且随着n值增大,识别率呈滑坡式下降;ORL库在n=0.03处达到最大识别率。

实验结果说明:阈值T可以增强ATRLBP算子在平滑图像灰度差异方面的鲁棒性,且最大识别率出现在n值的初期阶段;造成识别率呈滑坡式下降的主要原因是T值过大(n值过大),导致被提取出的二值编码全部为0。此外,从人脸图像本身来看,局部邻域内像素值之间的差值非常小,对相邻像素更是如此,所以,T应该是一个在一定范围内的较小的正数。在人脸图像特征提取过程中,本文采取对比实验最终确定n=0.02,即最终确定本文的ATRLBP算子形式为Mapping/noABS,且阈值T等于均值的0.02倍。

5 实验结果与分析

5.1 抗噪鲁棒性验证

ORL人脸库包含微小光照变化,用直方图均衡方法去除光照影响,人为加入高斯和椒盐两种类型噪声,验证在噪声影响下本文方法的识别率,

结果如表 1所示。可以看出,在不加噪声情况下识别率最高为98.85%,最低为80.56%,说明IE(w)ATR-LBP方法对人脸表情及姿态变化具有良好鲁棒性;加入高斯、椒盐噪声后识别率均有所下滑,但椒盐识别率下滑不明显,样本数为1时下降了5.75个百分点,样本数为5时仅下降了0.27个百分点;再次对比无噪声、加入高斯噪声和加入椒鹽噪声在5次不同训练样本实验下的平均识别率,加入高斯噪声后的平均识别率下降了14.04个百分点,而加入椒盐噪声后仅下降了2.95个百分点,说明IE(w)ATR-LBP方法对脉冲类噪声有良好的抗噪性。

5.2 不同方法对比验证

为了验证IE(w)ATR-LBP人脸识别方法在光照、人脸表情和姿态、遮挡等因素影响下的鲁棒性,与部分方法分别在ORL与AR人脸库进行对比实验,结果见表2~4。

在ORL人脸库分别选取S=2及S=5张人脸图像作训练样本,剩余作测试样本;将AR人脸库分为四个集进行实验,分别是表情集、光照集、遮挡集A、遮挡集B,每个人脸集分别取3张人脸图像作为训练样本,剩余作测试样本。SVM分类识别阶段均采自10次结果的平均值,增加结果稳定性。

表2是各对比方法在2张训练样本与5张训练样本两种情况下的10次平均识别率,IE(w)ATR-LBP人脸识别方法基本能达到最高识别率,在S=5时有最大识别率98.85%。识别率大小与IE(w)ATR-LBP人脸识别方法最接近的是文献[22]中提出的基于稀疏表示并且融合三种特征的人脸识别方法,但由于该方法融合了三种特征,如果不对数据作降维处理,计算量将非常大,若采取降维处理又将损失一定的特征信息,不能得到如此高的识别率。文献[21]中提出的对人脸分块加上信息熵的方式识别人脸,在本次实验中同样得到了不错的识别率,侧面证明了IE(w)ATR-LBP人脸识别方法的可靠性,但由于本文改进的LBP算子与该文提出的算子相比,不管是在特征有效性还是计算量上都更占优势,所以IE(w)ATR-LBP人脸识别方法也得到了更高的识别率。

由表3可知,AR人脸库的实验结果趋势基本与ORL人脸库保持一致,本文方法在四个集中得到的识别率分别为98.37%、94.17%、98.20%、99.34%,其中在光照集的识别率不太理想,原因在于:1)光照变化导致人脸图像的像素出现大范围的改变;2)对于光照变化后的人脸图像,IE(w)ATR-LBP方法的分块处理导致不同光照下的人脸图像所得特征结果差异很大。对比AR人脸库其他3个数据集的识别率,IE(w)ATR-LBP方法区分局部特征改变的人脸图像更加有效。

由于小样本时对深度学习无太大意义,所以在ORL及AR两个人脸库的对比实验设置如下:采用五步交叉验证法进行训练与测试,样本分配比例设置为4∶ 1。即将各个人脸库的总样本均分为5份,实验时,选取其中4/5用来作训练,剩下的用作测试。对于ORL人脸库,因为每人有10张人脸图像,故对于每类人脸图像,训练样本数与测试样本数的比例为8∶ 2,训练样本总数为320个,每次随机地选取2个样本输入训练,测试样本总数为80。对于AR人脸库,选择其前一个时期的12张人脸图像作为数据库,故训练样本数与测试样本数的比例为9∶ 3。

由表4对比不同方法在两个人脸库上的识别率不难发现,IE(w)ATR-LBP方法在10次均值下所得识别率均要高于对比方法。当训练样本数足够大时,三种基于深度学习的方法确实能达到较高的识别率,但当训练样本数不足甚至是单样本时,其识别率会严重下降,计算量也较大,而本文基于特征提取融合人脸轮廓空间信息的IE(w)ATR-LBP方法在低训练样本数下更具优势。

6 结语

本文提出了加权信息熵与ATRLBP算子结合进行人脸特征提取的方法IE(w)ATR-LBP。加权信息熵既很好地保留了原始人脸图像的空间信息,也对人脸重要部分作了权值判断;ATRLBP算子对人脸图像局部区域进行邻域环形差值编码,并用实验数据最终确定“差值形式”与“自适应阈值T”。IE(w)ATR-LBP方法能够有效提高人脸在光照、姿态、遮挡等因素,尤其表情变化及脉冲类噪声干扰情况下的识别率。

由于采用的数据库为现阶段标准的人脸数据库ORL及AR,IE(w)ATR-LBP方法在更复杂的自建库中的通用性可能还不是很强。因此,下一步的研究方向是,提高算法在复杂度更高的人脸图像中的识别率,以及进一步提高人脸识别效率。

参考文献

[1] TURK M, PENTLAND A. Eigenfaces for recognition [J]. Journal of Cognitive Neuroscience,1991,3(1): 71-86.

[2] CHELLAPPA R, WILSON C L, SIROHEY S. Human and machine recognition of faces: a survey [J]. Proceedings of the IEEE, 1995, 83(5): 705-741.

[3] BELHUMEUR P N, HESPANHA J P, KRIEGMAN D J. Eigenfaces vs. Fisherfaces: recognition using class specific linear projection [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1997, 19(7): 711-720.

[4] 彭中亚,程国建.基于独立成分分析和核向量机的人脸识别[J].计算机工程,2010,36(7):193-194. (PENG Z Y, CHENG G J. Face recognition based on independent component analysis and core vector machines [J]. Computer Engineering, 2010, 36(7):193-194.)

[5] 胡敏,余子玺,王晓华,等.G-LBP和方差投影交叉熵的人脸识别[J].图学学报,2017,38(1):82-89. (HU M, YU Z X, WANG X H, et al. G-LBP and variance cross projection function for face recognition [J]. Journal of Graphics, 2017, 38(1): 82-89.)

[6] 梁淑芬,刘银华,李立琛.基于LBP和深度学习的非限制条件下人脸识别算法[J].通信学报,2014,35(6):154-160. (LIANG S F, LIU Y H, LI L C. Face recognition under unconstrained based on LBP and deep learning [J]. Journal on Communications, 2014, 35(6): 154-160.)

[7] LECUN Y, BOSER B, DENKER J S, et al. Backpropagation applied to handwritten zip code recognition [J]. Neural Computation, 1989, 1(4): 541-551.

[8] SZEGEDY C, LIU W, JIA Y, et al. Going deeper with convolutions [C]// Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2015: 1-9.

[9] HE K, HANG X, REN S, et al. Deep residual learning for image recognition [C]// Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE, 2016: 770-778.

[10] 楊瑞, 张云伟, 苟爽, 等. Gabor特征与深度信念网络结合的人脸识别方法[J]. 传感器与微系统, 2017, 36(5): 68-70. (YANG R, ZHANG Y W, GOU S, et al. Face recognition algorithm based on Gabor feature and DBN [J]. Transducer and Microsystem Technologies, 2017, 36(5): 68-70.)

[11] 江大鹏, 杨彪, 邹凌. 基于LBP卷积神经网络的面部表情识别[J]. 计算机工程与设计, 2018, 39(7): 1971-1977. (JIANG D P, YANG B, ZOU L. Facial expression recognition based on local binary mode convolution neural network [J]. Computer Engineering and Design, 2018, 39(7): 1971-1977.)

[12] SUN K, YIN X, YANG M, et al. The face recognition method based on CS-LBP and DBN [J]. Mathematical Problems in Engineering, 2018, 2018: No. 3620491.

[13] OJALA T, PIETIKINEN M, HARWOOD D. A comparative study of texture measures with classification based on featured distributions [J]. Pattern Recognition, 1996, 29(1): 51-59.

[14] OJALA T, PIETIKINEN M, MAENPAA T. Multiresolution gray-scale and rotation invariant texture classification with local binary patterns [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2002, 24(7): 971-987.

[15] HEIKKL M, PIETIKINEN M. A texture-based method for modeling the background and detection moving objects [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2006, 28(4): 657-662.

[16] HEIKKIL M, PIETIKINEN M, SCHMID C. Description of interest regions with local binary patterns [J]. Pattern Recognition, 2009, 42(3): 425-436.

[17] TAN X, TRIGGS B. Enhanced local texture feature sets for face recognition under difficult lighting conditions [J]. IEEE Transactions on Image Processing, 2010, 19(6): 1635-1650.

[18] GUO Z, ZHANG L, ZHANG D. Rotation invariant texture classification using LBP Variance (LBPV) with global matching [J]. Pattern Recognition, 2010, 43(3): 706-719.

[19] 王燕, 王芸芸. 一种DCT和ELBP融合的人脸特征提取方法[J]. 计算机工程与应用, 2017, 53(4): 170-175. (WANG Y, WANG Y Y. Face feature extraction method based on fusing DCT and ELBP features [J]. Computer Engineering and Applications, 2017, 53(4): 170-175.

[20] WEI X, WANG H, GUO G, et al. Multiplex image representation for enhanced recognition [J]. International Journal of Machine Learning & Cybernetics, 2018, 9(3): 383-392.

[21] 張洁玉, 武小川. 加权局部二值模式的人脸特征提取[J]. 中国图象图形学报, 2018, 19(12): 1794-1801. (ZHANG J Y, WU X C. Feature extraction of faces based on a weighted local binary pattern [J]. Journal of Image and Graphics, 2018, 19(12): 1794-1801.)

[22] 木立生, 吕迎春. 基于稀疏表示与特征融合的人脸识别方法[J]. 现代电子技术, 2018, 41(9): 83-86,90. (MU L S, LYU Y C. Face recognition method based on sparse representation and feature fusion [J]. Modern Electronics Technique, 2018, 41(9):83-86,90.)

[23] SHANNON C E. A mathematical theory of communication [J]. Bell Labs Technical Journal, 1948, 27(3): 379-423.

[24] AHONEN T, HADID A, PIETIKINEN M. Face recognition with local binary patterns [C]// Proceedings of the 2004 European Conference on Computer Vision, LNCS 3021. Berlin: Springer, 2004: 469-481.