自动选取辅助目标的建筑物目标间接定位方法

2019-10-10涂直健张天序桑红石

涂直健,张天序,,桑红石

(1.武汉工程大学 电气信息学院,湖北 武汉 430205;2.华中科技大学 自动化学院,湖北 武汉 430074)

引言

在实际目标识别过程中,处于复杂背景下的地面建筑物目标易受背景干扰而出现目标不显著、遮挡和移出视场外等情况。而当前对红外目标的研究和应用主要针对与背景具有高对比度且目标特征明显的显著目标[1-5]。在目标识别、跟踪过程中因目标处于上述情况而出现虚警或丢失等问题会大大降低目标识别算法的识别率。

针对不显著目标或被遮挡目标的识别问题,文献[6]提出了一种更符合人类视觉导航特点的间接定位方法,即先在地面准备阶段选取地标并进行地标参考图制备,在目标识别阶段,采用模板匹配算法先识别和定位地标位置,然后利用地标与目标空间约束关系的先验知识,由成像姿态参数反过来解算目标在实时图中的位置,间接定位包含目标的局部感兴趣区。当目标显著时对目标进行直接识别操作。文献[7]借鉴并改进了文献[6]的间接定位方法,不依赖地标多尺度视图及成像姿态参数,而是由预先获取的参考图中选取显著区域,通过解算实时图与基准图之间的变换关系实现对复杂背景下不显著目标的定位,但该方法只适用于图像中的景物具有相同或相近景深的情况,远距离探测时,定位偏差会随着显著区域与目标之间景深的增大而增大,并且定位结果也会受到预先获取的参考图的影响,识别效果受到限制。以上方法均采用间接定位的方式取得了一定的识别效果,然而它们都依赖于地标或显著区域的先验知识,并且在目标识别定位过程中,当选定的地标或显著区域与目标不能同时处于视场范围内的情况下,间接定位失效。遮挡问题是导致跟踪算法丢失目标的原因之一,针对此类问题,经典的处理方法有中心加权算法、轨迹预测算法、贝叶斯预测算法、多信息融合方法及基于人工智能策略抗遮挡目标跟踪方法[8-12]。对于目标跟踪过程中因遮挡或其他原因导致的目标丢失问题,间接定位是一种全新的思路。

针对上述问题,提出一种自动选取辅助目标的建筑物目标间接定位方法,其特点在于:提出的方法无需地标或显著区域的先验知识,而是在实时图中自动选取形状稳定、灰度显著区域作为辅助目标对不显著或被遮挡目标的间接定位。近年来,研究人员针对显著区域的提取问题提出了大量算法,适用于图像分割、目标检测及识别等领域的研究[13-15]。提出了一种新的显著区域的提取方法,同时,为克服辅助目标移出视场外而导致间接定位失效的情况,算法会对辅助目标进行实时更新,保证其能时刻处于视场中。本文算法融合辅助目标间接定位与其他目标识别、跟踪算法结果,解决目标虚警或丢失问题,提高跟踪稳定性。

1 算法总体描述

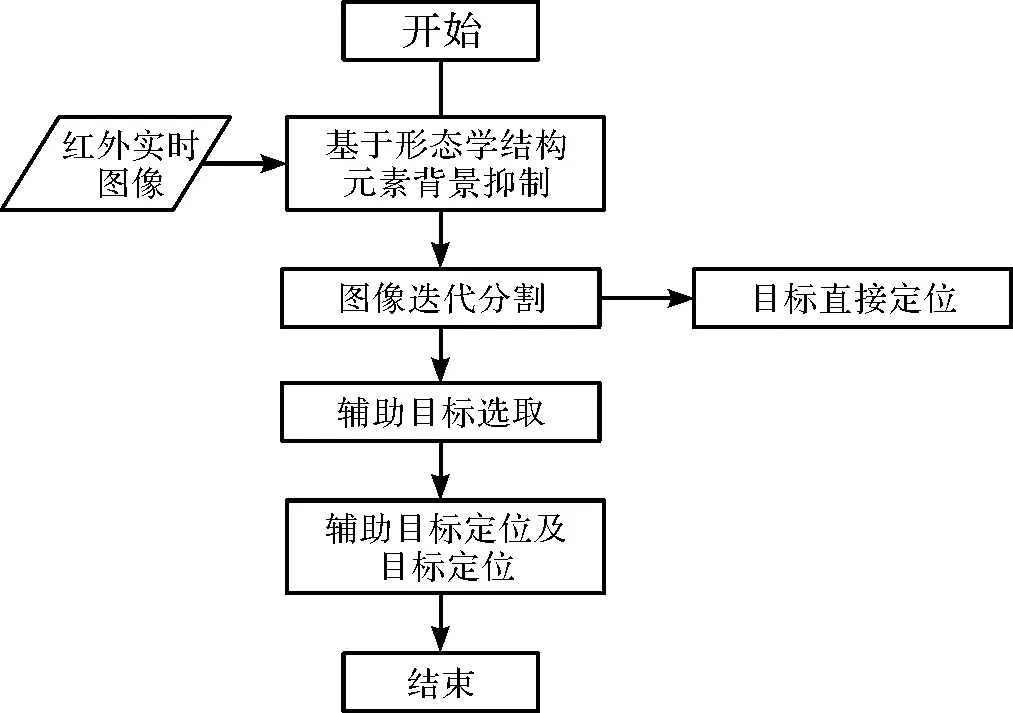

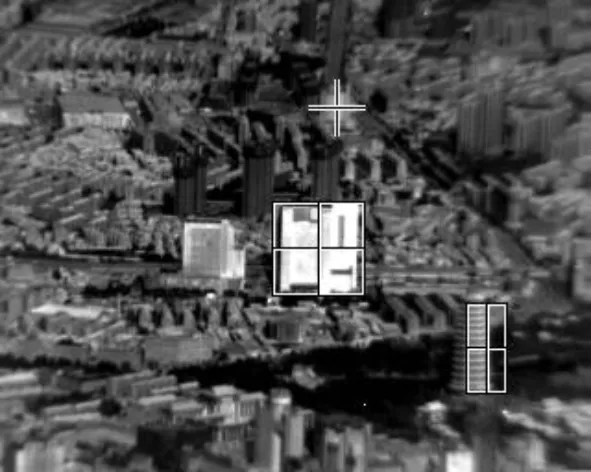

图1为算法流程图,选取图像中形状稳定、灰度显著区域作为辅助目标,提取辅助目标及目标相对位置关系,并根据辅助目标更新条件实时更新辅助目标,在目标直接定位算法出现目标虚警或丢失问题时,通过辅助目标位置及其与目标相对位置间接定位目标位置。

图1 算法流程图

算法包含3个部分:1)目标直接定位;2)辅助目标选取;3)辅助目标定位及目标定位。

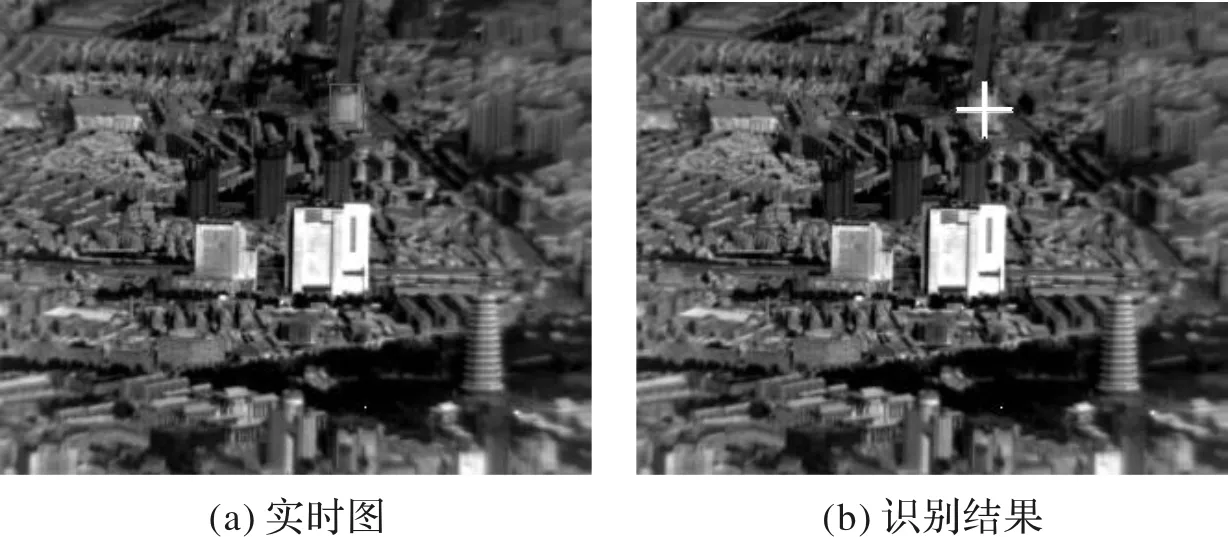

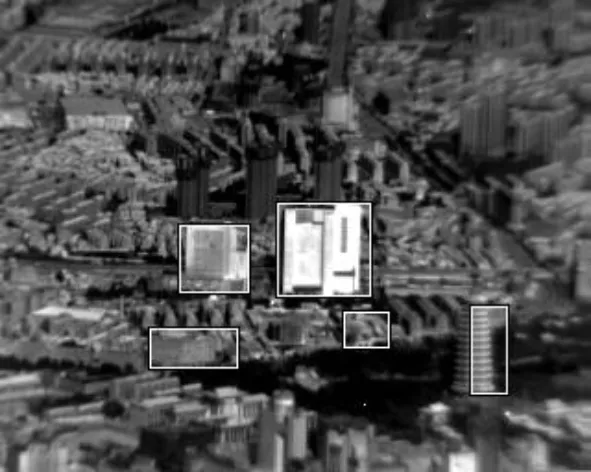

图2 目标直接识别结果

实验中第一部分目标直接定位采用文献[1]中提出的建筑物目标识别算法,并在序列图像中采用文献[1]算法及meanshift目标跟踪算法对目标进行跟踪。文献[1]采用基于飞行器传感器测量数据,根据目标三维参考模型,实时计算目标成像尺寸,并预测目标在该传感器参数下的模型特征。根据模型特征选取形态学结构元素对图像进行形态学背景抑制,根据背景抑制结果进行迭代分割,即先对图像进行灰度合并,之后采用不同阈值对图像进行分割,第一次分割阈值为图像最大灰度,之后通过一定步长不断修改分割阈值,直到达到停止条件。提取迭代分割得到的感兴趣区特征,提取特征与预测特征相匹配,确定候选目标,通过线特征验证,识别目标,其结果如图2所示,其中方框区域为目标区域,十字叉标记位置为目标直接识别结果。

2 辅助目标选取

从采用的文献[1]目标识别算法在迭代分割阶段得到的各分割区域中选取形状稳定、灰度显著区域作为辅助目标。在选取辅助目标后,根据辅助目标区域特征在之后的识别过程中对其进行定位,若辅助目标丢失、靠近图像边缘或达到一定识别帧数,则重新进入辅助目标选取流程。

2.1 辅助目标选取及特征提取

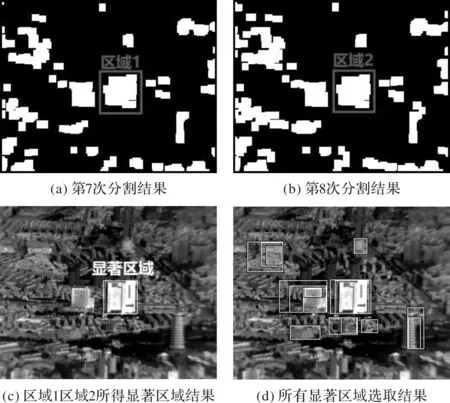

根据建筑物目标识别算法迭代分割结果,排除目标图像的边缘区域,保留具有一定面积且在连续两次迭代分割结果中处于同一位置且各感兴趣区域的形状特征相对误差不超过阈值threshold1的感兴趣区域作为显著区域,实验中threshold1取值为各区域形状特征的0.2倍,感兴趣区域形状特征包括区域高度、宽度、面积、矩形度,显著区域选取结果如图3所示,由图3(a)中区域1与图3(b)中区域2得到了图3(c)中显著区域,所有显著区域提取结果如图3(d)所示。

图3 显著区域选取结果

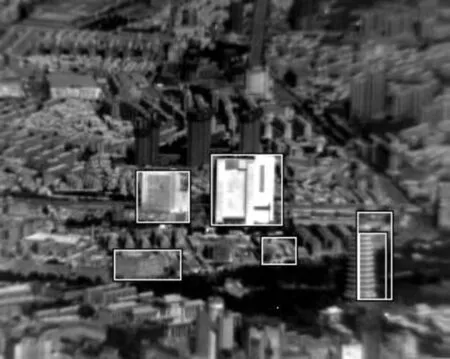

综合多帧的显著区域,从各帧对应的显著区域中,选取显著区域的形状特征相对误差不超过阈值threshold1的显著区域作为辅助目标候选区域,实验中选取5帧结果进行综合,辅助目标候选区域选取结果如图4所示。

图4 辅助目标候选区域选取结果

对同一位置上的辅助目标候选区域进行非极大值抑制处理。对位于同一位置的辅助目标候选区域,保留局部对比度最大的辅助目标候选区域作为辅助目标区域,并舍弃其他辅助目标候选区域,局部对比度定义如下:

(1)

式中:μB为区域局部背景区域平均灰度;μT为区域平均灰度。区域非极大值抑制结果如图5所示。

图5 非极大值抑制结果

从辅助目标候选区域中选取局部对比度最大的若干个区域作为辅助目标,实验中选取局部对比度最大的2个区域,如图6所示。

图6 辅助目标选取结果

2.2 辅助目标特征提取

通过目标直接识别得到目标位置后,保留辅助目标区域形状特征并提取其与目标相对位置。根据(2)式~(7)式计算t时刻辅助目标与目标在大地坐标系下的相对位置关系Δx、Δy,提取辅助目标与目标相对位置。

根据(2)式、(3)式计算目标与光轴瞄准点在大地坐标系下沿进入方向的偏移量,(2)式、(3)式如下所示:

(2)

(3)

式中:L1、L2表示目标与光轴瞄准点在大地坐标系下沿进入方向的横向、纵向偏移量;(X1,Y1)表示目标位置;θ表示当前时刻t获取的飞行器的俯仰夹角;h表示当前时刻t获取的飞行器飞行高度;NROW、NCOL表示实时图行数、列数,φ、φ表示飞行器的纵向、横向视场角。

根据(4)式、(5)式计算目标与光轴瞄准点在大地坐标系下沿正北方向上的偏移量,(4)式、(5)式如下所示:

dx2=L2cosα+L1sinα

(4)

dy2=L1cosα-L2sinα

(5)

式中:dx2、dy2表示目标与光轴瞄准点在大地坐标系下沿正北方向上的横向、纵向偏移量;L1、L2表示目标与光轴瞄准点在大地坐标系下沿进入方向的横向、纵向偏移量;α表示当前时刻t获取的飞行器航向夹角。同理,可由上述原理计算得到辅助目标与光轴准点在大地坐标下沿正北方向上的横向、纵向偏移量。

根据(6)式、(7)式计算辅助目标与目标在大地坐标系下的相对位置,(6)式、(7)式如下所示:

Δx=dx2-dx1

(6)

Δy=dy2-dy1

(7)

式中:Δx、Δy表示辅助目标与目标在大地坐标系下沿正北方向上的横向、纵向偏移量;dx1、dy1表示辅助目标与光轴瞄准点在大地坐标系下沿正北方向上的横向、纵向偏移量;dx2、dy2表示目标与光轴瞄准点在大地坐标系下沿正北方向上的横向、纵向偏移量。

3 辅助目标定位及目标定位

3.1 辅助目标定位

根据迭代分割结果,保留中心点位于选取的辅助目标区域范围内的区域,根据保留的辅助目标区域形状特征对各区域进行特征匹配,保留各形状特征相对误差不超过阈值threshold1且各形状特征相对误差之和的总误差最小的区域作为局部邻域辅助目标检测结果,如图7所示。

图7 辅助目标检测结果

3.2 目标间接定位

根据文献[6]中间接定位算法对目标位置进行间接定位,辅助目标间接定位结果如图8所示,其中十字叉位置为目标间接定位结果。

图8 辅助目标间接定位结果

3.3 目标定位结果融合

对目标的直接识别可以得到目标的精确位置,而目标间接定位结果无法得到目标精确的位置信息,而对于直接识别中出现的虚警、丢失问题,间接识别定位可以起到校正作用。目标识别过程中应当结合直接识别及间接定位结果,优势互补,提升算法识别概率。

如图9,目标定位结果融合策略如下:当辅助目标间接定位及目标直接识别定位都能得到定位结果时,若辅助目标间接定位结果位于目标直接定位的目标区域内,则将目标的直接定位结果作为目标最终定位结果,以修正间接定位产生的定位偏差;否则,将辅助目标间接定位的目标位置作为目标最终定位结果。当辅助目标间接定位及目标直接识别定位只有一种方式得到了定位结果,则将该定位方式得到的定位结果作为目标最终定位结果。当两种定位方式均未得到目标的定位结果,则表示没有目标最终定位结果。

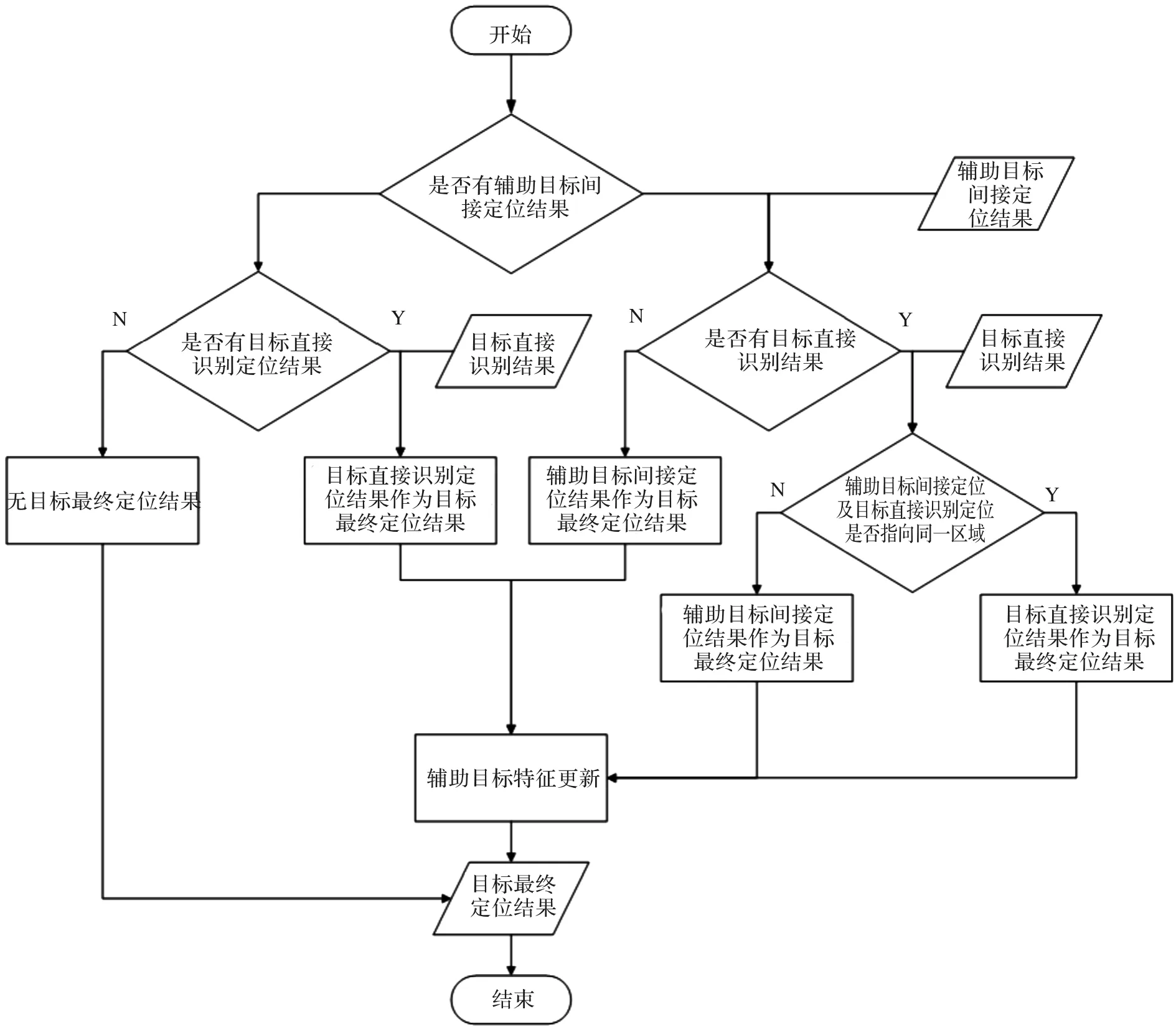

目标定位结果融合得到的目标最终定位结果如图10所示。

图9 目标定位结果融合流程

图10 目标最终定位结果

得到目标的最终定位结果后结合辅助目标的定位结果对辅助目标的特征进行实时更新。若有辅助目标定位结果,则提取辅助目标对应区域的形状特征,用来更新辅助目标的形状特征。若有目标最终定位结果,则更新辅助目标与目标相对位置;否则不更新辅助目标与目标相对位置。

4 实验结果

本次实验在真实的前视红外图像序列中验证算法的有效性。算法的运行环境为vs2012。本次实验验证本文算法与建筑物目标识别算法及跟踪算法结合效果,先用文献[1]算法识别目标,后用meanshift跟踪算法跟踪目标,meanshift目标跟踪算法采用Bhattacharyya系数作为算法相似性函数,当其小于0.9时判断为目标丢失,此时使用文献[1]算法对目标进行重新定位,之后重新进入跟踪,整个过程中目标识别及跟踪结果会根据文中融合策略与辅助目标间接定位结果融合,得到最终目标定位结果。实验前先对序列图像中目标区域范围进行人工标定,当目标识别结果位于标定区域内视为匹配成功。

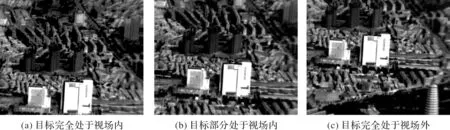

用于算法测试的图像序列1由660帧组成,图像大小320×256像素,每隔50帧或辅助目标位于图像边缘时重新选取辅助目标。序列1包含目标完全处于视场内、部分处于视场内及完全处于视场外3种典型情况,其中目标部分处于视场内及目标完全处于视场外的情况共300帧,如图11所示。

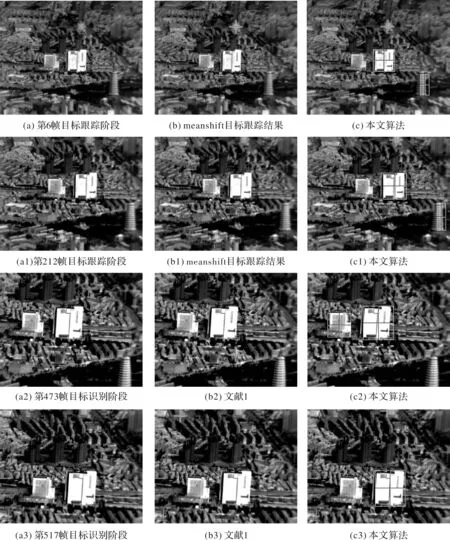

采用本文算法对上述红外图像序列进行目标定位,结果如图12所示。图12中包含了上述3种典型情况的目标定位结果,其中第6帧处于跟踪阶段,目标完整且与周围背景具有较高对比度。第212帧、第517帧目标位于图像边缘,只有部分出现在图像中,其中第212帧处于跟踪阶段,第517帧目标处于识别阶段。第473帧处于识别阶段,目标位于图像外。图中十字叉标记位置为目标位置,带十字叉方框标记位置为辅助目标位置。

图11 红外建筑序列1

图12 红外序列1目标定位结果

图12表明,第6帧、第212帧、第473帧及第517帧本文算法能正确定位目标位置,而在第212帧、第473帧及第517帧文献1与meanshift目标跟踪算法均无法准确定位目标,验证了本文算法在上述3种典型场景下的有效性,能够解决目标直接识别、跟踪算法在目标部分处于视场内、目标完全处于视场外这两种情况下的失效问题,避免虚警及目标丢失。而第517帧定位结果位于目标区域边缘,产生了定位偏差,原因为:目标在第450帧到517帧长时间处于图像边缘或处于图像外,在无法直接识别得到目标准确位置对间接定位结果进行修正的情况下,由于成像姿态参数误差较大而导致了定位偏差。

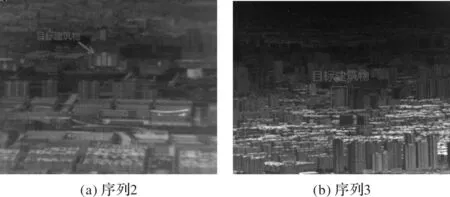

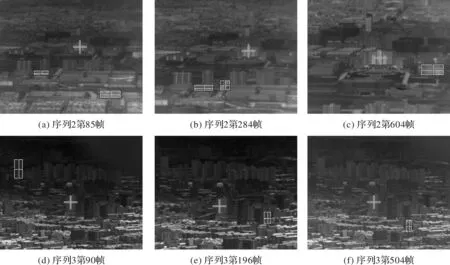

用于算法测试的图像序列2、序列3由820帧、450帧组成,图像大小320×256像素,每隔50帧重新选取辅助目标,序列中目标完整,没有处于图像边缘或视场外情况,但序列3中目标灰度有突变情况,如504帧所示。

图13 红外序列2、序列3

本文算法结果如图14所示。

图14 红外序列2、序列3本文算法目标定位结果

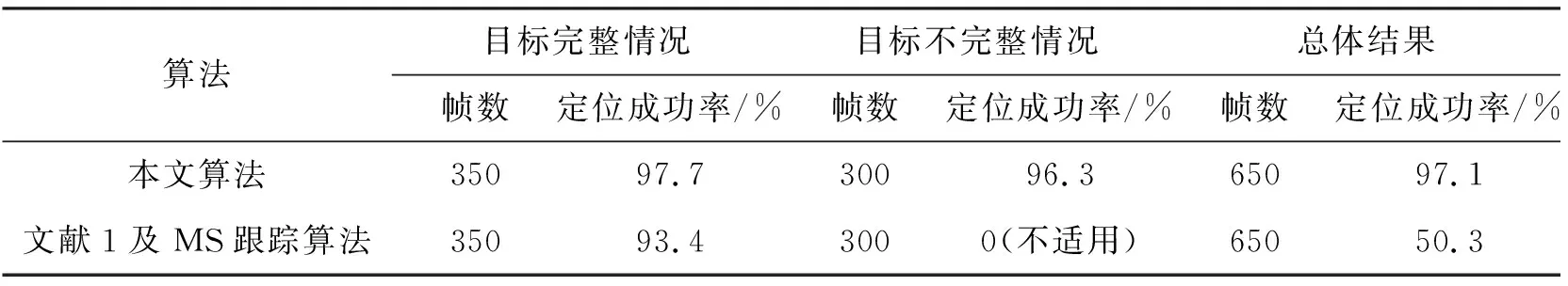

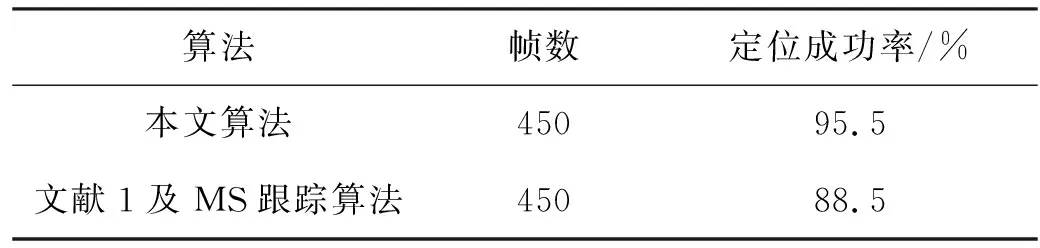

图14结果表明本文算法能够正确选取辅助目标区域,并在辅助目标移出视场时能自动更新辅助目标,不会因辅助目标出视场而丢失算法目标间接定位的能力,保证了算法间接定位的有效性,在目标尺度及灰度变化时也具有良好的效果,进一步验证了本文算法在不同图像序列上的有效性。对上述序列中算法定位结果进行统计,结果如表1~表3所示。

表1 序列1算法结果比较

表2 序列2算法结果比较

表3 序列3算法结果比较

由表1、表2、表3可知,本文算法在序列图像中相较于文献1目标识别及meanshift目标跟踪结合定位目标的定位成功率有所提高,特别对于存在大量视场遮挡情况的序列1有很大提高,能够在直接识别、跟踪算法失效的情况下准确定位目标。

5 结论

针对目标识别、跟踪过程中出现的目标不显著、目标被遮挡等造成丢失目标的问题,本文算法借鉴了间接定位的思想,在通过目标识别算法确认目标位置后,通过算法选取红外图像中显著、稳定的区域作为辅助目标,提取目标与辅助目标空间位置关系,采用间接定位的方式解决目标识别、跟踪过程中出现的虚警及目标丢失问题,有效提升算法识别概率。实验验证表明,该方法对于地面建筑物目标在直接识别、跟踪失效的情况下仍然可以通过本算法完成对目标的准确定位,但算法需要成像姿态参数作为保障,在目标长时间无法直接定位且成像姿态参数误差较大的情况下会出现定位偏差,接下来会对此问题进行研究。且算法针对的是静止的地面建筑物目标,未来研究重点是地面运动目标或天空及海面背景下的运动目标的间接定位方法。