高精度移动小车载具位姿检测平台仿真设计

2018-10-08,,

,,

(浙江工业大学 机械工程学院,浙江 杭州 310014)

AGV(Automatedguided vehicle) 是装备有电磁或光学等自动导引装置,能够沿规定的导引路径行驶,具有移载功能的运输车,属于轮式移动机器人范畴,在仓储、物流、制造等领域都有广泛应用。本研究致力于设计一种微型化、引导定位精度达到100 μm以上并且在二维平面上可随机移动的类AGV小车载具技术,为一类特殊的大幅面数字印刷设备提供基础。类似于AGV小车的小型二维平面移动机器人是当今学科研究热点之一,较常用见的AGV引导方案包括磁条、激光和超声波等[1]。磁条引导可以实现较高精度的可靠引导,但需要预先在工作区域内铺设磁条,AGV不能在整个工作区域内随机移动。超声波引导通过在小车不同位置分别安装超声波发射器,再利用几个位置固定的超声波接收器作为信标,利用接受的时间差计算小车位置和方向,其精度在2 m2范围内平均误差2.15 mm[2]。激光检测以激光扫描仪和小车周围安装的反光板得到小车相对于反光板的位置信息[3],但对于轨迹不固定的小车,固定的超声波接收器或反光板会导致某些位置无法检测到。现有研究和应用较多的各类引导技术都无法提供小于毫米级的解析度,高精度小车需要研究新的定位机制和控制算法,然而对此机制和算法的任何研究目标和效果验证都基于小车实际位姿和目标规划位姿之间的误差。因此,实时高精度地检测出小车实际位姿极为重要。

考虑小车在工作平面内的位置和角度姿态是随机变化的,且变化速率和所需的检测精度较高,如前述所述,常用的非接触式位置检测技术中,超声波精度不足,激光干涉因目标角度和运动范围较大,难以实现检测。本研究拟基于机器视觉原理进行检测,以高速高分辨率相机对移动小车进行快速拍照,获得小车在实验平台中每个位置点的信息。

1 实验平台设计

实验平台设计的基本目标:在300 mm×300 mm的区域内实现至少0.1 mm的定位精度,移动小车的速度为不大于0.1 m/s。

1.1 机器视觉系统

机器视觉系统设计框图如图1所示,主要包括视觉相机,数据采集卡和PC机[4]。该系统的工作原理:首先,通过Cameralink完成采集卡与相机之间的连接,系统上电初始化,然后相机进行图像采集。在相机内部将采集到的光信号转换为数字信号,通过串行总线Camera link把信号传输到FPGA中进行数据分析、处理,然后把数据传输到Flash中进行数据缓存。上位机软件通过PCI-E总线实现对图像采集的控制,把Flash存储单元中数据传送到计算机上处理,还原捕捉到的图像。

图1 系统总体设计框图Fig.1 The block diagram of system

1.2 相机选型

选择合适的工业相机对于成像系统而言极为重要,而一般相机的型号主要根据成像方式、分辨率、帧率、曝光时间和触发方式等综合考虑确定。其计算式为

(1)

式中:f为相机单方向上分辨率;l为单方向视野长度;u为理论精度;p为相机帧率;v为小车移动速度;t为相机的曝光时间;x为像元之间的距离。

平台精度为u=0.1 mm,平台范围为s=300 mm×300 mm,小车移动速度为v=0.1 m/s。选择IO-Flare系列12M125CL相机,采用coms全局快门,分辨率为4 096×3 072,帧率为124 fps,曝光时间可由触发信号脉宽调节。

1.3 相机安装检测

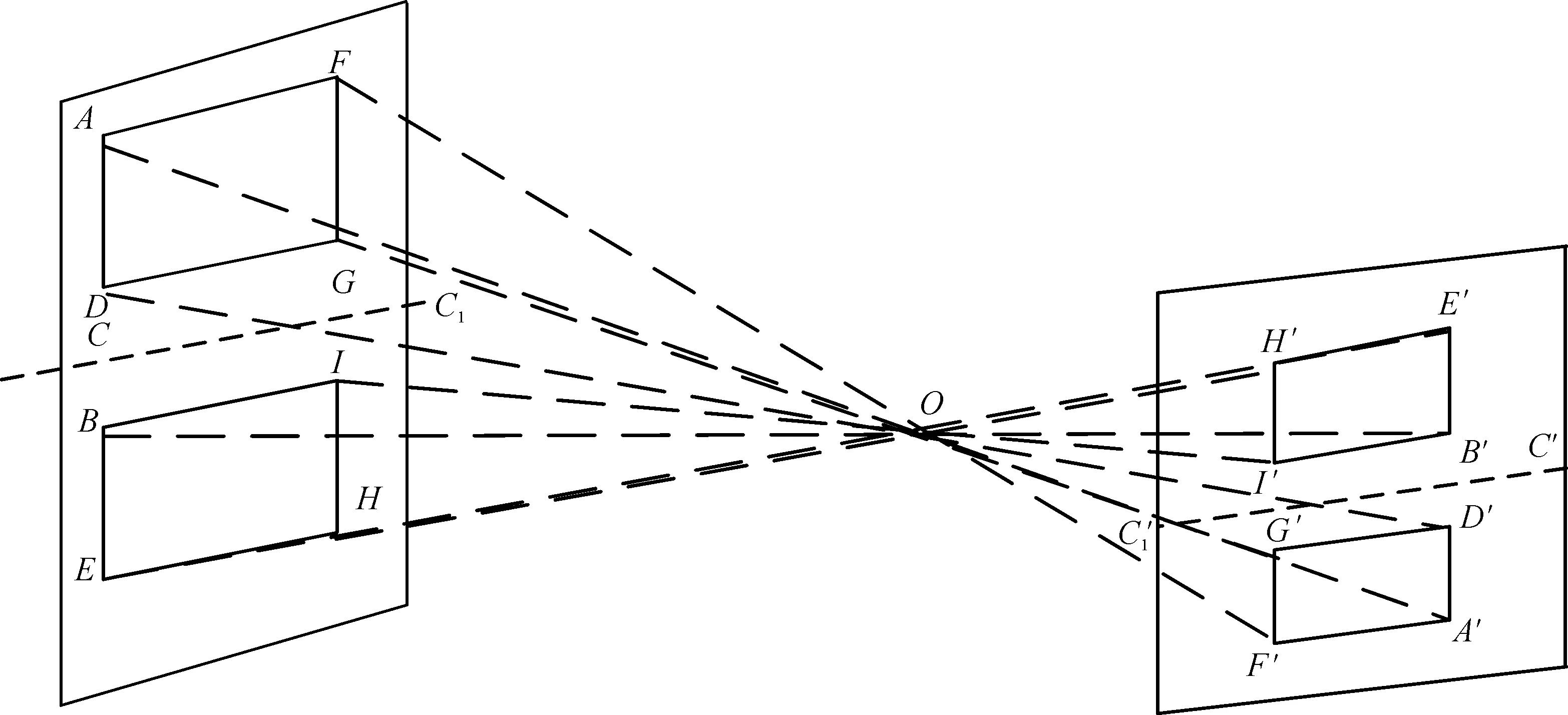

在相机安装过程中为保证视觉测量的精度和准确性,需要调节相机光轴与物体的垂直度,使光轴与被测物面法线之间的偏差降到最小。基于图2所示的小孔成像的模型采取操作简单,稳定性好,实用性强的面积法,比较图片中关于光轴对称的区域面积,进行光轴和物面垂直度检测[4]。

图2 相机成像模型Fig.2 Camera imaging model

为简化计算,单独考虑AC的成像规律,如图3所示。

图3 被测物AC垂直与倾斜成像图Fig.3 Vertical and oblique image of the measured object AC

根据透视投影原理可得方程为

(2)

在倾斜后被测物A1C所成像A1C′为

(3)

(4)

(5)

2 Matlab仿真

对所设计的机器视觉实验平台,为验证其可行性,利用Matlab工具箱对视觉系统进行相机安装检测和标定的仿真。根据检测和标定的原理,采用如图4所示的X靶面作为标准板。

图4 X靶面Fig.4 X target surface

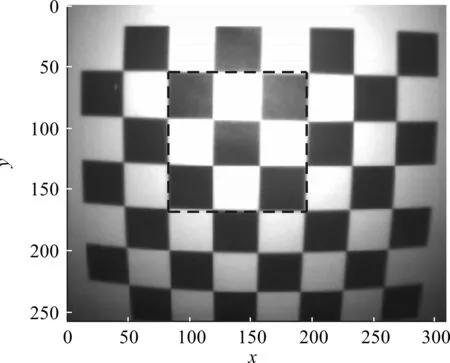

2.1 垂直度检测

(6)

图5 区域面积图Fig.5 Area map

图6 角点提取Fig.6 The image of angular point extraction

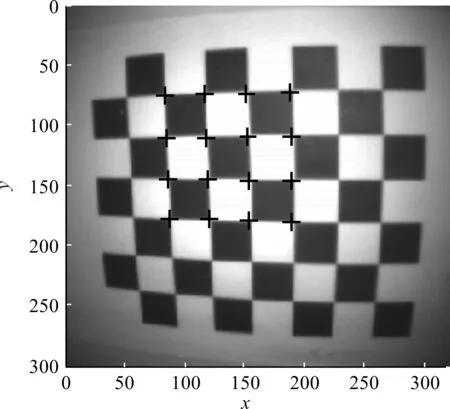

面积比较倾斜方向|s1-s3| 依据张氏标定原理[6-7],采集从不同角度拍摄得到的若干模板图像,图7为所采集到的16张相对相机不同角度的图像的3D模型图。 图7 3D采集模型Fig.7 3D acquisition model 如图8所示,对采集到的图像,依次进行亚像素级的角点选取。以每张图的角点作为特征点,根据提取得到的角点,依照张氏标定原理可以得到相机的内外参数,如表2所示。 图8 角点提取Fig.8 The image of angular point extraction 参数标定值焦距fc/mm [50.796 50 50.712 59]±[2.860 91 2.878 41]光心坐标X0[169.355 00 204.334 87]±[1.615 60 1.490 63]畸变系数K/mm [-0.364 14 0.158 97 -0.000 18 0.000 81]±[0.007 79 0.012 81 0.000 86 0.000 80]平移向量T/mm[81.811 740 -73.799 582 327.970 457]T旋转向量R/mm-0.047 194 0.998 788 -0.014 007 0.921 198 0.038 098 -0.387 224-0.386 220 -0.031 178 -0.921 879 通过相机标定得到的内外参数,根据图9所示的摄像机成像原理[8-9],各坐标之间变换关系为 Xc=RXw+T (7) (8) (9) 式中:Xw为世界坐标;Xc为摄像机坐标;Xd为图像平面坐标;Xu为图像像素点坐标;f为相机焦距;dx, dy为像元物理尺寸,相机厂家给出5.5 μm×5.5 μm;u0,v0为光心坐标。 图9 摄像机模型Fig.9 The camera model 实验中采用网格边长为30 mm的X靶标作为标准板,用相机对X靶标进行拍照得到采集图样,如图10所示。通过垂直度检测每张照片可以得到相应的相机倾斜方向,根据倾斜方向进行相应调整,减少垂直度误差。从左至右依次为图样1~6,阈值选为20,对每张图检测结果如表3所示。 图10 检测图样Fig.10 Inspection pattern 编号S1/mm2S3/mm2误差1/mm2S1'/mm2S3'/mm2误差2/mm2倾斜方向图样13 991.734 065.41-73.684 085.974 211.30-73.68右下方图样24 141.344 228.17-86.834 265.684 184.2981.39左下方图样34 202.834 217.62-14.804 190.854 227.18-36.33右方图样44 344.503 983.00361.504 062.914 274.06-211.15右上方图样54 310.694 264.3046.404 370.204 311.6158.60左上方图样64 078.274 123.94-45.674 093.874 109.80-15.92下方 在对相机光轴垂直进行调节后,选择世界坐标已知的X靶面作为实验板,采集如图11所示的测试图样。利用相机标定得到的参数对图片进行畸变矫正[10-11],对矫正后的图样进行亚像素级的角点提取得到如图12所示的图像。 图11 测试图样Fig.11 Test pattern 图12 矫正角点提取图Fig.12 The correction image of angular point extraction 对提取得到的角点利用坐标映射关系得到理论上的世界坐标,对实际与理论上的世界坐标进行误差分析,如图13所示。 图13 检测误差图Fig.13 Detection error diagram 图13中显示提取了42 个特征点的检测误差,平均误差为-0.020 7 mm。该误差在所要求的检测精度范围之内。 基于机器视觉原理对二维平面上随机移动的小车载具进行位姿检测,以高速高分辨率相机对移动小车进行快速拍照,通过实时计算处理,可以获得小车在实验平台中每个位置点的信息,实现所需的检测精度和速度。研究发现:1) 采用面积法进行光轴与物面垂直的判断,稳定性好,易于判定,同时给出需要被调节的方向,可以更好地提高视觉检测的精度;2) 通过对相机内外参数的标定,得到图像坐标与世界坐标之间的转换关系,并通过对这种映射关系进行误差分析,可知视觉检测的方式能够满足对移动小车位置检测的精度要求。2.2 相机标定

3 实验测试

4 结 论