基于深度神经网络的复杂光照下的蓝藻图片语义分割

2018-05-03罗艾娜

罗艾娜 郑 骏

(华东师范大学 上海 200062)

0 引 言

近年来,人口的急剧增长和工业的大规模发展导致水体富营养化成为一个严峻的问题,大量营养物质的涌入使得水体中的藻类大量繁殖,破坏了水体环境,甚至影响到人们的生存,这种现象被称为水华。研究表明,淡水藻的大部分门类都有形成有害水华的可能,其中蓝藻水华的发生范围最广,危害最大,对人类生存环境的破坏也最为严重[1]。

传统的蓝藻治理方法比如人工法、化学法或生物法,需要确定蓝藻的爆发情况和重灾区域,重点针对那些高频区域和关键区域进行治理。过去主要依靠人工巡视定位,人工巡视可以准确地判断蓝藻爆发规模和爆发地点,但人力有限,不能全面地覆盖到每个爆发点。针对这一问题,本文试图借助图像分割技术完成基于图像的蓝藻目标的语义分割,但传统的图像分割算法如基于阈值[2]、基于边缘、基于聚类分析以及基于小波变换等无法实现对蓝藻较高精度的识别[3]。故本文借助深度学习技术,构建了深度神经网络模型实现了基于图像的蓝藻分割,取得了比传统算法更高的准确率。

图像的语义分割是指根据灰度、颜色、纹理和形状等特征识别出图像中像素点的分类并分割出图像中的目标,是计算机视觉领域的重要组成部分。语义分割本质上是对目标图像进行像素级的分类。深度学习中,理想状态下的训练样本是均匀分布的,这样训练出来的网络模型具有更好的鲁棒性,可以适应各种复杂的场景。

但在实际情况中,由于样本的采集难度等问题的限制,很难采集到各种环境条件下的训练样本,环境对模型准确率的影响非常大。比如光照条件的影响,当模型的训练过多依赖良好光照条件下的目标图像时,其在对极端光照条件下的目标图像进行语义分割时会得到非常差的效果,甚至会出现无法有效分割的情况。

复杂光照这一问题在多个领域比如人脸识别、物体分割等具有普遍性,故本文研究了其他领域的复杂光照问题的解决方案。其中,林奎成等[4]提出了一种结合自适应区域增强和主动表观模型(AAM)的人脸特征定位方法,其通过对不同光照下的人脸区域进行直方图均衡补偿的方式解决了复杂光照的问题。张槐祥等[5]基于灰度直方图多峰值的特点,提出了一种分段自适应模糊阈值的分割方法,有效地克服了光照不均带来的灰度连续问题,并将其应用到线材表面缺陷的检测技术中。裴明涛等[6]通过利用先验知识和复杂光照背景下的车辆特征,利用车辆边缘信息生成假设,使用HOG算子和SVM分类器的方式验证假设,检测出了传统检测方法无法检测出的目标。李伟红等[7]提出一种基于各向异性扩散算法的多尺度人脸光照不变特征图像提取算法。通过引入区间不一致描述子和传递参数,有效提取出了不随光照变化的人脸特征图,明显地降低了复杂光照条件下的识别错误率。

本文针对复杂光照条件下目标语义分割效果不好甚至失效的情况,提出了一种图像处理算法,借助HIS颜色空间模型对光照的特殊表现性,有效地提高了目标在复杂光照条件下的分割准确率。

1 深度神经网络

1.1 卷积神经网络

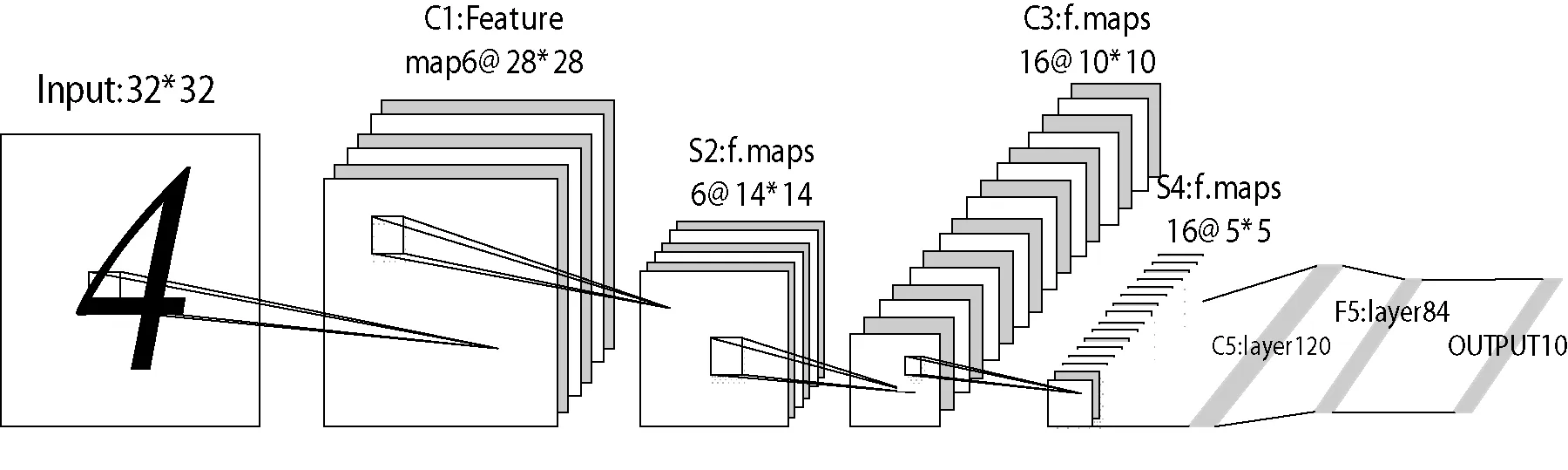

卷积神经网络CNN是近年发展起来,并引起广泛重视的一种高效识别方法,网络主要是由多层特征提取阶段和分类器组成的单一尺度结构,即输入经过逐层提取特征学习到更高层的特征后输入到分类器中进行分类。特征提取阶段主要包括卷积层和下采样层,之后会连接一到两层的全连接层。以LeNet网络[8]为例来说,输入为32*32的图像,如图1所示。

图1 LeNet网络结构图

1.1.1 卷积层

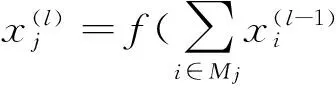

卷积层是卷积神经网络的核心组成部分,其具有局部连接和权值共享特征,这也是其可以接收大像素尺寸的图像样本的原因。此外,其提取特征的方式还具有平移和旋转不变性。LeNet中的C1和C3层为卷积层,其计算形式可表示为:

(1)

图2 卷积层操作

1.1.2 下采样层

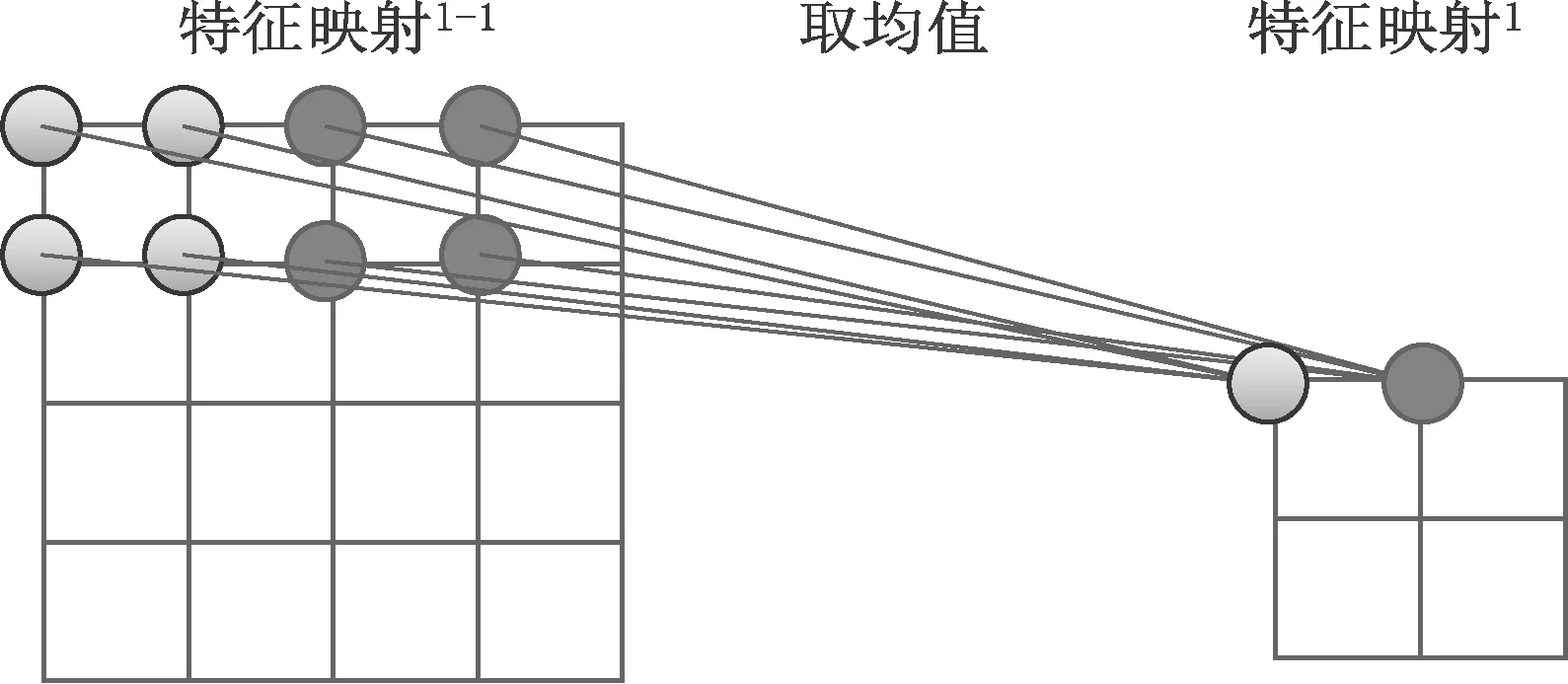

下采样层又称池化层,LeNet中的S2和S4层为下采样层,其主要目的是通过降低分辨率来减少训练参数个数,并且获得更抽象的特征以提高网络的鲁棒性。其操作方式有多种,最常见的有平均池化和最大池化,这里以平均池化为例表示其计算形式:

(2)

图3 下采样层操作

图像在经过多层卷积和下采样后,获得了具有平移和旋转不变性的低分辨率特征。通过全连接层 ,将这些特征映射成一个固定长度(类别数)的特征向量,每个值表示图像属于这类的概率,可以得到很高的分类正确率。

1.2 全卷积神经网络

Jonathan Long等[9]改进了这种结构,构造了全卷积神经网络FCN(Fully Convolutional Networks),使其可以对图像进行像素级的分类,从而解决了语义级别的图像分割问题。FCN弃用了全连接层,在最后一层卷积层提取到特征后,采用反卷积的操作进行上采样,使特征逐渐恢复到与输入图像相同的尺寸,从而对每个像素点都产生了一个预测。同时保留了原始输入图像中的空间信息, 最后在上采样的特征图上进行逐像素分类。

FCN实现了对图像语义级的分割,具有不错的分割效果,但由于图像在下采样的过程中丢失了部分信息,导致其通过上采样后得到的结果不够精细,缺乏轮廓感。虽然其改进了网络模型,用8倍上采样取代了32倍上采样,但仍旧无法获得特别精细的分割效果。另外,FCN在对像素进行分类时没有充分考虑像素与像素之间的关系,这也限制了它的精准度。

1.3 改进的网络模型

Chen等[10]针对FCN分割结果缺乏轮廓感的问题引入了全连接的条件随机场CRF(Conditional Random Field)[11],实现了更精确的分割,这种网络结构被称为Deeplab。Deeplab分为两步:第一步仍然采用了FCN得到初始结果图并插值到原图像大小;第二步借用CRF对从FCN得到的分割结果进行细节上的改善,使分割结果的精细度有了大幅度的提升,这个结构成为了效果最好的语义分割算法。

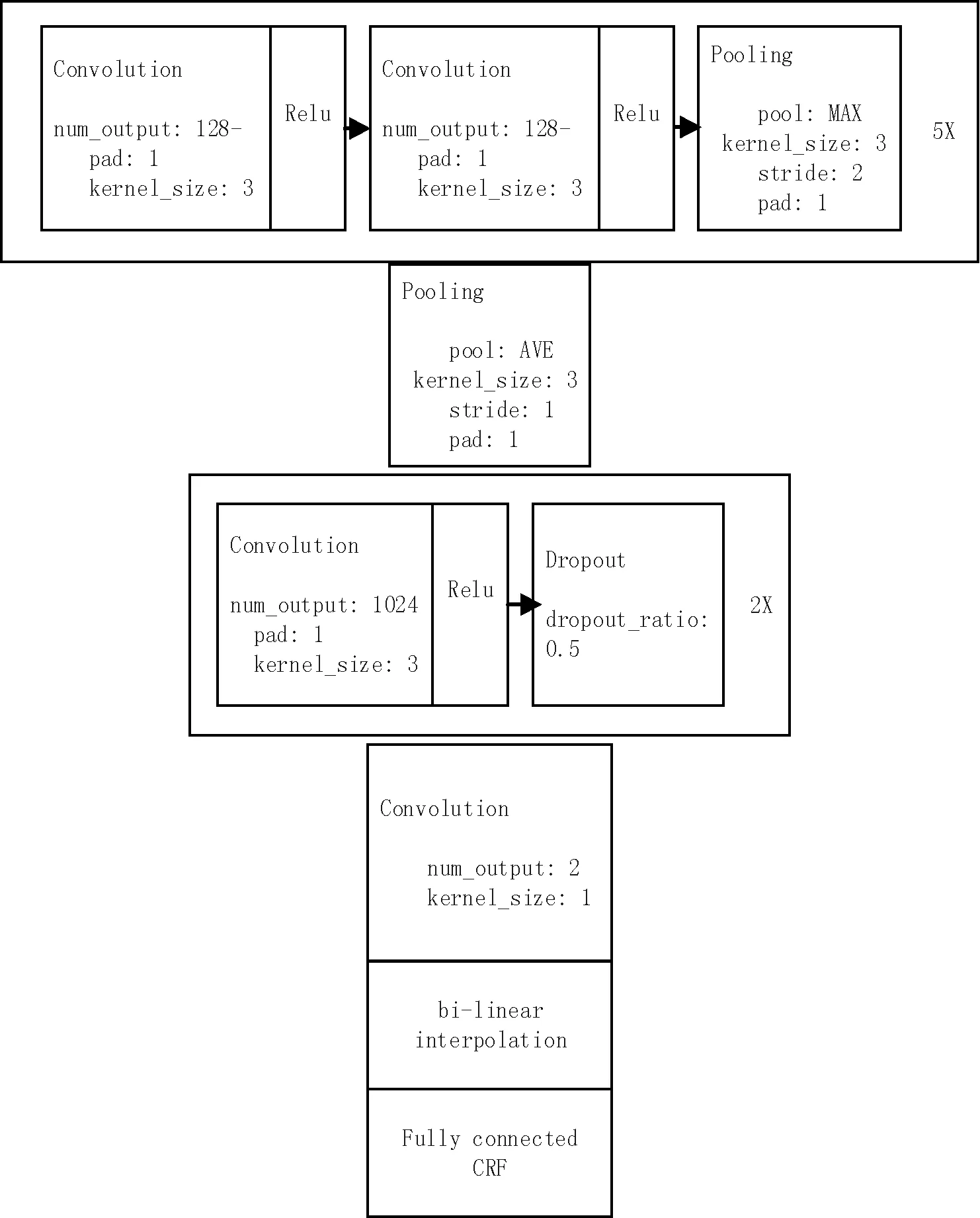

由于文献[11]所用的数据集包含了21类,但本文研究的问题是个二分类问题(蓝藻和非蓝藻),难度较21类容易很多。本文在其基础上做了部分改进:一是为加快训练速度,调整了网络结构,减少了部分卷积层。二是由于蓝藻本身不具有特定的形状,识别蓝藻更多依靠颜色信息,故我们增大了前几个卷积层的卷积核数量。经过实验,最终设计了如图4构造的网络模型。

图4 本文设计的网络模型

网络由五部分构成:

1) 第一部分由五个卷积-激活-卷积-激活-最大值池化结构的复合层构成,卷积核数量(提取特征图数量)分别为128、128、256、512、512(同一复合层内两个卷积层的参数一致),卷积核大小均为3*3,为防止最终取得的特征图像素尺寸过小,每层添加了一个像素尺寸的像素点填充。

2) 第二部分是一个均值池化操作。

3) 第三部分是两个卷积-激活-Dropout(用于防止过拟合)结构的复合层,卷积核数量均为1 024,卷积核大小均为3*3,像素填充同样为1个像素点。

4) 第四部分为卷积核大小为1*1的卷积操作,输出为2通道,分别表示该像素点属于蓝藻或非蓝藻的概率。

5) 第五部分首先将前一层的输出双线性插值并填充成原图大小,然后由CRF完成对各像素点分类结果的概率预测。本文构建了如图4所示的网络结构,实现了对蓝藻的语义分割,并验证本文提出的算法对复杂光照条件下语义分割准确率的提高。为方便表述,下文中用Deepnet表示本文设计的神经网络模型。

2 复杂光照问题

实际应用中,采集的图像样本不可能均匀分布于各种光照条件下,使得其对极端光照条件下的目标分割效果不好。针对这一问题,本文设计了如下算法用于处理图像。

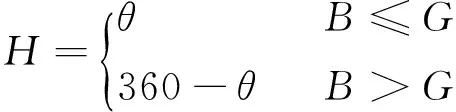

1) 将图像由RGB格式转为HIS格式。HIS是一种图像的表达方式,直接使用颜色三要素色调、饱和度和亮度来描述颜色。HIS颜色空间比RGB彩色空间更符合人的视觉特性。亮度和色度具有可分离特性,使得图像处理和机器视觉中大量图像处理算法都可在HIS颜色空间中方便使用。其中亮度指人眼感觉光的明暗程度。光的能量越大,亮度越大。色度由物体反射光线中占优势的波长决定,反映颜色的本质。饱和度指颜色的深浅和浓淡程度,饱和度越高,颜色越深。

(3)

式中:

(4)

(5)

(6)

2) 计算各测试样本中各像素点I通道的均值,作为该图像的光照强度指数:

(7)

3) 计算合适光照条件下图像的光照均值∂,将测试样本的光照归一化到均值为∂,方差标准差为λ的区间内,新的光照强度:

(8)

4) 更新测试样本中每个像素点的光照:

(9)

5) 将归一化后的图像转回RGB格式。

借助HIS图像中I通道可分离的特性,本文直接对I分量做处理,处理后各图像的光照强度指数αi被归一化到合适的光照区间内,光照不足的图像得到补光,光照过强的图像得到了一定程度的光照抑制。算法处理后的图像的光照强度指数αi一定程度上保留了原图的分布情况,光照较弱的图像处理后的结果的光照强度也较弱,但其被补足到了合适的光照区间内。

3 蓝藻的语义分割以及评价指标

3.1 蓝藻语义分割实验部分

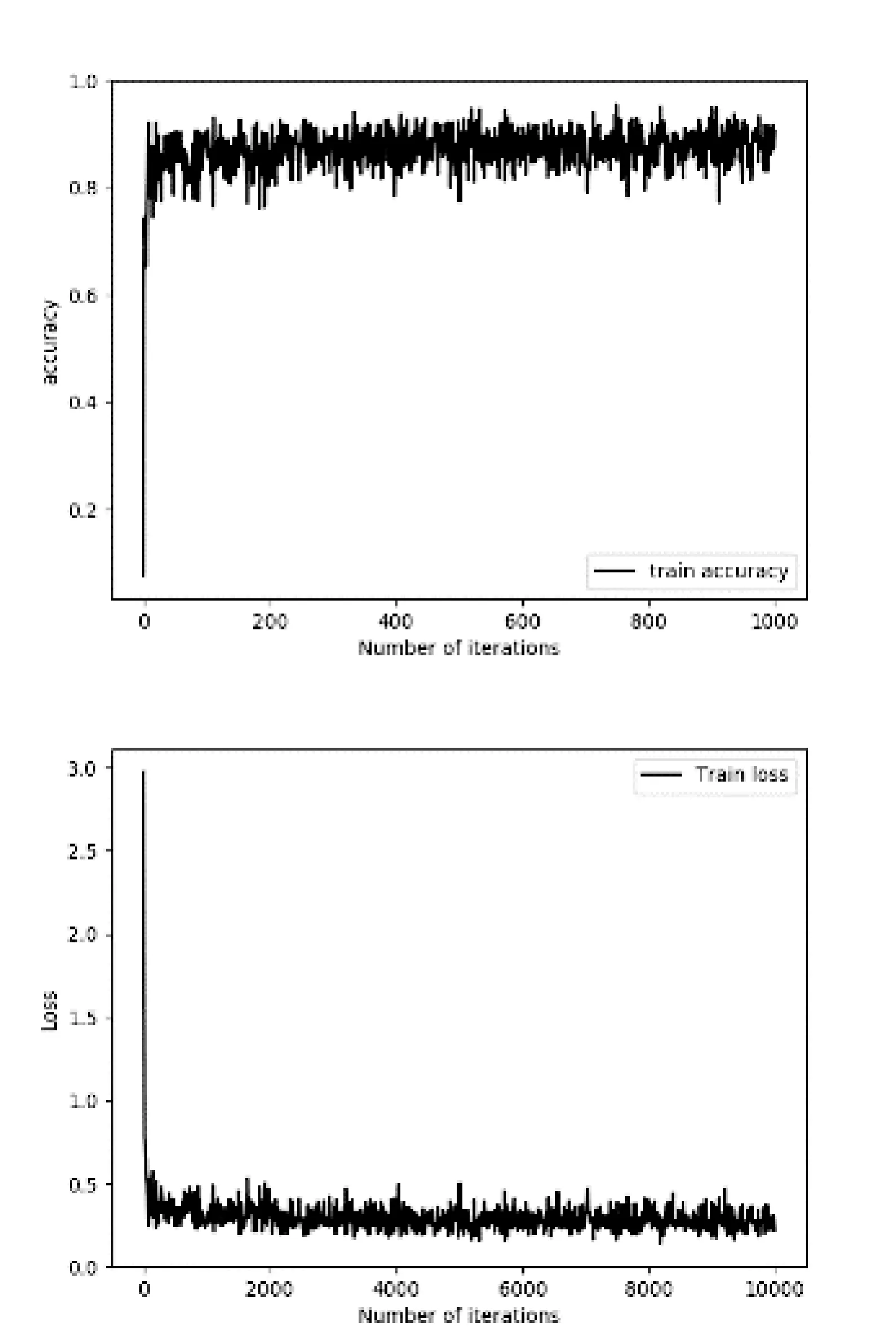

如上文所述,本文设计了Deepnet对蓝藻目标进行语义分割。本文自建了蓝藻图像的数据集,包括2 000张训练样本和300张测试样本。在神经网络的训练过程中,将batch_size设为30,基础学习率设为0.01,选用了‘step’的学习率下降策略。在进行了10 000次迭代后,网络已经基本收敛,准确率和loss值的变化如图5所示。

图5 训练过程中准确率和loss值的变化

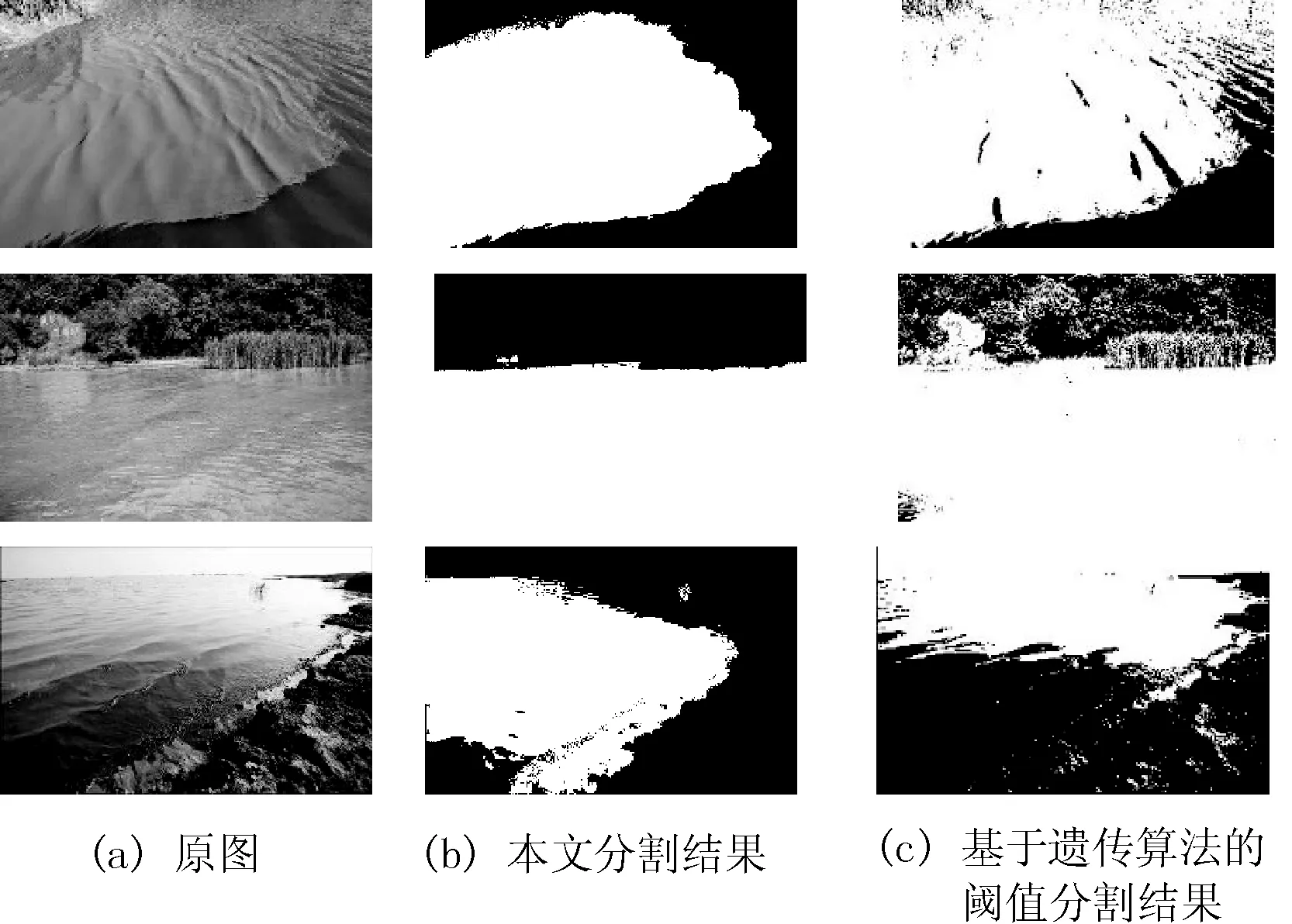

部分分割结果与传统图像分割技术的比较如图6所示。

图6 部分分割结果比较

如图6所示,本文选用的神经网络模型经过训练后可以很好地完成对蓝藻的语义分割,尤其是在图像中水草植被的颜色与蓝藻非常相似时,容易误分。本文选用的分割方式很好地区分出了干扰项,取得了比传统方式(基于迭代以及基于遗传算法的阈值分割)更好的分割效果。

3.2 评价指标

图像分割的本质对图像进行像素级的分类,即对每个像素点进行分类,本文所选的性能评估方法主要有三个,分别为准确率,召回率和MIoU。如表1所示。

表1 评价指标计算依据表

其中,Label表示图像的标签(实际值),每个像素点对应一个值,1表示该像素点为蓝藻,0表示非蓝藻。Predict表示网络的预测结果,同样用1和0表示该像素点属于蓝藻或非蓝藻。

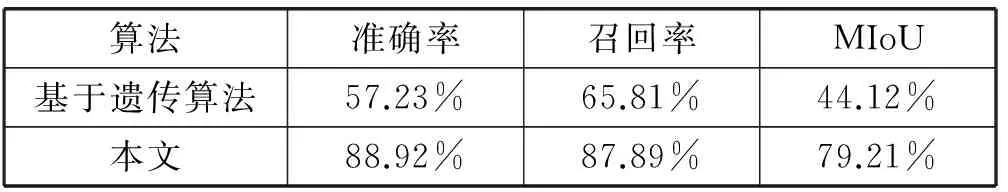

本文设计的Deepnet网络与基于遗传算法的阈值分割算法的结果比较如2所示。

表2 本文算法与传统算法的识别率比较

4 复杂光照下的蓝藻识别

4.1 数据集设计

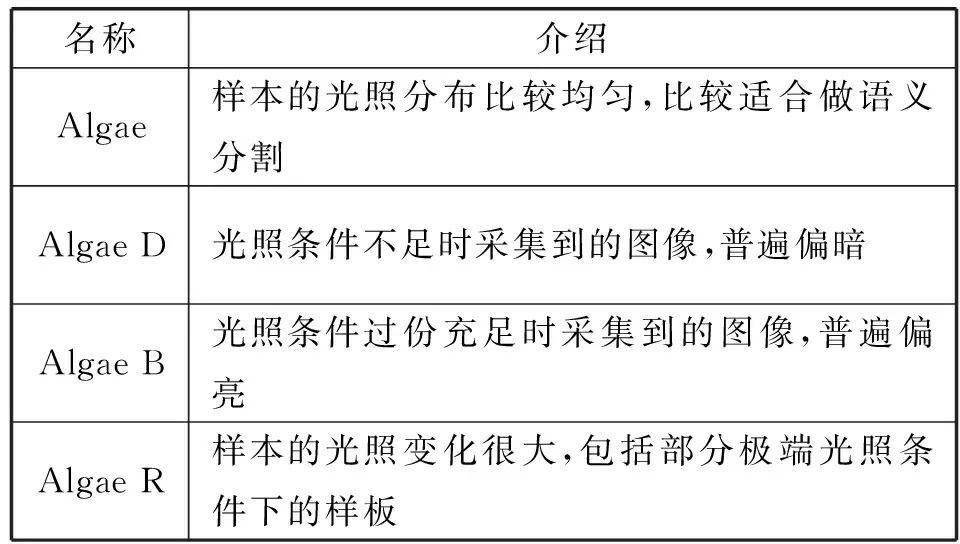

为了验证本文提出的算法对复杂光照问题的有效性,本文制作了4个具有不同光照强度的蓝藻样本集用于测试。各数据集的介绍如表3所示。

表3 复杂光照条件下的数据集

各数据集中样本的光照强度指数α分布如图7(a)所示,用本文方法处理后各数据集的光照强度指数α~分布如图7(b)所示。

图7 算法处理前后图像的光照强度指数分布图

4.2 算法有效性验证

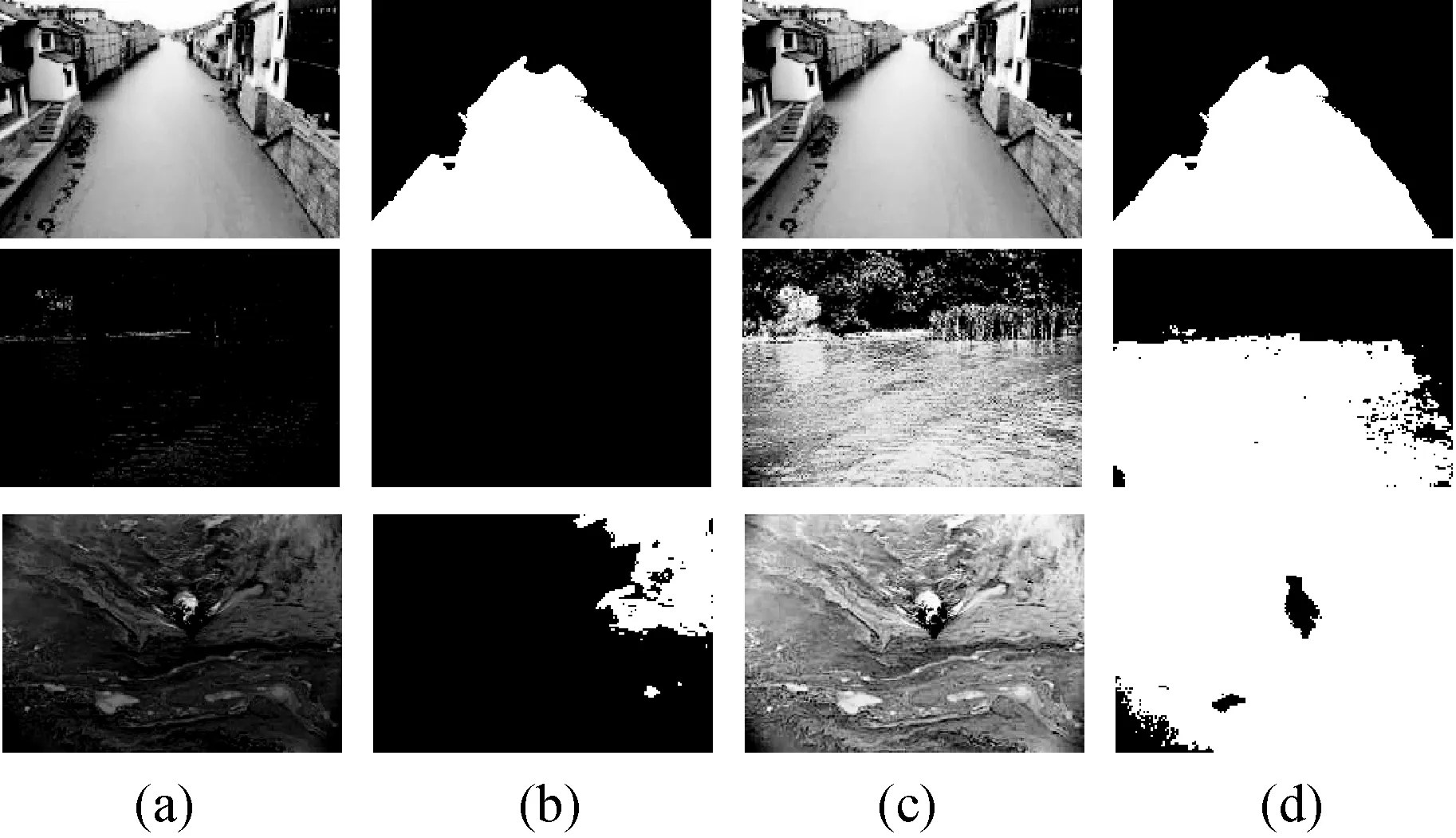

为了验证本文提出的算法的有效性,实验首先训练Deepnet用于语义分割,然后测试上述4个不同光照分布情况下的数据集,得到测试结果。其次用本文所述算法对上述数据集做处理(经过多次实验,∂取0.5,λ取0.01),再由Deepnet做分割,部分图像的分割情况如下:图8(a)为处理前的图像,图8(b)为直接用神经网络分割的结果,图8(c)为经过本文算法处理后的图像,图8(d)为经过本文算法处理后图像的分割结果。

图8 复杂光照条件下的分割结果

由图8可以看出,在光照合适的情况下,分割结果的差别并不大,但当图像的光照强度明显不足时,经本文算法处理后的分割效果明显更好。在极端光照条件下,Deepnet会出现分割失效的情况,本文提出的算法有效避免了这种情况。各数据集分割结果的准确率如表4所示。

表4 本文算法处理前后各数据集准确率比较

由表4可知,在光照良好的情况下,直接分割与用本文算法处理后再进行分割的差别不大,但在光照比较复杂的情况下,本文提出的处理方式可以明显地提升分割效果。

5 结 语

本文基于深度神经网络构建了一个网络模型,经过在自建数据集上的训练和调试,实现了对蓝藻的语义分割,取得了比基于遗传算法的阈值分割更好的分割效果。另外,本文针对复杂光照对蓝藻分割结果影响非常大的问题,设计了一种基于HIS图像格式的图像处理方法,以良好光照下图像中各像素点I通道的均值作为图像的光照强度指数。借助HIS中I分量可分离的特性,将复杂光照的图像归一化到合适的光照强度范围内。在本文自制的4个不同光照分布的测试集上的测试结果表示,经本文方法处理后的图像分割准确率更高。并且在图像的光照明显不足时,神经网络模型会出现无法正常分割的情况,但经本文算法处理后的图像避免了这一问题。

[1] Jia junmei,Luo wei,Du tingting,et al.Valuation of changes of ecosystem services of Tai Lake in recent 10 years[J].Acta Ecologica Sinica,2015,35(7):2255-2264.

[2] Jiang yunzhi,Hao zhifeng,Lin zhiyong,et al.Automatic multilevel thresholding for image sehmentation based on block sampling and genetic algorithm[J].Journal of Computer-Aided Design & Computer Graphics,2011(11):1860-1868.

[3] Liu Songtao,Yin Fuliang,et al.The Basic Principle and Its New Advances of Image Segmentation Methods Based on Graph Cuts[J].Acta Automatica Sinica,2012,38(6):911-922.

[4] Lin K,Wang X,Tan Y.Adaptive region enhancement based facial feature localization under complex illumination[J].Chinese Journal of Scientific Instrument,2014,35(2):292-298.

[5] Zhang H,Liu H,Yang M,et al.A Self-adaptive Segmentation Method of Wire Defects under Complex Illumination[J].Opto-Electronic Engineering,2014,41(2):40-46.

[6] Pei mingtao,Shen jiajun,Yang min,et al.Vehicle detection method in complex illumination enviroment[J].Transactions of Beijing Institute of Technology,2016(4):393-398.

[7] Li W,Wang B,Gong W,et al.Multiscale illumination invariant facial feature image extraction method[J].Chinese Journal of Scientific Instrument,2011,32(1):178-185.

[8] Lecun Y,Bottou L,Bengio Y,et al.Gradient-based learning applied to document recognition[J].Proceedings of the IEEE,1998,86(11):2278-2324.

[9] Long J,Shelhamer E,Darrell T.Fully convolutional networks for semantic segmentation[C]//IEEE Conference on Computer Vision and Pattern Recognition.IEEE,2015:3431-3440.

[10] Chen L C,Papandreou G,Kokkinos I,et al.Semantic Image Segmentation with Deep Convolutional Nets and Fully Connected CRFs[J].Computer Science,2014(4):357-361.

[11] Klinger R,Tomanek K.Classical Probabilistic Models and Conditional Random Fields[J].Classical Probabilistic Models & Conditional Random Fields,2007.