基于CLSTM的步态分类方法

2017-09-19房一泉

许 凡, 程 华, 房一泉

(华东理工大学信息科学与工程学院,上海 200237)

基于CLSTM的步态分类方法

许 凡, 程 华, 房一泉

(华东理工大学信息科学与工程学院,上海 200237)

步态分类在人体运动能量消耗评估等应用中具有重要意义,提高分类精度和降低对统计特征的依赖是步态分类的研究热点。采用传统的步态分类方法提取的步态特征用于细分化步态时不能得到较好的效果。考虑到步态的连续性和不同轴之间信号的相关性,本文提出了基于CLSTM的步态分类方法:采用卷积神经网络(CNN)操作,通过计算多轴步态数据提取步态特征;基于长短期记忆(LSTM)构建步态时间序列模型,学习步态特征图时间维度上的长期依赖性。基于USC-HAD数据集的实验结果表明,用此方法提取了步态序列特征,很好地利用了步态时间序列特点,提升了11种步态的分类精度。

步态分类; 信号相关性; 卷积神经网络; LSTM

可穿戴智能设备很容易获取步态数据,而步态分类技术在人体健康监控、人体运动能量消耗评估、跌倒检测等方面应用广泛。显然,步态模式的识别和分类具有重要的意义,而目前研究的步态模式很少[1-3],文献[4]仅构建了11种步态,且未做识别分类。文献[1,5]采用手动方法提取步态统计特征,需要有步态信号的专业知识[6],应用多种特征分类步态,冗余的特征导致识别能力下降,计算量加大。文献[7-8]采用隐马尔科夫模型进行长期行为识别,但分类器的输入仍然是步态统计特征,且步态的长期行为只采样前后一帧数据,数据长度有限,分类效果不佳。文献[9]采用卷积神经网络识别步态,全连接方式处理特征图,输入到输出完全独立,但未考虑步态序列时间关系。采用全连接结构需要连接步态特征图中的所有值,增加了大量的权值矩阵,影响了网络的识别能力。

采用深度学习的方法处理时间序列数据已广泛应用于语音、视频等领域中。文献[8]在隐马尔科夫模型基础上采用深度神经网络(DNN)提取步态特征,分类效果优于文献[7]。文献[10]建立了CNN和LSTM的组合模型,CNN提取语音的深度特征,LSTM建立特征的时间序列模型,取得了很好的分类效果。为此,本文提出了基于CLSTM的步态分类方法。

以往文献中提取的传感器步态时间序列信号特征均忽略不同轴之间信号的相关性,而本文将获取的多轴步态数据按两两互邻排列,CNN卷积计算相邻轴数据间隐含的相关性,能提取步态本质特征。CNN通过卷积操作、局部感受野和权值共享,逐层学习得到步态的深层特征,使原步态信号特征增强,且降低噪声,同时避免复杂的步态特征提取、选择及数据重建过程。LSTM提供长时记忆的功能,利用步态的时序关系,建立步态分类的时间序列模型,学习得到复杂的步态模式,提高步态模式分类精度。采用人体日常行为数据库USC-HAD[4]评估本文方法的有效性,实验结果表明该方法能有效地分析步态的特性并分类步态模式,提高分类精度,满足现有智能设备的步态识别。

1 步态信号的特征提取

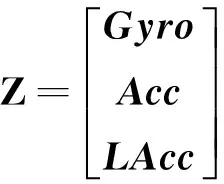

1.1步态信号的表示

(1)

为利用不同轴间的信号相关性,增强对步态数据的描述,且不破坏步态原始数据,将Z中两两非相邻轴步态向量排列组合,构成表示卷积层输入数据的36×N矩阵:

(2)

使得不同轴步态数据在CNN卷积过程中能共同参与计算,提取到的特征更能表示原始步态信息。

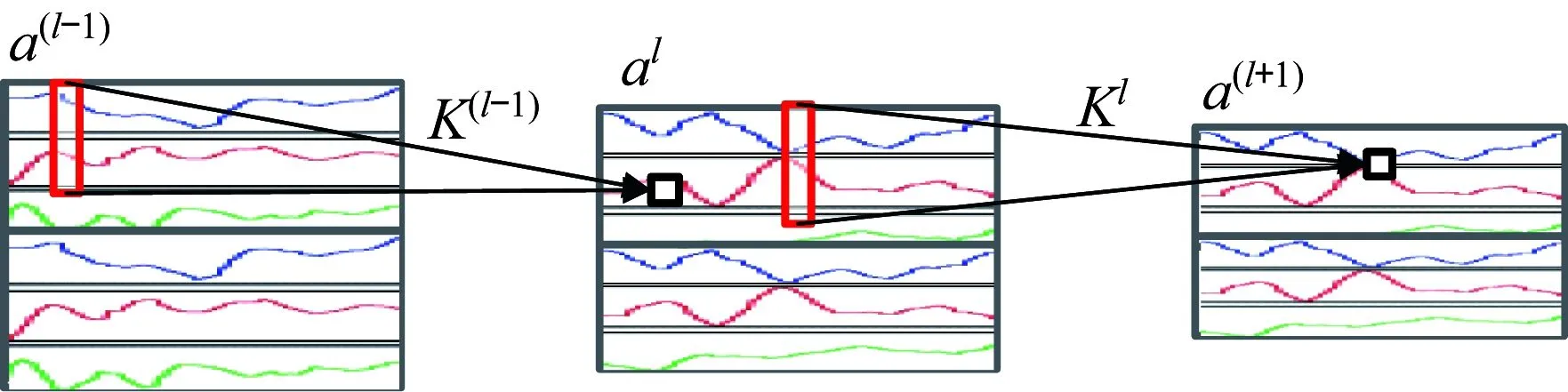

1.2基于CNN卷积的步态特征提取

CNN提取步态原始信号特征用于步态分类取得了很好的效果[12]。由1.1节得到的36×N步态输入数据作为CNN层级结构的最底层输入,每层输出数据依次传输到下一层,通过卷积操作计算每层相同输入、不同步态区域数据与卷积核点乘值,再经激活函数得到激活值,生成包含原始数据的部分特征的步态特征图。增加更多的不同卷积核会获得更多关于原始步态的特征,可用于分类模型的输入并得到更精确的概率输出。

(3)

图1 步态特征提取过程Fig 1 Gait features extraction process

2 基于CLSTM步态模式分类

2.1概述

一般的模式识别方法,如HMM、SVM及传统CNN模型,只独立计算出不同传感器数据的静态特征和动态特征,且只考虑当前分割时间段内的数据,忽略步态序列的连续性。本文基于LSTM构建步态序列特征模型,充分利用步态时间序列的时间信息,通过记忆单元存储、修正并连接内部状态信息(Cell State),精确改变权值。

2.2基于LSTM的循环神经网络模型

文献[1-2]采用传统CNN分类步态,全连接层每个神经元都与特征图的每个节点连接,无疑增加了权值矩阵,增大了计算量;且全连接方式未考虑步态在时间维度上的相关性,独立计算每个特征值导致分类效果较差。本文提出采用LSTM处理步态时间序列特征图,通过LSTM的输入门、遗忘门、输出门保护和控制每个记忆单元的激活情况,更好地学习步态时间信息,精确修正权值。

LSTM模型中,每一时刻的隐含层输出都会作为下一时刻隐含层的输入,即上一时刻的输出值影响下一时刻的输入值,建立步态时间序列模型,如图2所示。

图2 步态分类的LSTM模型示意图Fig.2 Schematic diagram of LSTM model for gaits classification

LSTM的输入为步态特征序列(a1,a2,…,aT)和t-1时刻隐藏层输出ht-1,输出步态概率分布为(h1,h2,…,hT)。LSTM模型完成步骤如下:

(1) 计算步态特征t时刻的“候选”输入值cint和输入门激活值it。

(4)

(5)

其中:gi,gc分别为sigmoid函数和tanh函数;ct-1为t-1时刻步态状态信息;Wai,Whi,Wci分别为输入a、隐含层输出h以及状态c到输入门i的权值矩阵;Wac,Whc为输入a和隐含层输出h到细胞状态c的权值矩阵;bi,bcin分别为输入门激活偏置向量和步态特征激活偏置向量。采用沿时间反向传播方法(BPTT)[13]训练权值矩阵和偏置向量参数。it的取值为[0 1],数值越大说明t时刻cint被写进t时刻步态状态ct的概率越大。

(2) 计算遗忘门激活值ft。

(6)

其中:gf为sigmoid函数;Waf,Whf,Wcf为输入a、隐含层输出h以及状态c到输入门f的权值矩阵;bf为遗忘门激活偏置向量。ft的取值为[0 1],数值越小,说明遗忘程度越高,则t时刻步态状态不会被t-1时刻步态状态影响。

(3) 细胞状态(Cellstate)更新。

通过ft和it更新ct值,

(7)

其中:ct是t时刻值cint和t-1时刻值ct-1的有效结合;ft·ct-1表示的是t时刻步态状态ct受到ct-1的影响程度,ft取值越大,则ct-1值完全赋值给ct;it·cint表示t时刻允许当前输入步态信息cint决定当前步态状态ct的程度,it取值越大,则cint最大化地决定ct,没有任何步态信息损失,全部传入ct。

(4) 计算输出门激活值ht、隐藏层输出值ot。

(8)

(9)

其中:go是sigmoid函数;Wao、Who、Wco分别为输入a、隐含层输出h、以及状态c到输出门o的权值矩阵;bo表示输出门激活偏置向量;ht是由ot决定状态ct中所有步态信息有效性的概率分布,决定t时刻步态信息所属步态类别的概率。

2.3基于CLSTM的步态分类方法

基于CLSTM的步态分类方法如图3所示,包括输入层、CNN步态特征提取层、LSTM循环层以及Softmax分类层。算法步骤如下:

(1) 由1.1节提出的步态输入数据表示方法,将2种原始步态信号扩展为36×N的多轴步态数据相邻的矩阵Y。

(2) 式(3)采用4层5×5的卷积核Pl作为特征提取器提取步态特征,卷积核个数为64个,依据反向传播[14]更新卷积核,得到表示原始步态信号的步态特征图(a1,a2,…,aT)。

(3) 应用LSTM学习步态特征,并建立步态时间模型;将时间序列数据(a1,a2,…,aT)输入到LSTM模型(ht,ct)=LSTM(at,ht-1,ct-1),得到t

时刻输出的步态模式向量ht和状态向量ct,LSTM节点个数为128个。

图3 基于CLSTM的步态模式分类方法Fig.3 CLSTM method for gait pattern classification

3 实验和结果分析

3.1实验数据

实验采用包含多种步态模式加速度数据的Southern California University人体日常行为数据库USC-HAD[4]评估本文方法的有效性。USC-HAD是关于14名健康实验参与者基于加速度和陀螺仪传感器获取并整理的步态数据库,包含了11种步态模式,见表1。步态采样频率为100 Hz,步态长度N为100。

3.2实验结果与分析

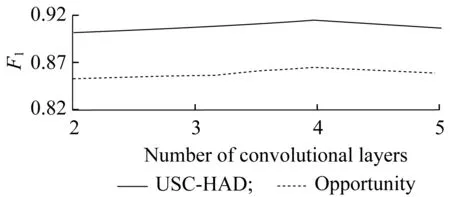

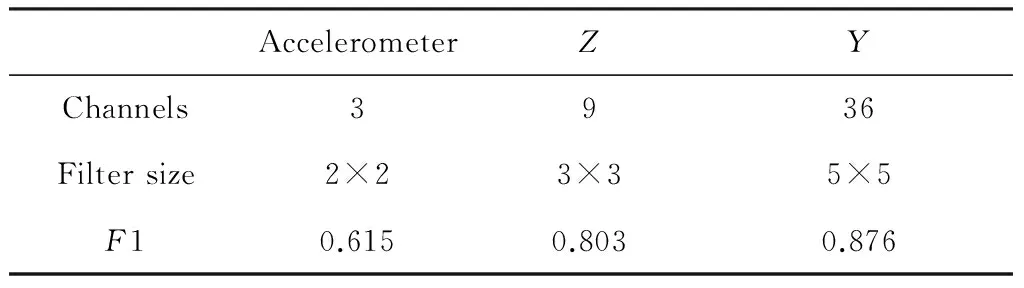

3.2.1 模型参数对分类的影响 卷积层数和卷积核大小对CLSTM方法分类结果的影响见图4和表2。

图4 卷积层数对F1值的影响趋势图Fig 4 Trend of the effect of number of convolution layers on F1

从图4可以看出,当卷积层数为4时,对两个数据集(USC-HAD和opportunity[15])分类获得的结果最优,因为4层卷积网络能很好地提取步态足够的本质特征,且无需进行更多的冗余计算,不仅减少了运行时间,也能得到较好的结果。

由表2可知,将2种原始步态信号扩展为36×N的多轴步态数据相邻的矩阵Y,F1值比输入信号为Z(式(1))时高出7%;随着输入步态信号维度大小的不同,调整卷积核大小为5×5。因为不同轴步态信号存在信息相关性,通过5×5的卷积运算使得不同轴步态数据在CNN卷积过程中能共同参与计算,提取得到的特征更能表示原始步态信息,从而得到很好的结果。

表1 步态模式Table 1 Gaits pattern

表2 输入数据和卷积核大小对F1值的影响Table 2 Effect of size of input data and convolution kernel on F1

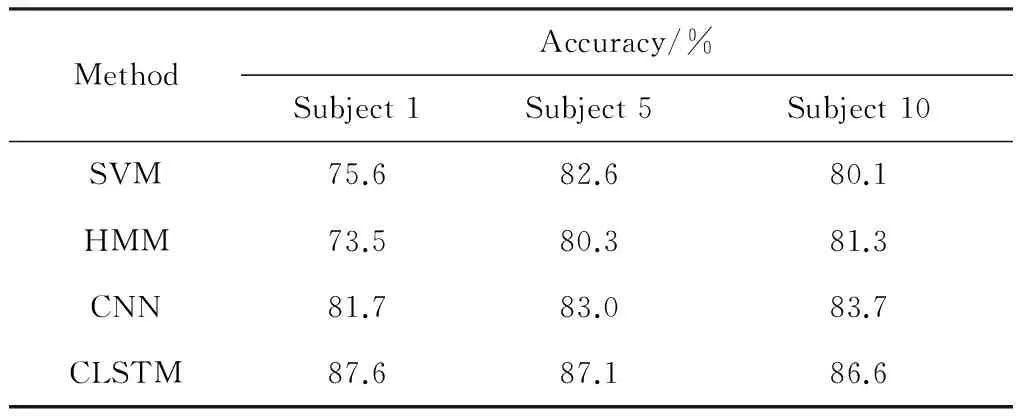

3.2.2 与传统方法的比较 将CLSTM方法与传统模型方法SVM[1]、HMM[7]、CNN[3]应用于USC-HAD数据上,结果如表3所示。其中,Subject 1、Subject 5、Subject 10表示3个实验参与者,结果用Accuracy参数[12]评估各种方法的性能。选取每个实验参与者每种步态10个样本,每个样本有100个数据点。

表3 步态分类方法的实验结果比较Table 3 Results comparison of the gait pattern classification methods

由表3可知,CLSTM方法应用在不同实验参与者上的表现都非常好,说明该方法适用于传感器步态分类;CLSTM和CNN比传统模型SVM和HMM识别精度高,说明CNN提取特征对步态分类更加高效和精确,而统计特征越来越不适用于复杂的步态序列识别和分类。

CLSTM方法对Subject 1、Subject 5、Subject 10的分类精度比CNN高出3%以上,表明循环LSTM提供了步态间更清晰的分割特性,能更好地区分相似的步态,得到了每种步态更好的分类结果,提升了整体的分类精度。

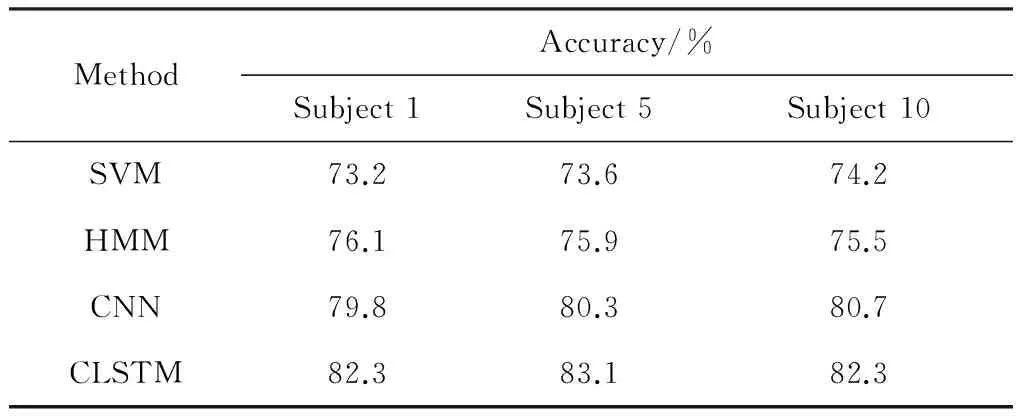

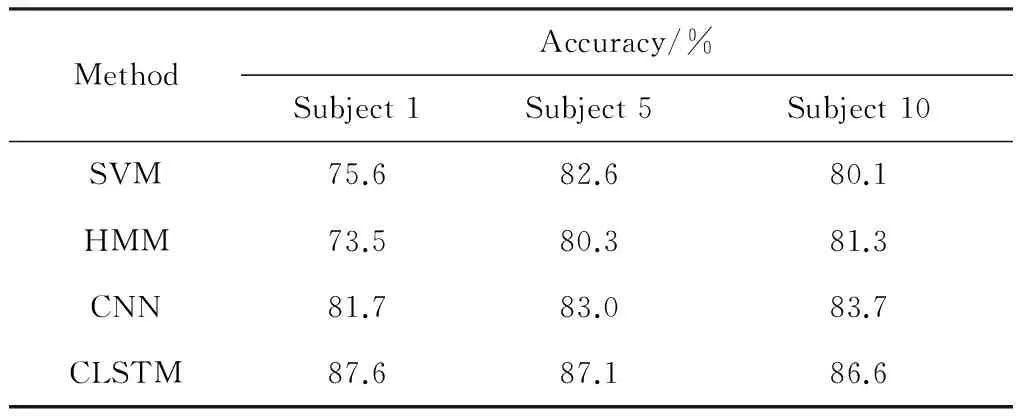

3.2.3 对5种和11种步态模式数据分类的实验结果与分析 细分的步态模式会有多种相似的步态,如“向前走”、“向左走”和“向右走”,为验证本文方法对粗分步态模式和细分步态模式的分类效果,分别针对5种粗分步态模式(走、跑、上楼、下楼和跳跃)和11种细分步态模式(如表1)进行实验,结果如表4、表5所示。

表4 5种步态模式的分类结果比较Table 4 Results comparison of classifying 5 gaits pattern

由表4、5可知,无论对5种步态模式还是11种步态模式,CLSTM方法的分类效果比SVM、HMM、CNN方法更有效。SVM和HMM分类11种步态模式比分类5种步态模式时分类效果要差,而CNN和CLSTM对这两类步态模式分类效果均有所提高,说明深度学习方法更能区别相似步态模式,同时保持分类可靠性和高精度。CLSTM比CNN的精度提高了5%,表明LSTM处理步态特征序列更有利于分类。

表5 11种步态模式的识别结果比较Table 5 Results comparison of classifying 11 gaits pattern

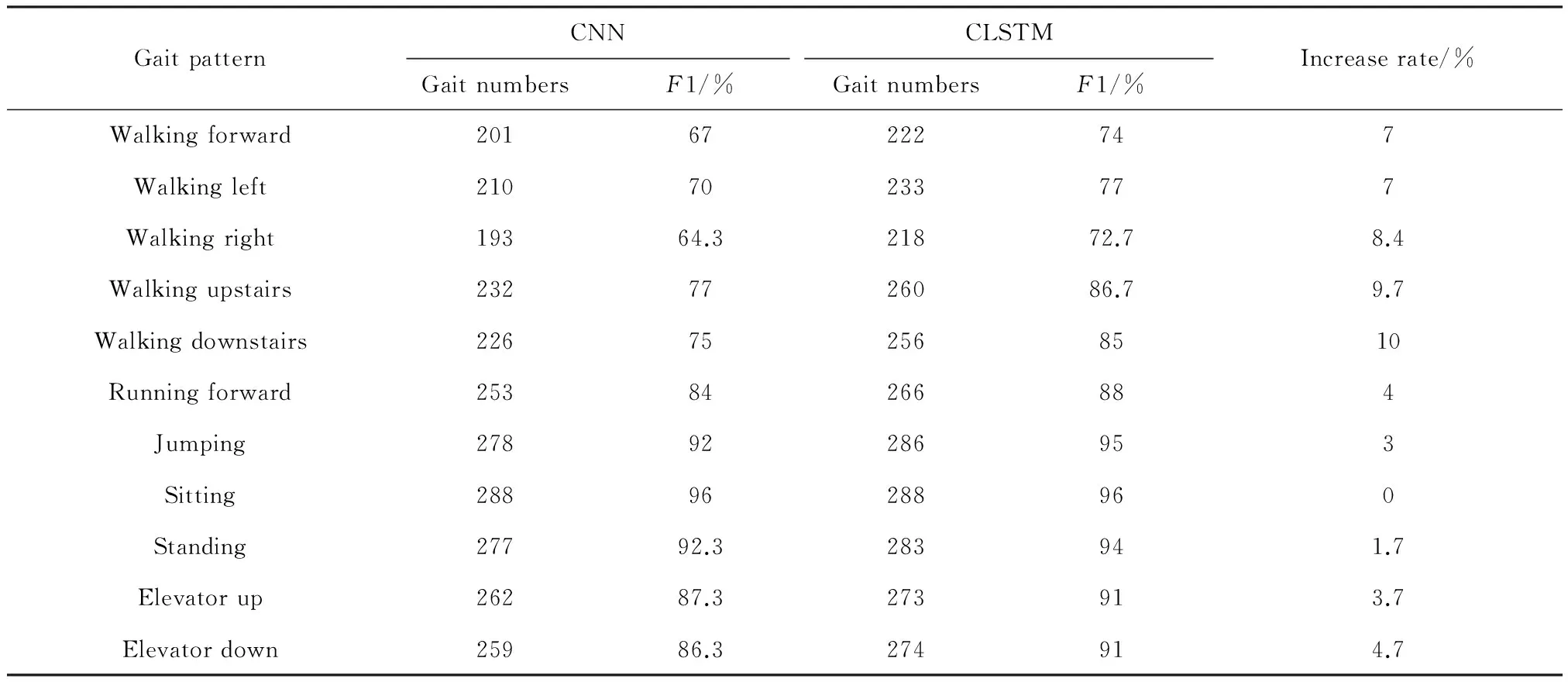

3.2.4 CLSTM方法对11种步态模式的分类实验 为了验证本文方法分类多种模式步态的精确性,选取USC-HAD数据集中每种步态连续的300个样本点,分别用CLSTM和CNN分类11种步态,其中CNN输入步态数据没有进行不同轴组合排列,结果见表6。由表6可知,CLSTM方法分类每一种步态的结果都比CNN的分类结果高约3%~10%,说明本文方法更加适用于识别多种细分化步态模式,采用基于步态时间相关性的LSTM替代全连接方式处理步态特征能得到更优的识别结果;分类“向前走”,“向左走”和“向右走”3种极其相似的步态模式时,CLSTM的分类结果比CNN的分类结果高出7%之多,因为联合计算不同轴步态数据对提取步态更本质特征是有利的,同时基于时间序列的LSTM模型学习步态长期依赖性分类步态更好。

4 结束语

本文提出的CLSTM步态模式分类方法能够很好地分类细分的步态模式,CNN提取步态时间序列特征方法替代手动提取步态统计和时频域特征,提取的特征经LSTM记忆模型能学习到步态特征时间上的长期依赖性。结果表明基于时间序列模型的步态模式分类方法对多模式步态分类效果很好。本文分割的数据长度为传感器采样频率(1 s),而不同人的各步态频率存在差异,为更好地分析步态特性,提高步态分类精度,分割数据仍是未来工作的重点。分类更多人体行为将是研究的目标。

表6 CNN和CLSTM分类11种步态结果比较Table 6 Results comparison of CNN and CLSTM in classifying 11 gaits pattern

[1] WU J,XU H.An advanced scheme of compressed sensing of acceleration data for telemonintoring of human gait[J].Biomedical Engineering Online,2016,15(1):1-15.

[2] RONAOO C A,CHO S B.Evaluation of deep convolutional neural network architectures for human activity recognition with smartphone sensors[C]//Proceedings of the KIISE Korea Computer Congress.Korea:[s.n.] ,2015:858-860.

[3] ZHENG Y,LIU Q,CHEN E,etal.Time series classification using multi-channels deep convolutional neural networks[C]//International Conference on Web-Age Information Management.USA:Springer International Publishing,2014:298-310.

[4] ZHANG M,SAWCHUK A A.USC-HAD:A daily activity dataset for ubiquitous activity recognition using wearable sensors[C]//Proceedings of the 2012 ACM Conference on Ubiquitous Computing.USA:ACM,2012:1036-1043.

[5] FIGO D,DINIZ P C,FERREIRA D R,etal.Preprocessing techniques for context recognition from accelerometer data[J].Personal and Ubiquitous Computing,2010,14(7):645-662.

[6] BULLING A,BLANKE U,SCHIELE B.A tutorial on human activity recognition using body-worn inertial sensors[J].ACM Computing Surveys (CSUR),2014,46(3):1- 33.

[7] ANGUITA D,GHIO A,ONETO L,etal.A public domain dataset for human activity recognition using smartphones[C]//21th European Symposium on Artificial Neural Networks,Computational Intelligence and Machine Learning (ESANN).Bruges,Belgium:[s.n.] ,2013:437-442.

[8] ZHANG L,WU X,LUO D.Human activity recognition with HMM-DNN model[C]//2015 IEEE 14th International Conference on Cognitive Informatics & Cognitive Computing (ICCI* CC).USA:IEEE,2015:192-197.

[9] ZENG M,NGUYEN L T,YU B,etal. Convolutional neural networks for human activity recognition using mobile sensors[C]//2014 6th International Conference on Mobile Computing,Applications and Services (MobiCASE).USA:IEEE,2014:197-205.

[10] SAINATH T N,VINYALS O,SENIOR A,etal.Convolutional,long short-term memory,fully connected deep neural networks[C]//2015 IEEE International Conference on Acoustics,Speech and Signal Processing (ICASSP).USA: IEEE,2015:4580-4584.

[11] HA S,YUN J M,CHOI S.Multi-modal convolutional neural networks for activity recognition[C]//2015 IEEE International Conference on Systems,Man,and Cybernetics (SMC).USA:IEEE,2015:3017-3022.

[12] YANG J B,NGUYEN M N,SAN P P,etal.Deep convolutional neural networks on multichannel time series for human activity recognition[C]//Proceedings of the 24th International Joint Conference on Artificial Intelligence (IJCAI).Buenos Aires,Argentina:ACM ,2015:25-31.

[13] SAK H,SENIORi A W,BEAIFAYS F.Long short-term memory recurrent neural network architectures for large scale acoustic modeling[C]//International Speech Communication Association.USA:[s.n.] ,2014:338-342.

[14] ALSHEIKH M A,SELIM A,NIYATO D,etal.Deep activity recognition models with triaxial accelerometers[C]// Proceedings of the 23rd ACM International Conference on Multimedia.USA:ACM,2015:689-692.

AGaitPatternClassificationMethodBasedonCLSTM

XUFan,CHENGHua,FANGYi-quan

(SchoolofInformationScienceandEngineering,EastChinaUniversityofScienceandTechnology,Shanghai200237,China)

Gait classification is an effective method for the assessment of human motion energy consumption,in which the key issue is to improve its classification accuracy and decrease the dependence on statistic features.Aiming at the shortcoming of the traditional gait classification methods in classifying subdivided gaits,this paper proposes a CLSTM method by considering the continuity of the gait and the signal correlation among different axes.By means of CNN convolution operation,this proposed method can extract the gait features by calculating the gait data among multi-axis.Besides,the present method utilizes the LSTM-based gait time series model to learn long-term dependent relation on gait features in the time dimension.Finally,it is illustrated via experiment on USC-HAR datasets that the proposed method can extract gait sequence features and effectively utilize the characteristics of gait time-series to raise classification accuracy in11gaits pattern.

gait classification; signal correlation; convolution neural network; LSTM

1006-3080(2017)04-0553-06

10.14135/j.cnki.1006-3080.2017.04.015

2016-10-17

许 凡(1990-),男,安徽池州人,硕士生,主要研究方向为信号处理。E-mail:1005364989@qq.com

程 华,E-mail:hcheng@ecust.edu.cn

TP391.41

A