基于卷积神经网络的高分辨率SAR图像飞机目标检测方法

2017-05-25王思雨高鑫孙皓郑歆慰孙

王思雨高 鑫孙 皓郑歆慰孙 显

①(中国科学院电子学研究所 北京 100190)

②(中国科学院大学 北京 100049)

基于卷积神经网络的高分辨率SAR图像飞机目标检测方法

王思雨①②高 鑫*①孙 皓①郑歆慰①孙 显①

①(中国科学院电子学研究所 北京 100190)

②(中国科学院大学 北京 100049)

传统的合成孔径雷达(Synthetic Aperture Radar,SAR)图像飞机检测方法一般利用像素对比度信息进行图像分割,从而提取待定目标。然而这些方法只考虑了像素亮度信息而忽视了目标的结构特征,进而导致目标的不精确定位和大量虚警的产生。基于上述问题,该文构建了一个全新的SAR图像飞机目标检测算法框架。首先,针对大场景SAR图像应用需求,提出了改进的显著性预检测方法,从而实现SAR图像候选飞机目标多尺度快速粗定位;然后,设计并调优了含4个权重层的卷积神经网络(Convolutional Neural Network,CNN),实现对候选目标的精确检测和鉴别;最后,因为SAR数据量有限、易导致过拟合,提出4种适用于SAR图像的数据增强方法,具体包括平移、斑点加噪、对比度增强和小角度旋转。实验证实该飞机检测算法在高分辨率TerraSAR-X数据集上效果显著,与传统的SAR飞机检测方法相比,该方法检测效率更高,泛化能力更强。

合成孔径雷达(SAR);飞机检测;卷积神经网络(CNN);数据增强;视觉显著性

1 引言

合成孔径雷达(Synthetic Aperture Radar,SAR)可以不受气候、天气、光照等条件影响,获得高分辨率雷达图像。与光学传感器相比,SAR在侦察、监视和跟踪等军事领域更具优势。然而SAR图像成像机理较为复杂,目标由较少的散射点组成而没有清晰轮廓,图像存在斑点噪声,这使得SAR飞机检测困难重重。

传统的SAR图像目标检测方法可以分为3类[1]。第1种基于单特征的方法通常利用雷达散射截面积(Radar Cross Section,RCS)信息挑选对比度较亮的部分作为候选目标。其中大多数检测方法使用恒虚警率(Constant False Alarm Rate,CFAR)算法做图像分割和候选目标定位。CFAR包含多种衍生算法,包括CA-CFAR (Cell-average CFAR)[2],SO-CFAR (Smallest of CFAR),GO-CFAR (Greatest of CFAR)[3],OS-CFAR (Order-statistic CFAR)[4]和VI-CFAR(Variability Index CFAR)[5]。CFAR具有恒虚警率和自适应阈值的特性[6–8]。然而CFAR检测器只考虑像素对比度而忽略了目标的结构信息,从而导致了目标的不精确定位。第2种是基于多特征的方法。多种特征如几何结构[9],扩展分形(Extended Fractal,EF)[10],小波系数[11]等可以融合起来检测目标。文献[12]中作者将梯度纹理显著图与CFAR相结合来检测停机坪上的飞机目标。综合而言,设计特征是复杂且耗时的,并且同种特征组合不一定适用于所有的场景。第3种是基于先验的方法,先验知识如成像参数、经纬度信息等需要协同加入检测流程[13]。这类方法较复杂且实际中应用较少。

随着人工智能的发展,机器学习被引入了SAR目标检测领域。支持向量机(Support Vector Machine,SVM)[14]和AdaBoost(Adaptive Boosting)[15]等常用方法在MSTAR(Moving and Stationary Target Acquisition and Recognition)[16]数据集上表现良好。虽然这些方法比传统方法性能有所提升,但它们仅适用于小样本情况,设计具有高泛化能力的特征难度较高。卷积神经网络(Convolutional Neural Network,CNN)[17]可以自动学习结构化特征并取得较好的性能。文献[18,19]中作者使用CNN对MSTAR数据集进行分类并取得较好的效果。

本文构建了一个完整的SAR图像飞机目标检测框架。总体流程如图1所示,本文的主要工作如下。首先,提出了一种改进的显著性预检测方法,实现在大场景中多尺度粗略快速地搜索候选目标。与滑动窗方法相比,该方法有效提升了检测效率并实现了多尺度定位。然后,设计并调校了适用于SAR图像的CNN模型,实现对预检测候选目标的精确检测,实验证实本文的CNN检测精度高于其他常用的检测方法。此外,为了应对SAR数据量有限的问题,提出了4种适用于SAR图像的数据增强方法,包括平移、加噪、对比度增强和小角度旋转。实验结果表明,该检测框架在TerraSAR-X数据集上有效减小了过拟合现象的影响,显著提升了飞机目标的检测率。

2 改进的显著性预检测方法原理与设计

在预检测阶段,滑动窗方法通常用于获取可能的候选目标。该方法机械地在待检测图像上,按预设步长和窗口大小,从左向右、从上向下滑动并裁切候选样本。然而,滑动窗法计算量很大,在大场景遥感图像中预检测效率较低。

为了解决上述问题,分别在训练和测试阶段前引入了一种基于显著性的预检测方法[20],以便快速粗略地定位候选目标。文献[20]中作者首先计算每个像素的显著值并得到整幅图像的显著图,飞机切片的显著图如图2所示。相同大小的初始方形窗口被不重不漏地覆盖在显著图上。然后,迭代计算每个窗口的几何中心pc并将窗口中心移动到新的直到pc和之 间的距离小于预设值δ。迭代结束后,所有飞机目标都被窗口框定,图中还存在一些不包含真实目标的虚警。

该方法的缺点是用固定尺寸的窗口检测不同尺寸的飞机。考虑到停机坪区域停放不同尺寸飞机的情况,本文在原有算法的基础上加入多尺度预检测模块。首先不同大小窗口的单尺度预检测分别进行,然后是第1次窗口融合。融合采用非极大值抑制算法(Non-Maximum Suppression,NMS),将包含同一目标的不同窗口融合为一个。当所有单尺度预检测结束后,将进行第2次窗口融合。

改进的显著性预检测方法的简要流程图如图3所示。所有选中的切片将被保存为候选目标图像以备后续CNN的精确检测。与滑动窗方法相比,该方法在大尺度SAR图像检测中更为高效。此外,改进后的方法因二次窗口融合,虚警率显著降低,且可以精确地定位不同尺寸的飞机目标。

3 数据增强原理与设计

深度学习在训练集较大时能够取得较好效果,但与光学图像相比SAR图像相对较少,易导致严重的过拟合。不同于常用的数据增强方法,由于SAR图像与光学图像成像原理差别较大,需要引入新的数据增强方法。本文提出适用于SAR图像的4种数据增强方法来扩充已标注数据集。4种数据增强方法如下所示。

3.1 平移

在目标不超过图像边界的条件下,对原始图像执行平移操作。假设原始图像大小为m×n,则平移后的图像可以表示为:

其中,(x,y)是位移尺度,(i,j)是平移后坐标。图4(a),图4(b)给出了平移前后的目标示例。

3.2 加噪

由于特殊的成像特性,SAR图像总是带有斑点噪声。斑点噪声是白色散斑状的乘性噪声。加噪后的图像可以被表示为:

其中,P表示原始图像,N表示斑点噪声。N为均值为0方差为v的均匀分布的随机噪声。由于加噪越严重图像越模糊,必须确保噪声的强度低于预设值。图4给出了基于原始图像图4(a)的加噪示例图4(c)。

3.3 对比度增强

同一地点拍摄的SAR图像可能有不同的亮度。因此本文利用像素对比度信息进行数据增强。对比度增强可以通过非线性变换来实现,具体变换可以表示如下:

其中,P表示原始图像,P′表示对比度增强后的图像。k是用户预定义的可调节因子,其值在0和1之间。I是与P具有相同维数的单位矩阵。此外,P和P′ 范 围均为(0,1)。图4(a),图4(d)给出了对比度增强的示例。

3.4 小角度旋转

雷达散射特性随着物体和传感器之间相对姿态的变化而变化。然而文献[21]中作者证明了飞机目标后向散射特性的位置和强度在至少5°内是旋转不变的。旋转坐标与原始坐标的映射关系可以表示为:

4 卷积神经网络原理与设计

基于LeNet-5网络,改进后的网络更适用于SAR图像飞机检测。由于SAR数据较少,大量的实验表明网络超过6层会发生过拟合。如图5所示,本文的CNN网络由4个可训练参数层组成。为了减小过拟合的影响,引入了dropout方法[22]。此外,用修正线性单元(Rectified Linear Units,ReLU)在实践中能很好地应对饱和问题[23],将其代替sigmoid函数。本文基于典型的随机梯度下降法,引入改进算法如动量法[24]以最小化损失函数。具体实现细节如下。

4.1 卷积层

在卷积层中,将输入X和一组滤波器W进行卷积,然后与偏置b相加。W表示可训练滤波器,b表示可训练偏差。最后,将上述结果传递给非线性激活函数f。公式如下:

其中,f(.)是修正线性单元(ReLU),函数由式(6)给出:

ReLU缩短了训练时间,并且在没有无监督预训练时效果较好[23]。

4.2 Max-pooling

Max-pooling在卷积层之后执行降采样操作。Max-pooling层计算出m×n局部切片内区域的最大值,公式如下:

其中,(m,n)表示局部区域的大小,Y表示pooling操作的输出。

4.3 Softmax

Softmax分类器在输出层后对切片进行二分类。它求出每类的判别概率并选择最大值作为最终输出。Softmax函数公式如下:

其中,Xi表示最后隐藏层的输出,k表示类的数量,Yi表示类i的判别概率。

4.4 实现细节

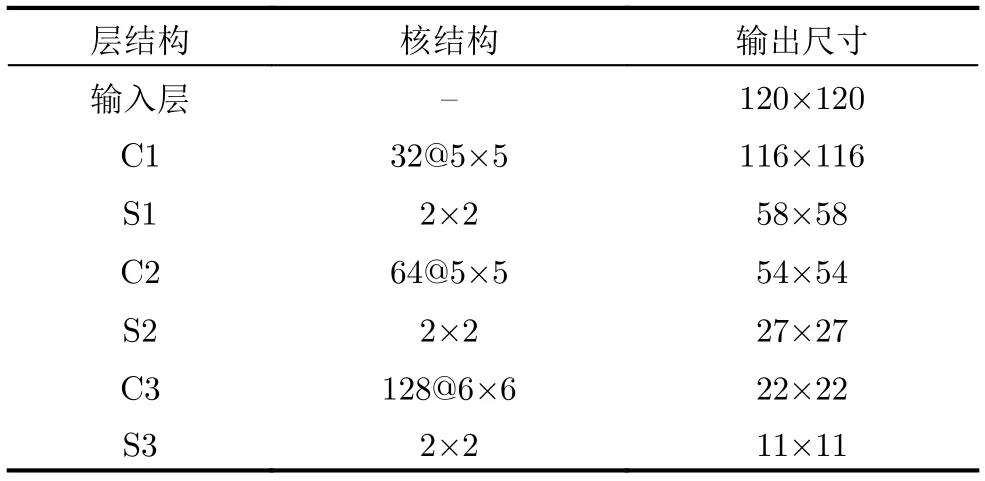

本文CNN的结构如图5所示,它由3个卷积层和3个pooling层组成。第1个卷积层的卷积核大小为5×5,并有32个输出图。相似地,第2个卷积层的卷积核尺寸也是5×5且有64个输出图。最后一个卷积层有128个输出图,卷积核大小为6×6。每个卷积层后连着2×2的Max-pooling层。输入图像切片的大小为120×120。它们在第1个卷积层后变为116×116,在第1个pooling层之后变为58×58。循环往复,Softmax层前输出两个大小为11×11的特征图。表1列出了CNN的具体结构数据。网络训练时间约30 min,测试时间约几秒钟。

表1 CNN参数Tab. 1 Parameters of our CNN

5 实验与分析

5.1 0.5 m分辨率TerraSAR-X数据集

本文使用的数据集是高分辨率TerraSAR-X卫星数据。所有数据含30张原始图像,大小约20000× 20000,覆盖几个常见机场,分辨率为0.5 m×0.5 m。本文数据集包含多种类型、多种朝向的飞机。首先,基于原始图像手动标记飞机目标并保存真值文件。在手工标注中我们参考了SAR解译人员的意见,以保证样本真值的可靠性。然后将切片分为两类:1000个目标和16000个非目标。之后,随机地将样本按照4:1的比例分为训练集和测试集。图6给出了训练集的示例。可以看到,正样本包含了各种形态的飞机,负样本包含了各种复杂场景。

5.2 改进的显著性预检测方法参数设置及结果分析

在大尺度遥感图像中,滑动窗方法一般用于候选目标预检测。显著性预检测方法的性能比滑动窗方法更好。显著性预检测方法可以快速定位候选目标并显著减少虚警。通过比较两种方法后发现,给定一个大小为8000×8000的SAR图像,显著性预检测方法在42.95 s内选出1489个候选目标。相同情况下,滑动窗口方法在80.06 s内筛选出611524个候选目标。

在原始显著性预检测方法的基础上,本文提出了多尺度算法来检测不同尺寸的飞机目标。为了适应在未知场景中不同尺寸飞机的情况,对原始算法进行了基于多尺度的改进。表2表示了不同预检测方法在大小为3708×3951的SAR图像上的性能比较。Selective Search方法采用图像分割和层次算法,虽能适应不同尺度,但处理流程复杂、运算速度较慢,虚警较多,为535个,框定的飞机目标不够完整,检测框尺寸波动过于明显;显著性预检测方法计算快速,但漏检2架飞机,虚警266个;改进后的显著性预检测方法可以搜索出所有真实目标,虚警相对原始显著性方法减少58个,检测框长宽比合适,范围可以人工设置,不会出现极小或极大的窗口。Selective search方法、原始显著性预检测方法和改进后的预检测方法的实验效果示例如图7所示,可以看到改进后的显著性方法预检测性能更好。

表2 不同预检测方法性能比较Tab. 2 The performance of different pre-detection methods

5.3 数据增强参数设置及结果分析

在数据增强阶段,800个原始训练正样本首先按照0.01的方差斑点加噪,然后顺时针旋转5°,再向上平移5个像素,最后以k=0.5对比度增强。按这种方式,原始的训练正样本扩展16倍至12800个,同样地,原始训练负样本由200个扩展到3200个。

为了比较不同数据增强方法,本文对每一种增强方法做了单独实验,同时与4种增强方法合用进行对比,实验结果如表3所示。

表3 不同数据增强方法的检测正确率Tab. 3 Accuracy rates of CNN with different augmentation methods

没有施加任何数据增强方法时,CNN的检测正确率为86.33%。分析可得:每种数据增强方法对最后检测正确率的提升都有作用,斑点加噪的提升作用更大。当把4种增强方法结合起来时,检测正确率达到了96.36%,超过了单独使用每种数据增强方法的性能。

5.4 卷积神经网络参数设置及结果分析

在训练前,将具有不同尺寸的候选目标调整为统一尺寸120×120。本文做了大量实验以获取最佳参数。当基本学习率为0.01,momentum为0.9,batchsize大小为50,迭代次数为5000时检测性能最佳。训练集包含25600个样本,测试集包含6400个样本。CNN部分的实验在具有Tesla k40M GPU和251 GB存储器的CAFFE框架上实现。实验的其余部分在具有32 GB存储器的3.1 GHz CPU上实现。

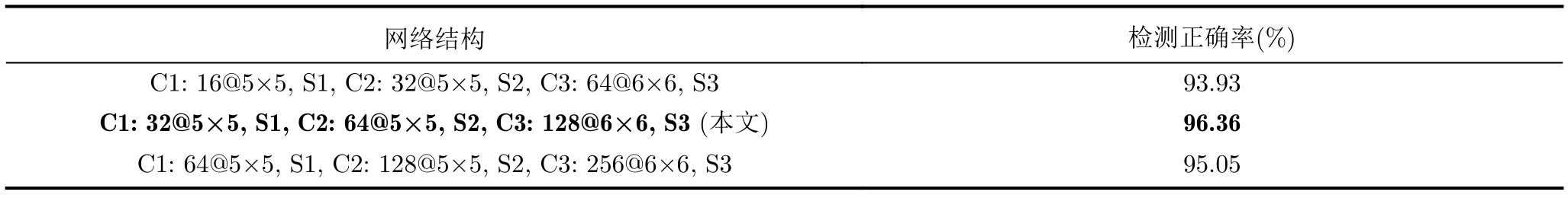

表4、表5、表6分别探究了不同网络结构、不同卷积核个数和不同卷积核大小对检测性能的影响。实验发现,分别改变网络层数、卷积核个数、卷积核大小后检测正确率均低于本文方法的性能指标。

为了验证方法的高效性,将本文的CNN网络与在SAR图像处理中广泛使用的其它机器学习方法(例如SVM和AdaBoost)作了对比。SVM使用径向基函数(Radial Basis Function,RBF)作为核函数,AdaBoost使用决策树作为弱分类器。方向梯度直方图(Histogram of Oriented Gradient,HOG)加SVM方法也加入了比较。表7列出了各种常用方法的检测正确率。实验证实,本文CNN的检测正确率达到96.36%,并且优于其他常用的SAR飞机检测方法。

表4 不同网络层数的检测正确率比较Tab. 4 Accuracy rates of CNN with different number of layers

表5 不同卷积核个数的检测正确率比较Tab. 5 Accuracy rates of CNN with different number of kernels

表6 不同卷积核大小的检测正确率比较Tab. 6 Accuracy rates of CNN with different size of kernels

表7 不同方法在同一数据集上的平均检测率Tab. 7 Average detection rates of different methods on the same dataset

不同方法的ROC曲线如图8所示,可以看到我们的CNN方法与横轴所围面积最大,检测性能最好,其余由高到底依次是HOG+SVM,SVM和AdaBoost方法。

当把上述所有算法合为一体时,最终得到SAR图像飞机目标的完整检测算法框架。图9表示了该检测方法在某停机坪区域的检测结果。在这样的复杂场景下,虽然存在少量虚警但并无漏警。总之,本文的飞机检测框架在大场景SAR图像中可以取得较为理想的效果。

6 结论

本文构建了一个完整的SAR飞机目标检测算法框架。首先,提出了一种改进的显著性预检测方法,实现在大规模SAR场景中粗略快速地定位候选飞机目标。实验证实该方法与滑动窗方法相比更为高效,改进后多尺度的加入提升了对待测场景的适应性。然后,设计并调优了含4个权重层的CNN网络,实现对候选目标的精确检测并得到最终的检测结果。此外,为了丰富训练集并防止过拟合,提出了4种数据增强方法。具体包括平移、斑点加噪、对比度增强和小角度旋转。实验结果证实,本文的飞机检测算法框架取得了96.36%的检测正确率,并优于其他常用的SAR飞机检测方法。

[1]El-Darymli K,McGuire P,Power D,et al.. Target detection in synthetic aperture radar imagery: A state-of-the-art survey[J].Journal of Applied Remote Sensing,2013,7(1): 071598.

[2]Steenson B O. Detection performance of a mean-level threshold[J].IEEE Transactions on Aerospace and Electronic Systems,1968,4(4): 529–534.

[3]Gandhi P P and Kassam S A. Analysis of CFAR processors in homogeneous background[J].IEEE Transactions on Aerospace and Electronic Systems,1988,24(4): 427–445.

[4]Novak L M and Hesse S R. On the performance of orderstatistics CFAR detectors[C]. IEEE 25th Asilomar Conference on Signals,Systems and Computers,Pacific Grove,California,USA,Nov. 1991: 835–840.

[5]Smith M E and Varshney P K. VI-CFAR: A novel CFAR algorithm based on data variability[C]. IEEE National Radar Conference,Syracuse,NY,May 1997: 263–268.

[6]Ai Jia-qiu,Qi Xiang-yang,Yu Wei-dong,et al.. A new CFAR ship detection algorithm based on 2-D joint lognormal distribution in SAR images[J].IEEE Geoscience and Remote Sensing Letters,2010,7(4): 806–810.

[7]di Bisceglie M and Galdi C. CFAR detection of extended objects in high-resolution SAR images[J].IEEE Transactions on Geoscience and Remote Sensing,2005,43(4): 833–843.

[8]Jung C H,Kwag Y K,and Song W Y. CFAR detection algorithm for ground target in heterogeneous clutter using high resolution SAR image[C]. 3rd International Asia-Pacific Conference on Synthetic Aperture Radar (APSAR),Seoul,South Korea,Sep. 2011: 1–4.

[9]Olson C F and Huttenlocher D P. Automatic target recognition by matching oriented edge pixels[J].IEEE Transactions on Image Processing,1997,6(1): 103–113.

[10]Kaplan L M. Improved SAR target detection via extended fractal features[J].IEEE Transactions on Aerospace and Electronic Systems,2001,37(2): 436–451.

[11]Sandirasegaram N M. Spot SAR ATR using wavelet features and neural network classifier[R]. Defence Research and Development Canada Ottawa (Ontario),2005.

[12]Tan Yi-hua,Li Qing-yun,Li Yan-sheng,et al.. Aircraft detection in high-resolution SAR images based on a gradient textural saliency map[J].Sensors,2015,15(9): 23071–23094.

[13]Jao J K,Lee C E,and Ayasli S. Coherent spatial filtering for SAR detection of stationary targets[J].IEEETransactions on Aerospace and Electronic Systems,1999,35(2): 614–626.

[14]Zhao Q and Principe J C. Support vector machines for SAR automatic target recognition[J].IEEE Transactions on Aerospace and Electronic Systems,2001,37(2): 643–654.

[15]Sun Yi-jun,Liu Zhi-peng,Todorovic S,et al.. Adaptive boosting for SAR automatic target recognition[J].IEEE Transactions on Aerospace and Electronic Systems,2007,43(1): 112–125.

[16]Keydel E R,Lee S W,and Moore J T. MSTAR extended operating conditions: A tutorial[C]. Proc. SPIE 2757,Algorithms for Synthetic Aperture Radar Imagery III,Orlando,FL,Apr. 1996: 228–242.

[17]Krizhevsky A,Sutskever I,and Hinton G E. ImageNet classification with deep convolutional neural networks[C]. International Conference on Neural Information Processing Systems,South Lake Tahoe,Nevada,USA,Dec. 2012: 1097–1105.

[18]Ding Jun,Chen Bo,Liu Hong-wei,et al.. Convolutional neural network with data augmentation for SAR target recognition[J].IEEE Geoscience and Remote Sensing Letters,2016,13(3): 364–368.

[19]Chen Si-zhe,Wang Hai-peng,Xu Feng,et al.. Target classification using the deep convolutional networks for SAR images[J].IEEE Transactions on Geoscience and Remote Sensing,2016,54(8): 4806–4817.

[20]Diao Wen-hui,Sun Xian,Zheng Xin-wei,et al.. Efficient saliency-based object detection in remote sensing images using deep belief networks[J].IEEE Geoscience and Remote Sensing Letters,2016,13(2): 137–141.

[21]Chen Jie-hong,Zhang Bo,and Wang Chao. Backscattering feature analysis and recognition of civilian aircraft in TerraSAR-X images[J].IEEE Geoscience and Remote Sensing Letters,2015,12(4): 796–800.

[22]Srivastava N,Hinton G,Krizhevsky A,et al.. Dropout: A simple way to prevent neural networks from overfitting[J].The Journal of Machine Learning Research,2014,15(1): 1929–1958.

[23]Glorot X,Bordes A,and Bengio Y. Deep sparse rectifier neural networks[C]. 14th International Conference on Artificial Intelligence and Statistics,Fort Lauderdale,FL,USA,2011: 315–323.

[24]Qian Ning. On the momentum term in gradient descent learning algorithms[J].Neural Networks,1999,12(1): 145–151.

王思雨(1992–),女,山西人,中国科学院电子学研究所硕士研究生,研究方向为SAR图像飞机目标检测识别。

E-mail: siyuwang92@163.com

成锐今年43岁,河北邯郸人。很多年前,他就从事金属加工业务,对于电焊、钣金等工作比较熟悉。2011年6月6日,他应聘到本市一家过滤器制造公司,专业从事铆工作业。

高 鑫(1966–),男,辽宁人,北京师范大学理学博士,现任中国科学院电子学研究所研究员,研究方向为SAR场景分类、目标检测识别、解译标注。

E-mail: gaxi@mail.ie.ac.cn

孙 皓(1984–),男,山东人,中国科学院大学工学博士,现任中国科学院电子学研究所副研究员,研究方向为遥感图像理解。

E-mail: sun.010@163.com

郑歆慰(1987–),男,福建人,中国科学院大学工学博士,现任中国科学院电子学研究所助理研究员,研究方向为大规模遥感图像解译。

E-mail: zxw_1020@163.com

孙 显(1981–),男,浙江人,中国科学院大学工学博士,现任中国科学院电子学研究所副研究员,研究方向为计算机视觉与遥感图像理解、地理空间大数据解译。

E-mail: sunxian@mail.ie.ac.cn

An Aircraft Detection Method Based on Convolutional Neural Networks in High-Resolution SAR Images

Wang Siyu①②Gao Xin①Sun Hao①Zheng Xinwei①Sun Xian①

①(Institute of Electronics,Chinese Academy of Sciences,Beijing100190,China)

②(University of Chinese Academy of Science,Beijing100049,China)

In the field of image processing using Synthetic Aperture Radar (SAR),aircraft detection is a challenging task. Conventional approaches always extract targets from the background of an image using image segmentation methods. Nevertheless,these methods mainly focus on pixel contrast and neglect the integrity of the target,which leads to locating the object inaccurately. In this study,we build a novel SAR aircraft detection framework. Compared to traditional methods,an improved saliency-based method is proposed to locate candidates coarsely and quickly in large scenes. This proposed method is verified to be more efficient compared with the sliding window method. Next,we design a convolutional neural network fitting in SAR images to accurately identify the candidates and obtain the final detection result. Moreover,to overcome the problem of limited available SAR data,we propose four data augmentation methods comprising translation,speckle noising,contrast enhancement,and small-angle rotation. Experimental results show that our framework achieves excellent performance on the high-resolution TerraSAR-X dataset.

Synthetic Aperture Radar (SAR); Aircraft detection; Convolutional Neural Networks (CNNs); Data augmentation; Visual saliency

TP753

A

2095-283X(2017)02-0195-09

10.12000/JR17009

王思雨,高鑫,孙皓,等. 基于卷积神经网络的高分辨率SAR图像飞机目标检测方法[J]. 雷达学报,2017,6(2): 195–203.

10.12000/JR17009.

Reference format:Wang Siyu,Gao Xin,Sun Hao,et al.. An aircraft detection method based on convolutional neural networks in high-resolution SAR images[J].Journal of Radars,2017,6(2): 195–203. DOI: 10.12000/JR17009.

2017-01-20;改回日期:2017-03-05;

2017-05-02

*通信作者: 高鑫 gaxi@mail.ie.ac.cn

国家自然科学基金青年基金(41501485)

Foundation Item: The National Natural Science Foundation of China (41501485)