融合显著性信息和社会力模型的人群异常检测

2016-10-13郭春梅吉培培

李 萌,陈 恳,郭春梅,李 斐,吉培培

融合显著性信息和社会力模型的人群异常检测

李 萌,陈 恳,郭春梅,李 斐,吉培培

( 宁波大学信息科学与工程学院,浙江宁波315211 )

人群异常事件检测是智能视频监控中的重要研究内容,本文提出一种新的融合时空特征的异常行为检测算法。首先提取显著性信息作为空间域特征,采用高精度的光流算法,结合社会力模型计算相互作用力作为时域特征;提出一种新的运动信息特征描述子——相互作用力直方图(HOIF),将其与显著性信息特征相融合送入支持向量机(SVM)进行学习训练,从而对人群事件进行分类。在UMN(University of Minnesota, Twin Cities)数据库上对本文算法有效性进行了验证。实验结果表明,该算法在检测正确率及鲁棒性上要优于其他算法。

时空特征;显著性信息;社会力模型;HOIF;SVM

0 引 言

近年来,随着人口的持续增长及城市化进程的不断加快,人群活动变得日益频繁,在交通路口、机场、火车站、旅游景区等人群密集的公共场所发生重大异常事件的现象屡见不鲜,人们的安全意识也在逐渐加强。因此,在智能视频监控中对大规模人群的异常检测则显得尤为重要[1]。

现有的对人群异常事件的检测主要分为两类:一种是基于个体目标检测和跟踪的方法[2]。该类方法集中研究视觉场景中的移动目标,识别并跟踪其运动轨迹,从轨迹中提取出运动目标特征来分析人群活动[3]。但在人群拥挤、遮挡的场面中,计算复杂度高,跟踪变得难以实现。

人群异常事件检测的第二种方法是从视频序列中提取全局特征和局部特征相结合的时空域特征[4-5]来分析人群行为。空间域特征的提取只考虑了目标与其邻域之间的差异性,时域特征的提取则是依靠分析一系列视频帧的整体场景,根据前后帧差异来判断异常事件的发生。目前很多算法只考虑了单一域的行为模式,例如社会力模型[6]、全局光流直方图[7]、显著性特征[8]等。

综合以上问题,本文提出一种新的融合时空特征的人群异常检测算法。该算法在特征提取及特征表示方面做了改进。首先采用分块的思想提取视频帧中的显著性信息作为空间域特征,并与由社会力模型提取出的时域特征——相互作用力相融合,经机器学习与训练来检测异常事件的发生。该方法有效的提高了人群异常事件检测率及鲁棒性。

1 基于HVS的显著性特征提取

人类视觉系统(HVS)是一种实现将外部世界投影在大脑中的机制,其中视觉注意力是研究HVS的一个重要特性。当人们观察一个场景时容易注意到一些低级特征,如颜色、亮度、对比度等,这说明在人类视觉系统中,选择性注意机制将主要接收视觉场景中不同于邻域地区的显著性区域信息。

在复杂场景中,通过选择性注意机制人眼可迅速有效的专注于重要的事件。一般来说,在视频帧中异常事件的发生可被描述成时空域中特征的突变,因此,异常事件也可被认为是视频帧中显著性区域。本文提出一种将显著性信息作为空间域特征与时域特征相融合的人群异常检测算法,采用自底向上的基于HVS与振幅谱的显著性检测算法[9]。首先将视频帧分解为个图像块,采用四元数傅里叶变换(QFT)的振幅谱来表示图像块的双通道颜色、强度和方向分布,最终每个图像块显著值的计算不仅由其与其他图像块的振幅谱差异决定,还取决于人类视觉灵敏度所影响的图像块显著性的权值。图像块的显著值计算公式为

图片尺寸为320×240,实验中采用4×4图像块。对人群场景进行显著性信息检测,实验结果如图2。

图2 (a) 正常帧;(b) 异常帧;(c),(d) 图像的显著性

2 人群运动状态信息提取

2.1 光流法

光流法是比较经典的运动估计算法,常用的光流算法有Horn-Schunck[10]光流法和Lucas-Kanade[11]光流法。本文采用Thomas Brox[12]等人提出的基于变形理论的高精度光流算法。该算法基于以下三个假设:亮度恒定约束、梯度恒定约束、保留不连续时空光滑性。为容许大的位移,要严格避免两个数据项之间的线性化,给出了一个一致的基于两个嵌套的固定点迭代的数值方案。实验证明这种新方法的角误差明显小于以前的光流估计方法,对参数变化的敏感程度非常低,因而在光照和噪声的影响下,基于变形理论的高精度光流法展现了良好的鲁棒性。

如果对每个像素点进行光流估计,计算量大且受噪声的影响严重,故提出网格状粒子采样。考虑到既要获得有效的特征又要保持较低的计算量,将粒子密度设置为总像素数的25%。图3显示了在UMN数据库视频场景中选用文中这三种光流算法产生的光流估计,可以看到,Horn-Schunck光流法和Lucas-Kanade光流法在非运动区域产生了大量光流,加大运算量,影响后续的人群运动特征的计算精度。而高精度的光流算法仅在人群运动区域产生光流估计,对光照和噪声具有强鲁棒性。

图3 依次使用HS光流法,LK光流法及高精度光流法产生的光流示意图

2.2 社会力模型

社会力模型是对行人受力的模拟,在社会力模型中,人是受主作用力的驱使做跟随运动,类似于牛顿力学。人群中行人受到的社会力为

2.3 相互作用力直方图

在光流计算的基础上进行二次特征提取,即相互作用力特征。相互作用力能很好的表征群体和个人的动态,但由于计算量大且存在大量的冗余,影响检测效率,提出一种新的特征描述子——相互作用力方向投标直方图。将平面九等分,对每个网格粒子在所属直方图方向的加权投标进行计算,其角度和幅值为

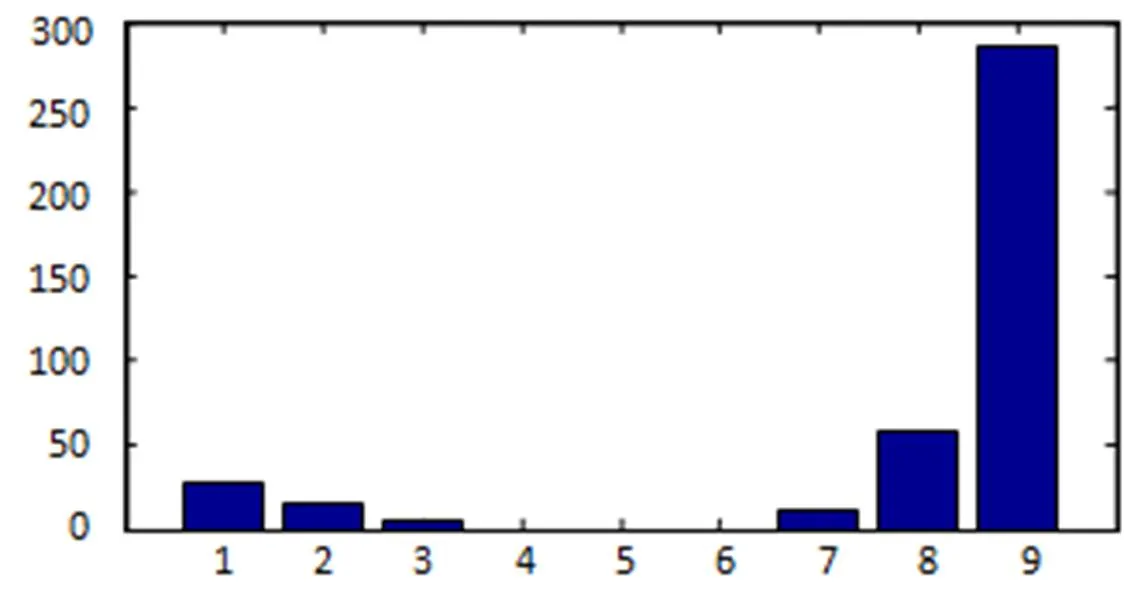

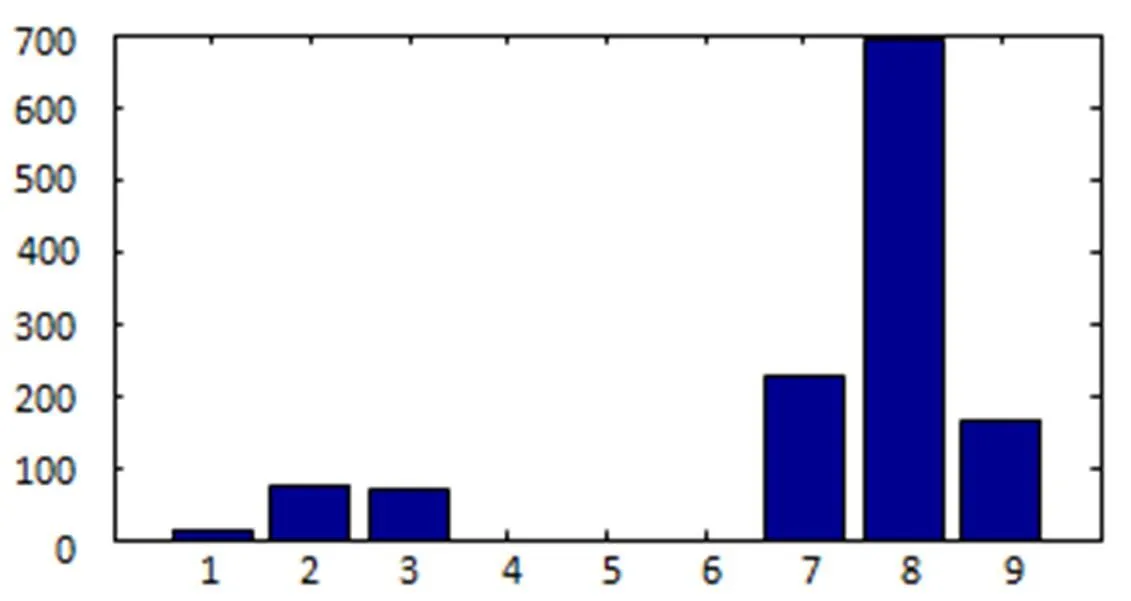

图4 (a) 是正常帧,(b) 是异常帧

图5 正常帧的相互作用力直方图

图6 异常帧的相互作用力直方图

3 算法描述

针对传统算法只考虑单一域模式的局限性,本文提出一种融合时空特征的人群异常事件检测算法。在视觉场景中显著性区域包含空间域的重要信息,相互作用力表征个人和群体的动态,提取HOIF作为时域特征,融合S和HOIF特征构建时空模型的人群异常检测。具体算法如下:

Step 3:对视频帧进行光流估计得到人群的运动速度及方向,结合社会力模型,提取HOIF特征矩阵。其中表示第帧的直方图矩阵,表示直方图的总维数;

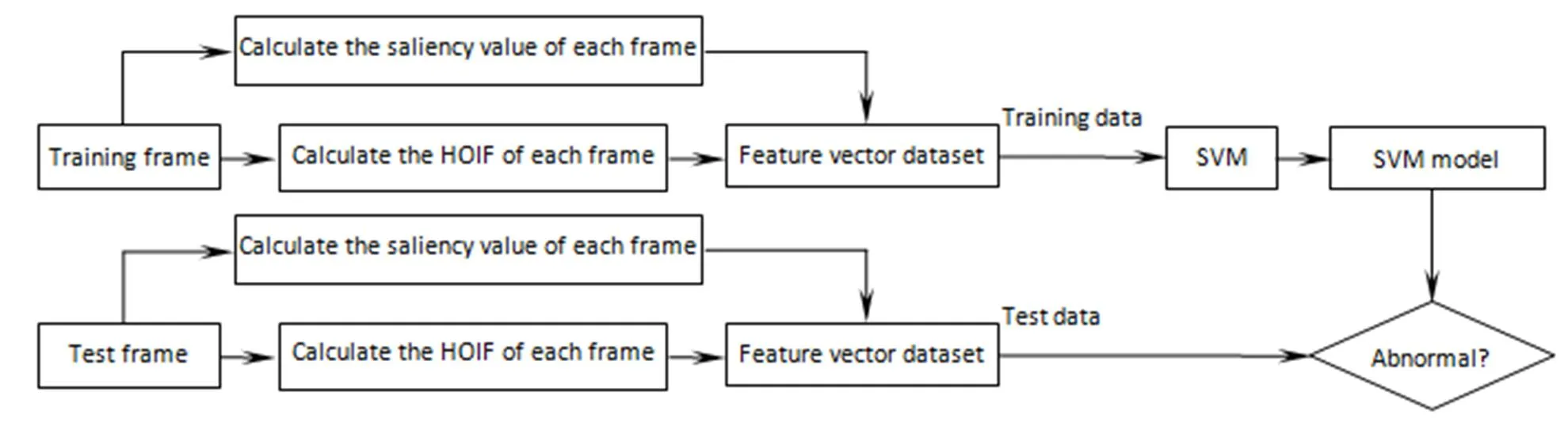

融合时空模型的人群异常事件检测模型框架如图7。

图7 时空异常检测模型图

4 实验结果及分析

4.1 UMN Dataset

本文使用UMN标准数据库进行实验性能验证。UMN数据库包含草坪、室内、广场三个视频序列,包含帧数为7 738帧。从中选取部分帧用作训练数据,部分帧为测试数据,每帧分为32个图像块,故将32维的显著值特征矩阵与9维的HOIF特征矩阵相融合,最终将41维的特征向量送入SVM进行训练及预测。

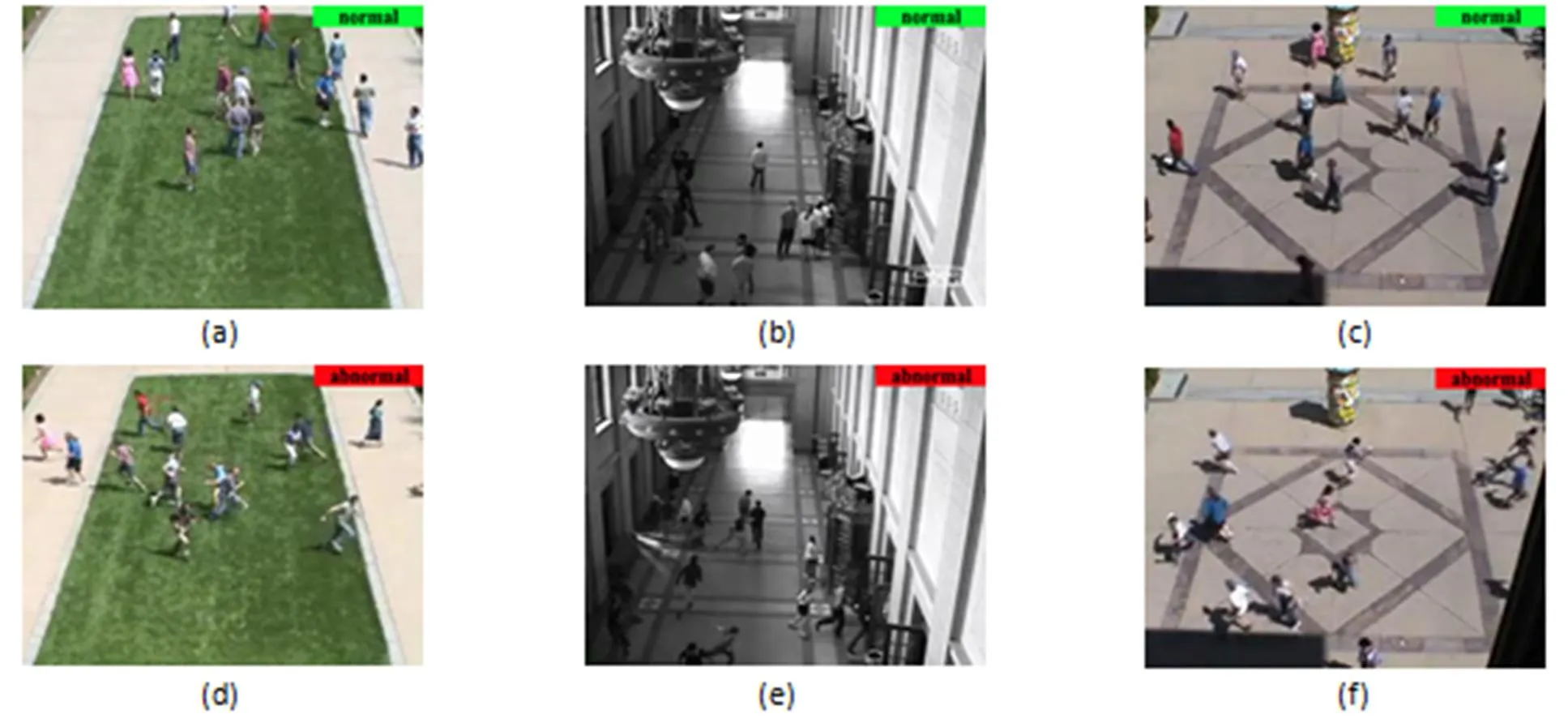

采用本算法在三个场景中进行实验验证,结果表明本算法能很好的检测出异常行为。检测结果如图8。

图8 采用本算法对正常行为及异常行为的分类

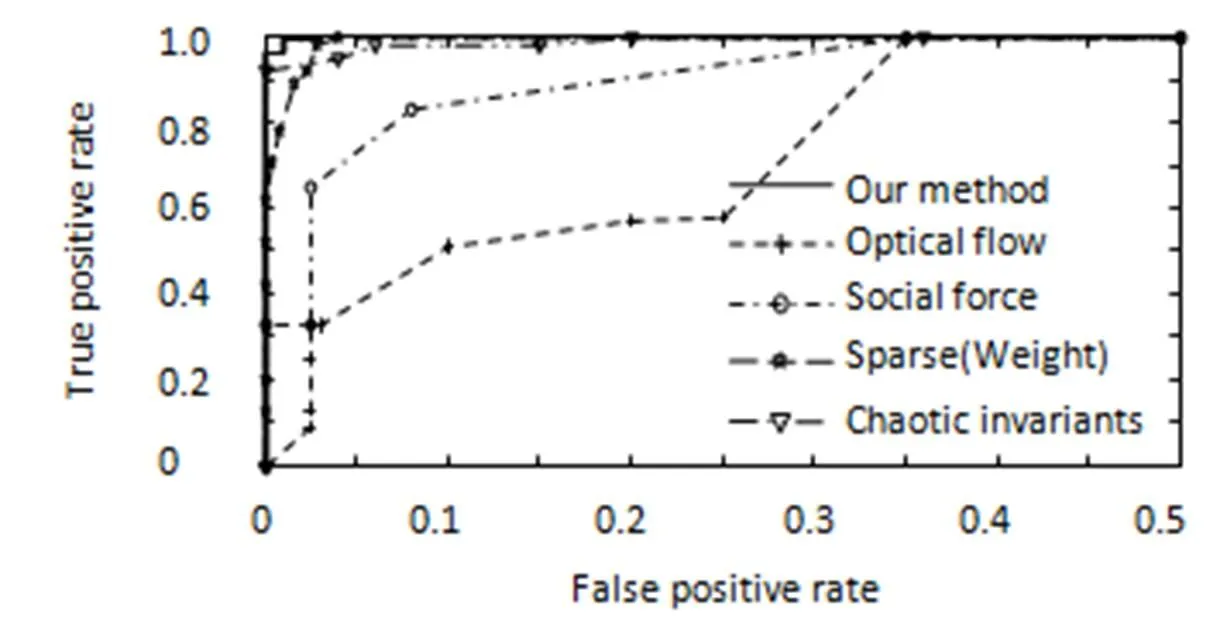

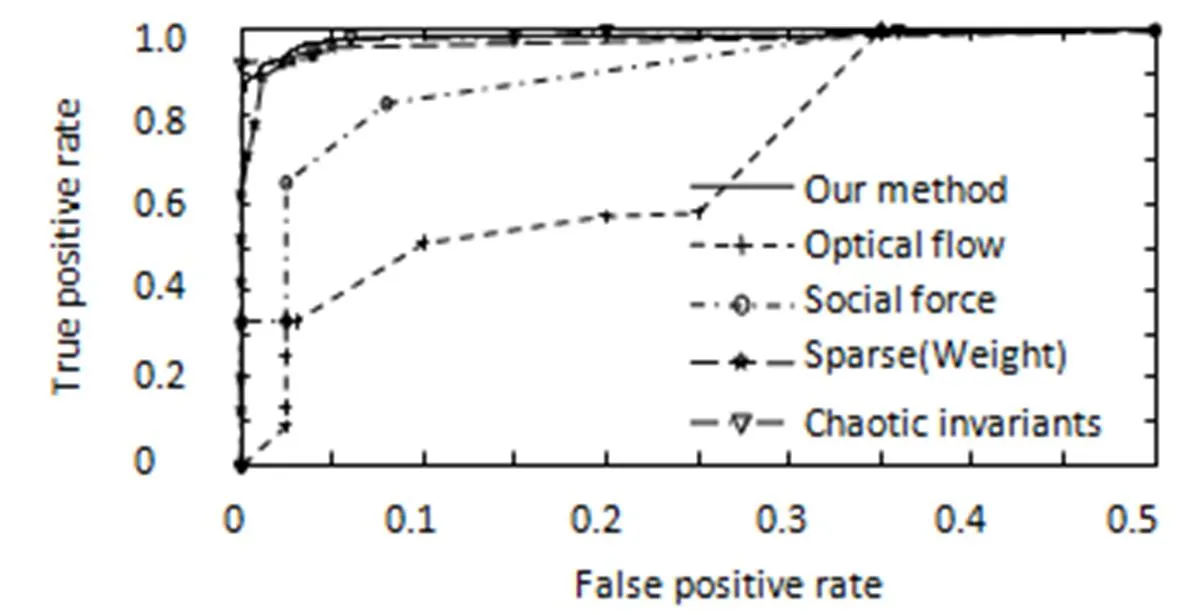

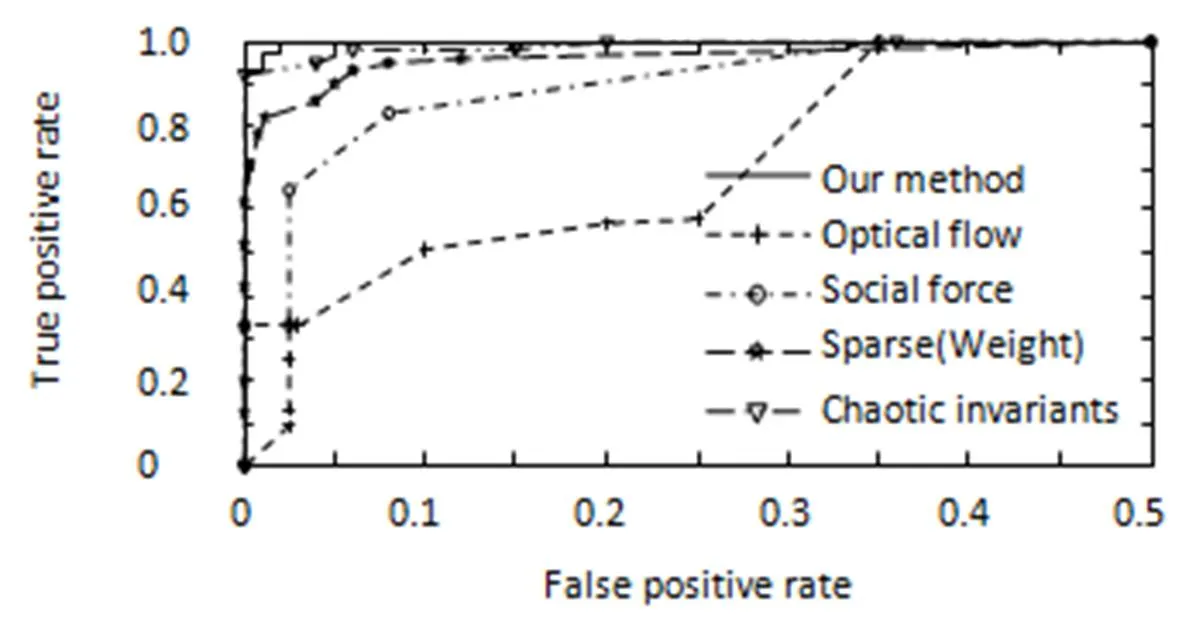

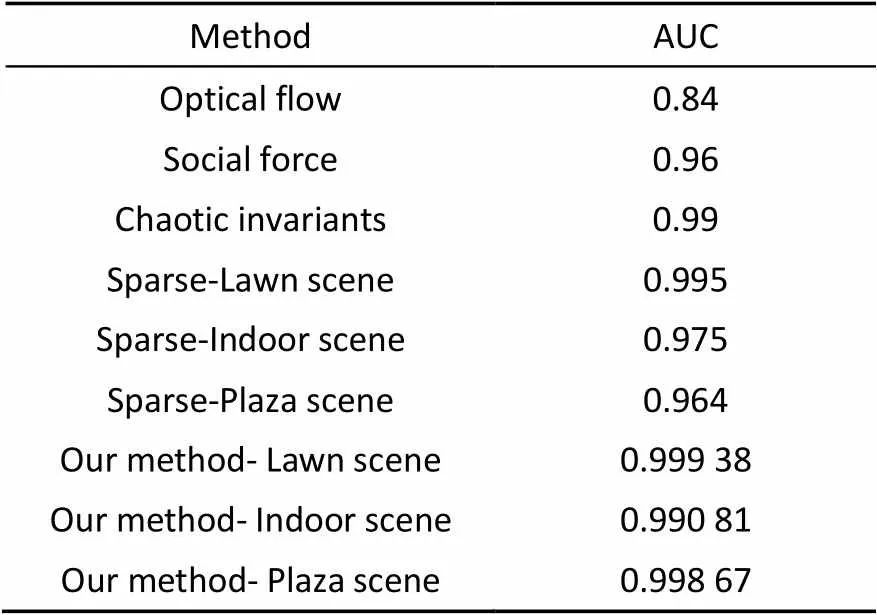

为验证本文算法的优越性,将光流法、社会力模型、混沌不变[14]、稀疏重构[15]等经典算法与本文算法分别在三个场景所生成的接受者操作特性曲线图(Receiver Operating Characteristic Curve, ROC)进行对比。其中,纵轴为真正类率(TPR),横轴为假正类率(FPR)。ROC曲线仿真结果如图9、图10、图11所示。AUC值为ROC曲线下的面积,用于提供总体性能评估,值越大,分类效果越好。

图9 草坪场景的ROC曲线

图10 室内场景的ROC曲线

图11 广场场景的ROC曲线

表1 本文算法与其他算法的AUC值对比

表1中可以看出各种方法的AUC对比,充分证实了本文算法在检测正确率及鲁棒性上要优于原始社会力模型及其他经典算法。

4.2 PETS 2009 Dataset

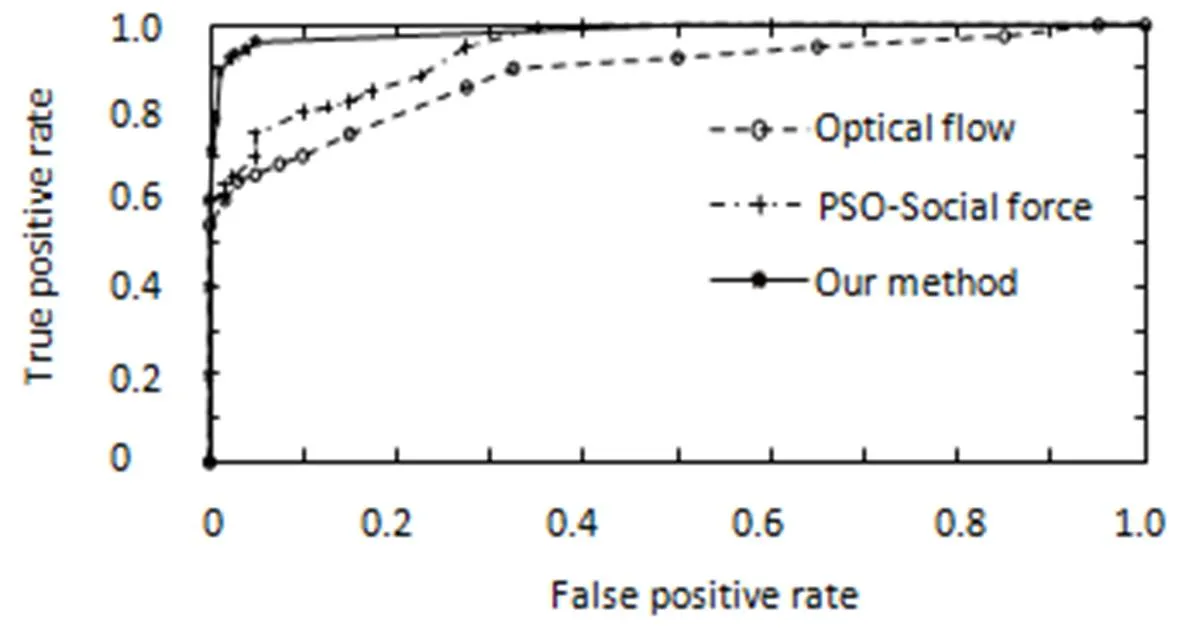

为了再次验证本文算法的有效性,在PETS 2009数据库中再次进行实验。选取PETS 2009“S3”数据库视频,总帧数为222帧,视频中人群由正常行走到奔跑定义为异常行为。不同于UMN数据库,该视频场景中正常事件到异常事件的转变比较缓慢,这就使得异常事件的检测变得更加具有挑战性。检测结果如图12,表明本算法能很好地检测出异常事件。图13为光流法、PSO-Social Force算法[16]与本文算法在“S3”场景生成的ROC曲线对比图,三种算法对应的AUC值分别为0.883 4,0.941 4,0.978 01。实验结果表明本文方法要优于其他算。

图12 采用本算法对正常行为及异常行为的分类

图13 PETS 2009数据库下的ROC曲线

5 总 结

本文针对传统社会力模型只考虑单一域的行为模式,提出一种融合显著性信息和社会力模型的人群异常事件检测算法,该算法考虑了时空域特征,在UMN标准数据库和PETS2009数据库中进行了性能验证。结果表明,该算法能很好的检测出人群异常事件,且在检测准确率及鲁棒性上要优于其他经典算法。

[1] Popoola Oluwatoyin P,WANG Kejun. Video-based Abnormal Human Behavior Recognition—A Review [J]. IEEE Transactions on Systems,Man,and Cybernetics,Part C:Applications and Reviews(S1094-6977),2012,42(6):865-878.

[2] Rasheed N,Khan S A,Khalid A. Tracking and Abnormal Behavior Detection in Video Surveillance using Optical Flow and Neural Networks [C]// International Conference on Advanced Information Networking and Applications Workshops,Victoria,BC,Canada,May 13-16,2014:61-66.

[3] Mousavi H,Mohammadi S,Perina A,. Analyzing Tracklets for the Detection of Abnormal Crowd Behavior [C]// IEEE Winter Conference on Applications of Computer Vision,Waikoloa,Hawaii,Jan 6-9,2015:148-155.

[4] Thida Myo,Eng Howlung,Remagnino Paolo. Laplacian Eigenmap with Temporal Constraints for Local Abnormality Detection in Crowded Scenes [J]. IEEE Transactions on Cybernetics(S2168-2275),2013,43(6):2147-2156.

[5] Benezeth Y,Jodoin P M,Saligrama V,. Abnormal Events Detection Based on Spatio-temporal Co-occurences [C]// IEEE Computer Society Conference on Computer Vision and Pattern Recognition,Miami,Florida,USA,June 20-26,2009:2458-2465.

[6] Mehran R,Oyama A,Shah M. Abnormal Crowd Behavior Detection using Social Force Model [J]. Computer Vision and Pattern Recognition(S1063-6919),2009,1(4):935-942.

[7] WANG Tian,Snoussi H. Detection of Abnormal Visual Events via Global Optical Flow Orientation Histogram [J]. IEEE Transactions on Information Forensics and Security(S1556-6013),2014,9(6):988-998.

[8] Gopalakrishnan Viswanath,HU Yiqun,Rajan Deepu. Salient Region Detection by Modeling Distributions of Color and Orientation [J]. Multimedia IEEE Transactions on(S1520-9210),2009,11(5):892-905.

[9] FANG Yuming,LIN Weisi,Lee Bu Sung,. Bottom-Up Saliency Detection Model Based on Human Visual Sensitivity and Amplitude Spectrum [J]. IEEE Transactions on Multimedia(S1520-9210),2012,14(1):187-198.

[10] Horn B K P,Schunck B G. Determining Optical Flow[J]. Artificial Intelligence(S0004-3702),1981,17(81):185-203.

[11] Lucas B D,Kanade T. An Iterative Image Registration Technique with an Application to Stereo Vision [C]// International Joint Conference on Artificial Intelligence,Vancouver,BC,Canada,Aug 24-28,1981,73(3):285-289.

[12] Brox T,Bruhn A,Papenberg N,. High Accuracy Optical Flow Estimation Based on a Theory for Warping [M]. Berlin:Springer,2004:25-36.

[13] CHANG Chihchung,LIN Chihien. LIBSVM:A Library for Support Vector Machines [J]. ACM Transactions on Intelligent Systems and Technology(S2157-6904),2011,2(3):389-396.

[14] Wu Shandong,Moore Brian E,Shah Mubarak. Chaotic Invariants of Lagrangian Particle Trajectories for Anomaly Detection in Crowded Scenes [C]// IEEE Conference on Computer Vision and Pattern Recognition,San Francisco,California,USA,June 13-18,2010:2054-2060.

[15] CONG Yang,YUAN Junsong,LIU Ji. Abnormal Event Detection in Crowded Scenes Using Sparse Representation [J]. Pattern Recognition(S0031-3203),2013,46(7):1851-1864.

[16] Raghavendra R,Del Bue A,Cristani M,. Optimizing Interaction Force for Global Anomaly Detection in Crowded Scenes [C]// IEEE International Conference on Computer Vision Workshops,Barcelona,Spain,Nov 6-13,2011:136-143.

Abnormal Crowd Event Detection by Fusing Saliency Information and Social Force Model

LI Meng,CHEN Ken,GUO Chunmei,LI Fei,JI Peipei

( Department of Information Science and Engineering, Ningbo University, Ningbo 315211, Zhejiang, China)

Abnormal event detection plays an important role in intelligent video surveillance. A new abnormal behavior detection algorithm is presented by fusing spatiotemporal features. We first extract SI as the feature representation in the spatial domain. Then, by combining the high precision optical flow algorithm with social force model, we calculate the interaction force as the feature representation in the temporal domain. A novel motion feature descriptor, i.e., Histogram of Interaction Force (HOIF) is proposed, which is combined with SI as temporal-spatial features to be input to the Support Vector Machine (SVM) to identify the crowd events. The effectiveness of the proposed algorithm is put to test on the UMN dataset, and the experimental results indicate that the presented method offers more reliable performance than some existing algorithms in terms of accuracy and robustness.

spatiotemporal features; saliency information; social force model; HOIF; SVM

1003-501X(2016)12-0193-07

TP391

A

10.3969/j.issn.1003-501X.2016.12.029

2016-06-15;

2016-10-06

国家自然科学基金(60972063);宁波市自然科学基金(2014A610065);宁波大学科研基金(理)/学科项目(XKXL1308)

李萌(1992-),女(汉族),河北新乐人。硕士研究生,主要研究工作是视频图像处理、计算机视觉。E-mail: limeng920303@163.com。

陈恳(1962-),男(汉族),重庆人。副教授,主要研究工作是视频图像处理、智能控制。E-mail:chenken@nbu.edu.cn。