机器人激光扫描式焊缝跟踪测量系统研究

2016-06-17宋亚勤刘开元

宋亚勤,张 斌,刘开元,唐 琛

(中国计量学院 计量测试工程学院,浙江 杭州310018)

机器人激光扫描式焊缝跟踪测量系统研究

宋亚勤,张斌,刘开元,唐琛

(中国计量学院 计量测试工程学院,浙江 杭州310018)

【摘要】提出了机器人激光扫描式焊缝跟踪系统参数的标定方法和基于数字图像处理的焊缝特征点识别方法.采用中值滤波、自适应阈值分割和孤点滤波法等对激光图像进行预处理,以数字形态学方法获得焊缝特征点坐标;然后以一组平行线为靶标,获得激光平面上无穷远处一点在摄像机中的投影,实现结构光参数的标定;最后以多个机器人位姿对固定目标点进行检测,求解出机器人的手眼矩阵.整个系统标定过程简单,精度可靠,可用于空间曲面的U型焊缝检测.

【关键词】数字形态学;结构光标定;三角测量法;手眼矩阵;焊缝跟踪

为了满足现代工业生产的需要,机器人在焊接中的应用成为研究的热点,主要应用的传感器有电弧传感器[1]和视觉传感器[2].随着计算机图像处理技术的发展[3],视觉传感器的应用更加广泛.本系统所采用的激光扫描式焊缝跟踪传感器是视觉传感器的一种.

传感器传输给计算机的信息为焊缝的二维图像信息,为了获得焊缝在机器人基坐标系下的三维信息,需要进行传感器参数标定与机器人的手眼标定.传感器的标定包括摄像机的标定和结构光的标定,摄像机的标定技术[4]比较成熟,最早用于激光结构光标定的方法有齿形标定法[5]和拉丝标定法[6].这些方法利用特定标定耙在结构光平面上产生标定点,并利用辅助测量仪获取其标定点在结构光平面上的坐标.针对机器人手眼标定,最经典的算法是通过方程AX=XB求解[7-8],在机器人相邻两次运动中,A表示机械手末端的变换矩阵,B表示传感器的变换矩阵,其中X表示手眼关系.在此基础上,存在不同的求解算法:Qi[9]采用了基于直线特征的机器人手眼标定的方法,但在实际应用中,直线特征很难构成,且其精度很难保证.Hu[10]采用了基于平面特征的机器人手眼标定方法,但同样存在平面特征很难保证的问题.

从实际应用的角度出发,标定方法应在保证标定精度的前提下尽可能简单易行.本文根据激光平面上无穷远处一点在摄像机中投影实现结构光的标定.再以多个机器人位姿对同一个固定的目标点进行检测,实现机器人的手眼标定.整个标定过程不需要精确的标定靶和辅助测量仪,简单易行,精度可靠.

1机器人激光扫描式焊缝跟踪系统

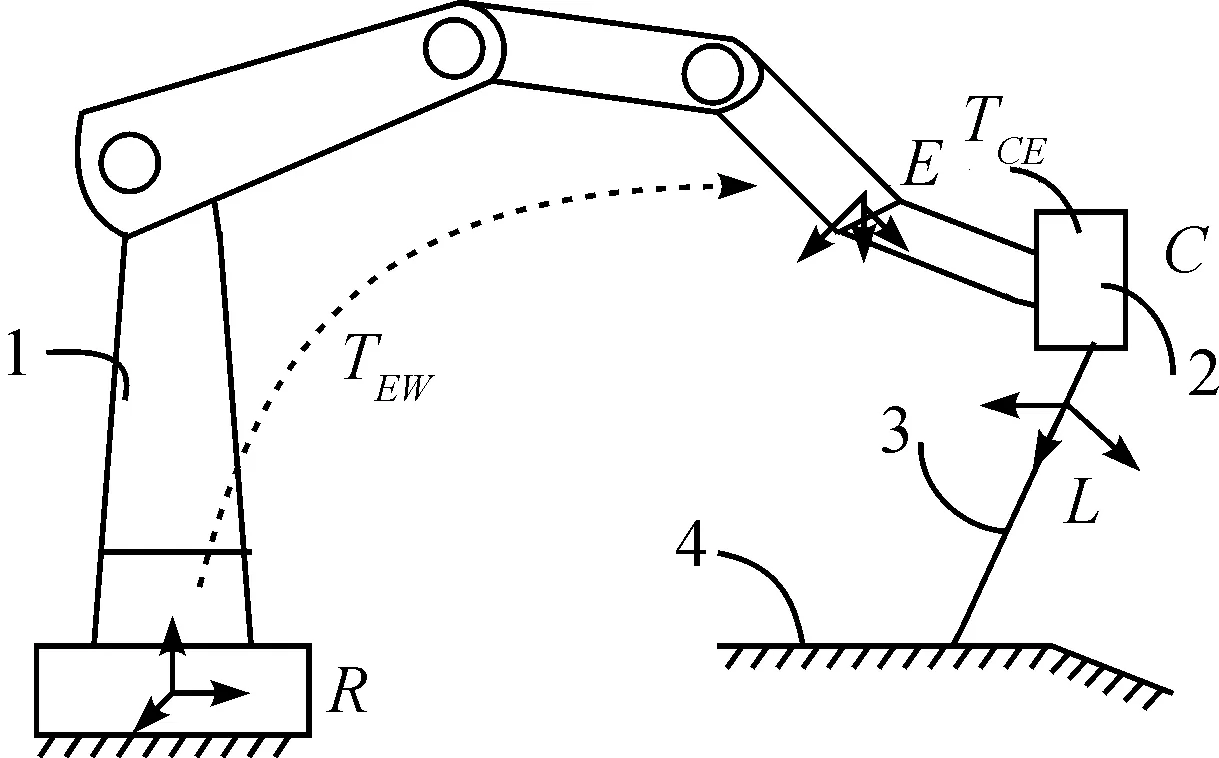

机器人激光扫描焊缝跟踪系统主要由六自由度机器人和传感器组成.如图1,机器人带激光扫描式焊缝跟踪传感器对焊缝进行检测,摄像机将采集的包含焊缝信息的激光图像传输给计算机.

1-机器人;2-激光焊缝跟踪传感器;3-一字结构光;4-焊缝表面图1 安装激光传感器的机器人Figure 1 Robot installed laser sensor

图中,{R}为与机器人底座固连的基础坐标系;{E}为机械手末端坐标系;{C}为摄像机坐标系.

2焊缝特征点检测

摄像机采集的激光图像存在电弧光、飞溅等噪声干扰.预处理是指根据原始焊缝图像的特点,最大程度的滤除噪声的干扰.

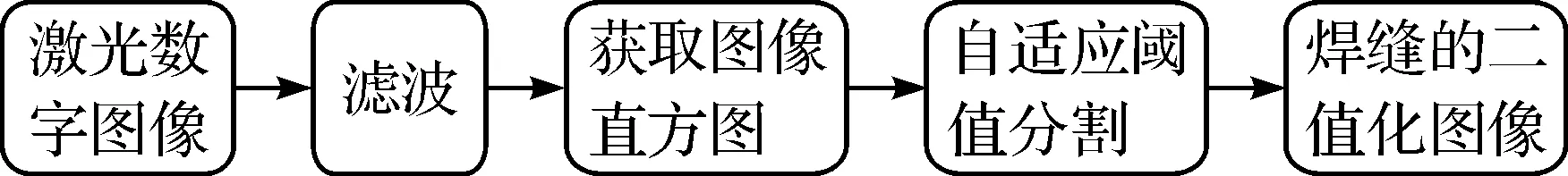

本文采用的激光图像预处理流程如图2.

图2激光图像预处理算法示意图

Figure 2Laser image preprocessing algorithm schematic

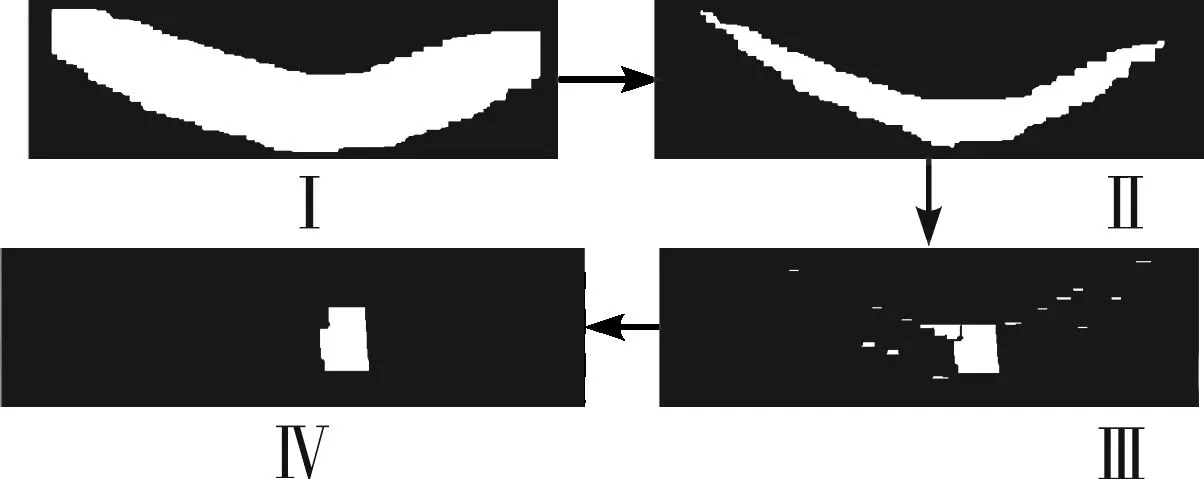

下面以U型曲面焊缝的图像处理为例,在焊缝的深度不同时,图像有所差异.如图3,(a)是焊缝较深时预处理前后的图像;(b)是焊缝较浅时预处理前后的图像.

图3 预处理后的激光图像Figure 3 Laser images after pretreatment

在获得清晰的焊缝图像后,先对图像中的不同区域用不同的灰度值表示出来,滤除图像中存在的孤立点与孤立的小区域,使得图像中只存在两段激光光带.

图4 焊缝特征点检测Figure 4 Weld feature point detection

如图4,以曲面焊缝为例,焊缝特征点的提取使用数字形态学中膨胀和腐蚀以及图像的减法运算,从而使得该算法可以应用于平面焊缝和曲面焊缝.具体步骤如下:

1)对激光图像先进行膨胀运算,使得两段激光结构光的图像连通起来.

2)对激光图像进行相同次数的腐蚀运算,使得连通起来的两段激光结构光图像形状恢复到膨胀运算之前.

3)将连通的激光结构光图像与膨胀运算之前的焊缝图像做减运算,得到小段激光图像与很多孤立的区域.

4)对图像中的不同区域用不同的灰度值表示出来,滤除图像中存在的孤立点与孤立的小区域.得到需要保留包含焊缝特征点的激光图像.

5)最后对图像扫描求取保留的激光图像的型心,即所要求取的焊缝特征点在图像中的图像坐标.

3系统标定

3.1结构光传感器标定

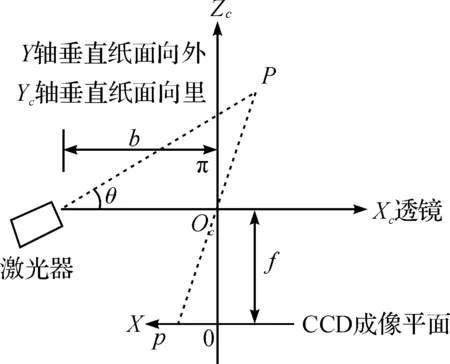

传感器采用三角法测量,图5为本系统采用的测量模型,其过程也可描述为激光光平面通过投影变换到摄像机的像平面.

图5 线性结构光的测量模型Figure 5 Measurement model of structured light

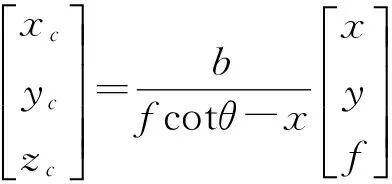

图5中,π为激光器投射的激光平面;Oc-XcYcZc为以光轴与透镜交点为原点建立的摄像机坐标系;O-XY为图像坐标系.激光平面存在一点P(xc,yc,zc),在图像平面的像点为p(x,y).根据三角法测量原理得到如下关系:

(1)

其中,f为摄像机焦距;b为激光平面与Xc轴交点到摄像机光轴的距离,称为基长;θ为Xc与激光平面的夹角,称为投射角.目标点的摄像机坐标与图像坐标的转换关系:

(2)

如果式⑵中摄像机焦距f、投射角θ、基长b均为已知,则三维空间中任意一点均可以与二维图像中的点一一对应.求解f、θ、b即激光传感器系统的系统内部参数标定.f可以通过摄像机标定求出.

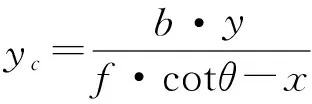

激光平面任意一点P(xc,yc,zc)在图像平面的像点为p(x,y)根据三角法测量原理可得

(3)

若P在激光平面的无穷远处,即(xc,yc,zc)→∞,zc→∞,可以得知f·cotθ-x∞→0即得

cotθ=x∞/f.

(4)

其中,x∞为激光平面上无穷远处P点在摄像机中投影的图像坐标.

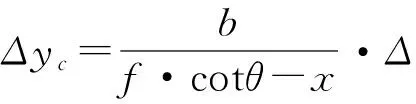

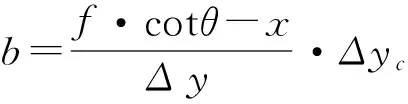

(5)

若令Δx=0即可以得

(6)

由式(6)可以得

(7)

其中,x为当前图像坐标,若可以控制Δyc的大小,并可以通过图像处理获得其相应的Δy、则结构光的基长b可确定.

3.2机器人手眼标定

机器人的手眼标定即确定摄像机坐标系与机械手末端坐标系的转换矩阵.

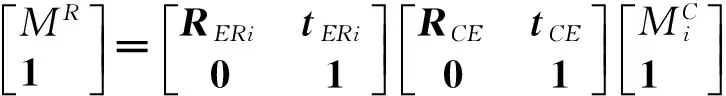

如图1,TER是机器人手末端{E}相对于基座标{R}的转换矩阵,可从机器人的控制器上读出,包括旋转矩阵RER与平移向量tER,TCE为摄像机坐标系{C}相对于机械手末端坐标系{E}的转换矩阵,包括旋转矩阵RCE与平移向量tCE.由于传感器是固接于机械手末端的,因此TCE不随机械手的运动而改变.TCE即为所求的摄像机坐标系与机械手末端坐标系的转换矩阵.本文通过改变机器人的姿态多次检测同一目标点M.

(8)

(9)

式(9)展开可得

(10)

控制机械手对目标点M就行对多次测量,可以得

(11)

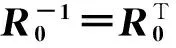

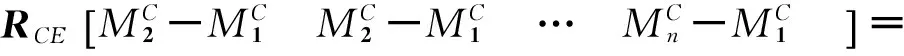

3.2.1旋转矩阵RCE求解

如果运动过程中机器人的姿态保持不变即RER1=RER2=…=RERn=R0.

(12)令

则上式可以写为RCEA1=b1的矩阵方程,按奇异矩阵分解法(SVD)Q求解,即

RCE=VUT.

(13)

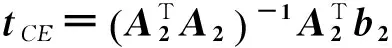

3.2.2平移向量tCE根据式(11)可得

(14)

控制机械手臂多个姿态对目标点进行检测可得到型如A2tCE=b2的方程,基于最小二乘法求解tCE即

(15)

4系统标定及焊缝跟踪实验

4.1传感器的标定

当登高远眺时,无穷远处的地平面是一条直线,同样,两条平行直线在无穷远处交于一点.如图6,将标定靶水平放置,调节传感器的位置,使摄像机的光轴垂直于标定靶,激光平面与两条平行线交于A、B两点,控制摄像机沿光轴方向移动,得到一系列的交点Ai、Bi(i=1,2…n),其在摄像机中的投影为ai、bi(i=1,2…n).Ai、Bi在激光平面上形成两条平行线,其在无穷远处激光平面上交于一点,将ai与bi分别拟合成直线,两条直线的交点(6.912 2,0.259 8)即为激光平面上无穷远处一点在摄像机中的投影,可得x∞=6.912 2 mm.在摄像机标定中可获得焦距f为6.759 5 mm.

图6 标定耙Figure 1 Calibration harrow

从而可得cotθ=x∞/f=1.022.

通过移动传感器改变Δv、Δyc的大小,可求得传感器的基长b,传感器的内部系统标定如表1.

表1 传感器内部参数

4.2机器人手眼矩阵

首先传感器以5次纯平移运动和5变位姿运动对目标点M进行检测,并记录每次机械手末端,如图7.

图7 手眼标定实验的标定靶Figure 7 Calibration target of hand-eye calibration experiments

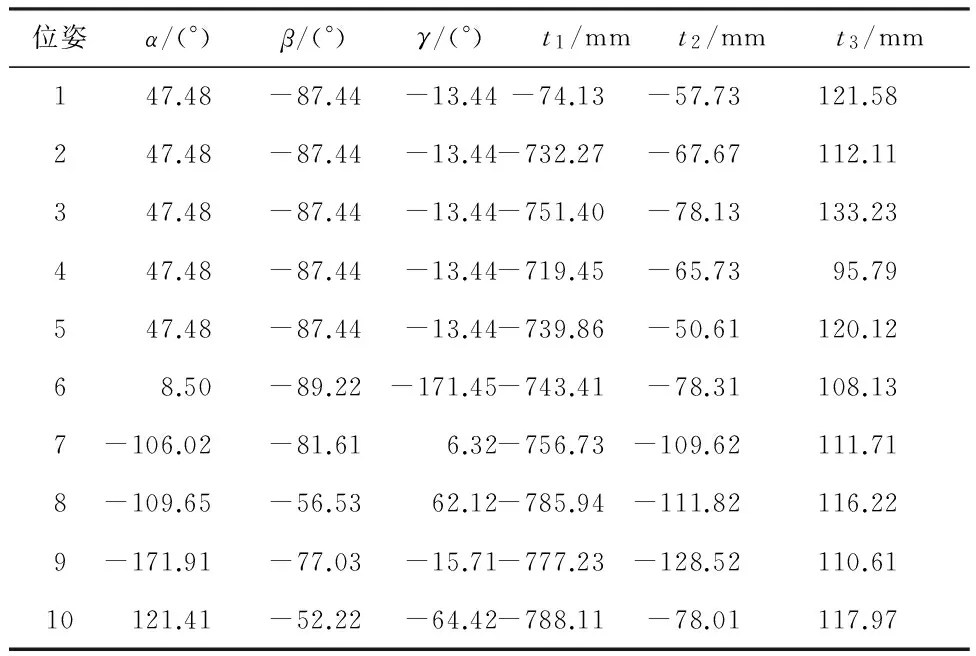

表2为目标点在摄像机坐标系下的坐标,表3为每次测量时读取的机械手末端的姿态.

表2 摄像机坐标系下的目标点

表3 机器手末端姿态

表3中的姿态角度为123顺序的欧拉角,它和转换矩阵的转换关系:

(16)

根据表2和表3的前五组数据,根据式(13)可以得到摄像机坐标系与机械手末端的旋转矩阵为

根据表2和表3的后五组数据,根据式(15)可以得到摄像机坐标系与机械手末端的平移向量为

4.3焊缝跟踪实验

为了验证以上标定算法的可行性,采用标定好的激光扫描式焊缝跟踪系统对工件焊缝进行检测跟踪,如图8.

图8 实验平台Figure 8 Experiment platform

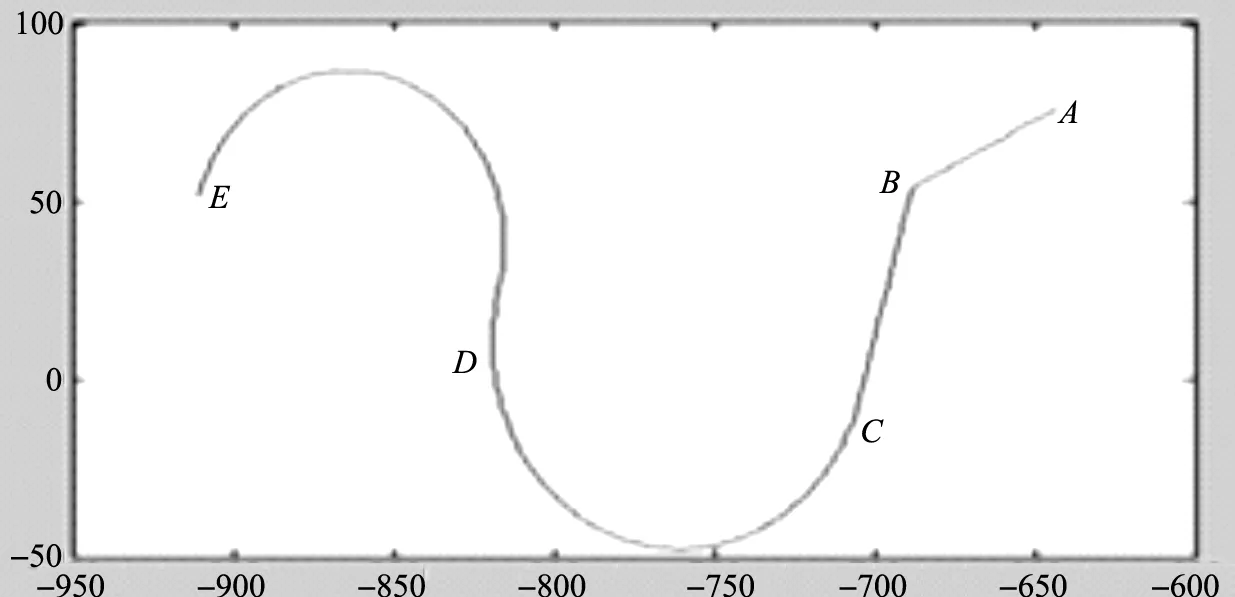

通过机器人控制传感器依次采集300多张包含焊缝信息的激光图像,经过图像处理,并将其转换为其在机器人基坐标系的世界坐标,所拟合的焊缝轨迹如图9.

图9 焊缝轨迹Figure 9 Seam track

基于最小二乘法对轨迹分段进行分析,与实际值进行比较,结果如表4与表5.

表4 直线轨迹分析

表5 圆弧轨迹分析

5结论

本文以机器人激光扫描焊缝跟踪系统为研究对象,基于数字形态学对激光图像进行处理,根据传感器测量的数学模型,给出了传感器结构参数标定方法和机器人手眼的标定方法.最后采用本系统对焊缝进行跟踪实验,通过对所采集的焊缝轨迹进行分析,结果表明该文中所述标定方法可行,能够满足自动化焊接的精度要求.今后将在此基础上对机器人运动控制方法等问题进行研究.

【参考文献】

[1]洪波,来鑫,魏复理,等.前置式磁控电弧传感器焊缝自动跟踪系统[J].传感器与微系统,2008,27:93-95.

HONG Bo, LAI Xin, WEI Fuli, et al. Seam tracking system with leading magnetic-control arc sensor[J]. Transducer and Microsystem Technologies,2008,27:93-95.

[2]林嘉睿,吴斌,高鹏,等.线结构光视觉传感器二维机器人焊缝跟踪系统[J].光电子·激光,2009(6):793-795

LIN Jiarui, WU Bin, GAO Peng, et al. 2-D Robot seam tracking system based on structured-light visual sensor[J]. Journal of Optoeleetronies·Laser,2009(6):793-795.

[3]冯染宝,徐自越.OpenCV在焊缝实时检测系统中的应用[J].工业仪表与自动化装置,2012(4):39-42.

FEND Ranbao,XU Ziyue. The application of OpenCV on the real-time detection system of the seam[J]. Industrial Instrument and Automation Devices,2012(4):39-42.

[4]高文娟,李健.基于OpenCV的摄像机标定问题研究[J].计算机与数字工程,2008,36(12):128-130.

GAO Wenjuan, LI Jian. Research on camera calibration technique based on OpenCV[J]. Computer and Digital Engineering,2008,36(12):128-130.

[5]段发阶,刘凤梅,叶声华.一种新型线结构光传感器结构参数标定方法[J].仪器仪表学报,2000,21(1):108-110.

DUAN Fajie, LIU Fengei, YE Shenghua. A new accurate method for the calibration of line structured light sensor[J]. Journal of Instrument,2000,21(1):108-110.

[6]GAN Z, TANG Q. Laser stripe sensor calibration[J]. Advanced Topics in Science & Technology in China,2011(12):41-91.

[7]王颖,董再励,孙茂相,等.一种基于线性模型的机器人手眼标定新方法[J].模式识别与人工智能,2005,18(4):491-495.

WANG Ying, DONG Zaili,SUN Maoxiang, et al. A new approach based robot hand-eye calibration linear prototype[J]. PR and AI,2005,18(4):491-495.

[8]李龙,白瑞林,吉峰,等.结构光视觉引导的轨迹跟踪系统的标定技术[J].计算机工程与应用,2014,50(16):259-264.

LI Long, BAI Ruilin, JI Feng, et al. Calibration technique for structured light vision guided trajectory tracking system[J]. Computer Engineering and Applications,2014,50(16):259-264.

[9]Qi A Y, Jing F, Tan M. Line-feature-based calibration method of structured light plane parameters for robot hand-eye system[J]. Optical Engineering,2013,52(3):254-260.

[10]HU J S, CHANG Y J. Calibration of an eye-to-hand system using a laser pointer on hand and planar constraints[C]// Proceedings-IEEE, International conference on robotics and automation (ICRA) .[s.l.]:[s.n.],2011:982-987.

Study on the calibration of robotic seam tracking of laser scanning systems

SONG Yaqin, ZHANG Bin, LIU Kaiyuan, TANG Chen

(College of Metrology and Measurement Engineering, China Jiliang University,Hangzhou 310018, China)

Abstract:The calibration method for the laser scanning weld seam tracking system parameters and the recognition method for the seam characteristic point based on digital image processing were proposed. The laser images were preprocessed by using the median filter method, the adaptive threshold method and the isolated point filter method. The seam characteristic point was found by using the digital morphological method. The parameter calibration of the structured light according to laser plane infinity point projection in the camera was obtained by moving the sensor with the target of a set of parallel lines. The position of the robot was changed to detect the fixed target and to solve the robot hand-eye matrix. The calibration process was convenient and reliable. It could be used for the detection of U weld seams on spatial free-form surfaces.

Key words:digital morphological; laser calibration; triangulation; hand-eye matrix; seam tracking

【文章编号】1004-1540(2016)01-0033-06

DOI:10.3969/j.issn.1004-1540.2016.01.006

【收稿日期】2015-09-18《中国计量学院学报》网址:zgjl.cbpt.cnki.net

【基金项目】浙江省仪器科学与技术重中之重学科人才培养计划资助项目(No.JL150505).

【作者简介】宋亚勤(1989-),女,陕西省渭南人,硕士研究生,主要研究方向机器人技术及应用.E-mail:281706269@99.com

【中图分类号】TP391

【文献标志码】A

通信联系人:张斌,男,博士.E-mail: zhwwbin@163.com