基于图像融合与分水岭技术的车辆检测*

2016-03-15张瑜慧郑步芹

张瑜慧 郑步芹 沈 洋

(宿迁学院 宿迁 223800)

基于图像融合与分水岭技术的车辆检测*

张瑜慧郑步芹沈洋

(宿迁学院宿迁223800)

摘要提出了一种有效的运动车辆检测方法。首先采用连续帧差法进行背景建模,之后采用像素级的图像融合技术,将视频帧与背景帧在RGB通道进行融合处理。随后在模板匹配的基础上进行分水岭分割,获取最佳匹配信息,最终实现车辆检测与定位。实验结果显示,该方法能够实时检测运动车辆,检测效果较好。

关键词目标检测; 图像融合; 分水岭技术

Vehicle Detection Based on Image Fusion and Watershed Technology

ZHANG YuhuiZHENG BuqinSHEN Yang

(Suqian College, Suqian223800)

AbstractAn effective detection method for moving vehicles is proposed. Firstly, the consecutive frames subtraction method is used for background modeling, the video frame and background frame are fused in the RGB channels based on the pixel level image fusion technology. Watershed segmentation is applied to obtain the best matching information after template matching, vehicle detection and localization is realized at last. Experimental results show that the proposed method can detect moving vehicles in real time and get good results.

Key Wordsobject detection, image fusion, watershed technology

Class NumberTN911; TP391

1引言

运动目标检测已成为视频处理中的关键技术,是进行后继目标跟踪、识别与分析的基础,在智能交通、智慧城市、公共安全和计算机视觉等领域有着重要的意义。目前,目标检测的主要方法有帧差法、光流法和背景减法等。光流法[1]能够在移动摄像头情形下进行运动目标检测,但其计算复杂度较高,并且需要特定的硬件支持,不能满足实时高效的检测需求。它适合于动态变化的环境,但是分割的运动目标容易出现空洞和沿着运动方向拉伸的现象,不能完整地检测运动目标,而且处理时间较长。背景减法是较常用的一种检测方法,适合于固定摄像头的情形,这种方法的关键在于建立可靠背景模型以及合理的背景更新机制,检测的结果直接依赖于背景模型提取的准确与否。而运动目标检测的实现主要是通过比较当前帧与背景模型之间的差别来完成的,其性能依赖于所使用的背景建模技术。因此设计高效鲁棒的背景建模算法,成为运动目标检测领域的一个研究热点[2~7]。本文采用连续帧差法提取视频背景,在此基础上结合图像融合技术和分水岭技术实现运动目标检测。

2背景建模

Surendra等人[2]提出一种以帧差分为基础,在固定场景下自动提取背景的连续帧差法。通过相邻两帧的差值确定运动前景区域,对前景区域保持不变,非运动区域则用当前帧进行更新,经过反复迭代形成背景。其具体步骤如下:

1) 把第一帧图像I0作为原始背景BI0;

2) 令迭代参数i值为1;

3) 求当前帧与前一帧帧差分的二值图像BWi;

(1)

其中,Ii、Ii-1分别为当前帧与前一帧图像,T为阈值,定义为帧差分图像灰度直方图中最大峰值右边0.1最大峰值处对应的灰度值;

4) 由二值图像BWi更新背景BIi。

BIi(x,y)=

(2)

其中,BIi(x,y)、BWi(x,y)分别是i时刻背景图像和二值图像在坐标(x,y)处的灰度值,背景更新系数a影响背景更新的速度,一般取值为0~1;

5)i=i+1,返回至步骤3)进行迭代,当迭代一定步数,便可结束迭代,BIi即为提取的背景图像。

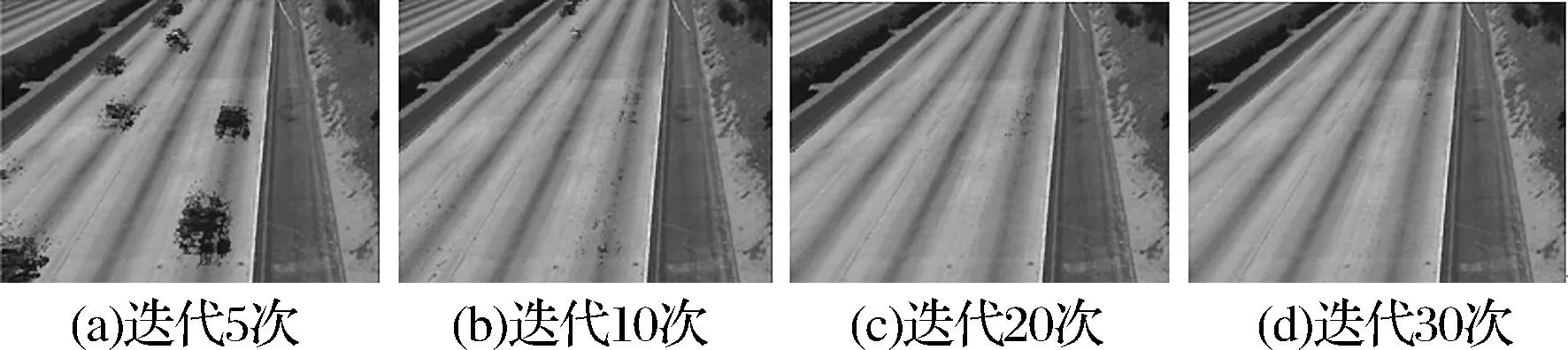

Surendra算法能较快地适应背景图像的实时变化,特别是对光照的变化适应能力很强,并且该算法不需要初始化背景,可以通过对前景图像的反复迭代,较快地提取背景图像[8]。图1是对一来源于网络的由固定摄像头获取的高速公路视频进行背景提取的实验结果。分别迭代5、10、20、30次获取背景图像,由图可以看出该算法随着迭代次数的增加能够迅速地提高背景提取质量,经过30次迭代可以形成较好的背景,能够满足后继处理的要求。

图1 交通视频的背景提取

3车辆检测

运动前景检测是视频监控处理的重要部分,本文采用基于图像融合的前景检测技术[9],将视频流的每一帧与背景帧融合,并借此提取运动前景。

一般由摄像机采集的视频采用的是RGB颜色空间模型,一帧图像由R(红色)、G(绿色)和B(蓝色)三个通道的图像组成彩色图像。为了提取运动前景区域,将当前帧Ii与背景帧BI按式(3)在三个颜色通道上进行融合:

F=(FR,FG,FB)

(3)

其中,F是融合图像,FR、FG和FB分别是融合图像在R、G和B通道的分量,具体取值为FR=Ii,FG=BI,FB=BI,Ii是第i帧图像,BI是当前背景。

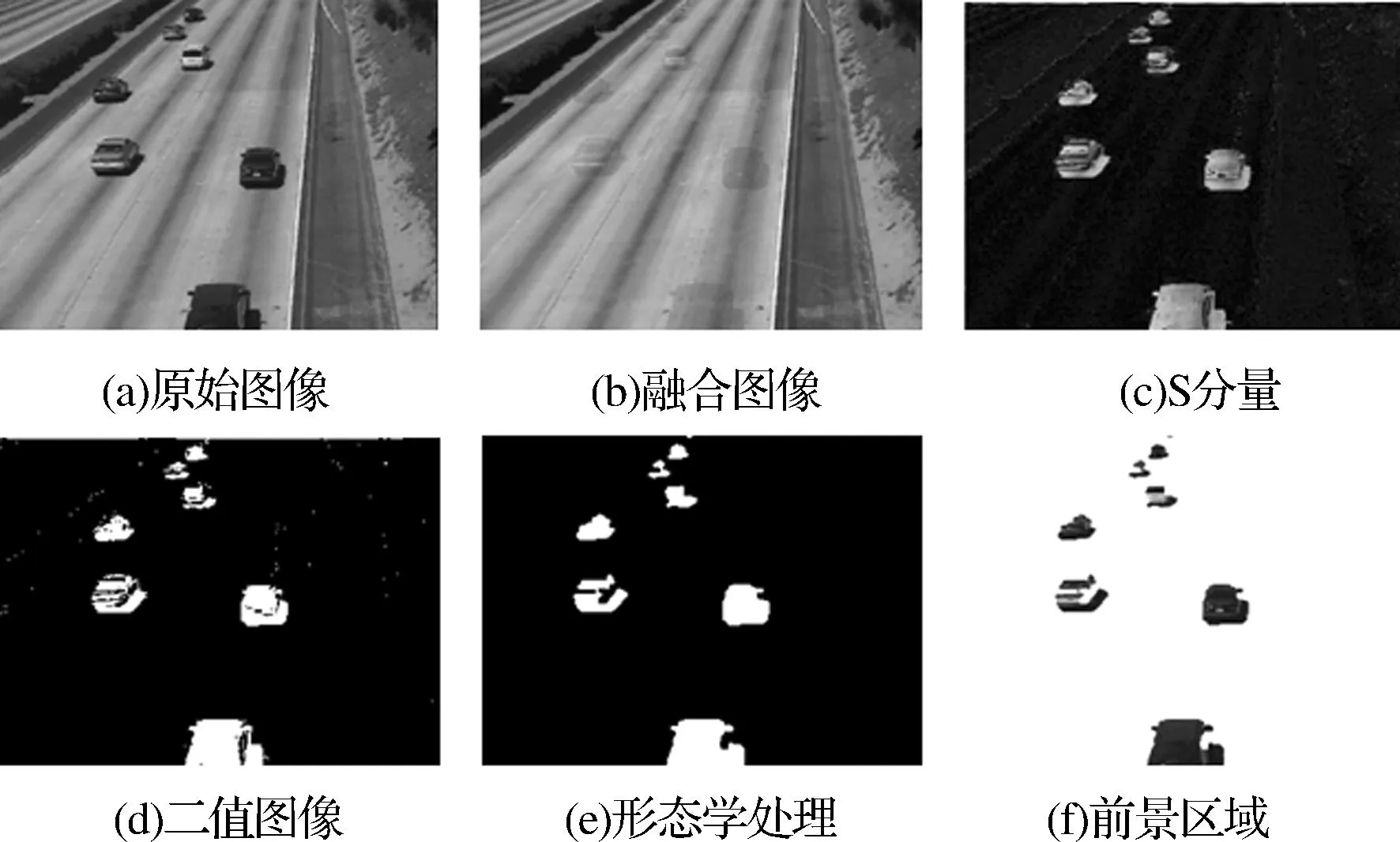

融合图像F在各个像素上同时包含了背景知识与当前帧信息。图2(a)为视频的第2帧图像,图2给出了对该帧进行前景检测的结果。图2(b)为采用式(3)在R、G、B颜色通道融合当前帧与背景后的图像。图2(c)是融合图像的S分量,图中,前景区域的饱和度较高,背景区域的饱和度很低。这为前景与背景的分离提供了条件。

算法采用大津算法自适应确定分割阈值,实现了目标与背景的分割。图2(d)是二值分割的结果示例图。其中,白色部分是检测到的前景区域,黑色部分是背景区域。图中前景区域虽然存在一些空洞,但背景区域噪声很少。针对二值化后目标区域产生的空洞以及背景区域存在孤立噪声的现象,结合形态学进行处理。首先采用较小的结构元素对图像进行开运算,以此消除孤立噪声,之后再用较大尺寸的结构元素进行闭合操作,填补目标空洞。开运算和闭运算的定义如式(4)~(5)所示

开启:A∘B=(A⊖B)⊕B

(4)

闭合:A·B=(A⊕B)⊖B

(5)

其中,A是二值图像,B是结构元素,⊖表示腐蚀,⊕表示膨胀。先腐蚀、后膨胀的过程称为开运算,原图经过开运算后,能够去除孤立的小点、毛刺和小桥,消除小物体、平滑较大物体的边界,同时并不明显地改变其面积;先膨胀后腐蚀的过程称为闭运算,其功能是用来填充物体内细小空洞、连接邻近物体、平滑边界。

对图2(d)二值图像进行形态学处理结果如图2(e)所示,从示例结果可以看出目标前景中一些小的空洞被填充了,背景区域中一些噪声也被有效去除,目标区域比较完整。在此基础上获取了前景图2(f),原始图像中的路面等背景区域被有效地分割了,剩下由目标车辆和其投射阴影组成的运动前景。

图2 运动前景检测

在目标前景区域初步检测之后,结合了模板匹配与分水岭技术以实现车辆检测与定位。为实现的简单化,车辆的模板直接采用矩形模板,具体模板的尺寸根据交通视频中车辆的平均大小进行动态设置。

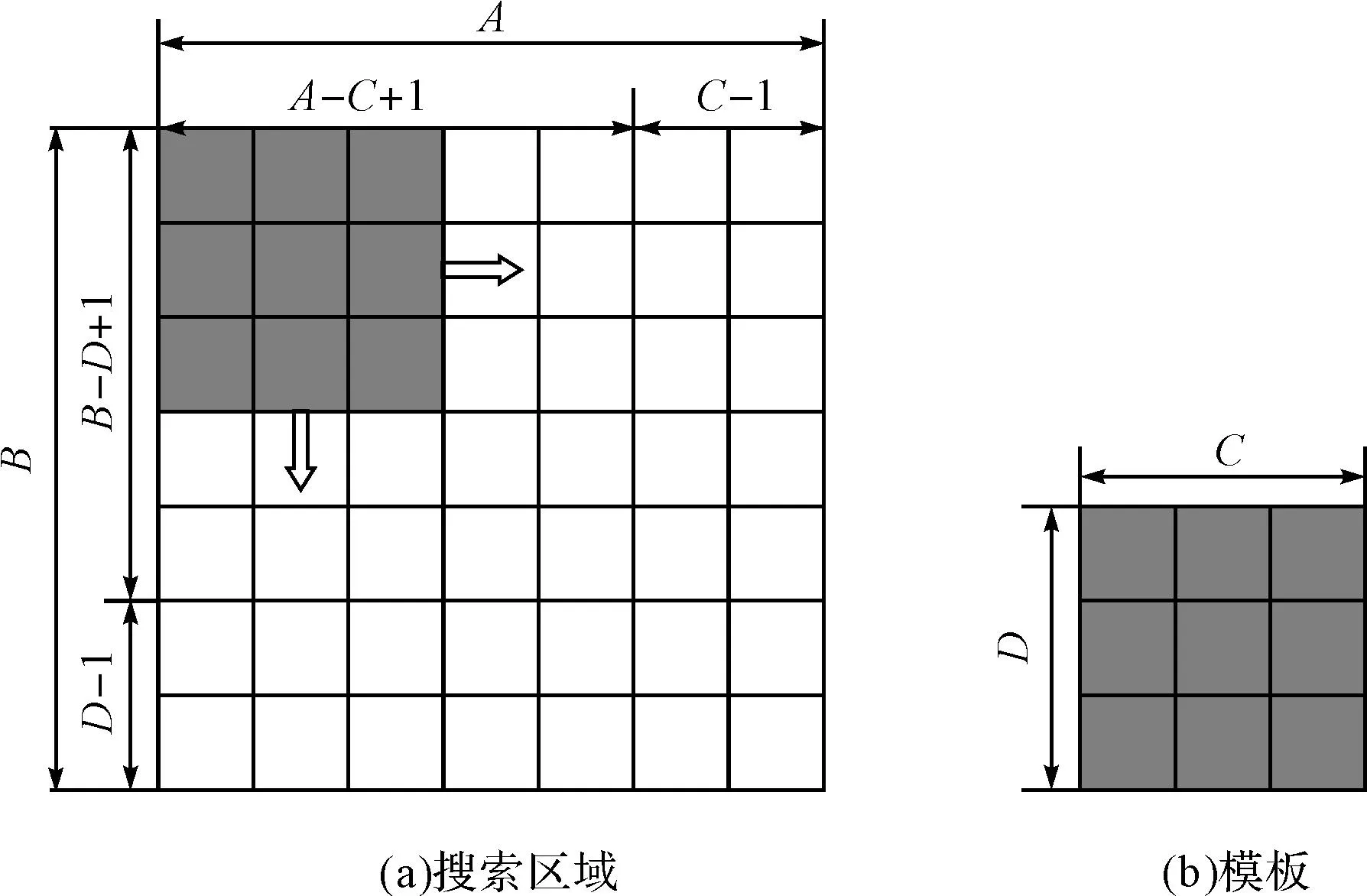

图3 模板匹配

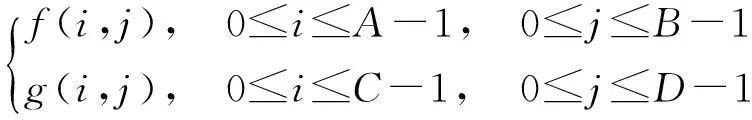

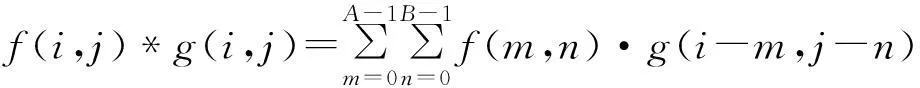

图3给出了模板匹配的示意图,图3(a)为搜索区域f(i,j),水平和垂直方向长度分别为A和B,图3(b)为矩形模板g(i,j),水平和垂直长度分别为C和D。

(6)

将模板在每一视频帧的搜索区域从左到右、从上到下进行平滑匹配,找到匹配位置。该过程的数学描述见式(7):

(7)

其中i=0,1,…,A-1,j=0,1,…,B-1。

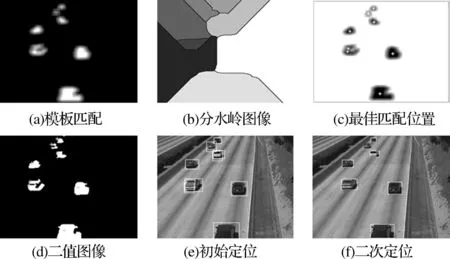

由于视频帧中的车辆往往不止一辆,因而可能获得多个匹配结果。图4给出了车辆检测的过程。图4(a)为用模板对某视频帧二值图像进行模板匹配的操作结果,可以看出在目标区域,匹配值较大,表现在图像上即呈现灰度值较亮区域。

为将目标与背景分离,引入分水岭技术。分水岭变换的思想来源于地形学,其本质是一种区域增长算法,所不同的是,它是从图像中的局部极小值开始增长的[10]。它将图像看作是地形学上被水覆盖的地貌,假想对该地注水,即在各极小区域的最小灰度值点打小孔,同时让水从小孔中涌出,并慢慢淹没极小区域周围的区域,当在某一个时刻,水位达到灰度值的最大高度时,两个或更多的集水盆就会开始连通。把能够阻止这种连通的点连成一条线,就会在来自不同区域将会连通的地方形成分水岭,这是把输入图像划分为一组区域的过程。分水岭计算过程是一个迭代标注过程,在该算法中,分水岭计算分为排序和淹没两个过程。

假设定义域Dk上的函数g为待处理图像,它的最大最小值分别为hmax=max(g),hmin=min(g)。集合[Dg]h表示函数g的上限阈值,其中:

[Dg]h={x∈Dg|g(x)≤h}

(8)

Reg_Mink(g)={x∈Dg|x=Localmin且g(x)≤h}

(9)

g的分水岭区域即为集合Xhmax和Xhmin,可以通过迭代运算得到,即:

(10)

图4 目标检测与定位

图4(b)是对图4(a)进行分水岭分割后形成的结果示意图,从图可以看出图4(a)的灰度被分割为几个区域,理论上每个区域对应一个目标。

对分水岭的每一个区域进行统计,找出对应平滑卷积区域的极值,由于卷积值等于极值的像素可能不唯一,因而获取极值像素坐标的均值作为最终确定的极值,并用白色星号标于图上,具体结果见图4(c)。为便于观察,将极值标于二值图像上,如图4(d)所示,可以看出通过上述模板匹配与分水岭技术获得的车辆区域较准确,由于模板匹配的特性,这些星号对应车辆区域的左上角。根据车辆左上角位置,结合车辆的宽度和高度等先验数据,可以获得初始的车辆检测结果,如图4(e)所示,图中用白色的矩形框将获得的车辆标识出来,从图可以发现,部分目标有重复标识现象,或目标标识的区域过大等不准确现象。因而结合先验知识对获得的目标区域边界进行处理。比如,标识的两个区域发生重叠时,如果重叠区域大于阈值,则认为是同一车辆被重复标识,此时采取相应处理措施,将两个标识矩形框取并集,合并成一个标识矩形框。当

然,由于视频中车型不一,以及摄像头安置位置的差异,车辆大小处于变化状态,因而处理结果中可能出现漏检现象,比如图4(f)图上方中漏检一辆汽车,其原因应是该帧上方车辆较小,且有三辆车较接近所致。

4结语

运动车辆检测是当前一个研究热点,论文结合图像融合技术与分水岭技术实现了目标的检测。首先采用帧差法获取视频背景帧,之后采用像素级的图像融合技术,将视频帧与背景帧进行融合处理,获得前景区域,随后在模板匹配的基础上进行分水岭分割,获取最佳匹配位置信息,结合先验知识最终实现车辆检测。实验证明,该方法能够实时检测运动车辆,检测效果良好。

参 考 文 献

[1] Horn B K P, Schunck B G. Determining optical flow[J]. Artificial intelligence,1981,17(1):185-203.

[2] Gupte S, Masoud O, Martin R, et al. Detection and classification of vehicles[J]. IEEE Transactions on Intelligent Transportation Systems,2002,(3):37-47.

[3] Kristan M, Kovacic S, Leonardis A, et al. A two-stage Dynamic Model for visual tracking[J]. IEEE Transactions on Systems, Man, and Cybernetics, Part B-Cybernetics,2010,40(6):1505-1520.

[4] 朱振峰,赤诚,赵耀.基于多尺度的增强ViBe背景建模[J].北京交通大学学报,2015,39(2):1-6.

ZHU Zhenfeng, CHI Cheng, ZHAO Yao. Multi-scale based Enhanced ViBe for Background Modeling[J]. Journal of Beijing Jiaotong University,2015,39(2):1-6.

[5] 曹倩霞,罗大庸,王正武.光照突变场景中结合Phong模型的分层差分前景检测[J].计算机科学,2015,42(2):283-286.

CAO Qianxia, LUO Dayong, WANG Zhengwu. Hierarchical Subtraction Combining Phong Model for Foreground Detection in Sudden Illumination Changes Scenes[J]. Computer Science,2015,42(2):283-286.

[6] 王爱丽,董宝田,王泽胜.融合光流速度场与背景差分的自适应背景更新方法[J].中国铁道科学,2014,35(6):131-137.

WANG Aili, DONG Baotian, WANG Zesheng, et al. Adaptive Background Updating Based on Optical Flow and Background Difference[J]. China Railway Science,2014,35(6):131-137.

[7] Brutzer S, Hofelin B, Heidemann G. Evaluation of background subtraction techniques for video surveillance[C]//Proceeding of IEEE Conference on Computer Vision and Patten Recognition,2011:1937-1944.

[8] 王正勤,刘富强.自适应背景提取算法的比较[J].计算机工程,2008,34(23):220-223.

WANG Zhengqin, LIU Fuqiang. Comparison of Adaptive Extract Algorithm of Object Scene[J]. Computer Engineering,2008,34(23):220-223.

[9] 张瑜慧,沈洋.基于图像融合的运动前景检测方法[J].现代电子技术,2013,36(24):67-69.

ZHANG Yuhui, SHEN Yang. Method for Moving Foreground Detection Based on Image Fusion[J]. Modern Electronics Technique,2013,36(24):67-69.

[10] 高丽,杨树元,李海强.一种基于标记的分水岭图像分割新算法[J].中国图象图形学报,2007,12(6):1025-1032.

GAO Li, YANG Shuyuan, LI Haiqiang. New Unsupervised Image Segmentation Via Marked-Based Watershed[J]. Journal of Image and Graphics,2007,12(6):1025-1032.

中图分类号TN911; TP391

DOI:10.3969/j.issn.1672-9722.2016.02.013

作者简介:张瑜慧,女,硕士,副教授,研究方向:图像处理,模式识别等。

基金项目:宿迁市科技创新专项基金资助项目(编号:Z201415,Z201446)资助。

*收稿日期:2015年8月8日,修回日期:2015年9月21日