稀疏编码目标跟踪方法研究

2015-11-04张冬梅汪荣贵杨娟游生福齐立立

张冬梅,汪荣贵,杨娟,游生福,齐立立

合肥工业大学计算机与信息学院,合肥230009

稀疏编码目标跟踪方法研究

张冬梅,汪荣贵,杨娟,游生福,齐立立

合肥工业大学计算机与信息学院,合肥230009

针对稀疏表示用于目标跟踪时存在重构误差表示不够精确、目标模板更新错误等问题,提出一种改进的稀疏编码模型。该模型无需重构误差满足特定的先验概率分布,且加入对编码系数的自适应约束,可以取得更优的编码向量,使得跟踪结果更为准确。在此基础上,将这种改进的编码模型与粒子滤波目标跟踪算法相结合,研究并实现一种新的基于鲁棒稀疏编码模型的目标跟踪方法。该方法对每个粒子的采样区域进行编码,用所得的稀疏编码向量作为当前粒子的观测量,并采用目标模板分级更新策略,使得目标模板更加准确。实验结果表明,方法可以较好地解决目标部分遮挡和光照变化等干扰下的目标跟踪问题。

目标跟踪;稀疏编码;稀疏表示;粒子滤波

1 引言

目标跟踪是计算机视觉的重要研究内容,在智能监控、汽车导航、目标识别与人机交互等领域都有着广阔的应用价值。实际应用中经常遇到不可预估的干扰,例如:光照变化、目标的遮挡以及旋转、尺度变化等,这些干扰经常导致目标跟踪的漂移或失败。因此,如何构造一个能够适应复杂场景的鲁棒的跟踪器是一个急需解决的问题[1]。

目前,复杂场景下的目标跟踪方法大致分为判别式和生成式两大类。判别式方法将跟踪问题作为分类问题处理[2-4],即将目标从背景中区分出来,跟踪过程中对分类器进行在线更新。例如H Grabner等[4]提出一种新的基于在线AdaBoost特征选择的目标跟踪算法,在跟踪过程中利用对背景的学习选取最具区分力的特征,并通过对分类器的在线训练以适应目标外观的变化。这类方法的难点主要是在线训练过程中能否实现对样本的自动正确标记。

生成式方法通过建立目标的观测模型,将跟踪问题转化为寻求与目标外观模型具有最高似然性的区域[5-6],在跟踪过程中,增量地更新目标的外观模型以适应环境的变化和目标外观的改变。例如S K Zhou等[6]提出基于粒子框架的外观自适应模型的目标跟踪识别算法;L Matthews等[7]对Lucas-Kanade跟踪方法中的模板更新方法进行改进,建立了目标的主动外观模型等等。其中,粒子滤波方法是目标跟踪的经典方法,通常从解决粒子退化和粒子的多样性保持[8]或者改进目标的观测模型[9]入手提高算法的鲁棒性。目前,描述目标外观模型有很多方法,如颜色特征、纹理特征和梯度方向等,但是在复杂环境下这些特征仍不足以描述目标外观的变化,以获取鲁棒的跟踪效果。

稀疏表示[10-11]是智能信息处理的重要工具,目前在图像分类[12-13],人脸识别[14],图像的超分辨重建[15-16]等方面得到广泛的应用。由于基于稀疏表示的目标观测模型对环境的变化具有一定的鲁棒性,因此,用稀疏表示解决复杂场景下的目标跟踪问题具有较大的研究价值。稀疏表示应用于目标跟踪时,将跟踪问题的求解转化为在模板空间中寻求一个稀疏近似解[9,17-18]。W Qing等[17]提出一种局部稀疏表示的目标跟踪算法,目标样本的每个局部块由一个在线更新的超完备字典编码表示,利用局部块的编码结果学习得到一个线性分类器,继而将目标跟踪问题转化为分类问题。这种局部化方法虽然在处理干扰时有一定的鲁棒性,但是通常会丢失目标的全局信息。M Xue等[9]提出目标样本由目标模板和平凡模板(trivial templates)构成的超完备字典稀疏表示(以下称ℓ1方法),加入了对平凡系数(trivial coefficient)的非负约束,对光照变化有一定的处理效果,但是重构误差的计算不够精确。

针对上述问题,本文提出一种改进的稀疏编码模型,这种编码模型无需重构误差满足特定的先验概率分布,使得编码模型更加精确,且加入对编码系数的自适应约束,取得更优的编码结果以使跟踪结果更为准确。在此基础上,本文将这种改进的编码模型与粒子滤波目标跟踪算法相结合,研究并实现一种新的基于鲁棒稀疏编码模型的目标跟踪方法。该方法对每个粒子的采样区域进行编码,用所得的稀疏编码向量作为当前粒子的观测量,并且采用目标模板分级更新策略,使目标模板更加准确,由此可以较好地处理目标部分遮挡和光照变化等干扰下的目标跟踪问题。

2 粒子滤波

粒子滤波是一种基于贝叶斯框架的状态估计方法,通过寻找一组在状态空间中传播的随机样本对概率密度函数p(xt|z1:t)进行近似,以样本均值代替积分运算,从而获得状态最小方差估计的过程[19]。粒子滤波分为预测和更新两个基本阶段,其中预测阶段是根据系统模型预测状态的先验概率分布,而更新阶段则是利用最新的观测值修正先验概率分布,得到状态的后验概率分布。

令xt表示目标在t时刻的状态,z1:t-1={z1,z2,…,zt-1}表示前t-1时刻系统的观测值,预测和更新过程分别如式(1)和式(2)表示:

其中,使得式(2)中后验概率最大的xt被认为是t时刻的最优状态。

由于式(1)的积分形式难以求出,粒子滤波中使用蒙特卡罗模拟将这个积分转化为加权的粒子集求和形式表示。t时刻从重要性密度函数中采样得到粒子(N为粒子的个数),其相应权重为,使用下式更新:

归一化后权重为:

后验概率分布可由粒子集加权平均表示为:

其中δ(·)为Diracδ函数。

3 基于鲁棒稀疏编码的目标观测模型

稀疏表示是获取、表示和压缩高维信号的重要工具[15],其基本思想是:给定一个足够大的基集(也称作超完备字典),对于一个待编码信号,从基集中尽可能少地选择基向量线性重建待编码信号,同时使重构误差尽可能小。在跟踪问题中,可以利用稀疏表示对干扰的不敏感特性建立目标观测模型。

3.1目标观测模型

在建立目标的观测模型时,将目标样本在目标子空间上的稀疏表示向量作为样本的观测量[20-21],将目标子空间表示为:

子空间中的每个向量由目标模板列向量化得到,n表示目标模板的个数。同时引入平凡模板来表示在跟踪过程中出现的如部分遮挡、光照变化等不可预知干扰,令ε表示干扰,加入平凡模板集。

使用平凡模板表示ε,每个平凡模板ii∈Rd都是只有一个非零元素的列向量。

为了滤掉那些如阴影这类与目标模板反密度模式相似的干扰,文献[9]中加入平凡模板的非负约束,这可以使平凡系数中的项全部为非负值,平凡模板集扩展为:

对于当前的一个样本,将其列向量化后得到y∈Rd,进而y可以由目标子空间T与平凡模板集线性表示为:

在文献[9]中描述的跟踪方法中,观测值y在编码字典B上的稀疏表示解c可以通过求解ℓ1规范化最小二乘问题得到,并用求得的编码向量c作为样本y的观测量。本文将这种方法称为ℓ1方法,计算表达式如式(7)表述:

3.2鲁棒稀疏编码

在求解编码向量时,希望得到的是使重构误差最小的解,即极大似然估计(MLE,Maximum Likelihood Estimation)解,这意味重构误差表示的精确度非常重要,式(7)采用ℓ2范数来表示编码重构误差,这需要误差满足高斯分布。

尽管由中心极限定理可知,当样本趋近于无穷时,可以认为这些随机出现的误差是近似满足高斯分布的;然而,在具体的某个跟踪问题中,干扰的出现满足随机性,但是一个视频中样本的数目却不是趋近于无穷大,因此用ℓ2范数来表示编码重构误差并不精确。

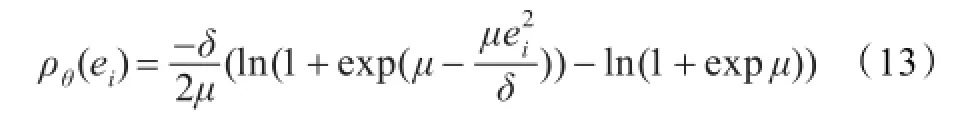

为了更精确地表示重构误差,本文仅给出每个重构误差项的概率密度函数表示形式fθ(ei),θ表示描述分布的参数集,然后根据MLE的原理,最大化似然函数:

或最小化目标函数:

其中ρθ(ei)=-lnfθ(ei)。

计算过程中,为方便起见,将编码字典B记为:

其中ri为B的第i行;

将观测值y记为:

编码向量按如下公式求解:

在实际的目标跟踪过程中,当出现严重干扰时,目标子空间将不能很好地表示目标样本,平凡系数中出现大量的非零项,平凡系数能量增大;当出现的干扰可忽略时,目标子空间很好地表示目标,平凡系数项几乎全部为零[9],但是平凡模板集也可以表示目标的某些部分,这会激活平凡系数中的零项,这时将无法得到最优的稀疏编码向量。

对此,为了提高鲁棒性,本文在式(8)中加入对平凡系数的自适应约束:当出现严重的干扰时,不考虑平凡系数能量的增大带来的影响;当出现的干扰可忽略时,增大对平凡系数的能量进行约束,使编码得到的平凡系数项尽可能多地为零。

基于以上分析,本文提出一种鲁棒稀疏编码模型,表述如下:

其中,λ2是一个自适应调节的值,当未检测到干扰或干扰可忽略时,为一个预设的常量,当检测到较严重干扰时,λ2=0。本文描述的稀疏编码模型式(9)不要求重构误差满足特定的先验概率分布,所以得到的编码结果更加精确。

加入对平凡系数的约束后,在干扰较小的时候,由式(9)求得的向量中,平凡系数的能量将会比式(7)的低。如图1、图2和图3所示,图1第一行为ℓ1方法对视频Tiger的跟踪效果,第二行为本文方法跟踪效果;图2和图3中分别为ℓ1方法中和本文求取的编码向量的平凡系数能量比,其中横轴为视频的帧数,纵轴为计算目标样本平凡系数能量比所得的值。

图1 跟踪效果

从图2中可看出,在ℓ1方法所求得稀疏向量中,平凡系数向量的比重在200帧以后一直高达30%,而在这些帧中,目标并不是一直受到干扰的,在那些受到干扰较小的帧中,平凡系数的能量应保持较低比值。这时,平凡系数的能量过高致使跟踪器无法区分目标和背景,最终发生跟踪错误。而本文由式(9)求解得到的系数向量基本上满足在目标受到较小干扰时,得到较佳的稀疏解,进而得到更优的跟踪结果。

图2 ℓ1中平凡系数能量比

图3 本文平凡系数能量比

4 基于鲁棒稀疏编码模型的目标跟踪

前文给出的鲁棒稀疏编码模型中仅设计出重构误差的计算表达式,还需要进一步探究相应编码向量的求解方法。为此,本章将给出这种稀疏编码模型的求解方法,并说明干扰检测以及目标模板的更新方法,然后与粒子滤波方法结合,提出一种新的基于鲁棒稀疏编码模型的目标跟踪方法。

4.1鲁棒稀疏编码模型的求解方法

在求解式(9)时,不能通过确定重构误差的分布进行求解。但是对于重构误差项,如果异常值(通常是由干扰引起)权值很小,那么就可以减小它们对回归估计的影响,从而使得编码对异常值的敏感性大大减小,M Yang等[22]将重构误差项改写成权重矩阵形式:

其中W为对角阵,且

e0为给定初始值后求得的重构误差,W对角线上的元素为权重值,指派给每个重构误差项。对于权重函数ωθ(ei),其范围应控制在[0,1]之间,这样可避免出现,很小的残差值获得趋近于无穷大的权重,综上权重函数ωθ(ei)可以写为:

其中,μ控制权重的下降率,δ为分界点。根据式(12)以及ρθ(0)=0,可得

由于W是使用前一次的重构误差而不断更新的,所以式(10)可以转化为一个迭代再加权的稀疏编码问题:即每次得到W后采用加速临近梯度法[23]求解得到一个稀疏解,然后根据最新得到的稀疏解更新权重矩阵W,不断循环,直到满足收敛条件其中γ是一个很小的正标量。

其中∂为控制参数,Γ为归一化因子,在t时刻,当前的跟踪结果是观测似然性最大的样本,并且由式(3)和式(14)可知,编码残差越小的样本,其对应粒子的权重越大。

4.2干扰检测及目标模板的更新

在跟踪中,为了处理随机出现的干扰,增强算法的稳健性,需要及时地更新目标子空间。目标外观的变化通常是由一系列干扰引起的,如果将带有严重干扰的样本更新到目标子空间中,将会导致子空间退化,最终无法较好地表示目标样本,进而导致跟踪错误。为此,在更新目标子空间时,必须对待更新样本进行干扰检测。

当出现干扰时,平凡系数中会出现很多非零项,可以利用这些非零项来检测当前样本受干扰的程度。首先,构造一个二维零矩阵,其大小和列向量化前的目标模板大小一致,每个元素对应样本中像素是否受到干扰,称其为干扰索引图。然后,将平凡系数向量进行列向量化的逆运算,转化为矩阵形式,扫描平凡系数的矩阵,只要它的元素大于选定阈值,就将干扰索引图中的相应位置标记为1,标记为1的位置表示当前像素点受到干扰。并且利用形态学方法处理干扰索引图,计算连通区域大小,即以受干扰的像素数来判断样本受干扰的程度。最后,统计受到干扰的像素所占的百分比。如果达到一定阈值,即认为发生干扰。

利用上述的干扰检测方法,在获取当前的跟踪结果后,采用如下步骤对目标子空间进行更新:

(1)选择出当前待更新的目标模板与最优模板,与目标系数中最小项对应的模板,记为待更新模板t0;与目标系数中最大项对应的模板,记为最优模板topt。

(2)当前跟踪结果记为y,然后计算y与topt的相似程度(本文用向量间的夹角作为判断标准,阈值η=0.5),如果两者相似程度小于阈值,则不需要进行更新,结束;否则,进行更新,转(3)。

(3)设定两个门限值tr1,tr2(本文中tr1=0.1,tr2=0.6),计算出当前目标样本的受干扰程度tr,若tr<tr1,直接用y替换t0进行更新;若tr1≤tr≤tr2,使用当前目标模板的均值替换当前样本中受到干扰的部分,其相应位置根据干扰索引图求得,然后使用修正过的y替换t0;若tr>tr2,则认为干扰太严重,不进行更新,结束。

4.3目标跟踪算法流程

结合前文所述,本文提出的基于鲁棒稀疏表示模型的目标跟踪算法跟踪流程如下:

(1)跟踪初始时,目标通过人机交互获取,同时得到一个目标模板,并利用在该模板中加入微扰的方式产生剩余模板,本文共使用10个目标模板,加入平凡模板,构成编码的超完备字典,初始化粒子。

(3)计算粒子权重,对于每个粒子,使用式(9)对粒子的采样区域进行稀疏编码,得到编码向量,也就是当前粒子的观测值后,根据得到的式(14)和式(3)更新粒子的权值。

(4)更新目标模板,根据当前的跟踪结果,对目标样本进行更新,更新算法如本文4.2节所述,更新后得到当前的超完备字典。

(6)输出当前跟踪结果,跟踪结果为粒子集的加权平均值,计算公式为公式(5),标记跟踪到的目标位置。是视频最后一帧,结束,否则转步骤(2)。

5 实验结果分析

本文实验平台为CPU双核2.6 GHz,内存2 GB,软件为Matlab R2009a,Windows XP操作系统,算法执行效率为1.93 s/帧。为了验证本文算法的有效性,实验中选取了多组具有代表性的视频进行处理,这些视频中包含了目标的遮挡,光照的剧烈变化,目标的快速移动等较难处理的情况。实验中选取ℓ1跟踪方法以及VTD(Visual Tracking Decomposition)[24]跟踪方法作为对比实验,并且分别通过主观观察和客观评价方法验证本文算法的优越性。

在跟踪起始时刻,需要跟踪的目标是在第一帧时经手动选取的。在实验过程中,粒子的个数为300个,目标模板的个数为10个,模板的大小根据第一帧选取所得的目标长宽比确定,由长宽比最终归一到四种大小12×15,15×12,10×18以及18×10中的一种,平凡模板的个数为360个,每个编码向量为370×1的列向量。令ψ=[(e1)2,(e2)2,…,(en)2],将其元素按升序排列,得到ψa。文中参数δ=ψa(175),μ=8/δ,λ1=0.01。图4为VTD,ℓ1和本文方法分别对视频Occlusion,David,Singer,Car以及Deer的跟踪效果。其中,蓝色框为VTD方法,绿色为ℓ1方法,红色为本文方法。

图4 各类算法跟踪效果对比

第一组为视频Occlusion的跟踪效果,此视频的主要处理难度在于人脸面部的遮挡,遮挡率最大时达到近70%,文中选取了较有代表性的#1、#130、#198、#300、#500、#550帧作为效果展示。在目标受到的遮挡不严重的时候,如#130、#198帧,ℓ1算法和本文算法都能较好地跟踪到目标,但是当干扰比较严重时,如#550帧,ℓ1算法的跟踪正确率下降,这时ℓ1跟踪算法中在模板更新时可能将受干扰的样本更新到目标模板中,而本文算法此时仍能较好地表示并跟踪到目标。

图5 各类方法中心像素误差对比

第二组为视频David中的#1,#100,#150,#300,#400,#460帧的效果展示,David视频中目标运动过程中有一些形变,并且光照也有一定的变化,其中摘戴眼镜时还发生了遮挡。在这个视频中,本文算法总体上跟ℓ1算法的效果差不多,但是在目标侧脸和摘戴眼镜时,目标外观发生了一定的变化,本文算法的跟踪结果较好,这可能是本文的编码方法对出现干扰有更为精确的表示,在求解编码向量时准确度更高。

第三组和第四组是视频Singer和Car的跟踪效果,其中分别选取了#1,#70,#90,#115,#170,#310帧以及#1,#55,#150,#250,#300,#390帧展示。对这两个视频处理时的主要挑战在于光照的剧烈变化,其中视频Singer中目标的尺度也发生了一定的变化。在Singer中,在光照变化非常剧烈的时候,如#115帧,ℓ1算法的准确度较本文算法下降更多,产生了一定的漂移,此时VTD方法保持不错的效果。在Car视频中,有一段时间目标穿越阴影区,光照变化也比较剧烈,如#150,此时本文算法仍保持比较高的跟踪精确度。

第五组为从视频Deer中选取的#1,#25,#35,#50,#52,#71帧,这组序列处理难度主要在于目标运动速度较快,很难通过预测来确定目标位置,这种由运动模糊造成的目标外形的变化在进行模板更新时处理难度较大。在这个视频中,本文方法和VTD方法具有较好跟踪效果,而在#50和#52帧中,ℓ1算法已几乎跟踪不到目标。

衡量一个算法的性能需要一种合理的评价标准,目前对于跟踪算法主要采用中心像素误差作为评价标准。中心像素误差指的是目前跟踪到的目标中心位置与目标实际中心位置的像素距离。图5为基于中心像素误差标准的跟踪效果对比:其中,蓝色为VTD方法,绿色为ℓ1方法,红色为本文方法。

基于中心像素误差的衡量标准一定程度上体现了一个算法的鲁棒性,但是这种标准并没有考虑目标的形状的大小。比如,中心像素误差为0,但是目标的实际大小和跟踪的结果大小相差较大,这时中心像素误差就不能很好地反映算法的性能了。所以,本文引入了另外一个评价标准,目标的重叠率。本文使用PASCAL VOC[25]的规范,设当前的跟踪结果为RT,实际的目标位置为RG,则重叠率定义为,理想情况下score值为1。这种评价标准不仅包括了对目标位置的准确度要求,也加入了对目标大小的准确度要求。图6为每个视频的跟踪结果重叠率比较。蓝色为VTD方法,绿色为ℓ1方法,红色为本文方法。图像横轴为视频帧数,纵轴为重叠率。

通过对实验结果的分析,以及针对两种跟踪评价标准(即中心像素误差和目标的重叠率)的对比,可以看出,本文算法具有较好的稳健性和鲁棒性,在目标有遮挡、光照变化和快速移动都有较高的跟踪准确度。

图6 各类方法重叠率对比

6 总结

本文对在粒子滤波框架下的基于稀疏表示模型的目标跟踪方法进行了理论分析,指出在进行编码时对重构误差表示的精确度不高,且存在将受干扰较大样本更新到目标模板中等问题。针对上述问题,本文首先提出了一种鲁棒稀疏编码模型,并且加入了对编码系数的自适应约束,该模型求取编码的极大似然估计解,对干扰更加鲁棒,可以取得更优的跟踪效果;其次,使用改进的目标模板更新方法,使当前的目标模板能够更好地描述最新的目标状态;通过多组实验表明,本文算法在处理部分遮挡、光照变化及一定程度的形变时,具有较好的跟踪效果。

[1]Yilmaz A,Javed O,Shah M.Object tracking:A survey[J]. ACM Comput Surveys,2006,38(4):13-32.

[2]Babenko B,Yang M H,Belongie S.Visual tracking with online multiple instance learning[C]//IEEE Conference on CVPR,Miami,FL,IEEE Proc,2009:983-990.

[3]Breitenstein M D,Reichlin F,Leibe B,et al.Robust trackingby-detection using a detector confidence particle filter[C]// IEEEConferenceonICCV,Kyoto,IEEEProc,2009:1515-1522.

[4]Grabner H,Grabner M,Bischof H.Real-time tracking via on-line boosting[C]//British Machine Vision Conference,2006:47-55.

[5]Matthews I,Baker S.Active appearance models revisited[J]. International Journal of Computer Vision,2004,60:135-164.

[6]Zhou S K,Chellappa R.Visual tracking and recognition using appearance-adaptive models in particle filters[J].IEEE Transactions on Image Processing,2004,13:1491-1506.

[7]Lain M,Takahiro I,Simon B.The template update problem[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2004,26:810-815.

[8]汪荣贵,沈法琳,李孟敏.非线性系统状态突变下的非退化粒子滤波方法研究[J].中国科学技术大学学报,2012,42(2):140-147.

[9]Mei X,Ling H.Robust visual tracking usingℓ1minimization[C]//IEEE Conference on ICCV,Kyoto,IEEE Proc,2009:1436-1443.

[10]戴琼海,付长军,季向阳.压缩感知研究[J].计算机学报,2011(3):425-434.

[11]Donoho D L.Compressed Sensing[J].IEEE Information Theory,2006,52(4):1289-1306.

[12]Mairal J,Bach F,Ponce J,et al.Discriminative learning dictionaries for local image analysis[C]//IEEE Conference on CVPR,Anchorage,AK,IEEE Proc,2008:1-8.

[13]亓晓振,王庆.一种基于稀疏编码的多核学习图像分类方法[J].电子学报,2012,40(4):773-779.

[14]Wright J,Yang A,Ganesh A,et al.Robust face recognition via sparse representation[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2009,30(2):210-227.

[15]Yang J,Wright J,Huang T,et al.Image superresolution as sparse representation of raw patches[C]//IEEE Conference on CVPR,Anchorage,AK,IEEE Proc,2008:1-8.

[16]练秋生,张伟.基于图像块分类稀疏表示的超分辨率重构算法[J].电子学报,2012,40(5):920-925.

[17]Wang Qing,Chen F.Online discriminative object tracking withlocalsparserepresentation[C]//IEEEConference on WACV,Breckenridge,CO,IEEE Proc,2012:425-432.

[18]Liu B,Yang L,Huang J,et al.Robust and fast collaborative tracking with two stage sparse optimization[C]// Computer Vision ECCV.Berlin Heidelberg:Springer,2010: 624-637.

[19]汪荣贵,李孟敏,吴昊,等.一种新型的基于自适应遗传算法的粒子滤波方法[J].中国科学技术大学学报,2012,41(2):134-141.

[20]Lee K C,Kriegman D.Online learning of probabilistic appearance manifolds for video-based recognition and tracking[C]//IEEEConferenceonCVPR,Kyoto,IEEE Proc,2005:825-859.

[21]Yu Q,Dinh T B,Medioni G.Online tracking and reacquisition using co-trained generative and discriminative trackers[C]//Computer Vision ECCV.Berlin Heidelberg:Springer,2008:678-691.

[22]Zhang Meng,Zhang Lei,Yang Jian,et al.Robust sparse codingforfacerecognition[C]//IEEEConferenceon CVPR,Providence RI,IEEE Proc,2011:625-632.

[23]Teng P.On accelerated proximal gradient methods for convex-concave optimization[J].SIAMJournal on Optimation,2008.

[24]Kwon J,Lee K M.Visual tracking decomposition[C]// IEEE Conference on CVPR,San Francisco,CA,IEEE Proc,2010:1269-1276.

[25]Everingham M,Van Gool L,Williams C K I,et al.The PASCAL visual object classeschallenge[J].Internatinal Journal of Computer Vision,2010,88(2):303-338.

Research on sparse coding object tracking method .

ZHANG Dongmei,WANG Ronggui,YANG Juan,YOU Shengfu,QI Lili

School of Computer and Information,Hefei University of Technology,Hefei 230009,China

To deal with the problems in sparse presentation’s application to object tracking,such as the not accurate enough representation of construction error,the wrong update of object templates and so on.This paper proposes a modified sparse coding model.This model doesn’t require the construction error following a particular prior probability density function,and adds an adaptive restraint of the coding coefficient,and this model can acquire better coding vectors for more accurate tracking results.Combined the modified model with the particle filter object tracking algorithm on this basis,a new object tracking method based on the robust sparse coding model is researched and realized.The proposed method encodes every particle’s sample area,uses the sparse coding vector as the observation for the particle,and updates the object templates with different grade to make them more accurate.The experiment results show that the proposed object tracking method can deal well with the corruption like occlusion and illumination variation in object tracking.

object tracking;sparse coding;sparse representation;particle filter

A

TP391.41

10.3778/j.issn.1002-8331.1311-0185

国家自然科学基金(No.61075032);安徽省自然科学基金(No.1408085QF117)。

张冬梅(1989—),女,硕士研究生,主要研究方向为智能视频处理与分析、目标跟踪;汪荣贵,教授,博导,主要研究领域为智能视频处理与分析、车载视觉增强系统、多媒体技术;杨娟,讲师,博士;游生福,硕士研究生;齐立立,硕士研究生。E-mail:zhangdm_ever@sina.com

2013-11-13

2013-12-26

1002-8331(2015)22-0053-08

CNKI网络优先出版:2014-04-01,http://www.cnki.net/kcms/doi/10.3778/j.issn.1002-8331.1311-0185.html