基于HyperWorks仿人机器人面部表情仿真

2015-07-07柯显信尚宇峰卢孔笔

柯显信,尚宇峰,卢孔笔

(上海大学 机电工程与自动化学院,上海 200072)

0 引言

在人与机器人交互的发展进程中,表情之间的交流起到越来越重要的作用。面部表情与情感表达的关系十分密切,心理学家认为,情感表达=7%语言+38%声音+55%面部表情,面部表情是通过眼、眉、嘴和脸颊部肌肉变化来表现情绪状态[1]。人的基本表情可以分为7种:平静、生气、悲伤、高兴、恐惧、厌恶和惊讶。目前,国内外的一些研究机构在仿人机器人面部表情的实现方法上大多是采用驱动柔性体的皮肤,所以面部柔性模型的仿真分析对实际仿人机器人头部模型的设计起到至关重要的作用[2]。2008年,英国西英格兰大学和布里斯托尔大学联合所属布里斯托尔机器人学实验室研制了一款可以模仿人类面部表情和嘴唇活动的类人机器人“朱利斯(Jules)”,采用软性橡胶(Frubbe)皮肤,Jules能模仿十种常见表情,例如,高兴,悲伤,忧虑等[3]。2009年,美国汉森机器人公司研发的以爱因斯坦为原型的表情机器人“Albert Hubo”,使用了一种类似肉体的叫做“Frubber”的机器人皮肤材料,从而使机器人可以实现面部皱纹的细微变化[4]。2011年,西安超人高仿真机器人科技有限公司研制的仿真硅像机器人李咏2能展现出多种不同的表情。本文在研究基本表情特点及表情实现方法的基础上,对柔性体皮肤进行仿真分析,为以后机器人头部机构的设计提供了一定的指导作用。

1 面部表情的空间模型

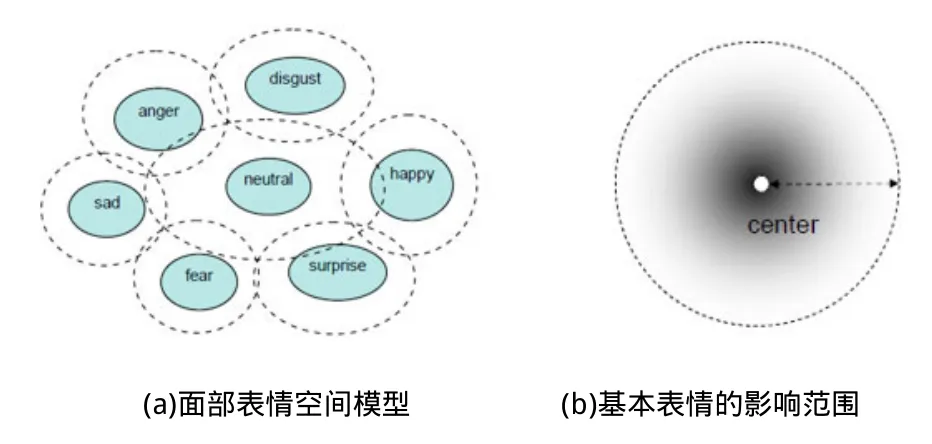

人类面部表情的产生是由于人类内心情感的波动造成的,人类情感的变化在时间和空间上都是连续的,所以面部表情的变化也是连续的。为了提高仿人面部面部表情机器人的拟人程度,必须对面部表情的变化做一定的研究。面部表情的变化是人内心情感反映的一种表象,面部表情的分类有很多种不同的分法,目前最常见的分法就是把人的面部表情分成7类,即平静、生气、悲伤、高兴、恐惧、厌恶和惊讶,这几种面部表情都能从中性面部表情变化而来,而且它们之间也有着紧密的联系,如图1所示。

图1 面部表情空间模型与基本表情的影响范围

该模型具有如下的特点[5]:

整个空间被化为7个部分,六种基本表情围绕着平静表情展开,如图1(a)所示。

每种表情都有一个中心,中心电的附近是该表情的一个范围空间,在这个范围内的都属于这种表情,离这个中心点越近,表情的逼真度越高,如图1(b)所示。

两个基本表情中心点之间的距离表明表情之间的相似程度,当某个表情处于两个基本表情交集的范围内时,这种表情就是两个基本表情混合而成的,这两种表情之间的变化可以从经过这个表情的过渡,当两种基本表情没有交集时,说明这两种表情之间没有过渡的表情。

观察发现,在表情空间模型中,厌恶与高兴这两种基本表情之间没有交集,意味着从厌恶表情转化为高兴表情必须经过平静这种表情过渡。经过观察日本女性JAFFE的大量照片,分析面部表情的动作特征,如表1所示,发现感兴趣这种表情的面部器官动作特征可以作为厌恶和高兴之间的过渡表情,假设从一个故事情节入手,故事情节的好坏往往首先使人产生兴趣,然后才会有各种表情的产生。所以对该模型进行改进,将人类的基本表情分为8种,即感兴趣、生气、悲伤、高兴、恐惧、厌恶、惊讶和平静,改进后的表情空间模型如2图所示。

表1 面部表情器官动作特征

图2 改进后的表情空间模型

2 面部表情机器人的表情实现

人脸的表情变化是由位于面部肌肤下层的表情肌的变化产生的,收缩时带动皮肤运动,当各个表情肌协同工作时,就能使面部呈现不同的表情[6]。机器人面部表情的实现是通过控制面部表情特征点来实施的,特征点的分布是根据人表情肌运动的特点来设计的,图3是机器人面部表情特征点分布情况,有6对特征点分别分布于面部的两侧,中间有两个控制点,这些控制点对表情的实现与识别都起到至关重要的作用。如图所示,P1和P2位于眉毛的内侧,P3和P4位于眉毛的外侧,P5和P6位于眼睛的内侧,P7和P8位于眼睛的外侧,P9 、P10位于上嘴唇的中间,P11和P12位于嘴巴的外侧,P13位于下嘴唇的中间。不同表情的实现实际上就是控制这些特征点的位置位移,位移的变化可以通过下面的公式来计算[7,8]:

x=(x1,x2)表示运动前点的坐标,y=(y1,y2)表示运动后点的坐标。

图3 部表情特征点分布

通过空间运动学知识,由舵机驱动仿人表情机器人面部的各个特征点,使之产生形变,形成特定的表情。

3 面部表情实现的模拟仿真

在建立面部弹性体模型的基础上,根据面部特征点的分布设计,运用有限元分析方法进行仿人面部器人柔性体模型下的面部表情仿真,并对各种不同条件下的仿真结果进行对比分析。

3.1 有限元软件HyperWorks介绍[9]

Altair HyperWorks是一个创新、开放的企业级CAE平台,它集成设计与分析所需各种工具,具有无比的性能以及高度的开放性、灵活性和友好的用户界面。HyperWorks包含丰富的产品模块,如HyperMesh、RADIOSS、MotionView、HyperGraph、HyperForm、HyperView等。本文主要用到HyperMesh、RADIOSS、HyperView三个模块。

HyperMesh:CAE前处理工具,可以快速建立高质量的CAE分析模型。

RADIOSS:快速、精确和稳健的有限元结构分析软件,能够进行多种线性和非线性分析。

HyperView:目前全球图形驱动速度最快的CAE仿真和实验数据的后处理可视化环境之一。

3.2 面部表情实现的模拟仿真过程

第一步:运用三维建模软件Solidworks建立面部几何模型,如图4所示,并将文件导入HyperMesh。然后赋予模型类似于橡胶材料弹性力学参数。文中弹性体模型赋予弹性模量为7.84Mpa、柏松比为0.48、密度1200 kg/m3的材料属性,各向同性,使几何模型成为一个具有弹性材料力学特性的面部弹性体模型。考虑到材料不会发生大应变情况,在此可以将其合理简化为普通线弹性模型。

图4 三维模型

第二步:划分网格。划分网格是有限元分析中的至关重要的一步,网格划分的好坏直接影响有限元分析是否能够收敛及结果的正确与否。由于曲面的复杂性,所以采用以四边形为主的网格划分方式。通过分析日本女性JAFFE的表情,得知影响表情的主要器官为眉毛,眼脸和嘴巴。利用分区功能,对这些区域进行分区,然后再划分网格 ,如图5所示,在嘴巴和眉毛的位置,网格比较密集。

图5 网格划分

图6 位移载荷分布图

第三步:施加约束与载荷。根据面部解剖学理论和面部表情编码系统(FACS),在嘴巴和眉毛区域附近添加载荷,并相应地设定边界条件,如将面部皮肤与头骨的接合部位设为固支条件,使模型产生不同的相对变形量,以实现不同的面部表情、模拟不同表情时面部表情控制点的运动情况并分析面部仿真皮肤材料所受位移载荷情况,如图6所示。

3.3 控制参数对基本表情实现的影响

影响面部基本表情实现的因素有很多,如材料的性能,约束的位置,载荷的大小以及载荷的控制区域的大小等。本文主要以高兴这种基本表情作为研究对象,研究载荷的大小和载荷施加区域的大小对基本表情的影响。

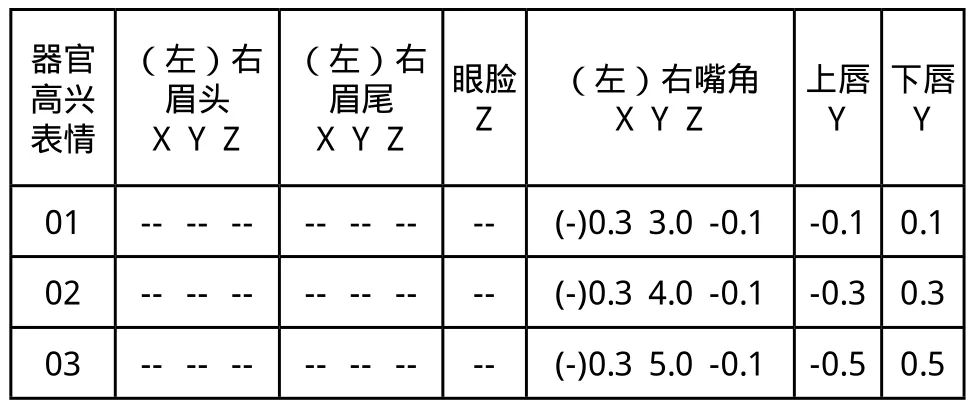

3.3.1 载荷的大小对基本表情实现的影响

以高兴表情为例,在约束和载荷施加区域相同的情况下,改变施加载荷的大小,如表2所示,观察施加载荷的大小对基本表情实现的影响。如图7所示,高兴程度从左到右依次增强,施加02组载荷大小时,表情的逼真程度比较好。在模拟高兴表情时,对嘴角处控制点Y轴的驱动载荷要求最高,此处材料厚度应与其他处有明显区别,当高兴的程度不大时,眼睑处和眉毛处的载荷可以忽略,进行简化。由此可见,对表情控制点施加位移载荷的大小对表情的强弱程度起到非常重要的作用。

表2 高兴表情三组不同载荷大小明细表

图7 高兴表情的不同程度分布

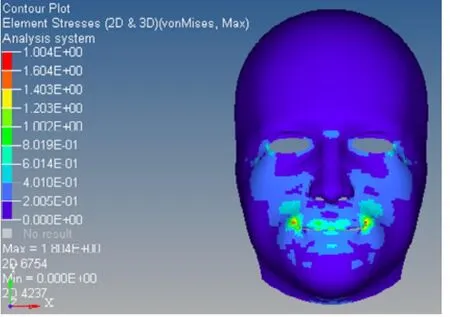

由图8可以发现,01组载荷的仿真结果中,最大应力出现在嘴角部位,是嘴角处表情控制点向上拉伸所致,越靠近嘴角处受到的力越大,该处也越容易产生疲劳破坏。

图8 01组载荷的应力云图

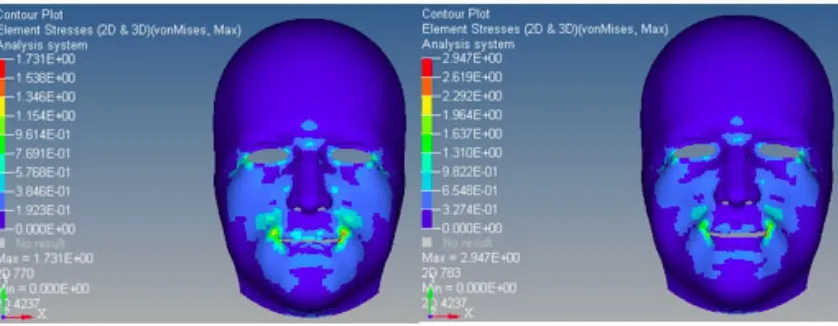

对比03组载荷的仿真结果应力云图,如图9所示,表情的逼真程度有所提高,但随着载荷的增大,可以发现鼻子下面的受力区域面积增大,说明载荷大小的改变会引起面部其他部位的受力发生变化,过渡增加嘴角处载荷的大小,可能引起鼻子下方区域的破坏。

图9 03组载荷的应力云图

3.3.2 载荷施加区域大小对基本表情实现的影响

改变嘴角处载荷施加区域的大小来观察其对表情的影响。以02组载荷大小和施加区域为标准,适当增加嘴角处载荷施加区域的面积,这里以原来嘴角载荷区域的1.5倍和2倍为例,得到其面部仿真图和应力云图。如图10所示,通过观察可以发现,在1.5倍这个范围内,仿真模拟结果并没有很明显的改变,但在2倍的控制区域时,面部表情形状开始发生扭曲,有一定的失真。

图10 施加载荷区域为原来1.5倍、2倍的情况时的仿真表情图

图11是控制区域为原来1.5倍和2倍两种情况下面部模型的应力云图,可以发现在几处表情控制区域材料所受应力伴随控制区域尺寸的增大而增加,和实际情况相符合。

图11 施加载荷区域为1.5倍、2倍时应力云图

3.3.3 面部表情仿真结果

通过在特征点区域施加不同的载荷,对8种基本表情(平静、生气、悲伤、高兴、恐惧、厌恶、惊讶、感兴趣)的反复试验,得到实现8种基本面部表情的最佳位移载荷,如表3所示,利用RADIOSS对模型进行求解,在HyperView中查看仿真结果,得出与最佳载荷匹配的8种基本表情的仿真图,如图12所示。

图12 面部表情仿真图

表3 8种基本表情的最佳载荷大小

4 结束语

通过对日本女性JAFFE面部表情特征的观察与分析,在传统的基本表情分类的基础上,增加了感兴趣这种表情,将基本表情分为8种(平静、生气、悲伤、高兴、恐惧、厌恶、惊讶、感兴趣)。在SolidWorks环境下完成了面部三维模型建立,用HyperWorks有限元软件进行分析,通过反复试验,得出8种基本面部表情仿真图以及在弹性皮肤材料下基本表情的最佳载荷驱动大小,为机器人样机面部表情实验控制提供了一定的依据。

[1]王志良.人工情感[M].北京:北京工业出版社,2009.178-273.

[2]MENG Qingmei,WU Weiguo,WANG Yu.Actions Simulation of Humanoid Head Robot with Mixed Models of Head Mechanism and Face Elastomer[J].System simulation journal, 2005,17:1466-1483.

[3]Delaunay F, de Greeff J,Belpaeme T.Towards retroprojected robot faces: An alternative to mechatronic and android faces[A].The 18th IEEE International Symposium on Robot and Human Interactive Communication[C].Toyama, Japan,2009:306-311.

[4]Ho J, Hanson O D,Kim W S, Park I W.Design of android type humanoid robot albert HUBO[A].IEEE International Conference on Intelligent Robots and Systems[C].Beijing,China, 2006:1428-1433.

[5]Weifeng Liu,Jili Lu,Zengfu Wang and so on.An Expression Space Model for Facial Expression Analysis[A].Congress on Image and Signal Processing[C].2008:680-684.

[6]Zhang yu, Yang kuo, Deng xueying, Research and Realization of Facial Expression Robot[J].IEEE Symp.Materials Science and Information Technology.2011:7413-7419.

[7]Yuta Kihara, Guifang Duan,Takeshi Nishida and so on.Dynamic Facial Expression Database for Quantitative Analysis of Facial Paralysis[A].Computer Sciences and Convergence Information Technology (ICCIT),2011 6th International Conference[C].2011: 949-952.

[8]Zhang yu, Yang kuo, Deng xueying, Research and Realization of Facial Expression Robot[J].Proc.IEEE Symp.Materials Science and Information Technology.IEEE Press,Sep 2011, pp.7413-7419.

[9]王钰栋,金磊,洪清泉.HyperMesh & HyperView应用技巧与高级实例[M].机械工业出版社,2012:6-86.