基于几何与粗糙深度信息的候选车辆生成方法*

2015-04-12蔡英凤林国余张为公

王 海,蔡英凤,林国余,张为公

(1.江苏大学汽车与交通工程学院,镇江 212013; 2.东南大学仪器科学与工程学院,南京 210096)

2015106

基于几何与粗糙深度信息的候选车辆生成方法*

王 海1,蔡英凤1,林国余2,张为公2

(1.江苏大学汽车与交通工程学院,镇江 212013; 2.东南大学仪器科学与工程学院,南京 210096)

基于单目视觉的车辆识别通常分为候选车辆生成(CG)和候选车辆验证(CV)两个步骤。传统的CG步骤往往采用遍历的方法,获得的候选车辆窗口数量庞大,增加了后续CV阶段的计算耗时,难以满足实际应用的实时性要求。本文提出一种基于几何和深度信息的CG方法,在不丢失有效车辆区域的前提下极大减少了候选车辆的数量。该方法首先将图像以超像素形式进行分块,同时利用预先训练的Adaboost分类器获取超像素图像的几何信息和粗糙深度信息。然后利用车辆在世界坐标系下的垂直度、位置和尺寸等先验知识,采用了一种分层聚类策略,合并图像中属于车辆的超像素块并生成候选车辆。与传统算法的比较结果表明,本方法以检测率的微小降低为代价,实现了候选车辆窗口数量的大幅度减少。

车辆识别; 单目视觉; 候选车辆生成; 超像素

前言

高级驾驶辅助系统(advanced driver asistant system,ADAS)的主要目的是提高驾驶员驾驶过程中的安全性和舒适性。ADAS系统要求对车辆所处的场景具有全面的感知和理解。例如,要求能对运动和静止的物体进行实时准确地检测,以确定车辆行驶的安全空间。目前,毫米波雷达、激光雷达等主动式传感器已经被广泛使用。

主动式传感器在车辆检测应用中已经表现出良好的效果。但是,高成本、高能耗和安装不便是主动式传感器短期内难以克服的固有缺点。近年来,以机器视觉信息获取(如摄像机)为代表的被动式传感器成为ADAS研究的热点。车载机器视觉可以获取周边环境丰富的图像信息,这些信息可以被用在车辆检测、车道线检测和交通标志识别等ADAS应用中。其中,车辆检测是基于机器视觉的交通场景理解的一个重要环节[1-6]。由于ADAS高实时性的要求和嵌入式硬件计算能力的制约,无法对一幅图像所有子区域都采用复杂的模式识别算法进行判断。因此,目前主流的目标检测算法一般采用两步的车辆检测策略:第一步,采用低耗时的算法在图像中生成车辆可能存在的假设候选区块,即候选车辆生成(candidate generation,CG);第二步,针对上一个步骤产生的候选区块,采用较为复杂的判断算法进行区块的候选车辆验证(candidate verification,CV)。上述环节中,步骤一中生成的CG区块数量的多少直接影响到整个目标检测算法的实时性和准确性。因为,一方面较少的CG区块会大大减少CV阶段的算法执行时间,显著提高实时性;另一方面,若能在CG阶段就排除掉绝大部分明显的非目标物体图像区块,则有助于降低整个系统的误检率(false positive,FP)。因此,实现一个高效的CG算法对保障ADAS的性能有着重要的现实意义。

目前,大多数CG算法都采用遍历搜索的方法,如滑动窗口法。为了兼顾实时性,这些算法往往会增大窗口滑动间隔和窗口尺度倍数,而这会在一定程度上带来车辆的漏检[7]。文献[8]中采用基于地平面假设的候选车辆生成方法,大大减少了候选窗口的数量。但是该方法在曲面路面和摄像机俯仰角变化时,CG窗口的选取效果大幅下降。文献[9]中采用了基于对称性和边缘特征的车辆候选方法,但是该方法在前车车身姿态发生变动,如有一定的偏移角时,效果不佳。

本文中采用图像中间层信息和底层信息相融合的策略,结合实际道路中车辆的几何特征,提出了一种新颖高效的基于图像几何特征和深度信息的候选车辆生成方法。本方法首先将图片按照像素的近似性转化为超像素形式;然后通过单幅图像场景的几何信息提取,将图像分成水平平面、竖直平面和天空3个主要部分,通过该分割,可以获得与车辆位置有关的大量细节信息,另外由于本文中采用基于单幅图像的粗糙深度信息的估计方法,能在仅有单幅图像的情况下,获得较为粗略的深度映射;最后,通过几何与深度信息融合,对图像中的超像素进行聚类组合,生成侯选车辆。本文的算法框架如图1所示。

1 底层信息提取

底层信息是指图像中如像素灰度、颜色等无须加工即可获得的图像信息,超像素是底层信息的一种重要的表达方式。其本质是一种分割方法,即将图像中具有相同或相似特征属性的近邻像素聚合成一个组,称之为一个超像素。文献[10]中最早提出生成超像素的算法,目前出现了大量的以超像素代替原始像素的机器视觉处理方法,在图像分割[11]、图像解析[12]和目标定位[13]等领域均有广泛应用。可见采用超像素的分割方法更能体现人类的感知意义,也更符合自然的现实表示。因此,超像素表达在以人的感知为基础的目标识别领域中具有得天独厚的优势。本文中采用文献[10]中所述的SLIC方法将车辆图像划分为底层的超像素形式(图1(b))。

2 中间层信息提取

2.1 场景几何信息提取

如上文所述,根据道路特点,单幅图像中道路场景的几何信息主要被分为3类。若能通过对单幅图片的分析,进行这样的物体区分,将对道路物体的检测和识别提供非常有价值的先验信息。通过对大量图片的统计和分析发现,在道路图像中,平面物体往往是路面区域,垂直物体往往是垂直于路面的物体,例如车辆、树木、护栏等,而天空部分往往是位于图像的上方。文献[14]中通过将每个超像素用颜色、位置和透视效果等信息进行表征,并将之输入到一个经预先训练的回归Adaboost分类器中,得到每个超像素的所属类别。本文中采用该方法,将道路图片分为前述路面、垂直物体和天空3类,如图1(c)所示。

2.2 粗糙深度信息提取

基于多幅图像的深度信息获取已有许多成熟的方法。文献[15]和文献[16]中均提出了基于单幅图像的精确深度信息获取算法,但是这两种方法需要以秒为计算单位的计算时间,难以满足本文候选车辆生成的实时性要求。

相比较需要精确获得物体在三维信息的应用,在候选车辆生成中,对图像中物体的深度信息的精度要求相对较低。对此,本文中利用双目视觉获得的已标有图像深度信息的大量样本图像,训练了一个可以进行粗糙深度分类的SVM分类器。根据道路车辆检测的应用特点,图像中的深度di被分为近距离(0~100m)、中距离(100~150m)和远距离(150m~∞)3类。

为进行分类器训练,本文中提取了图像的如下几个特征:(1)HSV图像空间3个通道的均值和直方图;(2)基于Gabor滤波的纹理梯度特征;(3)像素所属类别(天空、地面等)。将所有样本图像划分为6×6像素的小格,用以上3个特征构成相应的特征向量Vi。

对于任一个待测图片,将其用上文所述的特征向量Vi表征并输入到分类器C中进行训练[17]。分类器C输出待测图片属于某一个深度di的概率Pi,并按照最大概率原则进行判定。深度计算完成的图像如图1(c)右图所示。

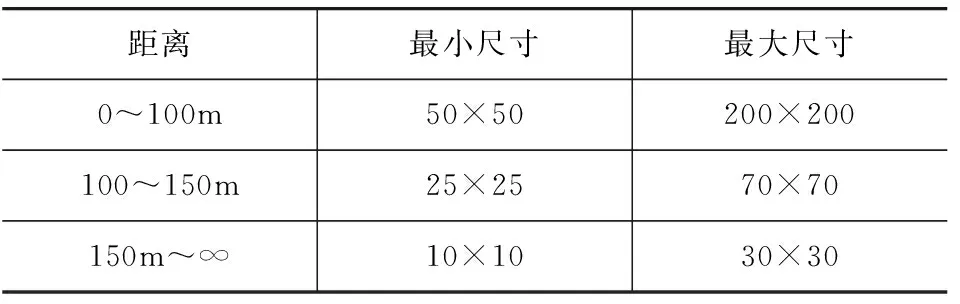

单目相机要求地平面平坦才能进行深度估计,基于分类器的粗糙深度信息提取可以克服这种不足,且可获得垂直的、离路面有一定高度的物体(如车辆等)的深度信息。在此基础上,配合摄像机参数和车辆尺寸的先验知识,可更有效地确定不同深度的车辆候选窗口大小。据此,预先确定了3个区域内车辆的像素大小范围,如表1所示。

表1 车辆像素尺寸范围

3 候选车辆生成策略

上一节中已将图像以超像素形式加以分割,并且从几何和深度的角度获得了图像相应的信息。接下来将通过这些信息的利用,首先筛选出符合车辆要求的超像素;其次,通过聚类算法将筛选出的超像素聚合成车辆可能存在的候选窗口。

选择策略主要依据如下先验知识:

(1)垂直约束,可能是车辆的超像素应存在于或邻近于垂直平面;

(2)地面约束,所有可能存在车辆的超像素区域必须和地面相连接;

(3)深度约束,所有属于同一深度的超像素方能聚为一类;

(4)尺寸约束,可能是车辆的超像素大小须和车辆在图像中的像素尺寸相一致。

在该选择策略的基础上,本文中有针对性地提出一种分层聚类的方法,将筛选出的超像素组合成若干个可能是车辆的区域。该聚类算法也是本文的创新点之一,具体算法如下。

(1)从任一类属于垂直类的超像素M开始,M须满足其到地面距离小于一定的阈值。N为M附近一定区域内属于垂直类的超像素集合。

(2)设m∈M,n∈N,找出欧氏距离d(m,n)最小的一组超像素对m,n。

(3)若m,n满足m,n都在同样的深度范围内,且m∪n的尺寸在一定的范围内,则m,n构成一个新的超像素m=m∪n。

(4)从N中移除n。

(5)若m满足表1所示车辆像素尺寸范围的约束,则跳转到步骤2,否则从M中随机选取一个新的m,再跳转至步骤2。

通过该分层聚类方法,将最终确定可能属于车辆的超像素组用相应的候选窗口区域覆盖,即确定了侯选车辆。图2为该聚类方法的一个实例。图2(a)为某个待处理区域的原始图像,图2(b)~图2(e)为采用候选车辆生成策略由超像素聚类成一个候选车辆的具体过程。

智能变电站应实现的高级应用功能包括:设备状态监测、基于多信息融合技术的综合故障诊断、防误功能扩展应用、智能告警及事故信息综合分析决策、智能操作票系统等。这些高级功能的开发及应用对公司来说既是一次挑战,也是一次机遇。

4 实验分析与比较

本节通过实验验证本算法中候选车辆生成的效果,并将本方法和已有流行的候选车辆生成方法进行比较。

4.1 实验数据准备

测试数据库部分来自PETS2001公开数据库,部分来自项目组试验车的摄像机在以沪宁高速为主的高速公路上所拍摄的道路行车视频片段。所有视频图片大小均为640×480,共选出3 463幅图片,其中共有6 297辆车辆。

4.2 评价指标

候选车辆生成的目的在于用低耗时的算法产生有效且尽可能少的有效候选目标。在候选目标中要求能够包含最多的正目标和最少的负目标。因此,本文中通过如下两个指标进行评价。

(1)生成的候选车辆总数VCN(vehicle candidates numbers)。

VCN=TP+FP

(2)正确的候选车辆占所有车辆的比率CCR(correctcandidatesrate)。

式中:TP为正确的候选车辆数目(候选窗口内确实存在车辆);FP为错误的候选车辆数目(候选窗口内不存在车辆);FN为未被选出的车辆数目(未被候选窗口标出的车辆)。

4.3 效果评估与分析

采用同样的测试图片,将本文方法与文献[7]中采用滑动窗口的候选车辆生成方法、文献[8]中采用基于地平面假设的候选车辆生成方法和文献[9]中的基于对称性及边缘特征等先验知识的车辆候选方法进行了比较,结果如表2所示。

表2 各主流方法比较

由表可见:密集的滑动窗口法几乎能够选出所有车辆,但这是建立在几乎穷举所有图像子窗口的基础上的,生成的候选车辆数量庞大,使下一步车辆验证完全无法满足车辆检测实时性的要求;稀疏的滑动窗口法减少了一半的VCN,但是CCR也降低了1%;地平面假设法大大降低了VCN,但是CCR相比稀疏滑动窗口法降低了2%;利用先验知识的方法虽然生成了最少的VCN,但代价是CCR降低至95%以下,出现了较多的漏检,使得后期车辆检测的性能下降较多;本文方法仅生成了不到稀疏的滑动窗口法1%的VCN,但CCR达到了与其极为接近的水平。图3中给出了本算法的部分图片处理结果。其中,图3(a)为原图,图3(b)为从原图中提取出的天空和垂直平面、地平面的几何信息图,图3(c)为利用分类器获得的深度信息图,而图3(d)为最终的候选车辆生成图。图3(a)和图3(b)来自PETS2001图库,图3(c)和图3(d)来自沪宁高速镇江至南京段采集的实际道路视频中所提取的图片。

本文中实验平台为惠普工作站,其主要参数为Intel酷睿2双核2.67G处理器,2G内存,操作系统为Windows XP,编程软件为Microsoft Visual 6.0。在该平台下,在未经过算法和硬件优化的情况下,处理一幅像素大小为640×480的图片,耗时约为18.3ms。考虑到本文方法可以减少90%以上后期CV阶段须处理的窗口数,因此可以认为本文方法能够满足车辆检测系统实时性的要求。

5 结论

本文中提出了一种新颖的基于单目视觉,用于道路车辆检测中的候选车辆提取算法。该算法通过图像几何信息和深度信息的提取,利用这两种中间层次的信息,并以此对超像素图像采用一种分层聚类策略,有效地提取出候选车辆。算法的评估和分析结果表明,该方法在大大减少候选车辆数量的基础上,能够选取出98%以上的车辆,既能缩短下一阶段车辆验证算法的计算时间,又能避免车辆的漏检。

在下一步的工作中,将对该算法在多种天气和光照环境下进行系统的效果测试和分析,并在此基础上进行改进并集成到实际车辆检测系统中。

[1] Gehrig S, Stein F. Collision Avoidance for Vehicle-Following Systems[J]. IEEE Transaction on Intelligent Transportation Systems,2007,8: 233-244.

[2] Giseok K, Jae-soo C. Vision-based Vehicle Detection and Inter-vehicle Distance Estimation[C].12th International Conference on Control, Automation and System, 2012: 625-629.

[3] Lan J, Zhang M. A New Vehicle Detection Algorithm for Real-time Image Processing System[C].2010 International Conference on Computer Application and System Modeling, 2010: 1-4.

[4] Acunzo D, Zhu Y, Xie B. Context-adaptive Approach for Vehicle Detection Under Varying Lighting Conditions[C].IEEE International Conference on Intelligent Transportation Systems Conference, 2007: 654-660.

[5] Lili H. Roadside Camera Calibration and Its Application in Length-based Vehicle Classification[C].2nd International Asia Conference on Informatics in Control, Automation and Robotics (CAR),2010, 2: 329-332.

[6] 陈涛, 谭华春, 冯广东,等. 运动车辆检测的APG-TR算法[J]. 交通运输工程学报, 2012, 12(4): 100-106.

[7] Sun Z, Bebis G, Miller R.On-road Vehicle Detection Using Evolutionary Gabor Filter Optimization[J]. IEEE Transactions on Intelligent Transportation System, 2005, 6(2):125-137.

[8] Kim Giseok, Cho Jae-Soo. Vision-based Vehicle Detection and Inter-Vehicle Distance Estimation[C].2012 12th International Conference on Control, Automation and Systems, Jeju Island, Korea, 2012, 1:625-629.

[9] Wang H, Zhang W, Cai Y. Design of a Road Vehicle Detection System Based on Monocular Vision[J]. Journal of Southeast University (English Edition), 2011, 27(2): 169-173.

[10] Felzenszwalb P, Huttenlocher D. Efficient Graph-based Image Segmentation[J]. International Journal of Computer Vision, 2004, 59(2): 167-181.

[11] He X, Zemel R, Ray D. Learning and Incorporating Top-down Cues in Image Segmentation[C].Proceedings of 9th European Conference on Computer Vision, Lecture Notes in Computer Science, London: Springer London Ltd, 2006: 338-351.

[12] Tighe J, Lazebnik S. Superparsing: Scalable Nonparametric Image Parsing with Superpixels[C].Proceedings of Perspectives in Neural Computing, 2010: 352-365.

[13] Fulkerson B, Vedaldi A, Soatto S. Class Segmentation and Object Localization with Superpixel Neighborhoods[C].Proceedings of the International Conference on Computer Vision, IEEE Computer Society, 2009: 670-677.

[14] Hoiem D, Efros A, Hebert M. Recovering Surface Layout from an Image[J]. International Journal of Computer Vision, 2007, 75(1): 151-172.

[15] Saxena A, Sun M, Ng A. Make3D: Learning 3D Scene Structure from a Single Still Image[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2009, 31(5): 824-840.

[16] Liu B, Gould S, Koller D. Single Image Depth Estimation from Predicted Semantic Labels[C].IEEE Conference on Computer Vision and Pattern Recognition, 2010: 1253-1260.

[17] Chih-Chung C, Chih-Jen L. LIBSVM: a Library for Support Vector Machines[J]. ACM Transactions on Intelligent Systems and Technology, 2011,2(27):1-27.

Vehicle Candidate Generation Based on Geometry and Coarse Depth Information

Wang Hai1,Cai Yingfeng1,Lin Guoyu2& Zhang Weigong2

1.SchoolofAutomotiveandTrafficEngineering,JiangsuUniversity,Zhenjiang212013;2.SchoolofInstrumentScienceandEngineering,SoutheastUniversity,Nanjing210096

Monocular vision based vehicle identification are often divided into two steps: candidate generation (CG) and candidate validation (CV). Traditional CG procedure adopting ergodic approach often generates a large amount of candidate windows, which dramatically increase the calculation time in CV phase and hence is hard to meet the real-time requirements of practical application. In this paper a novel vehicle candidate generation method is proposed based on geometry and depth information, which can greatly reduce the number of candidate windows generated. With the method, firstly images are divided into super pixel regions, and the geometry information and coarse depth information of images are obtained with pre-trained Adaboost classifier. Then by using the prior knowledge of vehicles (verticality, location and size) in global coordinate system, a hierarchical clustering strategy is adopted to merge the vehicle super pixel blocks in images and generate vehicle candidates. The results of comparison with traditional algorithms show that the method proposed achieves a great reduction in the number of candidate windows with a cost of minor drop in detection rate.

vehicle detection; monocular vision; vehicle candidate generation; super pixels

*国家自然科学基金(61403172、51305167和61203244)、交通运输部信息化项目(2013364836900)、中国博士后基金(2014M561592)、江苏省六大人才高峰项目(2014-DZXX-040)、江苏省自然科学基金(BK20140555)、江苏省博士后基金(1402097C)和江苏大学高级专业人才科研启动基金(12JDG010和14JDG028)资助。

原稿收到日期为2013年8月5日,修改稿收到日期为2013年12月2日。