亮度优化立体视频视觉舒适度评价

2015-02-22王晓燕王世刚姜秀红赵晓琳

王晓燕,王世刚,姜秀红,赵晓琳

(吉林大学 通信工程学院,吉林 长春 130012)

亮度优化立体视频视觉舒适度评价

王晓燕,王世刚*,姜秀红,赵晓琳

(吉林大学 通信工程学院,吉林 长春 130012)

摘要:结合立体视频帧左右视图的灰度图,采用鲁棒性算法与软剪刀算法相结合的“画笔”方案来提取立体视频帧的前景区域,合成视差图并提取水平视差,计算深度视差;根据主观评价结果建立视差深度—视觉舒适度模型,再结合亮度对视觉舒适度的评价模型进行优化,使模型的评分更接近人类视觉系统的评分;结合人类主观评价实验的结果,用逆向代入法求出模型的系数确定模型,最终实现基于人类视觉系统特性的对立体视频视觉舒适度的评价。实验结果表明:通过视觉舒适度模型计算得到的结果与人类主观评价结果之间的误差率不超过5%,其中大部分视频误差率不超过1%。说明评价模型更符合人类主观感知结果的立体视频视觉舒适度,模型评分更接近人类视觉系统特性的主观实验评分,这为立体视频舒适度的评价提供了参考。

关键词:立体视频;视觉舒适度;亮度;深度视差

1引言

随着多媒体技术和互联网技术的迅速发展,3D立体视频技术正在不断地趋于成熟,与传统的普通视频相比,它可以清晰地重现客观世界的景象信息,突出场景的层次感和景象的真实性,使观众获得更加强烈的临场感和视觉冲击,越来越多的3D视频应用正在改变着人们的生活[1-4]。2012年,我国立体视频电视试验频道开播,这将我国立体视频的产业带入了一个全新的发展阶段。频道开播三年多,通过各界多方参与,积累了诸多宝贵经验,为我国探索发展3D电视业务,提升我国电视发展水平发挥了重要作用。与此同时,3D电视产业经过多年的发展,仍然受到节目内容、运营模式、人才储备、技术标准、技术应用等诸多问题的影响与制约,尚未形成良性的产业链条。当前,中国的立体视频源产业正处于发展的重要阶段,如何才能促进我国3D电视产业进行持续而健康的发展,已经成为立体视频行业关注的重要问题。但是由于立体视频技术自身的不完善性以及对观影环境的要求苛刻,导致了人们在观看立体视频时经常会出现一些视觉不适症状,如头晕、眼花,严重时甚至会感觉恶心,导致呕吐等症状[5]。

对立体视频视觉舒适度的研究已经有将近20年的历史,通过对立体图像进行的大量主观评价实验,结合所得实验结果,得出了以下结论:引起人眼视觉不舒适的原因有很多,其中包括图像的亮度、饱和度、色度等,而且如果图像中对象的深度视差过大也会导致立体视频的视觉舒适度下降。国外学者也对影响立体图像舒适度的各种诱因进行了探索[6-9],其中Kooi通过实验对有可能造成双目立体图像舒适度的影响因素进行了系统的研究[10],其中包括对视差、亮度、色度、对比度、串扰等的研究。

国内学者李小方证实了亮度和颜色差异过大的左右视图会在人眼中产生不匹配的视差图像[2]。天津大学杨蕾定性研究了影响双目立体成像系统显示效果的四种因素,即亮度、色度、对比度和分辨率[3]。

国际标准化组织 ISO 于2000年发布了IWA3:Image safety,该份文件关于立体图像/视频的相关安全性明确阐述了当视图纹理特性差异过大,视觉生理健康会受到较为严重的影响,长久积累将会出现相关的并发症状,该标准还涉及包括观看、内容制作、显示设备制造等3D产业的各个环节[11],为了实现保证观影者获得较好视觉观测体验,应该保证立体显示技术的各个环节都是基于该标准完成实施的,这是保证最佳观影效果的基本要求。

观看立体视频的视觉舒适度已经直接关系到了观影者的生理健康,这是制约立体产品发展的一个主要因素,这一观点正逐渐被立体视频用户广泛认同。而立体视频是由一幅一幅的图像组成,所以对图像视觉舒适度评价是对立体视频视觉舒适度评价的基础[12]。到目前为止,国际上对立体视频视觉舒适度的评价暂时还没有制定统一的标准,因此,研究立体视频视觉舒适度的影响因素显得尤为重要,而如何建立一个基于人类视觉系统的立体视频视觉舒适度评价模型具有重要的意义。

2主观实验评价准备

2.1 主观实验设备标定

本次实验是在NVIDIA 3D Vision显示平台下进行的,其中放映设备采用Sony VPL-HW30ES立体视频投影仪。该投影仪较为广泛地应用于家庭影院播放、视频质量观测、医疗景象分析等领域,可以快捷地完成立体视频的播放工作,且具有立体成像效果显著、色彩逼真、清晰度高,层次感强等优点。

2.2 实验人员标定

对于观测人员的选用,为了保证其观测结果的合理性与有效性,需要对一系列影响因素予以限定以保证实验可以正常进行,其中包括年龄、性别、视力、有无视觉方面的生理疾病、有无观测立体视频的经验等[11]。这里根据是否具有立体视频主观评价经验对观测者予以区分,其中有观测经验的专家被试者可以在全面感受画质的同时,利用心里尺度准确地对视频进行主观评价,而非专家被试者由于缺少相关经验,需要事先安排一系列的培训,以保证可以得到较为合理准确的评判结果。

本次实验选用双目视觉以及生理正常的观测人员,其中视觉正常包括:裸视或佩戴眼镜矫正视力达到1.0,并且观测人员没有对实验结果产生影响的视觉方面生理疾病。被试者共20人(有立体视频观测经验,佩戴主动快门式眼镜无不良反应且能够正确透彻地理解评判标准,评分过程中不带有主观倾向性的专业人士作为观测者),年龄为20~35岁,其中男性12人,女性8人;有观测经验的专家被试者10人,培训后有观测经验的非专家被试者10人[11]。

2.3 实验片源及场景的标定

在观测过程中,立体屏幕摆放高度设定为1.2 m,经测试发现,观测者在距离3倍屏幕高度的位置处[10],可以获得较好的立体观测效果,且不易产生视觉不舒适的感觉。所以本次实验让观测者坐在距离立体屏幕3.6 m处完成对立体视频的观看。实验中播放的立体视频序列采用国际视频组织发布的标准视频序列,以保证实验结果具备普遍适用性,且设定播放间隔为20 s,防止观测者长时间观看视频产生主观因素的误差。

瞳孔可以根据外界入射光的强弱调节其自身大小,使映射到视网膜上的光通量尽可能适中[13]。在不同的亮度环境下,人眼对于同一实际亮度所产生的相对亮度感觉是存在差异的,同时人眼在弱光环境下对亮度信息的感知更为敏感,所以本实验采用全遮光式实验环境,以保证外界亮度环境一致,也使实验更具准确性。

2.4 主观评分标准

依据ITU(International Telecommunication Union)对电视视频质量主观评价推荐的准则[14],可将立体图像舒适度评分归为分5个等级,本实验为了提高实验数据的准确性,采取百分制打分,然后将分数按比例规范化为5分制,这样可使评分的精度达到0.1,并且4分以下数据为不可用数据,将其排除。具体舒适等级描述以及评分标准由表1给出。

表1 舒适度等级描述以及评分标准

3系统模型的建立

3.1 立体成像的原理

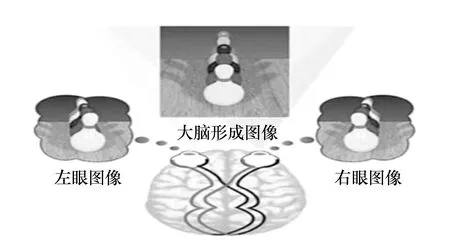

人们之所以能看到立体图像,是因为立体图像是由视差图构成。所谓视差图,是由两个具有同样参数的相机按照一定距离进行放置,同时对同一场景进行拍摄得到的,这样的两幅图像叫做视差图。在具备一定条件时,人眼只能接受一定范围内的视差,这一范围为人眼的融合范围。左右视图中存在差异的图像纹理在大脑皮层中被融合起来,形成中央眼视图中稳定存在的部分,如图1所示。观看平面视频时左右眼的图像完全相同,双目图像自然地被融合起来,双目对不同视觉信号的融合作用处于限制状态;而观看立体视频时,左右视图存在的某些较弱的差异能够在双目融合和双目抑制的作用下被弱化甚至被掩蔽。

图1 左右眼图像经视觉系统融合后形成“中央眼”图像的示意图 Fig.1 Cyclopean eye with binocular fusion and binocular suppression

在人们生活的世界中,视觉辐辏效应与视觉焦点调节是一致的。在观看立体图像时,若视差图的视差大小在视觉融合范围内,虽然辐辏和焦点调节不一致,大脑仍可以把视差图自动融合成一幅立体图像,所以在立体显示器上能看到一幅具有深度感的立体图像,如图2所示。

图2 视差的大小在融合范围内 Fig.2 Binocular fusion

但是,如果视差图的视差大小不在人眼融合范围内,人们就无法将视差图自动融合成一幅立体图像,看到的就是一幅不清晰的串扰图像,从而产生严重视疲劳,如图3所示。

图3 视差的大小在融合范围外 Fig.3 Binocular suppression

3.2 前景区域提取

所谓前景,即为“距离观察者近的部分”,或为镜头中位于前沿或靠近前沿的主体,一般为人或物。对于一幅图像中的前景区域与背景区域两个相邻区域的边缘来说,前景区域边缘往往有明确的形状,而背景区域与前景区域相邻的边缘一般没有明确的形状,好像是被前景遮掩了。除此之外,前景区域看起来比背景区域更接近观看者,这个过程是人类感知的过程,称之为前景区域与背景区域的感知。

首先,选取进行实验的四段视频序列中任意帧左、右两幅匹配视图,求出其标准视差图,然后用GBVS显著性检测算法对图像进行显著性区域提取。该方法利用标准技术从一幅图像中提取出一系列的特性,如强度、方向、颜色和对比度等以形成低阶特征图,然后定义在不同特征图谱下的马尔科夫链,然后将图像上均衡分布的区域作为活动的和显著性区域。

然后,通过自己的双眼去确定通过计算机对显著性区域(前景区域)进行的估计与基于人类视觉系统对人类感知到的前进区域是否一致。下一步,对前景区域进行提取,这是唯一需要用户输入的步骤。为了可以尽快提取到前景区域,又减少工作量,这一步采用鲁棒性前景提取算法与软剪刀方法相结合的前景提取方法,称为“画笔”方案。在这一方案中,只需在图像的前景区域部分用鼠标随意画几笔,每画一笔,系统就会根据画笔痕迹把属于前景区域的部分找出来;再在图像的背景区域部分画几笔,每画一笔,系统会自动把属于背景的区域的部分找出来,然后进行大片的背景区域删除。

图4 前景区域提取 Fig.4 Extracting of foreground image

3.3 前景区域深度视差

视差分为交叉视差(即负视差、凸出于屏幕)和非交叉视差(即正视差、凹进于屏幕),交叉视差时水平视差为负,非交叉视差时水平视差为正,为了计算方便,文中的ds为水平视差的绝对值。

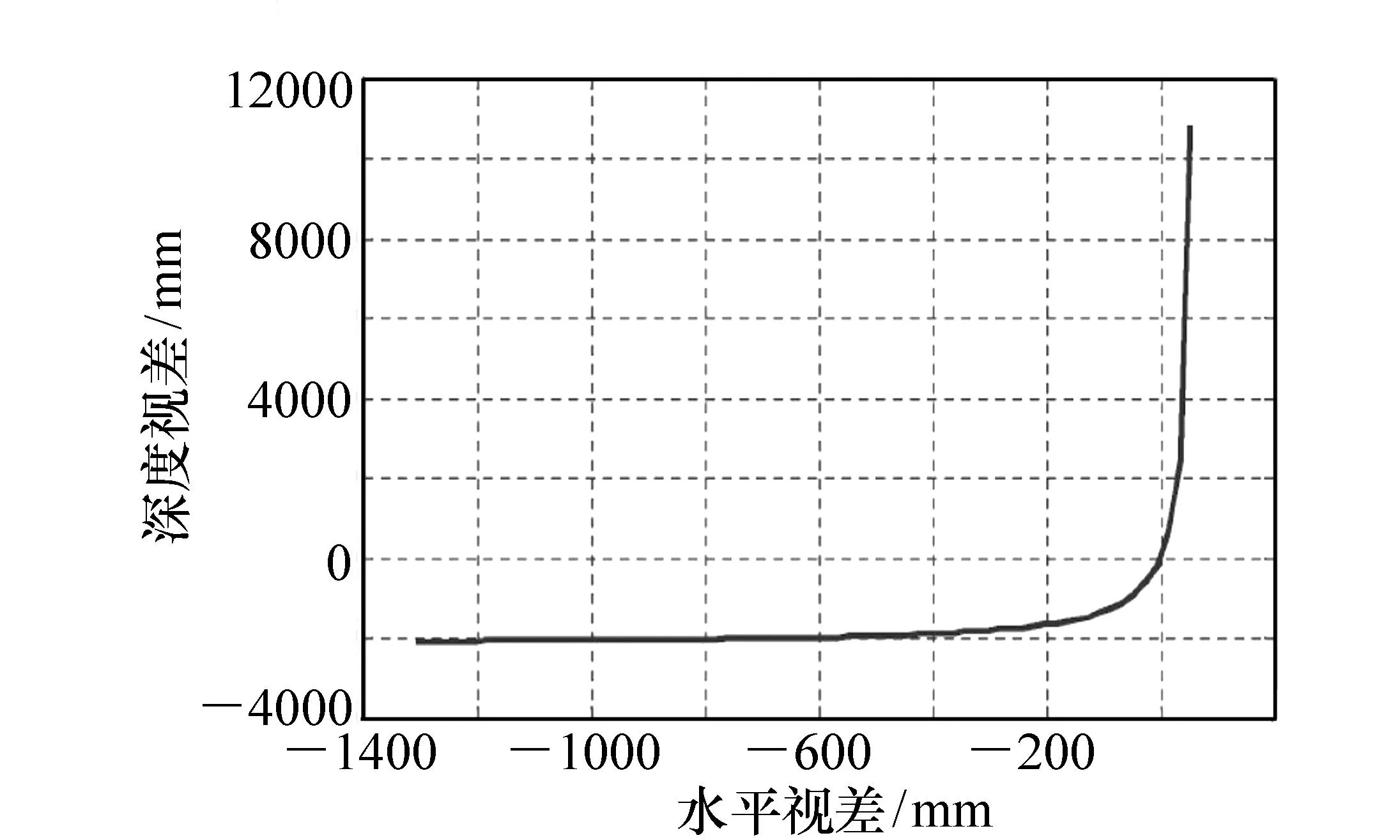

如图4实验数据所示,水平屏幕视差ds与感知深度d的关系是非线性的,当水平屏幕时差ds趋于W(屏幕宽度)时,曲线变得平直;当水平屏幕视差趋于s(两眼视距)时,曲线值急升,这可能导致错误的观众感知深度,但可以看出当水平屏幕视差ds趋近于0附近时,曲线可近似化为线性。文中视频均为国际视频组织发布的标准序列,水平视差趋近于0,所以可以将水平视差与深度视差近似看作线性关系。

图5 深度感知与水平视差的关系 Fig.5 Relationship between ds and d

(1)

式中:L为实验场景中观测者与屏幕间的观测距离(为屏幕高度H的3倍),s为两眼视距(为65 mm),在忽略掉垂直视差的情况下,ds为视差图的水平视差绝对值。

3.4 前景区域亮度

亮度是指图片的明暗程度,是颜色性质的一种。在Lab色彩空间中,亮度是人类主观明亮感觉的一种反映。根据人眼视觉机制,人眼感知的主观亮度和实际的客观亮度并非完全相同,但是有一定的对应关系。

人眼能够感觉的亮度范围极宽,从千分之几尼特到几百万尼特。通常,人类视觉能分辨的图像灰度等级约为26,灰度级分为0~255共256级,本文用图像的灰度级来表示图像的亮度。实验使用MATLAB 2010a处理前景区域图像,将选取进行实验的四段视频序列中任意帧左、右两幅匹配视差图的前景区域进行从RGB颜色空间到YUV颜色空间的转换,然后分别提取出左右视图中前景与背景区域的图像亮度。

3.5 立体视频舒适度的评价模型的建立

首先将主观评价的实验结果填入纵坐标为人类主观评价得分MOS、横坐标为立体对象凸出或凹入屏幕的视差深度d的坐标系中,将标注点连成光滑曲线,得到对应的函数。将坐标系中光滑曲线上的观测点所对应的当前帧左、右两幅匹配视图,求出其标准视差图,再用软剪刀方法和鲁棒性前景提取方法相结合的方法分别处理左、右视图,得到各自的前景区域和背景区域。

将前景区域进行分割、提取,计算出视差深度d,再对前景区域与背景区域分别进行亮度信息提取,得到前景区域亮度l1,背景亮度l2。定义纵坐标为人类主观评价得分MOS与对应函数vc值的差值δ,横坐标分别为前景区域亮度与背景区域亮度的坐标系,将标注点连成光滑曲线,得到相应的函数。根据视觉深度d与人类视觉系统特性的函数的关系和通过亮度补偿对人类主观视觉评分影响的关系,得到立体视频视觉舒适度评分的数学表达式:

S=vc+E=a1d3+a2d2+a3d+

(2)

其中,

(3)

(4)

式中:S为综合视觉舒适度评分,vc为视觉舒适度评分,E为亮度补偿得分,a,b,c,σ为特征参数,d为视差深度,l1为前景区域的亮度,l2为背景区域的亮度;σ赋值为0.75,通过逆向代入法求出模型的系数分别求出a1、a2、a3、a4;b1、b2、b3;c1、c2、c3。从而实现对立体视频视觉舒适度进行自适应评价。

4实验数据及分析

舒适度评价模型评分由两部分组成,其中,vc是基于深度视差的视觉舒适度评分,从20名观测人员对11段国际标准视频序列评分中,随机选取其中4段视频的评分,分别求出20个评分结果的平均值作为vc值,确定其深度视差d后,通过逆向代入法求得a1、a2、a3、a4后的表达式为:

vc=103(5.7625d3-8.0670d2+

(5)

随机选取3段视频,将评分结果的vc平均值与用模型求得的vc值进行作差,得到的值作为E值,确定其前景区域的亮度l1后,用逆向代入法求得b1、b2、b3;同理,确定背景区域的亮度l2后 ,求得c1、c2、c3。求得亮度补偿数学表达式为:

(6)

通过逆向代入法求得的评价模型各个系数后,确定了本文的评价模型表达式为:

S=103(5.7625d3-8.0670d2+3.7510d-

(7)

为验证本文所提算法的有效性,实验选用11段国际视频组织提供的分辨率大小为320 pixel×240 pixel,帧刷新频率为30 frame/s,且未经压缩处理过的标准视频序列作为测试样本,每段视频序列时间控制在8~15 s之间,以方便利用舒适度模型进行计算,同时安排被测者对这11段立体视频序列进行主观评价,将评价结果记录下来,与舒适度模型求得的视觉舒适度S进行比较,并计算其误差率。以下视频序列均选自国际视频组织发布的标准序列,实验结果如表2所示。

表2 11段标准视频序列舒适度评价结果

对上表结果进行分析可以发现,利用本文所提出的视觉舒适度模型S计算出的舒适度评分结果与人类主观评价结果基本相同。还可以看出,通过视觉舒适度模型计算得到的S值与人类主观评价结果之间的误差率不超过5%,其中有8段误差率不超过1%。其中第8段视频的模型评分与主观评分差异较大,对其分析原因,可能是该段视频的清晰度较差,图像的分辨率较低等因素造成的,这对视觉舒适度模型的评分造成了一定的影响。实验结果能够很好地反映立体视频的舒适度,为立体视频舒适度的主客观评价提供了依据。

5结论

本文首先建立了视差深度—视觉舒适度模型,再结合亮度对视觉舒适度的评价模型进行优化,使模型的评分更接近人类视觉系统的评分;结合人类主观评价实验的结果,用逆向代入法求出模型的系数确定模型,最终实现基于人类视觉系统特性的对立体视频视觉舒适度的评价。本文在研究深度视差对舒适度评价影响的同时,又考虑了亮度因素对立体视频视觉舒适度的影响,对前人视觉舒适度评价模型进行了优化。本文也提出了用鲁棒性算法与软剪刀算法相结合的“画笔”方案来提取图像的前景区域,大大减少了工作量。实验结果表明,评价模型更符合人类主观感知结果的立体视频视觉舒适度,模型评分更接近人类视觉系统特性的主观实验评分。

参考文献:

[1]JIN L,BOEV A,GOTCHEV A,etal.. 3D-DCT based perceptual quality assessment of stereo video[C]. 2011 18th IEEE International Conference on Image Processing(ICIP),Brussels,Belgium,11-14 Sept.,2011.

[2]李小方,王琼华.自由立体显示器观看视疲劳[J].液晶与显示,2008,23(4):464-466.

LI X F,WANG Q H. Free stereoscopic display watch visual fatigue[J].ChineseJ.LiquidCrystalsandDisplays,2008,23(4):464-466 (in Chinese)

[3]杨蕾.多视点、静止立体图像处理的理论分析及实验研究[D].天津:天津大学,2007:125-127.

YANG L. Theoretical analysis and experimental research on still multi-view auto-stereo image processing[D]. Tianjin:Tianjin University,2007:125-127.(in Chinese)

[4]LI J,BARKOWSKY M,LE CALLET P. The influence of relative disparity and planar motion velocity on visual discomfort of stereoscopic videos[C]. 2011 Third International Workshop on Quality of Multimedia Experience (QoMEX),Mechelen,Belgium,7-9 Sept.,2011.

[5]王小雨,王世刚,吕源治.基于特征区域分割的立体视频视觉舒适度评价方法[J].光电子技术,2014(2):87-90.

WANG X Y,WANG SH G,LV Y ZH. Evaluation of visual comfort for stereoscopic video based on region segmentation[J].PhotoElectronicTechnique,2014(2):87-90.(in Chinese)

[6]WANG X Y,WANG S G. Evaluation of visual comfort for stereoscopic video based on region segmentation[C]. Proceedings of 3rd International Conference on Multimedia Technology (ICMT-13),Guangzhou,China,Dec. 2013:805-813.

[7]臧艳军,李素梅,卫津津,等.影响立体图像舒适度的亮度范围测定[J].电子测量技术,2012(2):59-64.

ZANG Y J,LI S M,WEI J J,etal.. Affect the brightness of the stereoscopic image comfort range measurement[J].ElectronicMeasurementTechnology,2012(2):59-64.(in Chinese)

[8]DE SILVA D V S X,FERNANDO W A C,WORRALL S T,etal.. Just noticeable difference in depth model for stereoscopic 3D displays[C]. 2010 IEEE International Conference on Multimedia and Expo(ICME),Suntec City,Singapore,19-23 July 2010.

[9]ROGMANS S,DUMONT M,LAFRUIT G,etal.. Biological-aware stereoscopic rendering in free viewpoint technology using GPU computing[C].3DTV-Conference: The True Vision - Capture,Transmission and Display of 3D Video (3DTV-CON),Tampere,Finland,7-9,June 2010.

[10]KOOI F L,TOET A. Visual comfort of binocular and 3D displays[J].Display,2004,25(2-3):99-108.

[11]ISO IWA3. Image safety: Reducing the incidence of undesirable biomedical effects caused by visual image sequences[S]. Recommendation,2005.

[12]MAALOUF A,LARABI M C. CYCLOP:A stereo color image quality assessment metric[C]. 2011 IEEE International Conference on Acoustics,Speech and Signal Processing(ICASSP),Prague,Czech Republic,22-27 May,2011.

[13]KIM D,SOHN K. Visual fatigue prediction for stereoscopic image[J].IEEE,2011,21(2):231-236.

[14]ITU. Methodology for the subjective assessment of the quality of television pictures[S]. Recommendation BT 500-11,2002.

王晓燕(1988—),女,山东烟台人,硕士研究生,2011年于长春工业大学获得学士学位,主要从事图像视频方面的研究。E-mail:bingningyezi@163.com

王世刚(1961—),男,吉林长春人,教授,博士生导师,1983年于东北大学获得学士学位,1997年于吉林工业大学获得硕士学位,2001年于吉林大学获得博士学位,主要从事图像与视频信号智能处理方面的研究。E-mail:wangshigang@vip.sina.com

姜秀红(1990—),女,吉林松原人,硕士研究生,2013年于吉林大学获得学士学位,主要从事图像视频方面的研究。E-mail:251225458@qq.com

赵晓琳(1990—)女,山东聊城人,硕士研究生,2013年于吉林大学获得学士学位,主要从事图像视频方面的研究。E-mail:794601602@qq.com

Evaluation of stereo video visual comfort based on

luminance optimization

WANG Xiao-yan, WANG Shi-gang*, JIANG Xiu-hong, ZHAO Xiao-lin

(CollegeofCommunicationEngineering,JilinUniversity,Changchun130012,China)

Abstract:We extract the foreground region of stereoscopic video by combining the grayscales of left and right view, and synthesize the two pictures into a disparity map, then extract the horizontal parallax and calculate the depth parallax. Finally, we build the depth parallax-visual discomfort model on the basis of subject assessment and optimize the visual discomfort model by considering the luminance influence. Experimental results indicate that the error rate is less than 5% between calculated value and human subjective evaluation results, and most video error rates are less than 1%. The evaluation model is more accord with human subjective perception results and has good practicability, which provides a reference for the stereo video comfort evaluation.

Key words:stereoscopic video;visual comfort;luminance;depth parallax

作者简介:

*Corresponding author, E-mail:wangshigang@vip.sina.com

中图分类号:TP394.1; TH691.9

文献标识码:A

doi:10.3788/CO.20150803.0394

文章编号2095-1531(2015)03-0394-07

基金项目:教育部博士点基金资助项目(No.20120061110091)

收稿日期:2014-11-12;

修订日期:2015-01-18