面向车载监控视频的快速检索设计

2013-08-13李雨聪陈家新

李雨聪,陈家新

(河南科技大学电子信息工程学院,河南 洛阳 471023)

责任编辑:任健男

当前,对于装载有重要物品的特殊车辆(如油罐车、押款车或军用车等),使用视频监控已成为保障装载物和车辆本身安全的重要手段。随着监控网络规模不断扩大,视频数据呈现海量增长趋势,视频调用查看所耗人力、时间也成倍增长。如何从海量视频信息中获取感兴趣的视频片段,已成为影响网络视频监控性能的一个主要瓶颈。为此,视频检索技术的出现能够很好地解决这一问题。

所谓视频检索技术就是从大量的视频数据中找到所需的视频片段。传统的基于关键字的视频检索方式已无法满足人们对信息检索的高效性和准确性需求。因此,必须根据视频的时间及空间结构,更为合理地组织数据,才能有效地检索视频信息。针对以上问题,专家们提出了一种基于内容的视频检索技术[1](Content-Based Video Retrieval,CBVR),并迅速成为国内外学者研究的热点。在基于内容的视频检索中[2],一般先将图像序列分割为镜头,从镜头中提取关键帧;再提取出镜头的动态特征与关键帧的静态特征并存入数据库;最后,根据这些特征索引对视频实现检索。

针对车载的监控视频,本文以基于内容的视频检索技术为基础,设计了一种包含自动检索和主动检索两种方式的视频快速检索方法,以满足不同用户的检索需求。

1 车载监控视频快速检索设计

本文所处理的视频数据是由固定于车厢外的摄像头所采集。无论车辆处于何种状态,摄像机和车辆之间始终处于一种相对静止状态,其他任何靠近该车辆的人或物均成为运动目标。只不过当车辆运行时,由于车辆颠簸(振动)或加速,视频监测图像会有抖动现象。另外,用户对视频的调用中,关注的重点是监控录像中有活动物体的画面,即“活动”视频片段,对监控录像中大量无活动物体的“静止”画面并不感兴趣。

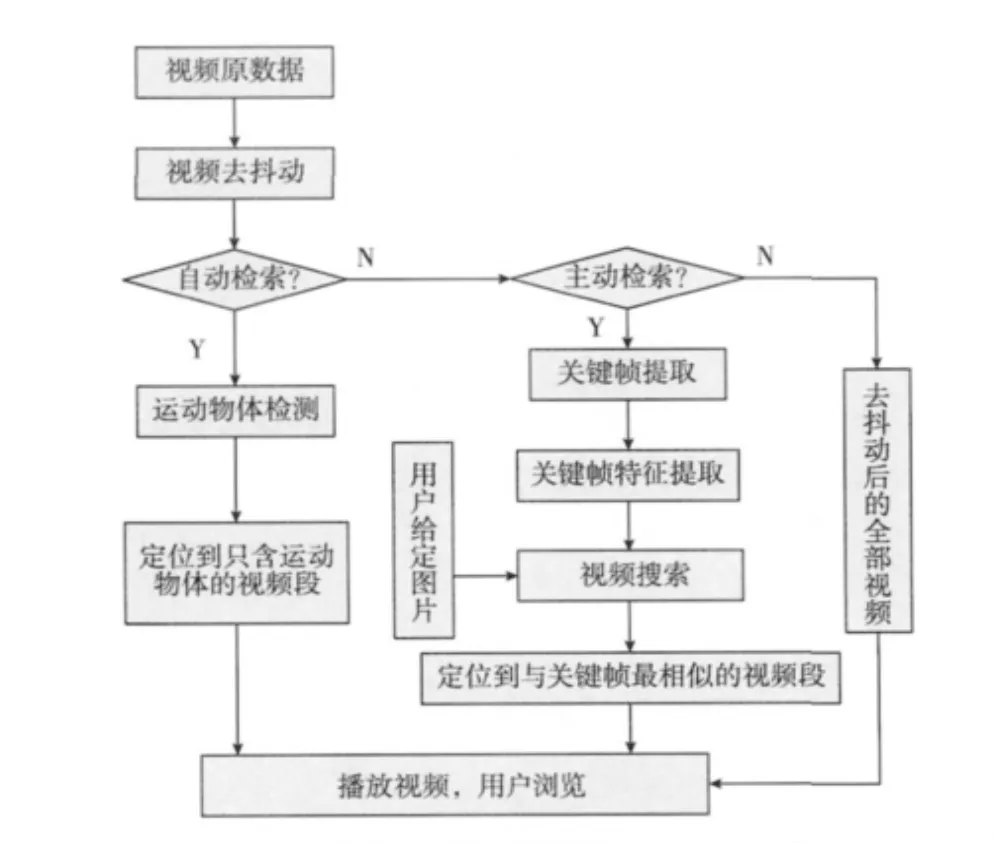

所以,针对车载监控视频存在抖动的特点和用户对视频检索的准确、高效要求,在检索之前,首先要对视频消除抖动,然后才能对稳像后的视频进行检索。视频检索中,自动检索方式是为了避开一些无大作用的视频画面,使用户不至于由于长时间浏览的疲劳而对一些细节运动视频漏失。实现时以检测出来的运动目标作为“活动”视频的“标记”,提取出只含有运动物体的视频段供一般的用户浏览。而主动检索方式是为了充分提高用户对车载监控视频浏览的效率和准确度,更有针对性地直接提取出用户所需要的视频片段(如为警察等特殊用户有针对性地快速检索出含有某嫌疑车或嫌疑人的视频片段)。该方式的实现首先要从视频中提取出关键帧,并对关键帧进行特征描述,用户可以通过人机交互给定的示例图片与提取出的关键帧进行相似度匹配。当取到相似度距离最小值时,为匹配成功。用户就可以从该关键帧处开始浏览视频。整个设计具体的实现过程如图1所示。

图1 监控视频快速检索方法实现过程

2 视频处理

2.1 快速消除视频抖动

消除视频抖动一般采用的方法中,特征匹配的方法[3]和光流的方法[4]运算量都太大,而块匹配的方法受限于对含有平移和微小旋转的图像序列具有较高的检测精度,但可采用两步搜索法、两维对数下降法等快速搜索算法来大幅度减少运算量[5]。考虑到车载摄像头紧固于车身上,在安装调试后参数固定不变,不存在大幅度旋转或调焦等运动。所以,本文采用改进的基于块匹配的算法消除视频抖动,从速度和效果上都能满足用户需求。

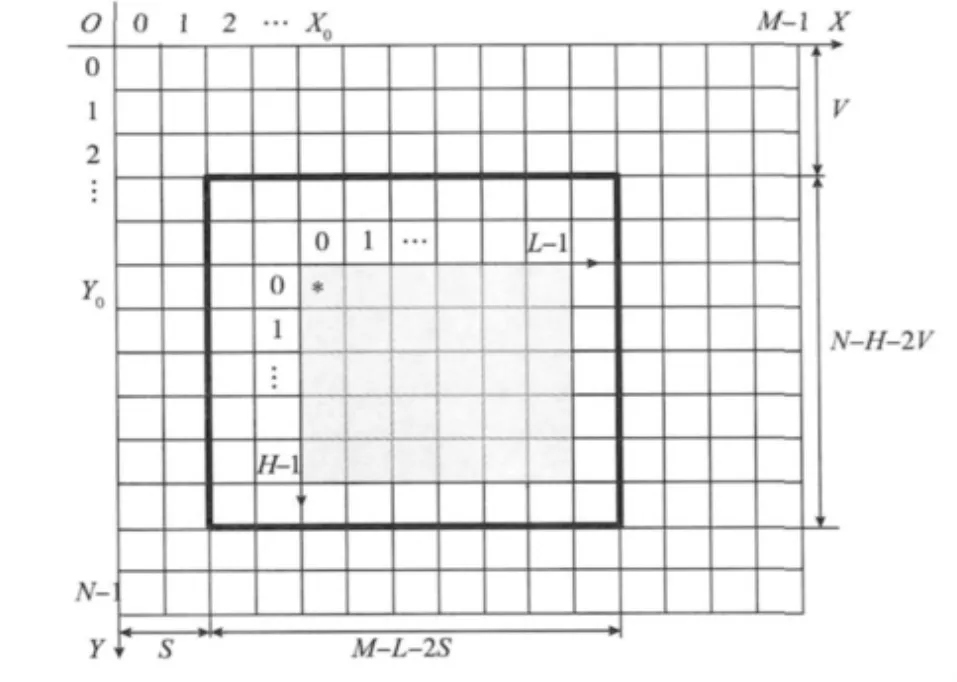

假设每帧图像水平、垂直方向像素数分别为M和N,如图2建立参考帧坐标系OXY,每个小方格为1个像素。在参考帧中选取一个特征明显又不会被遮挡的标示性物体作为匹配模板区域(如倒车镜),将其局部运动矢量直接作为全局运动矢量。图2阴影所示,划定出匹配模板区域,原点位于图2中“* ”处,坐标为(X0,Y0)。

图2 参考帧与匹配模板区域坐标系

根据实际情况,若水平、垂直抖动最大幅度分别为S和V像素。那么,划定模版匹配区域时就要先通过软件将模板匹配区域左上角原点限制在图2中黑色粗线框所示的矩形区域内。此矩形左上角坐标为(S,V),宽为(M -L-2S)像素,高为(N-H-2V)像素。

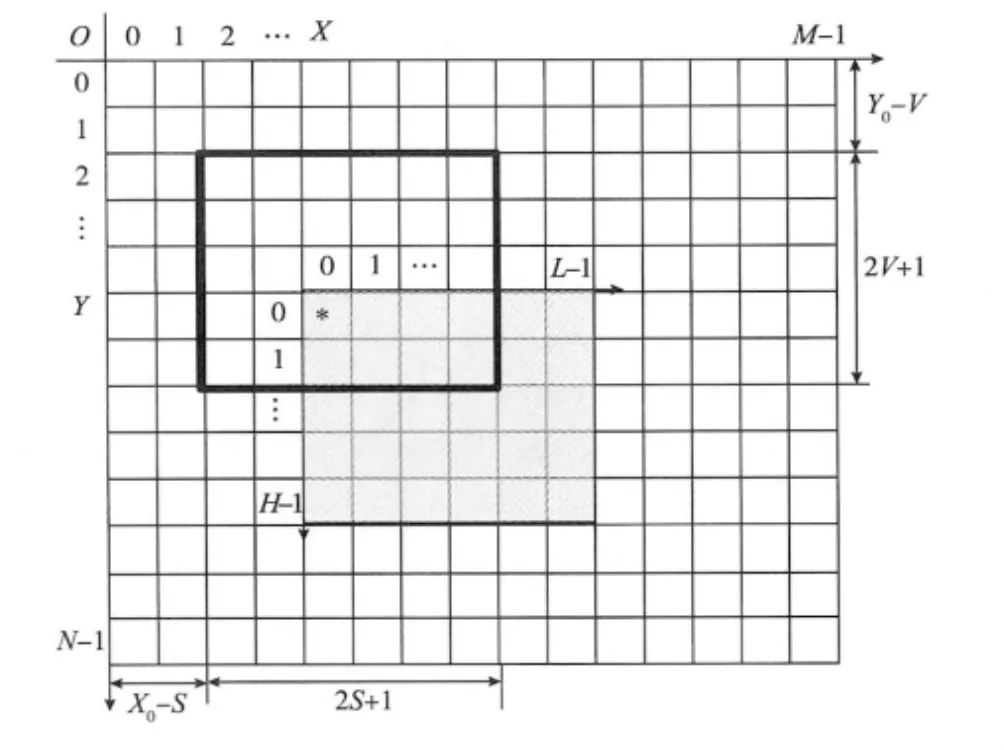

如图3所示,待匹配区域(图3阴影部分)尺寸与模版区域相同,左上角“*”所在像素在当前帧坐标系中的坐标为(X,Y)。图3中粗线框矩形为搜索范围,此矩形左上角坐标为(X0-S,Y0-V),宽为(2 S+1)像素,高为(V+1)像素。

图3 当前帧与待匹配区域坐标系

开始处理前设置偏移量(dx,dy)和运动趋势(kx,ky)的初始值分别为(0,0)和(+1,+1)。规定运动趋势kx和ky取+1时分别表示向右、向下运动,取-1时分别表示向左、向上运动。开始处理时,假设已求得上一帧中匹配模板区域的(dx,dy)和(kx,ky),搜索最佳匹配就按照以下步骤进行:

1)根据上一帧偏移量预测搜索起点。令第1个待匹配区域左上角在当前帧坐标系里的坐标(X,Y)满足X=X0+dx,Y=Y0+dy。然后使用绝对差值和求其与待匹配区域的相似度测量函数值D。

2)水平方向上的搜索。Y值不变。根据kx预测下一个待匹配区域的X,即令X=X+kx,重新计算测度函数值D。若D值不变大,说明搜索方向正确,则按kx规定的方向继续搜索,直到D值即将变大。若D值变大,说明搜索方向错误,则退回原位置,令kx= -kx,并根据新kx的方向搜索,直到D值即将变大。在搜索过程中若超出如图3中矩形粗线框所示的搜索范围则停止,认为搜索失败。

3)垂直方向上的搜索与步骤2)类似,只需将X,Y和kx分别换成Y,X和ky。

4)重复步骤2)和步骤3)直到X和Y不再改变。若重复次数超过给定值,认为搜索失败。

高速公路公司由收费站、服务区、排障大队等若干基层单位组成,负责人(站区长)身处一线,直接感知社会公众的满意度和职工群众的满意度,做好职工思想政治工作,服务经营管理,站区长是关键。

其中,步骤4)中的重复次数需根据软件的运行时间和处理效果来综合确定。若以上步骤搜索成功则继续以下处理:(1)由最后的X和Y求得当前帧的偏移量dx=X-X0和dy=Y-Y0,对当前帧进行平移消除抖动;(2)用最后的X和Y作为新的X0和Y0;(3)根据当前帧偏移量与上一帧偏移量的差别重新确定当前帧的运动趋势kx和ky;(4)利用最佳匹配处的待匹配区域定期更新匹配模板区域。若最佳匹配搜索失败则不再往下进行任何处理。

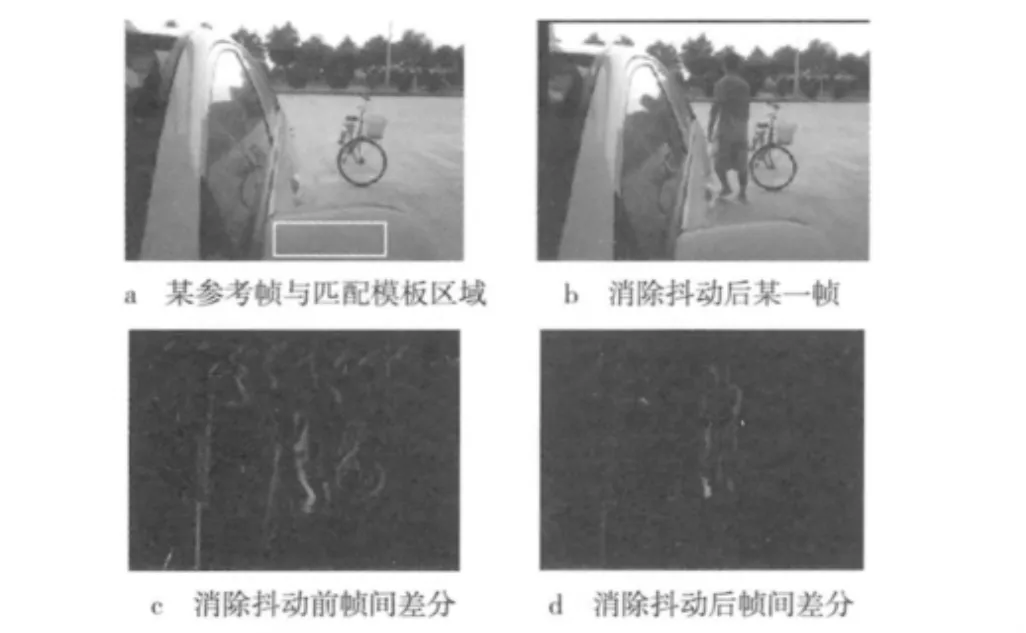

采用上述方法步骤,视频消除抖动的结果如图4所示。该段是车辆启动时有路人从车旁经过的视频,共306帧。图4a为参考帧,下方粗线矩形框为匹配模板区域,大小为110×35像素。图4b为消除抖动后有路人经过的某一帧图像,图中边缘黑色部分是图像平移的结果,水平方向移动了19像素,垂直方向移动了5像素。图4c为消除抖动前帧间差分结果,此时,静止的自行车也被作为移动物体检测出来。图4d为消除抖动后帧间差分结果,此时,静止的自行车已经看不到了,只有行人被检测出来。

图4 快速消除抖动的结果

本文用图像序列逼真度的评价标准对视频消除抖动的结果进行评定,评价参数是相邻图像间的峰值信噪比(Peak Signal to Noise Ratio,PSNR),单位为 dB。PSNR 值越大,两帧图像就越趋于相同。其中,消除图3中视频抖动耗时61 ms。抖动消除前参考帧与当前帧的PSNR值为33.740,抖动消除后 PSNR 值为38.068。消除抖动后,参考帧与当前帧的PSNR值明显大于消除抖动前。由此可知,该消除抖动方法的效果还是比较好的。

2.2 视频中运动物体检测

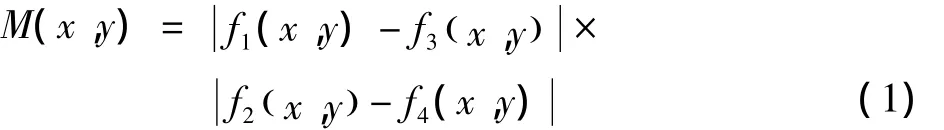

车载监控都发生在室外的变化环境中,视频受光照变化和自然场景(如树枝摆动、地面积水波纹等)中一些微小变化的影响,使得差分图像中存在很多“虚假”的运动目标。考虑到差分残留图像中必然存在运动目标的运动重叠区域,所以采用多帧差分相乘的方法使得差分图像中运动边缘的相关峰更加尖锐,再利用阈值,就能有效排除“虚假”运动物体的影响,正确测出运动物体的边缘轮廓。而且,一般情况下,相邻帧的背景只考虑平移变化量,只需简单计算出平移量就能实现配准。所以,综合实时性需要,本文采用相邻四帧配准图像差分相乘的方法检测运动物体,如式(1)所示

式中:f1(x,y),f2(x,y),f3(x,y),f4(x,y)分别为配准后的序列图像像素;M(x,y)为差分相乘图像的像素值。该检测方法具体的实现步骤如下:

1)将第1帧图像与第3帧图像配准,第2帧图像与第4帧图像配准。

2)将配准后的图像第1帧与第3帧做差分,第2帧与第4帧做差分,然后将2幅帧差图像相乘。

如图5所示,对车辆旁边检测出步行路人的结果。其中,图5e和图5f中检测出行人的同时还检测出该人物在车窗、车身上的模糊倒影,还有树枝微小的摆动等一些虚假运动目标,图5g显示出差分相乘后这些虚假运动目标被很好地去除。

图5 采用基于配准图像差分相乘的方法检测出运动目标

2.3 视频中关键帧提取

一般地,在一个长镜头中查找到能凸显出该段视频主要内容的图像帧作为关键帧。利用关键帧技术对视频数据库进行有效的快速查询、检索和浏览,可以大大减轻工作量。实际监控时,通常关注局部运动更多。因为局部运动表达的都是相对重要的物体或人物的运动,且能从中提取中很多更准确的视频内容。所以,针对车载监控视频镜头的移动性、内容的多样性,为避免冗余的同时能有效地选取到有代表性的关键帧,本文借鉴文献[6]中提出的基于粒子群的关键帧提取法,用全局运动特征与局部运动特征作为视频的整体特征,并关注局部运动更多。

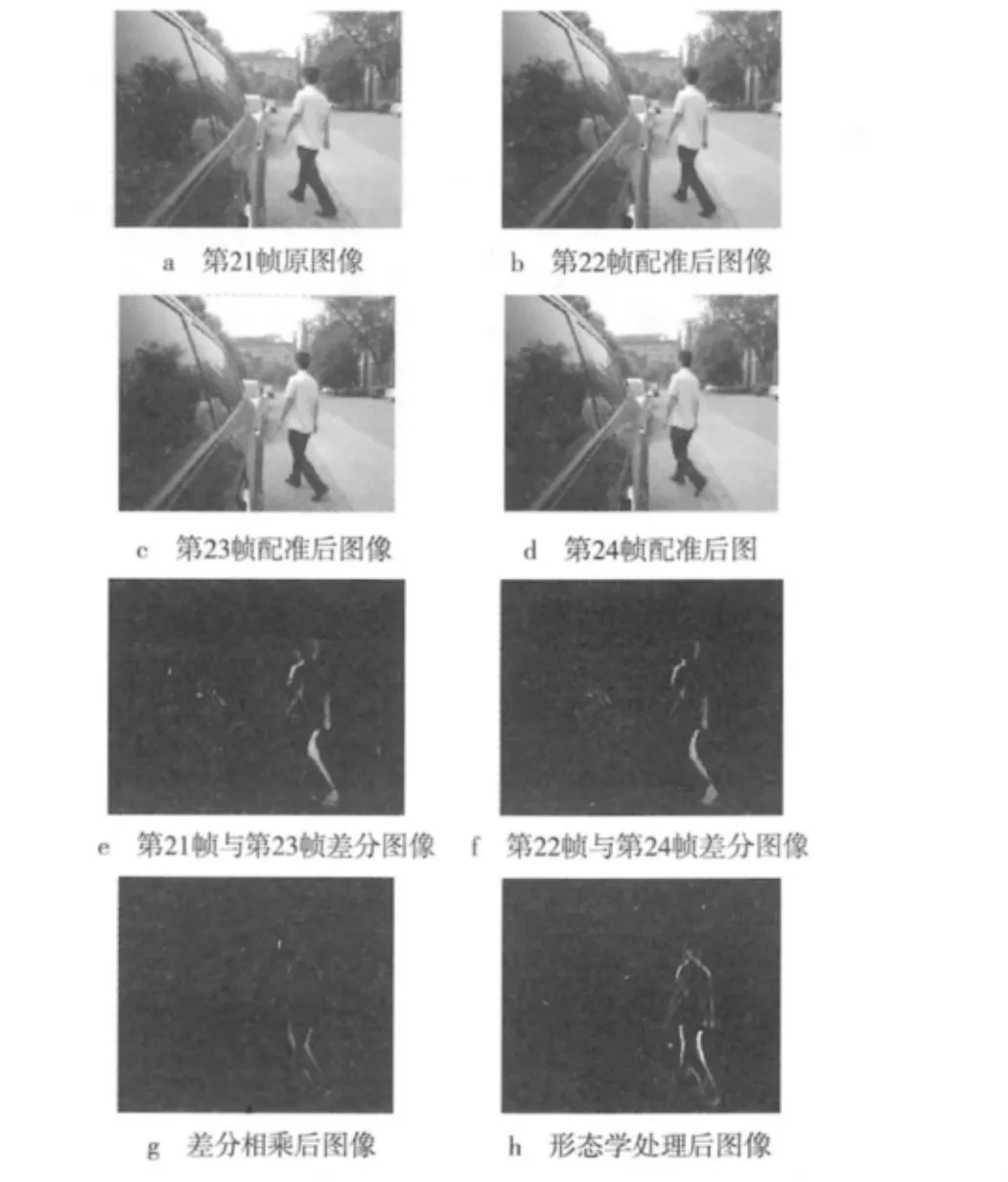

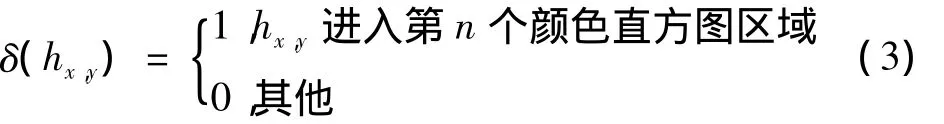

该方法首先提取出每帧的全局运动和局部运动特征,然后通过粒子群算法自适应地提取出关键帧。提取效果如图6所示。其中,图6a是某一时刻只有一个行人从车旁路过的段视频,共48帧,提取出1个关键帧,结果反映出该段视频的主要变化内容;图6b、图6c、图6d是另外某一时刻若干行人在车旁路过的视频段,共97帧,提取出3个关键帧,结果反映出该段视频中各个行人路过的大概过程。

图6 采用基于粒子群的方法提取出的视频关键帧

2.4 关键帧低层视觉特征描述

利用图像的低级物理特征(如颜色、纹理、运动等)的检索方法,不仅可以检索出一些视觉上相似的图像,甚至还包含一些语义相关的图像[7]。本文对关键帧图像采用如下描述:

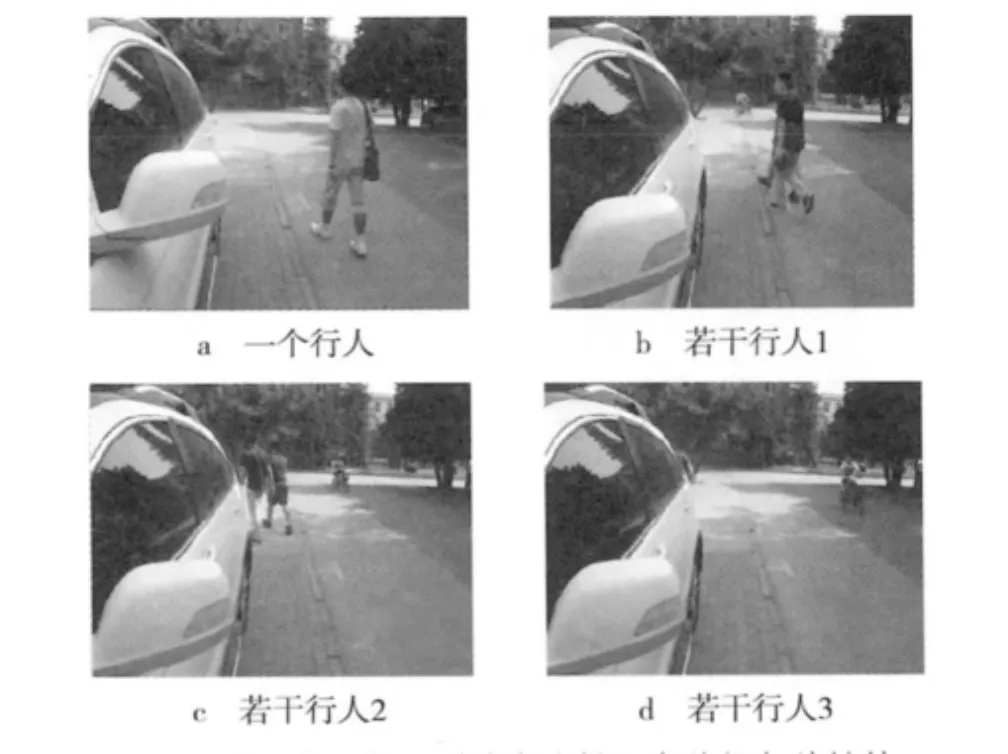

1)颜色。颜色为可见光的图像提供了有价值的自然属性。对于两个场景不同的视频关键帧,通常从图像主色以及颜色空间分布特性可以有效地区分开来。主导颜色向量Vic定义为HSV(Hue,Saturation,Value)空间Hue分量上的8个主导颜色值,第n个颜色直方图值Hn定义如为

式中:hx,y是像素点(x,y)的Hue 分量值;O(i)是分割得到的视频对象i。主导颜色向量Vic由M个主导颜色值[H0,H1,…,HM-1]组成。δ(hx,y)函数定义为

2)形状。相对于颜色或纹理等底层特征而言,形状信息是图像的中层特征。它可以刻画图像中物体和区域的重要特点。描述对象的形状包括轮廓和大小。视频场景中的视频尺寸与目标实际尺寸成一定比例关系。在本文中,矩形形状被设置为目标对象的尺寸大小,轮廓形状暂不考虑。

3)边缘直方图。它描述了边缘的空间分布信息,而边缘的空间分布是重要的纹理信息。尤其当图像中的纹理分布不一致时,该描述可用于图像间的匹配。首先将图像划分为16个互不重叠的矩形区域,对每个图像区域分别按角度0°,45°,90°,135°等4 个方向和一个无方向性边缘五类信息进行直方图统计。此描述子具有尺度不变性,支持纹理旋转和旋转不变匹配,适用于非一致纹理图像。

3 实验结果与分析

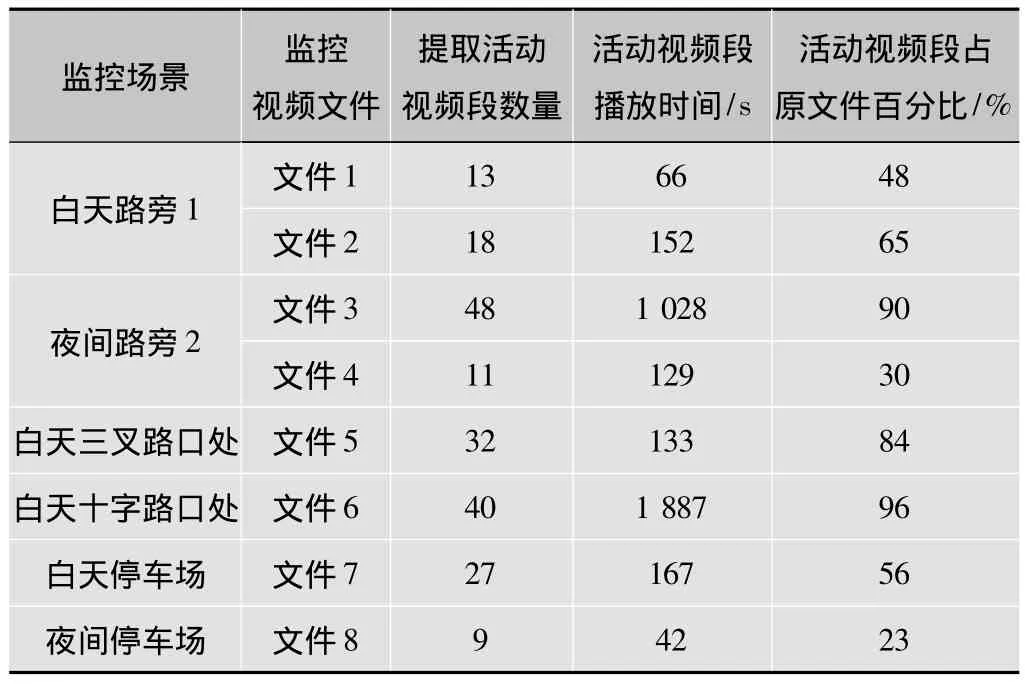

本文以 Microsoft Windows XP Professional,VC++6.0为实验开发平台。实验中,采用主动检索方式。为了验证方法的有效性,选取了不同停车场景、不同时间段视频,视频序列从几十帧到几万帧不等。实验结果如表1所示,其中“活动”视频段占原文件的平均百分比是61.5%。即使用主动检索后平均减少了38.5%的视频帧浏览数量。

表1 实验数据结果

图7和图8为快速视频检索方法实现的演示图。图7上边一行图像为原视频帧,下边一行是用户所能浏览到的只包含运动目标的“活动”视频帧。图8是通过左边用户输入的示例图片所提供的信息检索到的与其相似度最大的视频关键帧,点击“播放”按钮,即可从该帧处播放视频。

4 小结

本文设计的车载监控视频快速检索方法通过两种视频检索方式满足用户不同需求。一方面,利用运动目标检测的方法分割原视频,把只含“活动”视频片段信息与视频原文件关联,然后将这些视频片段按时间顺序组织起来,构成一个逻辑视频文件,并实现对该逻辑视频文件进行常规的播放控制功能,同时还可以在“活动”视频片段和原视频文件间平滑切换播放控制,从而减少了需要观看的视频帧数量,让用户集中精力在含有运动物体的重要画面上,实现了自动检索。另一方面,用户若想更加主动、直接地的找到感兴趣的视频片段,可利用提取出的关键帧及其特征,通过与示例图片的特征对比,定位到相似度最高的关键帧处,以此关键帧为起始点浏览视频片段。通过实验证明该方法充分减少了视频浏览的时间,提高了视频浏览的效率,实现对特殊车辆和运输物品实时安全监控。

[1]魏维,游静,刘凤玉,等.语义视频检索综述[J].计算机科学,2006,33(2):1-7.

[2]XIONG Ziyou,TIAN Qi,RUI Yong,et al.Semantic retrieval of video-review of research on video retrieval in meeting,movies and broadcast news,and sports[J].IEEE Signal Processing Magazine,2006,23(2):18-27.

[3]HARITAOGLU I,HARWOOD D,DAVIS L S.W4:Real-time surveillance of people and their activities[J].IEEE Transactions on Pattern A-nalysis and Machine Intelligence,2000,22(8):809-830.

[4]杨勇,王桥,吴乐南.基于标号场的光流法二维运动估计[J].电子与信息学报,2001,23(12):1321-1325.

[5]徐理东,林行刚.视频抖动矫正中全局运动参数的估计[J].清华大学学报:自然科学版,2007,47(1):92-95.

[6]张建明,蒋兴杰,李广翠,等.基于粒子群的关键帧提取算法[J].计算机应用,2011,31(2):358-361.

[7]孙君顶,赵珊.图像低层特征提取与检索技术[M].北京:电子工业出版社,2009.