违章车辆快速检测方法研究

——基于鲁棒颜色差分直方图

2013-02-22陈思聪胡士强张晓宇

邹 震,陈思聪,胡士强,张晓宇

1.上海交通大学 航空航天学院,上海200240

2.加州大学伯克利分校 理学院 应用数学与经济学系,加利福尼亚州 伯克利4010

1 引言

在交通压力日益增长的今天,为保障大众市民出行的通畅,政府专门开辟了公交专用车道。但是有些社会车辆司机缺乏自觉性,经常违章占用公交车道,影响公交车的正常运行。尤其是在上下班高峰期,社会车辆拥堵严重,此时保证公交车辆的运行通畅更显得非常重要。针对违章占用公交车道的社会车辆,交管部门采取了许多措施对社会车辆进行违章抓拍,比如目前北京的做法是在公交车头部安装摄像机,对占用公交车道的社会车辆进行跟踪智能抓拍并录像取证,这种方法对社会车辆起到了很好的威慑作用。在其他一些城市则采用在路口附近架设固定监测探头,对公交车道进行持续监测,实时抓拍占道车辆。对于基于固定摄像头的违章车辆检测方法,已经开展了许多先期研究[1-2]。文献[3]是实现了基于背景差分法建立了智能交通监测系统;文献[4]则基于道路边界检测和车辆检测跟踪提出了视觉跟踪的交通监控方法;文献[5]基于红外摄像头,该方法能够抑制可见光不足或可见光变化强烈对系统的影响;文献[6]通过基于像素的在线向量支持回归动态调整阈值进行前景分割方法,提高抑制光线的变化;文献[7]针对交通监测摄像机拍摄的视频流提出了高斯混合模型和背景差分相结合的方法进行处理,实现了交通监测。但在实际应用系统中,由于早晚及阴晴天气引起的光线变化,这些方法都不能很好地实时更新背景或智能适应环境变化,导致检测算法的鲁棒性不强,为抑制光线变化而采用的算法实时性又不能满足要求,不能快速准确地实现违章车辆监测和抓拍。

本文利用城市路口对准公交专用车道的固定摄像头拍摄的实际视频,提出了一种鲁棒颜色差分直方图检测算法,实现了对违章占用公交车道的违章车辆快速监测和准确抓拍。

2 鲁棒颜色差分直方图前景提取方法

针对环境光线变化对检测的影响,参考文献[8]给出的鲁棒颜色差分直方图算法分割前景,通过给出的背景图像,前景可以通过计算输入图像与背景图像每个像素的颜色差分值来提取。如果每个像素的颜色差分值比设定阈值大,这个像素就会被认为是前景;反之,该像素就会被认为是背景。由于该阈值能够自适应地根据当前帧图像改变,因此该算法能够适应环境以及光线的变化。

2.1 背景模糊匹配

为了更快地将当前背景图像更新至与当前环境相适应的图像,采用背景模糊匹配方法选择与当前环境最接近的初始背景图像。具体方法如下:

(1)选择不同的天气条件,在视野中没有车辆时拍摄当前图像,建立静态背景图像库。

(2)程序开始获取第一帧图像,选取特定区域,与背景库中图像的同样区域进行比较。

(3)取差异最小的背景库中图像作为当前初始背景图像,参与检测。

2.2 改进的前景提取算法

颜色分割算法从颜色差分直方图中提取阈值,以适应环境和光照的影响。因为阈值的计算是根据输入图像和背景图像的颜色差分直方图实时地计算求得,每一帧的阈值由当前帧计算得出用于当前帧前景分割,而文献[8]中,当前帧的前景分割用的是上一帧计算得出的阈值,这与实际情况不符。它能根据环境和光照的变化自适应改变,所以该阈值的选取具有一定的鲁棒性。为了使分割的车辆更清晰,需要对分割的结果进行处理,包括去除阴影,填补和去噪等过程。最后,背景图像根据颜色的分割结果进行更新。

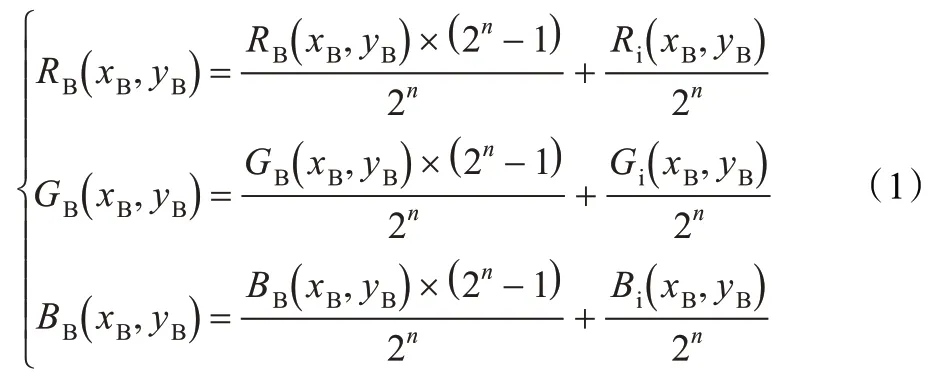

颜色差分直方图算法对光照变化的抑制具有一定的鲁棒性,该算法步骤如下:

(1)计算输入和背景图像在公交车道区域对应位置的颜色差分值ΔI。

(2)利用ΔI计算运动目标分割左右阈值。其中阈值设定理论表述为:在每一个颜色差分直方图中背景像素的分布类似于零均值的高斯分布,前景像素分布在零均值的两侧。文献[8]是从零均值开始往两侧遍历拐点,而本文是先找出峰值,再从峰值开始往两侧遍历高低阈值。这种方法更符合实际,因为在实际情况中峰值不一定落在零点。在峰值两边的第一个拐点分别定义为右阈值H和左阈值L。

(3)利用L,H和ΔI分割输入图像:

if (L≤ΔI≤H)

该像素是背景;

(1)干预前后评估两组关节活动度。(2)评估护理满意度,根据评分分为满意、基本满意与不满意,以满意与基本满意之和占比统计护理满意度。

根据式(1)背景更新;

else 该像素是前景;

其 中RB(x,y)、GB(x,y)、BB(x,y)分别是该背景图像像素红、绿、蓝三个通道的像素值,Ri(x,y)、Gi(x,y)、Bi(x,y)分别为该输入图像像素红、绿、蓝三个通道的像素值,n=3。

(4)定义图像Q为检测图像,其大小为M×N。先将其中所有像素都置为0,根据步骤(2)中得到的前景像素的坐标,将Q(xi,yi)置为1,即认为是前景。

(5)根据文献[9]的方法对Q去除阴影,定义:

若TH_S1≤Ra≤TH_S2,则Q(xB,yB) =0,即为背景。其中阈值参数TH_S1和TH_S2分别设为0.98 和1.6。

(6)根据文献[10]方法对图像Q进行腐蚀膨胀。此时图像Q即为检测前景的结果图像。

图1 初始处理

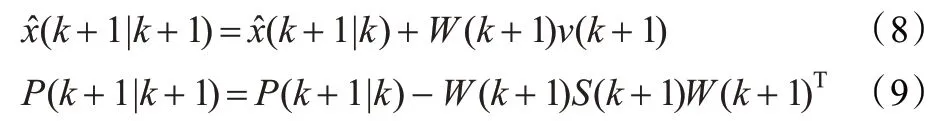

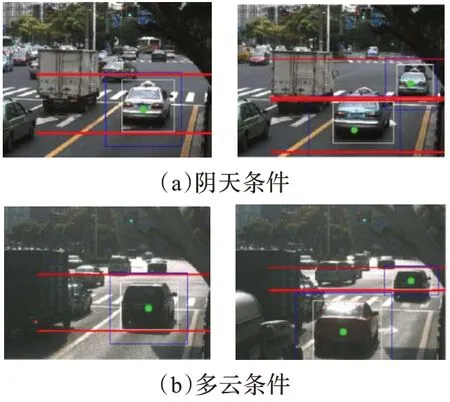

实验结果证明,基于鲁棒颜色差分直方图的方法能够实现不同光照条件下(早晨和傍晚、阴天和晴天等)车辆的鲁棒检测,为后续跟踪和判别车辆违章状态和抓拍提供了可靠的检测视频。

图2 阴天条件下检测结果

图3 多云条件下检测结果

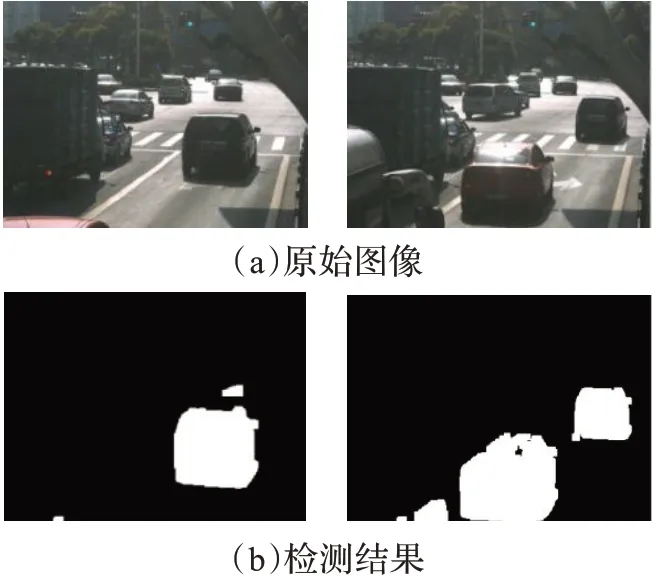

3 目标跟踪与违章判断

3.1 目标跟踪

根据目标检测的结果,在图像中框定前景团块,其大小为W×H,并且计算出其质心的坐标。通过卡尔曼滤波对其进行跟踪,预测目标在下一时刻出现的位置区域,其大小为1.4W×1.4H,在该区域内进行下一时刻的检测,以确认跟踪的是同一目标。

设车辆质心坐标为(xp,yp),车辆运动状态向量为。卡尔曼滤波采用匀速模型,状态转移矩阵为:

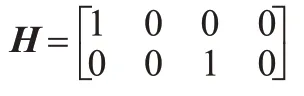

量测矩阵为:

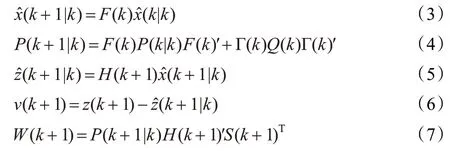

因为在实际系统中视频刷新周期为8 f/s,所以T=0.125 s 。初始状态X=[7 00 0 1 200 0]T,初始过程噪声协方差矩阵P( 0 |0 )与量测噪声协方差矩阵R 均为4×4单位矩阵。根据卡尔曼滤波基本方程:

得到预测状态X=x(k+1|k+1),即可得到车辆质心坐标的预测值。

图4 不同天气条件下跟踪结果

3.2 违章判断

在本十字路口,最右侧车道为公交专用车道。当社会车辆借用公交车道右转弯时,并不构成违章;但当社会车辆占用公交车道,越过十字路口中心线并且继续直行的,则视为违章车辆。因此,当车辆越过停车线时,需要对车辆进行持续检测与跟踪,依据划定的边界线判断其是右转弯还是直行。此时,将车辆越过停车线的图像保存在缓冲区作为第一张图片。若跟踪的车辆质心越过设定的边界线时,判断该目标是直行还是转弯,决定是否抓拍。如图在视野中划定车辆右转弯的界线横坐标为1 500,当xp≥1 500 时,认为车辆右转弯,释放缓冲区中保存的图像;划定车辆直行的界线纵坐标为520,当yp≥520 时,则认为该车辆直行了,属于违章车辆,将此时的图像与缓冲区中的图像一起保存,该组图像即可作为违章的证据。

图5 违章判断流程图

图6 直行(横)转弯(竖)边界线

图7 违章证据

4 程序实现与实验结果分析

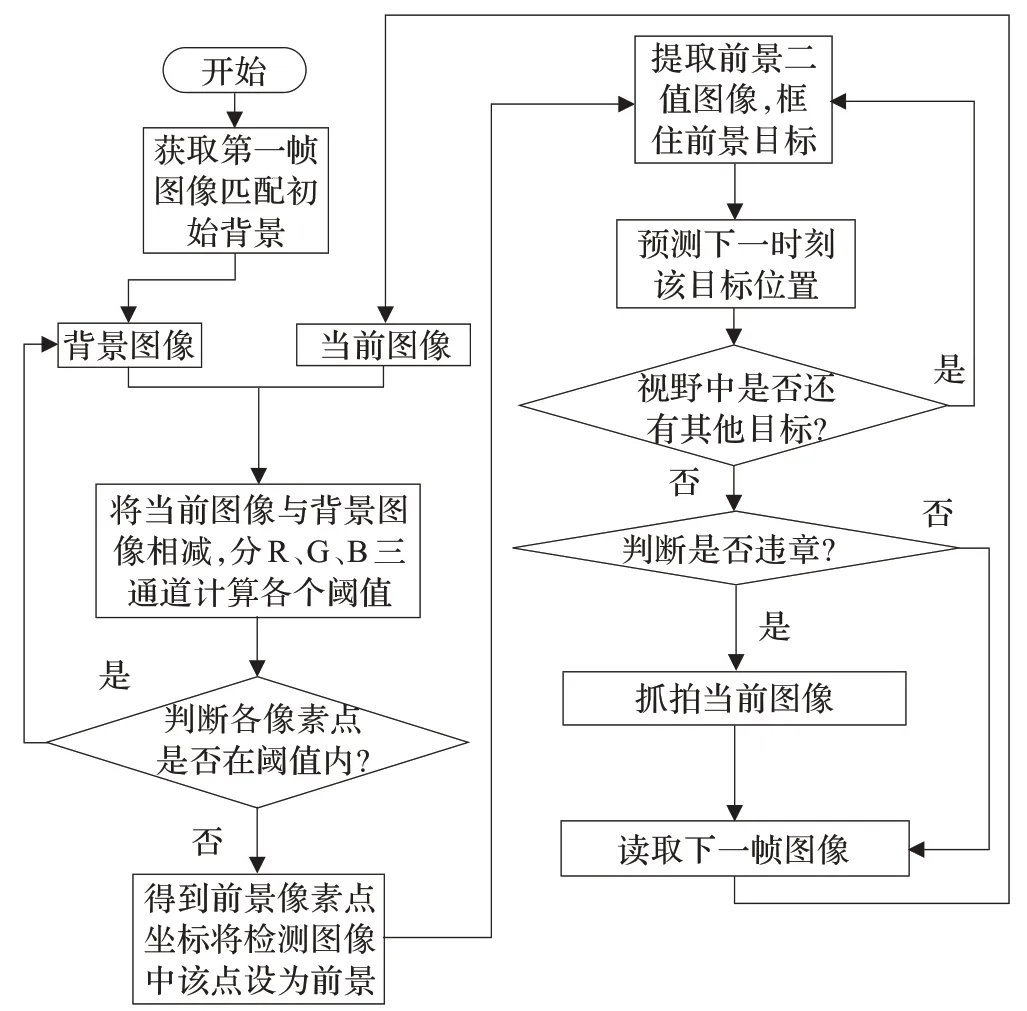

系统主程序采用Visual Studio 2008 编译环境,MFC和OpenCV2.0 库函数编写[11]。为了进一步加快运算速度,处理时将原图分辨率从1 600×1 200 缩放至320×240,而抓拍时为了保证图像清晰度,仍然保存1 600×1 200 的高清晰图像。摄像头型号为CY-DC2035J,读取速率为8 f/s,图8为系统主程序运行流程图。

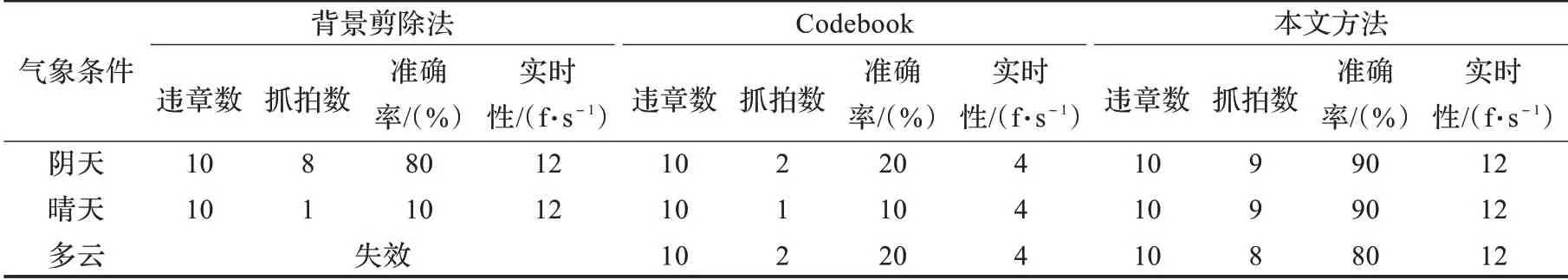

表1 不同方法现场处理结果比较

表2 不同方法处理同一段视频结果比较

图8 系统流程图

为了验证本文提出算法的有效性,利用同一路口监测场景,分别在光照变化不明显的阴天、光照变化相对稳定的晴天和光照变化剧烈的多云天气进行违章车辆抓拍实验,记录实际违章车辆数和程序抓拍车辆数,采用平均背景分割法、Codebook 法与本文方法作为比较,在一个绿灯周期内对违章车辆进行检测抓拍。得到的对比结果如表1所示。

表1 中每个条件下的4 个数据分别为:实际违章车辆数,抓拍车辆数,准确率和处理速率。通过分析表中数据可以看出,Codebook方法处理速度有限,每秒只能处理4帧,导致在不同环境下违章辨别准确率不足20%。而背景剪除法在光照变化不明显的环境下能够满足要求,但是环境发生变化后就会失效崩溃,其处理速度由于算法简单而能够满足8 f/s 的要求。本文提出的鲁棒颜色差分直方图方法能够实时处理摄像头读取的图像,满足摄像头读取速率,并且在环境变化时违章辨别准确率均能保证在80%以上。表2 中列出了对三种不同天气环境下同一段视频的处理结果,通过实验数据可以看出,当播放速率达到12 f/s 时,本文方法依然能够跟上播放速率,处理速率也能达到12 f/s,并且能够保证准确率在80%以上,而背景剪除法不能适应环境变化,Codebook 方法不能满足实时性要求。以上实验结果证明在不同的场景和天气条件下,该方法能够保证准确性和实时性,是一种可应用于实际系统的快速检测方法。

5 结语

针对交通监测中对违章车辆辨别不能满足鲁棒性和实时性的要求,本文采用鲁棒颜色差分直方图方法抑制环境变化,分割前景和背景,准确分辨违章车辆。采用设定感兴趣区域ROI 和图像缩放提高处理速度,精确跟踪公交车道上的车辆,区分和记录违章车辆。本文方法特点如下:(1)采用背景图像模糊匹配,对初始背景图像进行筛选,以便更快将背景更新至适应当前环境。(2)对颜色差分直方图阈值自适应算法进行改进,当前帧阈值用于分割当前帧前景,改善检测效果。(3)采用划定感兴趣区域和图像缩放,加快运算速度。实验结果表明该方法可靠有效,并且满足实时性要求,目前该系统已应用于路口违章车辆实时检测系统中。

[1] 王为,姚明海.基于计算机视觉的智能交通监控系统[J].浙江工业大学学报,2010,38(5):574-579.

[2] 冯军,金立.基于视觉跟踪的交通监控[J].电脑知识与技术,2010,6(24):62-67.

[3] 白立岗,贾冬冬.红外摄像机在交通监控系统中的应用[J].中国交通信息产业,2009,11(11):89-90.

[4] 高韬,刘正光,岳士宏,等.用于智能交通的运动车辆跟踪算法[J].中国公路学报,2010,23(3):89-94.

[5] 陈功,杨奎元,周荷琴,等.鲁棒的实时多车辆检测与跟踪系统设计[J].信号处理,2009,25(4):607-612.

[6] Wang Junxian,Bebis G,Miller R.Robust video-based surveillance by integrating target detection with tracking[C]//Proceedings of the 2006 Conference on Computer Vision and Pattern Recognition Workshop(CVPRW’06),2006.

[7] Kun A J.Traffic monitoring with computer vision[C]//7th International Symposium on Date of Conference on Applied Machine Intelligence and Informatics,2009.

[8] Chiu Chung-Cheng,Ku Min-Yu,Liang Li-Wey.A robust object segmentation system using a probability-based background extraction algorithm[J].IEEE Transactions on Circuits and Systems for Video Technology,2010,4(20):68-76.

[9] Bevilacqua A.Effective shadow detection in traffic monitoring applications[J].WSCG,2004,1(11):57-64.

[10] Wahl F M,Wong K Y,Casey R G.Block segmentation and text extraction in mixed text/image documents[J].Computer Graphics Image Process,1982,20(4):375-390.

[11] Bradski G,Kaehler A.Learning OpenCV[M].[S.l.]:Newgen Publishing,2008:68-108.

[12] Salvador E.Cast shadow segmentation using invariant color features[J].Computer Vision and Image Understanding,2004,2(6):238-259.