一种基于虚拟实景空间的测量与定位方法

2012-09-28段瑞青刘晓平

段瑞青, 余 烨, 刘晓平

(合肥工业大学 计算机与信息学院,安徽 合肥 230009)

在交通设施管理、车辆智能导航等领域中交通元素采集必不可少。目前社会建设快、交通元素多、更新快,研究快速准确的交通元素采集是一个重要课题。其中,针对交通元素的测量与定位需求,传统的人工测绘方法效率低、成本高,不能满足实际需要,而基于航空、卫星图像的方法则受图像精确度的影响,更加不切实际。虚拟实景空间[1-3]是以实景图像为基础,包含空间位置信息的虚拟空间,具有数据采集方便、图像精确度高、信息量丰富等优点。因此,如果能基于虚拟实景空间进行测量与定位将会很方便和直观。

基于虚拟实景空间的测量与定位工作采用的是单目视觉技术[4-6]。单目视觉技术是指仅利用单个相机拍摄的单张图像来进行相关工作,具有结构简单、操作方便等特点。文献[7]提出了基于摄像机标定的测距方法,通过车载相机拍摄图像以测量其距离和高度;文献[8]在对车道内的前方车辆快速检测和对摄像机预先标定的基础上,仅利用摄像机内部参数和透视投影几何关系,就可计算前方车辆距离;文献[9]提出了一种基于单目视觉的公路分道线二维重建算法和距离测量算法,测距算法的准确度能满足安全行车防止碰撞的需要,但测距算法是基于分道线几何约束的;文献[10]提出了基于几何关系推导法的单目视觉实时测距方法,利用边界平行约束条件和像摄影方程进行被摄物体与摄像机间的空间几何关系推导,实现了像机到拍摄目标间的距离估算。上述文献所用的设备都是普通的相机或摄像机,只能拍摄单视角图像用于测量或定位操作,而本文所用的设备是全景采集设备,拍摄得到的全景图像用于构造虚拟实景空间。此外,直接基于虚拟实景空间的测量与定位方面的研究很少,因此研究基于虚拟实景空间的测量与定位方法具有重要的实际应用价值。

鉴于虚拟实景空间的应用可以增强测量与定位操作的直观性和方便性,本文提出了基于虚拟实景空间的测量与定位方法。利用坐标转换将二维屏幕坐标转换成单幅图像坐标,再根据单目视觉中的摄像机模型原理,实现3种情况下的边长测量;根据前后位置得到相机的前进方向,再确定摄像机坐标系,根据摄像机坐标系坐标经计算获得目标的经纬度值,实现目标的定位。

1 坐标转换

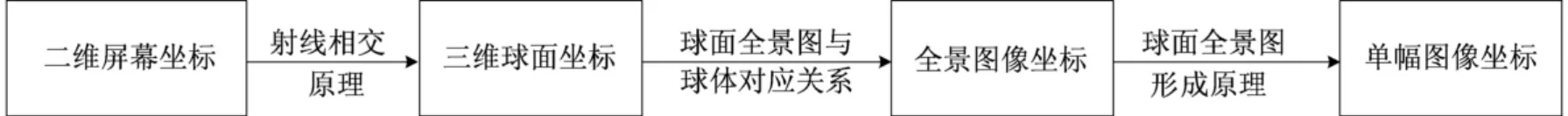

在虚拟实景空间中,对感兴趣物体进行测量与定位操作时,需要进行一系列的坐标转换。因为全景采集设备拍摄的全景图是由6个镜头的单幅图像合成的,且本文工作是基于单目视觉原理,故后续计算需要的是单幅图像坐标。由于二维屏幕坐标是用户交互中直接接触的坐标格式,而单幅图像坐标是在后续计算中应用到的坐标格式,因此,需要实现这2种坐标之间的转换。转化过程如图1所示。

首先利用计算机图形学中的射线相交原理将二维屏幕坐标转换为三维球面坐标,然后根据球面全景图与球体的对应关系将三维球面坐标转换为全景图像坐标,再根据球面全景图的形成原理将全景图像坐标转化为单幅图像坐标。

图1 坐标的转换过程

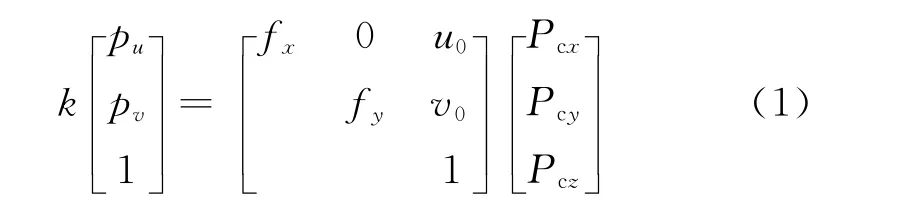

2 摄像机模型

空间任意一点在图像上的成像位置可以用针孔模型近似表示(不考虑摄像机的畸变),即空间任意点P在图像上的投影位置p,为光心O与P点的连线OP与图像平面的交点,这种关系也称为透视投影。摄像机成像相当于2个过程的叠加:

(1)将世界坐标系转换到摄像机坐标系;

(2)将摄像机坐标系投影到成像平面坐标系。

其中第1个过程涉及摄像机的外参数(旋转、平移),第2个过程由摄像机内参数(焦距、主点、畸变因子)来决定。因为本文的测量与定位采用的世界坐标系与摄像机坐标系重合(本文中所说的坐标均指摄像机坐标系下的坐标),故忽略第1个过程涉及的摄像机外参数。

在摄像机坐标系下,成像原理如图2所示,设点P 的坐标为(Pcx,Pcy,Pcz)T,图像上投影点p的图像坐标系坐标为(pu,pv)T,则根据针孔模型可以得到:

其中,k为比例因子;fx=f/dx,fy=f/dy,dx、dy为图像x和y轴方向上单位像素的长度。

图2 摄像机成像原理

3 边长测量

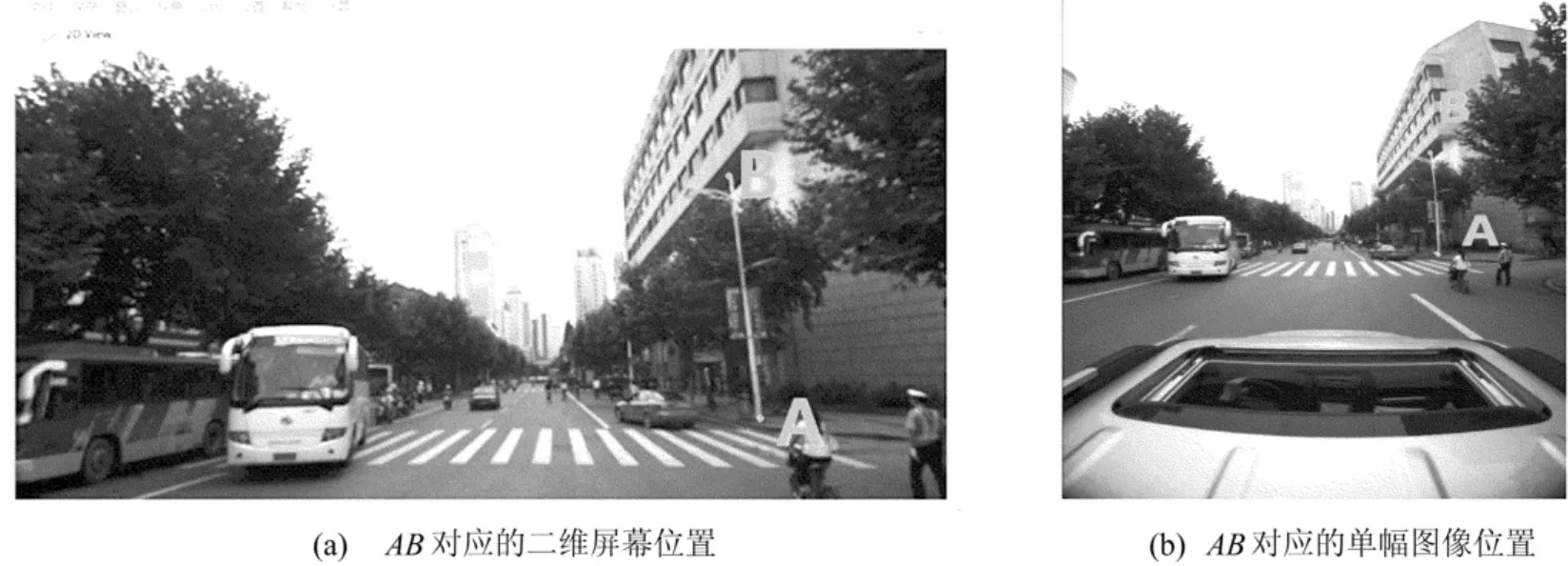

用户在虚拟实景空间中进行漫游时,为测量感兴趣物体的长度,首先根据上述提到的坐标转换得到该边2个端点的单幅图像坐标,如图3所示,其中,图3a、图3b分别是路灯两端A、B在虚拟实景漫游软件中的屏幕位置以及实际对应的单幅图像位置,坐标转换后得到A、B2个端点的单幅图像坐标,设为A(u1,v1)和 B(u2,v2)。

图3 AB对应的二维屏幕位置和单幅图像位置

假设摄像机坐标系下的YOZ平面与地面平行,则地面上任意点的Xc轴坐标都是一个固定值,其大小为摄像机中心到地面的高度值h,为已知值。全景采集设备的焦距f和主点的坐标(u0,v0)由全景采集设备开发包提供。在进行任意边的长度测量时,存在如下3种情况:

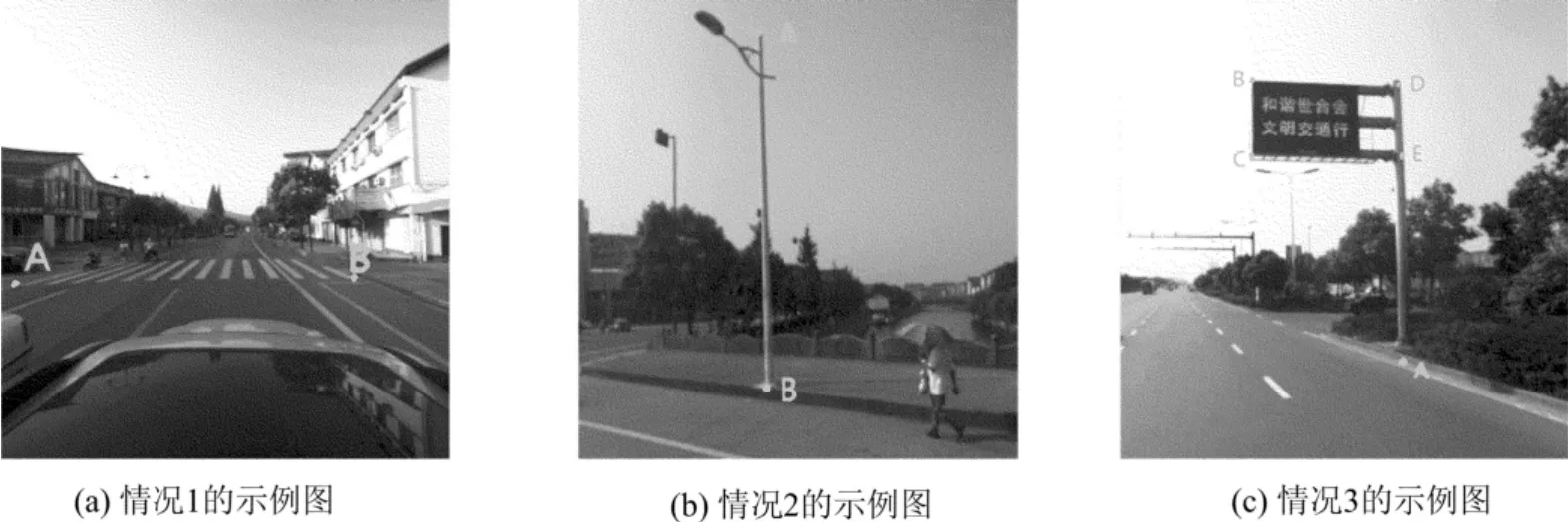

(1)边的2个端点均在地面上,如图4a中的AB线段。

(2)边与地面垂直,且一个端点在地面上,如图4b中的AB线段。

(3)边的2个端点均不在地面上,如图4c中的BC线段。

图4 实际应用中需测量的3种边

针对以上3种情况,计算方法如下:

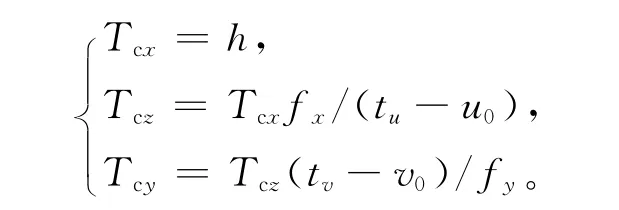

情况1:假设地面上一点T,其坐标为(Tcx,Tcy,Tcz),其中Tcx=h。它所对应单幅图像点t的坐标为(tu,tv),可利用坐标转换步骤得到。由(1)式可得:

从而计算出点T 的坐标(Tcx,Tcy,Tcz)。同理求得A、B2点的坐标,得到边AB的长度。

情况2:对于垂直于地面的边上点,如图4b中的点A、B,其中A点对应的单幅图像点为a(au,av)。利用情况1的方法求得点B的坐标(Bcx,Bcy,Bcz)。边 AB 垂直于地面,即边 AB 平行于摄像机坐标系的Xc轴,因此A、B点的Yc、Zc轴坐标是相同的,结合(1)式,可得:

由此可得到点A的坐标,所以边AB的长度也就可以求出了。

情况3:对于2个端点都不在地面上的边,根据平行或垂直等限制条件,并结合情况1和情况2的方法测量边的长度。以图4c中的BC线段为例,根据情况1和情况2的方法可以得到点A、D、E的坐标。由于BD、CE都平行于地面,B、D 点的Yc、Zc轴坐标是相同的,C、E 点的Yc、Zc轴坐标也是相同的,再根据情况2的方法可求出B、C的Xc轴坐标,边BC的长度就可以得到。

4 目标定位

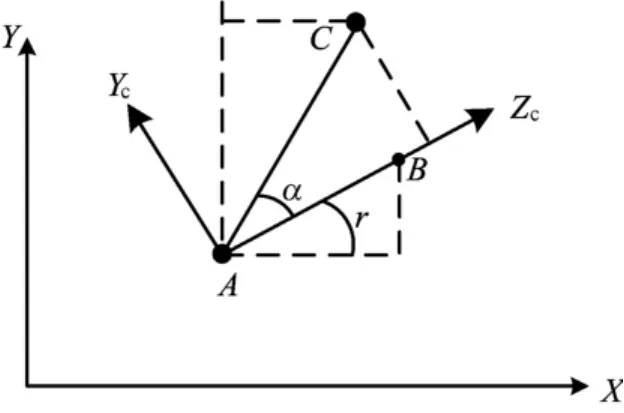

在用全景采集设备拍摄图像的同时,用GPS定位仪实时地记录拍摄每帧图像时相机光心所处的经纬度值。不妨设摄像机坐标系的Zc轴为摄像机的前进方向,假设摄像机从位置A运动至位置B,则A、B位置对应的经纬度值已知,且线段AB的方向即为Zc轴的正方向。因为摄像机坐标系的Xc轴方向始终垂直向下,因此可以确定Yc轴方向,如图5所示。将A、B位置对应的经纬度坐标转换为 UTM 坐标,即A(Ax,Ay)、B(Bx,By)。C点的摄像机坐标系坐标可由边长测量步骤得到,设为(Ccx,Ccy,Ccz),而待求的C 点UTM 坐标设为(Cx,Cy)。

图5 UTM坐标系下点的位置关系

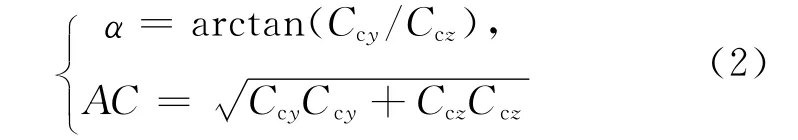

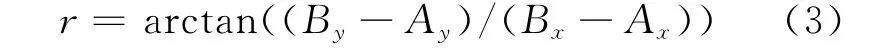

在摄像机坐标系下,已求得C点的坐标,α和AC的长度可由(2)式求解。

在UTM坐标系下,已知A和B的UTM坐标,r可由(3)式求解。

结合(2)式和(3)式可以求得C点的UTM坐标:

在得到C点的UTM坐标以后,把它转换为经纬度坐标,即求得C点的经纬度坐标,实现目标的定位。

5 实验结果

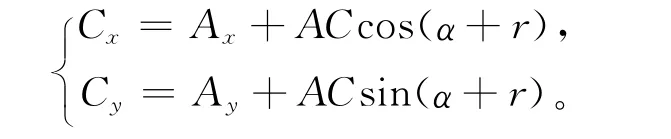

为验证测量方法的精确性,本文利用全景采集设备在50个不同的位置对包含了3种边长的同一场景进行拍摄,全景图像大小为2048*1024,单幅原始图像大小为808*616。实验结果见表1所列。

表1 测量实验的结果

由表1可以看出情况1的测量误差可以很好满足实际应用的要求,而情况2和情况3的误差相对较大。情况1存在误差的原因有以下几种:光心位于相机中心的假设理想化、焦距和主点坐标值不是精确值、地面平行于摄像机坐标系下YOZ平面的假设理想化。在情况2和情况3中,由于引入了线段平行性和垂直性的限制,因此它们的误差比情况1更大。

排除一些无法改变的因素,通过对实验结果的分析,发现如下几个提高测量精度的方法:① 测量误差随图像分辨率的提高而下降,尽量采用较高的图像分辨率;②被测量点在图像中心处的误差比周边的要小,这与相机镜头的畸变有关,主要是径向畸变,可以通过在摄像机模型中考虑径向畸变来提高测量的精度。

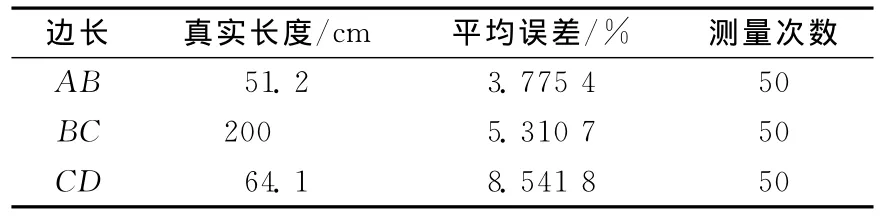

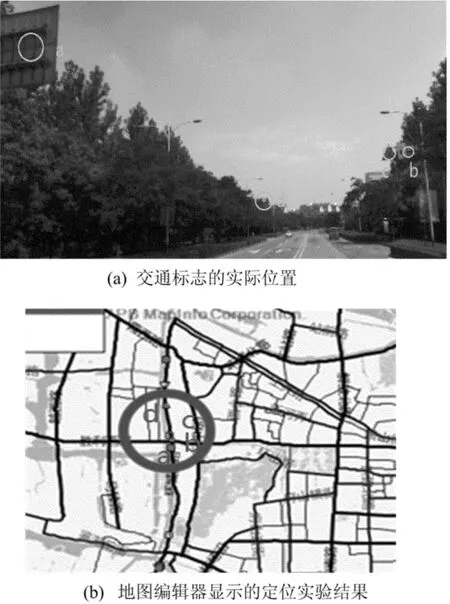

为验证定位方法的有效性,本文在某路上选择了4个位置连续的交通标志进行试验,4个交通标志从南到北依次记为a、b、c、d,其中b、c相距很近,c、d相距很远。实验结果和真实情况一致,如图6所示,可以证明定位方法的有效性。

图6 交通标志的实际位置与地图编辑器显示的定位实验结果

6 结束语

为了利用虚拟实景空间自身的强大表现力和易操作性,本文提出了在实景空间中进行边长测量和定位的相关方法。它涉及虚拟实景空间和计算机视觉中的单目视觉理论,主要解决了如何在三维虚拟实景空间中进行不同类型边长的测量,同时结合经纬度信息,解决目标的定位问题。从实验的结果来看,这些方法可以更方便、准确地测量物体的长度和对物体进行定位,能比较有效地解决交通设施管理等应用领域中的一些问题,具有一定的应用前景。

[1]Chen S.Quick Time VR:an image-based approach to virtual environment navigation[C]//Computer Graphics(ACM SIGGRAPH’95),August 1995:29-38.

[2]钟 力.虚拟实景空间的研究与实现[D].长沙:国防科技大学,1988.

[3]徐 玮,张茂军,吴玲达.虚拟实景空间的漫游机制及其实现方法[J].计算机工程与应用,2000,(12):5-7.

[4]高学海,徐科军,张 瀚,等.一种基于投影标靶的手眼相机标定方法[J].合肥工业大学学报:自然科学版,2008,31(9):1352-1357.

[5]祝世平,强锡富.用于摄像机定位的单目视觉方法研究[J].光学学报,2001,21(3):339-343.

[6]黄桂平,李广云,王宝丰,等.单目视觉测量技术研究[J].计量学报,2004,25(4):314-317.

[7]Bucher T.Measurement of distance and height in images based on easy attainable calibration parameters[C]//Proceedings of the IEEE Intelligent Vehicles Symposium,2000:314-319.

[8]王荣本,李 斌,储江伟,等.公路上基于车载单目机器视觉的前方车距测量方法研究[J].公路交通科技,2001,18(6):94-98.

[9]周 欣,黄席樾,黎 昱.基于单目视觉的高速公路车道保持与距离测量[J].中国图象图形学报,2003,8(5):590-595.

[10]郭 磊,徐友春,李克强,等.基于单目视觉的实时测距方法研究[J].中国图象图形学报,2006,11(1):74-81.