基于双尺度动态贝叶斯网络及多信息融合的步态识别

2012-09-19薛定宇

杨 旗 薛定宇

①(沈阳理工大学机械工程学院 沈阳 110159)

②(东北大学信息科学与工程学院 沈阳 110819)

1 引言

作为远程生物特征认证技术,步态识别越来越受到人们的重视。近些年来对步态识别的研究大都是通过提取人行走的步态轮廓后进行识别,技术可分为两类;一是利用步态轮廓的静态信息,如Kim等人提出了基于主动轮廓模型及运动预测的步态识别[1]。二是采用提取轮廓的动态信息,这类研究的算法很多,如基于步态能量图像(GEI)和2维主成分分析的步态识别方法[2],基于主动能量图(AEI)及2维局部投影的方法进行识别[3],基于帧差能量图(FDEI)及隐马尔可夫模型(HMM)进行识别[4],基于双层的动态贝叶斯网络的步态识别[5]、基于手臂和腿部运动的步态识别[6]等。如上方法从步骤上大都是从建立步态的特征图像下手,利用步态的特征图像进行特征的提取识别,如基于特征匹配的方法[7],这些方法虽然表达了人体行走的步态动态信息,但是大都是把动态信息的总和叠加构成一个静态的图像作为识别的特征图像,很少考虑步态行走时的时序特性,即随着时间的推移,步态行走姿势及运动幅度的变化,而这些特征恰恰反映了一个人行走的独有特征,如步态行走时人体姿态,运动幅度等特性的节奏的变化,这些特征都是表现为时序特征。目前考虑时序特性的识别方法有基于动态贝叶斯网络的方法[5,8-13],但是大都是着眼于步态序列的大尺度信息,如构建步态能量图GEI等,缺乏对身体部位运动细节的考虑。

本文提出一种4层的双尺度多信息融合的动态贝叶斯网络(DBN),模型中每个时间片都为整体信息即大尺度信息和局部细节信息即小尺度信息的融合,而每层状态分别反映了步态的整体信息或局部细节信息,不同层状态之间反映了整体信息与局部细节信息之间的关系。此模型能很好地表达步态的时序特性,能有机的融合步态的整体信息及局部细节信息。

2 整体信息及局部细节信息相融合的DBN模型

步态行走是个周期性重复运动的过程,在一个步态循环内,人体的步态特征也是周期性变化的,如图1所示。步态特征在大尺度上可以由步态帧差图中的整体轮廓信息表达,如图2(a)为帧差图像,而细节的特征,如头部、肩部、腿部等细节部位的运动变化,更能反映步态的特征,可用图2(b)表达。对帧差图像来讲,根据选取时刻t不同及时间片t长度不同,可体现为在不同时刻人体的运动特征。如图1为一个步态循环的帧图像,提供了8帧图像,利用帧图像之间相减就可得到帧差图像,如图2(a)为帧差图像,图2(b)为从帧差图像2(a)提取的细节部位特征图像。

步态行走是个时序的过程,在 DBN模型中在单位时间片t内,包含有多种信息,不仅包含有由步态序列帧差图像表达人体行走时的外形轮廓的动态整体信息,如上图2(a),还包含有人体局部细节表达的动态局部细节信息,如用来表达人体行走时特有的肩膀晃动、头部摆动等行走时的节奏性信息,以及人体走动时腿部关节角度变化、步幅宽度变化、步幅轮廓变化等轮廓细节信息,如上图2(b)。如上的整体信息(大尺度)和局部信息(小尺度)相结合构建的数学模型如图3所示。

图1 穿外套一个步态周期的图像

图2 相邻的两幅步态帧差图像及身体各部位的细节图像

图3 动态贝叶斯网络模型

DBN模型含有 4个状态变量X1,X2,X3,X4及8个观测变量O1~O8,其中X1用来表达人体行走时步态的整体动态信息即大尺度信息,用帧差图来表达,如上图2(a)。X2,X3,X4用来表达步态帧差图的细节信息即小尺度信息,分别表示头部、躯干、腿部运动的信息,如上图2(b)。观测变量O1O2O3为帧差图像的步态幅度、步态速度、步态中心高度;O4O5O6为头部、躯干、腿部运动的幅度信息,O7O8为腿部关节角、步幅宽度信息。

2.1 模型分析

步态识别的DBN模型采用4层的状态来描述人行走时步态的整体信息及局部细节信息,而在每层中动态概率过程假设是马氏的(Markov),即未来时刻的概率只与当前时刻有关而与过去时刻无关:Xt依赖于Xt-1。由于步态行走是个时序的过程,反映的是随时刻t步态帧的姿态、幅度、轮廓以及节奏的变化;随时刻t变化的整体信息能很好地反映出人行走时的步态幅度、轮廓的变化,而随时刻t变化的身体部位细节信息能很好地表达人体行走时步态的节奏特征,在此基础上建立的模型能很好融合步态行走的不同尺度的信息。

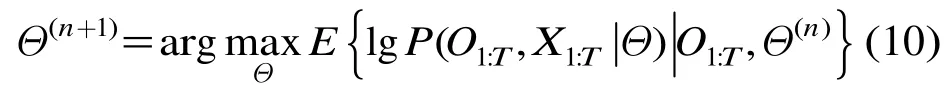

2.2模型推理与学习

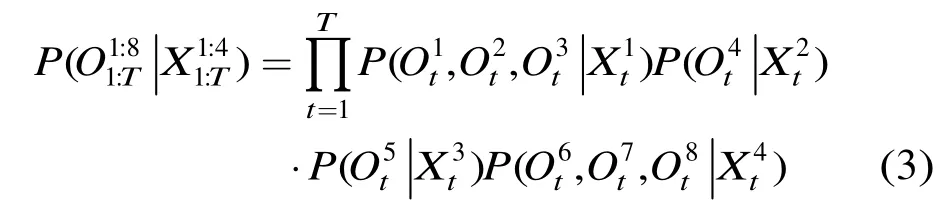

2.2.1 模型推理DBN是以概率网络为基础,把原来的静态网络结构与时间信息结合,形成具有处理时序数据的随机模型,从静态贝叶斯(BN)出发,导出DBN的概念及图形表达,进而描述[14]。推理DBN网络就是计算在给定观察序列O1:i=O1O2…Oi计算隐状态变量Xi的边缘概率,可通过计算所有节点的联合概率分布,然后再边缘化,进而计算所有节点的概率分布,双尺度多信息融合的DBN推理的全局联合概率分布为

在式(1)中,任一节点的联合概率分布为

其中条件概率分布为

表示第i个隐状态变量t时刻的取值,表示其父节点

2.2.2 模型参数表示与学习在模型中参数的更新公式及极大似然估计表示如下[15]:在时刻t=1,状态X1,X2,X3,X4的初始转换概率如式(5),式(6)所示。

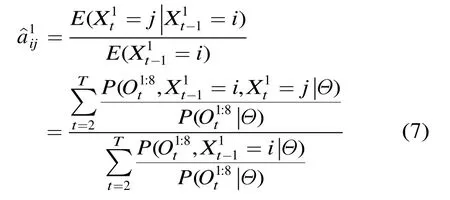

状态X1从状态i到状态j的转换概率如式(7)所示。

状态X2X3X4从状态k到状态h的转换概率如式(8)所示。

观测概率为

2.2.3 模型步态识别从使用模型的识别上来看,在识别过程中,基于 DBN网络识别实际上是一个推理迭代求解过程,如给定R个训练好的模型M1,…,MR,其中每个模型对应一个人的步态,通过测试,观测序列为O1:T,则由式(11)确定分类:

P(Mi)为模型Mi的先验概率,取为平均值1/R,设Mi模型参数为Θi,则,观测序列给定,则P(O1:T)=1 ,则式(11)可推导为

由式(12)确定分类,进而识别。

3 模型特征提取

根据人体步态行走的特点,步态行走时动态的信息可以反映出一个人的步态特征,而静态信息即帧图像信息受环境影响较大,在穿外套、背包情况下,帧图像轮廓变化较大,直接影响识别的结果,所以本文在步态特征选取上,选择帧差图像信息作为行走时的动态信息,帧差图像信息能很好反映步态行走时的时序特性,即随时间t变化人体各部位运动的幅度、姿态、步伐节奏等信息。在 DBN模型第1层中选取帧差图像的整体信息,第2,第3,第4层中选取的头部、躯干、腿部的帧差图像信息作为局部细节信息。根据人体标准比例,头部、躯干、腿部比例选择为0.182: 0.333: 0.485。

3.1 步态图像预处理

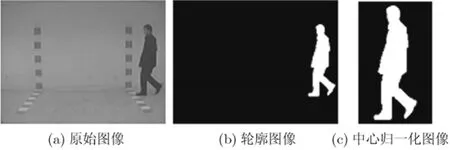

数据取自CASIA B步态数据库,数据库图像的原始尺寸大小为 320×240。采用90°的视角,首先对输入的步态图像序列进行背景减除、二值化、阴影消除及数学形态学等操作后,可以得到步态序列中每帧图像的单连通人体运动区域,即轮廓图像。再对原始数据进行中心化及归一化,处理后的图像尺寸为90×150,如图4所示。

图4 步态图像预处理

3.2 大尺度动态特征信息

在大尺度动态特征信息中,帧差步态轮廓中心坐标表示为(,)。对于t时刻帧差轮廓的大尺度信息为:(1)步态轮廓信息的中心高度;步态行走时是双臂、腿部、躯干交替的摆动过程,从90°视角来看,人体轮廓宽度是个周期变化的过程,从高度上看,人体行走时从脚尖到脚跟的着地过程,表现为人体身高的周期性变化,这里对于大尺度特征采用轮廓中心高度作为特征之一,轮廓中心点高度的坐标利用矩的统计特性来进行描述,,其中零阶矩,相当于图像中总的灰度值,一阶矩m10=除以零阶矩m00,表示区域内的灰度重心坐标,即轮廓中心坐标。其中(x,y)为图像的位置坐标,f(x,y)为图像在坐标(x,y)点的灰度值。如图5。(2)计算步态运动的幅度,在t时间片内的身体各个部位动态的变化,体现人体在行走时姿态、幅度等特征;计算中采用扇形区域法建立特征向量[13]。(3)步态在单位时间t内的运动速度,取步态帧差的前向帧差图像中白色区域的像素个数值作为步态的运动速度。

图5 关节角示意图

3.3 小尺度动态特征信息

小尺度的特征表现为步态局部细节信息的表达,即头部、躯干、腿部信息。特征取值如下:(1)步态运动的幅度,选取方法同大尺度的动态特征选取方法相同,建立表达运动幅度信息的特征向量,以像素点的转动惯量值作为特征向量的值,中心选为矩形框的中心点,如图2(b)的头部、躯干、腿部矩形区域的中心点。(2)腿部关节角度信息θ;图5所示为关节角示意图。(3)腿部的宽度值,即腿部最大的宽度的像素个数。

4 实验及结果分析

实验采用CASIA B步态数据库,Dataset B是中国科学院提供的一个大规模的,多视角的步态库,共有124个人,每个人有11个视角(0°,18°,3 6°,…,180°),在 3种行走条件下(普通条件,穿大衣,携带包裹条件)采集。本实验采用90°视角,在3种行走状态即普通、穿大衣、背包下试验。

4.1 本文模型识别结果

实验1 在步态识别DBN模型中,采用3种方式对模型进行训练和识别来研究环境对识别率的影响。方式 1:普通,穿大衣,背包的单一样本条件下对模型训练识别。方式 2:普通,穿大衣,背包条混合样本条件下对模型进行训练和识别。

表1 不同方式下的识别率

表中样本数为124人,其中普通条件下提供了每人6个视频序列,穿大衣条件下提供了2个视频序列,背包条件下提供了2个视频序列。在训练时取视频中的一个步态循环作为训练样本,通常一个视频中含有3个步态循环,(一个步态循环为从当次左腿或右腿迈出到下次左腿或右腿迈出所经历的步态序列,称为一个步态循环),这样大大增加了训练样本数。从实验结果可以看出,方式1的普通条件下识别率较高,方式2识别结果有一定幅度降低,说明在步态识别中,背包条件下,对模型的识别效果有影响。而在同样的数据库中采用帧差能量图及马尔可夫模型的方法[4]的识别率最高为91.1%,而采用利用动态部位变化的步态识别方法[13],文章中的识别率最高为 94.4%,但他采用的方法,不是把 3种状态的混合样本进行训练,而是分别对普通、穿大衣、背包的样本数据进行训练和识别。在文献[2]中,采用3种状态的混合样本进行训练的最高识别率为 85.5%,从识别结果可以看出本模型受背包、外套的影响最小。本文模型采用3种状态(普通,穿大衣,背包)独立的训练识别率如表2所示。

表2 相同方式下的识别率

可以看出本模型有较好的识别率。

4.2 不同方法的识别结果

实验 2 本论文的模型采用 4层的动态贝叶斯网络,可以充分表达人体行走时的步态整体特征及局部细节特征,即行走姿态、幅度等特性的大尺度及小尺度变化。模型中用X2,X3,X4分别表达头部、躯干、腿部运动的信息,用以说明人体运动的身体摆动的细节信息。如采用单层的动态贝叶斯网络,即嵌入式隐马尔可夫模型来表达步态的整体信息(大尺度信息)及局部细节信息(小尺度信息),实验结果如表3所示。

4层的动态贝叶斯网络识别效果更好。

表3 不同模型下的识别率

4.3 模型鲁棒性分析

在数据获取中,观测数据样本会出现噪声或者数据缺失的情况,实验在噪声或者数据缺失情况下对模型定量地分析了步态的识别结果。

数据中存在噪声的情况,噪声表示如下:()为t时刻人体的轮廓坐标,()为对应加噪声后的值,为满足标准正态分布的高斯噪声,表示对人体步态轮廓的污染。

从图6中可以看出,w≥3时,识别率下降迅速,但本文提出的动态贝叶斯网络模型识别结果明显优于其他模型。

图6 识别率-污染程度曲线图

对于数据缺失的情况,在一个周期步态序列内,随机抽取n帧图像,抽取的方式采用随机方式,抽取比例占整个周期步态帧图像的10%-90%。随机抽取图像作为数据缺失条件下,单步态循环的样本帧数越多,受样本数据缺失的影响越小,同时步态识别中,由于存在着大量的冗余帧信息,所以几乎所有模型都对数据缺失有较好鲁棒性,本文提出的方法,可关注双尺度的信息,并实现多信息融合,在数据缺失条件下鲁棒性更好。

5 结论

本文提出一种4层的双尺度多信息融合的动态贝叶斯网络(DBN),模型中每个时间片都为整体信息即大尺度信息和局部细节信息即小尺度信息的融合,而每层状态分别反映了步态的整体信息或局部细节信息,不同层状态之间反映了整体信息与局部细节信息之间的关系。此模型能很好地表达步态的时序特性,即步态行走时人体姿态,运动幅度等特性的节奏的变化,能有机地融合步态的整体信息及局部细节信息进行建模及识别。实验在 CASIA B数据库进行,实验表明,本文模型识别率高,并且可降低背包对步态识别的影响,模型在有噪声污染及数据缺失情况下,识别效果依然良好。

[1]Kim D and Paik J.Gait recognition using active shape model and motion prediction[J].IET Computer Vision,2010,4(1):25-36.

[2]王科俊,刘丽丽,贲晛烨.基于步态能量图像和2维主成分分析的步态识别方法[J].中国图象图形学报,2009,14(12):2503-2509.Wang K J,Liu L L,and Ben X Y.Gait recognition based on gait energy image and two dimensional principal component analysis[J].Journal of Image and Graphics,2009,14(12):2503-2509.

[3]Zhang E H,Zhao Y W,and Xiong W.Active energy image plus 2DLPP for gait recognition[J].Signal Processing,2010,90(7): 2295-2302.

[4]Chen C H.Frame difference energy image for gait recognition with incomplete silhouettes[J].Pattern Recognition Letters,2009,30(11): 977-984.

[5]Chen C H,Liang J M,and Zhu X C.Gait recognition based on improved dynamic Bayesian networks[J].Pattern Recognition,2011,44(4): 988-995.

[6]Tafazzoli F and Safabakhsh R.Model-based human gait recognition using leg and arm movements[J].Engineering Applications of Artificial Intelligence,2010,23(8): 1237-1246.

[7]赵永伟,张二虎,鲁继文.多特征和多视角信息融合的步态识别[J].中国图象图形学报,2009,14(3): 387-393.Zhao Y W,Zhang E H,and Lu J W.Gait recognition via multiple features and views information fusion[J].Journal of Image and Graphics,2009,14(3): 387-393.

[8]Suk H,Sin B K,and Lee S W.Hand gesture recognition based on dynamic Bayesian network framework[J].Pattern Recognition,2010,43(9): 3059-3072.

[9]Bae J and Tomizuka M.Gait phase analysis based on a Hidden Markov Model[J].Mechatronics,2011,21(6):961-970.

[10]Cheng M H,Ho M F,and Huang Chung-lin.Gait analysis for human identification through manifold learning and HMM[J].Pattern Recognition,2008,41(8): 2541-2553.

[11]Waleed H and Kasabov N.Reduced feature-set based parallel CHMM speech recognition systems[J].Information Sciences,2003,156(1/2): 21-38.

[12]张前进,徐素莉.基于嵌入式隐马尔可夫模型的步态识别[J].信息与控制,2010,39(1): 25-29.Zhang Q J and Xu S L.Gait recognition based on embedded hidden Markov model[J].Information and Control,2010,39(1): 25-29.

[13]张二虎,赵永伟.利用动态部位变化的步态识别[J].中国图象图形学报,2009,14(9): 1756-1763.Zhang E H and Zhao Y W.Gait recognition using variance of dynamic region[J].Journal of Image and Graphics,2009,14(9): 1756-1763.

[14]Yang G S,Lin Y Z,and Bhattacharya P.A driver fatigue recognition model based on information fusion and dynamic Bayesian network[J].Information Sciences,2010,180(10):1942-1954.

[15]Murphy K.Dynamic Bayesian network: representation,inference and learning[D].University of California,Berkeley,2002.