基于NSCT和伪Zernike矩的人脸识别*

2011-03-21刘晓山杜明辉曾春艳金连文

刘晓山 杜明辉 曾春艳 金连文

(华南理工大学电子与信息学院,广东广州510640)

人脸识别作为图像分析和图像理解的典型应用之一,已广泛应用于信息安全、法律实施、视频监控、智能卡、门禁系统等领域.人脸的特征表示与简约是人脸识别系统的关键,要求提取的特征能够很好地表示人脸,同时维数不能太高以便于计算机处理.早期的特征提取方法是基于人脸的几何特征(如鼻子的宽度和长度、嘴巴的位置、两眼的距离和下巴的形状等)进行识别.模板匹配[1-2]已广泛应用于人脸识别和检测中.但这些方法受表情、姿态的影响非常明显,提取的特征误差比较大,或者不能较好地区分不同类别的特征,识别率比较低.主成分分析(PCA)和线性判决分析(LDA)是基于表象的人脸识别技术中最基本的降维方法[3],已广泛应用于人脸识别系统中.人们在PCA和LDA基础上提出了很多相关的改进算法[4-5],大大提高了识别率.局部二值模式(LBP)[6]、弹性约束图匹配(EBGM)[7]、双树复小波变换(DTCWT)[8]、Contourlet变换[9]等人脸识别算法在人脸正面姿态光照不变的情况下具有较好的识别效果,但当姿态、光照或表情发生变化时,识别率明显下降.在实际的人脸识别应用中,获取的人脸图像往往都存在光照、姿态和大小的变化,这些变化都会影响算法的识别效果.

文中在Lambertian光照模型[10]的基础上,将人脸图像看作是光照分量和反射分量的乘积,充分利用非下采样Contourlet变换(NSCT)[11]的多尺度、多方向和平移不变特性,使用阈值去噪方法提取出人脸光照不变成分,然后求出所对应的伪Zernike矩特征向量,最后进行人脸识别.

1 人脸光照模型

根据Lambertian光照模型[10],人脸灰度图像F可以表示成

式中,I(x,y)为光照亮度,R(x,y)为反射率.根据模型描述,R(x,y)被认为是人脸的光照不变成分.由于没有一个确定的反射率模型来表示R,因此求解式(1)是一个病态问题.一个通用的假设就是I变化缓慢,而R变化剧烈.变化剧烈的R属于图像的高频部分,类似于噪声.因此可以利用图像去噪的思想来获得光照不变成分R.对于乘性噪声,可以通过对数变换将其转换成加性噪声进行去噪.即

可以表示成

文中首先对图像F'进行NSCT分解,然后在NSCT变换域对其高频系数进行阈值收缩去噪滤除R',得到I',再利用式(3)可以得到光照不变成分R'的值.

2 NSCT提取光照不变成分

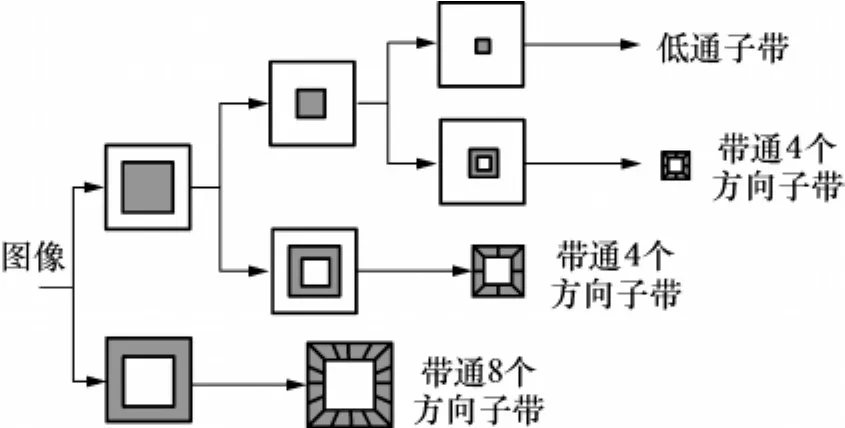

NSCT[11]是在Contourlet变换基础上发展而来的.Contourlet变换首先使用拉普拉斯金字塔(LP)对图像进行多尺度分解检测出奇异点,然后使用方向滤波器组(DFB)将分布在同方向上的奇异点合成为一个系数.由于在LP和DFB中都存在下采样操作,这就造成Contourlet变换不具有平移不变性,在奇异点附近存在伪吉布斯现象.在NSCT中,由于采用的是非下采样LP和非下采样DFB,避免了伪吉布斯现象,不但具有良好的方向选择性,而且还具有重要的平移不变性,非常适合自然图像的纹理描述.图1给出了NSCT的3层分解示意图.

图1 NSCT的3层分解示意图Fig.1 Schematic diagram of three-layer decomposition of NSCT

文中使用NSCT对人脸图像进行3层分解,每层(由粗到精)分解的方向数分别为4、4、8.分解后的系数可以表示成:{D0,C11,C12,C13,C14,C21,C22,C23,C24,C31,C32,…,C38},其中D0为分解后的低频系数,Csk为第s层第k方向的高频系数.由于NSCT采用了非下采样LP和非下采样DFB,所以分解后的系数跟原始图像的大小相同.

根据文献[12],阈值(Tsk)选择公式为

J为NSCT的分解层数(文中取J=3),Lsk为第s层第k方向的子带长度,λ为可调节的尺度参数,¯Csk为子带Csk系数的均值,M、N分别为子带Csk的行数和列数为Csk模的中值.高频系数软阈值收缩量化公式为

经过软阈值收缩去噪后,将低频系数D0和量化后的高频系数进行逆NSCT变换得到光照亮度I',最后利用式(3)可求出光照不变成分R'.

从式(4)、(6)和(8)可以知道,Tsk随λ的增加而减小,滤除的噪声也随之减少,得到的光照不变成分损失较严重.经过实验观察,当λ大于0.02时得到的光照不变成分能量太小,无法用于下一步实验,文中取λ=0.0005.图2所示为Extended YaleB库中编号为07的人在多个光照条件下的人脸图像所对应的I'和R'.从图2中可以看出,光照不变成分R'在4种不同的光照条件下变化不大,不受光照的影响.

图2 原始人脸图像及其光照不变成分和光照亮度成分Fig.2 Original face images and their illumination invariant components and illumination components

3 伪Zernike矩人脸特征向量

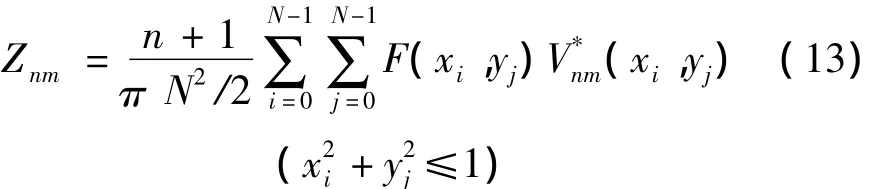

伪Zernike矩(PZM)[13]是图像函数F(x,y)在正交多项式Vnm(x,y)上的投影.n阶m重的PZM定义为

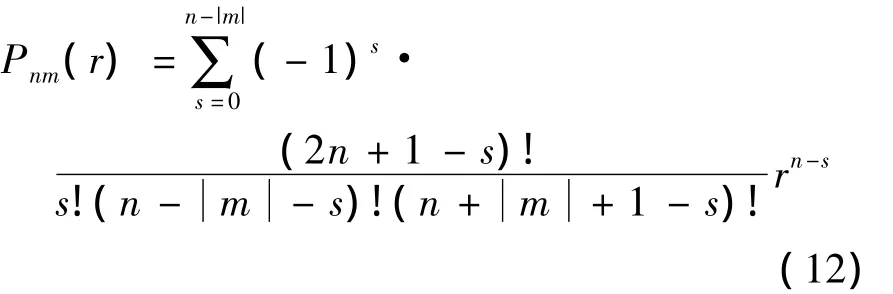

实值径向多项式Pnm(r)定义为

对于一幅数字图像,式(10)的积分用求和来代替,即

文中提出的基于NSCT和PZM的人脸识别算法步骤如下:

1)对人脸图像F进行对数操作得到新的数据矩阵F';

2)对F'进行3层多方向NSCT分解得到分解系数{D0,Csk};

3)根据式(4)-(7)求出各个高频子带的阈值,再利用式(8)、(9)对高频子带进行软阈值滤波操作,得到滤波后高频系数

5)求出每幅人脸R'的PZM特征序列,作为人脸的分类特征,并使用LDA进行降维处理;

6)使用欧式距离的最近邻分类器进行分类识别.

4 实验及结果分析

为验证文中算法的有效性,分别使用Extended YaleB人脸库[15]和CMU PIE人脸库[16]进行识别测试.Extended YaleB人脸库中共包含38人,每人含有在9种姿态、64种不同光照情况下的576幅图像.将姿态编号为P00、P02、P03、P05和水平光照编号为A+000、A+005、A-005、A+020、A-020、A+070、A-070的共88幅图像作为实验数据.CMU PIE人脸库包含68人的41638幅图像,这些图像分别处于不同的头部姿势、光照和表情.每人选取5个近似正面的姿态(C05、C07、C09、C27、C29)下光照编号为08、10、11和13的共20幅人脸图像.实验时采用手工裁剪的方法去掉图像中的头发和背景,仅保留人脸的面部区域,并缩放成100×100大小.同时为了比较算法的优越性,将文中算法同几种常用的人脸识别算法(Eigenface、LBP、Contourlet、DTCWT)进行比较,其中LBP采用3×3分块的均衡二值模式;Contourlet变换参数与文中算法的NSCT参数相同;DTCWT采用文献[8]中的方法进行3层分解,提取高频复系数的振幅作为特征向量,并采用LDA进行降维.每次实验时训练样本都是随机抽取的,为了保证实验结果的稳定性,每次实验都重复20次,取所有正确识别率的平均值作为最终的识别率.

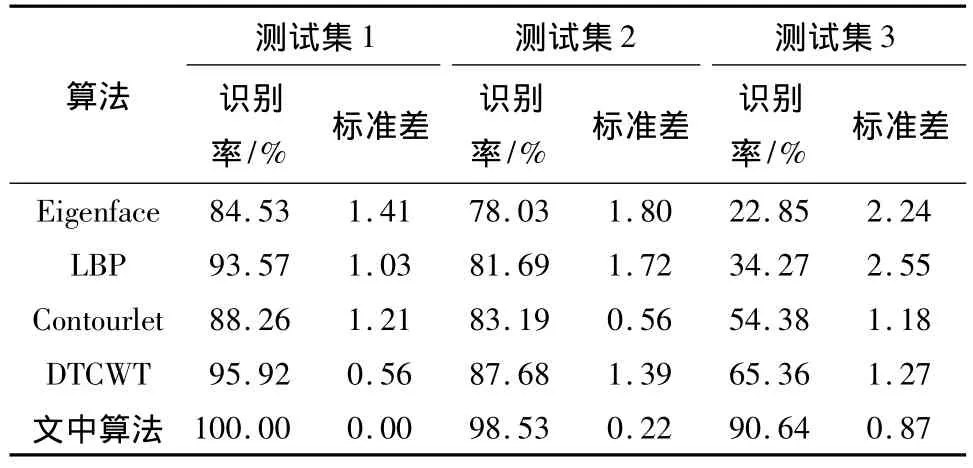

在Extended YaleB人脸库上进行实验时,从编号为A+000的人脸图像中任选3幅作为训练集.将编号为A+005和A-005的图像作为测试集1,编号为A+020和A-020的图像作为测试集2,编号为A+070和A-070的图像作为测试集3.表1给出了几种算法在3个测试集上的识别率.从表1中可以看出,文中提出的人脸识别算法在所有测试集上的识别率均最高,并且在光照很不理想的测试集上的识别率显著高于其它算法.同时,在使用LDA降维之前文中算法的分类特征维数为130,而DTCWT算法的特征为19764维,文中算法大大降低了特征的维数.

表1 几种算法在Extended YaleB库上的识别率Table 1 Recognition rates of several algorithms on Extended YaleB database

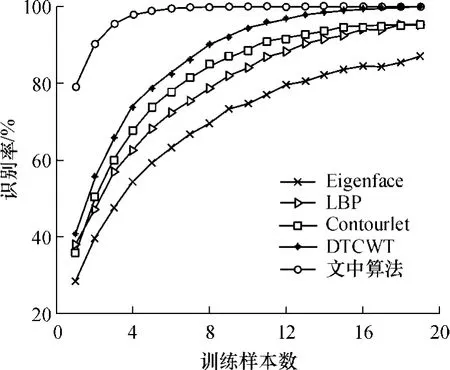

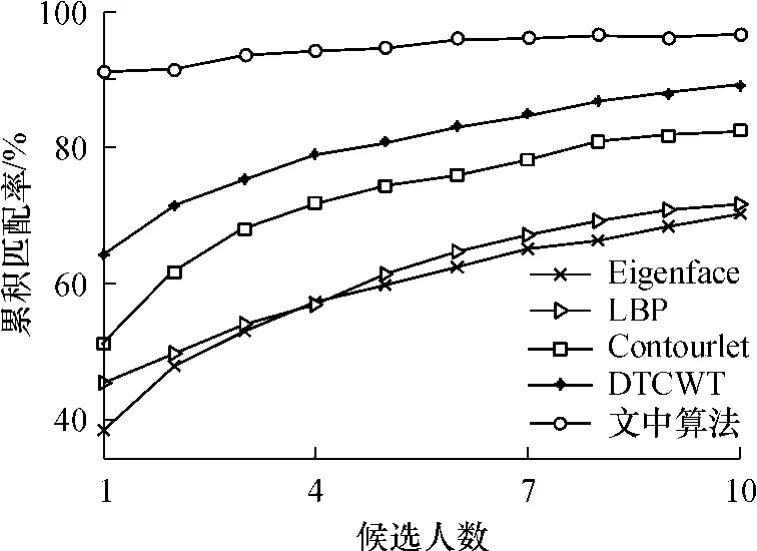

在CMU PIE人脸库中随机选取部分人脸作为训练样本,剩余人脸作为测试样本.图3给出了几种算法在CMU PIE人脸库上的识别性能曲线.从图3可以看出,随着训练样本数的增加,识别率稳步上升;与其它算法相比,文中算法的性能最优.图4给出了几种算法在CMU PIE人脸库上的累积匹配特性(CMC).实验中随机选取2幅人脸图像作为候选集.曲线描述排前n'位的累积匹配率,即正确识别结果在前n'个候选人中的比率.结果表明,与其它算法相比,文中算法能更好地应用于身份辨识.

图3 几种算法在CMU PIE库上的识别性能Fig.3 Recognition performances of several algorithms on CMU PIE database

图4 几种算法在CMU PIE库上的累积匹配特性曲线Fig.4 CMC curves of several algorithms on CMU PIE database

5 结语

文中在Lambertian光照模型的基础上提出了一种基于NSCT和伪Zernike矩的人脸识别算法.该算法利用了NSCT的多尺度、多方向特性和伪Zernike矩的旋转、尺度不变性,提取出来的人脸特征能够更好地表达人脸图像,同时也大大降低了分类特征的维数.实验结果表明:文中算法能够去除人脸大部分的光照影响,提取出来的人脸特征对光照有非常强的鲁棒性;并能改善由于手工裁剪人脸图像带来的人脸图像尺度不同和姿态微变引起的识别率下降问题.今后将对不同光照类型对识别率的影响进行研究,进一步提高算法对光照变化的鲁棒性.

[1]Miao J,Yin B C,Wang K Q,et al.A hierarchicalmultiscale and multiangle system for human face detection in a complex background using gravity-center template[J].Pattern Recognition,1999,32(7):1237-1248.

[2]马丽红,余英林,张宇.人脸特征提取及自动定位的研究[J].华南理工大学学报:自然科学版,2000,28(4):96-102.Ma Li-hong,Yu Ying-lin,Zhang Yu.A study on facial feature extraction and automatic location[J].Journal of South China University of Technology:Natural Science Edition,2000,28(4):96-102.

[3]Zhao W,Chellappa R,Phillips P J,et al.Face recognition:a literature survey[J].ACM Computing Surveys,2003,35(4):399-459.

[4]Xu Y,Zhang D,Yang J.A feature extraction method for use with bimodal biometrics[J].Pattern Recognition,2010,43(3):1106-1115.

[5]Eftekhari A,Forouzanfar M,Moghaddam H A,et al.Block-wise 2D kernel PCA/LDA for face recognition[J].Information Processing Letters,2010,110(17):761-766.

[6]Ahonen T,Hadid A,Pietikainen M.Face description with local binary patterns:application to face recognition[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2006,28(12):2037-2041.

[7]Wiskott L,Fellous JM,Kruger N,et al.Face recognition by elastic bunch graph matching[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1997,19(7):775-779.

[8]Liu C C,Dai D Q.Face recognition using dual-tree complex wavelet features[J].IEEE Transactions on Image Processing,2009,18(11):2593-2599.

[9]Lajevardi SM,Hussain ZM.Contourlet structural similarity for facial expression recognition[C]∥Proceedings of IEEE International Conference on Acoustics,Speech and Signal Processing.Dallas:IEEE,2010:1118-1121.

[10]Shan SG,Gao W,Cao B,et al.Illumination normalization for robust face recognition against varying lighting conditions[C]∥Proceedings of IEEE International Workshop on Analysis and Modeling of Faces and Gestures.Washington:IEEE,2003:157-164.

[11]Cunha A L,Zhou JP,Do M N.The nonsubsampled Contourlet transform:theory,design,and applications[J].IEEE Transactions on Image Processing,2006,15(10):3089-3101.

[12]Huang Liangliang,Wang Hongzhi,Zhu Bo.Adaptive thresholds algorithm of image denoising based on nonsubsampled Contourlet transform[C]∥Proceedings of IEEE International Conference on Computer Science and Software Engineering.Wuhan:IEEE,2008:209-212.

[13]Mukundan R,Ramakrishnan K R.Moment functions in image analysis:theory and applications[M].Singapore:World Scientific Publishing Company,1998:57-62.

[14]Pang Y H,Teoh A B J,Ngo DC L.A discriminantpseudo Zernikemoments in face recognition[J].Journal of Research and Practice in Information Technology,2006,38(2):197-211.

[15]Georghiades A S,Belhumeur P N,Kriegman D J.From few tomany:illumination cone models for face recognition under variable lighting and pose[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2001,23(6):643-660.

[16]Sim T,Baker S,Bsat M.The CMU pose,illumination,and expression(PIE)database automatic face and gesture recognition[C]∥Proceedings of the Fifth IEEE International Conference on Automatic Face and Gesture Recognition.Washington:IEEE,2002:46-51.